XTuner V1 - открытый движок Shanghai AI Lab для обучения больших моделей

Что такое XTuner V1?

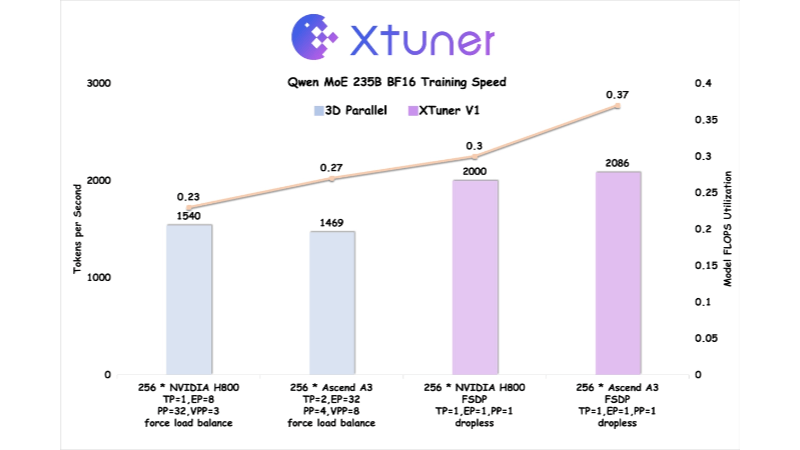

XTuner V1 - это новое поколение движка для обучения больших моделей с открытым исходным кодом Шанхайской лаборатории искусственного интеллекта, предназначенного для обучения сверхбольших разреженных моделей смешанных экспертов (MoE). Разработанный на основе PyTorch FSDP, XTuner V1 достигает высокой производительности обучения за счет многомерной оптимизации памяти, связи, нагрузки и т.д. XTuner V1 поддерживает обучение моделей MoE с 1 триллионом параметров и впервые превосходит традиционное параллельное 3D-решение по пропускной способности обучения на моделях масштаба более 200 миллиардов. Поддерживается обучение длинных последовательностей 64k без технологии параллелизма последовательностей, что значительно снижает зависимость от экспертного параллелизма и повышает эффективность обучения длинных последовательностей.

Особенности XTuner V1

- неразрушающее обучениеМодели MoE масштаба 200 миллиардов могут быть обучены без экспертного параллелизма, а модели 600 миллиардов требуют только внутриузлового экспертного параллелизма.

- Поддержка длинных последовательностей: Поддерживает обучение с длиной последовательности 64k для 200 миллиардов моделей MoE без параллелизма последовательностей.

- высокая эффективность: Поддержка обучения модели MoE с 1 триллионом параметров и пропускной способностью 200 миллиардов и более моделей по сравнению с традиционным 3D-параллелизмом.

- Оптимизация видеопамяти: Уменьшает скачки графической памяти благодаря автоматическому механизму Chunk Loss и технологии Async Checkpointing Swap.

- покрытие связи: Уменьшение затрат времени на связь благодаря оптимизации памяти и технологии Intra-Node Domino-EP.

- Балансировка нагрузки DP: Устранение проблемы вычислительного "пустого пузыря", вызванной вниманием переменной длины, и поддержание баланса нагрузки при параллельном измерении данных.

- Совместная оптимизация оборудования: Оптимизированный на суперузле Ascend A3 NPU в сотрудничестве с Huawei Rise, эффективность обучения превосходит NVIDIA H800.

- Поддержка открытого исходного кода и инструментальных цепочек: XTuner V1, DeepTrace и ClusterX с открытым исходным кодом, обеспечивающие полный спектр поддержки.

Основные преимущества XTuner V1

- Эффективное обучение: Поддерживает обучение моделей MoE с количеством параметров до 1 триллиона, при этом производительность обучения превосходит традиционные параллельные 3D-решения для моделей масштаба 200+ миллиардов.

- Обработка длинных последовательностейОбучение 200 миллиардов моделей MoE с длиной последовательности 64k без параллелизма последовательностей, что подходит для сценариев обработки длинных текстов, таких как обучение с подкреплением.

- низкая потребность в ресурсах200 миллиардов параметрических моделей не требуют экспертного параллелизма, а 600 миллиардов моделей требуют только внутриузлового экспертного параллелизма, что снижает требования к аппаратным ресурсам.

- Оптимизация видеопамятиНовейшее дополнение к системе - новая технология, которая значительно уменьшает скачки памяти за счет автоматической потери чанков и асинхронной замены контрольных точек, позволяя обучать более крупные модели.

- оптимизация коммуникаций: Уменьшение влияния коммуникационных накладных расходов на эффективность обучения путем маскировки затрат времени на коммуникацию с помощью оптимизации памяти и внутриузловых методов Domino-EP.

- балансировка нагрузки: Смягчение проблемы вычислительного "нулевого пузыря", вызванного вниманием переменной длины, обеспечение балансировки нагрузки при параллельном измерении данных и повышение эффективности обучения.

Что такое официальный сайт для XTuner V1

- Веб-сайт проекта:: https://xtuner.readthedocs.io/zh-cn/latest/

- Репозиторий GitHub:: https://github.com/InternLM/xtuner

Люди, для которых предназначен XTuner V1

- Исследователи крупных моделей: Для исследователей, которым необходимо обучать сверхбольшие по масштабу разреженные модели смешанной экспертизы (MoE), XTuner V1 предоставляет высокопроизводительный обучающий движок, поддерживающий обучение моделей с числом параметров до 1 триллиона.

- Инженер по глубокому обучениюДля инженеров, работающих над крупномасштабным распределенным обучением, XTuner V1 предоставляет оптимизированные функции связи и управления памятью, что значительно повышает эффективность обучения.

- Разработчики инфраструктуры искусственного интеллектаДля разработчиков, ориентированных на кооптимизацию аппаратного обеспечения и высокопроизводительные вычисления, XTuner V1 сотрудничает с командой Huawei по технологии Rise, обеспечивая глубокую оптимизацию аппаратного обеспечения.

- Участники сообщества с открытым исходным кодомОткрытый исходный код XTuner V1 предоставляет широкие возможности для развития и оптимизации для разработчиков, которые интересуются проектами с открытым исходным кодом и хотят внести свой вклад.

- Команда корпоративного искусственного интеллектаXTuner V1 обеспечивает простую в использовании и высокопроизводительную поддержку инструментальной цепочки для корпоративных команд, которым требуется эффективное низкопороговое решение для обучения больших моделей.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...