VITA: Мультимодальные модели большого языка с открытым исходным кодом для визуального и речевого взаимодействия в реальном времени

Общее введение

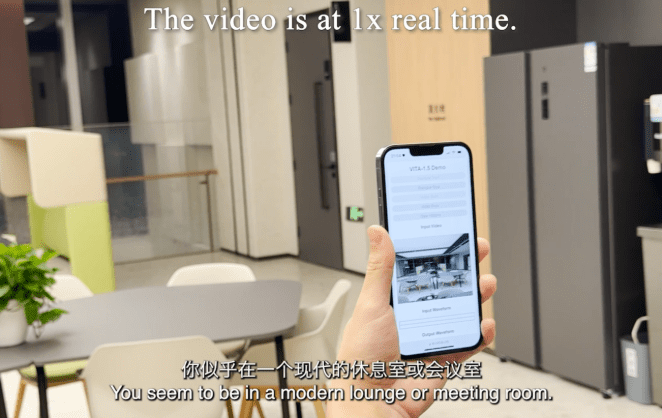

VITA - ведущий проект по интерактивному мультимодальному моделированию больших языков с открытым исходным кодом, который является пионером в достижении истинного полного мультимодального взаимодействия. Проект запустил VITA-1.0 в августе 2024 года, став пионером первой интерактивной мультимодальной модели большого языка с открытым исходным кодом, а в декабре 2024 года проект запустил крупную обновленную версию, VITA-1.5, которая значительно улучшает опыт взаимодействия и производительность. Модель VITA поддерживает мультимодальные входы и выходы, такие как изображение, видео и аудио, и оснащена возможностями взаимодействия в реальном времени, значительно сокращая время ожидания голосового взаимодействия от конца к концу с 4 секунд до 1,5 секунд. Модель VITA поддерживает мультимодальные входы и выходы, такие как изображение, видео и аудио, и оснащена возможностью взаимодействия в режиме реального времени, что значительно сокращает время ожидания голосового взаимодействия с 4 секунд до 1,5 секунд, значительно повышая удобство использования. Будучи полностью открытым проектом, VITA представляет собой идеальную платформу для исследователей и разработчиков для изучения мультимодального ИИ.

Список функций

- Мультимодальная обработка ввода: поддержка изображений, видео, аудио и других видов ввода

- Голосовое взаимодействие в режиме реального времени: задержка при сквозном голосовом взаимодействии составляет всего 1,5 секунды

- Возможности визуального анализа: мощные возможности восприятия и анализа изображений и видео.

- Обработка звука: поддержка распознавания и синтеза речи

- Кросс-модальное понимание: к интеллектуальной корреляции между текстом, изображением и аудио

- Поддержка с открытым исходным кодом: весь код обучения и вывода открыт

- Предварительно обученные модели: доступно несколько версий предварительно обученных моделей

- Гибкие возможности развертывания: поддержка развертывания на нескольких аппаратных платформах

Обзор VITA-1.5

12 августа 2024 года мы выпустили VITA-1.0Это Первая интерактивная мультимодальная модель макроязыка с открытым исходным кодом "все в одном. И сейчас (20 декабря 2024 года) мы представляем вам Новая версия VITA-1.5!

Что нового в VITA-1.5?

Мы рады представить VITA-1.5, в котором был представлен ряд достижений:

- Значительное сокращение времени ожидания взаимодействия.. Конечная задержка при голосовом взаимодействии увеличилась с Приблизительно 4 секунды Сокращение до 1,5 секундычто обеспечивает практически мгновенное взаимодействие и значительно повышает удобство использования.

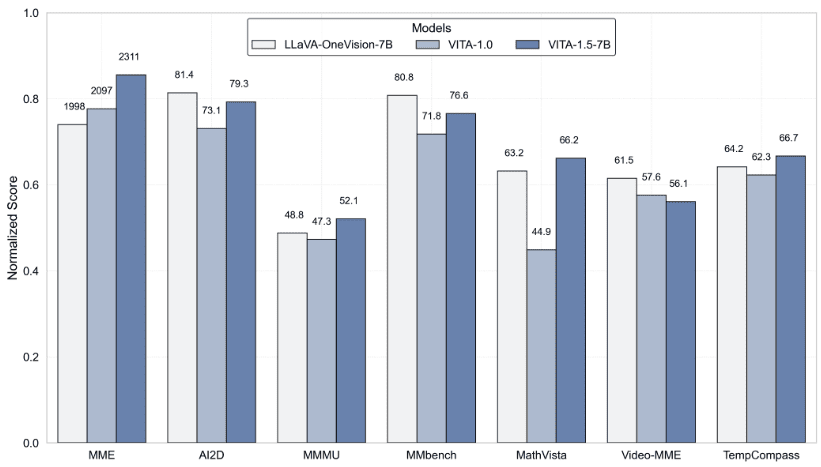

- Улучшенная мультимодальная производительность. В MME, иMMBench ответить пением MathVista Средние показатели в мультимодальных бенчмарках, таких как 59.8 поднять его до 70.8.

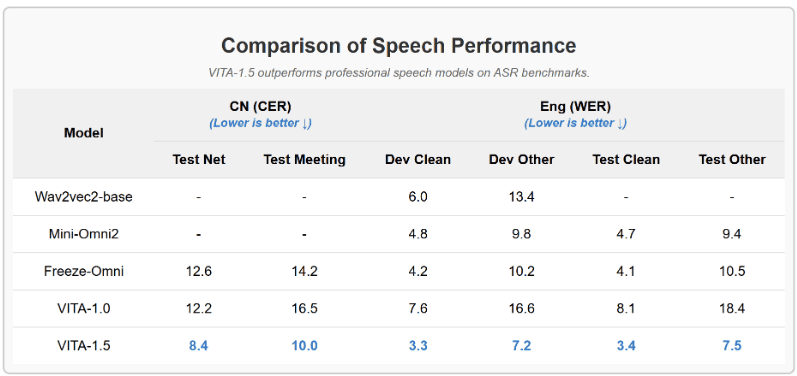

- Расширение возможностей обработки речи.. Был достигнут новый уровень мощности обработки речи: коэффициент ошибок в словах ASR WER (Word Error Rate, Test Other) вырос с 18.4 Уменьшить до 7.5. Кроме того, мы использовали Конечный модуль TTS Заменяет отдельный модуль TTS из VITA-1.0, который принимает на вход встраивание больших языковых моделей.

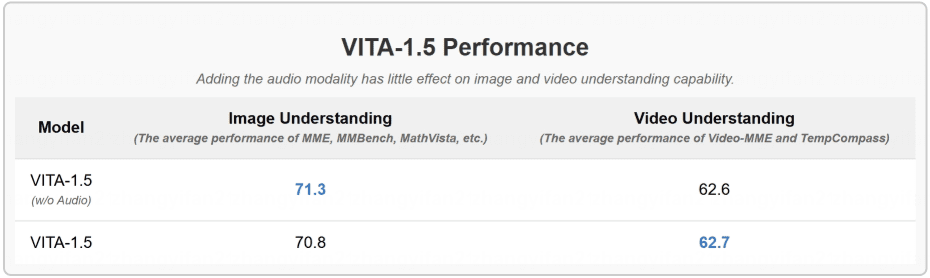

- Прогрессивные стратегии обучения. Таким образом, включение речевого модуля практически не влияет на другие мультимодальные показатели (визуально-вербальные). Средний показатель понимания изображений снизился лишь с 71,3 до 70,8.

Результаты

- Оценка эталонных тестов для понимания изображений и видео

- VITA-1.5 превосходит профессиональные речевые модели в бенчмарках ASR

- Включение аудиомодальностей практически не влияет на восприятие изображений и видео.

Использование помощи

1. Настройка и установка среды

1.1 Требования к фундаменту:

- Среда Python

- Фреймворк PyTorch

- Поддержка CUDA (рекомендуется ускорение GPU)

1.2 Этапы установки:

# 克隆项目仓库

git clone https://github.com/VITA-MLLM/VITA.git

cd VITA

# 安装依赖

pip install -r requirements.txt

2. использование моделей

2.1 Загрузка предварительно обученной модели:

from vita.model.builder import load_pretrained_model

from vita.conversation import conv_templates

from vita.util.mm_utils import get_model_name_from_path

# 加载模型

model_path = 'VITA/vita'

model_name = get_model_name_from_path(model_path)

tokenizer, model, image_processor, _ = load_pretrained_model(

model_path,

None,

model_name,

model_type='mixtral-8x7b',

device_map='auto'

)

2.2 Конфигурация обработки звука:

# 初始化音频编码器

audio_encoder = model.get_audio_encoder()

audio_encoder.to(dtype=torch.float16)

audio_processor = audio_encoder.audio_processor

3. интерактивные функции в режиме реального времени

- Поддержка голосового ввода и ответа в режиме реального времени

- Интегрированное распознавание и анализ изображений

- Поддержка многораундовых диалогов

- Предоставьте полную систему шаблонов диалогов

4. Использование расширенных функций

4.1 Обработка мультимодального ввода:

- Поддержка пакетной обработки изображений

- Анализ видеопотоков в режиме реального времени

- Обработка и синтез аудиопотоков

4.2 Обучение и тонкая настройка модели:

- Предоставляет полные сценарии обучения

- Поддержка функций непрерывного обучения

- Поддержка обучения с использованием пользовательских наборов данных

5. Оценка и тестирование

- Поддерживает основные эталоны мультимодальной оценки

- Встроенный инструмент оценки VLMEvalKit

- Предоставляет подробные показатели тестирования производительности

6. Предостережения

- Для вывода модели рекомендуется использовать графические процессоры

- Обратите внимание на управление памятью, особенно при работе с большими мультимодальными данными.

- Регулярно проверяйте обновления проекта, чтобы узнать о последних возможностях и оптимизациях.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...