VimRAG - 阿里通义实验室开源的多模态检索增强生成框架

VimRAG是什么

VimRAG是阿里巴巴通义实验室开源的多模态检索增强生成框架,专门攻克文本、图像与视频混合场景下的长上下文推理难题。框架创新性地引入多模态记忆图将推理轨迹建模为动态DAG结构,实现显式状态追踪;通过图调制视觉记忆编码依据节点拓扑重要性动态分配高分辨率token,压缩冗余视觉数据;并设计图引导策略优化机制将稀疏轨迹奖励解耦为细粒度步骤级评估。

VimRAG的功能特色

- 多模态记忆图构建:将智能体推理轨迹建模为动态有向无环图(DAG),节点显式编码动作决策、视觉观测与时间/逻辑依赖关系,突破传统线性历史的"状态盲区"限制。

- 图调制视觉记忆编码:依据节点在图中的拓扑重要性(中心性、出度、时序位置)动态分配视觉token预算,对关键证据保留高分辨率编码,对冗余视觉线索执行压缩或丢弃。

- 图引导策略优化(GGPO):通过图剪枝机制将稀疏的轨迹级奖励解耦为步骤级有效性评估:在成功路径中屏蔽无效探索节点(降低假阳性),在失败路径中保留有价值的检索尝试(降低假阴性)。

- 细粒度时间戳对齐:支持视频内容的秒级/帧级时间戳定位,实现视频片段的精确语义检索与长序列推理。

- 长上下文极限处理:针对包含海量图像、CAD图纸与视频的企业级知识库,通过拓扑感知的token分配策略,在有限上下文窗口内处理数万token级别的视觉数据.

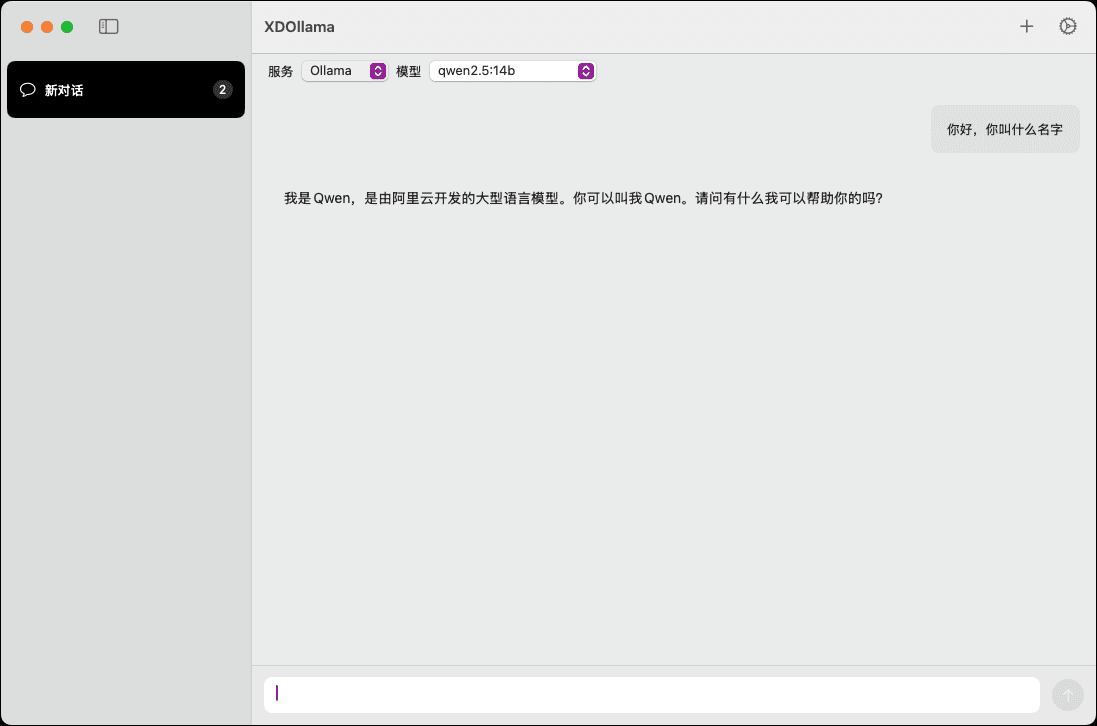

- 开源即插即用:提供完整的训练与推理代码库,支持基于Qwen3-VL、InternVL等主流多模态大模型的快速集成与二次开发。

VimRAG的核心优势

- 突破线性历史限制,根治状态盲区:传统RAG依赖线性交互历史,无法区分"已探索的死胡同"与"全新查询"。VimRAG通过多模态记忆图显式建模推理路径的拓扑关系,智能体可精准定位当前状态在整体推理图中的位置,避免重复探索或路径迷失。

- 拓扑感知降本增效,压缩冗余视觉开销:面对图像/视频动辄数万token的视觉数据,传统方法均匀分配计算资源导致关键信息淹没。VimRAG依据节点中心性、出度、时序等拓扑指标动态分配高分辨率token预算,将有限上下文窗口留给关键证据,实现"好钢用在刀刃上"。

- 细粒度信用分配,破解奖励稀疏难题:传统强化学习在RAG中仅能获得轨迹末端的稀疏奖励,导致训练信号误导。VimRAG的图引导策略优化(GGPO)通过图剪枝将轨迹级奖励解耦到步骤级:成功时屏蔽无效探索节点,失败时保留有价值检索,实现精准的梯度归因。

- 统一多模态理解,支持企业级复杂场景:无缝融合文本、图像与视频数据,支持秒级/帧级时间戳定位,已在阿里云百炼知识库落地,应对制造业PDF、CAD图纸与监控视频混合检索等长上下文极限场景。

VimRAG官网是什么

- Репозиторий GitHub:https://github.com/Alibaba-NLP/VRAG

- Библиотека моделей HuggingFace:https://huggingface.co/papers/2602.12735

- Технический документ arXiv:https://arxiv.org/pdf/2602.12735v1

使用VimRAG的操作步骤

- 环境准备与安装:从GitHub克隆开源仓库

Alibaba-NLP/VRAG,安装依赖库(PyTorch、Transformers等),配置支持长上下文的GPU环境(建议显存≥24GB以处理大规模视觉token)。 - 多模态知识库构建:整理文本、图像、视频混合的企业数据,建立统一的向量化存储;对视频数据提取关键帧并标记秒级/帧级时间戳,对图像/PDF进行OCR与结构化解析,生成可供检索的初始节点。

- 模型配置与初始化:加载基础多模态大模型(如Qwen3-VL-8B-Instruct或InternVL),配置VimRAG的三大核心模块:记忆图构建器、图调制视觉编码器、图引导策略优化器;设定token预算阈值与拓扑重要性评估参数。

- 推理执行(单次查询):输入多模态查询后,系统自动构建动态DAG记忆图,迭代执行:检索候选证据→评估节点拓扑重要性→动态分配视觉token预算→生成下一步动作或答案,直至达成目标或达到最大迭代次数。

- 模型训练/微调(可选):针对特定领域数据,使用GGPO(图引导策略优化)算法进行强化学习微调:构造正负样本轨迹,通过图剪枝计算步骤级奖励,更新策略网络以优化推理路径选择能力。

- 部署集成:将训练好的模型通过API服务化部署,或集成至阿里云百炼知识库等现有平台,支持并发处理多模态长上下文查询。

VimRAG的适用人群

- 企业级多模态知识库开发者:制造业、工程设计、能源等行业的技术团队,需构建支撑PDF文档、CAD图纸、监控视频混合检索的企业内部知识系统,解决传统RAG无法处理海量视觉数据的痛点。

- 长上下文多模态AI研究员:从事视觉语言模型(VLM)、检索增强生成(RAG)或强化学习策略优化的研究人员,关注如何在有限token预算内建模数万token级别的图文视频混合序列.

- 复杂场景智能体开发者:开发需迭代式多模态推理应用的工程师,如工业质检助手(需比对设计图与实拍视频)、医疗影像分析系统(需关联病历文本与CT/MRI影像),依赖VimRAG的状态显式追踪与细粒度信用分配Способности.

- 视频理解与内容检索从业者:安防监控、媒体资产管理、在线教育等领域的开发者,需要秒级/帧级时间戳定位技术,实现视频片段的精确语义检索与长视频内容问答。

VimRAG的常见问题FAQ

Q:VimRAG主要解决传统RAG的哪些痛点?

A:传统RAG依赖线性交互历史,存在三大瓶颈:状态盲区(无法区分已探索的死胡同与新查询)、视觉token开销巨大(图像/视频数据信息稀疏但占用大量token)、以及稀疏的轨迹级奖励导致训练信号误导。VimRAG通过多模态记忆图、图调制视觉编码与图引导策略优化(GGPO)三大创新分别攻克这些难题。

A:传统RAG依赖线性交互历史,存在三大瓶颈:状态盲区(无法区分已探索的死胡同与新查询)、视觉token开销巨大(图像/视频数据信息稀疏但占用大量token)、以及稀疏的轨迹级奖励导致训练信号误导。VimRAG通过多模态记忆图、图调制视觉编码与图引导策略优化(GGPO)三大创新分别攻克这些难题。

Q:VimRAG支持哪些模态的数据输入?

A:VimRAG原生支持文本、图像、视频三种模态的混合输入。针对视频数据,系统支持秒级/帧级时间戳定位;针对图像与PDF,支持OCR提取与结构化解析,实现CAD图纸、设计文档与监控视频的统一检索与推理。

A:VimRAG原生支持文本、图像、视频三种模态的混合输入。针对视频数据,系统支持秒级/帧级时间戳定位;针对图像与PDF,支持OCR提取与结构化解析,实现CAD图纸、设计文档与监控视频的统一检索与推理。

Q:运行VimRAG需要什么样的硬件配置?

A:建议使用显存≥24GB的GPU以处理大规模视觉token的长上下文场景。虽然VimRAG通过拓扑感知的token压缩策略显著降低了显存占用,但在处理企业级海量图像/视频知识库时,充足的显存仍是保证推理效率的关键。

A:建议使用显存≥24GB的GPU以处理大规模视觉token的长上下文场景。虽然VimRAG通过拓扑感知的token压缩策略显著降低了显存占用,但在处理企业级海量图像/视频知识库时,充足的显存仍是保证推理效率的关键。

Q:VimRAG可以与哪些基础多模态大模型结合使用?

A:根据官方开源信息,VimRAG已成功适配Qwen3-VL系列(实验基于Qwen3-VL-8B-Instruct完成,准确率从43.6%提升至50.1%)和InternVL等主流视觉语言模型。其模块化设计支持快速集成至现有VLM架构,无需从头训练基础模型。

A:根据官方开源信息,VimRAG已成功适配Qwen3-VL系列(实验基于Qwen3-VL-8B-Instruct完成,准确率从43.6%提升至50.1%)和InternVL等主流视觉语言模型。其模块化设计支持快速集成至现有VLM架构,无需从头训练基础模型。

Q:如何准备数据以发挥VimRAG的最佳性能?

A:需构建统一的多模态知识库:对视频提取关键帧并标记精确时间戳,对图像/PDF进行OCR与结构化解析生成初始节点。核心在于建立可供图结构检索的向量化存储,确保文本描述与视觉内容的语义对齐,以便记忆图构建器准确建立节点依赖关系。

A:需构建统一的多模态知识库:对视频提取关键帧并标记精确时间戳,对图像/PDF进行OCR与结构化解析生成初始节点。核心在于建立可供图结构检索的向量化存储,确保文本描述与视觉内容的语义对齐,以便记忆图构建器准确建立节点依赖关系。

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...