VideoReTalking: система синхронизации губ и видеомонтажа на основе звука

Общее введение

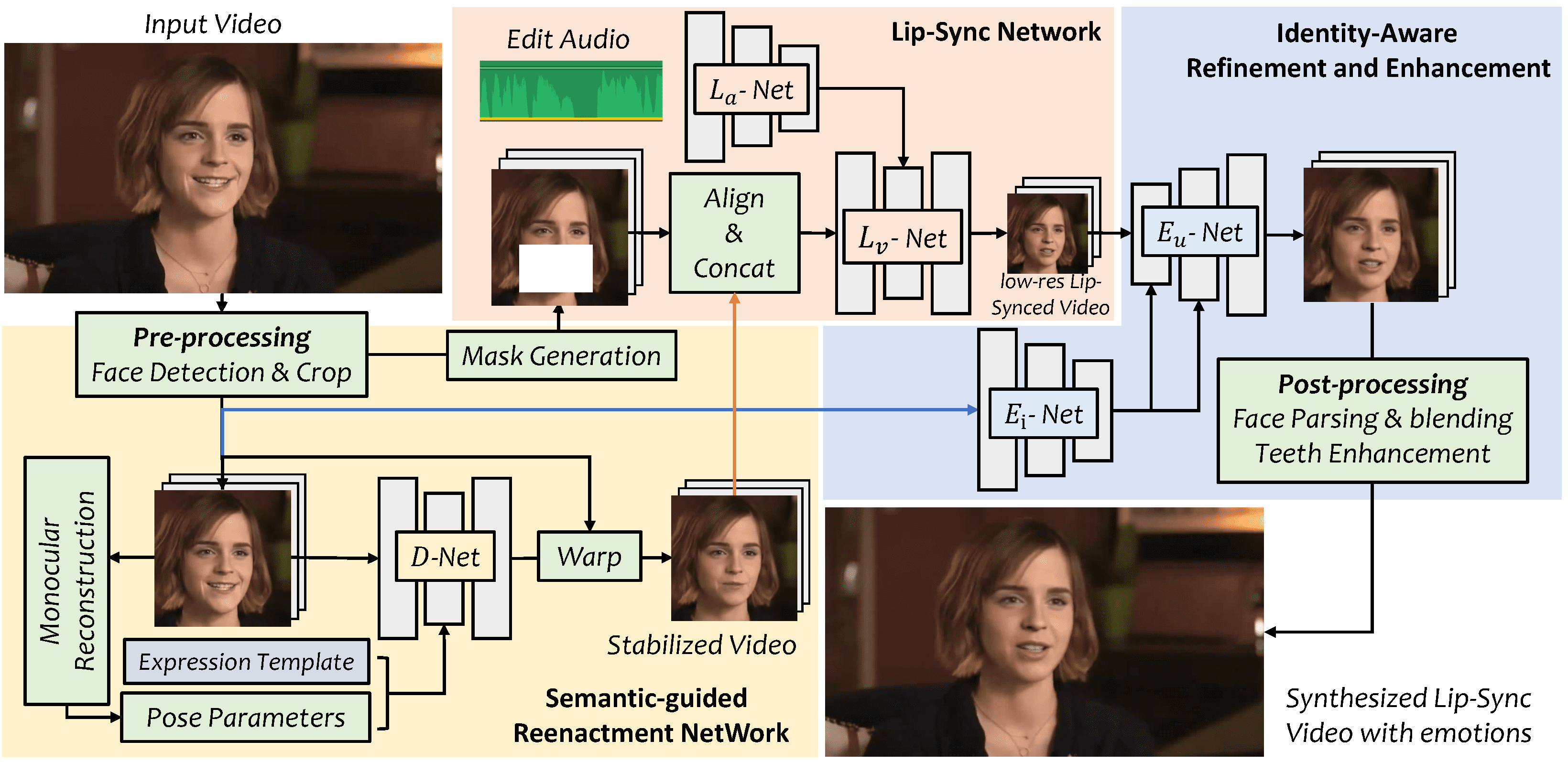

VideoReTalking - это инновационная система, которая позволяет пользователям генерировать синхронизированные по губам видео с лицами на основе входного аудио, создавая высококачественные и синхронизированные по губам выходные видео даже с различными эмоциями. Система разбивает эту цель на три последовательные задачи: создание видео с типичными выражениями лица, синхронизация губ с аудио и улучшение лица для повышения фотореалистичности. Для решения всех трех задач используется подход, основанный на обучении, который может быть выполнен последовательно без вмешательства пользователя. Ознакомьтесь с VideoReTalking и его применением для видеомонтажа говорящих голов с аудиосинхронизацией губ по указанной ссылке.

(нечетко, нужно дважды улучшить качество видео, немного плохой синхрон с китайским)

Список функций

Генерация видеороликов с лицами: генерирует видеоролики с типичными выражениями лиц на основе входного аудио.

Синхронизация губ на основе аудио: генерирует видео с синхронизацией губ на основе заданного аудио.

Улучшение лица: повышение фотореалистичности синтетических лиц с помощью сети улучшения лица с учетом идентификации и постобработки.

Использование помощи

Загрузите предварительно обученную модель и поместите ее в папку `. /checkpoints`.

Запустите `python3 inference.py` для быстрого анализа видео.

Выражениями можно управлять, добавив аргументы `--exp_img` или `--up_face`.

Адрес онлайн-опыта

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...