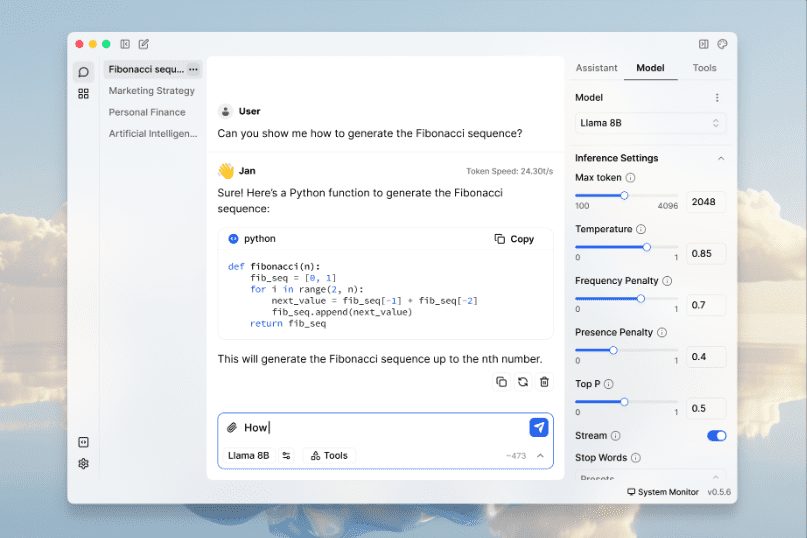

llama.cpp: эффективный инструмент для вывода, поддерживает множество аппаратных средств, легко реализует вывод LLM

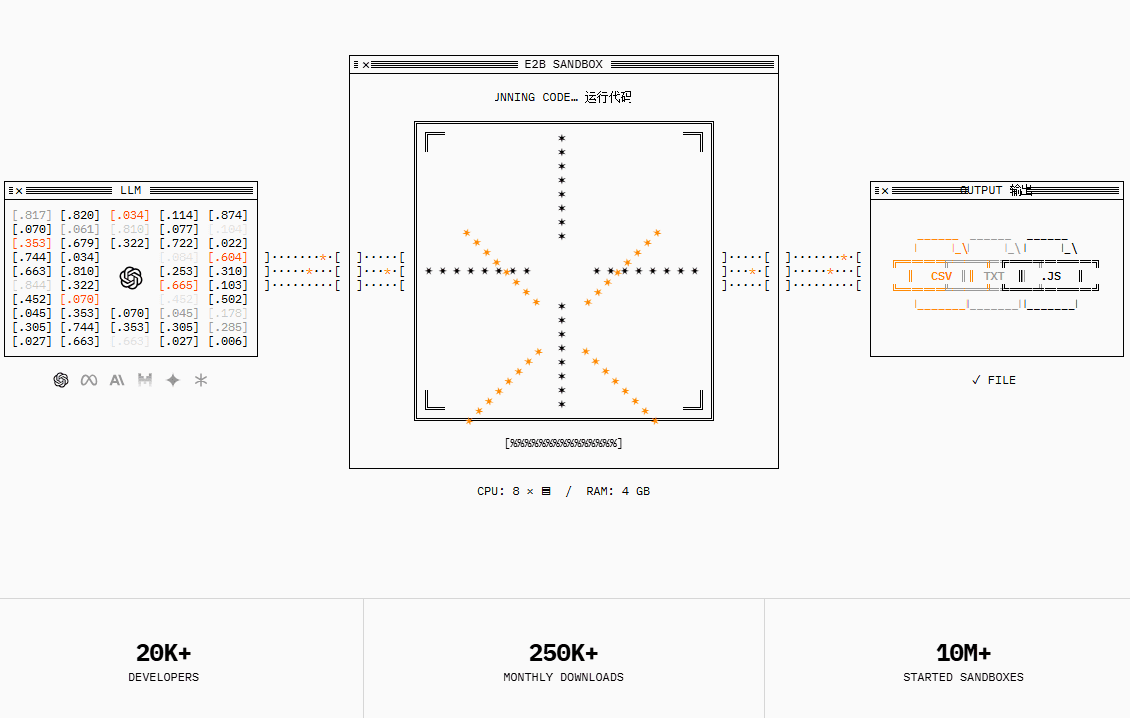

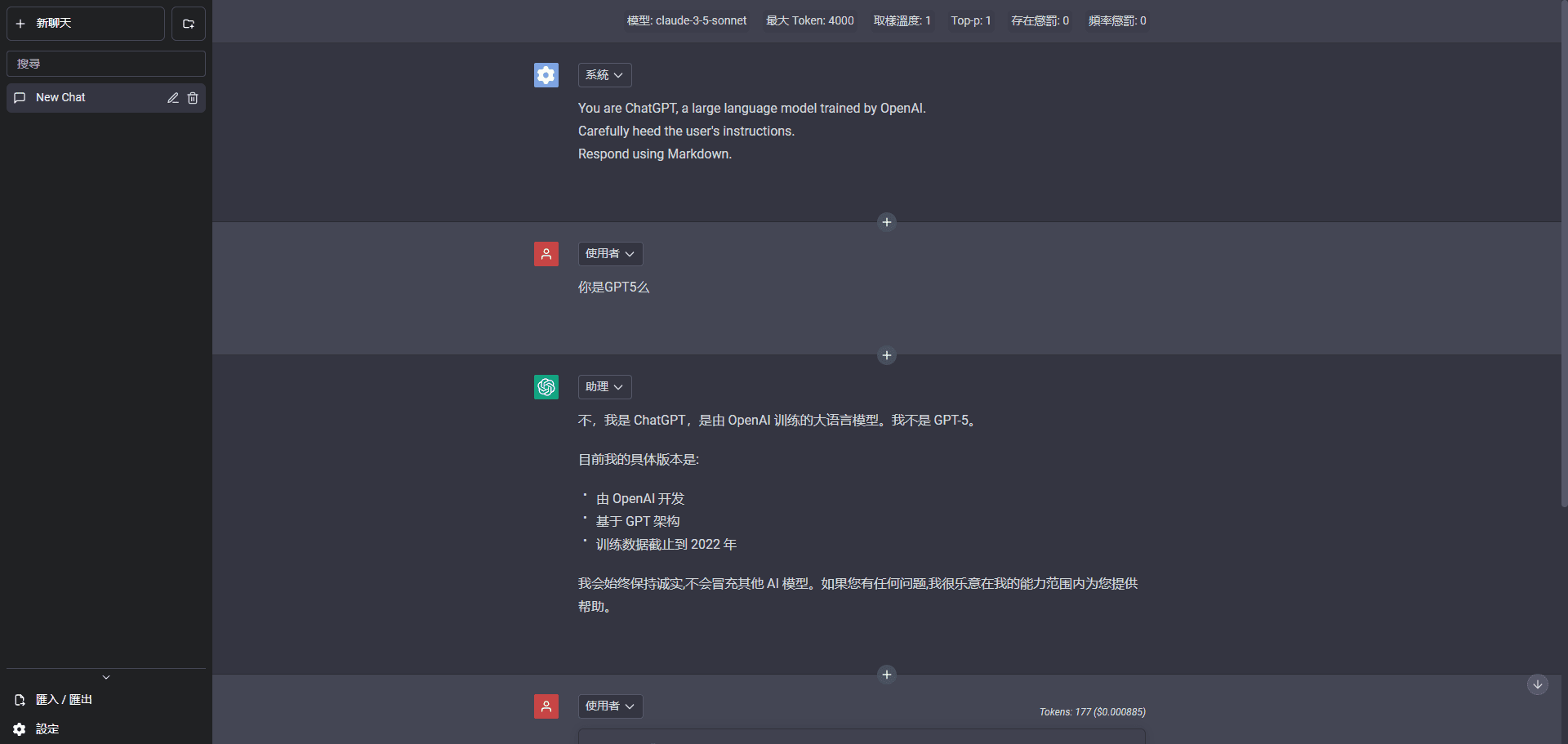

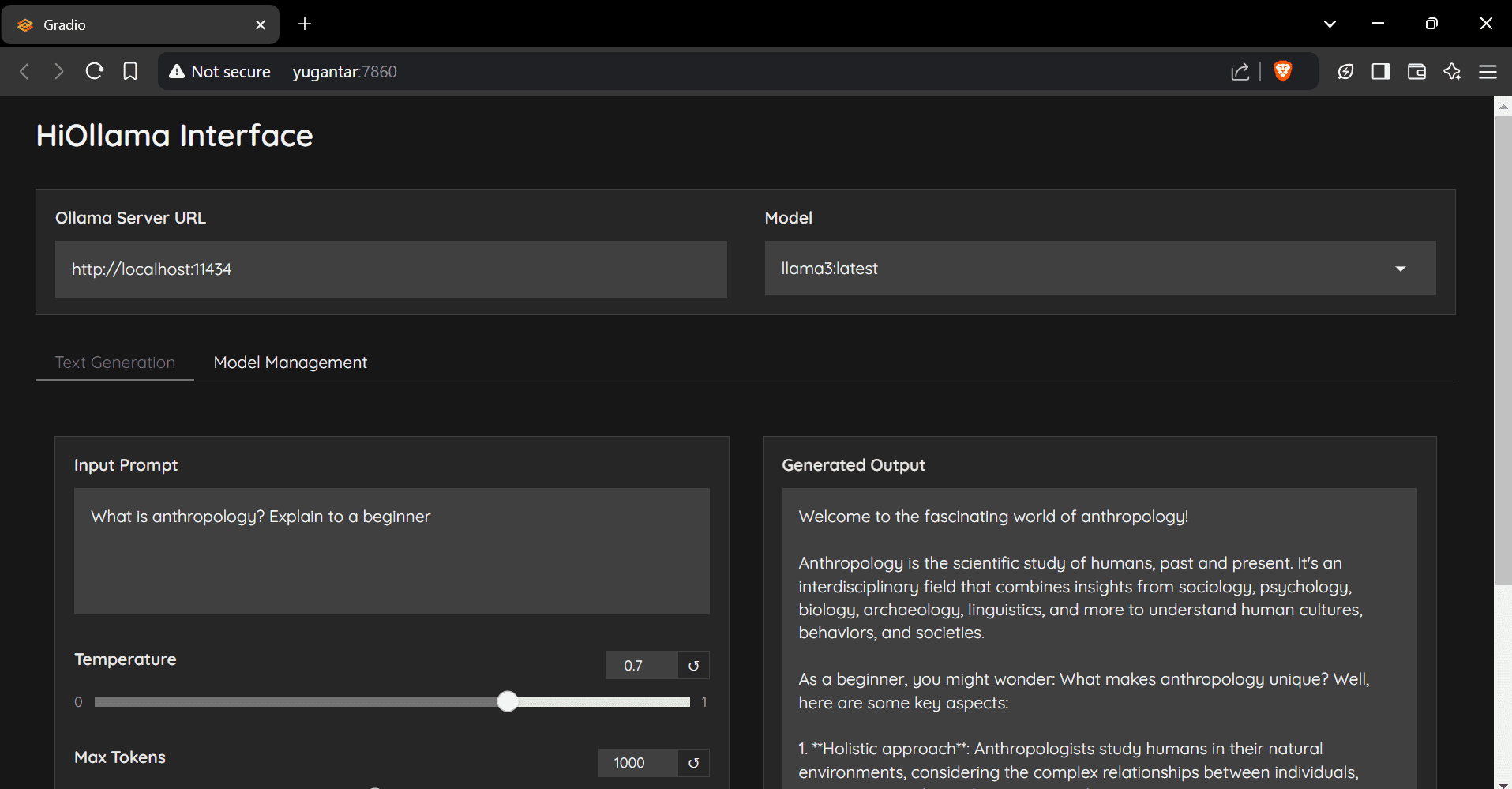

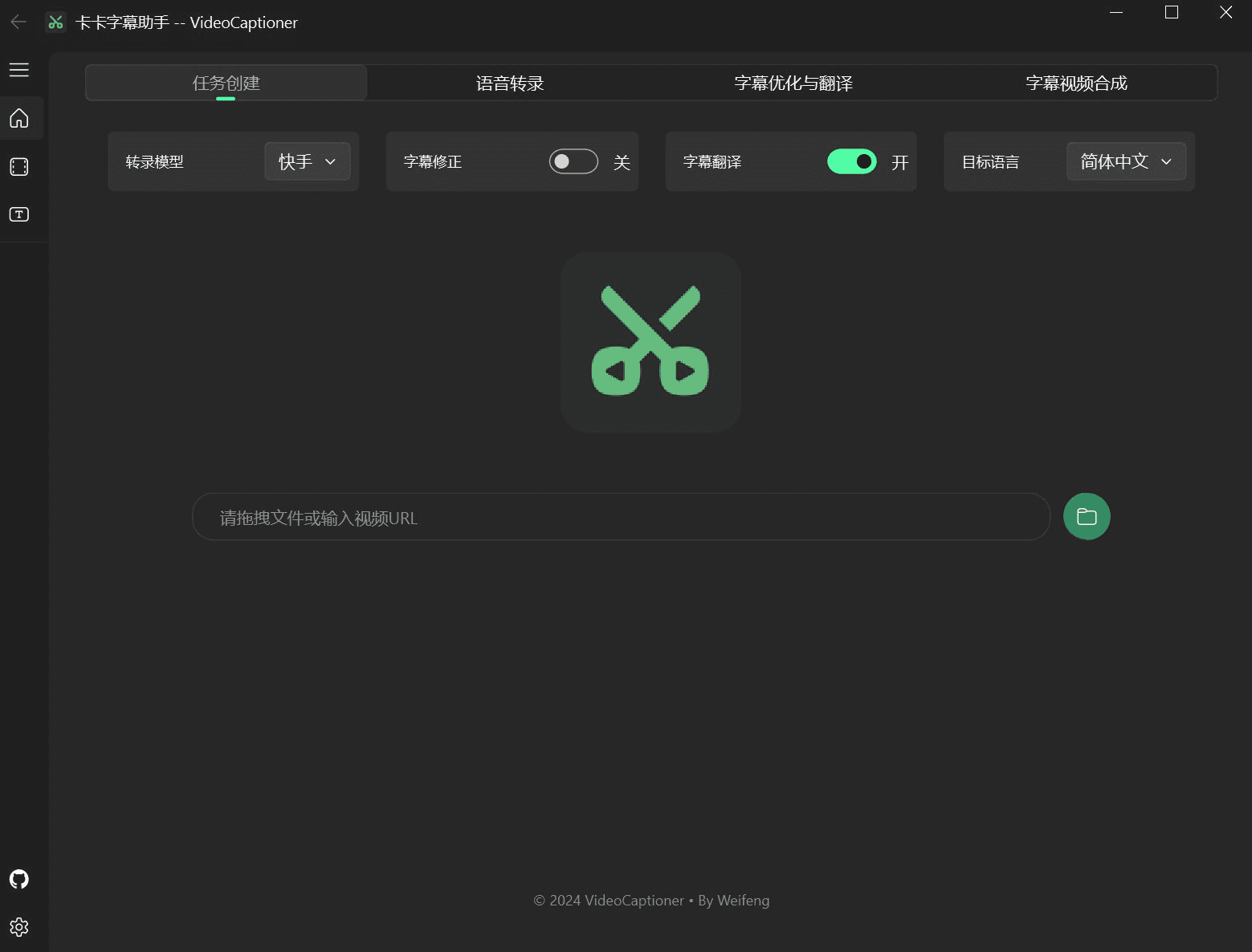

Общее представление llama.cpp - это библиотека, реализованная на чистом C/C++ и предназначенная для упрощения процесса вывода для больших языковых моделей (LLM). Она поддерживает широкий спектр аппаратных платформ, включая Apple Silicon, NVIDIA GPU и AMD GPU, и предоставляет множество количественных...