Step-Audio: мультимодальный фреймворк для голосового взаимодействия, который распознает речь и общается с помощью клонированной речи, среди прочих возможностей

Общее введение

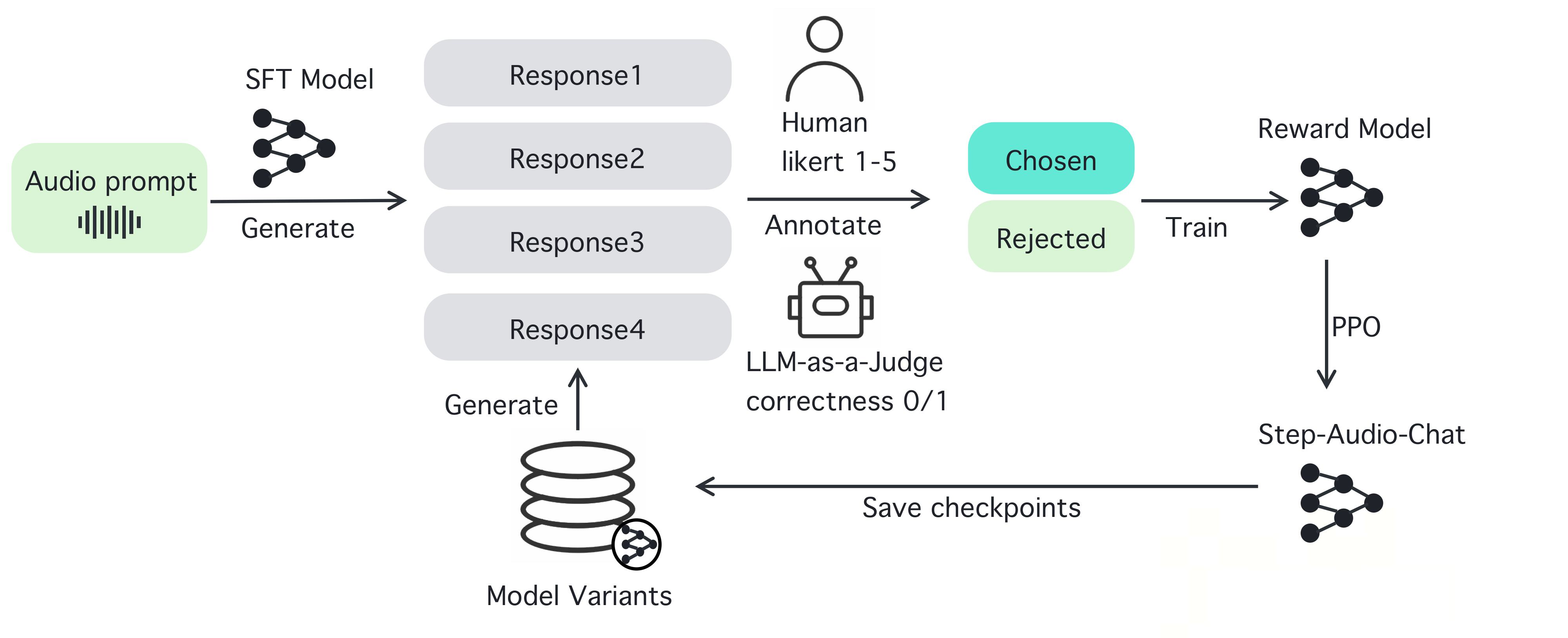

Step-Audio - это фреймворк интеллектуального голосового взаимодействия с открытым исходным кодом, предназначенный для обеспечения готовых возможностей понимания и генерации речи в производственных средах. Фреймворк поддерживает многоязычные диалоги (например, китайский, английский, японский), эмоциональную речь (например, happy, sad), региональные диалекты (например, кантонский, чешский), а также регулируемый темп речи и стили рифмы (например, рэп). Step-Audio реализует распознавание речи, семантическое понимание, диалог, клонирование речи и синтез речи с помощью 130B-параметрической мультимодальной модели. Генеративный механизм данных позволяет отказаться от традиционного ручного сбора данных TTS, генерируя высококачественный звук для обучения и публикации экономичной модели Step-Audio-TTS-3B.

Список функций

- Распознавание речи в реальном времени (ASR): преобразует речь в текст и поддерживает высокоточное распознавание.

- Синтез текста в речь (TTS): преобразовывает текст в естественную речь, поддерживая широкий спектр эмоций и интонаций.

- Многоязыковая поддержка: поддерживает такие языки, как китайский, английский, японский, а также такие диалекты, как кантонский и чечуаньский.

- Управление эмоциями и интонацией: регулировка эмоций речевого вывода (например, счастливый, грустный) и стиля рифмы (например, RAP, напевание).

- Клонирование голоса: генерирование похожего голоса на основе входного голоса, поддержка персонализированного дизайна голоса.

- Управление диалогом: поддерживайте непрерывность диалога и улучшайте впечатления пользователей с помощью Context Manager.

- Инструментарий с открытым исходным кодом: предоставляет полный код и модельные веса, которые разработчики могут использовать напрямую или разрабатывать самостоятельно.

Использование помощи

Step-Audio - это мощный фреймворк с открытым исходным кодом для мультимодального голосового взаимодействия, позволяющий разработчикам создавать голосовые приложения в режиме реального времени. Ниже представлено подробное пошаговое руководство по установке и использованию Step-Audio, а также его возможностей, чтобы вы могли легко начать работу и использовать его в полной мере.

Процесс установки

Чтобы использовать Step-Audio, необходимо установить программу в среде с NVIDIA GPU. Ниже приведены подробные шаги:

- Подготовка к защите окружающей среды::

- Убедитесь, что в вашей системе установлен Python 3.10.

- Установите Anaconda или Miniconda для управления виртуальной средой.

- Убедитесь, что установлен драйвер NVIDIA GPU и поддержка CUDA. Для наилучшего качества генерации рекомендуется использовать 4xA800/H800 GPU (80 ГБ ОЗУ).

- склад клонов::

- Откройте терминал и выполните следующую команду, чтобы клонировать репозиторий Step-Audio:

git clone https://github.com/stepfun-ai/Step-Audio.git cd Step-Audio

- Откройте терминал и выполните следующую команду, чтобы клонировать репозиторий Step-Audio:

- Создание виртуальной среды::

- Создание и активация виртуальной среды Python:

conda create -n stepaudio python=3.10 conda activate stepaudio

- Создание и активация виртуальной среды Python:

- Установка зависимостей::

- Установите необходимые библиотеки и инструменты:

pip install -r requirements.txt git lfs install - Клонирование дополнительных весов модели:

git clone https://huggingface.co/stepfun-ai/Step-Audio-Tokenizer git clone https://huggingface.co/stepfun-ai/Step-Audio-Chat git clone https://huggingface.co/stepfun-ai/Step-Audio-TTS-3B

- Установите необходимые библиотеки и инструменты:

- Проверка установки::

- Запуск простого тестового сценария (как в примере кода)

run_example.py), чтобы убедиться, что все компоненты работают правильно.

- Запуск простого тестового сценария (как в примере кода)

После завершения установки вы можете приступить к использованию различных функций Step-Audio. Ниже приведены подробные инструкции по работе с основными и дополнительными функциями.

Основные функции

1. распознавание речи в реальном времени (ASR)

Функция распознавания речи Step-Audio преобразует голосовой ввод пользователя в текст, что делает ее подходящей для создания голосовых помощников или систем транскрибирования в реальном времени.

- процедура::

- Убедитесь, что микрофон подключен и настроен.

- Используйте предоставленный

stream_audio.pyСкрипт для запуска потокового аудио:python stream_audio.py --model Step-Audio-Chat - Когда вы говорите, система преобразует речь в текст в режиме реального времени и выводит результат на терминал. Вы можете проверить журнал, чтобы убедиться в точности распознавания.

- Основные функции: Поддержка распознавания нескольких языков и диалектов, например, смешанного китайского и английского ввода или локализованной речи, такой как кантонский и сычуаньский.

2. Синтез текста в речь (TTS)

С помощью функции TTS вы можете преобразовать любой текст в естественную речь, поддерживающую широкий спектр эмоций, темпов и стилей речи.

- процедура::

- Подготовьте текст для синтеза, например, сохраните как

input.txt. - пользоваться

text_to_speech.pyСкрипты для генерации речи:python text_to_speech.py --model Step-Audio-TTS-3B --input input.txt --output output.wav --emotion happy --speed 1.0 - Описание параметра:

--emotion: Установите эмоцию (например, счастливая, грустная, нейтральная).--speed: Регулировка скорости речи (0,5 - медленная, 1,0 - нормальная, 2,0 - быстрая).--output: Указывает путь к выходному аудиофайлу.

- Подготовьте текст для синтеза, например, сохраните как

- Основные функции: Поддерживает создание стилей речи RAP и humming, например:

python text_to_speech.py --model Step-Audio-TTS-3B --input rap_lyrics.txt --style rap --output rap_output.wav

这将生成一段带有 RAP 节奏的音频,非常适合音乐或娱乐应用。

#### 3. 多语言与情感控制

Step-Audio 支持多种语言和情感控制,适合国际化应用开发。

- **操作步骤**:

- 选择目标语言和情感,例如生成日语悲伤语气语音:

python generate_speech.py --language japanese --emotion sad --text "私は悲しいです" --output sad_jp.wav

- 方言支持:如果需要粤语输出,可以指定:

python generate_speech.py --dialect cantonese --text "I'm so hung up on you" --output cantonese.wav

- **特色功能**:通过指令可以无缝切换语言和方言,适合构建跨文化语音交互系统。

#### 4. 语音克隆

语音克隆允许用户上传一段语音样本,生成相似的声音,适用于个性化语音设计。

- **操作步骤**:

- 准备一个音频样本(如 `sample.wav`),确保音频清晰。

- 使用 `voice_clone.py` 进行克隆:

python voice_clone.py --input sample.wav --output cloned_voice.wav --model Step-Audio-Chat

- 生成的 `cloned_voice.wav` 将模仿输入样本的音色和风格。

- **特色功能**:支持高保真克隆,适用于虚拟主播或定制语音助手。

#### 5. 对话管理与上下文保持

Step-Audio 内置上下文管理器,确保对话的连续性和逻辑性。

- **操作步骤**:

- 启动对话系统:

python chat_system.py --model Step-Audio-Chat

- Введите текст или речь, и система сгенерирует ответ, основываясь на контексте. Пример:

- Пользователь: "Какая сегодня погода?"

- СИСТЕМА: "Пожалуйста, скажите мне ваше местоположение, и я проверю его".

- Пользователь: "Я в Пекине".

- СИСТЕМА: "Сегодня в Пекине солнечно, температура 15°C".

- Основные функции: Поддерживает несколько раундов диалога, сохраняет контекстную информацию и подходит для ботов по обслуживанию клиентов или интеллектуальных помощников.

предостережение

- требования к оборудованию: Убедитесь, что GPU имеет достаточно памяти, для оптимальной производительности рекомендуется 80 ГБ или больше.

- сетевое подключение: Некоторые веса модели необходимо загрузить из Hugging Face, чтобы обеспечить стабильную работу сети.

- обнаружение ошибок: Если вы столкнулись с ошибками установки или выполнения, проверьте файлы журнала или обратитесь за помощью на страницу проблем GitHub.

Следуя этим шагам, вы сможете в полной мере использовать возможности Step-Audio, будь то разработка речевых приложений в реальном времени, создание персонализированного речевого контента или создание многоязычной диалоговой системы. Открытый исходный код Step-Audio также позволяет модифицировать код и оптимизировать модель в соответствии с потребностями вашего конкретного проекта.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...