R1-V: Недорогое обучение с подкреплением для обобщения возможностей визуальных языковых моделей

Общее введение

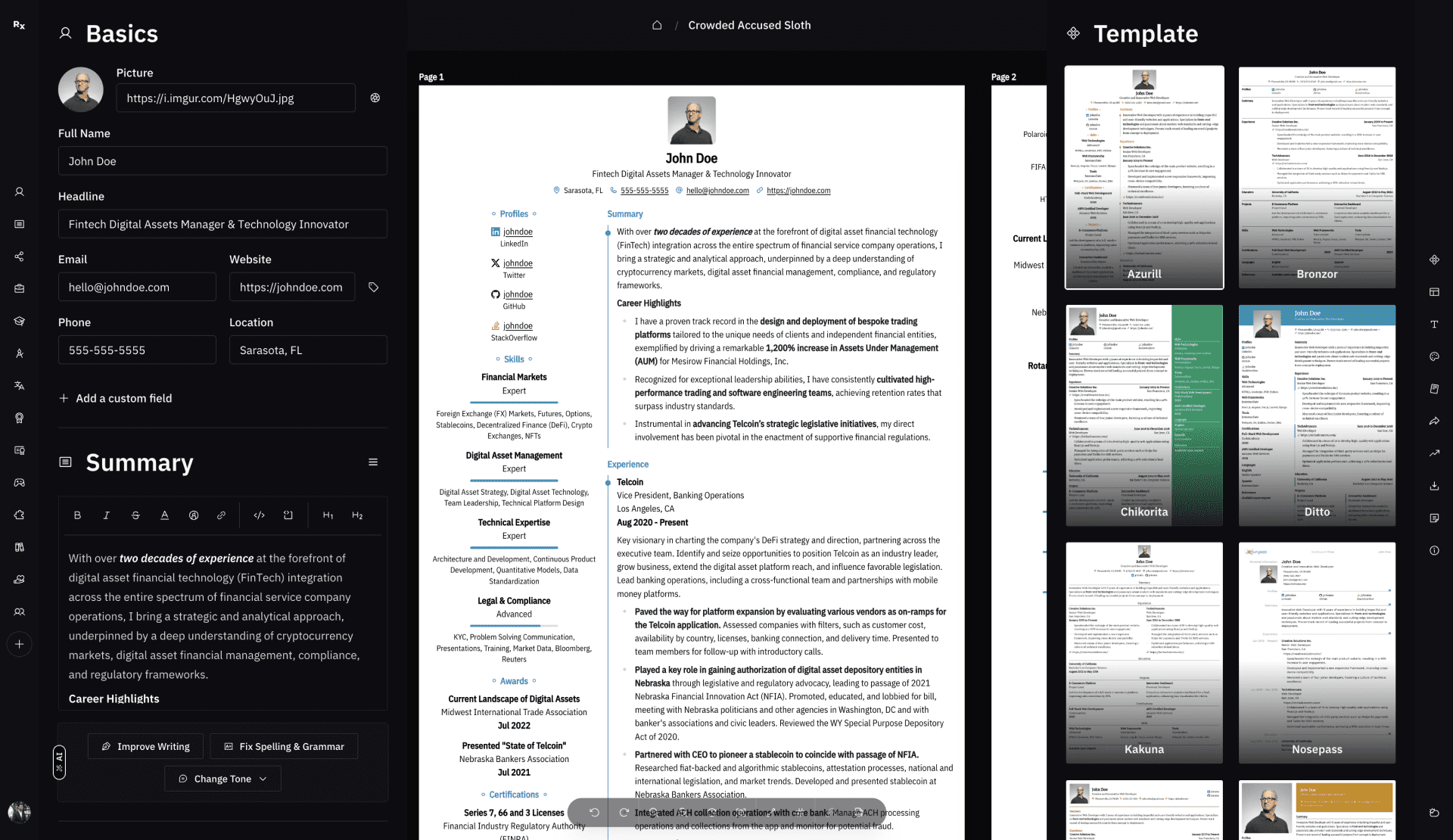

R1-V - это проект с открытым исходным кодом, целью которого является достижение прорыва в визуальном моделировании языка (VLM) с помощью недорогого обучения с подкреплением (RL). Проект использует проверяемый механизм вознаграждения, чтобы мотивировать ВЛМ к обучению общим способностям счета. Удивительно, но модель R1-V на 2B превосходит модель на 72B всего после 100 шагов обучения, а стоимость обучения составляет менее 3 долларов. Весь процесс обучения занял всего 30 минут на 8 графических процессорах A100 при общей стоимости 2,62 доллара. Проект R1-V полностью открыт, и пользователи могут исследовать неограниченный потенциал ИИ, экспериментируя и разрабатывая модели R1-V, получая доступ и внося свой код через платформу GitHub.

Список функций

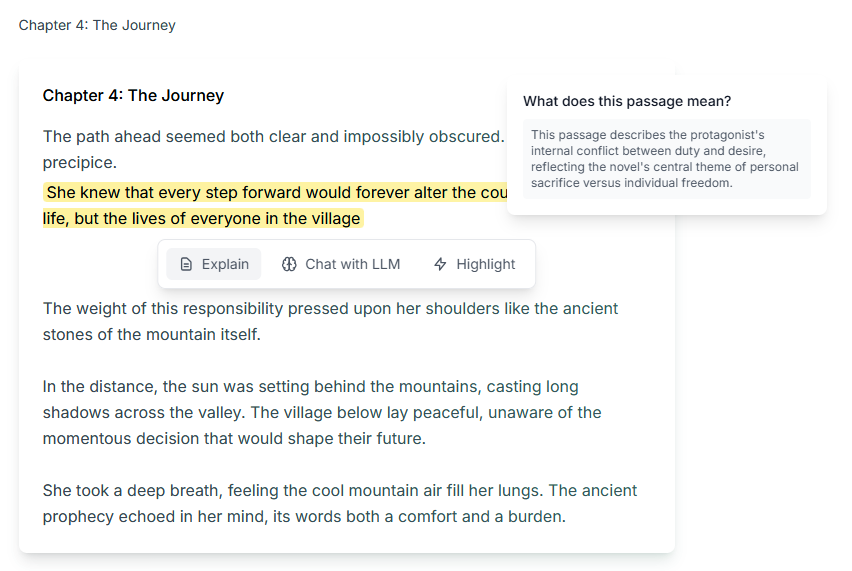

- визуальная модель языка: Объединение изображений и текстовых данных для обработки и анализа.

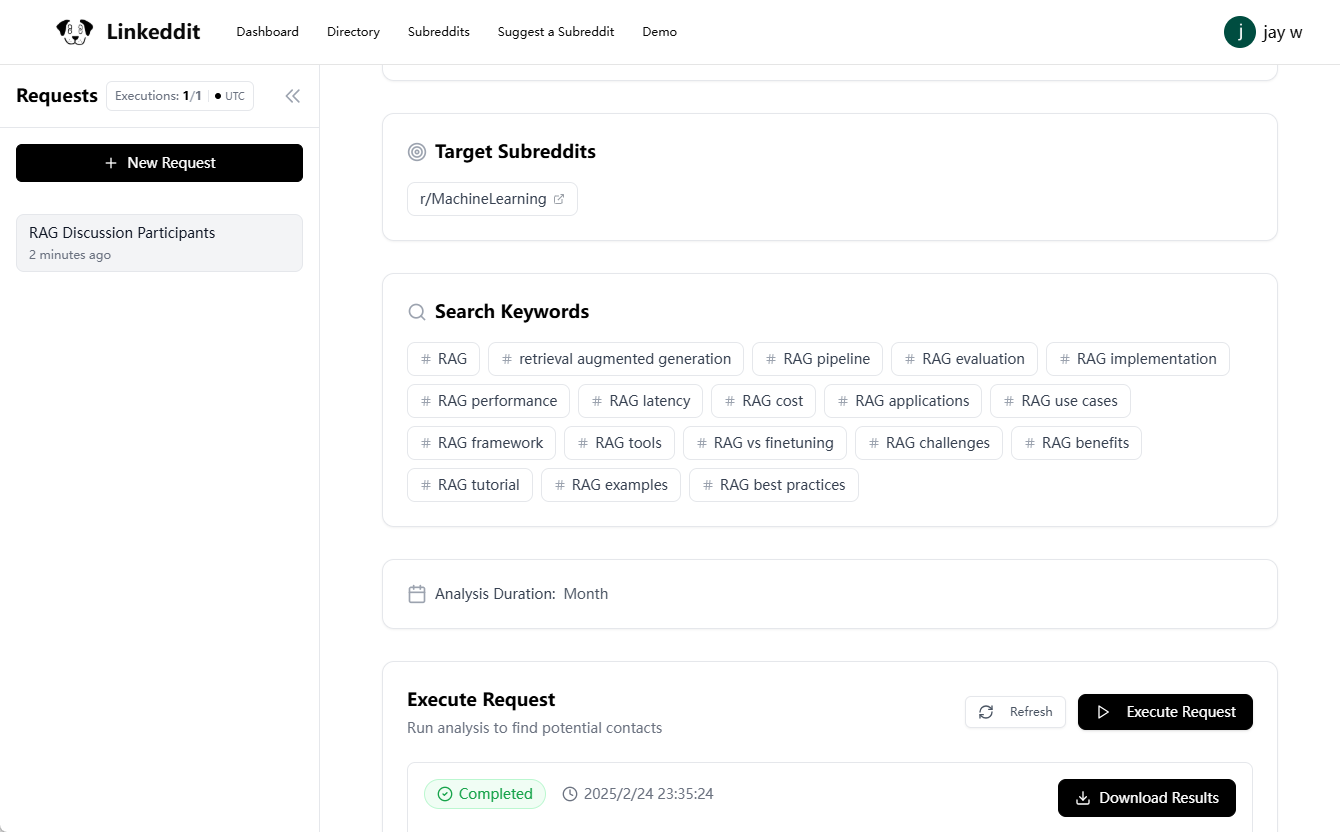

- Интенсивное обучение: Повышение обобщенности моделей с помощью проверяемых механизмов вознаграждения.

- Недорогое обучение: Эффективное обучение в короткие сроки и по низкой цене.

- глубокое обучение: Поддержка сложных задач глубокого обучения и повышение точности и эффективности моделей.

- обработка естественного языка (NLP)Обработка и понимание естественно-языковых текстов с многоязыковой поддержкой.

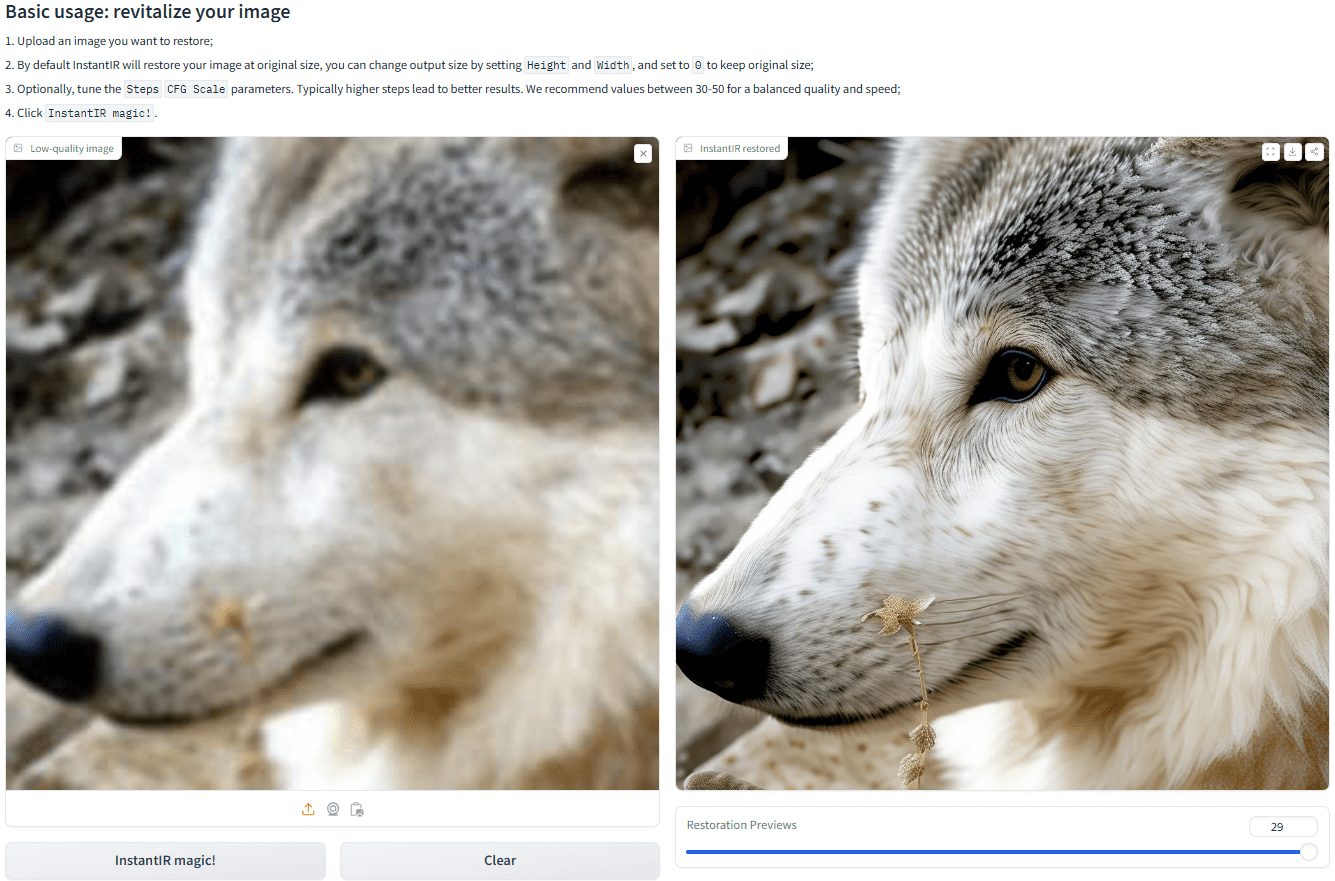

- компьютерное зрение: Анализирует и понимает содержание изображений и поддерживает такие задачи, как классификация изображений и обнаружение целей.

- открытый исходный код: Полный открытый исходный код доступен для легкой загрузки, модификации и участия.

- Поддержка общества: Активное сообщество разработчиков, предоставляющее техническую поддержку и платформу для общения.

Использование помощи

Процесс установки

- склад клонов: Выполните следующую команду в терминале, чтобы клонировать репозиторий проекта:

git clone https://github.com/Deep-Agent/R1-V.git

- Установка зависимостей: Перейдите в каталог проекта и установите необходимые зависимости:

cd R1-V

pip install -r requirements.txt

- Конфигурационная среда: Настройте переменные окружения и пути в соответствии с требованиями проекта.

Использование

- Модели для погрузки: Загрузите модель R1-V в код:

from r1v import R1VModel

model = R1VModel()

- Обработка изображений и текста: Использование моделей для обработки изображений и текстовых данных:

image_path = 'path/to/image.jpg'

text = '描述图像的文本'

result = model.process(image_path, text)

print(result)

- Модели обучения: Обучите модель так, как это необходимо для решения конкретной задачи:

model.train(data_loader)

Подробный порядок работы функций

- классификация изображений: Загрузите изображение и используйте модель для классификации:

from PIL import Image

image = Image.open('path/to/image.jpg')

classification = model.classify(image)

print(classification)

- обнаружение цели: Обнаружение целей с помощью моделей:

detections = model.detect_objects(image)

for detection in detections:

print(detection)

- Генерация текста: Создание описательного текста на основе изображений:

description = model.generate_text(image)

print(description)© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...