Детали примера из блокнота Qwen2.5-VL: начало работы с мультимодальными визуальными моделями

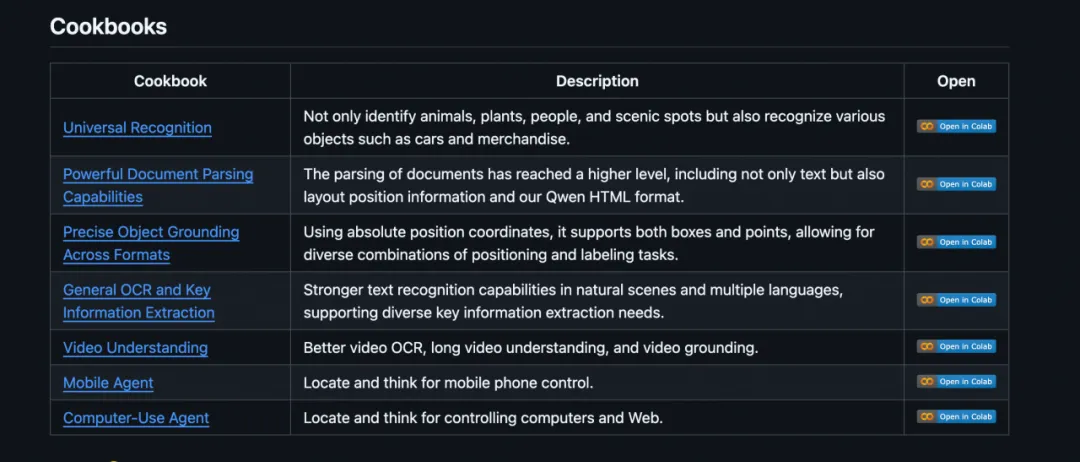

Недавно команда Qwen с гордостью запустила серию Пример блокнота по использованию Qwen2.5-VLЭто всесторонняя демонстрация возможностей нативных моделей и API. Эта коллекция тщательно продуманных блокнотов призвана помочь разработчикам и пользователям глубже понять Qwen2.5-VL Мощное визуальное восприятие и вдохновение для более инновационных приложений.

Пример блокнота: начало работы с Qwen 2.5-VL

С помощью этих подробных примеров из блокнота разработчики смогут Начните работать и убедитесь сами, что модель Qwen 2.5-VL справляется с любой задачей!Qwen2.5-VL Будь то разбор сложных документов, выполнение точных задач OCR или глубокий анализ видеоконтента, Qwen2.5-VL обеспечивает эффективную и точную обратную связь, демонстрируя свою превосходную производительность.

В то же время команда Qwen с нетерпением ждет отзывов и вклада сообщества в улучшение и расширение возможностей Qwen 2.5-VL, а также совместной работы по продвижению развития мультимодальных технологий.

🔗 ССЫЛКИ:

- Репозиторий GitHub. https://github.com/QwenLM/Qwen2.5-VL/tree/main/cookbooks

- Опыт работы в Интернете. https://chat.qwenlm.ai (выберите модель Qwen2.5-VL-72B-Instruct)

- Ссылка на модель ModelScope: https://www.modelscope.cn/collections/Qwen25-VL-58fbb5d31f1d47

- Интерфейс API компании Parsons Brinckerhoff. https://help.aliyun.com/zh/model-studio/user-guide/vision/

Примеры блокнотов в деталях

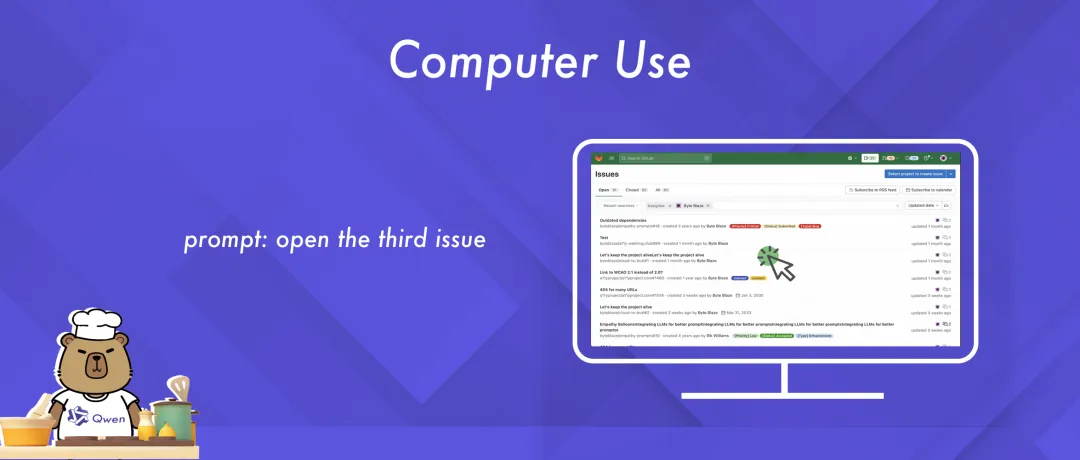

01 Использование компьютера

В этом примере Блокнота показано, как использовать Qwen2.5-VL для выполнения задач, связанных с использованием компьютера.

Пользователю достаточно сделать скриншот рабочего стола компьютера и задать запрос, модель Qwen2.5-VL может проанализировать содержимое скриншота, понять намерения пользователя, а затем сгенерировать точные инструкции, такие как нажатие или ввод текста, чтобы добиться интеллектуального управления компьютером.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/computer_use.ipynb

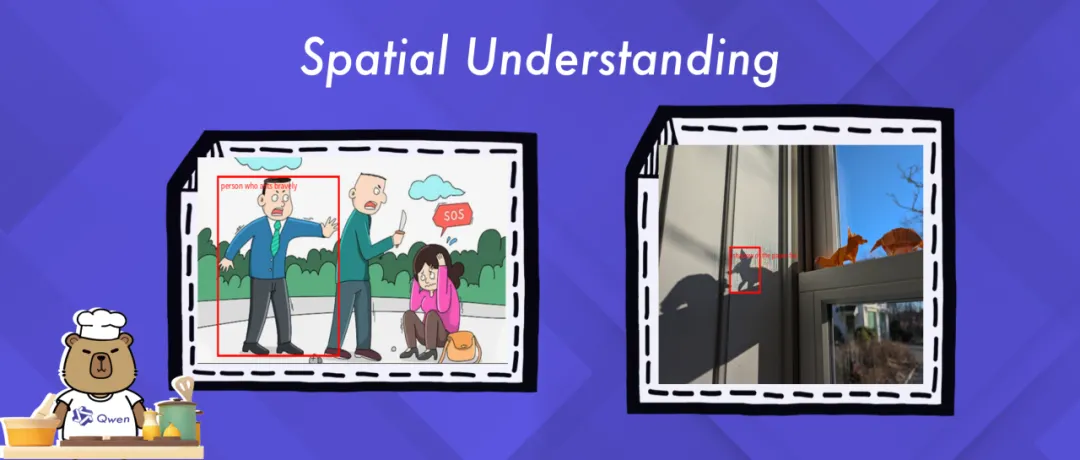

02 Пространственное понимание

Этот пример из блокнота демонстрирует расширенные возможности Qwen2.5-VL по пространственной локализации, включая точное обнаружение объектов и локализацию конкретных целей на изображении.

Примеры дают представление о том, как Qwen2.5-VL эффективно объединяет визуальное и лингвистическое понимание для точной интерпретации сложных сценариев и расширенного пространственного мышления.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/spatial_understanding.ipynb

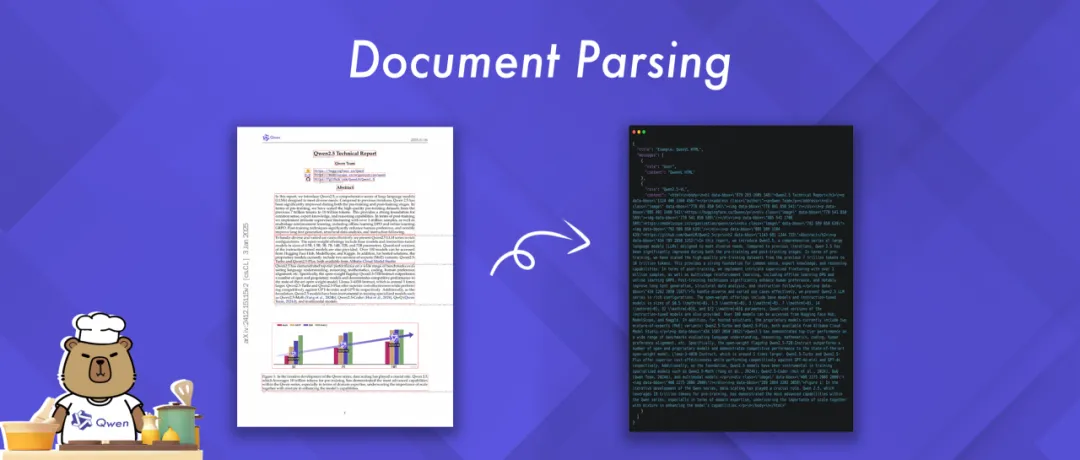

03 Разбор документов

Этот пример из блокнота демонстрирует мощные возможности Qwen2.5-VL по разбору документов. Он может обрабатывать документы в различных форматах изображений и выводить результаты разбора в различных форматах, включая HTML, JSON, MD и LaTeX.

Особый интерес представляет инновационное внедрение компанией Qwen уникального формата QwenVL HTML. Этот формат содержит информацию о местоположении каждого компонента в документе, что позволяет точно реконструировать документ и гибко манипулировать им.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/document_parsing.ipynb

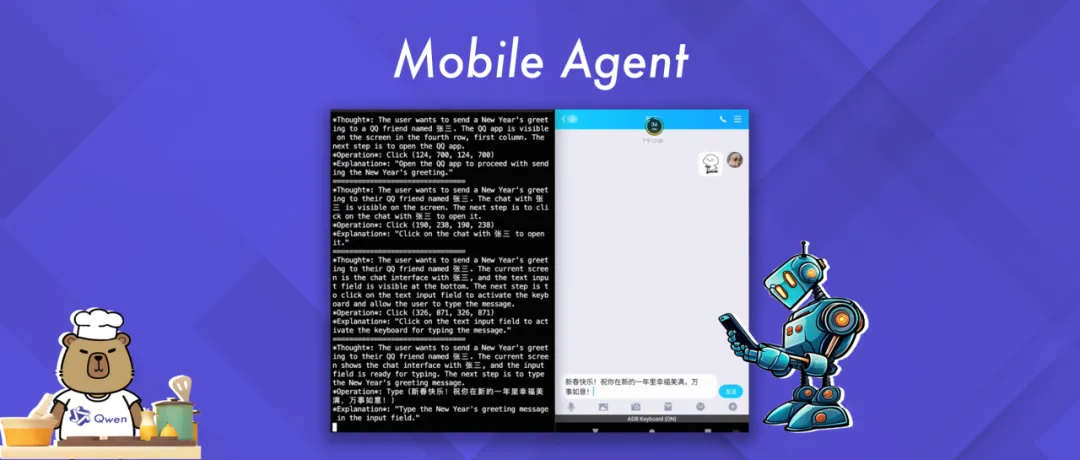

04 Мобильный агент (агент мобильного устройства)

Этот пример из блокнота демонстрирует, как интеллектуально взаимодействовать с мобильным устройством, используя агентские возможности Qwen2.5-VL.

Пример показывает, как модель Qwen2.5-VL генерирует и выполняет действия на основе запроса пользователя и визуального контекста мобильного устройства, позволяя легко управлять мобильным устройством.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/mobile_agent.ipynb

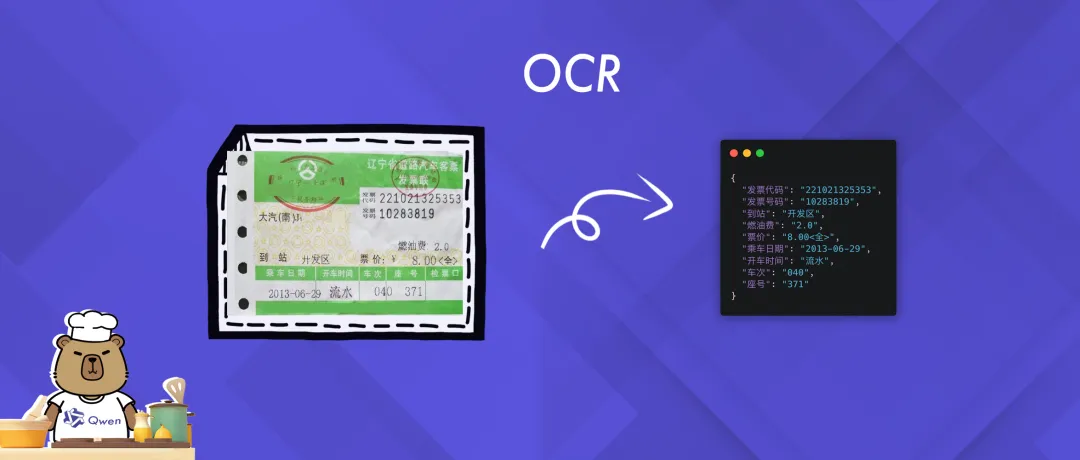

05 OCR (оптическое распознавание символов)

Этот пример из блокнота посвящен демонстрации возможностей оптического распознавания символов (OCR) в Qwen2.5-VL, включая точное извлечение и распознавание текстовой информации из изображений.

На примерах пользователи могут интуитивно понять, как Qwen2.5-VL может точно захватывать и интерпретировать текстовый контент в сложных сценариях, демонстрируя свои мощные возможности распознавания текста.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/ocr.ipynb

06 Всеобщее признание

Этот пример из блокнота показывает, как использовать Qwen2.5-VL для общего распознавания объектов.

Модель Qwen2.5-VL анализирует изображение, понимает намерения пользователя и выдает соответствующие результаты распознавания, достигая полного понимания содержания изображения.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/universal_recognition.ipynb

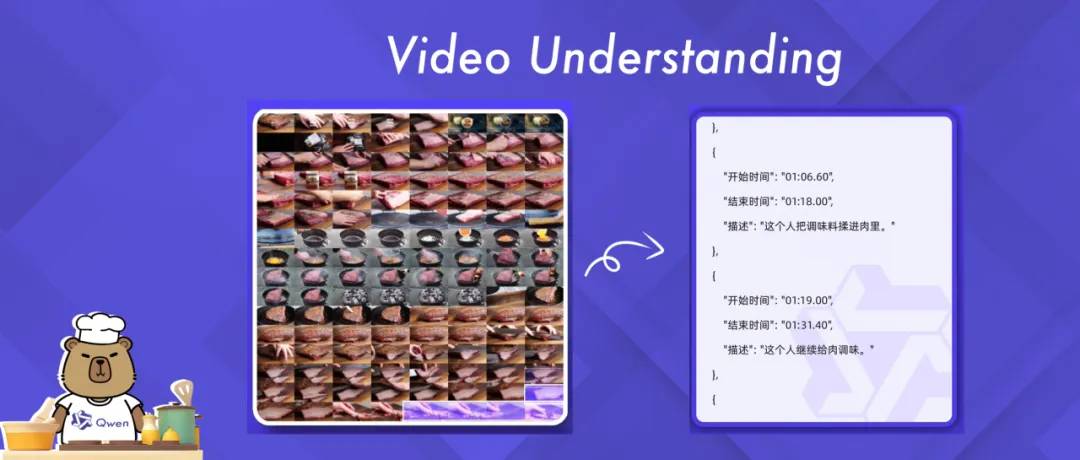

07 Видеопонимание

Модель Qwen2.5-VL обладает мощными возможностями понимания длинного видео и может работать с видеоматериалами длительностью более 1 часа. В этом примере блокнота подробно рассматриваются возможности модели Qwen2.5-VL для задач понимания видео.

Qwen2.5-VL призван продемонстрировать свои возможности в широком спектре сценариев видеоаналитики, от базового OCR (оптического распознавания символов) до сложного обнаружения событий и обобщения контента.

👉 Ссылки на блокнот. https://github.com/QwenLM/Qwen2.5-VL/blob/main/cookbooks/video_understanding.ipynb

Лучшие практики Magic Hitch: пример бесплатной поваренной книги арифметических игр

В сообществе ModelScope Magic Hitch пользователи могут легко испытать эти примеры из Cookbook с помощью свободной арифметики.

Для начала загрузите код Qwen2.5-VL.

git clone https://github.com/QwenLM/Qwen2.5-VL.git

Используйте API Models в Notebook: API-инференция MagicBuilder Platform предоставляет бесплатный API для семейства моделей Qwen2.5-VL, который может быть использован непосредственно пользователями MagicBuilder через API-вызовы, заменив base-URL в Cookbook и заполнив MagicBuilder SDK. Токен Вот и все.Подробная документация: https://www.modelscope.cn/docs/model-service/API-Inference/intro

from openai import OpenAI

client = OpenAI(

api_key="<MODELSCOPE_SDK_TOKEN>", # ModelScope Token

base_url="https://api-inference.modelscope.cn/v1"

)

response = client.chat.completions.create(

model="Qwen/Qwen2.5-VL-72B-Instruct", # ModelScope Model-Id

messages = [

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://modelscope.oss-cn-beijing.aliyuncs.com/demo/images/bird-vl.jpg"}

},

{ "type": "text",

"text": "Count the number of birds in the figure, including those that are only showing their heads. To ensure accuracy, first detect their key points, then give the total number."

},

],

}

],

stream=True

)

Блокнот использует локальную модель: Пожалуйста, выберите модель графического процессора.

Заключение: Добро пожаловать в будущее и создавать его вместе

В будущем команда Qwen продолжит обновлять и расширять эти примеры Notebook, чтобы включить в них больше полезных функций и сценариев применения, стремясь предоставить разработчикам более комплексные решения. Приглашаем вас посетить репозиторий Qwen2.5-VL на GitHub или ModelScope, чтобы ознакомиться с примерами Notebook и поделиться своим опытом и инновационными приложениями! Команда Qwen с нетерпением ждет возможности исследовать возможности Qwen2.5-VL вместе с вами.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...