Observers: легкая библиотека для наблюдаемости ИИ, которая отслеживает данные API-запросов, совместимых с OpenAI

Общее введение

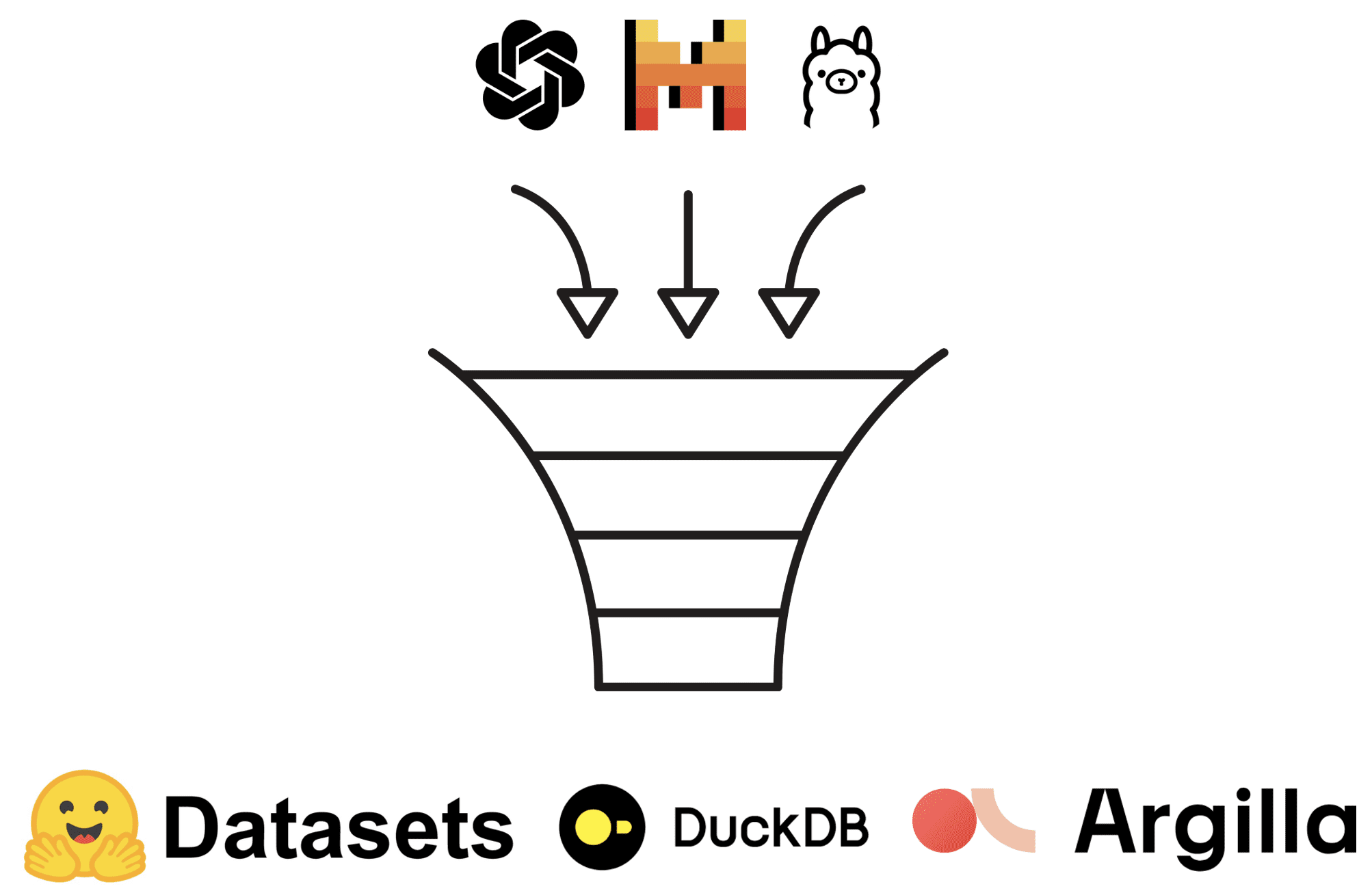

Observers - это Python SDK с открытым исходным кодом, разработанный для обеспечения комплексной наблюдаемости для генеративных API ИИ. Библиотека позволяет пользователям легко отслеживать и записывать взаимодействие с моделями ИИ и хранить эти наблюдения в различных бэкендах. Будь то OpenAI или другой LLM-провайдер, реализующий формат сообщений OpenAI API, наблюдатели могут эффективно отслеживаться и регистрироваться. Благодаря интеграции с такими бэкэндами хранения данных, как DuckDB и Hugging Face, пользователи могут легко запрашивать и анализировать данные о взаимодействии ИИ.

Список функций

- Мониторинг API генеративного искусственного интеллекта: Поддержка OpenAI и других LLM-провайдеров, реализующих формат сообщений OpenAI API.

- Многочисленные внутренние хранилища данных: Поддержка DuckDB, наборов данных Hugging Face и многих других бэкендов для хранения данных.

- Информационное наблюдение за документами: Поддержка множества форматов документов, таких как PDF, DOCX, PPTX, XLSX, изображения, HTML, AsciiDoc и Markdown благодаря интеграции с Docling.

- Поддержка телеметрии с открытым исходным кодом: Поддержка нескольких поставщиков телеметрии благодаря интеграции с OpenTelemetry.

- унифицированный интерфейс: Предоставляет унифицированный интерфейс LLM API через AISuite и Litellm.

Использование помощи

монтаж

Во-первых, вы можете установить Observer SDK с помощью pip:

pip install observers

Если вы хотите использовать другой провайдер LLM через AISuite или Litellm, вы можете установить его с помощью следующей команды:

pip install observers[aisuite] # 或者 observers[litellm]

Если вам нужно наблюдать за информацией о документах, вы можете использовать интеграцию Docling:

pip install observers[docling]

Для поддержки телеметрии с открытым исходным кодом можно установить следующее:

pip install observers[opentelemetry]

пользоваться

Библиотека наблюдателей различает наблюдателей и хранилища. Наблюдатели используют генеративные API ИИ (например, OpenAI или llama-index) и отслеживают их взаимодействие. Класс хранилища, с другой стороны, синхронизирует эти наблюдения с другим бэкендом хранилища (например, DuckDB или Hugging Face dataset).

пример кода (вычисления)

Ниже приведен простой пример кода, показывающий, как отправлять запросы и регистрировать взаимодействие с помощью библиотеки Observer:

from observers.observers import wrap_openai

from observers.stores import DuckDBStore

from openai import OpenAI

store = DuckDBStore()

openai_client = OpenAI()

client = wrap_openai(openai_client, store=store)

response = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "Tell me a joke."}],

)

Код отправляет запрос на бессерверную конечную точку и регистрирует взаимодействие в наборе данных Hub, используя стандартное хранилище DatasetsStore. Набор данных будет размещен в вашем личном рабочем пространстве (например, http://hf.co/{ваше_имя_пользователя}).

Хранение конфигурации

Чтобы настроить другой бэкэнд хранения, можно обратиться к следующему примеру:

- Хранилище DuckDB: По умолчанию используется хранилище DuckDB, которое можно просматривать и запрашивать с помощью DuckDB CLI.

- Хранение набора данных "Обнимающиеся лица: Наборы данных можно просматривать и запрашивать с помощью Hugging Face Datasets Viewer.

- Хранение в Аргилле: Позволяет синхронизировать наблюдения с Argilla.

- Хранилище OpenTelemetry: Позволяет синхронизировать наблюдения с любым провайдером, поддерживающим OpenTelemetry.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...