MoshiVis: модель с открытым исходным кодом для речевого диалога в реальном времени и понимания изображений

Общее введение

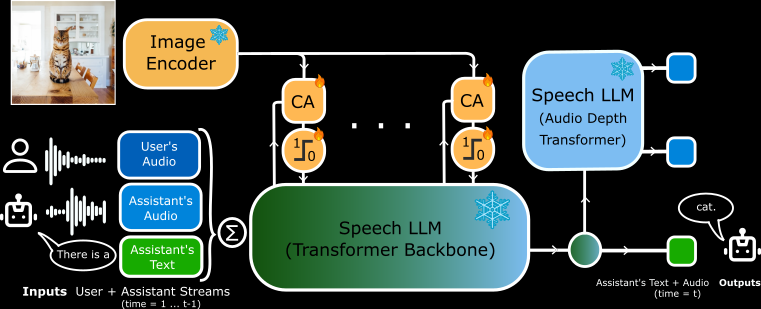

MoshiVis - это проект с открытым исходным кодом, разработанный Kyutai Labs и размещенный на GitHub. В его основе лежит модель преобразования речи в текст Moshi (7B параметров) с примерно 206 миллионами новых параметров адаптации и замороженный визуальный кодер PaliGemma2 (400M параметров), который позволяет модели обсуждать содержание изображения с пользователем в реальном времени с помощью речи. Основные особенности MoshiVis - низкая задержка, естественные диалоги и возможность понимания изображения. Он поддерживает бэкенды PyTorch, Rust и MLX, а пользователи могут бесплатно скачать код и весовые коэффициенты модели для запуска на своих локальных устройствах. Проект ориентирован на разработчиков и исследователей и подходит для изучения взаимодействия ИИ и разработки новых приложений.

Список функций

- Поддержка голосового ввода и вывода в реальном времени, модель быстро реагирует на слова пользователя.

- Способность анализировать содержание изображения и описывать его детали в речи или тексте.

- Для различных аппаратных средств доступны бэкенды PyTorch, Rust и MLX.

- Открытый исходный код и веса моделей, позволяющие пользователям свободно их модифицировать.

- Дизайн с низкой задержкой для сценариев диалога в реальном времени.

- Поддержка форматов квантования (например, 4-битных, 8-битных) для оптимизации памяти и производительности.

- Встроенный механизм перекрестного внимания позволяет объединить визуальную и речевую информацию.

Использование помощи

Для установки и использования MoshiVis требуются некоторые технические навыки. В комплекте поставляются подробные официальные инструкции, а ниже приводится полное руководство по установке и эксплуатации.

Процесс установки

MoshiVis поддерживает три версии бэкенда, что позволяет пользователям выбрать подходящую версию для своего устройства. Минимальные требования включают Python 3.10+ и достаточное количество оперативной памяти (для версии PyTorch рекомендуется 24 ГБ GPU, а версия MLX подходит для Mac).

Установка PyTorch Backend

- Установите зависимость:

pip install -U moshi

- Загрузите модель весов и запустите сервис:

cd kyuteye_pt

python -m moshi.server --hf-repo kyutai/moshika-vis-pytorch-bf16 --port 8088

- интервью

https://localhost:8088Войдите в веб-интерфейс. - Если вы работаете удаленно, вам нужно пробросить порт с помощью SSH:

ssh -L 8088:localhost:8088 user@remote

Установка бэкенда Rust

- Установите инструментарий Rust (через

rustup(Доступ). - Настройте поддержку GPU (Metal для Mac, CUDA для NVIDIA).

- Запустите службу:

cd kyuteye_rs

cargo run --features metal --bin moshi-backend -r -- --config configs/config-moshika-vis.json standalone --vis

- Как только вы увидите надпись "standalone worker listening", зайдите в раздел

https://localhost:8088. - Дополнительная квантифицированная версия:

cargo run --features metal --bin moshi-backend -r -- --config configs/config-moshika-vis-q8.json standalone --vis

Установка MLX Backend (рекомендуется Mac)

- Установите зависимость MLX:

pip install -U moshi_mlx

- Служба запуска (поддерживает несколько форматов квантования)

cd kyuteye_mlx

python -m moshi_mlx.server # 默认 BF16

python -m moshi_mlx.server -q 4 # 4 位量化

python -m moshi_mlx.server -q 8 # 8 位量化

- интервью

http://localhost:8008Используйте веб-интерфейс.

Установка фронтальной части

- Загрузите предварительно созданный клиент:

pip install fire rich huggingface_hub

python scripts/get_static_client.py

- Сгенерируйте сертификат SSL (для HTTPS):

openssl req -x509 -nodes -days 365 -newkey rsa:2048 -keyout key.pem -out cert.pem

- По умолчанию бэкэнд предоставляет веб-интерфейс, не требующий дополнительных операций.

Основные функции

голосовой диалог в реальном времени (RTV)

- перейти: После запуска службы откройте веб-интерфейс (

https://localhost:8088возможноhttp://localhost:8008). Нажмите на значок микрофона, чтобы начать разговор. - типичный пример: Скажите "Привет", и модель ответит женским голосом (Moshika) "Здравствуйте, чем я могу вам помочь?". .

- точка: Задержка до миллисекунд, чтобы обеспечить включение привилегий микрофона.

- адаптировать: Версия Rust поддерживает интерфейс командной строки:

cd kyuteye_rs

cargo run --bin moshi-cli -r -- tui --host localhost

графическое понимание

- перейти: Загрузите изображение в веб-интерфейсе или укажите путь в командной строке:

python -m moshi_mlx.server -q 8 --image path/to/image.jpg

- буровая установкаЗагрузите его и спросите: "Что это?". Модель опишет его фонетически, например, "Это изображение голубого неба с белыми облаками".

- характеристика: Основанный на кодере PaliGemma2, он распознает объекты, цвета и сцены.

Персонализация модели

- перейти: Скачать другие весчи из Hugging Face (например.

kyutai/moshika-vis-mlx-bf16), замените путь в конфигурационном файле. - буровая установка: Модификация

configs/moshika-vis.yamlвозможноconfig-moshika-vis.jsonПерезапустите службу. - использовать: Настройте стиль голоса или оптимизируйте исполнение.

Полная процедура работы

- Выберите бэкэнд: Выберите PyTorch (GPU), Rust (кроссплатформенный) или MLX (Mac) в зависимости от вашего устройства.

- среда установки: Установите зависимости и модели в соответствии с приведенной выше командой.

- Начальные услуги: Запустите бэкэнд и дождитесь готовности сервиса.

- Интерфейс подключения: Зайдите на указанный порт с помощью браузера.

- Пробный голос: Произносите простые предложения и проверяйте ответы.

- Тестовые изображения: Загружайте фотографии и задавайте вопросы голосом.

- Настройки оптимизации: Настройка параметров квантования (

-q 4возможно-q 8) или номер порта.

предостережение

- HTTPS требует наличия SSL-сертификата, иначе браузеры могут ограничить доступ к микрофону.

- Квантование не поддерживается в PyTorch и требует высокопроизводительного GPU.

- Версия Rust требует времени на компиляцию, поэтому будьте терпеливы, когда запускаете ее в первый раз.

- Версия MLX стабильно работает на M3 MacBook Pro, рекомендуется для пользователей Mac.

сценарий применения

- Образовательная поддержка

Студенты загружают изображения из учебника, а MoshiVis объясняет их содержание с помощью звука, например, "Это схема строения клетки, на которой изображены ядро и митохондрии". - Помощь в обеспечении доступности

Пользователи с ослабленным зрением ежедневно загружали фотографии моделей с описанием "это полка супермаркета, полная молока и хлеба". - развивающий эксперимент

Разработчики используют его для создания голосовых помощников, которые интегрируются в смарт-устройства для взаимодействия с изображением.

QA

- Поддерживает ли MoshiVis работу в автономном режиме?

Да. После установки все функции работают локально, не требуя подключения к Интернету. - Поддерживает ли Voice несколько языков?

В настоящее время поддерживает в основном английские диалоги и описания, функциональность других языков ограничена. - Подойдет ли недорогой компьютер?

Версия MLX работает на обычном Mac, а версия PyTorch требует 24 ГБ памяти GPU.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие посты

Нет комментариев...