MiMo-VL - мультимодальная модель Xiaomi с открытым исходным кодом

Что такое МиМо-ВЛ

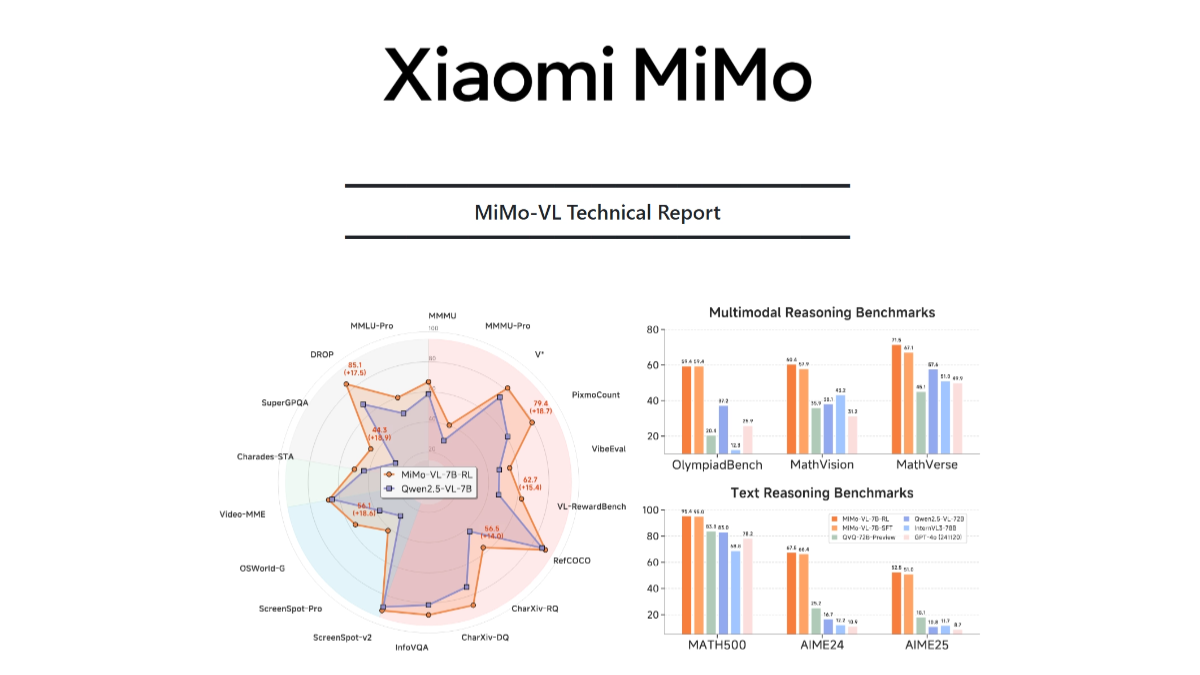

MiMo-VL - это мультимодальная модель Xiaomi с открытым исходным кодом, которая состоит из визуального кодера, кросс-модального проекционного слоя и языковой модели. Визуальный кодер основан на Qwen2.5-ViT, который поддерживает входные данные с родным разрешением и сохраняет больше деталей; языковая модель - это собственная разработка Xiaomi MiMo-7B, оптимизированная для сложных рассуждений. Модель основана на многоступенчатой стратегии предварительного обучения и тренируется на 2,4 Т лексем мультимодальных данных, охватывающих такие типы данных, как пары изображение-текст, видео-текст и последовательности операций графического интерфейса. Основанный на гибридном онлайн-обучении с подкреплением (MORL) алгоритм улучшает вывод модели, перцептивную производительность и пользовательский опыт во всех аспектах. MiMo-VL демонстрирует хорошие результаты в сложных выводах по изображениям, взаимодействии с графическим интерфейсом, понимании видео и разборе длинных документов, например, он достигает 66.7% на MMMU-val, превосходя Gemma 3 27B; 59.4% на OlympiadBench 59.4% на OlympiadBench, превосходя модель 72B.

Ключевые особенности MiMo-VL

- Рассуждения и викторина по сложным картинкам: Точно понимает содержание сложных картинок, давая разумные объяснения и ответы.

- Работа и взаимодействие с графическим интерфейсом: Поддерживает до 10+ шагов операций графического интерфейса для понимания и выполнения сложных инструкций.

- Видео и понимание языка: Понимание содержания видео, рассуждения и викторины в сочетании с языком.

- Разбор и обоснование длинных документовОбработка длинных документов для сложных рассуждений и извлечения информации.

- Оптимизация пользовательского опыта: Улучшение умозаключений, перцептивной производительности и пользовательского опыта на основе гибридного онлайн-обучения с подкреплением.

Адрес официального сайта MiMo-VL

- Репозиторий Github::https://github.com/XiaomiMiMo/MiMo-VL

- Библиотека моделей HuggingFace::https://huggingface.co/collections/XiaomiMiMo/mimo-vl

- Технические документы::https://github.com/XiaomiMiMo/MiMo-VL/blob/main/MiMo-VL-Technical-Report

Как использовать MiMo-VL

- Платформа для обнимающихся лиц::

- Доступ к библиотеке моделей Hugging Face: Доступ к MiMo-VL'sБиблиотека моделей обнимающихся лицСтраница.

- Модели для погрузки: Используйте библиотеку Python Hugging Face для загрузки модели MiMo-VL. Пример:

from transformers import AutoModelForVision2Seq, AutoProcessor

model = AutoModelForVision2Seq.from_pretrained("XiaomiMiMo/mimo-vl")

processor = AutoProcessor.from_pretrained("XiaomiMiMo/mimo-vl")- Обработка входных данных: Входные данные, такие как изображения, видео или текст, предварительно обрабатываются процессором.

- Сгенерировать вывод: Ввод обработанных данных в модель и получение выходных данных модели.

- Репозиторий GitHub::

- Клонирование репозиториев GitHub: ДоступРепозиторий GitHubКлонируйте репозиторий локально.

git clone https://github.com/XiaomiMiMo/MiMo-VL.git- Установка зависимостей: Установите необходимые зависимости Python в соответствии с файлом requirements.txt в репозитории.

pip install -r requirements.txt- работающий код: Следуйте инструкциям в репозитории, чтобы запустить код примера или открыть приложение.

Основные преимущества MiMo-VL

- Сильная способность к мультимодальному слияниюОбработка мультимодальных данных, таких как изображения, видео и текст, для понимания сложных сценариев.

- Превосходная производительность вывода: Отличная производительность в нескольких бенчмарках, например 66,71 TP3T в MMMU-val и 59,41 TP3T в OlympiadBench.

- Оптимизация пользовательского опыта: Основанная на смешанном онлайновом обучении с подкреплением (MORL), модель поведения динамически корректируется на основе обратной связи с пользователем для повышения удобства работы с ней.

- Широкий спектр сценариев примененияПрименяется в различных областях, таких как интеллектуальное обслуживание клиентов, умный дом и научные исследования.

- Открытый исходный код и поддержка сообщества: Предоставление открытого исходного кода и поддержка сообщества для содействия исследованиям и разработкам разработчиков.

Люди, для которых предназначен МиМо-ВЛ

- Исследователи искусственного интеллектаФокусируется на исследованиях в области мультимодального слияния, сложных рассуждений, зрения и понимания языка.

- Разработчики и инженеры: Разработка интеллектуальных приложений, таких как "умное" обслуживание клиентов, "умный" дом, "умное" здравоохранение и т. д., требует интеграции мультимодальной функциональности.

- специалист по анализу данных: Обработка и анализ мультимодальных данных для повышения производительности модели и эффективности обработки данных.

- Преподаватели и студенты: Помощь в преподавании и обучении, например, решение математических задач, обучение программированию и т.д.

- Медицинские работники: Помощь в анализе медицинских изображений и понимании текста для повышения эффективности и точности диагностики.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...