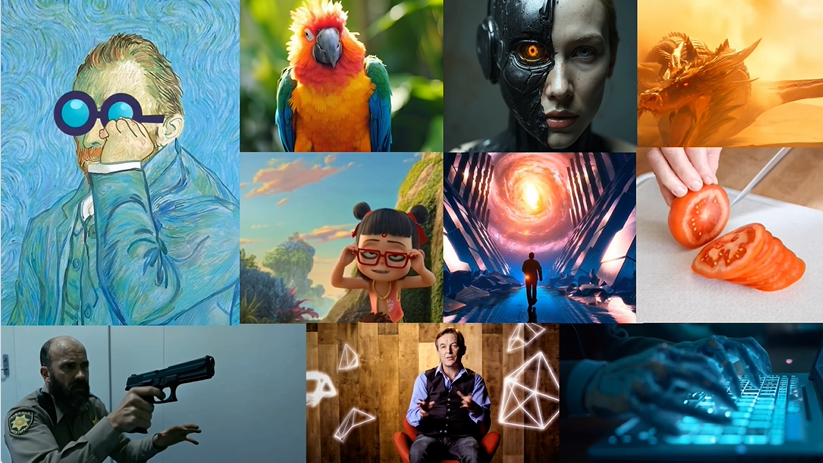

Magic 1-For-1: эффективная генерация видео - проект с открытым исходным кодом, претендующий на создание одноминутного видео за одну минуту

Общее введение

Magic 1-For-1 - это эффективная модель генерации видео, разработанная для оптимизации использования памяти и уменьшения времени ожидания вывода. Модель декомпозирует задачу генерации текста в видео на две подзадачи: генерацию текста в изображение и генерацию изображения в видео для более эффективного обучения и дистилляции. Magic 1-For-1 может генерировать высококачественные одноминутные видеоклипы менее чем за минуту для сценариев, в которых необходимо быстро генерировать короткие видео. Проект был разработан исследователями из Пекинского университета, Hedra Inc. и Nvidia, а код и весовые коэффициенты модели находятся в открытом доступе на GitHub.

Список функций

- Генерация текста в изображение: преобразование входного текстового описания в изображение.

- Генерация изображений в видео: преобразование сгенерированных изображений в видеоклипы.

- Эффективное использование памяти: оптимизация использования памяти для сред с одним GPU.

- Быстрый вывод: уменьшение задержки вывода для быстрого создания видео.

- Загрузка весов модели: предоставляет ссылки для загрузки предварительно обученных весов модели.

- Настройка среды: содержит подробное руководство по настройке среды и установке зависимостей.

Использование помощи

Параметры окружающей среды

- Установите git-lfs:

sudo apt-get install git-lfs

- Среда Conda создана и активирована:

conda create -n video_infer python=3.9

conda activate video_infer

- Установите зависимости проекта:

pip install -r requirements.txt

Скачать модельные веса

- Создайте каталог для хранения предварительно обученных весов:

mkdir pretrained_weights

- Скачать Магия 1-For-1 весов:

wget -O pretrained_weights/magic_1_for_1_weights.pth <model_weights_url>

- Загрузите компонент "Обнимающиеся лица":

huggingface-cli download tencent/HunyuanVideo --local_dir pretrained_weights --local_dir_use_symlinks False

huggingface-cli download xtuner/llava-llama-3-8b-v1_1-transformers --local_dir pretrained_weights/text_encoder --local_dir_use_symlinks False

huggingface-cli download openai/clip-vit-large-patch14 --local_dir pretrained_weights/text_encoder_2 --local_dir_use_symlinks False

Создать видео

- Выполните следующие команды для генерации текста и изображения в видео:

python test_ti2v.py --config configs/test/text_to_video/4_step_ti2v.yaml --quantization False

- Или воспользуйтесь предоставленным скриптом:

bash scripts/generate_video.sh

Подробный порядок работы функций

- Генерация текста в изображение: Введите текстовое описание, и модель сгенерирует соответствующее изображение.

- Генерация изображений в видео: Введите сгенерированные изображения в модуль генерации видео для создания коротких видеоклипов.

- Эффективное использование памяти: Обеспечивает эффективную работу даже в средах с одним GPU, оптимизируя использование памяти.

- быстрый вывод: Сокращение задержки вывода и достижение быстрого создания видео для сценариев, требующих быстрого создания коротких видео.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...