LongCat-Next - 美团龙猫开源的原生多模态大模型

LongCat-Next是什么

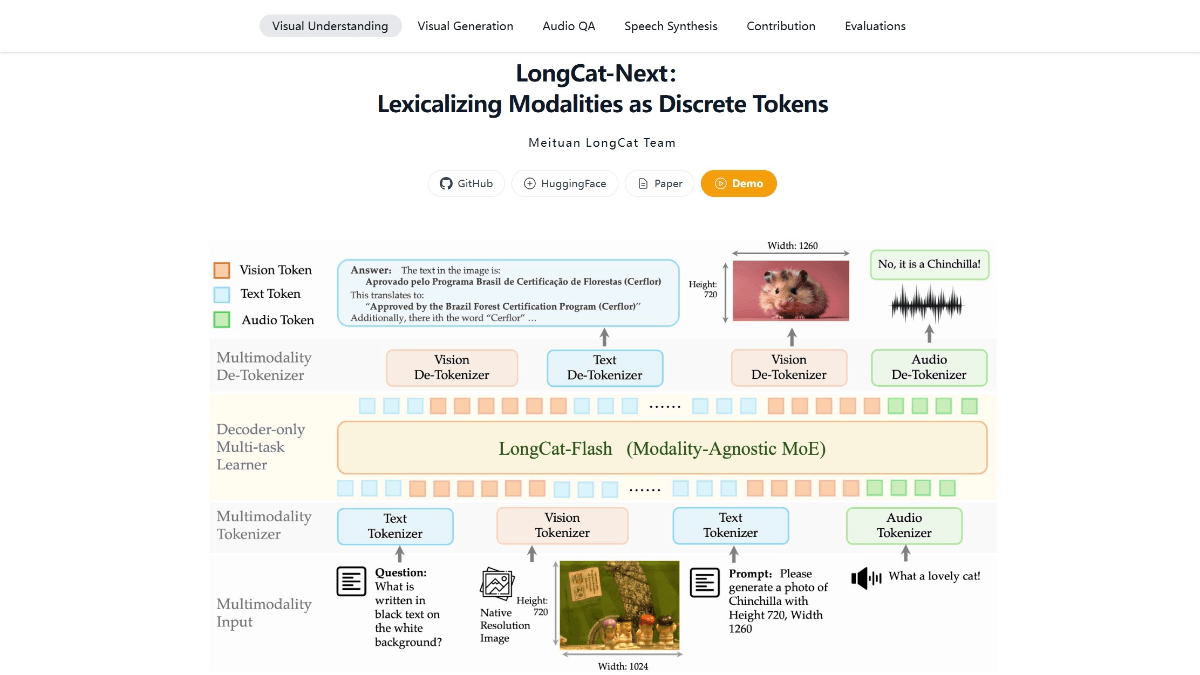

LongCat-Next 是美团龙猫开源的原生多模态大模型,采用"下一个Token预测"(NTP)统一架构,将图像、语音与文本映射为同源离散Token,打破传统"语言为中心"的拼凑式设计。核心创新包括DiNA离散原生自回归架构、dNaViT动态分辨率视觉分词器(28倍压缩比)及语义对齐完备编码器,实现视觉与语音的"原生理解"。在OmniDocBench、MathVista、τ²-Bench等基准测试中,LongCat-Next表现超越Qwen3-Omni等同类模型,代码能力(SWE-Bench 43.0)与纯文本能力(MMLU-Pro 77.02)同样领先。

LongCat-Next的功能特色

- 原生多模态统一架构:采用DiNA(离散原生自回归)架构,将图像、语音、文本统一映射为同源离散Token,通过单一"下一个Token预测"(NTP)范式完成所有模态的理解与生成,打破传统"语言为中心"的拼凑式设计。

- 动态分辨率视觉理解:基于dNaViT(离散原生分辨率视觉分词器),支持28倍压缩比下的高质量视觉编码,可处理任意分辨率的图像输入,实现像素级精度的视觉理解。

- 端到端语音交互:语音直接作为离散Token输入输出,无需独立的ASR/TTS模块,支持自然流畅的语音对话与跨模态转换。

- 多模态推理与工具调用:具备跨模态联合推理能力,支持视觉问答、图表分析、文档理解,并能调用外部工具完成复杂任务(τ²-Bench零售场景得分73.68)。

- 高质量视觉生成:通过反分词器实现从离散Token到高保真图像的生成,支持图像编辑、风格迁移等创作任务。

- 代码与文本能力兼备:SWE-Bench代码能力得分43.0,MMLU-Pro纯文本能力77.02,证明原生多模态训练未削弱语言核心能力。

- 开源可部署:模型权重与训练代码全面开源,支持3×80GB GPU部署,提供完整的技术文档与示例。

LongCat-Next的核心优势

- 架构统一性领先:首创DiNA离散原生自回归架构,彻底摒弃传统"视觉编码器+语言模型+生成头"的三段式拼凑,将图像、语音、文本统一为同源离散Token,实现真正的端到端多模态原生理解。

- 信息保真度突破:通过语义对齐完备编码器结合SAE(稀疏自编码器)与RVQ(残差向量量化),破解"离散化必然损失信息"的行业难题,在28倍压缩比下仍保持高质量视觉表示。

- 跨模态性能均衡:在OmniDocBench、MathVista、τ²-Bench等多个基准测试中全面超越Qwen3-Omni,代码能力(SWE-Bench 43.0)与纯文本能力(MMLU-Pro 77.02)同步领先,无"偏科"现象。

- 动态分辨率适配:dNaViT支持任意分辨率图像输入,无需固定尺寸裁剪,在学术论文、财报、表格等复杂版式文档理解上表现优异。

- 端到端效率优化:语音直接以Token形式流转,省去传统ASR/TTS的级联延迟与误差累积,交互更自然流畅。

- 开源生态完整:美团全面开源模型权重、训练代码及技术细节,降低多模态大模型研究门槛,推动行业技术普惠。

LongCat-Next官网是什么

- Веб-сайт проекта:https://longcat.chat/longcat-next/intro

- Репозиторий GitHub:https://github.com/meituan-longcat/LongCat-Next

- Библиотека моделей HuggingFace:https://huggingface.co/meituan-longcat/LongCat-Next

- Технические документы:https://github.com/meituan-longcat/LongCat-Next/blob/main/tech_report.pdf

使用LongCat-Next的操作步骤

- Подготовка к защите окружающей среды:确保拥有至少3张80GB显存的GPU(如H100/A100),安装Python 3.10+及CUDA 12.1+环境。

- Получение модели:访问GitHub仓库(https://github.com/meituan-longcat/LongCat-Next)克隆代码,从Hugging Face下载预训练模型权重。

- Установка зависимостей: Реализация

pip install -r requirements.txt安装transformers、torch、accelerate等核心依赖库。 - Модели для погрузки:使用Hugging Face Transformers接口加载模型与分词器,初始化DiNA架构及dNaViT视觉编码器。

- Приготовьтесь к поступлению:将图像、音频或文本转换为模型支持的格式,图像通过dNaViT编码为离散视觉Token,音频通过声学编码器转为离散Token。

- исполнительное мышление:调用模型生成接口,输入多模态Token序列,模型通过NTP范式自回归生成下一个Token,支持多轮对话与工具调用。

- 解析输出:将生成的离散Token解码为对应模态输出,文本直接输出,图像Token经反分词器还原为图片,音频Token经声码器合成语音。

- 微调部署(可选):基于自有数据使用官方脚本进行LoRA或全参数微调,适配特定业务场景后部署为API服务。

LongCat-Next的适用人群

- AI研究人员与算法工程师:从事多模态大模型架构创新、离散Token表示学习、原生多模态统一建模等前沿方向的研究者,可基于开源代码深入探索DiNA与dNaViT技术细节。

- 企业开发者与架构师:需要构建端到端多模态应用(如智能客服、文档理解、视觉问答系统)的技术团队,可利用LongCat-Next的统一架构简化系统复杂度,降低多模块拼接的维护成本。

- 语音交互产品团队:开发语音助手、智能座舱、智能硬件等产品的团队,可借助原生语音Token流转能力,实现更自然流畅的语音交互体验,省去传统ASR/TTS级联链路。

- 视觉内容创作者:需要进行图像生成、编辑、风格迁移及复杂文档(论文、财报、表格)理解的创作者与分析师,可利用其高保真视觉编解码能力提升生产效率。

- 科研与教育机构:高校实验室、科研院所等具备A100/H100算力资源的机构,可用于多模态大模型教学、学术研究及垂直领域模型微调。

- Участники сообщества с открытым исходным кодом:关注大模型开源生态的开发者,可参与LongCat-Next的代码优化、功能扩展及社区建设,推动原生多模态技术普惠。

LongCat-Next的常见问题FAQ

Q:LongCat-Next对硬件的最低要求是什么?

A:官方建议至少配备3张80GB显存的GPU(如NVIDIA H100或A100),用于模型推理与微调。消费级显卡无法直接运行完整模型。

Q:LongCat-Next与Qwen3-Omni有什么区别?

A:LongCat-Next采用原生多模态统一架构(DiNA),将图像、语音、文本统一为离散Token进行端到端训练;而Qwen3-Omni属于"语言为中心"的拼凑式架构,依赖独立的视觉/语音编码器与生成模块。

Q:模型支持哪些输入输出模态?

A:支持文本、图像、语音三种模态的任意组合输入,可输出文本、生成图像、合成语音,实现真正的跨模态理解与生成。

Q:LongCat-Next是否支持商业用途?

A:需查阅官方发布的开源协议(通常为Apache 2.0或类似许可),建议企业用户在正式商用前确认授权范围及合规要求。

Q:模型在中文场景表现如何?

A:作为美团龙猫团队出品,LongCat-Next针对中文语境进行了充分优化,在中文文档理解、多轮对话等场景表现优异。

Q:是否支持模型微调?

A:支持,官方提供LoRA与全参数微调脚本,用户可基于自有领域数据(如医疗影像、教育内容)进行定制化训练。

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...