Groq: поставщик решений для ускорения вывода больших моделей ИИ, высокоскоростной бесплатный интерфейс больших моделей

Groq Общее представление

Компания Groq, расположенная в Маунтин-Вью, штат Калифорния, разработала чип GroqChip™ и блок обработки языка Language Processing Unit™ (LPU). Компания известна своими тензорными процессорами, разработанными для приложений искусственного интеллекта с низкой задержкой.

Компания Groq была основана в 2016 году, и в том же году ее название было официально защищено торговой маркой. Основной продукт Groq - блок обработки языка (LPU), новый класс чипов, предназначенных не для обучения моделей ИИ, а для их быстрого запуска. Системы LPU компании Groq возглавили новое поколение ускорителей ИИ, которые предназначены для обработки последовательных данных (например, ДНК, музыки, кода,) естественный язык) и превосходят графические процессоры.

Groq поддерживает стандартные фреймворки машинного обучения, такие как PyTorch, TensorFlow и ONNX. Кроме того, компания предлагает пакет GroqWare™, включающий инструменты для индивидуальной разработки и оптимизации рабочих нагрузок, такие как Groq Compiler.

Список функций Groq

- Обработка приложений ИИ в режиме реального времени

- Поддержка стандартных фреймворков машинного обучения

- Поддержка легкого оборудования для SaaS и PaaS

- Обеспечение быстрой и точной работы искусственного интеллекта

- Комплект GroqWare™ для оптимизации рабочих нагрузок по индивидуальному заказу

- Обеспечение точности, энергоэффективности и воспроизводимости крупномасштабных выводов

Помощь Groq

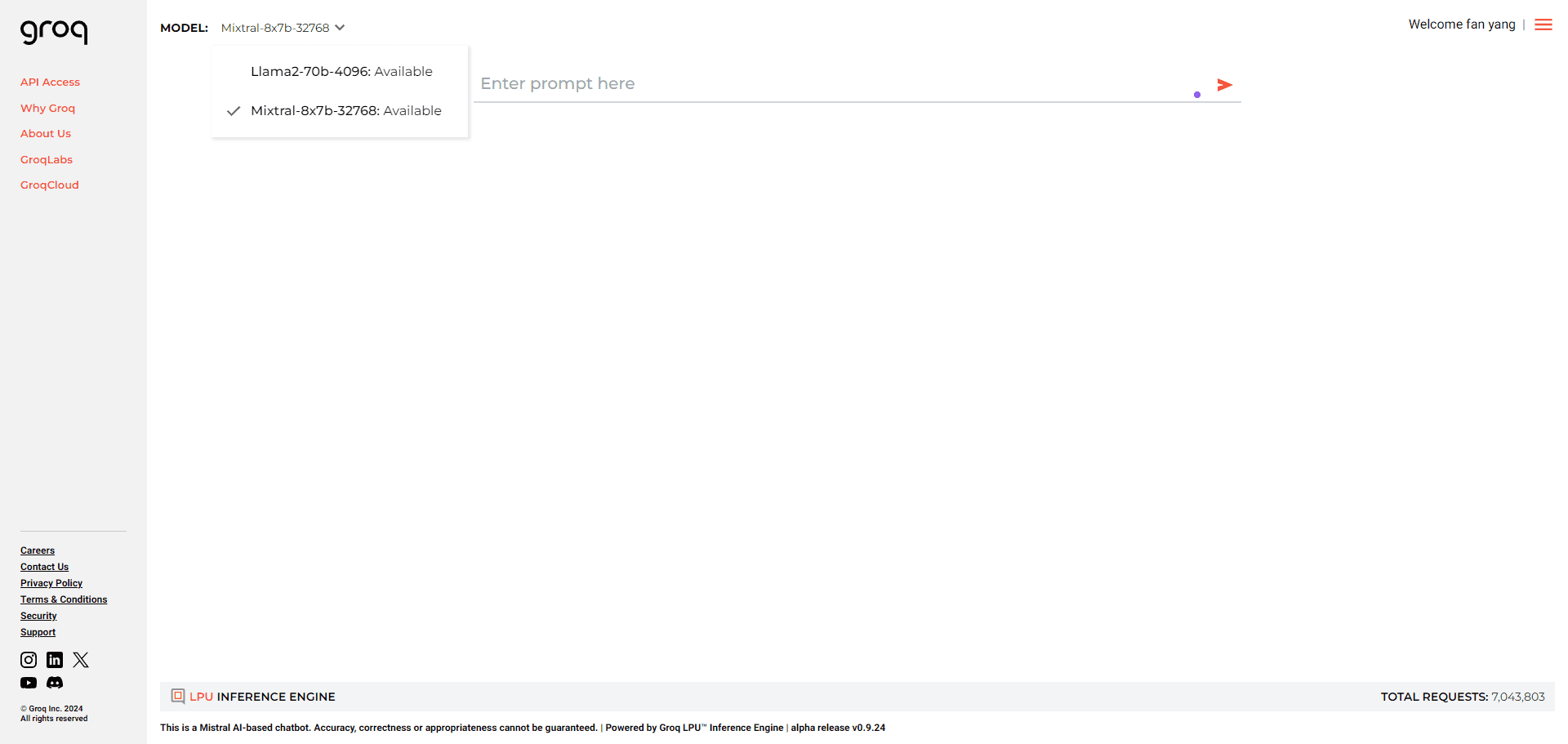

- Разработчики могут самостоятельно предоставлять доступ для разработчиков через Playground на GroqCloud

- Если вы используете OpenAI API, то для конвертации в Groq вам понадобятся всего три вещи: ключ Groq API, конечная точка и модель.

- Если вам нужны самые быстрые рассуждения в масштабах центра обработки данных, мы должны поговорить об этом.

Вы можете.Нажмите здесьПодайте бесплатную заявку на APIKEY и выберите модель после завершения рассмотрения заявки:

Завершение чата

| ID | Запросы в минуту | Запросы в день | Жетоны в минуту | Жетоны в день |

|---|---|---|---|---|

| gemma-7b-it | 30 | 14,400 | 15,000 | 500,000 |

| gemma2-9b-it | 30 | 14,400 | 15,000 | 500,000 |

| llama-3.1-70b-versatile | 30 | 14,400 | 20,000 | 500,000 |

| лама-3.1-8b-инстант | 30 | 14,400 | 20,000 | 500,000 |

| llama-3.2-11b-text-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-1b-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-3b-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-90b-text-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-guard-3-8b | 30 | 14,400 | 15,000 | 500,000 |

| лама3-70б-8192 | 30 | 14,400 | 6,000 | 500,000 |

| лама3-8b-8192 | 30 | 14,400 | 30,000 | 500,000 |

| llama3-groq-70b-8192-tool-use-preview | 30 | 14,400 | 15,000 | 500,000 |

| llama3-groq-8b-8192-tool-use-preview | 30 | 14,400 | 15,000 | 500,000 |

| llava-v1.5-7b-4096-preview | 30 | 14,400 | 30,000 | (Без ограничений) |

| mixtral-8x7b-32768 | 30 | 14,400 | 5,000 | 500,000 |

Передача речи в текст

| ID | Запросы в минуту | Запросы в день | Аудиосекунды в час | Аудиосекунды в день |

|---|---|---|---|---|

| distil-whisper-large-v3-en | 20 | 2,000 | 7,200 | 28,800 |

| шепот - большой - 3 | 20 | 2,000 | 7,200 | 28,800 |

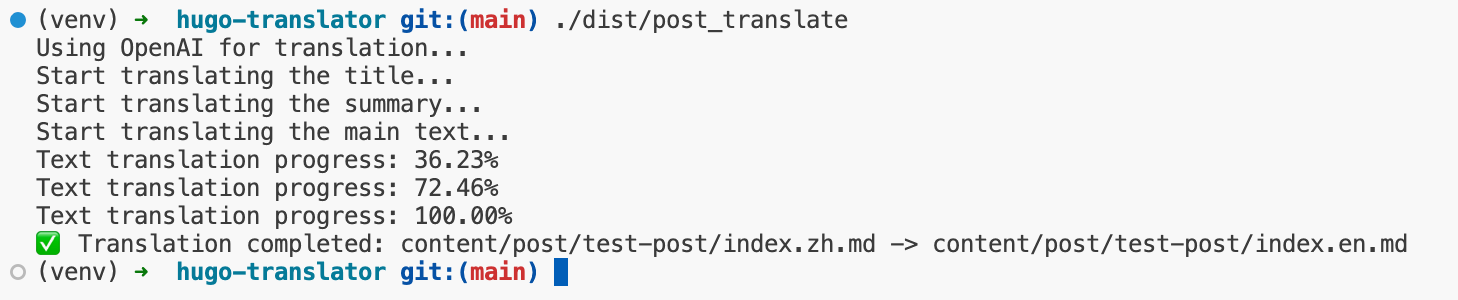

Далее, в качестве примера возьмем формат curl. Этот интерфейс совместим с форматом интерфейса OPENAI, так что используйте свою фантазию, пока есть интерфейсы, позволяющие настраивать API OPENAI, а также использовать Groq.

curl -X POST "https://api.groq.com/openai/v1/chat/completions" \

-H "Authorisation: Bearer $GROQ_API_KEY" \

-H "Content-Type: application/json" \

-d '{"messages": [{"role": "user", "content": "Explain importance of low latency LLMs"}], "model": "mixtral-8x7b-32768"}'

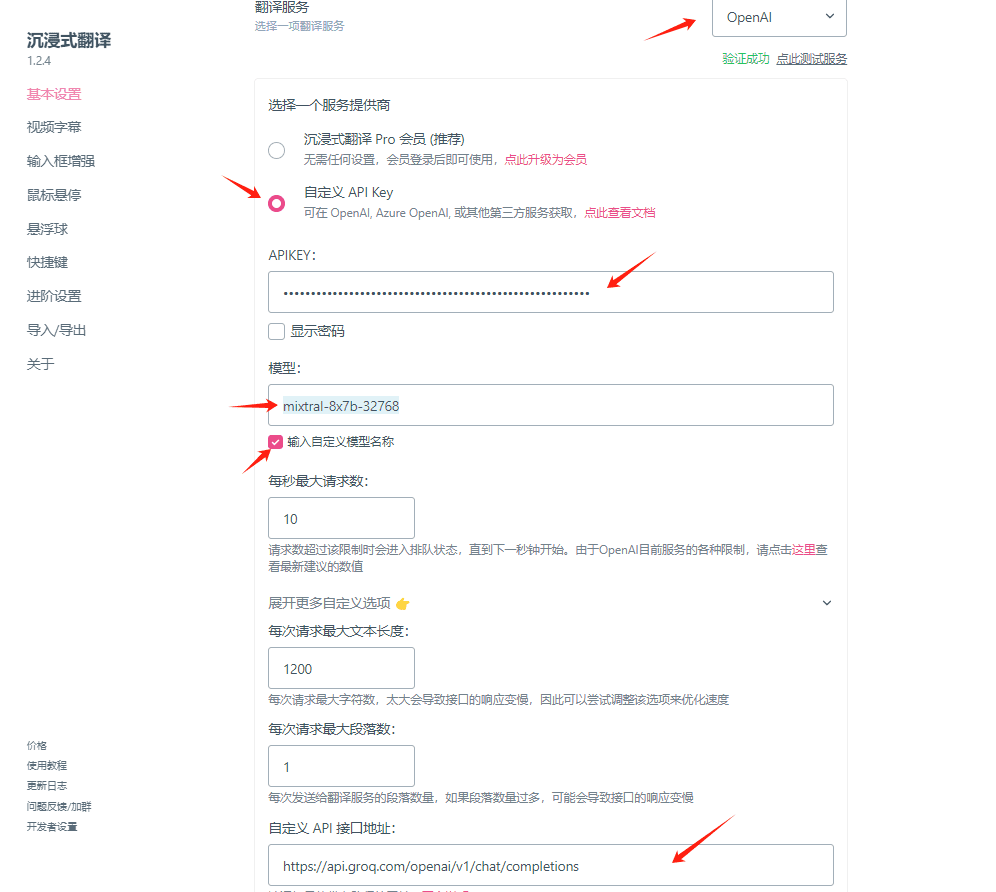

Пример использования: настройка ключей Groq для использования в плагине Immersive Translation Plugin

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...