GLM-4.7-Flash - 智谱开源的混合专家架构语言模型

GLM-4.7-Flash是什么

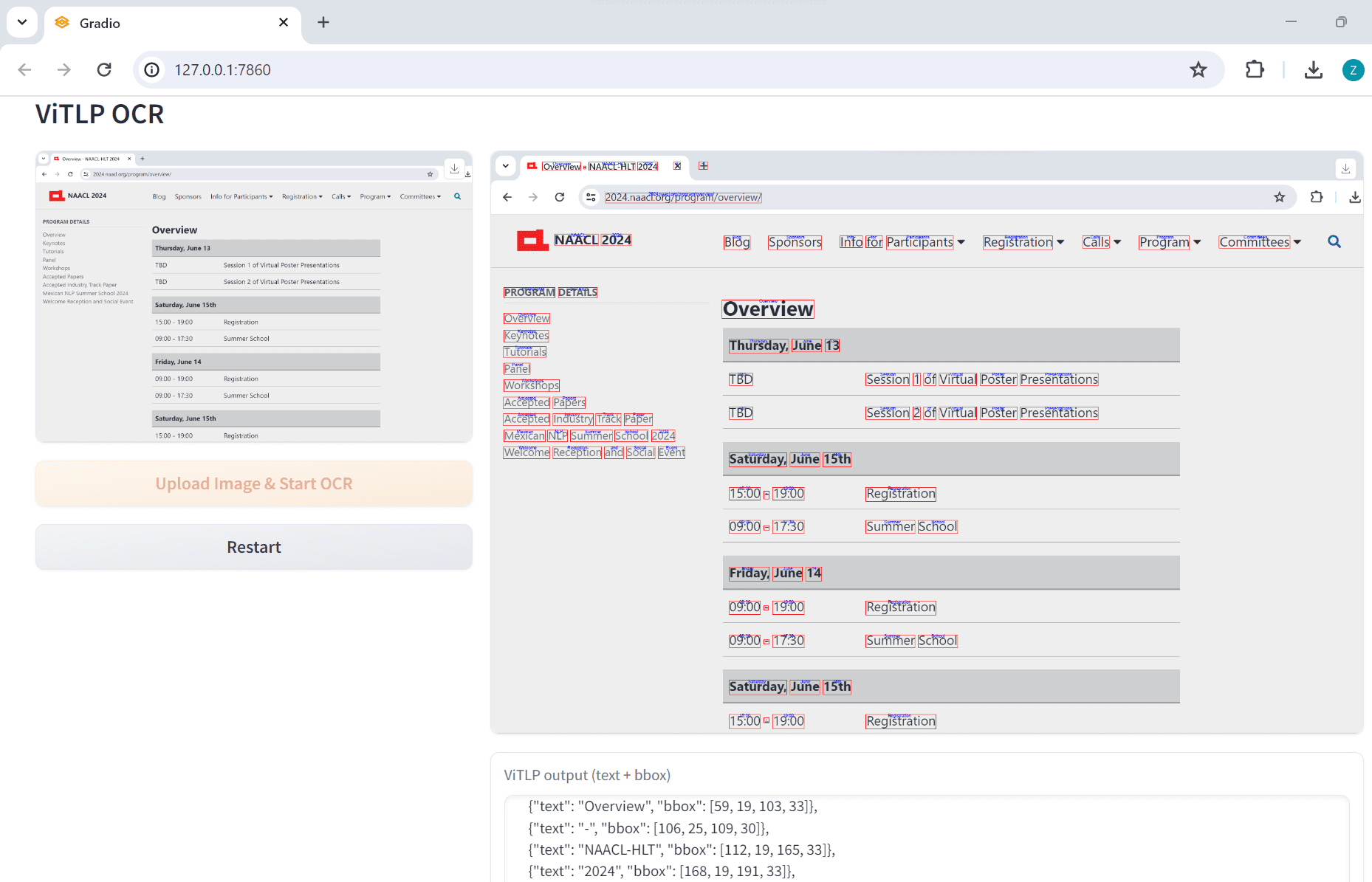

GLM-4.7-Flash是智谱开源的混合专家架构语言模型,参数规模为30B,激活参数量3B,上下文窗口达200K,最大输出令牌为128K。在编程能力上表现出色,SWE-bench验证集分数达59.2,任务执行能力强,AIME 25、GPQA、LCB v6等任务得分分别为91.6、75.2、64.0,高负载下错误率仅0.3%,一致性达96.7%。模型采用多阶段思考机制,支持轻量化部署,适用于本地编程、智能体任务和工具调用等场景,是30B级别中的性能标杆,适合开发者、研究人员及企业用户使用。

GLM-4.7-Flash的功能特色

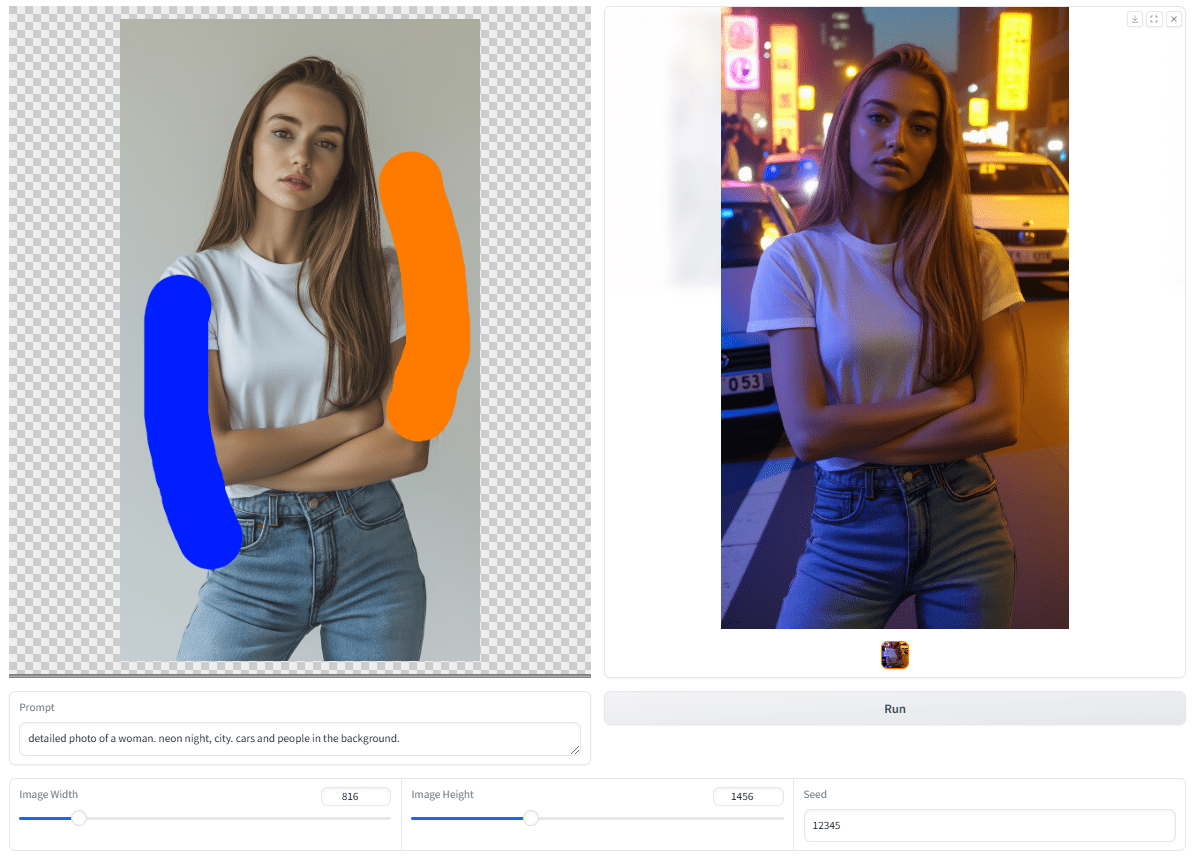

- 高效编程辅助:能生成高质量代码,支持本地编程,提升开发效率。

- Выполнение сложных задач:具备强大的任务规划和执行能力,适用于智能体任务。

- Оптимизация вызовов инструментов:在工具调用方面表现强劲,支持高效的工具交互。

- 高稳定性支持:在高负载条件下,错误率极低,一致性高,保障稳定运行。

- 轻量化部署:作为30B类别中的轻量化模型,平衡性能与效率,适合多种部署场景。

GLM-4.7-Flash的核心优势

- 卓越编程能力:在编程基准测试中表现优异,能高效生成高质量代码,特别适合开发者使用。

- 高负载稳定性:在高负载条件下错误率极低,一致性高达96.7%,确保长时间稳定运行。

- Легкая конструкция:作为30B级别中的轻量化模型,兼顾性能与效率,适合多种部署需求。

- 多阶段思考机制:采用混合思考模式,能高效处理复杂任务,提升任务执行能力。

- С открытым исходным кодом и бесплатно:模型权重完全开源,用户可以免费调用,降低了使用门槛。

GLM-4.7-Flash官网是什么

- Библиотека моделей HuggingFace:https://huggingface.co/zai-org/GLM-4.7-Flash

GLM-4.7-Flash的适用人群

- разработчики:适合需要高效编程辅助的软件开发者,能够提升代码生成和调试效率。

- научный сотрудник:可用于研究复杂任务处理和模型优化,助力学术研究和技术探索。

- бизнес-пользователь:适合对性能有较高要求且需要轻量化部署的企业,支持高效工具交互。

- Разработчик умного тела:适用于开发智能体任务,支持复杂的任务规划和执行能力。

- Участники сообщества с открытым исходным кодом:由于模型开源,适合开源社区的开发者参与贡献和二次开发。

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...