FitDiT: высокоточный инструмент для виртуальной примерки с искусственным интеллектом для повышения достоверности деталей одежды

Общее введение

FitDiT - это высокоточная система виртуальной примерки, основанная на диффузионных трансформаторах. Разработанный Tencent AI Lab, проект направлен на устранение ограничений традиционных систем виртуальной примерки в отображении деталей одежды. FitDiT предлагает новую алгоритмическую архитектуру, которая лучше сохраняет подлинные детали одежды, делая эффект виртуальной примерки более реалистичным. Проект имеет полностью открытый исходный код и предоставляет онлайн-демонстрации, предварительно обученные модели и полные кодовые реализации для поддержки исследователей и разработчиков для академических исследований и коммерческих предварительных исследований. Проект выпустил статью в ноябре 2024 года и последовательно открыл онлайн-демонстрацию, набор данных и весовые коэффициенты моделей в декабре 2024 года, что привлекло широкое внимание академических и промышленных кругов.

Онлайн-демонстрация: https://huggingface.co/spaces/BoyuanJiang/FitDiT

Список функций

- Полностью автоматизированная функция создания виртуальных фитингов

- Интеллектуальная генерация масок для подгоночных зон

- Ручная настройка маски и инструменты редактирования

- Поддержка эффекта подгонки в нескольких разрешениях

- Оптимизация точности воспроизведения деталей одежды

- Поддержка платформы для онлайн-презентаций (интерфейс Gradio)

- Поддержка локального развертывания (поддерживается несколько конфигураций производительности)

- Набор данных Complex Virtual Dressing Dataset (CVDD)

- Полный код обучения и вывода модели

- Обнимающиеся лица Модель хостинга Интеграция

Использование помощи

1. Доступ в режиме онлайн

FitDiT предлагает два способа использования в режиме онлайн:

- Онлайн-демонстрация Hugging Face Space: посетите https://huggingface.co/spaces/BoyuanJiang/FitDiT.

- Официальная онлайн-демонстрационная платформа: посетите http://demo.fitdit.byjiang.com/.

Порядок использования:

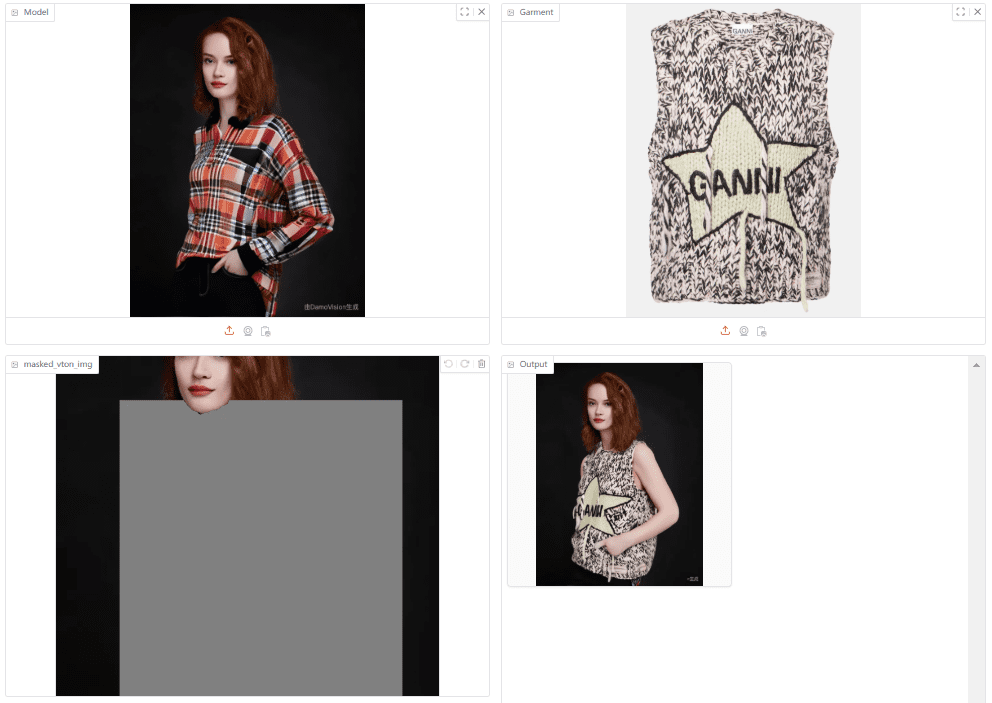

Шаг 1: Создайте маску области подгонки

- Загрузите фотографию человека, одежду которого вы хотите изменить

- Загрузите фотографию одежды, которую вы хотите примерить

- Нажмите кнопку "Step1: Run Mask", чтобы сгенерировать начальную маску.

- Если вам нужно настроить диапазон маски, вы можете это сделать:

- Используйте ползунок для настройки диапазона маски:

- Смещение маски сверху: настраивает верхнюю границу

- Смещение маски вниз: настраивает нижнюю границу

- Смещение маски влево: настраивает левую границу

- Смещение маски вправо: настраивает правую границу

- Вручную измените замаскированную область с помощью инструмента "Кисть".

- С помощью инструмента "Ластик" уточните края маски.

- Используйте ползунок для настройки диапазона маски:

Шаг 2: Получение результатов подгонки

- Выберите нужное разрешение установки

- Нажмите на "Шаг2: Запустить примерку", чтобы начать генерацию.

- Дождитесь окончания обработки модели, чтобы увидеть результат подгонки.

2. Методология локального развертывания

Экологические требования:

torch==2.3.0

torchvision==0.18.0

diffusers==0.31.0

transformers==4.39.3

gradio==5.8.0

onnxruntime-gpu==1.20.1

Этапы развертывания:

- Запросите доступ к весам моделей FitDiT:

- Посетите https://huggingface.co/BoyuanJiang/FitDiT

- Загрузите модель в локальный каталог после получения доступа

- Запустите локальную службу Gradio:

Предусмотрено четыре режима работы, которые можно выбрать в зависимости от конфигурации оборудования:# 最快速模式(需要较大显存): python gradio_sd3.py --model_path local_model_dir # FP16精度模式: python gradio_sd3.py --model_path local_model_dir --fp16 # CPU辅助模式(中等速度,适中显存): python gradio_sd3.py --model_path local_model_dir --fp16 --offload # 激进CPU负载模式(速度最慢,显存占用最少): python gradio_sd3.py --model_path local_model_dir --fp16 --aggressive_offload

3. Инструкции по применению для разработчиков

- Проект осуществляется в соответствии с лицензией CC BY-NC-SA-4.0

- Только для некоммерческого использования

- Для получения коммерческих лицензий обращайтесь по адресу byronjiang@tencent.com.

- Полный код обучения модели и набор данных находятся в открытом доступе

- Поддержка использования предварительно обученных моделей с помощью Hugging Face

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...