COT и связанные с ним расширенные варианты кия Объяснение слов кия

Отказ от ответственности: Хотя базовые методы подсказок (например, нулевые/малые примеры или императивные подсказки) очень эффективны, более сложные подсказки могут быть более эффективны при решении некоторых сложных головоломок (например, математических/программных или требующих многоэтапных логических рассуждений). Поскольку большие языковые модели (LLM), естественно, испытывают трудности при решении таких задач (их способность к рассуждению не монотонно возрастает с увеличением размера модели), большинство исследований в области разработки подсказок было сосредоточено на том, как улучшить рассуждение и способность решать сложные задачи. Для большинства других задач достаточно простых подсказок.

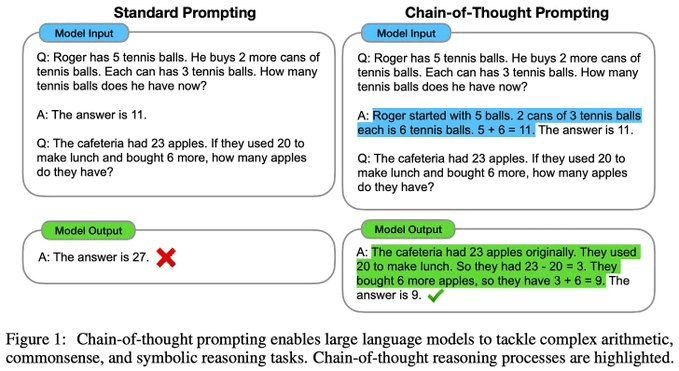

Цепь мысли (CoT)Hints [1] активирует возможности рассуждений LLM, добавляя цепочку промежуточных шагов рассуждений к подсказкам модели. Добавляя цепочку мыслей для каждого примера, модель затем учится (посредством контекстного обучения) автоматически генерировать аналогичные цепочки мыслей, прежде чем дать ответ. Исследование, проведенное в [1], показывает, что явное объяснение процесса рассуждений для решения проблемы может быть эффективным для улучшения способности модели к рассуждениям.

Вход:

Нечетные числа в этом наборе складываются в четное число: 4, 8, 9, 15, 12, 2, 1.

A: Сложите все нечетные числа (9, 15, 1), чтобы получить 25. ответ: Ложь.Нечетные числа в этом наборе складываются в четное число: 17, 10, 19, 4, 8, 12, 24.

Ответ: Сложите все нечетные числа (17, 19), чтобы получить 36.Нечетные числа в этом наборе складываются в четное число: 16, 11, 14, 4, 8, 13, 24.

Ответ: Сложите все нечетные числа (11, 13), чтобы получить 24.Нечетные числа в этом наборе складываются в четное число: 17, 9, 10, 12, 13, 4, 2.

A: Сложите все нечетные числа (17, 9, 13), чтобы получить 39. ответ: Ложь.Нечетные числа в этом наборе складываются в четное число: 15, 32, 5, 13, 82, 7, 1.

A:Выход:

Сложите все нечетные числа (15, 5, 13, 7, 1), чтобы получить 41. ответ - Ложь.

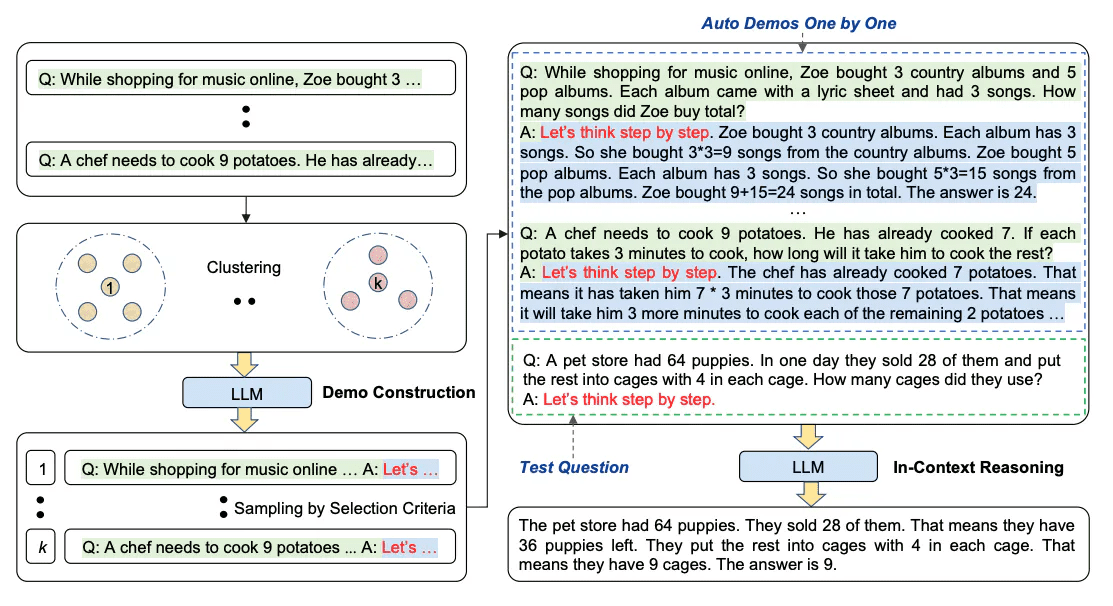

Автоматизированная цепочка мыслей (Auto-CoT)[8]: При использовании подсказок в виде цепочки мыслей необходимо вручную подбирать эффективные и разнообразные примеры. Такая ручная работа может привести к неоптимальным решениям. В [8] предлагается способ устранить ручную работу, используя подсказки LLM "Давайте думать шаг за шагом" для создания цепочек рассуждений одна за другой. Такой автоматизированный процесс все равно может привести к ошибкам в генерируемых цепочках. Чтобы смягчить последствия ошибок, важно разнообразить представление информации. В данной работе предлагается Auto-CoT, который выбирает проблемы с разнообразием и генерирует цепочки рассуждений для построения демонстраций.

Auto-CoT состоит из двух основных этапов:

Этап 1: Кластеризация проблемы: разделение заданной проблемы на несколько кластеров

Этап 2: Демонстрационная выборка: выбор репрезентативной задачи из каждого массива и генерация ее цепочки выводов с помощью Zero-Shot-CoT с простой эвристикой

Простыми эвристиками могут быть длина задачи (например, 60 лексем) и количество шагов в обосновании (например, 5 шагов умозаключения). Это побуждает модели использовать простые и точные представления.

Процесс показан ниже:

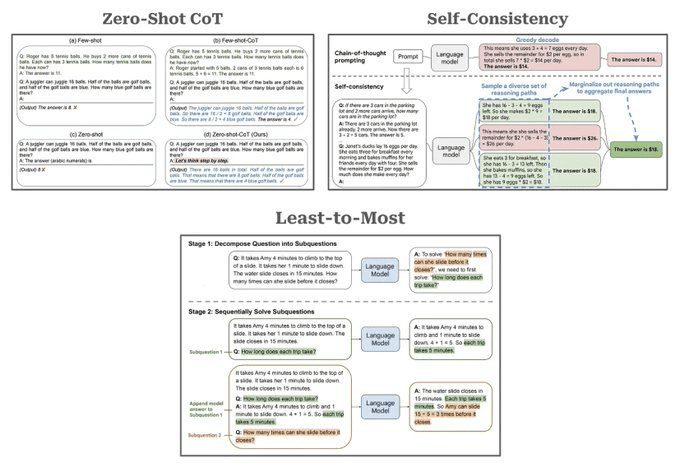

Вариант CoT: Учитывая валидность подсказок CoT и их популярность, было предложено множество производных техник:

- Обнуление примеров CoT [2]: убирает несколько примеров и мотивирует модель на логические рассуждения для решения задачи, добавляя "Давайте думать шаг за шагом." в конце подсказки. чтобы мотивировать модель к логическим рассуждениям для решения проблемы.

Вход:

Я пошел на рынок и купил 10 яблок. Я отдал 2 яблока соседу и 2 яблока ремонтнику. Затем я пошел, купил 5 яблок и съел 1. Сколько яблок у меня осталось?

Давайте думать шаг за шагом.

Выход:

Сначала у вас будет 10 яблок.

Вы отдали по 2 яблока соседу и ремонтнику, так что у вас осталось 6 яблок.

Затем вы покупаете 5 яблок, и теперь у вас 11 яблок.

В итоге вы съедаете 1 яблоко, и у вас остается 10 яблок.

- Самосогласованность (SC) [3]: повышает устойчивость процесса рассуждений за счет независимого генерирования нескольких решений и голосования большинством голосов за окончательный ответ.

Вход:

Вопрос: В лесу растет 15 деревьев. Сегодня лесники будут сажать деревья в лесу. Когда они закончат, будет 21 дерево. Сколько деревьев посадили лесники сегодня?

О: Мы начали с 15 деревьев. Позже у нас было 21 дерево. Разница должна быть в количестве деревьев, которые они посадили. Следовательно, они должны были посадить 21-15 = 6 деревьев. Ответ: 6.

Q: На парковке было 3 машины, потом приехали еще 2 машины, сколько машин было на парковке?

О: На парковке уже стоят 3 машины. Приехали еще 2 машины. Теперь там 3 + 2 = 5 машин. Ответ: 5.

Вопрос: У Лии есть 32 кусочка шоколада, а у ее сестры - 42. Если они съели по 35 кусочков, сколько кусочков у них осталось в общей сложности?

Ответ: У Лии 32 шоколадки, а у сестры Лии - 42. Это значит, что изначально было 32 + 42 = 74 шоколадки. 35 штук уже съедены. Следовательно, всего осталось 74 - 35 = 39 шоколадок. Ответ: 39.

Вопрос: У Джейсона есть 20 леденцов. Он отдает Денни несколько леденцов. Теперь у Джейсона только 12 леденцов. Сколько леденцов Джейсон отдал Денни?

A: У Джейсона есть 20 леденцов. Поскольку у него теперь только 12, он должен отдать остальные Денни. Количество леденцов, которые он отдаст Денни, должно быть 20 - 12 = 8 леденцов. Ответ: 8.

Вопрос: У Шона есть пять игрушек. На Рождество он получил от родителей две игрушки. Сколько игрушек у него теперь?

О: У него 5 игрушек. Он получил 2 от мамы, так что после этого у него стало 5 + 2 = 7 игрушек. Затем он получил 2 от папы, так что всего у него 7 + 2 = 9 игрушек. Ответ: 9.

Вопрос: В серверной комнате 9 компьютеров. С понедельника по четверг каждый день устанавливается по 5 компьютеров. Сколько компьютеров сейчас находится в серверной?

О: Было 4 дня с понедельника по четверг. Каждый день добавлялось по 5 компьютеров. Это означает, что в общей сложности 4 * 5 =

20 компьютеров. В начале было 9 компьютеров, поэтому теперь их 9 + 20 = 29. Ответ: 29.

Вопрос: У Майкла есть 58 мячей для гольфа. Во вторник он потерял 23 мяча для гольфа. В среду он потерял еще 2 мяча. Сколько мячей для гольфа осталось у него в конце среды?

Ответ: Изначально у Майкла было 58 шаров. Во вторник он потерял 23, так что после этого у него осталось 58-23 = 35 шаров. В среду он потерял ещё 2, так что теперь у него 35-2 = 33 шара. Ответ: 33.

Вопрос: У Оливии есть 23 доллара. Она купила пять бубликов по $3 за каждый. Сколько денег у нее осталось?

О: Она купила 5 бубликов по 3 доллара за каждый. Это означает, что она потратила 15 долларов. У нее осталось 8 долларов.

Вопрос: Когда мне было 6 лет, моя сестра была вдвое моложе меня. Сейчас, когда мне 70, сколько лет моей сестре?

A:Выход 1:

Когда мне было 6 лет, моя сестра была вдвое моложе меня, или 3 года. Сейчас мне 70, значит, ей 70-3 = 67. Ответ: 67.

Выход 2:

Когда рассказчику было 6 лет, его сестра была вдвое моложе его, или 3 года. Теперь, когда рассказчику 70 лет, его сестре было бы 70-3 = 67. Ответ: 67.

Выход 3:

Когда мне было 6 лет, моя сестра была вдвое моложе меня, или 3 года. Сейчас мне 70, значит, ей 70/2 = 35. Ответ: 35.

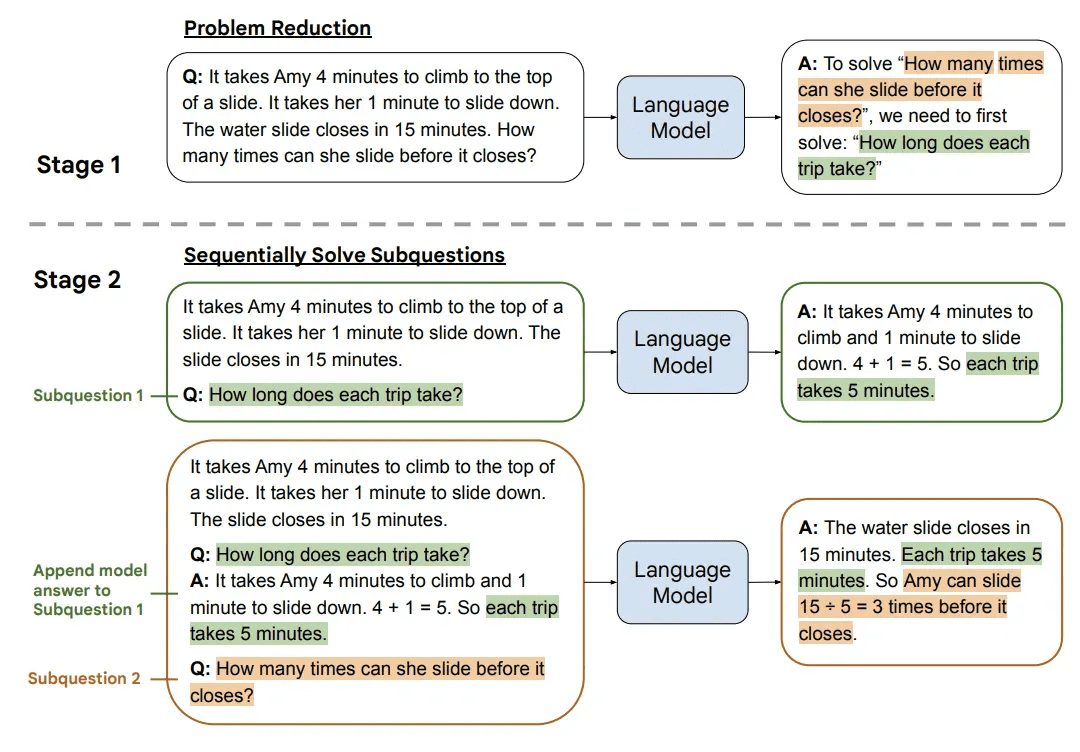

- Least-to-Most [4]: разбиение проблемы на несколько частей, решение их по очереди, а затем использование ответа на каждую подпроблему в качестве контекста для решения следующей.

Вход:

Запрос клиента.

Я купил футболку из вашей коллекции Арнольда 1 марта. Я видел, что она была на распродаже, поэтому купил футболку, которая изначально стоила 30 долларов. Я заметил, что теперь у вас есть новая скидка на футболки, 50%. Я хотел бы узнать, могу ли я вернуть ее и при этом получить достаточно кредита в магазине, чтобы купить две ваши футболки?Командуйте.

Вы являетесь представителем службы поддержки клиентов и отвечаете на их запросы в дружелюбной манере. Возврат товара возможен в течение 30 дней. Сегодня 29 марта. На все рубашки сейчас действует скидка 50%. Цены на рубашки в магазине варьируются от $18 до $100. Пожалуйста, не придумывайте никакой информации о политике скидок.

Какие подвопросы необходимо решить, прежде чем ответить на этот вопрос?Выход:

1. дата, когда клиент приобрел рубашку;

2. Текущие дисконтные мероприятия;

3. ценовой диапазон рубашек в магазине;

4. Достаточно ли у клиента кредита на покупку;

5. политика возврата товара.Вход:

Запрос клиента.

Я купил футболку из вашей коллекции Арнольда 1 марта. Я видел, что она была на распродаже, поэтому купил футболку, которая изначально стоила 30 долларов. Я заметил, что теперь у вас есть новая скидка на футболки, 50%. Я хотел бы узнать, могу ли я вернуть ее и при этом получить достаточно кредита в магазине, чтобы купить две ваши футболки?Командуйте.

Вы являетесь представителем службы поддержки клиентов и отвечаете на их запросы в дружелюбной манере. Возврат товара возможен в течение 30 дней. Сегодня 29 марта. На все рубашки сейчас действует скидка 50%. Цены на рубашки в магазине варьируются от $18 до $100. Пожалуйста, не придумывайте никакой информации о политике скидок.

Определите, находится ли покупатель в пределах 30-дневного срока возврата. Давайте разберемся с этим по порядку.Выход:

Уважаемый клиент, большое спасибо за поддержку ассортимента Arnold! Мы рады предложить вам наши услуги. Согласно нашей политике возврата, покупатели могут вернуть товар в течение 30 дней с момента покупки. Поскольку вы приобрели товар 1 марта, вы все еще находитесь в пределах срока возврата и можете его вернуть.

Кроме того, в настоящее время мы проводим распродажу 50%, в рамках которой вы можете использовать свой магазинный кредит для покупки двух футболок из коллекции Arnold. Стоимость наших футболок варьируется от $18 до $100, так что вы сможете выбрать именно ту футболку, которая вам нужна.

Если у вас есть какие-либо другие вопросы, пожалуйста, не стесняйтесь обращаться к нам. Мы будем рады служить вам!

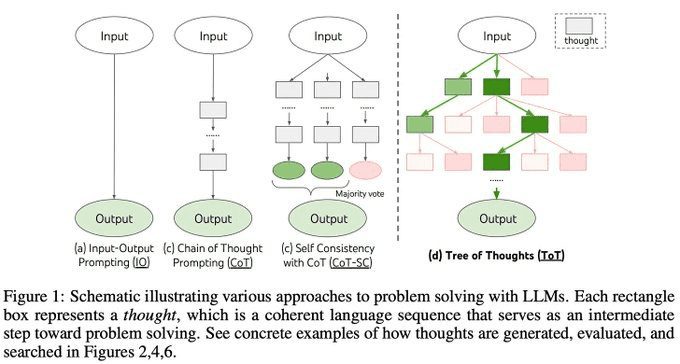

Древо мыслей [ToT].Совет [5]: советы CoT не решают проблемы, требующие планирования, стратегического предвидения, отката назад и параллельного поиска нескольких решений. советы toT разбивают сложные проблемы на ряд более простых проблем (или "мыслей"). lLM генерирует множество "мыслей" и постоянно оценивает их продвижение к окончательному решению с помощью естественного языка. LLM генерирует множество "мыслей" и постоянно оценивает их продвижение к окончательному решению с помощью естественного языка. Используя самооценку модели о ходе решения, мы можем применять широко распространенные алгоритмы поиска (например, поиск в ширину или в глубину) для облегчения процесса исследования и обеспечения возможности предвидения/отслеживания при решении задач.

Предположим, что на этот вопрос отвечают три разных эксперта.

Все эксперты записали свои первые шаги в размышлении над проблемой, а затем поделились ими с группой.

Затем все эксперты записывают следующие шаги в своих размышлениях и делятся ими.

И так далее, пока все эксперты не напишут обо всех этапах своего мышления.

Как только люди замечают, что действия эксперта неверны, пусть он уходит.

Простите...

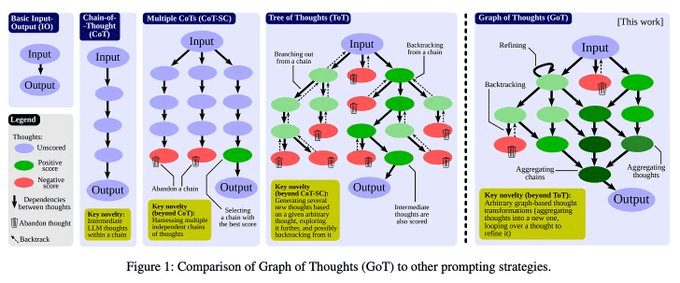

График мыслей (GoT)Подсказки [6, 7]: последующие исследования расширили работу над подсказками ToT на стратегии рассуждений на основе графов. Эти методы похожи на подсказки ToT, но не предполагают, что путь мысли, генерирующей решение, является линейным. Мы можем повторно использовать мысли и даже рекурсивно применять их к серии мыслей при поиске решения. Хотя были предложены различные стратегии подсказок на основе графов, эти методы, как и подсказки ToT, подвергались критике за их недостаточную полезность. Решение проблемы рассуждения с использованием подсказок GoT может потребовать от LLM выполнения большого количества шагов рассуждения!

Ниже приведены ссылки на все цитируемые выше работы!

[1] https://arxiv.org/abs/2201.11903[2] https://arxiv.org/abs/2205.11916

[3] https://arxiv.org/abs/2203.11171

[4] https://arxiv.org/abs/2205.10625

[5] https://arxiv.org/abs/2305.10601

[6] https://arxiv.org/abs/2308.09687

[7] https://arxiv.org/abs/2305.16582[8] https://arxiv.org/abs/2201.11903

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...