ChatOllama: нативный пользовательский интерфейс приложения для чата в реальном времени на основе Nuxt 3 и Ollama

Общее введение

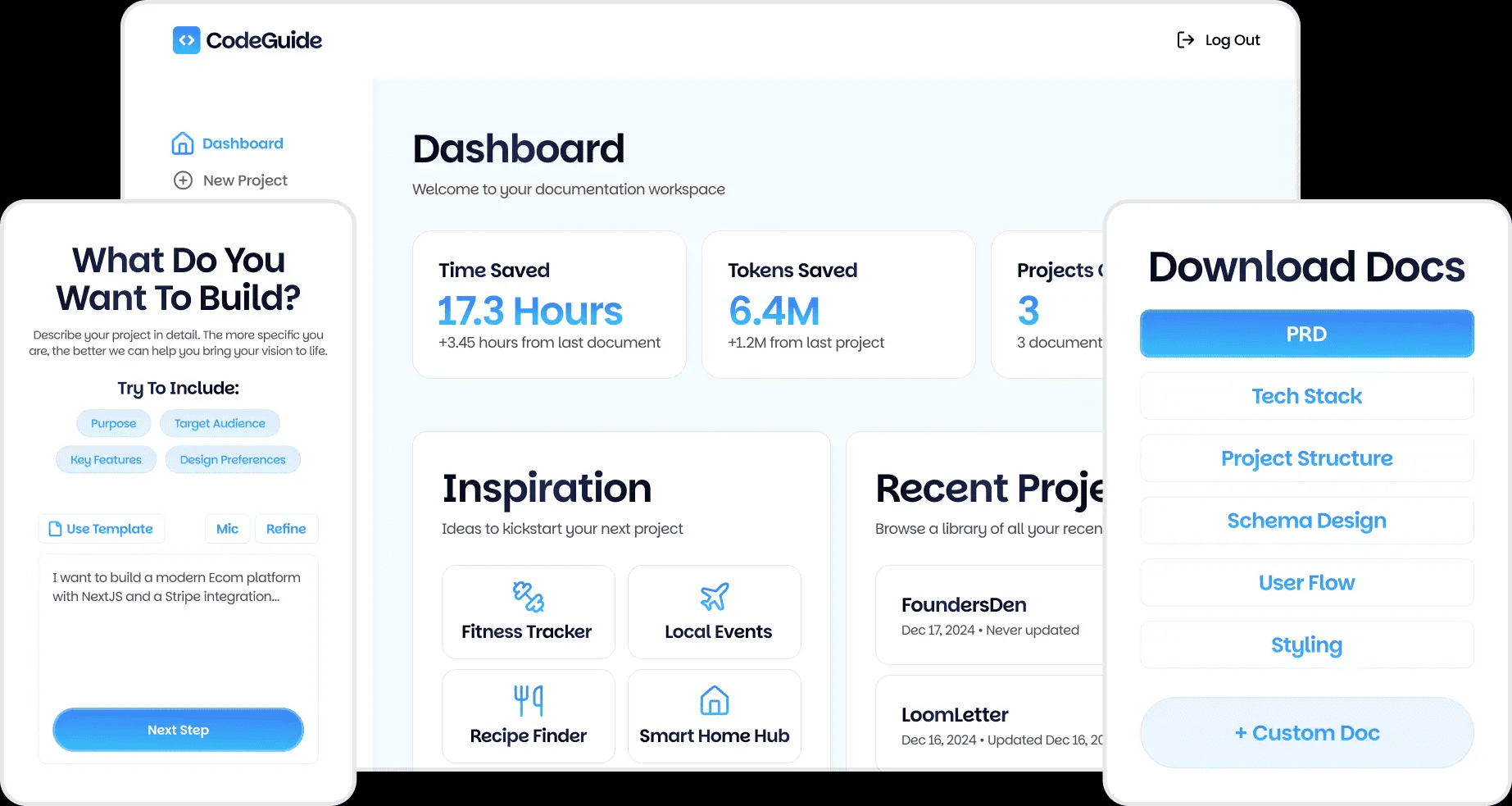

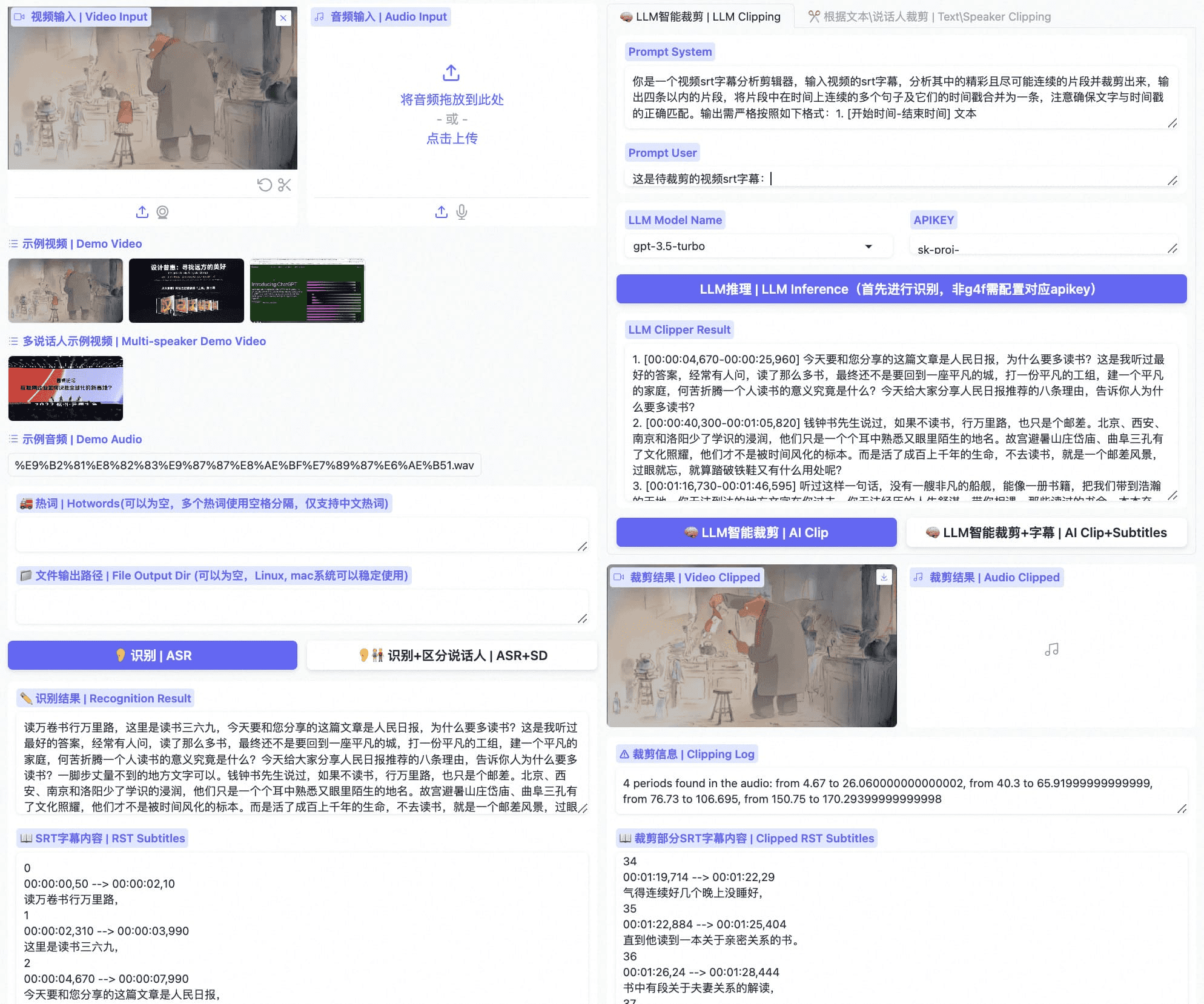

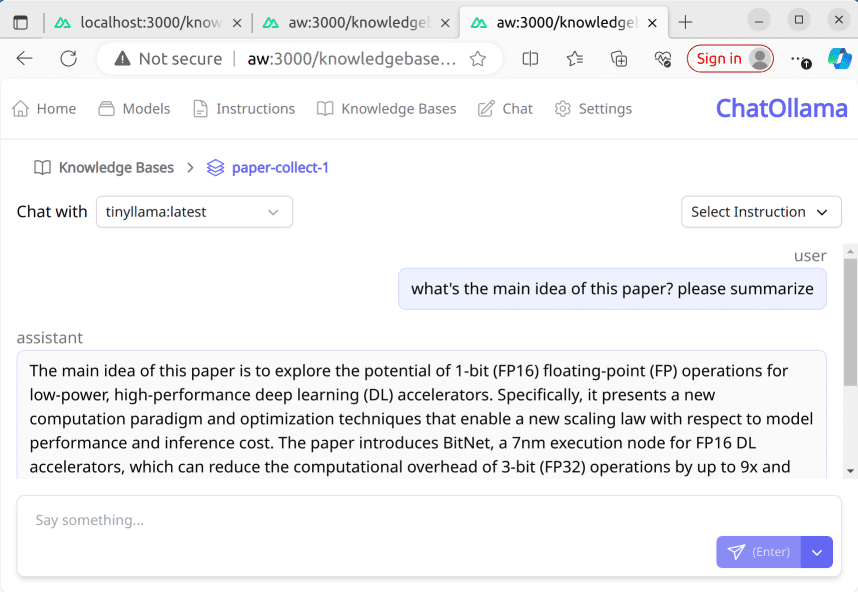

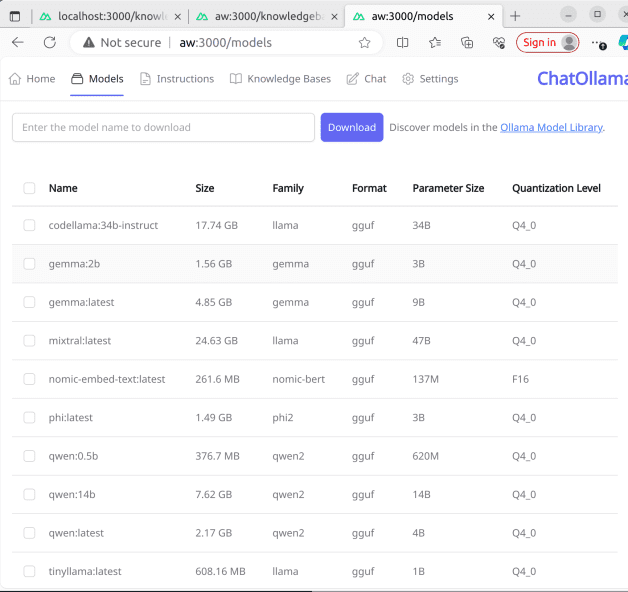

ChatOllama - это проект онлайн чата с открытым исходным кодом, основанный на крупномасштабных языковых моделях (LLM), поддерживающий множество языковых моделей и управление базой знаний. Пользователи могут использовать платформу для управления моделями (отображение списка, загрузка, удаление), общения с моделями и других функций. Проект использует фреймворк Nuxt 3 и предоставляет подробное руководство по настройке и рекомендации по серверу разработки для разработчиков, заинтересованных в создании чатботов, для просмотра и внесения вклада.

Список функций

Управление моделями: включая просмотр, загрузку и удаление списка моделей

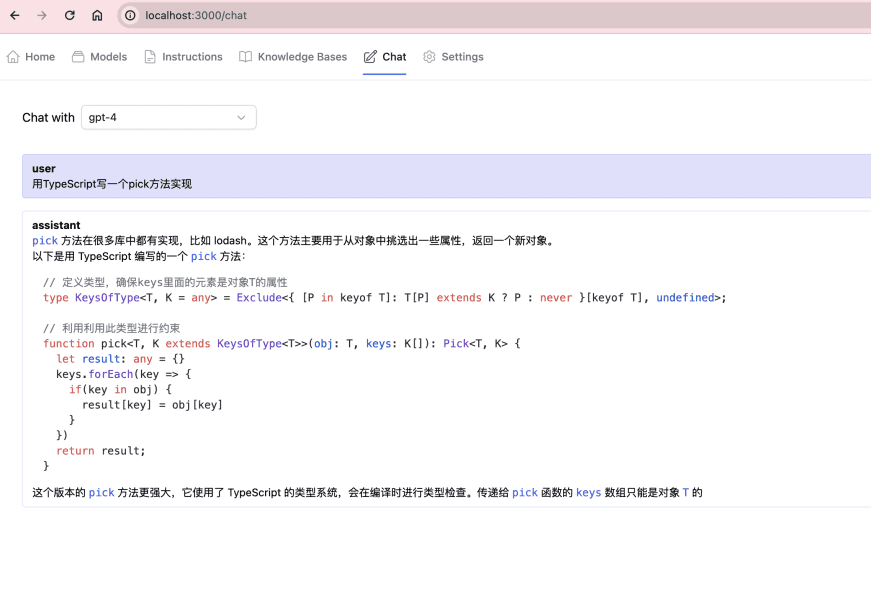

Возможность взаимодействия с моделями чата

Поддержка многоязычного моделирования и управления базой знаний (база знаний на основе LangChain)

Разработан на Nuxt 3 и написан на Vue и TypeScript.

Использование помощи

Сначала установите зависимости: npm install, pnpm install, yarn install или bun install

Убедитесь, что у вас запущен сервер Ollama, локальная среда по умолчанию запускается по адресу http://localhost:11434.

Найдено на http://localhost:3000上启动开发服务器: npm run dev

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...