Extra: o1-mini foi totalmente aberto para a experiência de conta gratuita do ChatGPT!

A família de modelos o1 é composta por modelos avançados de raciocínio de processos, dos quais o modelo o1-mini, de tamanho reduzido, tem o potencial de ser mais forte que o o1-preview em termos de raciocínio lógico, embora a capacidade de conhecimento do mundo tenha sido reduzida.

Atualmente, a o1-mini está aberta apenas a algumas contas gratuitas para experiência de visualização. Se sua conta está oficialmente aberta, o modelo o1-mini pode ser verificado com as seguintes perguntas de decodificação:

oyfjdnisdr rtqwainr acxz mynzbhhx -> Pense passo a passo

Use o exemplo acima para decodificar.

oyekaijzdf aaptcg suaokybhai ouow aqht mynznvaatzacdfoulxxz

A pergunta de validação acima vem de OpenAI o1 Aprendizagem da capacidade de raciocínio para modelos de idiomas grandesPara obter mais informações sobre o modelo o1-mini, consulte o artigo a seguir. Introdução ao macromodelo OpenAI o1-mini.

Se você não tiver uma conta gratuita do ChatGPT ou não tiver acesso à experiência do o1-mini, poderá visitar o site:Site espelho do ChatGPT (acesso doméstico aos modelos da série GPT4) Experiência.

Algumas questões de interesse sobre o modelo o1 da OpenAI

Nomes de modelos e padrões de inferência

- OpenAI o1 representa um novo nível de capacidade de IA e o contador é redefinido para 1

- "Preview" indica que esta é uma versão inicial do modelo completo.

- "Mini" indica que essa é uma versão menor do modelo o1, otimizada para velocidade

- o - em nome da OpenAI

- o1 não é um "sistema", mas um modelo que treina os alunos a desenvolver a cadeia de raciocínio antes de fornecer a resposta final.

- O ícone do o1 representa simbolicamente um alienígena com habilidades extraordinárias

o1 Tamanho e desempenho do modelo

- O o1-mini é menor e mais rápido que o o1-preview, portanto, estará disponível para usuários gratuitos no futuro

- O o1-preview é um ponto de verificação inicial no modelo o1, nem muito grande nem muito pequeno

- o1-mini tem melhor desempenho em tarefas STEM, mas é limitado no conhecimento do mundo

- O o1-mini tem um bom desempenho em algumas tarefas, especialmente em tarefas relacionadas a códigos, melhor do que o o1-preview

- Entradas para o1 Token é calculado da mesma forma que o GPT-4o, usando o mesmo Tokenizer

- Em comparação com o o1-preview, o o1-mini pode explorar mais cadeias de pensamento

Contextos de token de entrada e recursos de modelo

- Em breve, os modelos o1 suportarão contextos de entrada maiores

- O modelo o1 pode lidar com tarefas mais longas e abertas, com menos necessidade de dividir as entradas como no GPT-4o

- o1 pode gerar longas cadeias de raciocínio antes de fornecer uma resposta, diferentemente dos modelos anteriores

- No momento, não é possível pausar a inferência durante a inferência de CoT para adicionar mais contexto, mas esse recurso está sendo explorado em modelos futuros

Ferramentas, recursos e recursos futuros

- O o1-preview não usa ferramentas no momento, mas planeja oferecer suporte a chamadas de função, intérpretes de código e recursos de navegação

- Suporte a ferramentas, saída estruturada e dicas de sistema serão adicionados em atualizações futuras

- Os usuários poderão eventualmente controlar o tempo de reflexão e os limites de token

- Há planos em andamento para dar suporte ao streaming e considerar a possibilidade de refletir o progresso da inferência na API

- Os recursos multimodais do o1 foram incorporados, com o objetivo de alcançar o desempenho de última geração em tarefas como o MMMU

Raciocínio CoT (cadeia de raciocínio)

- o1 Geração de cadeias de inferência ocultas durante os processos de inferência

- Não há planos de expor o token CoT aos usuários da API ou do ChatGPT

- O CoT Token será resumido, mas não há garantia de que ele será totalmente consistente com o processo de raciocínio real

- As instruções no prompt podem influenciar a maneira como o modelo pensa sobre o problema

- A aprendizagem por reforço (RL) foi usada para aprimorar a capacidade de CoT de o1, enquanto o GPT-4o não conseguiu atingir seu desempenho de CoT somente por meio de dicas

- Embora a etapa de raciocínio possa parecer mais lenta, na realidade a geração de respostas costuma ser mais rápida, pois resume o processo de raciocínio

API e restrições de uso

- O o1-mini tem um limite semanal de 50 prompts para usuários do ChatGPT Plus

- Todas as dicas são contadas da mesma forma no ChatGPT

- Mais níveis de acesso à API e limites mais altos a serem implementados ao longo do tempo

- O armazenamento em cache de dicas em APIs é uma demanda crescente, mas ainda não há um cronograma

Precificação, ajuste fino e expansão

- o1 Espera-se que o preço do modelo siga uma tendência de queda a cada 1 ou 2 anos

- Preços de API de volume a serem suportados à medida que as restrições aumentam

- O ajuste fino está em andamento, mas o cronograma ainda não foi determinado

- o1 Expansão limitada por gargalos em talentos de pesquisa e engenharia

- Um novo paradigma estendido para a computação de inferência pode levar a aprimoramentos significativos nas futuras gerações de modelos

- As extensões reversas não são significativas no momento, mas a o1-preview tem um desempenho apenas um pouco melhor (ou até um pouco pior) do que a GPT-4o em solicitações de escrita individuais

Desenvolvimento de modelos e percepções de pesquisa

- o1 Habilidades de raciocínio por meio de treinamento de aprendizado intensivo

- O modelo demonstra pensamento criativo e se destaca em tarefas laterais, como poesia

- O raciocínio filosófico e as habilidades de raciocínio abrangente de o1 são impressionantes, como decifrar códigos

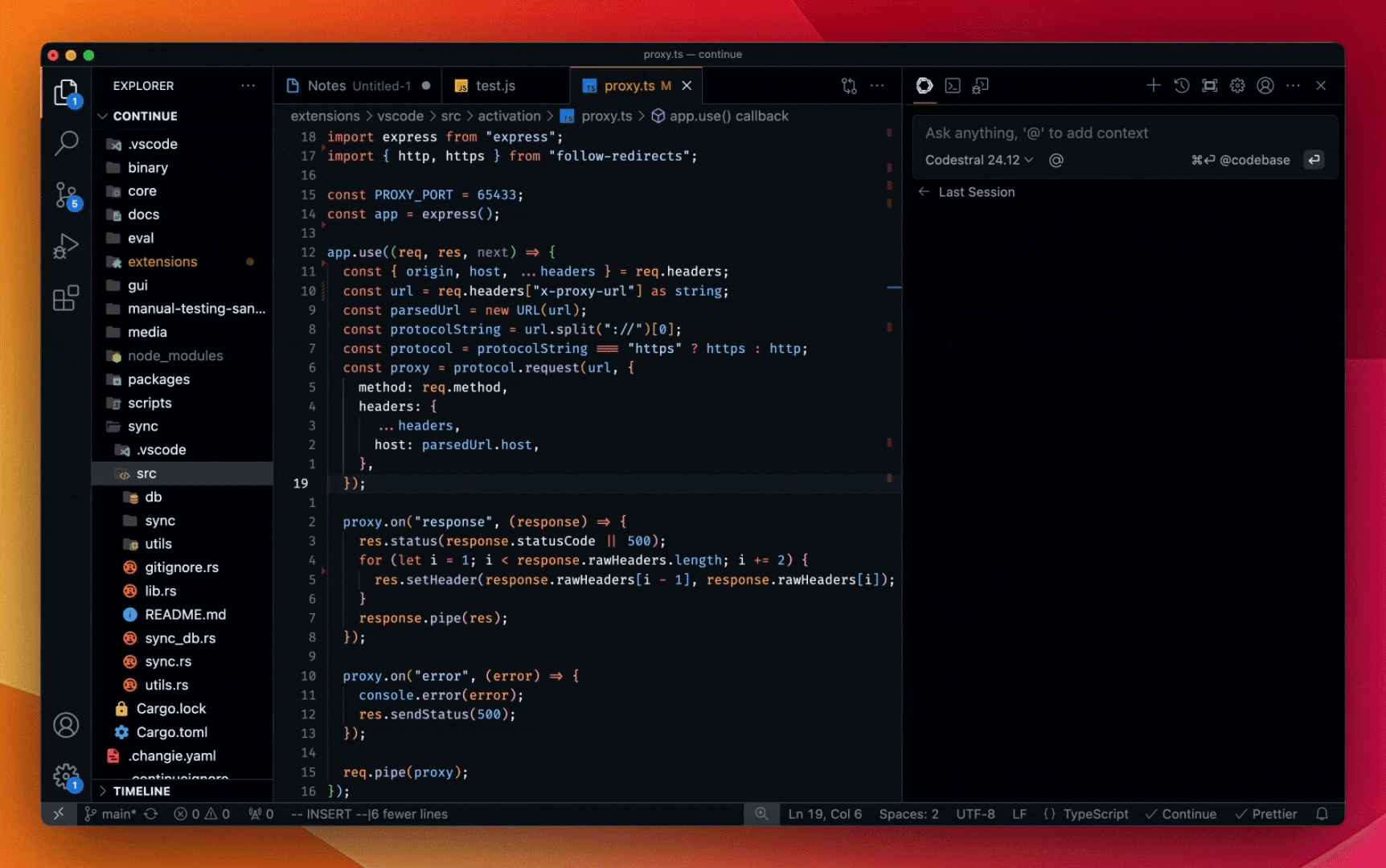

- O o1 foi usado pelos pesquisadores para criar um bot do GitHub que envia pings aos CODEOWNERS certos para revisões de código

- Nos testes internos, a o1 fez perguntas difíceis a si mesma para avaliar sua capacidade de

- Um amplo conhecimento do domínio mundial está sendo adicionado e será aprimorado em versões futuras

- Dados atualizados planejados para serem adicionados ao o1-mini (atualmente em outubro de 2023)

Dicas Dicas e práticas recomendadas

- o1 Beneficie-se do fornecimento de prompts para casos extremos ou estilos de raciocínio

- Os modelos o1 são mais receptivos a pistas de raciocínio em pistas do que os modelos anteriores

- O fornecimento de contexto relevante no Retrieval Augmented Generation (RAG) melhora o desempenho; fragmentos irrelevantes podem enfraquecer a inferência

Feedback geral e aprimoramentos futuros

- o1-preview é menos restritivo por estar em uma fase inicial de testes, mas aumentará o número de

- A latência e os tempos de inferência estão sendo ativamente aprimorados

Recursos significativos de modelagem

- o1 pode pensar em questões filosóficas como "O que é a vida?"

- Os pesquisadores descobriram que o o1 é excelente em lidar com tarefas complexas e raciocínio extenso a partir de instruções limitadas

- As habilidades de raciocínio criativo de o1, como avaliar sua capacidade fazendo suas próprias perguntas, demonstram um alto nível de habilidades de resolução de problemas

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...