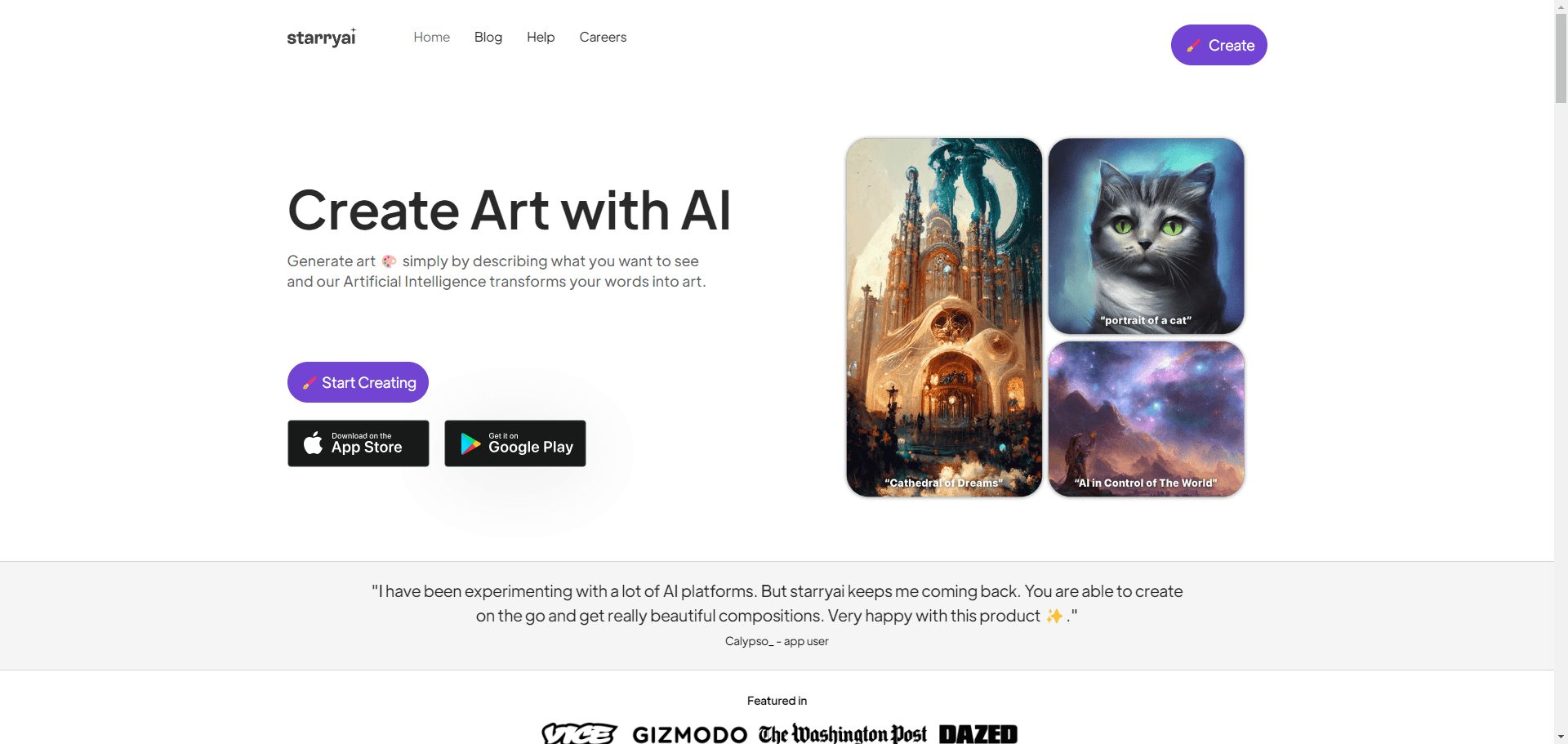

위드애니원이란 무엇인가요?

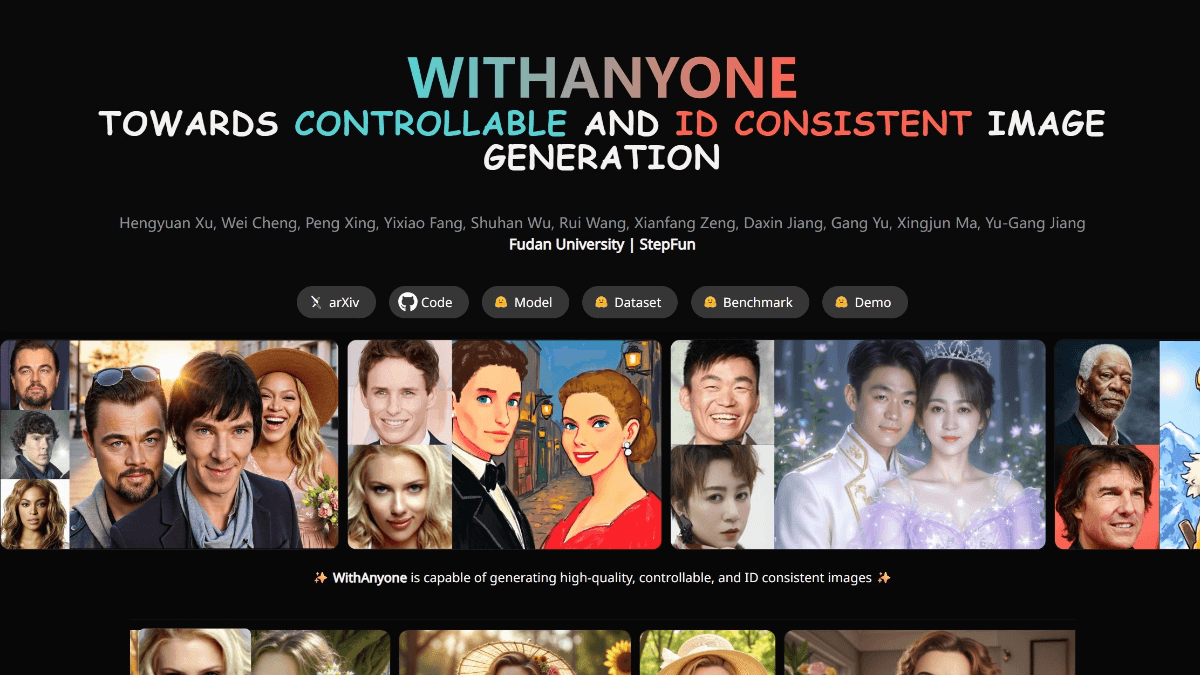

위드애니원은 푸단대학교와 스텝스타가 공동 개발한 인공지능 사진 생성 모델로, 기존 인공지능 이미지 생성에서 흔히 발생하는 '복사 및 붙여넣기' 문제를 해결하고 보다 자연스럽고 제어 가능한 다중 인물 이미지 생성을 실현합니다. 위드애니원은 확산 모델 아키텍처를 기반으로 하여 생성된 이미지의 인공물을 효과적으로 줄이고 신원 유사성과 생성의 다양성을 향상시킵니다. 이 모델은 오픈소스로 공개되었으며, 모델과 데이터셋, 데모는 허깅페이스에서 확인할 수 있습니다. 사용자는 개인 사진을 쉽게 업로드하여 다양한 시나리오에서 여러 사람과 함께 단체 사진을 생성하고 자연스럽고 사실적인 AI 이미지 생성 효과를 경험할 수 있습니다.

WithAnyone의 주요 기능

- 다중 사진 생성여러 사람을 하나의 단체 사진에 자연스럽게 합성하여 눈에 거슬리지 않는 이미지를 만드는 기능입니다.

- ID 일관성 유지이미지를 생성하는 동안 캐릭터의 아이덴티티를 유지하여 생성된 이미지가 입력된 캐릭터와 매우 유사하도록 할 수 있습니다.

- 세부 사항을 유연하게 조정캐릭터의 표정, 자세, 헤어스타일 등의 디테일을 유연하게 조정하여 개인화된 이미지를 생성할 수 있습니다.

- '복사 및 붙여넣기' 아티팩트 줄이기AI 이미지 생성 프로세스는 첨단 기술을 기반으로 하며, 기존 AI 이미지 생성에서 흔히 발생하는 '복사 및 붙여넣기' 현상을 효과적으로 줄이고 이미지 품질을 향상시킵니다.

- 오픈 소스 및 사용 편의성이 모델은 오픈 소스이며 사용자는 허깅 페이스에서 리소스를 찾아 쉽게 기술을 사용하고 체험할 수 있습니다.

위드애니원의 기술 원칙

- 대규모 데이터 세트 지원50만 장의 다인 단체 사진과 다양한 표정, 헤어스타일, 각도를 아우르는 수많은 참조 이미지가 포함된 MultiID-2M 데이터 세트가 사용되어 모델 학습을 위한 풍부한 데이터베이스를 제공합니다.

- 대조적인 신원 손실 교육생성된 이미지가 캐릭터의 아이덴티티 특성을 유지하면서 자연스러운 시각 효과를 낼 수 있도록 대비적 아이덴티티 손실(CIL) 및 쌍별 데이터 학습을 통해 아이덴티티 충실도와 생성 다양성의 균형을 맞추고 있습니다.

- 확산 모델 아키텍처확산 모델 기반 아키텍처는 '복사 및 붙여넣기' 아티팩트를 효과적으로 줄이면서 높은 아이덴티티 유사성을 유지하고 생성된 이미지의 전반적인 품질을 개선합니다.

- 신원 코드캐릭터의 신원 특성을 인코딩하면 생성 과정에서 캐릭터의 고유 속성이 정확하게 복원되어 신원 혼동을 방지할 수 있습니다.

- 멀티태스킹 최적화신원 유지, 자세 조정, 배경 융합과 같은 여러 작업을 훈련 중에 동시에 최적화하여 모델의 종합적인 성능과 적응력을 향상시킵니다.

WithAnyone의 프로젝트 주소

- 프로젝트 웹사이트:: https://doby-xu.github.io/WithAnyone/

- 깃허브 리포지토리:: https://github.com/Doby-Xu/WithAnyone

- 허깅페이스 모델 라이브러리:: https://huggingface.co/WithAnyone/WithAnyone

- arXiv 기술 논문:: https://arxiv.org/pdf/2510.14975

- 온라인 경험 데모:: https://huggingface.co/spaces/WithAnyone/WithAnyone_demo

위드애니원의 대상

- 소셜 미디어 사용자아이돌, 친구 또는 가족과 함께 창의적인 단체 사진을 만들어 소셜 플랫폼에 공유하는 데 AI 기술이 활용되기를 기대합니다.

- 콘텐츠 크리에이터동영상, 기사 또는 광고 제작을 위해 여러 사람의 고화질 단체 사진을 빠르게 생성해야 합니다.

- 디자이너 & 사진작가창의적인 디자인이나 가상 촬영을 위해 새로운 형태의 시각적 표현을 탐구합니다.

- 일반 사용자AI 기술의 재미를 경험하고 엔터테인먼트와 기념을 위한 개인화된 사진을 만들 수 있습니다.

- 기술 애호가 및 개발자오픈 소스 모델을 활용한 AI 이미지 생성 기법, 학습 및 2차 개발 연구.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...