일반 소개

VITA는 선도적인 오픈 소스 대화형 대규모 언어 모델링 프로젝트로, 진정한 완전한 멀티모달 상호 작용을 실현하는 기능을 개척하고 있습니다. 이 프로젝트는 2024년 8월 최초의 오픈소스 대화형 멀티모달 대규모 언어 모델을 개척한 VITA-1.0을 출시했으며, 2024년 12월에는 상호작용 경험과 성능을 크게 개선한 주요 업그레이드 버전인 VITA-1.5를 출시했습니다.VITA 모델은 이미지, 비디오, 오디오 등 다중 모드 입출력을 지원하고 실시간 상호작용 기능을 탑재하여 엔드투엔드 음성 상호작용 지연 시간을 4초에서 1.5초로 대폭 줄였습니다. VITA 모델은 이미지, 비디오, 오디오 등 멀티 모달 입출력을 지원하고 실시간 상호작용 기능을 갖추고 있어 엔드투엔드 음성 상호작용 지연 시간을 4초에서 1.5초로 대폭 단축하여 사용자 경험을 크게 향상시킵니다. 완전한 오픈 소스 프로젝트인 VITA는 연구자와 개발자가 멀티모달 AI를 탐구할 수 있는 이상적인 플랫폼을 제공합니다.

기능 목록

- 멀티모달 입력 처리: 이미지, 비디오, 오디오 및 기타 형태의 입력 지원

- 실시간 음성 상호 작용: 단 1.5초의 엔드투엔드 음성 상호 작용 지연 시간

- 시각적 분석 기능: 강력한 이미지 및 동영상 이해 및 분석 기능

- 오디오 처리: 음성 인식 및 음성 합성 지원

- 크로스 모달 이해: 텍스트, 이미지, 오디오 간의 지능적인 상관관계를 지향합니다.

- 오픈 소스 지원: 전체 교육 및 추론 코드 공개

- 사전 학습된 모델: 여러 버전의 사전 학습된 모델을 사용할 수 있습니다.

- 유연한 배포 옵션: 여러 하드웨어 플랫폼 배포 지원

VITA-1.5 개요

2024년 8월 12일, 저희는 VITA-1.0이것은 최초의 오픈 소스 대화형 올인원 멀티모달 매크로 언어 모델. 그리고 지금(2024년 12월 20일), 저희는 여러분께 새 버전 VITA-1.5!

VITA-1.5의 새로운 기능은 무엇인가요?

다음과 같이 소개합니다. VITA-1.5를 통해 일련의 발전된 기능을 소개했습니다:

- 인터랙션 지연 시간 대폭 단축.. 종단 간 음성 상호 작용 지연 시간이 다음에서 증가했습니다. 약 4초 감소 1.5초를 통해 거의 즉각적인 상호 작용을 가능하게 하고 사용자 경험을 크게 향상시킵니다.

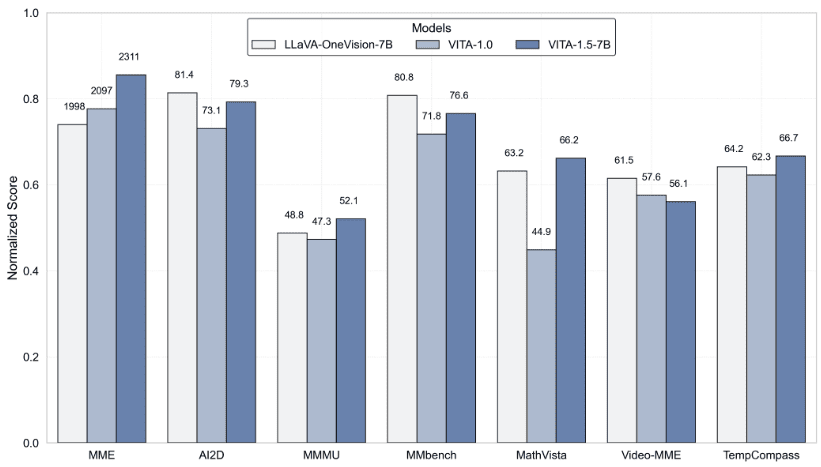

- 향상된 멀티모달 성능. In MME및MMBench 노래로 응답 MathVista 다음과 같은 멀티모달 벤치마크의 평균 성능은 다음과 같습니다. 59.8 로 올리십시오. 70.8.

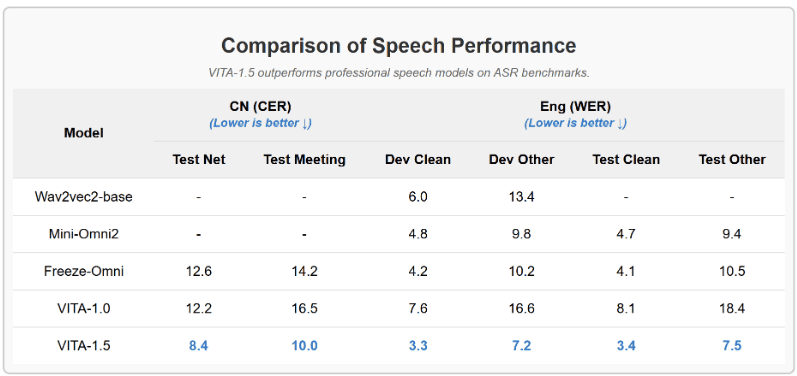

- 음성 처리 기능 향상.. 새로운 수준의 음성 처리 성능을 달성하여 ASR WER(단어 오류율, 기타 테스트)이 다음에서 증가했습니다. 18.4 로 감소 7.5. 또한, 저희는 엔드투엔드 TTS 모듈 대규모 언어 모델의 임베딩을 입력으로 받아들이는 VITA-1.0의 독립형 TTS 모듈을 대체합니다.

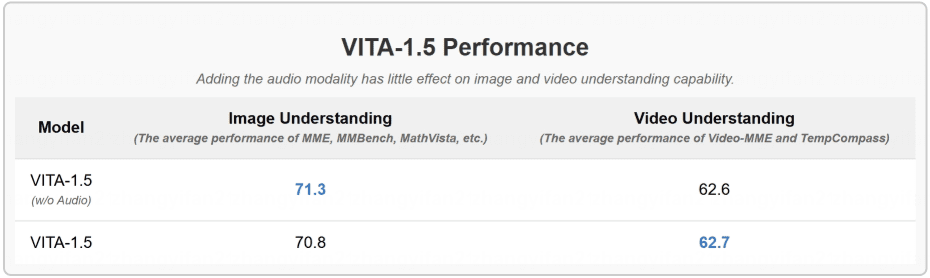

- 점진적 교육 전략. 이러한 방식으로 음성 모듈을 포함해도 다른 멀티모달 성능(시각-언어)에는 거의 영향을 미치지 않습니다. 이미지 이해의 평균 성능은 71.3에서 70.8로 감소했을 뿐입니다.

결과

- 이미지 및 비디오 이해도 벤치마크 테스트 평가

- ASR 벤치마크에서 전문 음성 모델보다 뛰어난 성능의 VITA-1.5

- 오디오 양식의 포함은 이미지 및 비디오 이해도에 거의 영향을 미치지 않습니다.

도움말 사용

1. 환경 구성 및 설치

1.1 기초 요구 사항:

- Python 환경

- PyTorch 프레임워크

- CUDA 지원(GPU 가속 권장)

1.2 설치 단계:

# 克隆项目仓库

git clone https://github.com/VITA-MLLM/VITA.git

cd VITA

# 安装依赖

pip install -r requirements.txt

2. 모델 사용

2.1 사전 학습된 모델 불러오기:

from vita.model.builder import load_pretrained_model

from vita.conversation import conv_templates

from vita.util.mm_utils import get_model_name_from_path

# 加载模型

model_path = 'VITA/vita'

model_name = get_model_name_from_path(model_path)

tokenizer, model, image_processor, _ = load_pretrained_model(

model_path,

None,

model_name,

model_type='mixtral-8x7b',

device_map='auto'

)

2.2 오디오 처리 구성:

# 初始化音频编码器

audio_encoder = model.get_audio_encoder()

audio_encoder.to(dtype=torch.float16)

audio_processor = audio_encoder.audio_processor

3. 실시간 대화형 기능

- 실시간 음성 입력 및 응답 지원

- 통합 이미지 인식 및 분석

- 다원 대화 상호작용 지원

- 완벽한 대화 템플릿 시스템 제공

4. 고급 기능 사용

4.1 멀티모달 입력 처리:

- 일괄 이미지 처리 지원

- 비디오 스트림의 실시간 분석

- 오디오 스트림 처리 및 합성

4.2 모델 교육 및 미세 조정:

- 완전한 교육 스크립트 제공

- 지속적인 학습 기능 지원

- 맞춤형 데이터 세트 교육 지원

5. 평가 및 테스트

- 주요 멀티모달 평가 벤치마크 지원

- 통합 VLMEvalKit 평가 도구

- 자세한 성능 테스트 지표 제공

6. 주의 사항

- 모델 추론에는 GPU를 권장합니다.

- 특히 대규모 멀티모달 입력을 처리할 때는 메모리 관리에 주의하세요.

- 최신 기능 및 최적화를 위한 프로젝트 업데이트를 정기적으로 확인하세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...