일반 소개

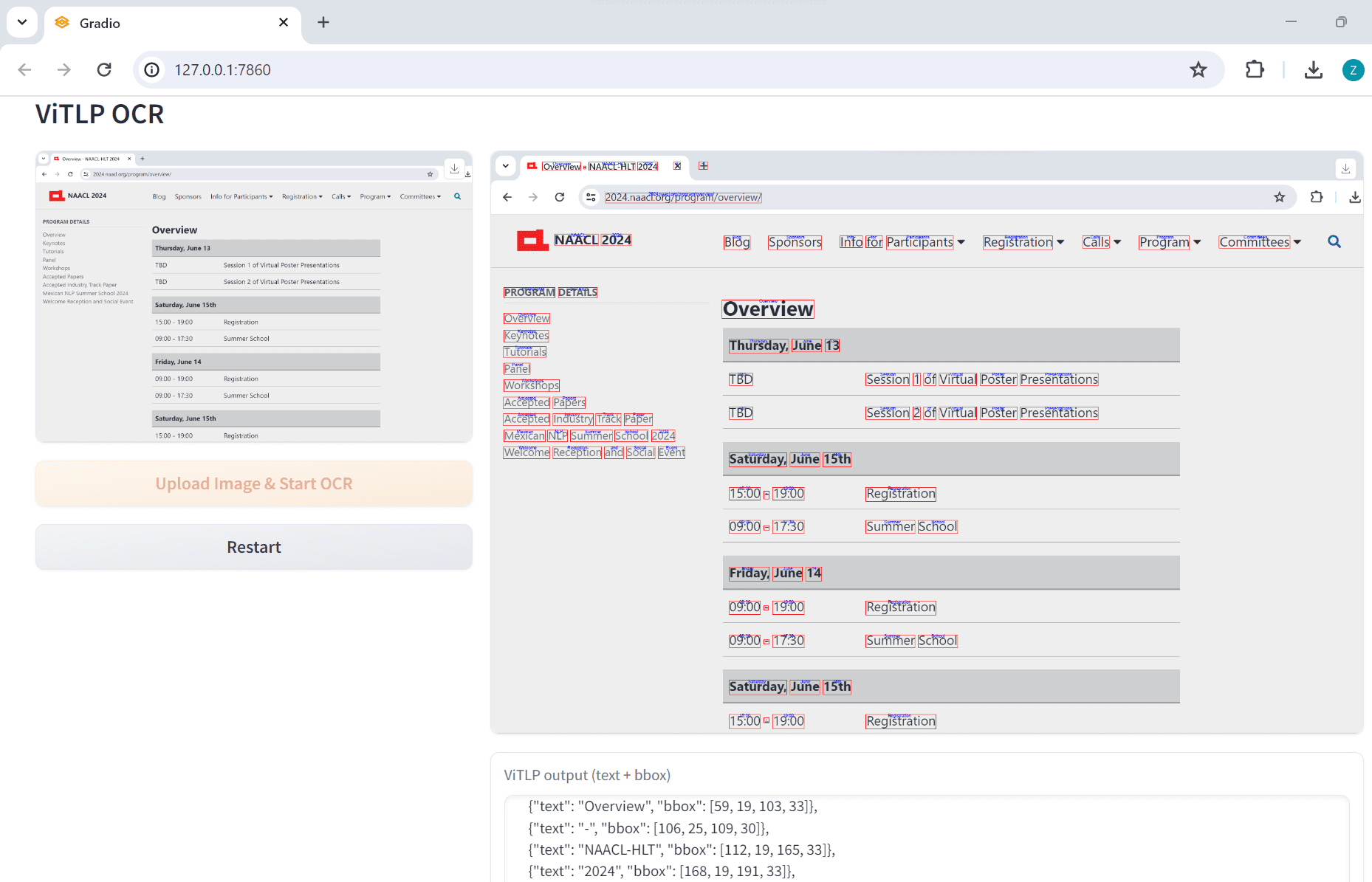

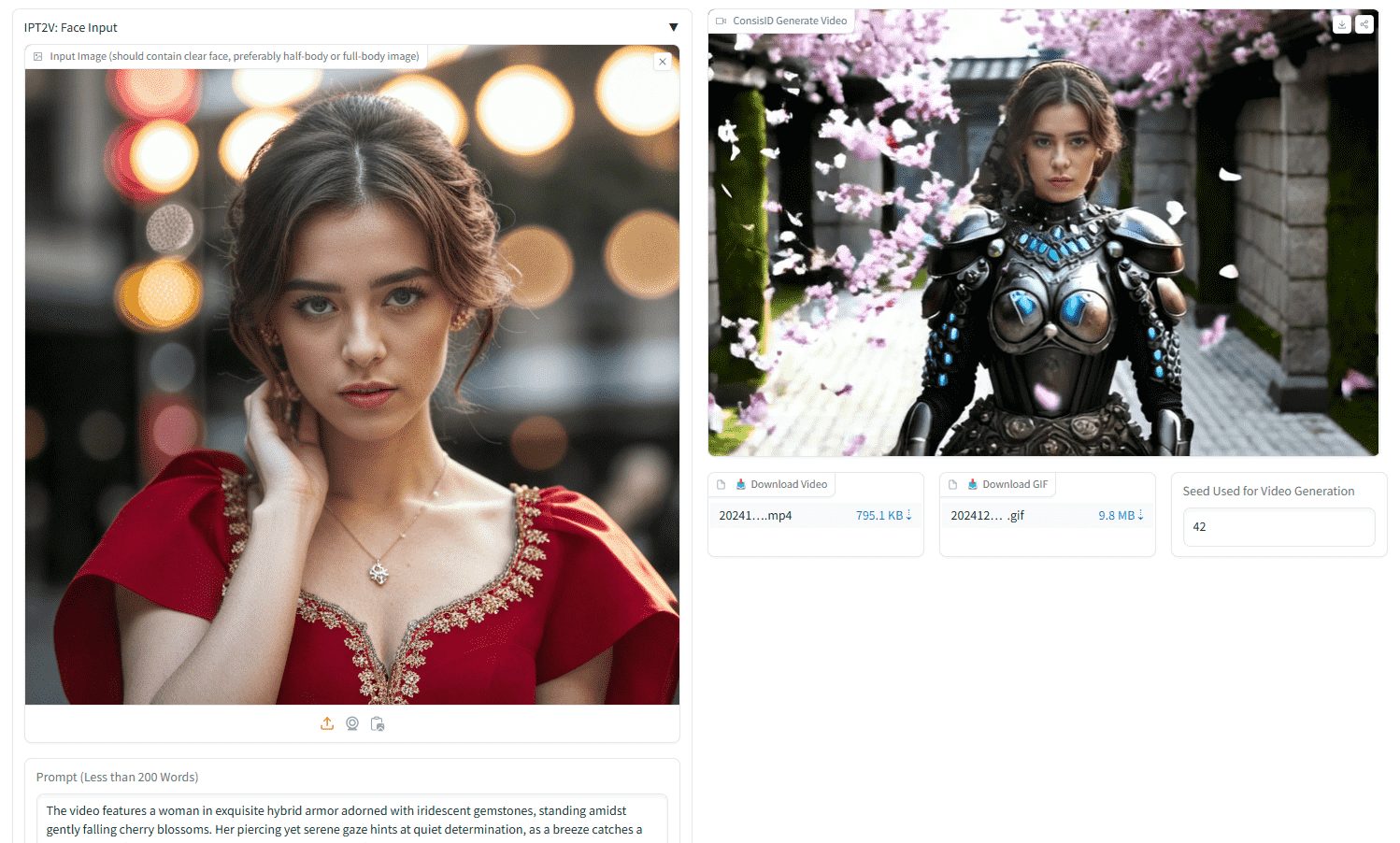

Vision Parse는 최첨단 시각 언어 모델링(비전 언어 모델) 기술을 스마트하게 결합하여 PDF 문서를 고품질 마크다운 형식의 콘텐츠로 지능적으로 변환하는 혁신적인 문서 처리 툴입니다. 이 도구는 OpenAI, LLama, Google Gemini 등 다양한 최고의 시각 언어 모델을 지원하며 문서의 텍스트와 표를 정확하게 추출하고 원본 문서의 계층 구조, 스타일 및 들여쓰기를 유지할 수 있으며, Vision Parse는 다중 페이지 PDF 처리를 지원할 뿐만 아니라 로컬 모델 배포 옵션도 제공하므로 사용자가 동시에 문서 보안을 보장할 수 있습니다. 오프라인 처리. 간단한 API 설계를 통해 개발자는 몇 줄의 코드만으로 복잡한 문서 변환 작업을 수행하여 문서 처리의 효율성과 정확성을 크게 향상시킬 수 있습니다.

기능 목록

- 지능형 콘텐츠 추출: 고급 시각 언어 모델을 사용하여 텍스트 및 표 콘텐츠를 정확하게 인식하고 추출합니다.

- 서식 무결성: 문서의 전체 계층 구조, 스타일 및 들여쓰기 서식을 유지합니다.

- 다중 모델 지원: OpenAI, LLama, Gemini 및 기타 시각 언어 모델 제공업체와 호환 가능

- PDF 다중 페이지 처리: 다중 페이지 PDF 문서 지원은 처리를 위해 base64 인코딩된 이미지로 변환됩니다.

- 로컬 모델 배포: Ollama는 문서 보안 및 오프라인 사용을 위한 로컬 모델 배포를 지원합니다.

- 사용자 지정 구성: DPI, 색 공간 등과 같은 사용자 지정 PDF 처리 매개변수를 지원합니다.

- 유연한 API: 간단하고 직관적인 Python API 인터페이스 제공

도움말 사용

1. 설치 준비

기본 요구 사항:

- Python 3.9 이상

- 로컬 모델을 사용하려면 Ollama를 설치해야 합니다.

- OpenAI 또는 Google Gemini를 사용하려면 적절한 API 키가 필요합니다.

설치 단계:

- pip를 사용하여 기본 패키지를 설치합니다:

pip install vision-parse

- 필요에 따라 추가 종속성을 설치합니다:

- OpenAI 지원:

pip install 'vision-parse[openai]' - 제미니 지원:

pip install 'vision-parse[gemini]'

2. 기본 사용법

샘플 코드:

from vision_parse import VisionParser

# 初始化解析器

parser = VisionParser(

model_name="llama3.2-vision:11b", # 使用本地模型

temperature=0.4,

top_p=0.3,

extraction_complexity=False # 设置为True获取更详细的提取结果

)

# 转换PDF文件

pdf_path = "your_document.pdf"

markdown_pages = parser.convert_pdf(pdf_path)

# 处理转换结果

for i, page_content in enumerate(markdown_pages):

print(f"\n--- 第 {i+1} 页 ---\n{page_content}")

3. 고급 구성

PDF 페이지 구성:

from vision_parse import VisionParser, PDFPageConfig

# 配置PDF处理设置

page_config = PDFPageConfig(

dpi=400,

color_space="RGB",

include_annotations=True,

preserve_transparency=False

)

# 使用自定义配置初始化解析器

parser = VisionParser(

model_name="llama3.2-vision:11b",

temperature=0.7,

top_p=0.4,

page_config=page_config

)

4. 지원 모델

Vision Parse는 광범위한 주류 시각 언어 모델을 지원합니다:

- OpenAI 모델: gpt-4o, gpt-4o-mini

- 구글 제미니 모델: 제미니-1.5-플래시, 제미니-2.0-플래시-익스프레스, 제미니-1.5-프로

- 메타 라마 및 라바(Ollama를 통해): llava:13b, llava:34b, llama3.2-vision:11b, llama3.2-vision:70b

5. 사용 기술

- 적합한 모델 선택: 필요에 따라 로컬 모델 또는 클라우드 기반 서비스를 선택하세요.

- 매개변수 조정: 출력의 창의성과 정확성은 매개변수 temperature 및 top_p에 의해 조정됩니다.

- 추출 복잡도: 복잡한 문서의 경우, 추출 복잡도 = True로 설정하는 것이 좋습니다.

- 로컬 배포: 민감한 문서에서는 로컬 모델 배포에 Ollama를 사용할 것을 권장합니다.

- PDF 구성: 문서의 특성에 따라 DPI와 색 공간 및 기타 매개변수를 조정합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...