일반 소개

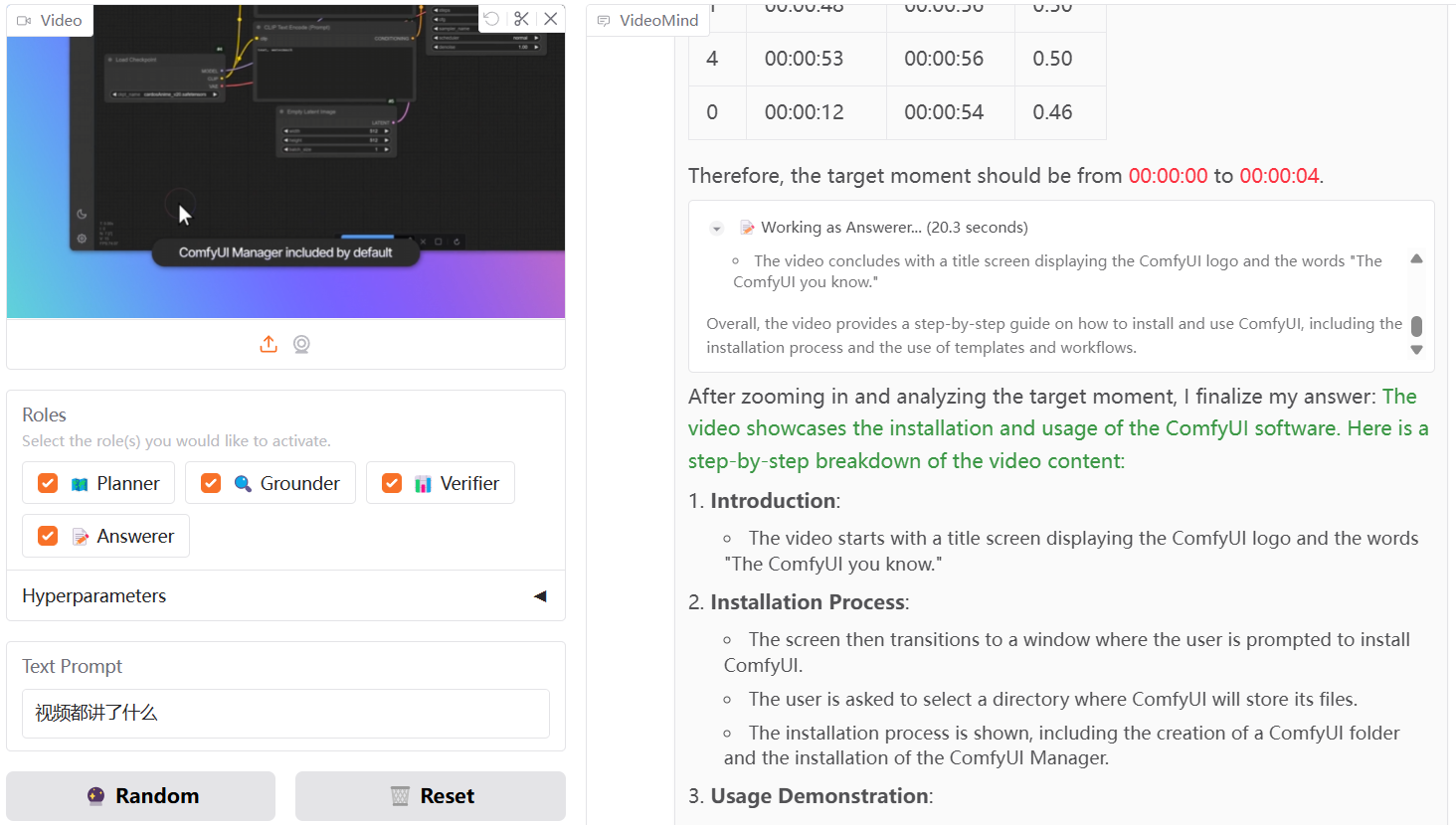

비디오마인드는 긴 동영상을 위한 추론, Q&A 및 요약 생성에 중점을 둔 오픈 소스 멀티모달 AI 도구입니다. 홍콩 폴리테크닉 대학교의 예 리우와 싱가포르 국립대학교의 쇼 랩 팀이 개발했습니다. 이 도구는 사람이 동영상을 이해하는 방식을 모방하여 계획, 위치 설정, 확인, 답변 등의 단계로 작업을 세분화하여 단계별로 문제를 해결합니다. 핵심 기술은 기본 모델을 통해 역할을 전환하는 Chain-of-LoRA로, 효율적이고 리소스 효율적입니다.2024년 3월 21일에 코드, 모델 및 데이터 세트를 공식 출시하고 2025년 3월 17일에 기술 보고서를 업데이트합니다.VideoMind는 GitHub 또는 GitHub를 통해 이용할 수 있습니다. 사용자는 GitHub 또는 Hugging Face를 통해 리소스에 액세스할 수 있습니다.

이 프로젝트는 내용을 이해하기 위해 오디오를 텍스트로 추출하지 않고 순전히 그래픽과 타임 스탬프에 따라 비디오의 내용을 정확하게 이해하기 위해 자동 비디오 미세 조정, 교육 시나리오에 사용할 수 있으며 매우 실용적입니다!

체험: https://huggingface.co/spaces/yeliudev/VideoMind-2B

기능 목록

- 긴 동영상 시간대 타겟팅: 동영상에서 질문과 관련된 시간대를 찾습니다.

- 동영상 Q&A 기능: 사용자의 질문을 기반으로 동영상에서 정확한 답변을 추출합니다.

- 동영상 요약 생성: 주요 동영상 콘텐츠를 추출하여 간결한 개요를 생성합니다.

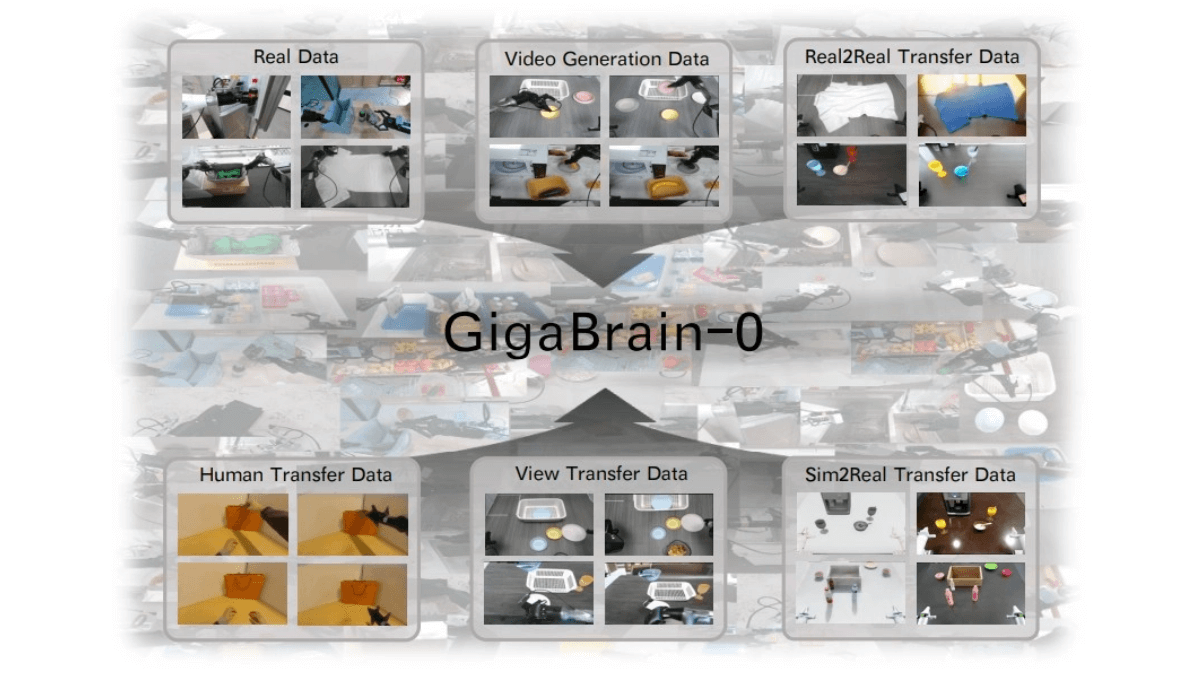

- 멀티모달 에이전트 프레임워크: 작업에서 협업하는 플래너, 로케이터, 검증자 및 응답자를 포함합니다.

- Chain-of-LoRA 기술: 단일 모델로 다양한 기능을 제공하고 리소스 소비를 줄입니다.

- 여러 하드웨어 지원: NVIDIA GPU 또는 Ascend NPU에서 실행됩니다.

- 효율적인 교육 지원: 딥스피드, LoRA, 플래시어텐션2 및 기타 기술의 통합.

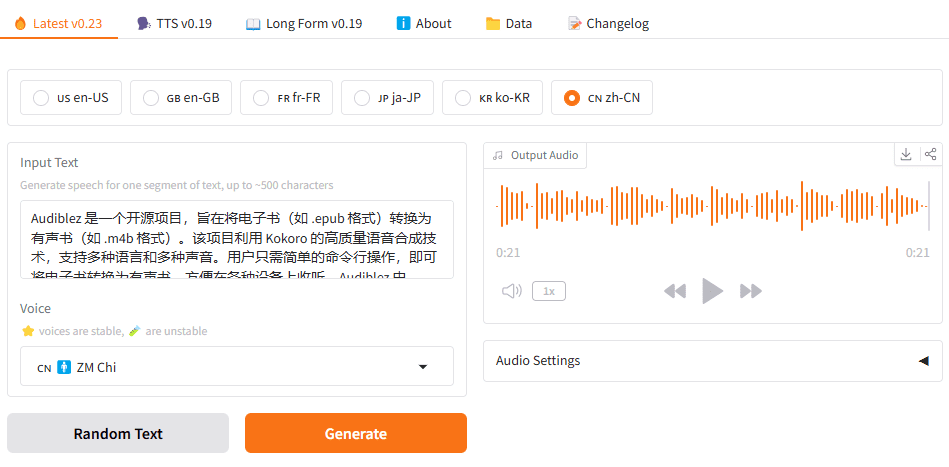

- 온라인 데모: Gradio 인터페이스를 통해 기능을 빠르게 체험해 보세요.

도움말 사용

비디오마인드는 오픈 소스 프로젝트이므로 사용자가 코드를 다운로드하고 사용 환경을 구성해야 합니다. 다음은 설치 및 기능 사용에 대한 자세한 가이드입니다.

설치 프로세스

- 복제 코드 리포지토리

터미널에서 다음 명령을 실행하여 비디오마인드 소스 코드를 다운로드합니다:

git clone https://github.com/yeliudev/VideoMind.git

프로젝트 카탈로그로 이동합니다:

cd VideoMind

- Python 환경 설정

콘다를 사용하여 가상 환경을 만듭니다(Python 3.12 권장):

conda create -n videomind python=3.12 -y

conda activate videomind

- 종속 라이브러리 설치

다음 명령을 실행하여 필요한 종속성을 설치합니다:

pip install -r requirements.txt

효율적인 교육을 위해 DeepSpeed를 설치하세요:

pip install deepspeed

- 모델 및 데이터 세트 다운로드

- https://huggingface.co/collections/yeliudev/videomind-67dd41f42c57f0e7433afb36 방문하여 사전 학습된 모델을 다운로드하세요(예

VideoMind-2B)에 압축을 풀고models폴더. - 데이터 세트는 https://huggingface.co/datasets/yeliudev/VideoMind-Dataset下载 에서 확인할 수 있으며, 27개의 비디오 데이터 세트와 비디오마인드-SFT(481K 트레이닝 데이터)가 포함되어 있습니다.

data카탈로그.

- 테스트 설치

테스트 스크립트를 실행하여 환경이 올바른지 확인합니다:

python test.py

주요 기능

1. 긴 형식의 동영상 시간 포지셔닝

- 동영상 준비하기비디오 파일을

data/videos카탈로그, MP4, AVI 및 기타 포맷을 지원합니다. - 명령 실행::

python run_grounding.py --video_path data/videos/sample.mp4 --query "找到讨论AI的部分"

- 결과 출력: 시간 범위(예: "00:05:12 - 00:07:34")를 반환합니다.

2. 동영상 퀴즈

- 입력 문제신규

query.txt"동영상 속 주인공은 누구인가요?"와 같은 질문을 작성합니다. . - 명령을 실행합니다.::

python run_qa.py --video_path data/videos/sample.mp4 --query_file query.txt

- 답변 받기: 단말기에 "주인공은 리밍입니다"와 같은 결과가 표시됩니다.

3. 동영상 요약 생성

- 명령 실행::

python run_summary.py --video_path data/videos/sample.mp4

- 요약 보기결과는 다음과 같이 저장됩니다.

summary.txt예를 들어 "이 동영상은 과학 및 기술 강의를 소개합니다."라고 설명합니다.

주요 기능 작동

체인 오브 로라 기술

- 비디오마인드는 단일 모델을 사용하여 LoRA 어댑터를 통해 역할을 전환합니다. 구성 파일은

config/lora.yaml조정 가능rank파라미터 부스팅 효과:

lora:

rank: 16

온라인 데모

- 로컬 설치가 필요 없으므로 https://huggingface.co/spaces/yeliudev/VideoMind-2B 에 방문하여 동영상을 업로드하고 질문을 입력하면 기능을 직접 체험할 수 있습니다. 자세한 내용은 다음을 참조하세요.

docs/DEMO.md.

교육 모델

- 데이터 준비사용

VideoMind-SFT또는 27개의 다른 데이터 세트는data카탈로그. - 프라이밍 교육실행:

python train.py --dataset data/VideoMind-SFT --model models/VideoMind-2B

- 교육 모니터링진행 상황 보기를 위한 텐서보드 또는 완드비 지원, 자세한 내용은 설정을 참조하세요.

docs/TRAIN.md.

주의

- 동영상 파일이 너무 큰 경우 메모리 오버플로우를 방지하기 위해 세그먼트 단위로 처리하는 것이 좋습니다.

- Ascend NPU 사용자는 Ascend 드라이버를 설치하고 실행 시 파라미터를 추가해야 합니다.

--device ascend. - 커미셔닝에 대한 자세한 내용은 다음을 참조하세요.

docs/EVAL.md에서 벤치마킹 가이드라인을 확인하세요.

이 단계를 통해 사용자는 VideoMind를 빠르게 설치하고 사용하여 긴 동영상 작업을 처리할 수 있습니다.

애플리케이션 시나리오

- 비디오 콘텐츠 분석

사용자는 VideoMind를 사용하여 긴 YouTube 동영상을 분석하고, 주요 클립을 찾거나, 요약을 생성하여 시청 시간을 절약할 수 있습니다. - 교육 및 연구

강의 동영상으로 작업하는 학생이나 연구자는 "어떤 알고리즘을 다뤘나요?"라고 질문할 수 있습니다. 라고 질문하여 답을 얻고 노트를 보다 효율적으로 정리할 수 있습니다. - 콘텐츠 감사

플랫폼 관리자는 이를 사용하여 위반되는 클립이 있는지 확인하는 등 동영상 콘텐츠가 규정을 준수하는지 확인합니다.

QA

- 비디오마인드가 처리할 수 있는 동영상 길이는 어느 정도인가요?

하드웨어에 따라 16GB RAM은 1시간 분량의 동영상을 처리할 수 있으며, 32GB는 더 긴 콘텐츠를 지원합니다. - 온라인 데모와 로컬 배포의 차이점은 무엇인가요?

온라인 버전은 설치가 필요 없지만 기능이 제한적이며, 로컬 버전은 사용자 지정 교육 및 대규모 처리를 지원합니다. - 데이터 세트는 어떻게 사용되나요?

27개의 데이터 세트가 훈련 및 평가에 사용되었으며, https://huggingface.co/datasets/yeliudev/VideoMind-Dataset 에서 설명한 대로 VideoMind-SFT가 모델 최적화에 적합했습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...