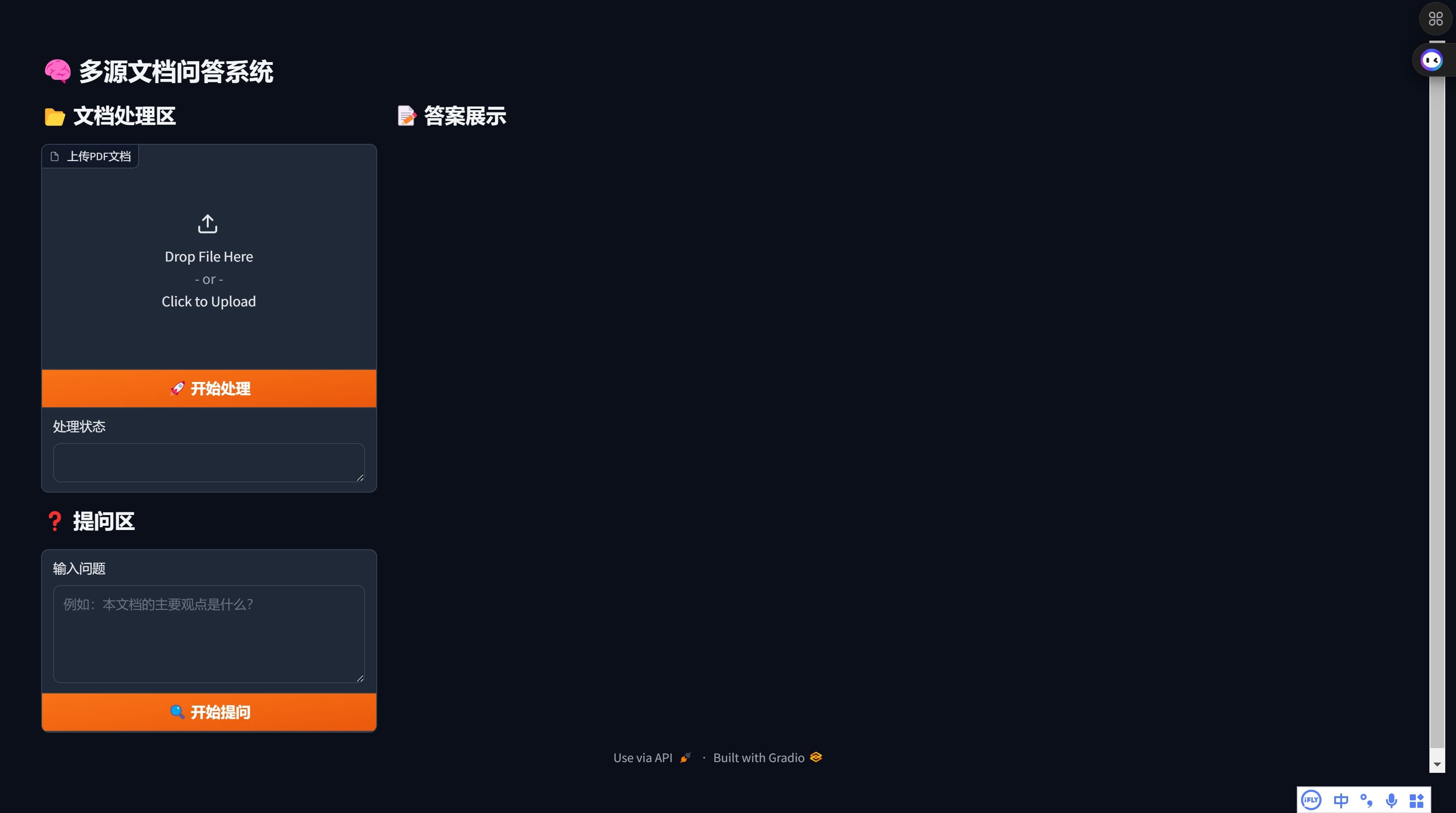

울트라라이트 디지털 휴먼: 원클릭 설치 패키지로 초경량 디지털 휴먼을 실시간으로 실행하는 오픈 소스 엔드사이드 실시간 실행

일반 소개

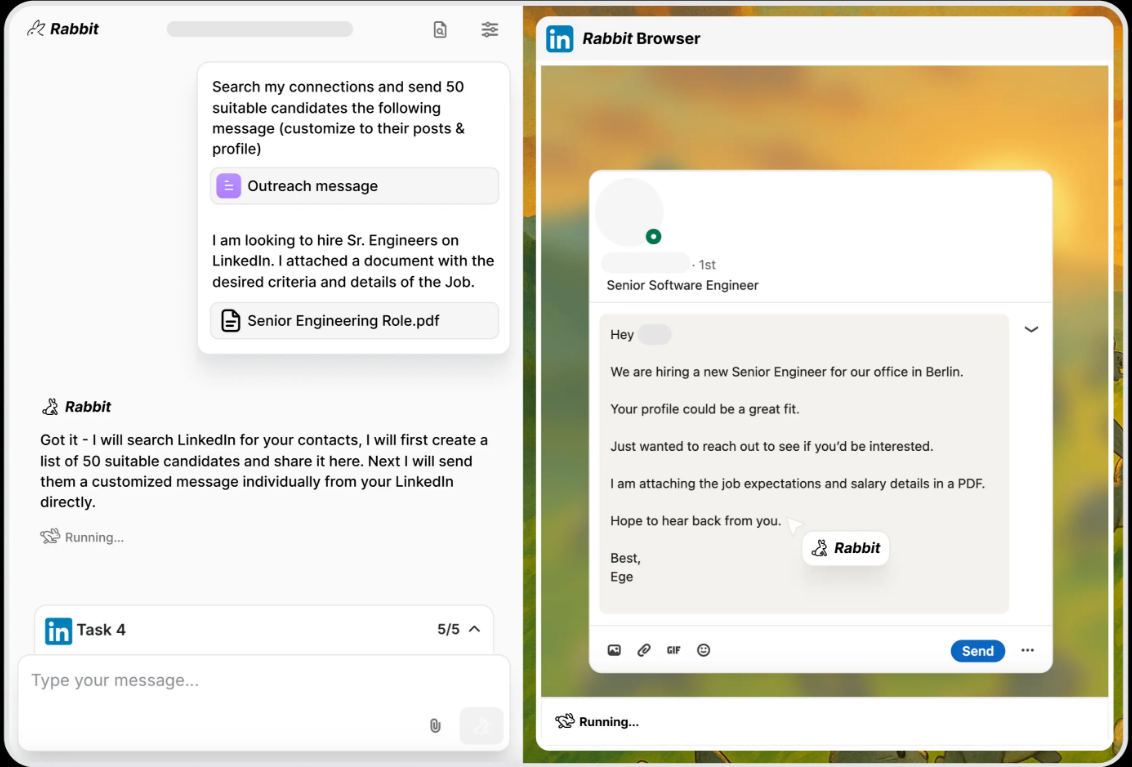

초경량 디지털 휴먼은 모바일 기기에서 실시간으로 실행할 수 있는 초경량 디지털 휴먼 모델 개발을 목표로 하는 오픈 소스 프로젝트입니다. 이 프로젝트는 소셜 애플리케이션, 게임, 가상 현실 등 다양한 시나리오에 맞게 알고리즘과 모델 구조를 최적화하여 모바일 기기에서 원활하게 작동할 수 있도록 합니다. 사용자는 자신만의 디지털 휴먼 모델을 쉽게 훈련하고 배포하여 개인화된 몰입형 경험을 즐길 수 있습니다.

모바일에서도 잘 작동한다는 사실에 대해서는 현재 모델의 채널 수를 조금 더 작게 변경하고 오디오 기능에 wenet을 사용하면 괜찮을 것입니다.

기능 목록

- 실시간 운영모바일 기기에서 실시간으로 실행할 수 있고 반응성이 뛰어난 모델입니다.

- 경량 설계리소스가 제한된 모바일 기기에 최적화된 모델 구조.

- 오픈 소스 프로젝트코드와 모델은 완전히 오픈 소스이며 사용자가 자유롭게 수정하고 사용할 수 있습니다.

- 멀티 시나리오 애플리케이션소셜 애플리케이션, 게임, 가상 현실 등 다양한 시나리오에 적합합니다.

- 오디오 특징 추출웨넷 및 휴버트 오디오 특징 추출 방식을 모두 지원합니다.

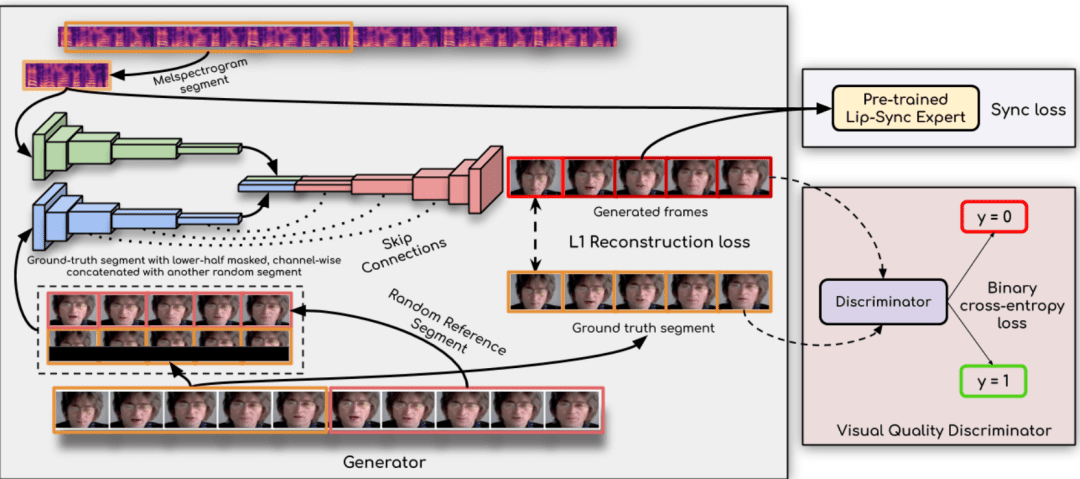

- 동기식 네트워크싱크넷 기술로 향상된 립싱크 동기화.

- 자세한 튜토리얼사용자가 빠르게 시작할 수 있도록 자세한 교육 및 사용 튜토리얼이 제공됩니다.

도움말 사용

설치 프로세스

- 환경 준비::

- Python 3.10 이상을 설치합니다.

- PyTorch 1.13.1 및 기타 종속 요소를 설치합니다:

conda create -n dh python=3.10 conda activate dh conda install pytorch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1 pytorch-cuda=11.7 -c pytorch -c nvidia conda install mkl=2024.0 pip install opencv-python transformers numpy==1.23.5 soundfile librosa onnxruntime

- 모델 파일 다운로드::

- 다음 링크에서 wenet encoder.onnx 파일을 다운로드하여

data_utils/카탈로그: 다운로드 링크

- 다음 링크에서 wenet encoder.onnx 파일을 다운로드하여

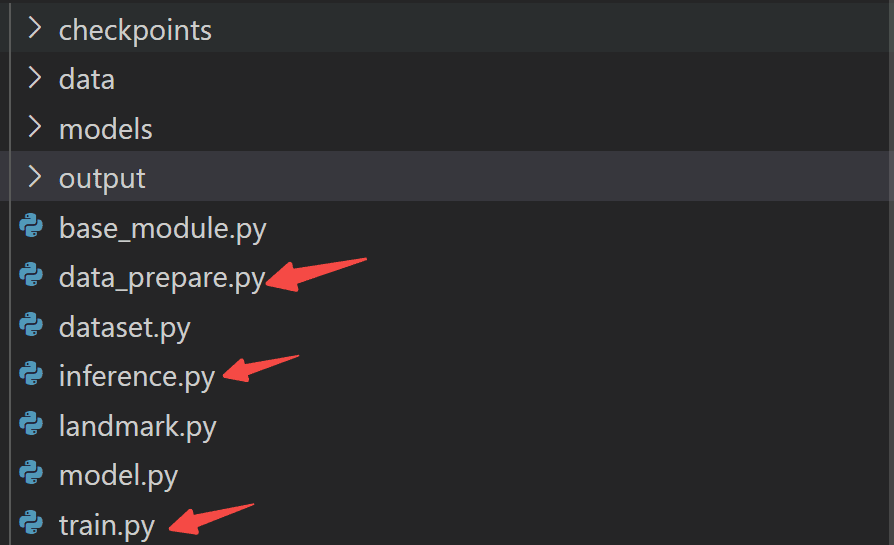

사용 프로세스

- 동영상 준비하기::

- 각 프레임에 얼굴이 완전히 노출되고 소리가 선명하고 잡음이 없는지 확인하면서 3~5분 분량의 동영상을 준비합니다.

- 동영상을 새 폴더에 넣습니다.

- 오디오 특징 추출::

- 다음 명령을 사용하여 오디오 특징을 추출할 수 있습니다:

cd data_utils python process.py YOUR_VIDEO_PATH --asr hubert

- 다음 명령을 사용하여 오디오 특징을 추출할 수 있습니다:

- 교육 모델::

- 더 나은 결과를 위해 싱크넷 모델을 훈련하세요:

cd .. python syncnet.py --save_dir ./syncnet_ckpt/ --dataset_dir ./data_dir/ --asr hubert - 최저 손실 체크포인트를 사용하여 디지털 휴먼 모델을 훈련합니다:

python train.py --dataset_dir ./data_dir/ --save_dir ./checkpoint/ --asr hubert --use_syncnet --syncnet_checkpoint syncnet_ckpt

- 더 나은 결과를 위해 싱크넷 모델을 훈련하세요:

- 추론::

- 테스트 오디오 특징 추출하기:

python extract_test_audio.py YOUR_TEST_AUDIO_PATH --asr hubert - 추론 실행:

python inference.py --dataset ./data_dir/ --audio_feat ./your_test_audio_hu.npy --save_path ./output.mp4 --checkpoint ./checkpoint/best_model.pth

- 테스트 오디오 특징 추출하기:

주의

- 비디오 프레임 속도가 선택한 오디오 특징 추출 방식과 일치하는지 확인합니다(wenet의 경우 20fps, hubert의 경우 25fps).

- 학습 및 추론 과정에서 모델의 손실 값을 정기적으로 모니터링하고 학습을 위한 최적의 체크포인트를 선택합니다.

Monkey 원클릭 통합 팩

https://pan.baidu.com/s/19DcRlR0kJVg4bLb7snUrBQ?pwd=tct1

사용자의 편의를 위해 위의 프로세스를 통합하여 요약했습니다(모델 가중치 및 테스트 사례 포함):

그냥 장난을 치면 됩니다:

0단계: 종속성을 설치합니다:

conda create -n udh python=3.10 conda activate udh pip install -r requirements.txt

1단계: 데이터 준비

python data_prepare.py

2단계: 모델 교육:

python train.py

3단계: 모델링 추론:

python inference.py

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 게시물

댓글 없음...