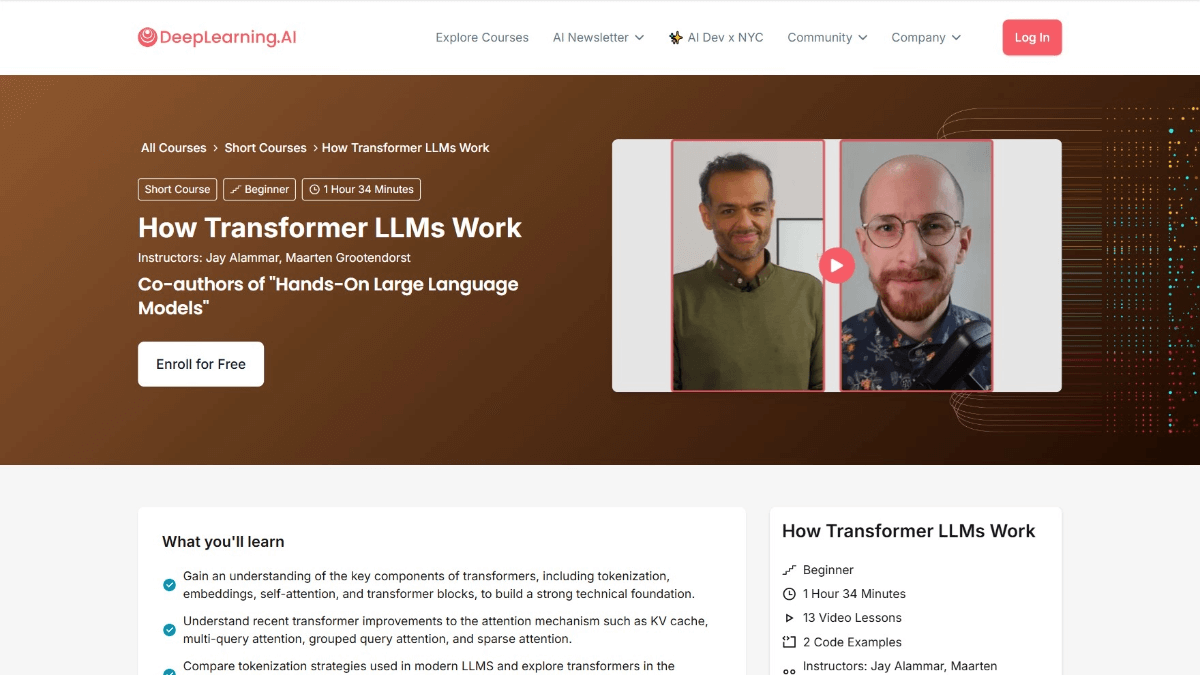

트랜스포머 LLM은 어떻게 작동하나요?

트랜스포머 LLM의 작동 방식은 '대규모 언어 모델 실습'의 저자인 Jay Alammar 및 Maarten Grootendorst와 공동으로 개발한 DeepLearning.AI의 강좌입니다. 이 강좌에서는 대규모 언어 모델(LLM)을 지원하는 Transformer 아키텍처에 대해 심층적으로 살펴봅니다. 이 과정은 언어의 수치 표현의 진화부터 시작하여 모호성, 주의 메커니즘 및 Transformer 블록의 피드포워드 계층, 계산을 캐싱하여 성능을 개선하는 방법과 같은 주제를 다룹니다. 이 과정을 마치면 LLM이 언어를 처리하는 방식을 심층적으로 이해하고, 관련 논문을 읽고 이해할 수 있으며, LLM 애플리케이션 구축 능력을 향상시킬 수 있습니다.

Transformer LLM의 작동 방식에 대한 과정 목표

- 언어의 숫자 표현의 진화 이해하기간단한 Bag-of-Words 모델부터 복잡한 Transformer 아키텍처에 이르기까지 언어가 디지털 방식으로 표현되는 방식을 이해합니다.

- 분사 처리 마스터하기입력 텍스트를 '토큰'으로 분해하는 방법을 배우고 토큰이 언어 모델에 어떻게 공급되는지 이해합니다.

- 트랜스포머 아키텍처 자세히 알아보기트랜스포머 아키텍처의 세 가지 주요 단계인 모호성 제거 및 임베딩, 트랜스포머 블록 스택, 언어 모델 헤더에 대해 자세히 살펴봅니다.

- 트랜스포머 블록의 세부 사항 이해하기주의 메커니즘과 피드포워드 레이어, 그리고 이들이 함께 작동하여 텍스트를 처리하고 생성하는 방법을 포함합니다.

- 학습 성능 최적화캐시 컴퓨팅과 같은 기술을 통해 Transformer의 성능을 향상시키는 방법을 알아보세요.

- 실용적인 애플리케이션 탐색허깅 페이스 트랜스포머 라이브러리를 통해 향상된 실제 적용을 위한 최신 모델 구현을 살펴봅니다.

Transformer LLM의 작동 방식에 대한 과정 개요

- 트랜스포머 LLM 개요최신 LLM(대규모 언어 모델)의 맥락에서 트랜스포머 아키텍처의 과정 목표, 구조 및 중요성에 대한 소개입니다.

- 언어적 표현의 진화Bag-of-Words에서 Word2Vec, Transformer 아키텍처에 이르는 언어 모델링의 진화 과정을 살펴봅니다.

- 분사 및 임베딩입력 텍스트가 토큰으로 분해되는 방법과 위치 코딩 적용을 포함하여 토큰을 임베딩 벡터로 변환하는 방법에 대해 알아보세요.

- 변압기 블록자기 주의 메커니즘과 피드 포워드 네트워크의 역할을 포함한 트랜스포머 블록의 구조를 이해합니다.

- 긴 주의멀티 헤드 주의 메커니즘이 여러 '헤드'를 통해 입력의 다양한 측면을 포착하여 모델 성능을 향상시키는 방법을 살펴보세요.

- 트랜스포머 블록 스태킹여러 개의 트랜스포머 블록을 쌓아 딥 모델을 구축하는 방법과 잔여 링크 및 레이어 정규화의 역할에 대해 알아보세요.

- 언어 모델 헤더언어 모델 헤더에서 다음 토큰의 확률 분포를 생성하여 Transformer가 텍스트 생성을 구현하는 방법을 이해합니다.

- 캐싱 메커니즘캐싱 메커니즘을 통해 트랜스포머 모델의 추론 속도를 개선하는 방법과 캐싱의 실제 적용 사례에 대해 알아보세요.

- 최신 아키텍처 혁신전문가 혼합(MoE) 및 기타 트랜스포머 아키텍처의 최신 혁신 기술을 소개합니다.

- 포옹하는 얼굴로 트랜스포머 구현하기허깅 페이스 트랜스포머 라이브러리를 사용하여 사전 학습된 트랜스포머 모델을 로드하고 미세 조정하는 방법을 알아보세요.

- 트랜스포머의 실습 코딩트랜스포머의 주요 구성 요소를 구현하고 실습 코딩 연습을 통해 간단한 트랜스포머 모델을 만드는 방법을 배워보세요.

- 읽기 및 이해력 연구 논문트랜스포머 관련 연구 논문을 읽고 이해하는 방법, 최근 논문과 해당 분야에 대한 기여도를 분석하는 방법에 대해 알아보세요.

- LLM 애플리케이션 구축LLM 기반 애플리케이션을 개발하는 방법을 살펴보고 Transformer 아키텍처의 향후 방향과 잠재적 적용 가능성에 대해 논의합니다.

Transformer LLM의 작동 방식에 대한 코스 주소

- 코스 주소::DeepLearning.AI

트랜스포머 LLM이 일하는 대상

- 자연어 처리(NLP) 연구원언어 이해, 생성 및 번역 분야의 최첨단 애플리케이션을 탐구하고 자연어 처리 기술 개발을 촉진하는 트랜스포머 아키텍처에 대해 심층적으로 연구합니다.

- 머신 러닝 엔지니어모델 성능을 최적화하고, 모델 정확도와 효율성을 개선하며, 더욱 강력한 언어 모델 애플리케이션을 개발할 수 있도록 Transformer의 작동 방식을 마스터하세요.

- 데이터 과학자트랜스포머 아키텍처로 대규모 텍스트 데이터를 처리 및 분석하고, 데이터에서 패턴과 정보를 마이닝하여 의사 결정을 지원합니다.

- 소프트웨어 개발자챗봇, 콘텐츠 추천 시스템 등 다양한 소프트웨어 애플리케이션에 트랜스포머 LLM을 통합하여 제품 인텔리전스를 향상시킬 수 있습니다.

- 인공 지능 애호가트랜스포머 아키텍처에 관심이 있고 그 작동 방식을 배우고, AI 기술을 더 깊이 이해하며, 기술적 지평을 넓히고자 합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...