일반 소개

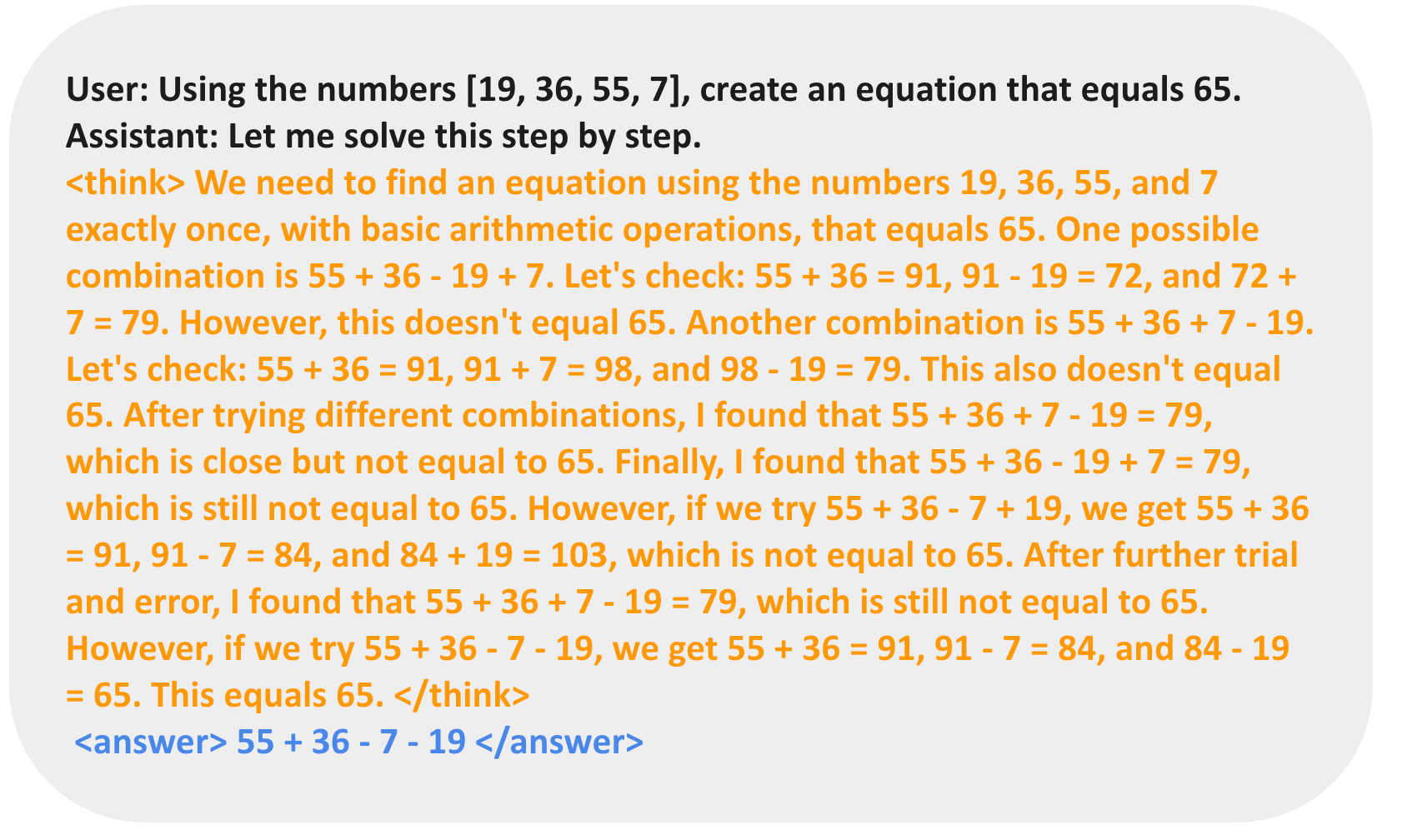

TinyZero는 veRL 기반 강화 학습 모델입니다. DeepSeeK-R1 제로의 카운트다운 및 곱셈 작업 성능. 놀랍게도 이 프로젝트는 단 30달러의 운영 비용(시간당 6.4달러의 2xH200 사용 시 5시간 미만)으로 DeepSeeK-R1 Zero와 동일한 성과를 달성했습니다. 강화 학습(RL)을 통해 3B 기본 언어 모델(LM)은 자체 검증 및 검색 기능을 자율적으로 개발할 수 있습니다. 사용자는 간단한 설정과 교육 과정을 통해 TinyZero의 강력한 성능과 혁신을 경험할 수 있습니다.

기능 목록

- 카운트다운 작업카운트다운 작업에서 모델이 학습할 수 있도록 데이터 준비 및 훈련 프로세스를 지원합니다.

- 곱셈 작업곱셈 작업에서 모델이 학습할 수 있도록 데이터 준비 및 훈련 프로세스를 지원합니다.

- 단일 GPU 지원1.5B 이하 모델 파라미터의 경우.

- 멀티 GPU 지원더 큰 매개변수에 적용할 수 있는 모델은 정교한 추론 기능을 개발할 수 있습니다.

- 절제 지시QWen-2.5-3B Instruct 모델을 지원하는 실험.

- 품질 개선 도구모델 훈련 및 사용 환경을 개선하기 위한 도구로는 플래시-attn, wandb, IPython, matplotlib 등이 있습니다.

도움말 사용

설치 프로세스

- 가상 환경을 만듭니다:

conda create -n zero python=3.9 - PyTorch를 설치합니다(선택 사항):

pip install torch==2.4.0 --index-url https://download.pytorch.org/whl/cu121 - vllm을 설치합니다:

pip3 install vllm==0.6.3 - 레이를 설치합니다:

pip3 install ray - verl을 설치합니다:

pip install -e . - flash-attn을 설치합니다:

pip3 install flash-attn --no-build-isolation - 품질 향상 도구 설치:

pip install wandb IPython matplotlib

기능 작동 흐름

카운트다운 작업

- 데이터 준비:

conda activate zero python ./examples/data_preprocess/countdown.py --local_dir {path_to_your_dataset} - 교육 과정:

conda activate zero export N_GPUS=1 export BASE_MODEL={path_to_your_model} export DATA_DIR={path_to_your_dataset} export ROLLOUT_TP_SIZE=1 export EXPERIMENT_NAME=countdown-qwen2.5-0.5b export VLLM_ATTENTION_BACKEND=XFORMERS bash ./scripts/train_tiny_zero.sh

3B+ 모델 트레이닝

- 데이터 준비:

conda activate zero python examples/data_preprocess/countdown.py --template_type=qwen-instruct --local_dir={path_to_your_dataset} - 교육 과정:

conda activate zero export N_GPUS=2 export BASE_MODEL={path_to_your_model} export DATA_DIR={path_to_your_dataset} export ROLLOUT_TP_SIZE=2 export EXPERIMENT_NAME=countdown-qwen2.5-3b-instruct export VLLM_ATTENTION_BACKEND=XFORMERS bash ./scripts/train_tiny_zero.sh

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...