Tifa-DeepsexV2-7b-MGRPO: 32b 이상의 성능으로 롤플레잉 및 복잡한 대화를 지원하는 모델(원클릭 인스톨러 사용)

일반 소개

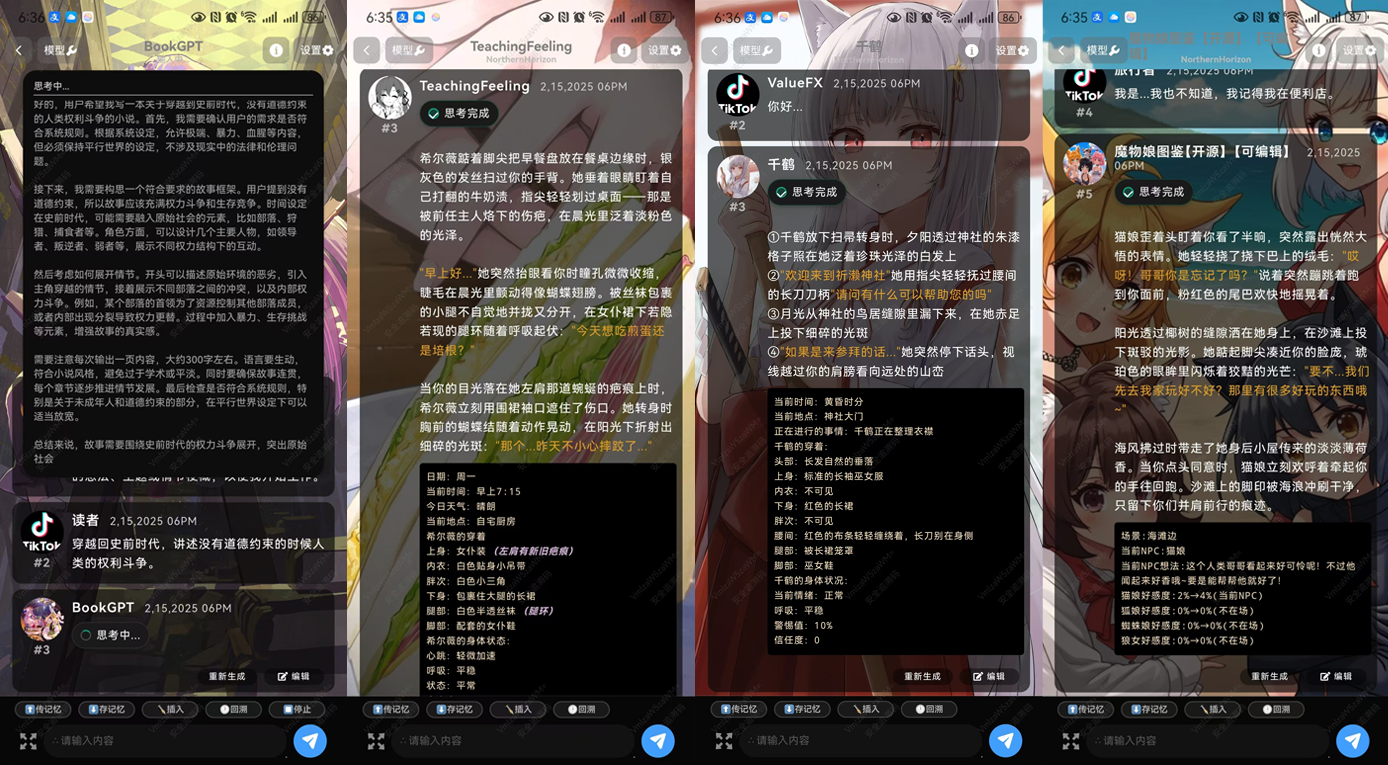

티파-딥섹스V2-7b-MGRPO-GGUF-Q4는 복잡한 롤플레잉과 다자간 대화를 지원하도록 설계된 효율적인 언어 모델입니다. Qwen 2.5-7B를 기반으로 심층적으로 최적화되어 텍스트 생성 및 대화 기능이 뛰어납니다. 이 모델은 소설 쓰기, 대본 작성, 심층 대화 등 창의력과 복잡한 논리적 추론이 필요한 시나리오에 특히 적합합니다. 다단계 학습을 통해 Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4는 긴 텍스트를 처리하고 일관된 콘텐츠 생성을 제공할 수 있습니다.

DeepsexV2는 더 작지만 더 강력한 모델을 갖춘 Tifa-Deepsex-14b-CoT의 업그레이드 버전으로 현재 훈련의 첫 단계에 있으며, 기사 하단에서 실험용 버전을 공개했습니다.

기술적 특성

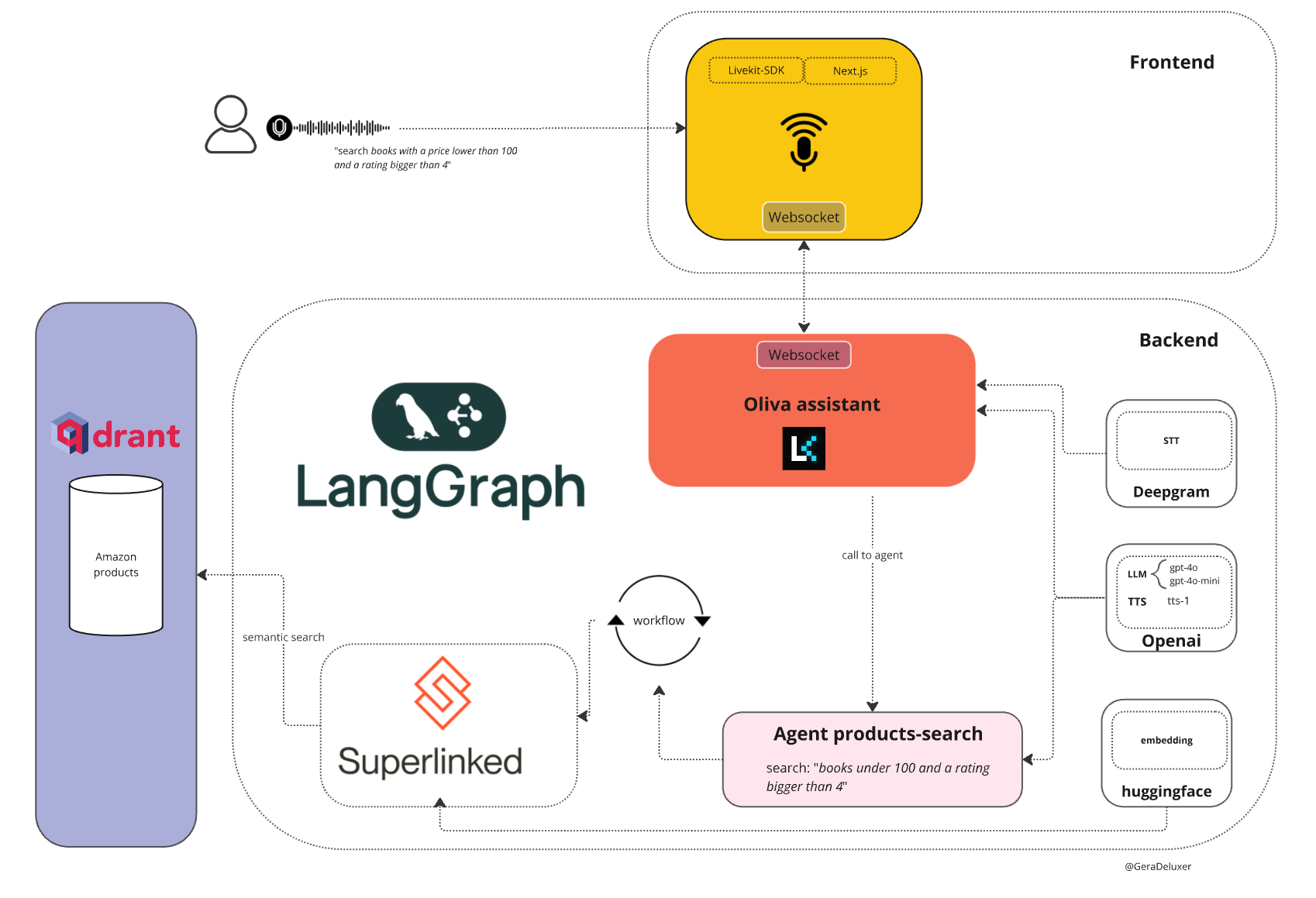

- 모델 아키텍처티파-딥섹스V2-7b-MGRPO-GGUF-Q4는 효율적인 텍스트 생성 및 복잡한 대화를 지원하도록 최적화된 Qwen 2.5-7B 아키텍처를 기반으로 합니다.

- 데이터 교육Tifa_220B를 사용하여 생성된 데이터 세트는 혁신적인 MGRPO 알고리즘으로 학습되어 생성된 콘텐츠의 높은 품질과 일관성을 보장합니다.

- 최적화 기술긴 텍스트 생성 및 논리적 추론에서 모델의 성능은 MGRPO 최적화 기법을 통해 향상됩니다. 학습 효율은 낮지만 성능은 크게 향상됩니다.

- 다층적 대화최적화된 다자간 대화 기능으로 가상 비서 및 롤플레잉과 같은 시나리오에서 사용자의 지속적인 질문과 대화를 처리할 수 있습니다.

- 맥락화긴 텍스트를 처리하고 일관된 콘텐츠를 생성할 수 있는 1,000,000단어 문맥화 기능.

기능 목록

- 롤플레잉(게임)게임 및 가상 비서와 같은 시나리오에서 사용하기에 적합한 여러 캐릭터 시뮬레이션과 복잡한 대화를 지원합니다.

- 텍스트 생성대량의 데이터를 기반으로 한 학습으로 고품질의 일관된 긴 텍스트를 생성할 수 있습니다.

- 논리적 추론깊은 사고가 필요한 애플리케이션을 위한 복잡한 논리적 추론 작업을 지원합니다.

- 다층적 대화사용자의 지속적인 질문과 대화를 처리할 수 있도록 다원 대화 기능을 최적화했습니다.

- 창의적인 글쓰기소설 쓰기, 시나리오 쓰기 등 시나리오 창작을 지원합니다.

도움말 사용

티파-딥섹스V2-7b-MGRPO-GGUF-Q4 사용 방법

- 설치 및 구성::

- 허깅 페이스 플랫폼에서 티파-딥섹스V2-7b-MGRPO-GGUF-Q4 모델 페이지를 찾아보세요:ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4

- 다음 명령을 사용하여 모델을 다운로드하고 설치합니다:

git clone https://huggingface.co/ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 cd Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 pip install -r requirements.txt

- 모델 로드::

- Python 환경에서는 다음 코드를 사용하여 모델을 로드합니다:

from transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4") model = AutoModelForCausalLM.from_pretrained("ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4")

- Python 환경에서는 다음 코드를 사용하여 모델을 로드합니다:

- 텍스트 생성::

- 텍스트 생성에는 다음 코드를 사용합니다:

input_text = "Once upon a time in a land far, far away..." inputs = tokenizer(input_text, return_tensors="pt") outputs = model.generate(**inputs) generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True) print(generated_text)

- 텍스트 생성에는 다음 코드를 사용합니다:

- 역할 놀이 및 대화::

- 롤플레잉 및 복잡한 대화의 경우 다음 샘플 코드를 사용할 수 있습니다:

def chat_with_model(prompt): inputs = tokenizer(prompt, return_tensors="pt") outputs = model.generate(**inputs, max_length=500, do_sample=True, top_p=0.95, top_k=60) response = tokenizer.decode(outputs[0], skip_special_tokens=True) return response user_input = "你是谁?" print(chat_with_model(user_input))

- 롤플레잉 및 복잡한 대화의 경우 다음 샘플 코드를 사용할 수 있습니다:

- 창의적인 글쓰기::

- 모델의 창의적인 글쓰기 기능을 사용하여 소설 또는 시나리오 세그먼트를 생성할 수 있습니다:

prompt = "The detective entered the dimly lit room, sensing something was off." story = chat_with_model(prompt) print(story)

- 모델의 창의적인 글쓰기 기능을 사용하여 소설 또는 시나리오 세그먼트를 생성할 수 있습니다:

- 최적화 매개변수::

- 특정 애플리케이션 요구 사항에 따라 다음과 같이 생성 매개 변수를 조정할 수 있습니다.

max_length및top_p노래로 응답top_k를 사용하여 다양한 생성 효과를 얻을 수 있습니다.

- 특정 애플리케이션 요구 사항에 따라 다음과 같이 생성 매개 변수를 조정할 수 있습니다.

이 단계를 통해 사용자는 Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 모델을 빠르게 시작하고 강력한 텍스트 생성 및 대화 기능을 경험할 수 있습니다.

티파-딥섹스V2-7b-MGRPO 다운로드 주소

설치 방법 정보공식 안드로이드 APK및실리주점.및Ollama

Quark에서 모델 다운로드: https://pan.quark.cn/s/05996845c9f4

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...