Step-Audio: 음성을 인식하고 복제된 음성을 사용하여 통신하는 멀티모달 음성 상호작용 프레임워크 등 다양한 기능

일반 소개

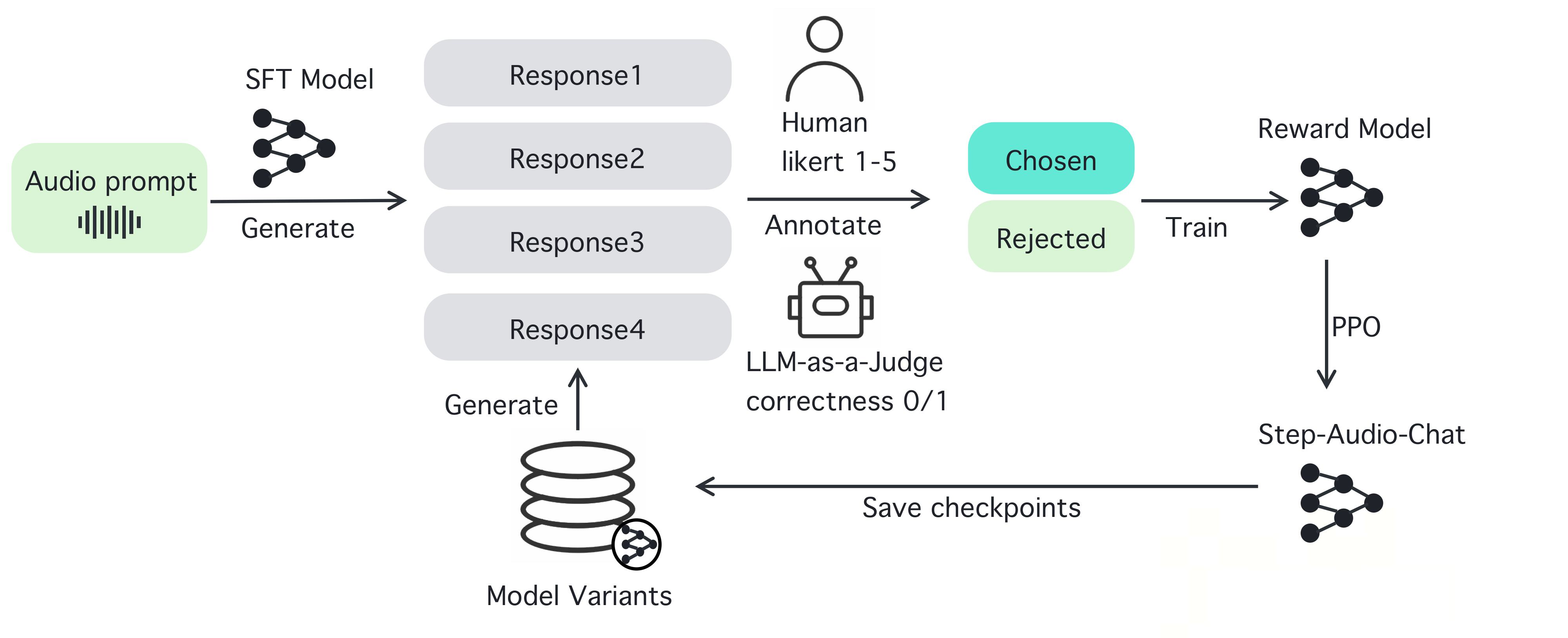

Step-Audio는 프로덕션 환경에서 바로 사용할 수 있는 음성 이해 및 생성 기능을 제공하도록 설계된 오픈 소스 지능형 음성 인터랙션 프레임워크입니다. 이 프레임워크는 다국어 대화(예: 중국어, 영어, 일본어), 감정적 음성(예: 행복, 슬픔), 지역 방언(예: 광동어, 사천어), 조정 가능한 음성 속도 및 라임 스타일(예: 랩)을 지원합니다. Step-Audio는 130B 파라미터의 다중 모달 모델을 통해 음성 인식, 의미 이해, 대화, 음성 복제 및 음성 합성을 구현합니다. 생성 데이터 엔진은 고품질 오디오를 생성하여 리소스 효율적인 Step-Audio-TTS-3B 모델을 훈련하고 게시함으로써 기존의 TTS 수동 데이터 수집에 대한 의존도를 제거합니다.

기능 목록

- 실시간 음성 인식(ASR): 음성을 텍스트로 변환하고 고정밀 인식을 지원합니다.

- TTS(텍스트 음성 합성): 텍스트를 자연스러운 음성으로 변환하여 다양한 감정과 억양을 지원합니다.

- 다국어 지원: 중국어, 영어, 일본어 및 광동어, 사천어 등의 방언을 처리합니다.

- 감정 및 억양 제어: 음성 출력 감정(예: 행복, 슬픔) 및 운율 스타일(예: 랩, 허밍)을 조정합니다.

- 음성 복제: 입력된 음성을 기반으로 유사한 음성을 생성하고, 개인화된 음성 디자인을 지원합니다.

- 대화 관리: 컨텍스트 관리자를 통해 대화의 연속성을 유지하고 사용자 경험을 향상하세요.

- 오픈 소스 툴체인: 개발자가 직접 사용하거나 두 번 개발할 수 있는 완전한 코드와 모델 가중치를 제공합니다.

도움말 사용

Step-Audio는 개발자가 실시간 음성 애플리케이션을 구축할 수 있는 강력한 오픈 소스 멀티모달 음성 인터랙션 프레임워크입니다. 아래는 Step-Audio를 쉽게 시작하고 그 잠재력을 최대한 활용할 수 있도록 설치 및 사용에 대한 자세한 단계별 가이드와 기능에 대한 설명입니다.

설치 프로세스

Step-Audio를 사용하려면 NVIDIA GPU가 있는 환경에 소프트웨어를 설치해야 합니다. 자세한 단계는 다음과 같습니다:

- 환경 준비::

- 시스템에 Python 3.10이 설치되어 있는지 확인하세요.

- 가상 환경을 관리하기 위해 Anaconda 또는 Miniconda를 설치합니다.

- NVIDIA GPU 드라이버와 CUDA 지원이 설치되어 있는지 확인하고, 최상의 화질을 위해 4xA800/H800 GPU(80GB RAM)를 권장합니다.

- 클론 창고::

- 터미널을 열고 다음 명령을 실행하여 Step-Audio 리포지토리를 복제합니다:

git clone https://github.com/stepfun-ai/Step-Audio.git cd Step-Audio

- 터미널을 열고 다음 명령을 실행하여 Step-Audio 리포지토리를 복제합니다:

- 가상 환경 만들기::

- Python 가상 환경을 만들고 활성화합니다:

conda create -n stepaudio python=3.10 conda activate stepaudio

- Python 가상 환경을 만들고 활성화합니다:

- 종속성 설치::

- 필요한 라이브러리 및 도구를 설치합니다:

pip install -r requirements.txt git lfs install - 추가 모델 가중치 복제:

git clone https://huggingface.co/stepfun-ai/Step-Audio-Tokenizer git clone https://huggingface.co/stepfun-ai/Step-Audio-Chat git clone https://huggingface.co/stepfun-ai/Step-Audio-TTS-3B

- 필요한 라이브러리 및 도구를 설치합니다:

- 설치 확인::

- 간단한 테스트 스크립트 실행(예제 코드에서와 같이)

run_example.py)를 클릭하여 모든 구성 요소가 제대로 작동하는지 확인합니다.

- 간단한 테스트 스크립트 실행(예제 코드에서와 같이)

설치가 완료되면 Step-Audio의 다양한 기능을 사용할 수 있습니다. 다음은 주요 기능 및 주요 기능에 대한 자세한 작동 지침입니다.

주요 기능

1. 실시간 음성 인식(ASR)

Step-Audio의 음성 인식 기능은 사용자의 음성 입력을 텍스트로 변환하므로 음성 비서 또는 실시간 전사 시스템을 구축하는 데 적합합니다.

- 절차::

- 마이크가 연결되어 있고 구성되어 있는지 확인합니다.

- 제공된

stream_audio.py라이브 오디오 스트리밍을 시작하는 스크립트입니다:python stream_audio.py --model Step-Audio-Chat - 사용자가 말을 하면 시스템이 음성을 실시간으로 텍스트로 변환하여 단말기에 결과를 출력합니다. 로그를 확인하여 인식 정확도를 확인할 수 있습니다.

- 주요 기능중국어와 영어가 혼합된 입력 또는 광동어, 사천어와 같은 현지화된 음성 등 다국어 및 방언 인식을 지원합니다.

2. 텍스트 음성 합성(TTS)

TTS 기능을 사용하면 모든 텍스트를 자연스러운 음성으로 변환하여 다양한 감정, 음성 속도 및 스타일을 지원할 수 있습니다.

- 절차::

- 합성할 텍스트를 준비합니다(예: 다른 이름으로 저장).

input.txt. - 활용

text_to_speech.py음성을 생성하는 스크립트:python text_to_speech.py --model Step-Audio-TTS-3B --input input.txt --output output.wav --emotion happy --speed 1.0 - 매개변수 설명:

--emotion: 감정을 설정합니다(예: 행복, 슬픔, 중립).--speed: 말하기 속도를 조절합니다(느린 경우 0.5, 보통 1.0, 빠른 경우 2.0).--output: 출력 오디오 파일 경로를 지정합니다.

- 합성할 텍스트를 준비합니다(예: 다른 이름으로 저장).

- 주요 기능: 예를 들어 랩과 허밍 스타일의 음성 생성을 지원합니다:

python text_to_speech.py --model Step-Audio-TTS-3B --input rap_lyrics.txt --style rap --output rap_output.wav

这将生成一段带有 RAP 节奏的音频,非常适合音乐或娱乐应用。

#### 3. 多语言与情感控制

Step-Audio 支持多种语言和情感控制,适合国际化应用开发。

- **操作步骤**:

- 选择目标语言和情感,例如生成日语悲伤语气语音:

파이썬 생성_스피치.py -언어 일본어 --감정 슬픈 --텍스트 "私は悲しいです" -출력 슬픈_jp.wav

- 方言支持:如果需要粤语输出,可以指定:

python generate_speech.py --다이얼렉트 칸톤어 --text "I'm so hung up on you" --output cantonese.wav

- **特色功能**:通过指令可以无缝切换语言和方言,适合构建跨文化语音交互系统。

#### 4. 语音克隆

语音克隆允许用户上传一段语音样本,生成相似的声音,适用于个性化语音设计。

- **操作步骤**:

- 准备一个音频样本(如 `sample.wav`),确保音频清晰。

- 使用 `voice_clone.py` 进行克隆:

python voice_clone.py --input sample.wav --output cloned_voice.wav --model Step-Audio-Chat

- 生成的 `cloned_voice.wav` 将模仿输入样本的音色和风格。

- **特色功能**:支持高保真克隆,适用于虚拟主播或定制语音助手。

#### 5. 对话管理与上下文保持

Step-Audio 内置上下文管理器,确保对话的连续性和逻辑性。

- **操作步骤**:

- 启动对话系统:

python chat_system.py --model Step-Audio-Chat

- 텍스트나 음성을 입력하면 시스템이 문맥에 따라 응답을 생성합니다. 예시:

- 사용자: "오늘 날씨는 어때요?"

- 시스템: "위치를 알려주시면 확인하겠습니다."

- 사용자: "저는 베이징에 있습니다."

- 시스템: "베이징은 오늘 맑고 기온은 15°C입니다."

- 주요 기능여러 차례의 대화를 지원하고 상황에 맞는 정보를 유지하며 고객 서비스 봇이나 지능형 어시스턴트에 적합합니다.

주의

- 하드웨어 요구 사항GPU에 충분한 메모리가 있는지 확인합니다. 최적의 성능을 위해 80GB 이상을 권장합니다.

- 네트워크 연결안정적인 네트워크를 보장하기 위해 일부 모델 가중치를 허깅 페이스에서 다운로드해야 합니다.

- 오류 감지설치 또는 런타임 오류가 발생하면 로그 파일을 확인하거나 GitHub 이슈 페이지를 참조하여 도움을 받으세요.

이 단계를 따르면 실시간 음성 애플리케이션을 개발하거나 개인화된 음성 콘텐츠를 제작하거나 다국어 대화 시스템을 구축할 때 Step-Audio의 기능을 최대한 활용할 수 있으며, Step-Audio의 오픈 소스 특성 덕분에 필요에 따라 코드를 수정하고 모델을 최적화하여 특정 프로젝트 요구 사항을 충족할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...