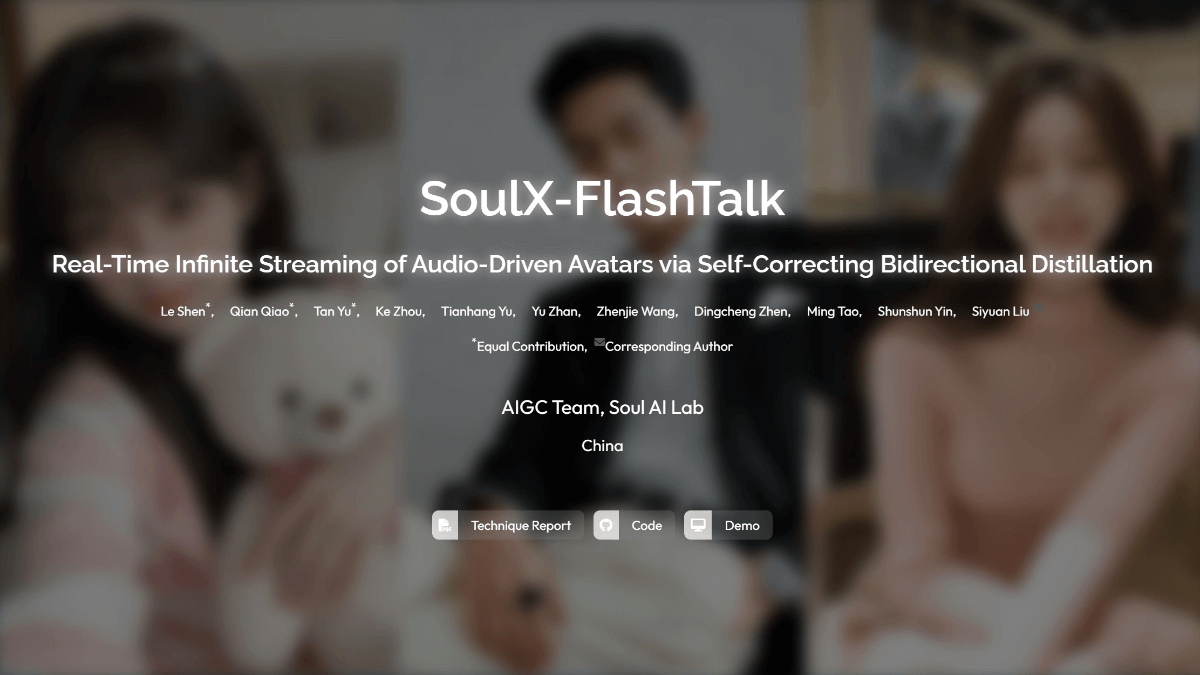

SoulX-FlashTalk是什么

SoulX-FlashTalk是Soul App AI团队开源的实时数字人生成模型,拥有140亿参数量,实现了0.87秒超低延迟和32帧/秒的高帧率。模型通过双向蒸馏技术解决了传统数字人延迟高、画面易崩坏的问题,支持超长视频稳定生成,适用于电商直播、AI客服等场景。其创新点包括自纠正机制和混合序列并行技术,显著提升了实时交互体验。

SoulX-FlashTalk的功能特色

- 亚秒级实时响应:首帧输出延迟仅 0.87 s,14B 大模型也能“零等待”开口说话,视频通话、直播弹幕、智能客服等场景可即时对答。

- 高帧率流畅画面:推理吞吐 32 FPS,高于直播行业 25 FPS 标准,全程无卡顿,重新定义“丝滑”。

- 超长视频稳定生成:自纠正双向蒸馏 + 多步回溯机制,边生成边“校准”,长时间直播不崩脸、不糊图,口型、背景、身份保持一致 。

- 全身动作交互:音频直接驱动全身骨骼,不仅对口型,还能同步手势、肢体动作;手部畸形与运动模糊显著减少,动作自然且稳定(Subject-C 一致性 99.22)。

- 14B 大模型开源可商用:代码、权重、技术报告全公开,支持单卡 4090 到多卡 H800 灵活部署,电商直播、在线教育、虚拟客服等场景可直接落地。

SoulX-FlashTalk的核心优势

- 성과 지표:首帧输出延迟 0.87 s,推理吞吐 32 FPS,可在 8×H800 节点上实现真正“无限时长”实时流 。在 TalkBench 测评中,ASE(音频同步性)3.51、IQA(图像质量)4.79、Sync-C(唇音同步)1.47,三项均高于现有同类模型.

- 技术方案::

- 自纠正双向蒸馏:保留“块内”双向注意力,兼顾时空一致性与推理速度;仅用 1 000 步 SFT + 200 步蒸馏就完成训练,效率提升 23×.

- 多步回溯自纠正:每生成 K 个 chunk 就自动回溯检测并修正身份漂移,防止长视频“崩脸”

- 延迟感知时空适配:先降低分辨率与帧长再微调,保证低显存占用,单卡 4090 可跑(40 G 显存开 cpu_offload)。

- 全身动作:音频直接驱动全身骨骼,手部畸形/运动模糊显著减少,Subject-C 一致性 99.22 %。

多语言、卡通风格、长时直播均已提供 demo,支持 ComfyUI 工作流一键出片 。

SoulX-FlashTalk官网是什么

- 프로젝트 웹사이트:https://soul-ailab.github.io/soulx-flashtalk/

- GitHub 리포지토리:https://github.com/Soul-AILab/SoulX-FlashTalk

- 허깅페이스 모델 라이브러리:https://huggingface.co/Soul-AILab/SoulX-FlashTalk-14B

SoulX-FlashTalk的适用人群

- 电商/带货主播:想 24h 无人值守直播、降低真人出镜成本,又需亚秒级互动答疑、口型精准、画面不崩。

- 在线教育讲师 & 知识付费机构:用 AI 分身批量生成多语种课程,长时稳定不“穿帮”,节省录制与后期剪辑人力。

- 游戏/动漫 IP 运营方:把 2D 立绘或 3D 角色直接“活化”成可实时对话的虚拟偶像,做直播、粉丝互动、周边带货。

- 企业客服 & 数字员工团队:银行、运营商、政务大厅等需要“面对面”视频客服,亚秒响应提升用户体验,降低真人坐席峰值压力。

- 内容创作者 & MCN 机构:短视频、广告、影视预演需要“无限时长”口播素材,无需昂贵动捕棚,一键生成多镜头脚本。

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...