일반 소개

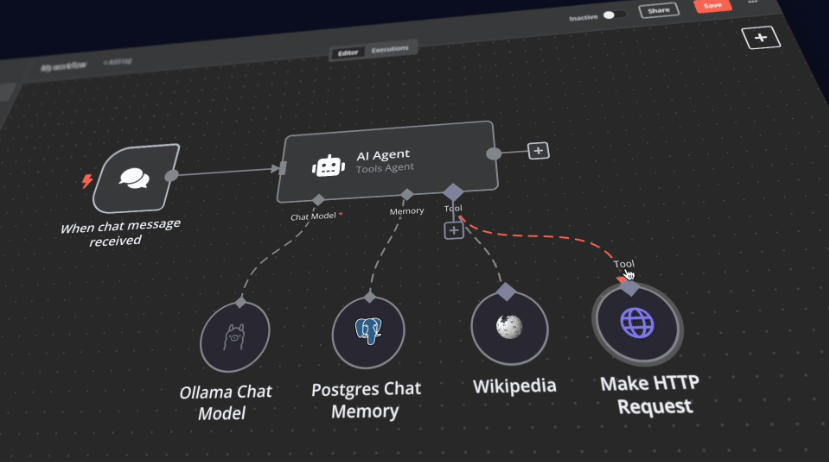

n8n 셀프 호스팅 AI 스타터 키트는 포괄적인 로컬 AI 및 로우코드 개발 환경을 빠르게 초기화할 수 있도록 설계된 오픈 소스 Docker Compose 템플릿입니다. n8n 팀에서 선별한 이 제품군은 자체 호스팅 n8n 플랫폼과 호환 가능한 다양한 AI 제품 및 구성 요소를 결합하여 사용자가 자체 호스팅 AI 워크플로를 빠르게 구축할 수 있도록 지원합니다. 이 제품군에는 지능형 에이전트, 문서 요약, 지능형 챗봇, 개인 금융 문서 분석 등 다양한 AI 애플리케이션 시나리오를 위한 n8n 로우코드 플랫폼, Ollama 크로스 플랫폼 LLM 플랫폼, Qdrant 고성능 벡터 스토리지, PostgreSQL 데이터베이스가 포함되어 있습니다.

기능 목록

- N8N 로우코드 플랫폼빠른 빌드 워크플로우를 지원하는 400개 이상의 통합 및 고급 AI 컴포넌트를 제공합니다.

- 올라마 플랫폼최신 네이티브 LLM 설치 및 실행을 지원하는 크로스 플랫폼 LLM 플랫폼입니다.

- 큐드론 벡터 스토리지포괄적인 API를 제공하는 오픈 소스 고성능 벡터 스토리지입니다.

- PostgreSQL 데이터베이스대용량 데이터 처리를 위한 안정적인 데이터베이스.

- 지능형 에이전트회의 및 작업 예약을 위한 AI 에이전트.

- 문서 요약회사 PDF 문서를 안전하게 요약하고 데이터 유출을 방지하세요.

- 지능형 챗봇회사 커뮤니케이션 및 IT 운영을 향상시키는 지능형 Slack 봇입니다.

- 개인 재무 문서 분석최저 비용으로 개인 재무 문서 분석.

도움말 사용

설치 프로세스

- 클론 창고::

bash

git clone https://github.com/n8n-io/self-hosted-ai-starter-kit.git

cd self-hosted-ai-starter-kit

- 도커 컴포즈로 n8n 실행하기::

- Nvidia GPU 사용자의 경우:

docker compose --profile gpu-nvidia up참고: 이전에 도커에서 Nvidia GPU를 사용해 본 적이 없는 경우, Ollama 도커에 대한 지침을 따르세요.

- Mac/Apple Silicon 사용자의 경우:

- 옵션 1: 전적으로 CPU에서 실행됩니다:

docker compose --profile cpu up - 옵션 2: Mac에서 Ollama를 실행하고 n8n 인스턴스에 연결합니다:

docker compose up그런 다음 다음을 사용하여 Ollama 자격 증명을 변경합니다.

http://host.docker.internal:11434/호스트로서.

- 옵션 1: 전적으로 CPU에서 실행됩니다:

- 다른 사용자의 경우:

docker compose --profile cpu up

- Nvidia GPU 사용자의 경우:

사용 가이드라인

- n8n 시작::

- 인터뷰

http://localhost:5678를 클릭하고 n8n 인터페이스로 들어갑니다. - 기본 계정으로 로그인하거나 새 계정을 만드세요.

- 인터뷰

- 워크플로 만들기::

- n8n 인터페이스에서 "새 워크플로"를 클릭합니다.

- 왼쪽 메뉴에서 원하는 노드를 작업 영역으로 드래그합니다.

- 각 노드에 대한 매개변수 및 연결을 구성합니다.

- 워크플로 실행::

- 구성이 완료되면 실행 버튼을 클릭하여 워크플로를 실행합니다.

- 워크플로 실행 결과 및 로그를 확인합니다.

빠른 시작 및 사용

셀프 호스팅 AI 스타터 키트의 핵심은 네트워크 및 스토리지 설정이 미리 구성된 Docker Compose 파일로, 추가 설치가 필요 없습니다. 설치 단계를 완료했으면 아래 단계를 따라 시작하세요:

- http://localhost:5678/设置n8n 을 엽니다. 이 작업은 한 번만 수행하면 됩니다.

- 포함된 워크플로우를 엽니다(http://localhost:5678/workflow/srOnR8PAY3u4RSwb).

- 옵션테스트 워크플로워크플로우 실행을 시작하세요.

- 이 워크플로를 처음 실행하는 경우 Llama 3.2의 Ollama 다운로드가 완료될 때까지 기다려야 할 수도 있습니다. 도커 콘솔 로그에서 진행 상황을 확인할 수 있습니다.

http://localhost:5678/来打开n8n 을 방문하세요.

n8n 인스턴스를 사용하면 400개 이상의 통합은 물론 AI 에이전트, 텍스트 분류기, 정보 추출기 노드와 같은 기본 및 고급 AI 노드 세트에 액세스할 수 있습니다. 로컬 런타임이 언어 모델로 Ollama 노드를 사용하고 벡터 저장소로 Qdrant를 사용하는지 확인하세요.

"다음 사항에 유의하십시오.이 스타터 키트는 자체 호스팅 AI 워크플로우를 시작하는 데 도움이 되도록 설계되었습니다. 프로덕션 환경에 완전히 최적화된 것은 아니지만, 원활하게 협업하는 강력한 구성 요소를 결합하여 개념 증명 프로젝트에 이상적입니다. 필요에 맞게 사용자 지정할 수 있습니다.

"

업그레이드 지침

Nvidia GPU 설정의 경우:

docker compose --profile gpu-nvidia pull

docker compose create && docker compose --profile gpu-nvidia up

Mac/애플 실리콘 사용자

docker compose pull

docker compose create && docker compose up

비 GPU 설정의 경우:

docker compose --profile cpu pull

docker compose create && docker compose --profile cpu up© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...