SD 모델 드레스업: 무엇이든 칠하기

유사한 사례: https://cloud.tencent.com/developer/article/2365063

실제 사례

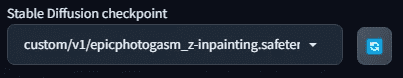

레이스로 장식 된 흰색 웨딩 드레스를 입은 아름다운 여성이 해질녘 해변을 따라 걷고 있습니다. 그녀의 머리카락은 바람에 부드럽게 들어 올려지고 그녀는 흰 장미 꽃다발을 들고 있습니다. 그녀의 머리카락은 바람에 부드럽게 들어 올려지고 그녀는 흰 장미 꽃다발을 들고 있습니다. 역동적 인 포즈, 사진, 걸작, 최고 품질, 8K, HDR, 고해상도, 부조리 : 1.2, Kodak 인물 인물 400, 필름 그레인, 흐린 배경, 보케 : 1.2, 필름 그레인. 흐린 배경, 보케: 1.2, 렌즈 플레어

역방향: nsfw, 추한, 그림, 스케치, (최악의 품질:2), (낮은 품질:2), (보통 품질:2), 낮은 해상도

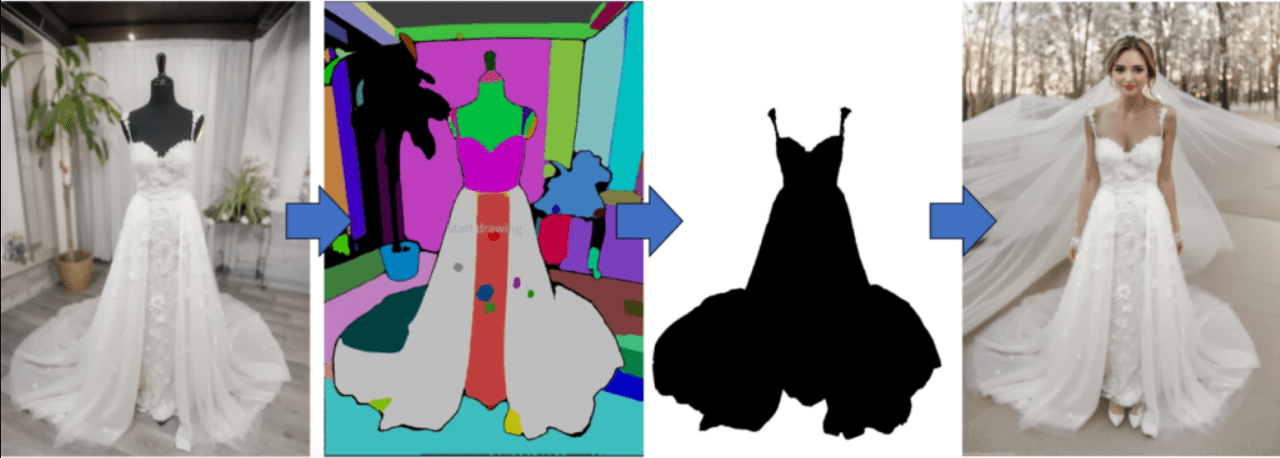

예를 들어, 저희 쇼룸에서 촬영한 옷을 입은 마네킹 사진 같은 것이 있습니다.

루프탑 플랜

안정적인 확산을 사용할 수 있다면 첫 번째 사진을 얻는 데 10분 이상 걸리지 않습니다.

조정이 필요한 경우에도 한 시간이면 충분합니다. 예를 들어

마네킹 제너레이션 라이브 모델 1

마네킹 제너레이션 라이브 모델 2

마네킹 제너레이션 라이브 모델 2

I. 휴먼 플랫폼 다이어그램의 실제 생성을 위한 아이디어

더미 테이블을 실제 사람으로 바꾸고 옷을 그대로 유지하려면 무엇이 필요하나요?

이 시점에서 안정된 확산에 익숙한 친구들은 다음과 같이 말할 것입니다 : 나는 알고 있습니다, 그것은 투청 투에서 페인트 기능을 사용하고 옷 밖에서 마스크를 만들어 안정된 확산이 다시 칠하는 것입니다.

마스크는 어떻게 만드나요? 손으로 한 획으로 마스킹을 해야 하는데 너무 느리다면 특별히 이 마스크를 사용할 필요가 없습니다.

다시 말하지만, 누군가는 먼저 포토샵에서 마스크를 만든 다음 마스크 다시 그리기 기능을 사용하라고 말할 것입니다.

이 방법도 한 가지 방법이지만 지금은 더 스마트한 방법이 될 수 있습니다.

오늘은 사진을 찍고 다양한 색상 블록으로 구분하는 플러그인을 사용해 사진을 색칠해 보겠습니다. 마지막으로 마스크로 만들 색상 블록을 선택하기만 하면 마스크가 만들어집니다.

그런 다음 다시 칠하기 기능을 사용하여 옷을 그대로 유지하면서 더미를 실물 크기로 만듭니다.

기본 아이디어는 이렇지만, 직접 운전해 보면 여전히 많은 포트홀이 있다는 것을 알 수 있습니다.

따라서 이 글에서는 더미를 실제 사람으로 만드는 방법을 직접 보여드릴 뿐만 아니라, 중요한 것은 그 구멍을 어떻게 메우는지도 보여드릴 것입니다.

지금부터 모두 설명해드리겠습니다.

II. 더미 테이블 모델 구현 준비 도구

이 데모는 SD 1.5 모델과 함께 자동 1111의 웹UI를 사용하고 있으니 준비하세요!

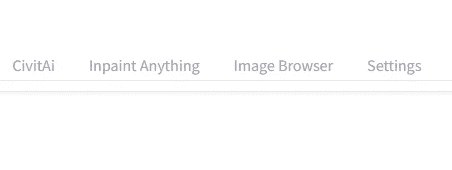

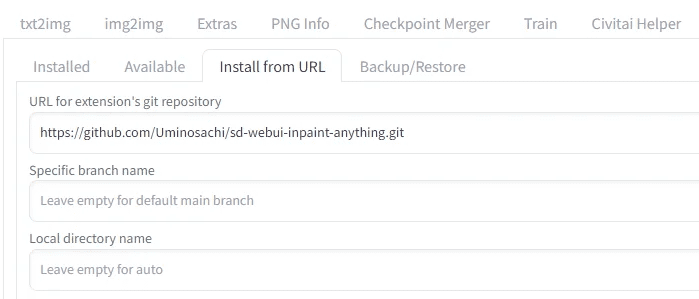

준비 1: 무엇이든 칠하기

우선, 플러그인 Inpaint Anything이 필요한데, 자동 1111의 웹UI를 확인하여 플러그인 Inpaint Anything이 있는지 확인하고 없는 경우 설치하시기 바랍니다.

인페인트 설치

URL에서 설치로 이동하여 다음을 입력합니다.

https://github.com/Uminosachi/sd-webui-inpaint-anything.git

설치 준비 완료

설치가 완료되면 설치 탭으로 돌아가서 적용을 누르고 종료합니다.

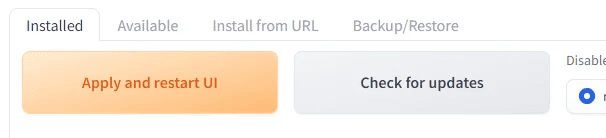

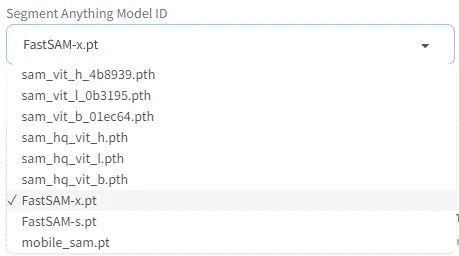

준비 2: 인페인트용 모델

이번에는 에피포토가즘을 사용하여 마치 마스터 사진작가가 촬영한 듯한 화질이 나오기 때문에 사실적인 이미지가 필요한 곳에서 사용하기에 특히 적합하다는 것을 보여드리겠습니다.

오늘은 메인 모델 대신 Inpaint 모델을 사용하겠습니다.

아래 링크로 이동하여 인페인트 모델을 다운로드하고 나중에 사용할 수 있도록 설치하세요.

https://civitai.com/models/132632?modelVersionId=201346

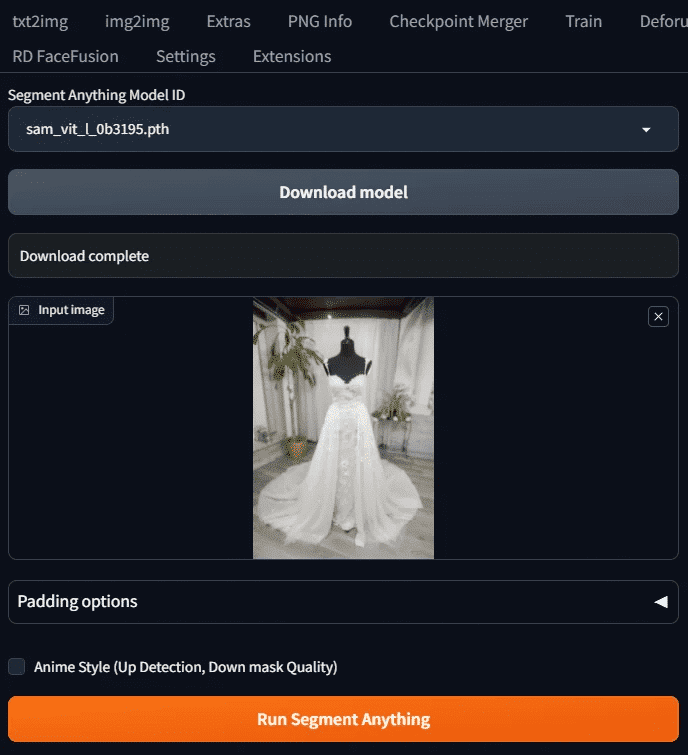

준비 3: 더미 사진

이 예시를 사용하겠습니다.

이 사진은 자신의 쇼룸에서 촬영한 것으로, 검은색 마네킹이라 나중에 문제가 생길 수 있으니 주의하세요. 먼저 여기 티저입니다.

이 세 가지가 준비되면 시작할 수 있습니다.

III. 운영 데모

이 강의에서는 SD 1.5 모델을 사용하여 전체 과정을 시연합니다.

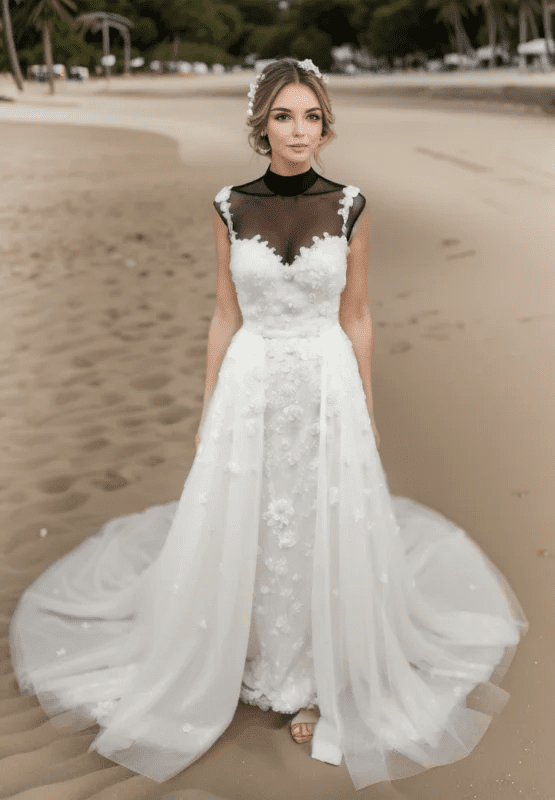

1단계: SAM 모델 및 다운로드 모델 선택

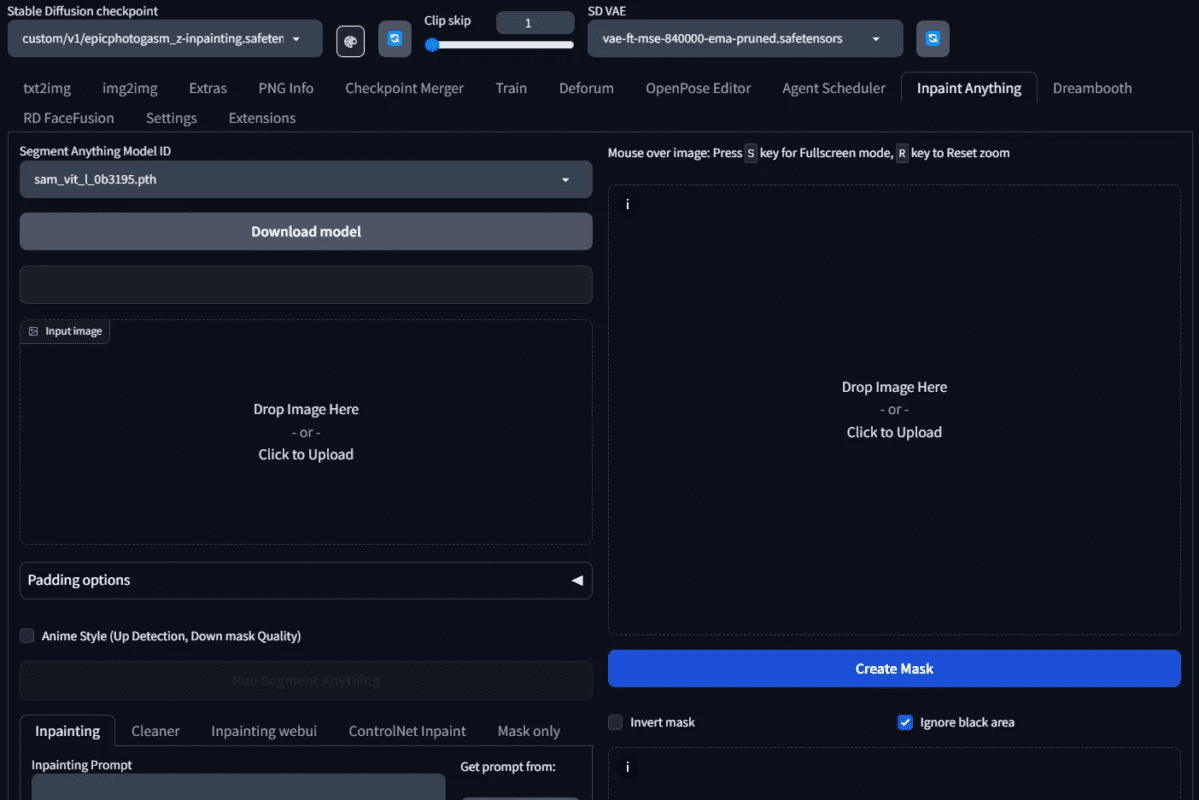

아무거나 칠하기 탭을 누르면 다음과 같은 화면이 표시됩니다.

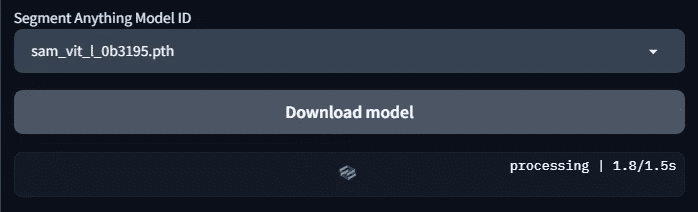

사용할 시맨틱 세그먼트 모델의 세그먼트 모델 ID를 선택합니다. 여기서는 sam_vit_l_0b3195.pth 모델을 선택합니다. 방금 설치한 경우 이 모델은 아직 다운로드되지 않은 상태이므로 모델 다운로드 버튼을 눌러야 다운로드됩니다.

로드.

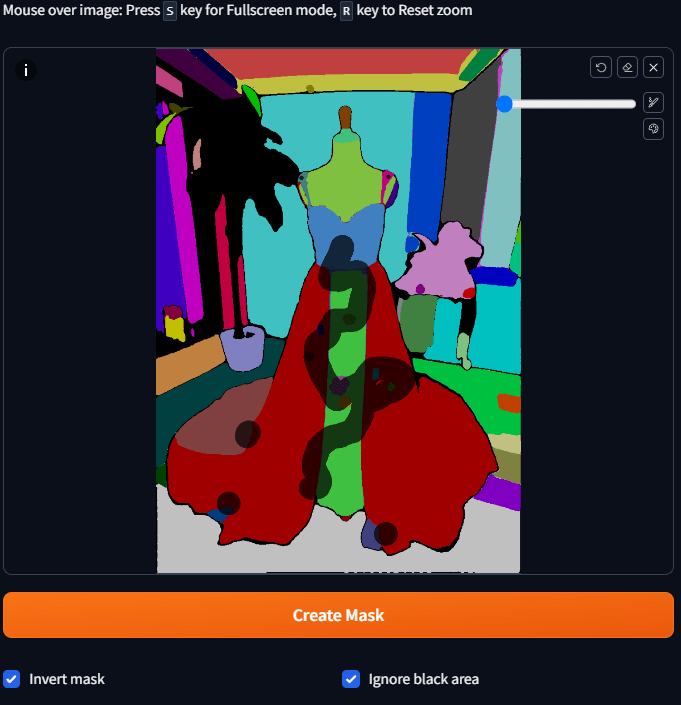

2단계: 세분화 다이어그램 예시 가져오기

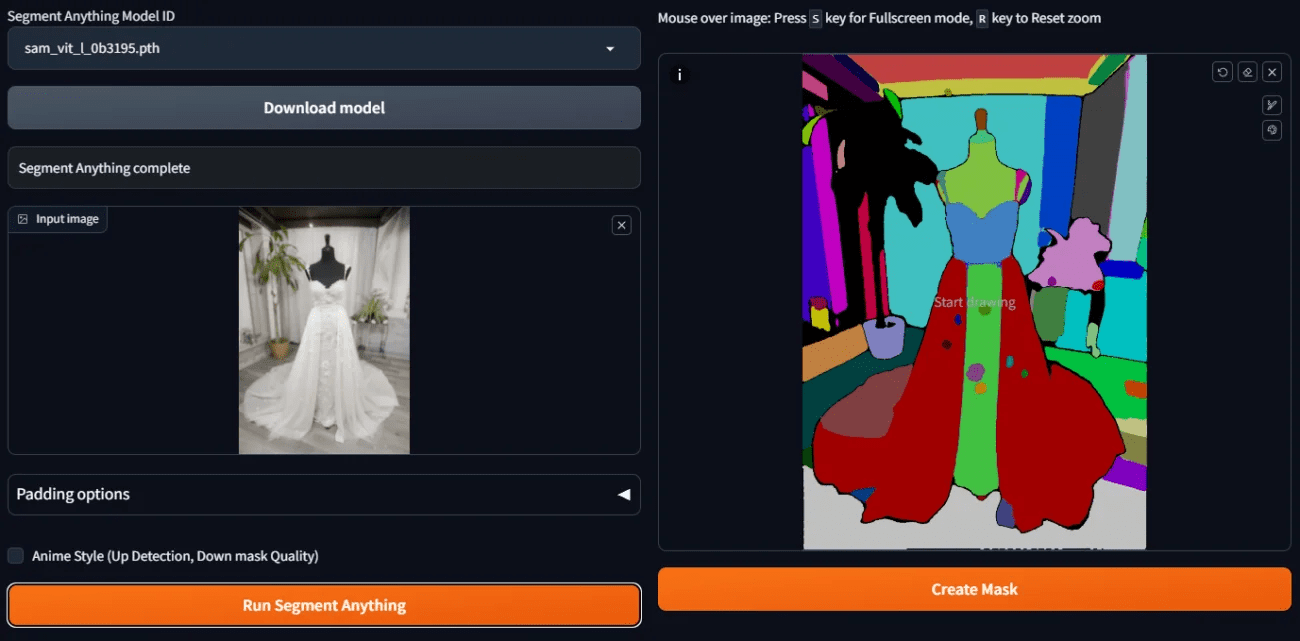

이미지를 업로드하여 아무거나 칠할 이미지를 업로드하고 아무거나 세그먼트 실행을 누릅니다.

오른쪽에 분할 예시 다이어그램이 표시됩니다.

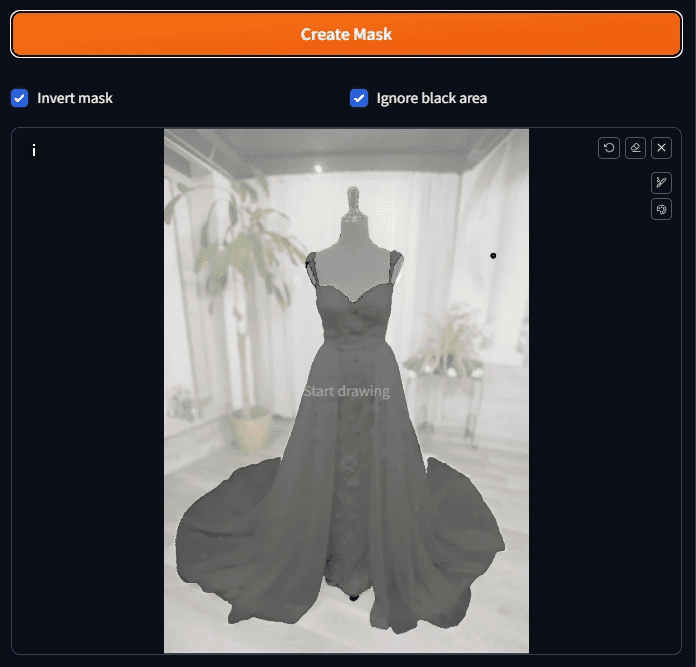

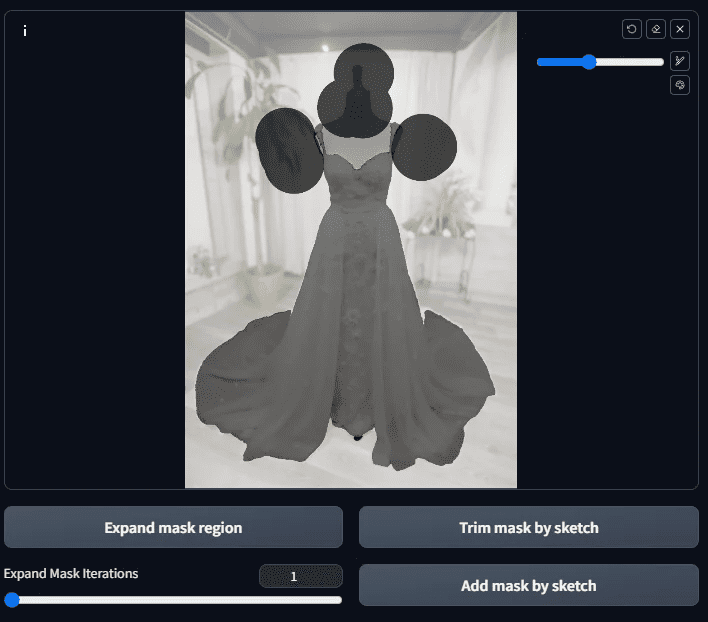

3단계: 예비 마스크를 만듭니다.

나중에 다시 그리기 기능을 사용하려면 다시 그리려는 영역의 마스크를 만들어야 합니다. 이제 의미적으로 구분된 색상 블록이 생겼으니 마스크를 빠르게 만들려면 어떻게 해야 할까요?

마스크를 만들고 싶은 색상 블록을 마우스로 탭하기만 하면 전체 블록을 칠할 필요 없이 해당 블록을 탭하고 조금만 기다리면 마스크가 됩니다.

배경, 더미 등을 다시 칠해야 하므로 그런 곳을 선택해야 하는데 배경을 칠하는 것이 조금 복잡합니다.

너무 번거롭기 때문에 대신 드레스에 있는 색상 블록을 클릭한 다음 마스크 반전을 선택하면 됩니다.

모두 선택했으면 마스크 만들기를 누르면 마스크의 결과를 볼 수 있습니다.

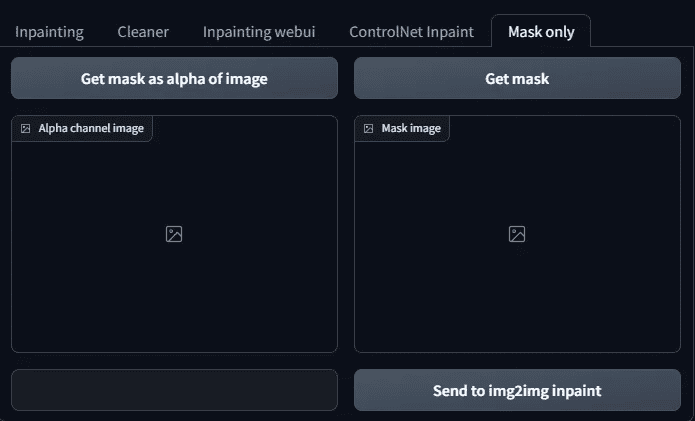

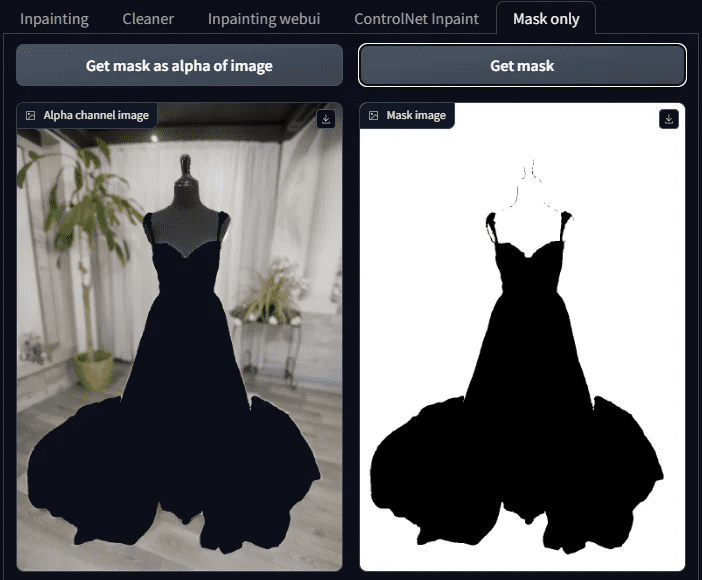

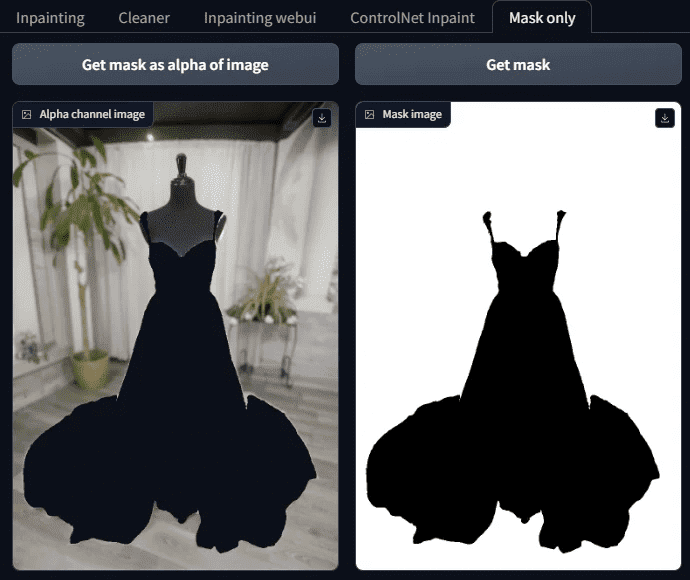

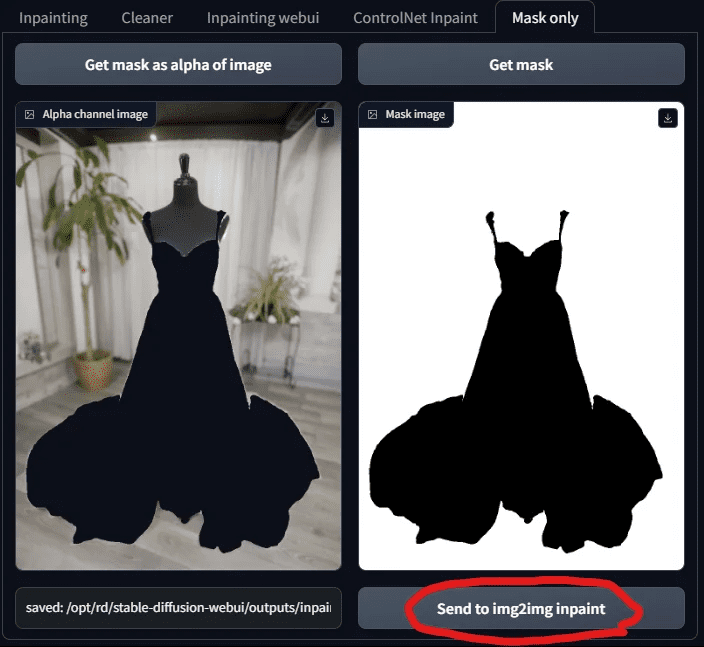

4단계: 마스크 결과 보기

마스크 결과를 확인하여 누락된 항목이 있는지 확인하고, 실제로 화면이 더 복잡하여 명확하게 보기 어려운 경우 마스크 전용 탭의 측면을 열어보는 트릭이 있습니다.

두 개의 버튼이 있습니다:

이미지의 알파로 마스크 가져오기

마스크 받기

이 두 버튼을 누르면 마스크가 완료되었는지 확인할 수 있습니다.

여기 흰색은 마스크이며, 앞으로 AI가 채워질 영역이고, 검은색은 유지해야 할 부분이므로 잘못 이해하지 마세요.

5단계: 마스크 미세 조정

이 가려진 이미지에서 볼 수 있듯이 옷 외에 아직 가려지지 않은 부분이 있습니다(즉, 있어서는 안 되는 부분이 있습니다).

(검은색 선).

수작업으로 미세 조정할 때입니다.

마스크를 생성한 다이어그램으로 돌아가서 마스크를 추가할 영역을 그 위에 칠합니다. 검정색으로 추가할 영역이 있으면 수동으로 칠하고 스케치로 마스크 다듬기 버튼을 누르고, 반대로 흰색으로 추가하려면 수동으로 칠하고 스케치로 마스크 추가 버튼을 누릅니다.

그림이 너무 작아 그리기 어렵다고 생각되면 S를 눌러 확대한 다음 다시 S를 눌러 복원할 수 있습니다.

플러스 블랙: 스케치 버튼으로 마스크 다듬기

흰색 추가: 스케치 버튼으로 마스크 추가

신청 후 Add mask by sketch.

그런 다음 마스크 전용 탭으로 이동하여 Get mask 최대 Get mask as alpha of image 우리가 원하는 게 그런 건가요?

마스크.

다른 부분이 있으면 같은 방법으로 잘라내고, 괜찮으면 다음 단계로 넘어갑니다.

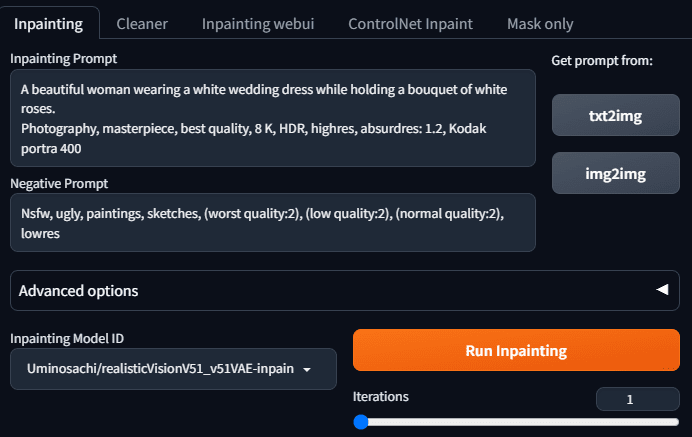

6단계: 무엇이든 다시 칠하기 시작하기

마스크가 모두 완성되면 배경을 채우는 데 도움이 되는 안정적인 확산을 요청할 수 있습니다.

인페인트 탭으로 이동하여 멘션 및 리버스 멘션을 입력합니다. 제가 생성하려는 이미지는 웨딩드레스를 입고 흰 장미를 들고 있는 아름다운 여성입니다. 따라서 다음 멘션을 입력합니다:

A beautiful woman wearing a white wedding dress while holding a bouquet of white roses.

Dynamic pose, photography, masterpiece, best quality, 8K, HDR, highres, absurdres: 1.2,

Kodak portra 400, film grain, blurry background, bokeh: 1.2, lens flare

역방향 텔레프롬프터는 다음과 같습니다:

Nsfw, ugly, paintings, sketches, (worst quality:2), (low quality:2), (normal quality:2), lowres

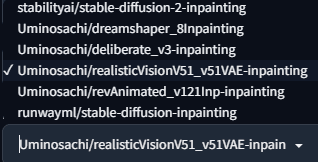

인페인트 모델 중 하나를 선택하면 미리 설정된 모든 것을 인페인트합니다.

우리는 실제 사진을 찍고 싶기 때문에 우미노사치/리얼리스틱비전V51_v51VAE-페인팅 이것

모델.

인페인팅 실행을 누르면 라이브 모델의 사진이 표시됩니다.

좋아 보이네요, 몇 개 더 먹어보죠.

차트를 받고 나면 이 교육이 끝났다고 생각하시나요?

아직은 아닙니다! 실제로 사용하려면 아직 몇 가지 질문이 남아있기 때문입니다.

- 한 번에 많은 사진을 골라낼 수 있는 방법은 없습니다.

- 원하는 모델을 사용할 방법이 없습니다.

이제 어떻게 해야 할까요? 다음 단계가 필요합니다.

7단계: 투펠로의 다시 그리기 기능 사용

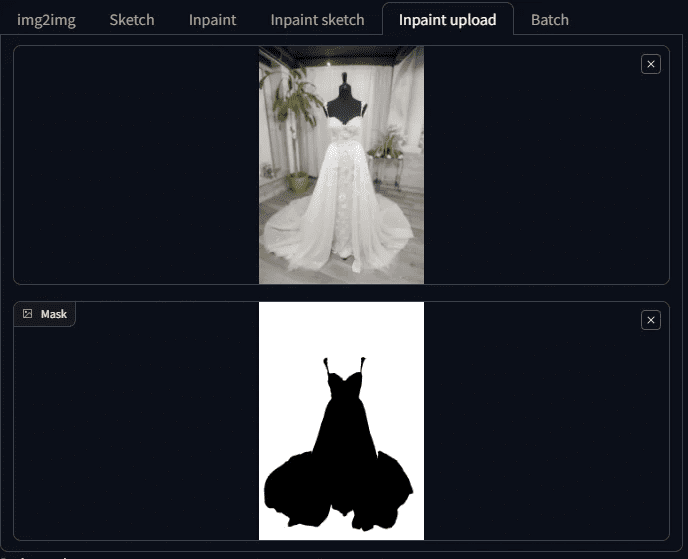

마스크 전용 탭으로 돌아가서 '이미지로 보내기 2 이미지 인페인트'를 누릅니다.

마스크를 보내면 투펠로의 페인트 업로드 탭으로 이동합니다. 이미지와 마스크가 전송된 것을 확인할 수 있습니다!

SD에 익숙한 사람들은 익숙한 장소로 돌아와서 마침내 마음에 드는 모델을 선택할 수 있게 된 것을 기뻐할 것입니다.

이제 모델을 선택해 봅시다! 여기서는 칠아웃믹스를 선택합니다.

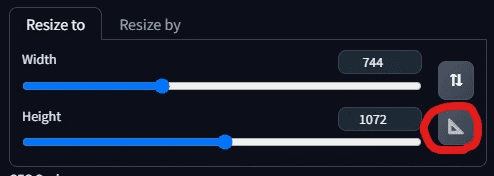

그런 다음 사진의 크기를 조정하려면 삼각형 보드를 누른 후 다시 입력할 필요 없이 시스템이 자동으로 너비와 높이를 사진과 동일하게 조정합니다.

이제 텔레 프롬프터를 채우기 위해 이제 아름다운 여성이 웨딩 드레스를 입고 해변에 있고 그녀의 머리카락이 바람에 부드럽게 날리고 흰 장미 꽃다발을 들고 있도록 변경하고 싶습니다. 따라서 텔레프롬프터를 다음과 같이 변경해 보겠습니다:

A beautiful woman wearing a white wedding dress adorned with lace, walking along the

beach at sunset. Her hair is gently lifted by the breeze, and she is holding a bouquet of white roses. Dynamic pose, photography, masterpiece, best quality, 8K, HDR, highres, absurdres: 1.2,

Kodak portra 400, film grain, blurry background, bokeh: 1.2, lens flare

역방향 텔레프롬프터는 변경되지 않습니다:

Nsfw, ugly, paintings, sketches, (worst quality:2), (low quality:2), (normal quality:2), lowres

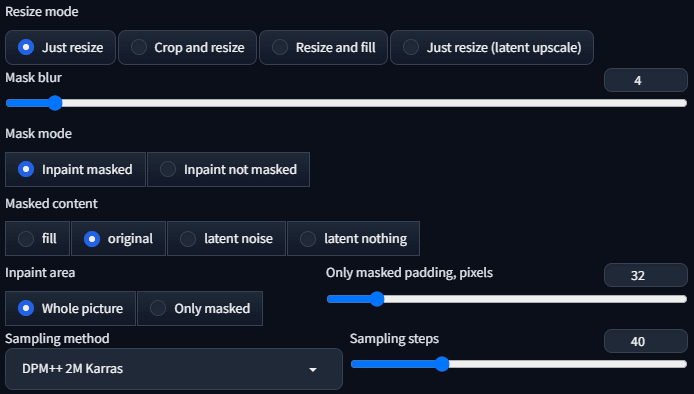

샘플러는 샘플링 단계가 40으로 설정된 DPM++ 2M Karras입니다.

다른 모든 매개변수는 아래와 같이 사전 설정으로 사용됩니다:

이제 모두 생성할 준비가 되었을 것입니다!

이상한 것들이 나타났습니다!

AI가 생성한 모델이 옷을 갈아입지 않는 이유는 무엇인가요? 옷이 공중에 떠 있는 것처럼 보입니다.

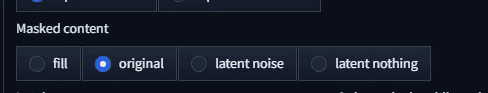

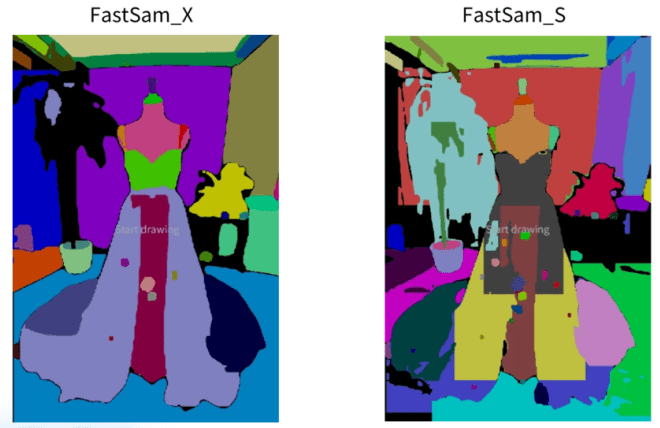

조정해야 하는 것이 마스크된 콘텐츠인가요? 현재 프리셋은 원본입니다.

다른 것으로 변경해 보겠습니다. 채우기로 시작하겠습니다.

여전히 잘 들리지 않습니다. 그런 다음 잠복 노이즈로 전환하고 확인해 보세요.

상황은 더 이상합니다. 그렇다면 잠복기가 없는 것일까요?

즉, 옷을 입지 않았어요! 이게 무슨 일이죠? 왜 옷은 항상 입고 있는 거죠?

그래서 여기, 결론을 내렸습니다... 고장났습니다 ....

아직 섣불리 결론을 내리지 마세요. 이것은 우리가 잘못된 모델을 선택했기 때문입니다.

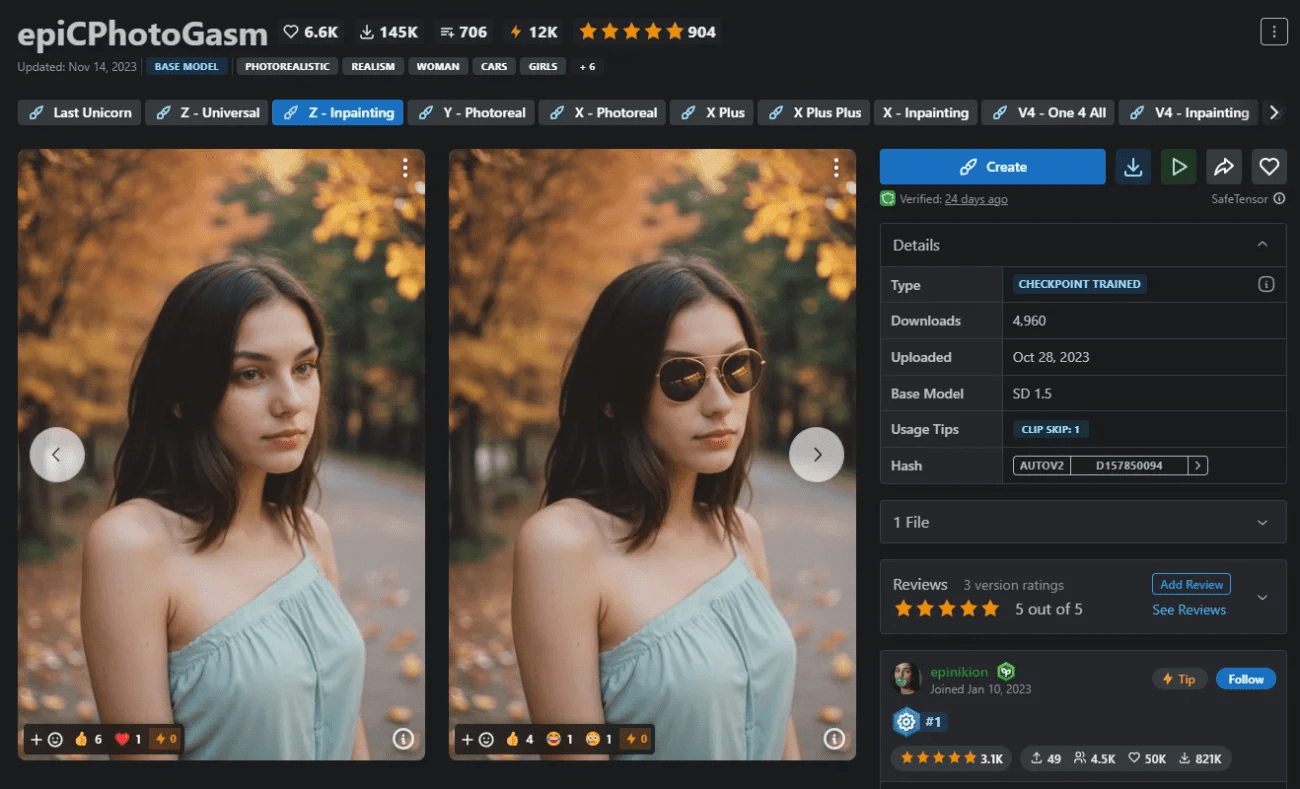

8단계: 에피포토가즘 모델 다시 칠하기 선택

옷이 항상 맞지 않는 이유는 단순합니다. 우리가 하는 것은 순수 생성이 아니라 리페인팅이기 때문에 리페인팅을 위해 특별히 설계된 모델을 사용할 것입니다.

칠아웃믹스는 다시 칠하는 데 사용할 모델이 아니므로 이제 이전에 다운로드한 epiCPhotoGasm_zinpainting을 대신 사용하겠습니다.

모델.

모델이 변경되었으니 이제 생성을 시작해 보겠습니다. 이제 괜찮을 것입니다!

결과를 살펴보겠습니다:

옷을 차려입은... 아름다운 마네킹이 있습니다.

무슨 일이야? 방금 옷을 입지 않았고 이제 그 사람은 사라졌고 약속 된 아름다움은 어디에 있습니까? 불운 일 수 있습니다. 다시 생성하고 확인하십시오.

결과적으로 아름다움은 있지만 가슴에 검은 천은 뭐죠? 이 천은 우리가 요청한 게 아니에요!

그 이유는 현재 마스크 콘텐츠 매개변수가 원본 이미지의 구조와 색상을 참조하여 다시 그릴 때 원본 이미지에 있는 플랫폼과 검은색 천의 모양이 그대로 나타나기 때문입니다. 그렇다면 이 문제를 어떻게 해결할 수 있을까요?

매개 변수를 다른 것으로 변경하기만 하면 됩니다(예: 다음과 같이 변경해 보겠습니다). 채우기 를 클릭하면 아래와 같은 다이어그램이 표시됩니다.

잠복 노이즈가 사용되는 경우 결과는 다음과 같습니다.

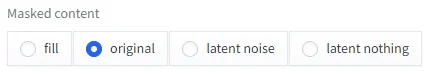

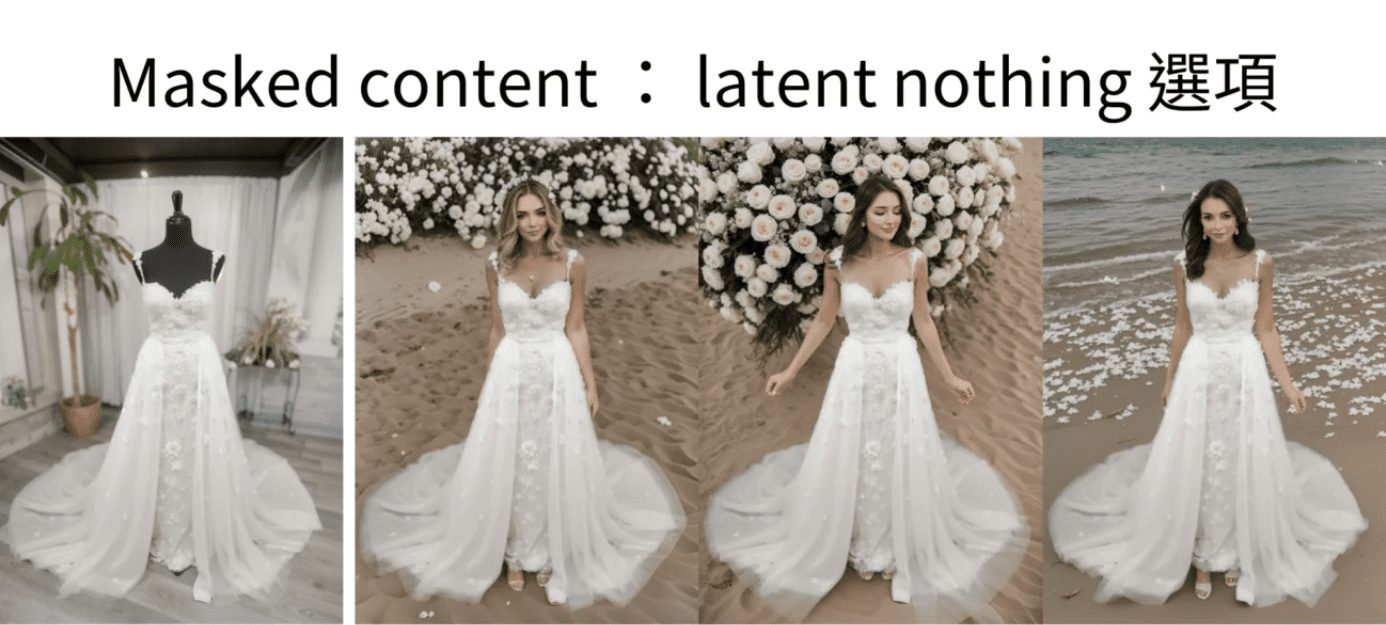

잠재적 아무것도 사용하지 않으면

정말 멋진 사진 아닌가요? 아직 이런 화질로 미세 조정되지도 않았는데 다시 최적화하면 더 좋아질 텐데 다음 단계는 무엇일까요?

IV. 자주 묻는 질문

이런 식으로 운영하다 보면 하나씩 설명해야 할 질문이 생길 수 있습니다.

질문 1: 인스턴스 파티셔닝이란 무엇인가요?

인스턴스 분할은 사진에서 사물을 서로 다른 색상으로 표시하여 사물을 구분하는 프로세스를 말하며, 각 색상은 한 가지 사물을 나타냅니다.

이번에는 마스크를 만드는 데 걸리는 시간을 단축하기 위해 예제를 통해 분할하는 방법에 대해 설명합니다.

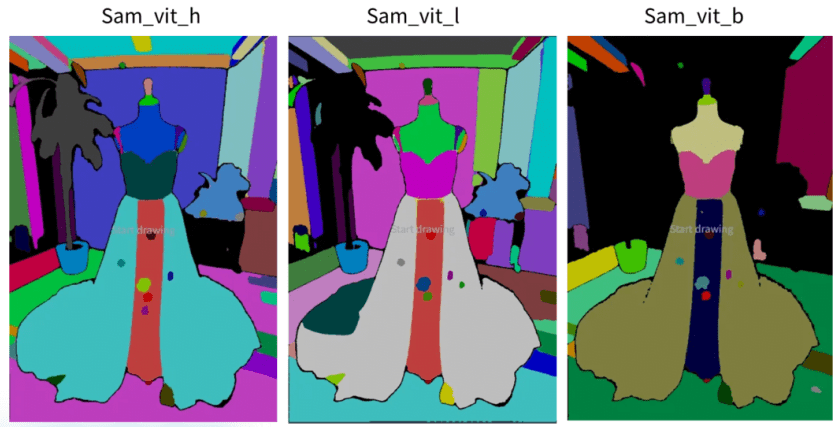

질문 2: 인페인트 애니띵에는 다양한 세그먼트 애니띵 모델이 있는데, 어떤 차이가 있나요?

SAM이라고도 하는 세그먼트 애니씽 모델은 인페인트 애니씽에서 9가지 유형의 세그먼트 애니씽 모델을 제공합니다.

4가지 카테고리로 나눌 수 있으며, 하나씩 설명해드리겠습니다.

클래스 1: sam_vit으로 시작 - Meta에서 제공하는 SAM 모델

sam_vit의 시작은 메타에서 제공하는 모델입니다. 메타는 시맨틱 세그멘테이션 모델의 이름을 세그먼트 애니씽 모델이라고 지었기 때문에, 현재 우리가 이야기하고 있는 SAM은 여기서부터 시작되며, SAM 모델의 원조로 간주해야 합니다.

2023년 4월 메타에서 발표한 일련의 모델이며, 다른 SAM 모델도 이 시리즈와 비교될 예정입니다. 크기에 따라 h(거대), l(대형), b(베이스), 거대 > 대형 > 베이스의 3가지 모델이 있으며, 정확도는 이론적으로 크기에 비례하고 계산 속도도 크기에 비례합니다.

효과 측면에서는 거대하고 큰 차이는 거의 없지만 기본과 거대 사이에는 상당한 차이가 있습니다.

메타 SAM 참조:

https://segment-anything.com/

https://github.com/facebookresearch/segment-anything

https://huggingface.co/facebook/sam-vit-base/tree/main

https://huggingface.co/facebook/sam-vit-large

https://huggingface.co/facebook/sam-vit-huge

클래스 2: sam_hq_vit의 시작 - 고품질 시리즈에서 무엇이든 세그먼트화하기

sam_hq_vit으로 시작하는 모델은 ETH 취리히의 시각 지능 및 시스템 그룹에서 제공하는 고품질 시맨틱 분할 모델이며, 그들의 논문에서 제공된 데이터에 따르면 절단 정확도가 Meta보다 우수하므로 고품질이라고합니다. 논문에서 제공된 데이터에 따르면 세분화의 정확도가 메타보다 우수하기 때문에 고품질이라고 하지만 세분화된 영역이 메타보다 얇지만 우리의 경우 그 차이가 크지 않습니다.

SAM 본사 참조:

https://github.com/SysCV/sam-hq

https://huggingface.co/lkeab/hq-sam/tree/main

클래스 3: FastSAM 시작 - FastSAM 시리즈

좋은 결과를 얻고 메모리를 절약하려면 CASIA-IVA-Lab(CASIA-IVA-Lab)에서 제공하는 FastSAM 시리즈를 사용할 수 있습니다. 저는 이 모델을 소형 VRAM 머신에서 직접 사용합니다.

X와 S의 두 가지 모델로 제공됩니다.

이 웨딩 드레스 예시에서는 모델 X가 잘 작동했지만, S는 이 예시에는 적합하지 않았을 것입니다.

FastSAM 정보는 아래에 제공됩니다:

https://github.com/CASIA-IVA-Lab/FastSAM

https://huggingface.co/An-619/FastSAM

카테고리 4: 모바일 SAM

작고 빠른 SAM , CPU를 사용해도 빠르게 실행할 수 있는 SAM입니다. 그러나 효과는 최악 중 하나이며 큰 블록을 구별하는 데만 적합합니다.

모바일 SAM 참조:

https://github.com/ChaoningZhang/MobileSAM

https://huggingface.co/dhkim2810/MobileSAM/tree/main

질문 3: Inpaint의 마스크된 콘텐츠 파라미터는 무엇을 제어하나요?

마스크된 콘텐츠에는 아래에 설명된 네 가지 옵션이 있습니다:

옵션 1: 채우기

채우기 옵션은 다시 그린 영역의 이미지를 최대한 흐리게 처리하여 일반적인 구조와 색상만 유지합니다. 따라서 대규모로 다시 칠해야 할 때 사용합니다.

우리의 패러다임에서는 해수면의 위치, 모래 난이도의 코스, 심지어 일몰의 색깔까지 모두 동일합니다.

옵션 2: 원본

원본은 원본 이미지를 의미하며, 생성된 이미지는 블록, 색상 등의 측면에서 원본 이미지와 매우 유사합니다.

이 예제에서 이 옵션을 선택하면 마네킹의 검은색 부분은 남고 해변의 방향은 그대로 유지됩니다.

옵션 3: 잠재 노이즈

잠재 노이즈는 다시 그릴 부분에 노이즈를 주어 관련 없는 콘텐츠를 생성하는 경향이 있으며 창의성이 필요한 경우에 사용됩니다.

데모에서 볼 수 있듯이 잠재 노이즈로 생성된 이미지는 프롬프트에서 언급된 작은 것(예: 이 경우 흰 장미)을 반복합니다.

옵션 4: 잠복 없음

잠복색은 다시 그릴 영역 근처의 색을 참조하여 주변 색의 평균을 구한 다음 다시 그린 영역을 채웁니다. 원하지 않는 개체를 제거할 때 유용합니다.

하지만 이번 예제에서는 대규모로 다시 그리기 때문에 무언가를 제거한 것처럼 느껴지지 않습니다. 그러나 아무것도 없는 상태에서 생성된 다이어그램을 관찰하면 색 구성표와 구성이 매우 유사하다는 것을 알 수 있습니다(예: 모래 색상도 모두 매우 유사합니다).

V. 확장 문제 검토

방금 수행한 작업을 검토해 보겠습니다.

간단히 말해, 크게 두 가지 단계가 있습니다:

- 인페인트 애니씽의 시맨틱 세분화 기능으로 마스킹합니다.

- 그런 다음 투펠로용 인페인트 업로드와 특수 모델 리페인팅을 위한 인페인트로 전송됩니다.

그것만으로도 오늘날과 같은 생산성을 달성할 수 있었을 것입니다.

모든 것이 더 나아질 수 있지만 현재 접근 방식에는 여전히 몇 가지 문제가 있습니다:

- 원하는 모델에 인페인트 모델이 없는 경우 어떻게 하나요? 일반 모델을 사용할 수 있나요?

- 옷의 빛과 그림자를 바꾸려면 어떻게 해야 하나요?

- 가끔 포토샵한 사진처럼 느껴질 때가 있는데, 더 자연스러운 사진을 만들려면 어떻게 해야 하나요?

- 지금과 같은 이미지가 아닌 더 풍부한 이미지를 생성하는 방법을 알아보세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 게시물

댓글 없음...