개요

오늘, 강력하고 다양하며 유용한 Qwen2.5-Coder 모델 제품군을 오픈소스화하게 되어 기쁘게 생각하며, 앞으로도 Open CodeLLM의 개발을 지속적으로 발전시키기 위해 최선을 다할 것입니다.

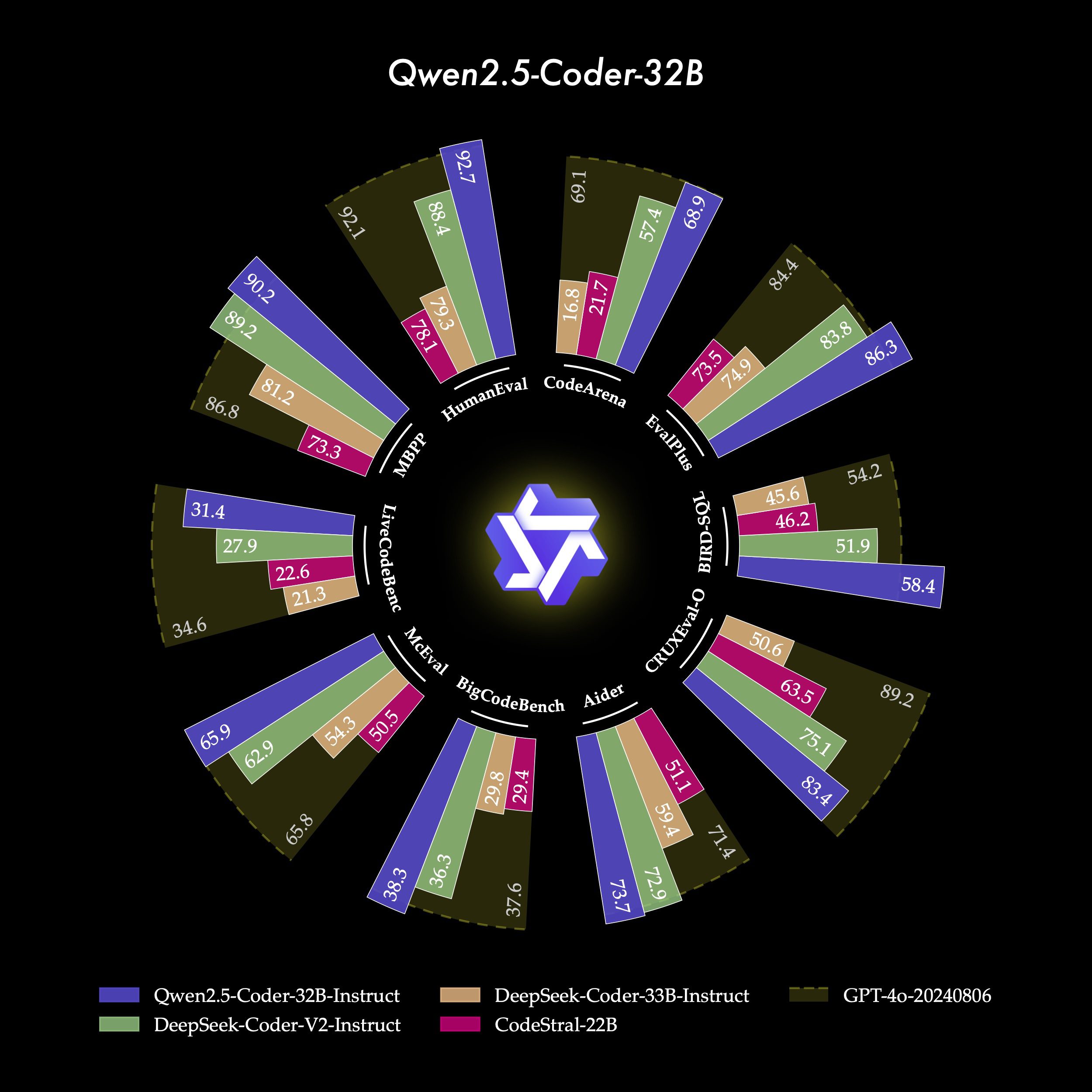

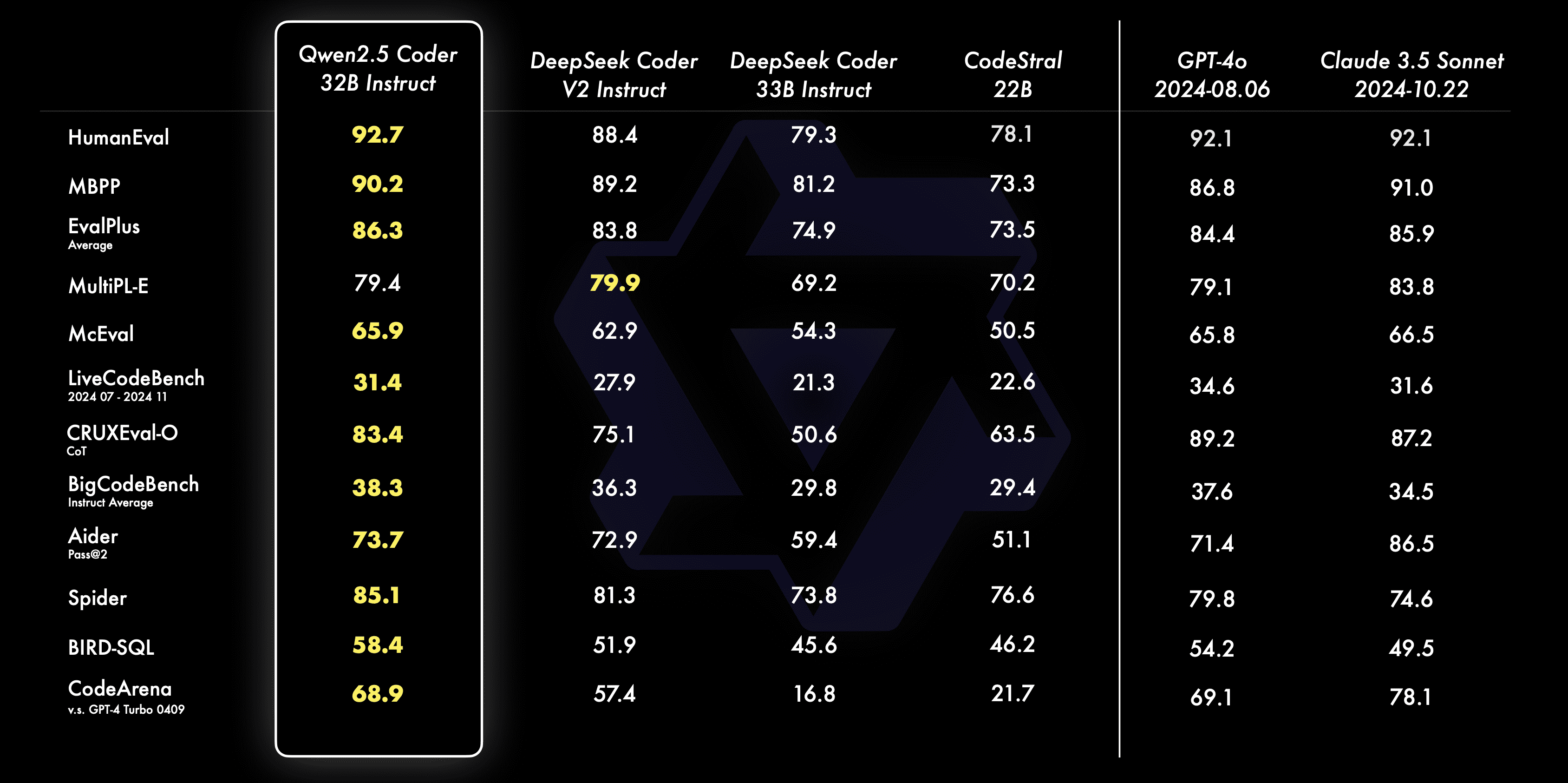

- 강력한Qwen2.5-Coder-32B-Instruct는 현재 SOTA의 오픈 소스 모델이 되었으며, GPT-4o에 필적하는 코드 기능으로 강력하고 포괄적인 코드 기능은 물론 우수한 범용 및 수학적 기능을 보여줍니다.

- 매니폴드지난달에는 1.5B 및 7B 크기를 오픈소스화했고, 이번에는 0.5B, 3B, 14B 및 32B 크기를 오픈소스화하여 다양한 개발자의 요구를 충족할 수 있도록 6가지 모델 크기를 지원하게 되었습니다.

- 실용적코드 어시스턴트 및 아티팩트 시나리오에서 Qwen2.5-Coder의 유용성을 살펴보고, 몇 가지 샘플을 사용하여 실제 시나리오에서 Qwen2.5-Coder의 잠재력을 시연해봅니다.

강력한 기능: 오픈 소스 모델 SOTA까지의 코드 기능

- 코드 생성이 오픈 소스의 플래그십 모델인 Qwen2.5-Coder-32B-Instruct는 여러 유명 코드 생성 벤치마크(예: EvalPlus, LiveCodeBench, BigCodeBench)에서 오픈 소스 모델 중 최고의 성능을 달성했으며, GPT-4o와 경쟁할 수 있는 성능을 달성했습니다.

- 코드 수정Qwen2.5-Coder-32B-Instruct는 사용자가 코드의 오류를 수정하고 프로그래밍을 더 효율적으로 할 수 있도록 도와주며, 코드 수정에 널리 사용되는 벤치마크인 Aider에서 Qwen2.5-Coder-32B-Instruct는 73.7점을 획득하여 Aider의 GPT와 비슷한 점수를 기록했습니다. Qwen2.5-Coder-32B-Instruct는 Aider에서 73.7점을 획득하여 GPT-4o와 비슷한 성능을 보였습니다.

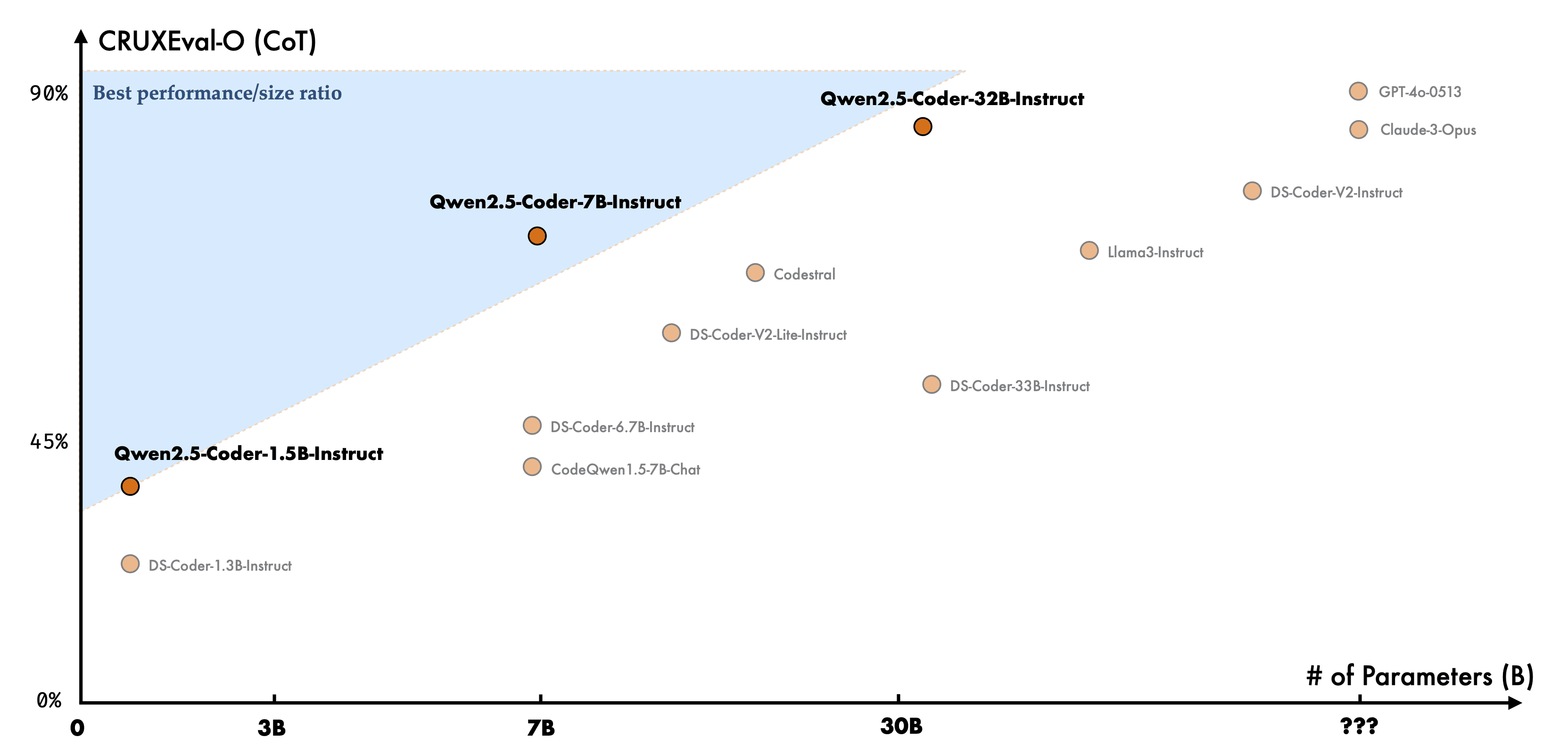

- 코드화된 추론코드 추론이란 모델이 코드 실행 과정을 학습하고 모델의 입력과 출력을 정확하게 예측하는 능력을 말합니다. 지난달 출시된 Qwen2.5-Coder-7B-Instruct는 이미 코드 추론 능력에서 좋은 성능을 보여줬으며, 32B 모델은 이보다 한 단계 더 나아간 모델입니다.

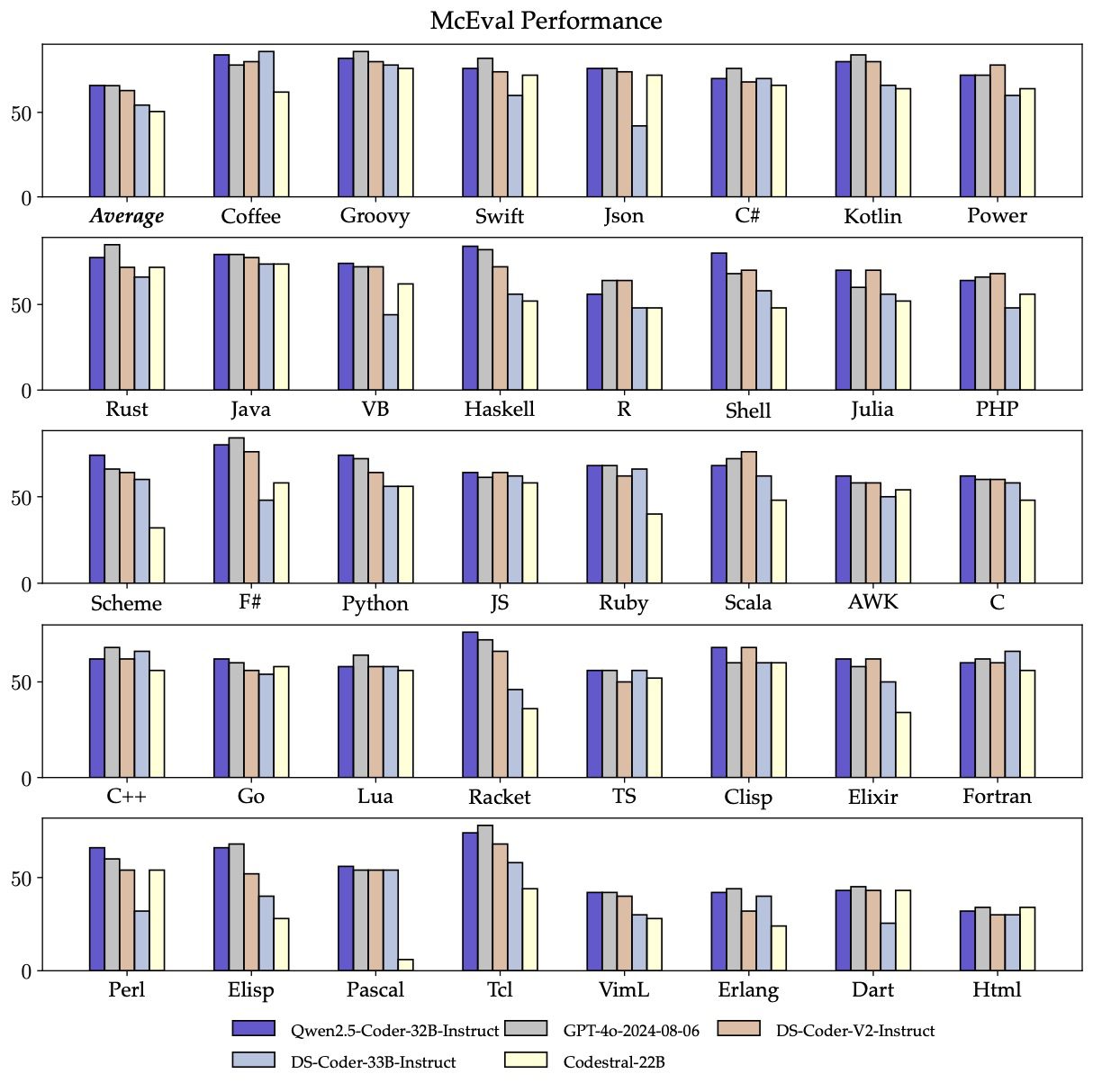

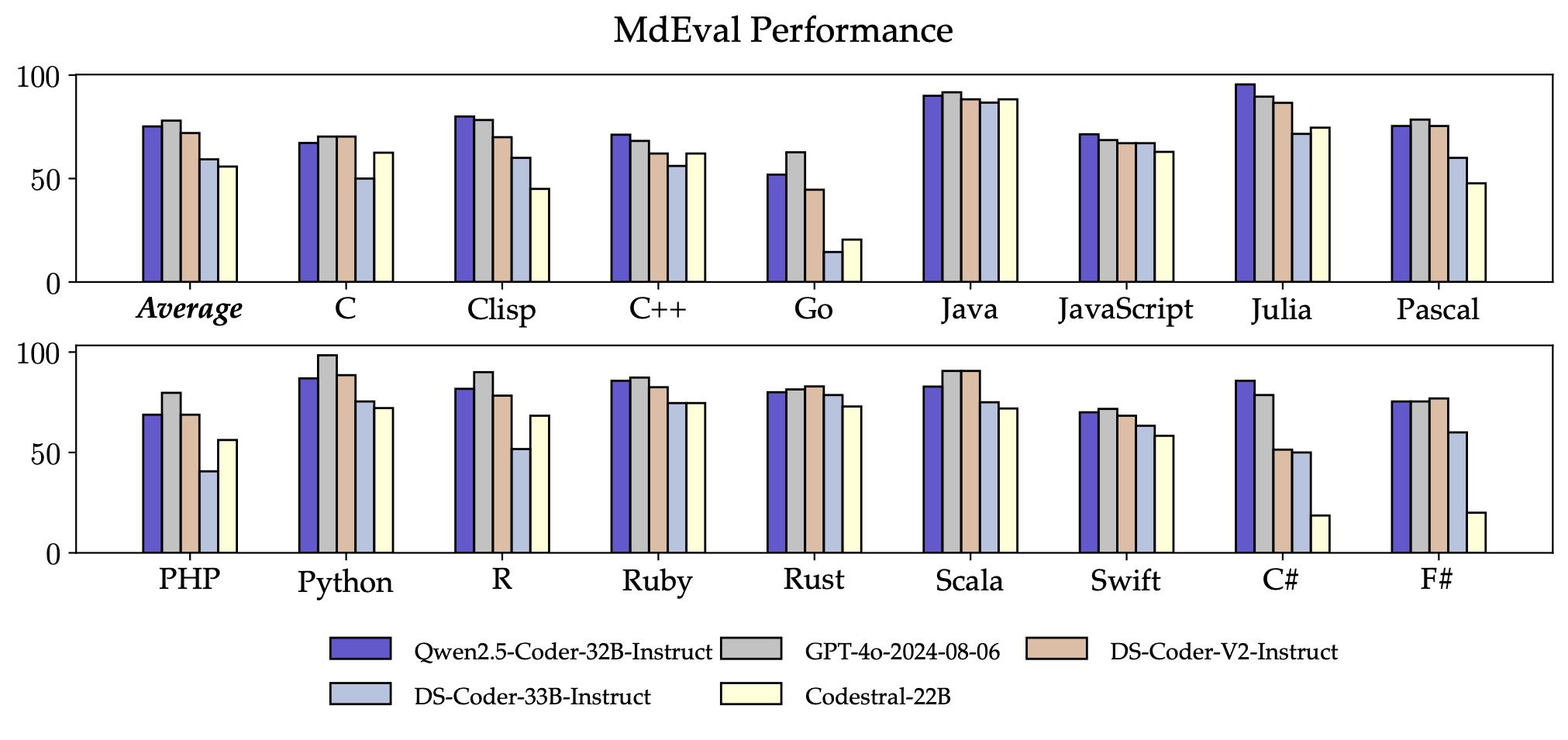

- 다국어지능형 프로그래밍 어시스턴트는 모든 프로그래밍 언어에 익숙해야 하며, Qwen2.5-Coder-32B-Instruct는 40개 이상의 프로그래밍 언어에서 우수한 성능을 보였으며, 사전 학습 단계의 데이터 정리 및 배분 덕분에 McEval에서 65.9점을 획득하고 Haskell, Racket 등에서 인상적인 성능을 보였습니다.

또한 Qwen2.5-Coder-32B-Instruct의 다중 프로그래밍 언어 코드 수정 기능도 놀랍기 때문에 사용자가 익숙한 프로그래밍 언어를 이해하고 수정하는 데 도움이되며 익숙하지 않은 언어의 학습 비용을 크게 완화 할 수 있습니다.

McEval과 마찬가지로 MdEval은 멀티 프로그래밍 언어 코드 수정 벤치마크로, Qwen2.5-Coder-32B-Instruct는 MdEval에서 75.2점을 획득하여 전체 오픈 소스 모델 중 최고 점수를 기록했습니다.

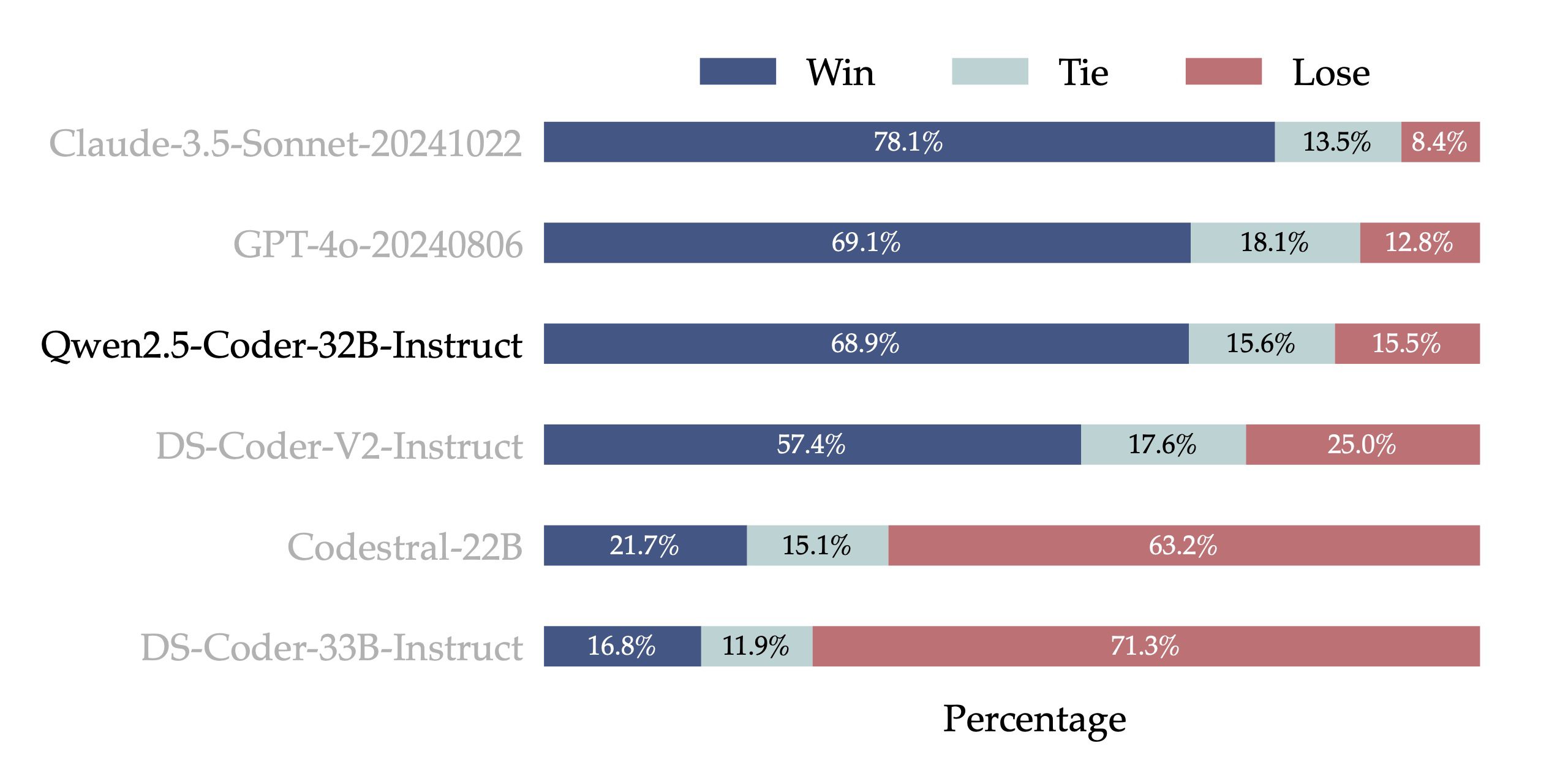

- 인간 선호도 정렬Qwen2.5-Coder-32B-Instruct의 인간 선호도에 대한 정렬 성능을 테스트하기 위해 내부 주석에서 코드 선호도 평가 벤치마크인 Code Arena(Arena Hard와 유사)를 구성했습니다. 선호도 정렬을 위한 평가 모델로 GPT-4o를 사용했으며, "A 대 B 승리" 평가, 즉 테스트 인스턴스 세트에서 모델 A의 점수가 모델 B의 점수를 초과하는 비율을 기준으로 삼았습니다. 다음 그림의 결과는 선호도 정렬에서 Qwen2.5-Coder-32B-Instruct의 이점을 보여줍니다.

다용도성: 다양한 모델 크기

Qwen2.5-Coder 오픈 소스 모델 제품군은 0.5B, 1.5B, 3B, 7B, 14B, 32B의 6가지 크기로 구성되어 다양한 리소스 시나리오에서 개발자의 요구를 충족할 뿐만 아니라 연구 커뮤니티에 좋은 실험 기반을 제공합니다. 다음 표는 자세한 모델 정보를 보여줍니다:

| 모델 | 매개변수 | 비-Emb 매개변수 | 레이어 | 헤드(KV) | 넥타이 임베딩 | 컨텍스트 길이 | 라이선스 |

|---|---|---|---|---|---|---|---|

| Qwen2.5-Coder-0.5B | 0.49B | 0.36B | 24 | 14 / 2 | 예 | 32K | Apache 2.0 |

| Qwen2.5-Coder-1.5B | 1.54B | 1.31B | 28 | 12 / 2 | 예 | 32K | Apache 2.0 |

| Qwen2.5-Coder-3B | 3.09B | 2.77B | 36 | 16 / 2 | 예 | 32K | Qwen Research |

| Qwen2.5-Coder-7B | 7.61B | 6.53B | 28 | 28 / 4 | 아니요 | 128K | Apache 2.0 |

| Qwen2.5-Coder-14B | 14.7B | 13.1B | 48 | 40 / 8 | 아니요 | 128K | Apache 2.0 |

| Qwen2.5-Coder-32B | 32.5B | 31.0B | 64 | 40 / 8 | 아니요 | 128K | Apache 2.0 |

우리는 항상 다음과 같은 믿음을 가지고 있습니다. 스케일링 법칙 철학. 모든 데이터 세트에서 다양한 크기의 Qwen2.5 코더 모델의 성능을 평가하여 코드 LLM에 대한 스케일링의 효과를 검증합니다.

각 사이즈별로 오픈소스인 기본 모델과 인스트럭트 모델이 있으며, 기본 모델은 개발자가 모델을 미세 조정할 수 있는 기반이 되고 인스트럭트 모델은 직접 채팅에 사용할 수 있는 공식 얼라인먼트 모델입니다.

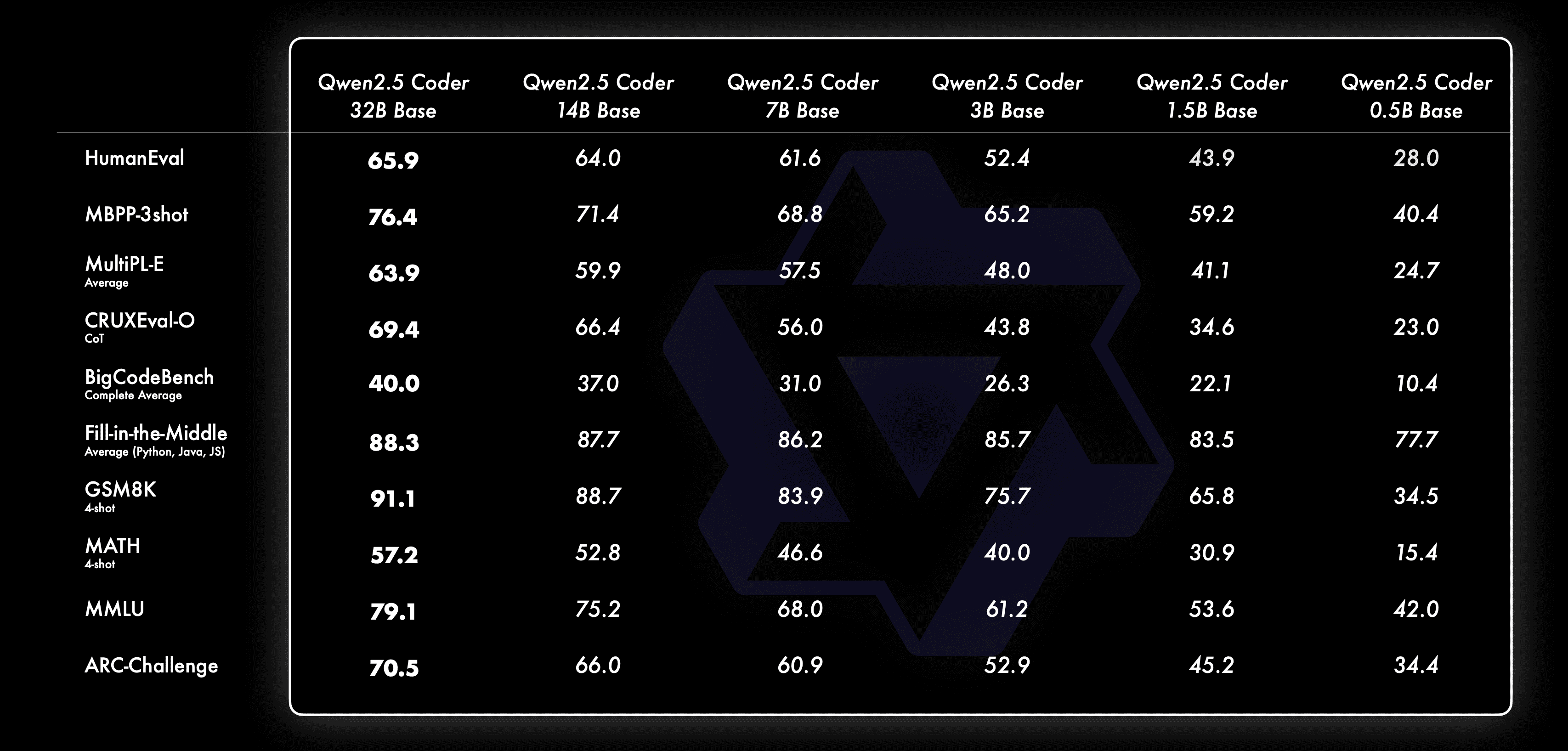

다음은 다양한 크기에서 기본 모델이 작동하는 방식입니다:

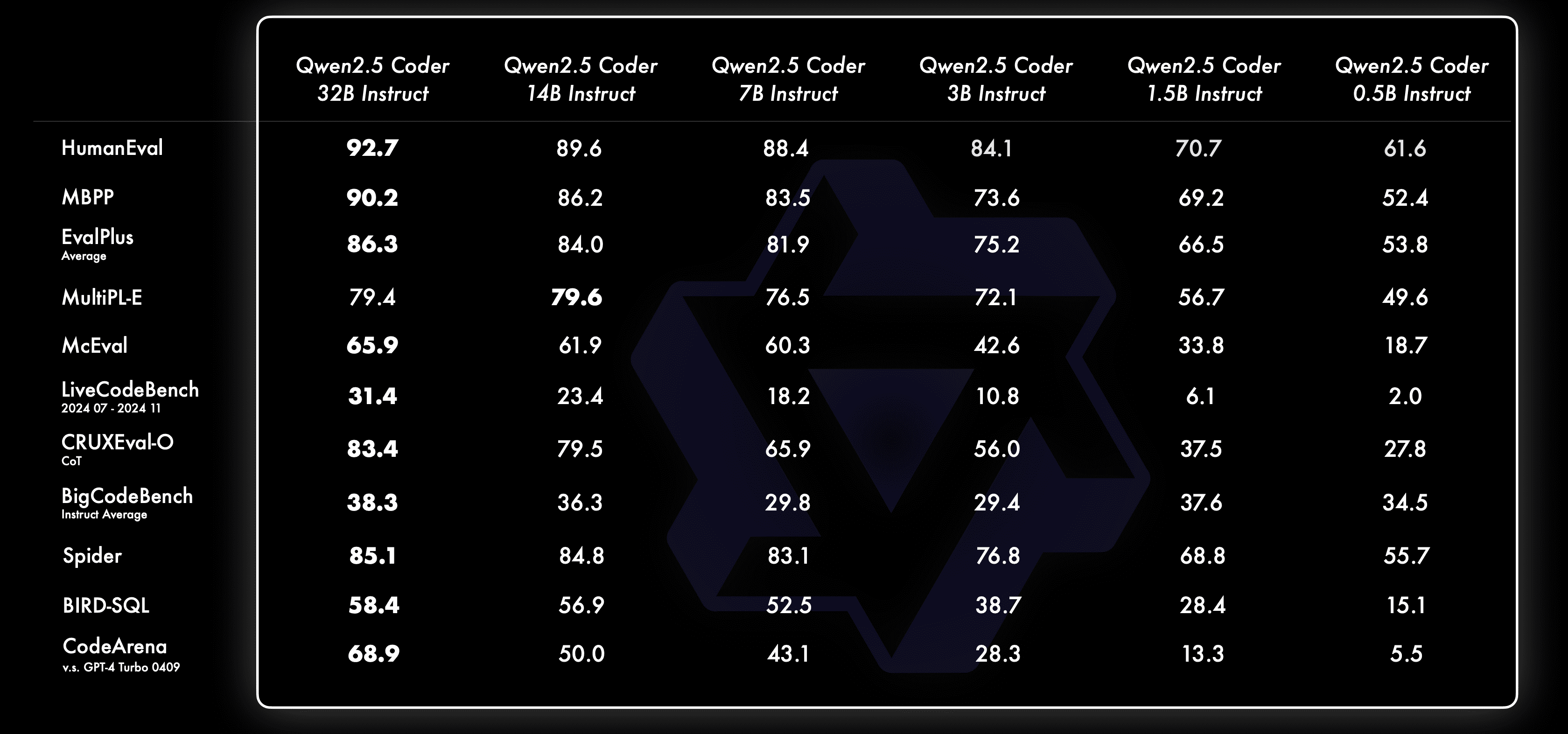

다음은 다양한 크기에서 인스트럭트 모델이 작동하는 방식입니다:

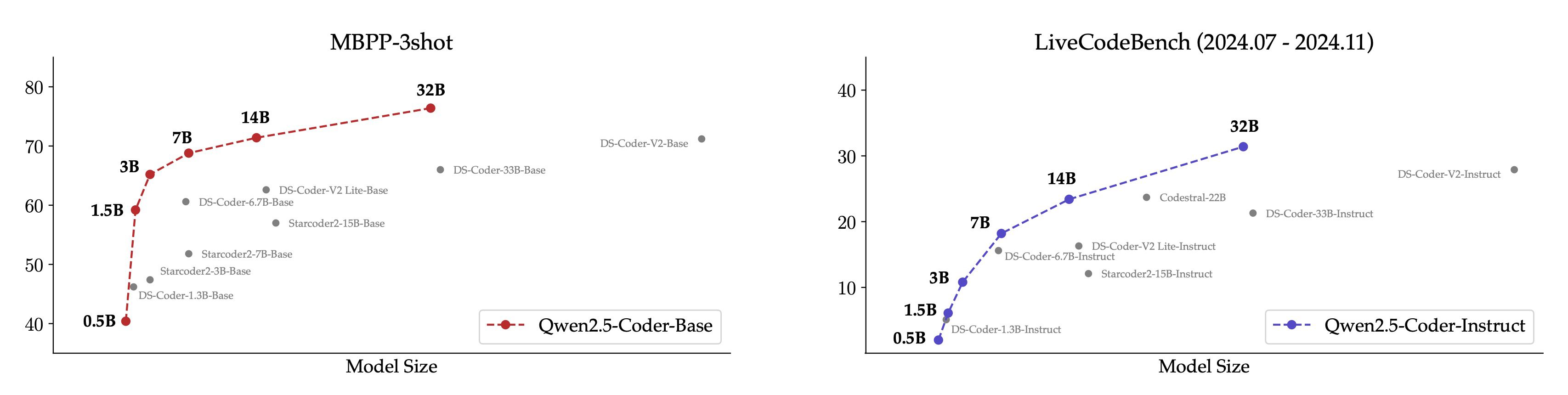

보다 직관적인 이해를 돕기 위해 핵심 데이터 세트에서 다양한 크기의 Qwen2.5-Coder 모델과 다른 오픈 소스 모델을 비교하여 보여드리겠습니다.

- 기본 모델의 경우 MBPP-3샷을 평가 지표로 선택했으며, 광범위한 실험을 통해 MBPP-3샷이 기본 모델을 평가하는 데 더 적합하고 모델의 실제 효과와 잘 상관관계가 있음을 확인했습니다.

- Instruct 모델의 경우 지난 4개월(2024.07~2024.11)의 LiveCodeBench 주제를 평가 대상으로 선택했으며, 훈련 세트에 유출될 가능성이 낮은 최근 게시된 주제는 모델의 OOD 기능을 반영합니다.

모델 크기와 모델 효과성 사이에는 예상했던 양의 상관관계가 있었고, Qwen2.5-Coder가 모든 크기에서 SOTA 성능을 달성했다는 사실은 더 큰 코더 모델을 계속 탐색하도록 장려합니다.

실습: 커서와 아티팩트 만나기

실용적인 코더는 항상 우리의 비전이었습니다. 이를 위해 코드 어시스턴트와 아티팩트의 맥락에서 Qwen2.5-Coder 모델을 실제로 적용하는 방법을 살펴봤습니다.

Qwen2.5-코딩기 🤝 커서

지능형 코드 어시스턴트는 이미 널리 사용되고 있지만 현재는 대부분 비공개 소스 모델에 의존하고 있으며, Qwen2.5-Coder의 등장으로 개발자에게 친숙하고 강력한 대안을 제공할 수 있기를 바랍니다.

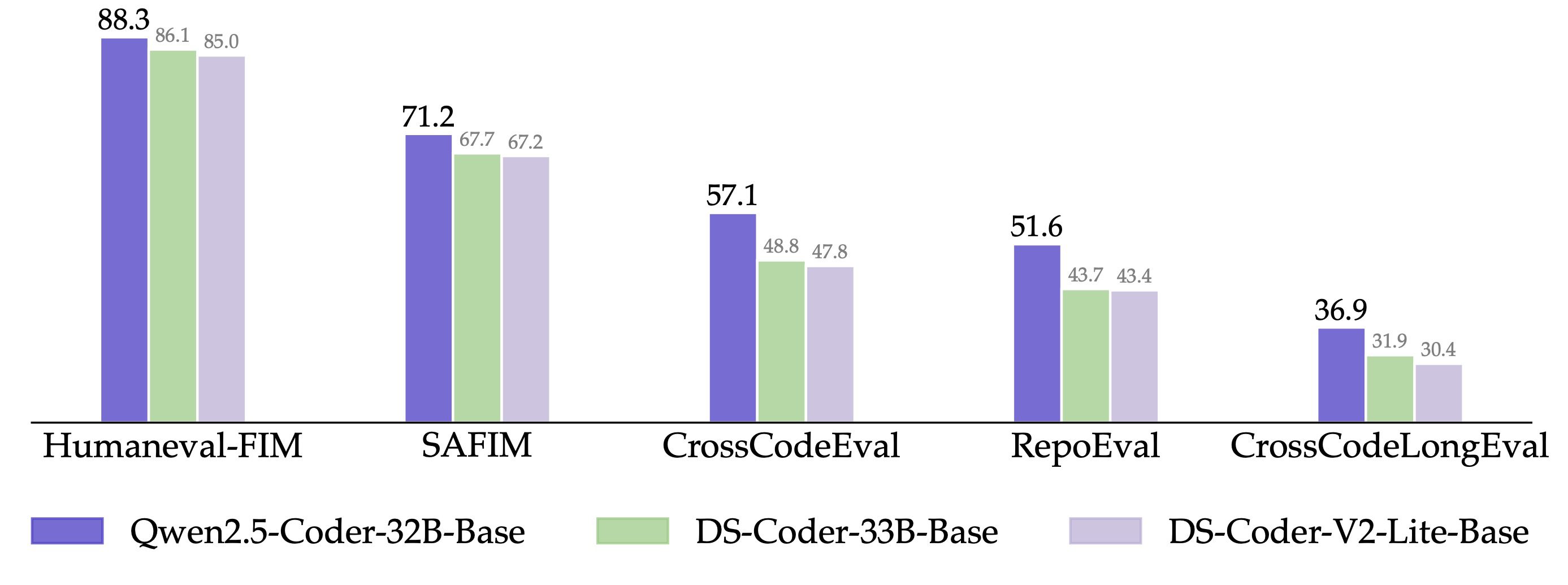

또한 Qwen2.5-Coder-32B는 사전 학습된 모델에서 강력한 코드 완성 능력을 입증했으며, Humaneval-Infilling, CrossCodeEval, CrossCodeLongEval, RepoEval, SAFIM 등 5가지 평가 세트에서 SOTA 성능을 달성했습니다.

공정한 비교를 위해 최대 시퀀스 길이를 8k로 제어하고 중간 채우기 모드를 사용하여 테스트했습니다. 4가지 리뷰 세트인 CrossCodeEval, CrossCodeLongEval, RepoEval, Humaneval-Infilling에서는 생성된 콘텐츠가 실제 레이블과 완전히 동일한지(정확히 일치)를 평가했고, SAFIM에서는 1회 실행 성공률(Pass@1)을 사용해 평가했습니다. 평가했습니다.

Qwen2.5-코딩 🤝 아티팩트

아티팩트는 사용자가 시각화에 적합한 무언가를 만들 수 있도록 도와주는 코드 생성에 가장 중요한 애플리케이션 중 하나이며, 저희는 이를 위해 WebUI 열기 아티팩트 시나리오에서 Qwen2.5-Coder의 잠재력을 살펴볼 수 있는 몇 가지 구체적인 예시를 소개합니다:

한 문장 생성 웹사이트, 미니 게임, 데이터 차트 등 모든 종류의 시각화 애플리케이션을 지원하는 통이 공식 웹사이트(https://tongyi.aliyun.com)의 코드 모드가 곧 온라인에 공개될 예정입니다. 꼭 체험해 보세요!

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...