일반 소개

Pieces-OS는 오픈 소스 프로젝트로, Pieces-OS GRPC 스트림을 역으로 표준 OpenAI API 인터페이스로 변환하고 Claude, GPT, Gemini를 지원하는 것을 목표로합니다. 이 프로젝트는 상업적 용도가 아닌 주로 학습 및 커뮤니케이션을 위해 GPL-3.0 프로토콜 오픈 소스를 기반으로 Nekohy에서 개발했습니다. 이 프로젝트는 다양한 모델 호환성을 제공하며 Vercel 원클릭 배포를 지원합니다.

역방향 조각 클루드, GPT, 제미니 모델을 지원하는 API 인터페이스를 1분간 무료로 배포할 수 있습니다. 제공GO 버전.

기능 목록

- GRPC 흐름 반전: Pieces-OS에서 표준 OpenAI 인터페이스로 GRPC 스트림을 변환합니다.

- 다중 모델 지원호환 가능 Claude 시리즈, GPT 시리즈, Gemini 시리즈 및 기타 여러 모델.

- 원클릭 배포: 지원 원클릭으로 배포하는 Vercel 플랫폼를 사용하여 사용자가 쉽게 빠르게 구축할 수 있습니다.

- 클라우드 모델 구성클라우드 모델의 프로필을 제공하여 사용자가 필요에 따라 다른 모델을 추출하여 사용할 수 있도록 합니다.

- API 요청 관리환경 변수를 구성하여 API 요청의 접두사 경로, 키, 재시도 등을 관리합니다.

도움말 사용

설치 프로세스

- 복제 프로젝트사용

git clone명령을 사용하여 프로젝트를 로컬로 복제합니다.git clone https://github.com/Nekohy/pieces-os.git - 종속성 설치프로젝트 디렉토리로 이동하여 설치

package.json에 정의된 종속성 라이브러리cd pieces-os npm install - 트리거 절차: 구현

node index.js절차를 시작합니다.node index.js

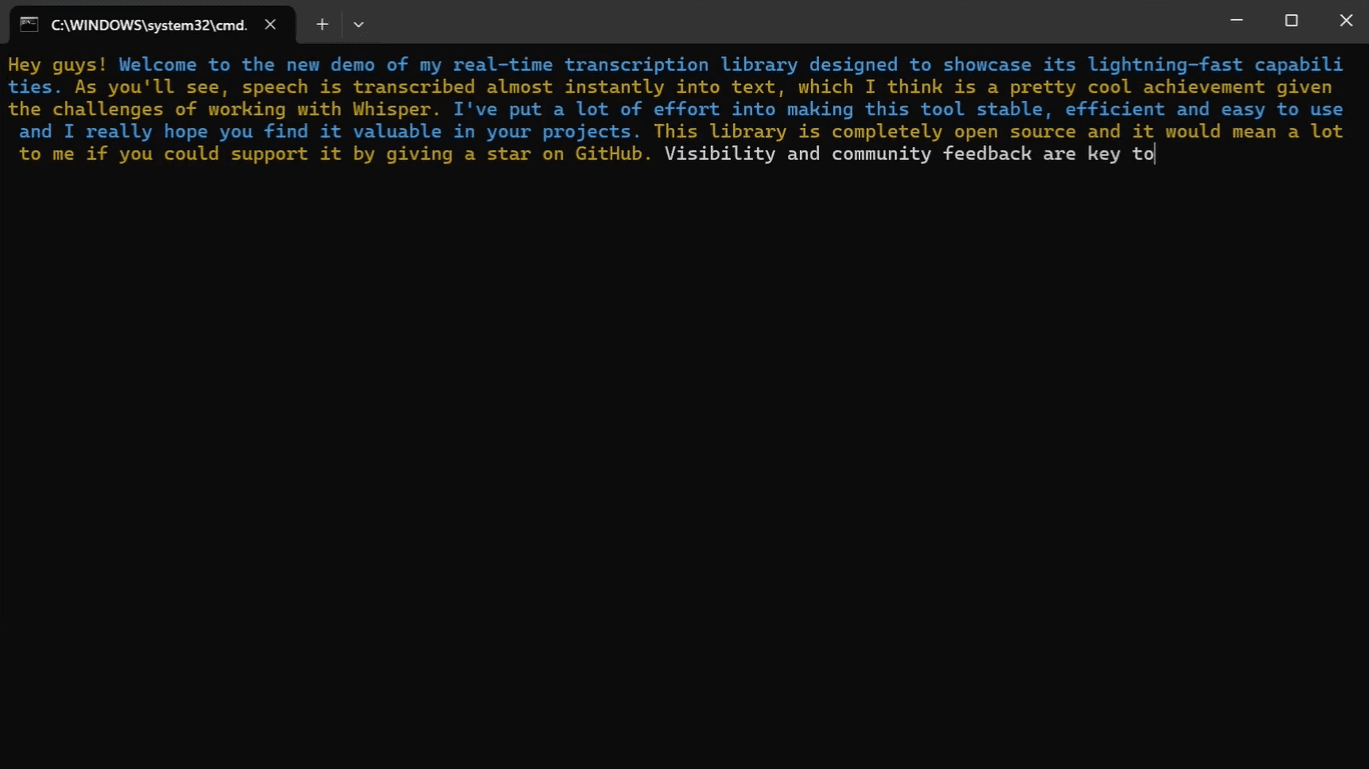

사용 프로세스

- 모델 목록 가져오기다음 명령으로 사용 가능한 모델 목록을 가져옵니다.

curl --request GET 'http://127.0.0.1:8787/v1/models' --header 'Content-Type: application/json' - 요청 보내기: 다음 명령을 사용하여 채팅 요청을 보냅니다.

curl --request POST 'http://127.0.0.1:8787/v1/chat/completions' --header 'Content-Type: application/json' --data '{ "messages": [ { "role": "user", "content": "你好!" } ], "model": "gpt-4o", "stream": true }'

환경 변수 구성

- API_PREFIXAPI 요청의 접두사 경로, 기본값은

'/'. - API_KEYAPI 요청의 키. 기본값은 빈 문자열입니다.

- 최대_재시도_수최대 재시도 횟수, 기본값은

3. - RETRY_DELAY재시도 지연 시간(밀리초), 기본값은

5000(5초). - PORT: 서비스가 수신 대기하는 포트이며, 기본값은

8787.

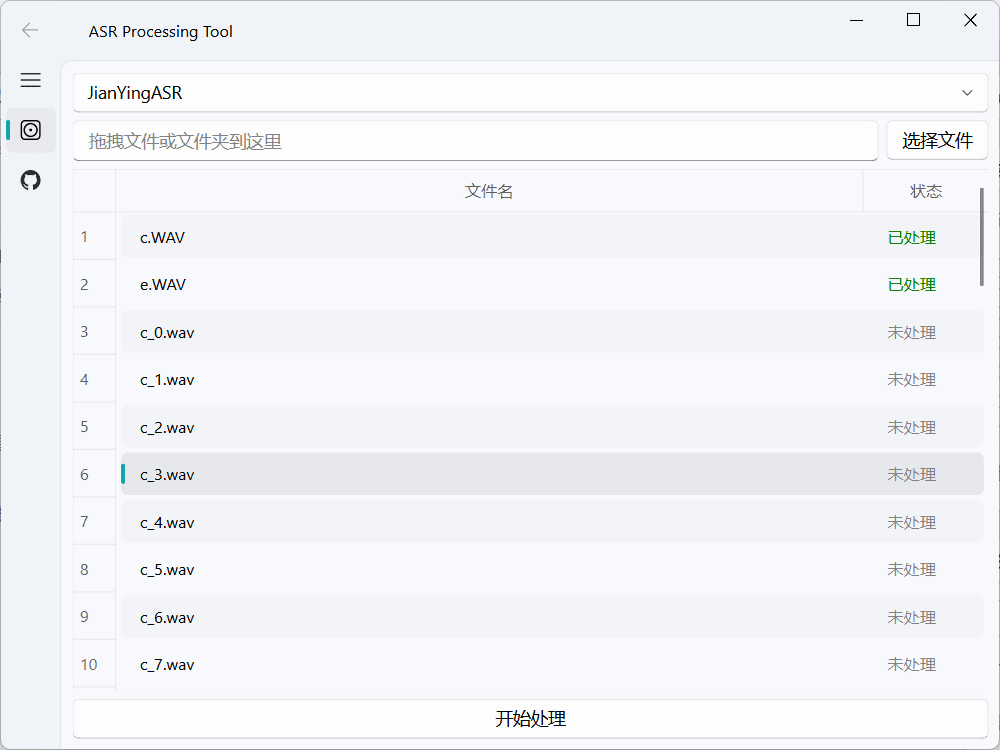

모델 구성

이 프로젝트는 여러 모델에 대한 프로필을 제공합니다. cloud_model.json사용자는 필요에 따라 다른 모델을 추출하여 사용할 수 있습니다. 예를 들어

- 클로드 시리즈::

claude-3-5-sonnet@20240620및claude-3-haiku@20240307등 - GPT 시리즈::

gpt-3.5-turbo및gpt-4및gpt-4-turbo등 - 제미니 시리즈::

gemini-1.5-flash및gemini-1.5-pro등

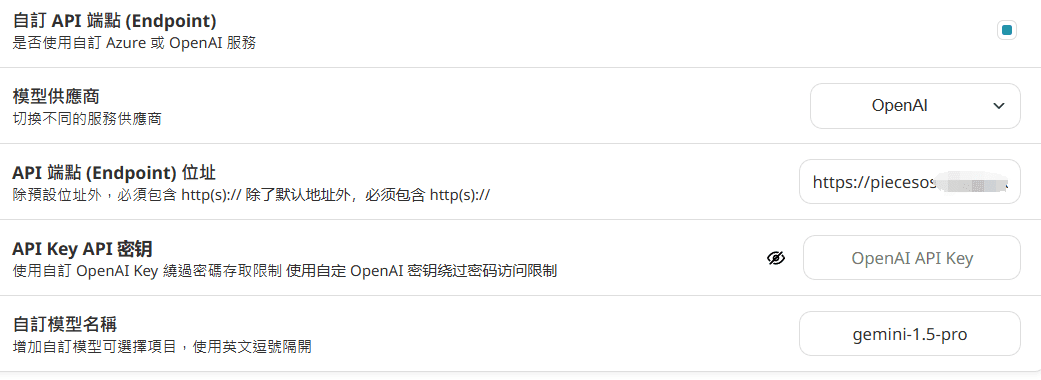

배포 후 사용 방법

다음 채팅에서 구성합니다:

도메인 이름을 직접 입력하고 URL 뒤에 추가하지 마세요./v1/models 및 /v1/chat/completions

API_KEY가 Vercel에 구성되지 않은 경우 입력이 필요하지 않습니다.

몰입형 번역 구성: (동시성 문제로 인해 권장하지 않음)

https://你的域名/v1/chat/completions

아피키가 설정되지 않은 경우 빈칸을 채우세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...