MuseV+Muse Talk: 완벽한 디지털 휴먼 비디오 생성 프레임워크 | 포트레이트에서 비디오로 | 포즈에서 비디오로 | 립싱크

일반 소개

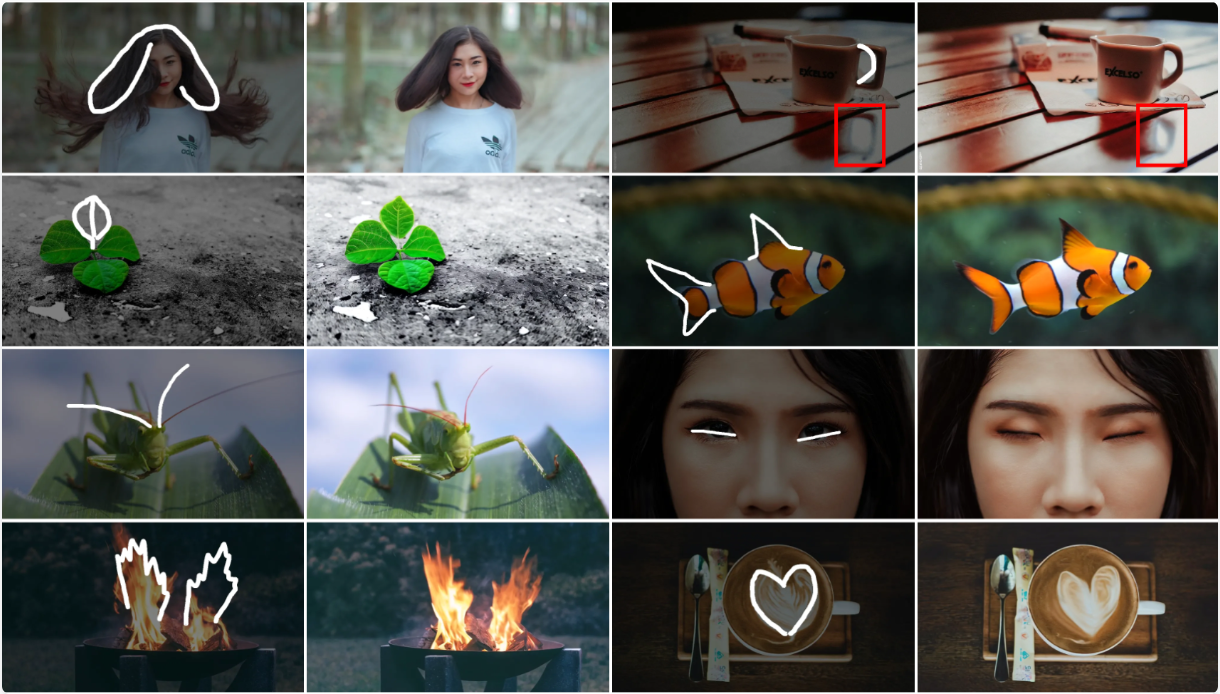

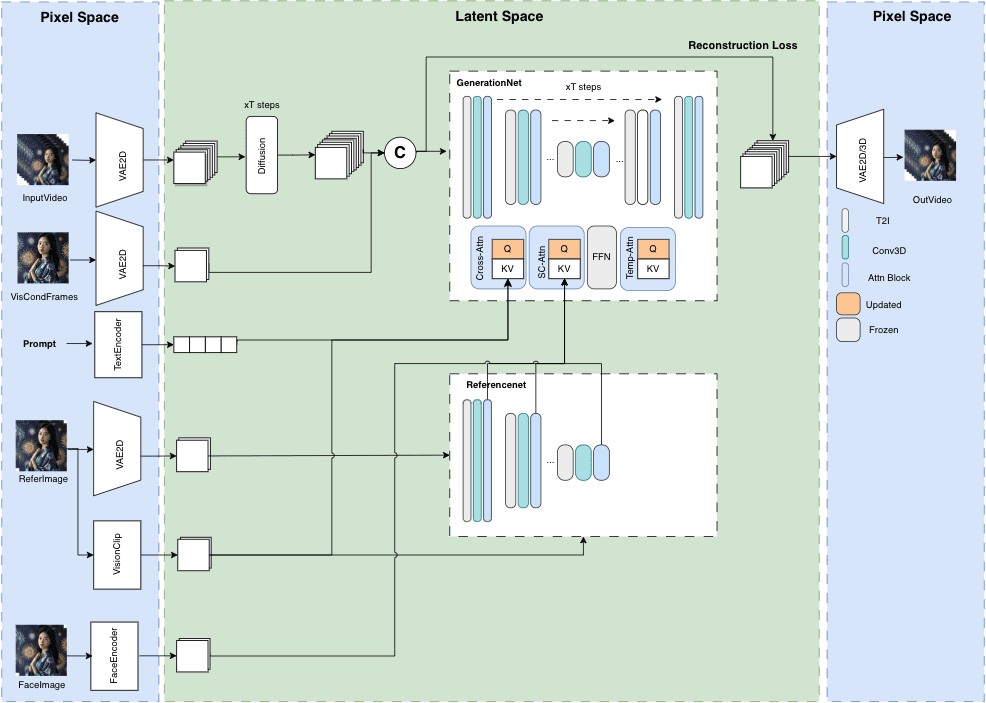

MuseV는 길이에 제한이 없는 고화질의 아바타 동영상 생성을 목표로 하는 깃허브의 공개 프로젝트입니다. 디퓨전 기술을 기반으로 하며 이미지2비디오, 텍스트2이미지2비디오, 비디오2비디오 등 다양한 기능을 제공합니다. 모델 구조, 사용 사례, 빠른 시작 가이드, 추론 스크립트 및 인정에 대한 세부 정보가 제공됩니다.

MuseV는 확산 모델에 기반한 가상 인간 동영상 생성 프레임워크로 다음과 같은 기능을 갖추고 있습니다:

특히 카메라 위치가 고정된 장면에서 오류 누적 문제 없이 새로운 시각적 조건부 병렬 노이즈 제거 방식을 사용하여 무한 길이 생성을 지원합니다.

캐릭터 유형 데이터 세트에 대해 학습된 아바타 동영상 생성을 위한 사전 학습된 모델이 제공됩니다.

이미지 대 비디오, 텍스트 대 이미지 대 비디오, 비디오 대 비디오 생성을 지원합니다.

base_model, lora, controlnet 등을 포함한 스테이블 디퓨전의 그래픽 생성 에코시스템과 호환됩니다.

IPAdapter, 참조 전용, 참조 네트워크, IPAdapterFaceID를 포함한 여러 참조 이미지 기술을 지원합니다.

교육 코드도 추후 공개할 예정입니다.

기능 목록

길이 제한 없는 동영상 생성

고충실도 가상 인간 이미지

다양한 지원: 이미지2비디오, 텍스트2이미지2비디오, 비디오2비디오

명확한 모델 구조 및 사용 사례

빠른 시작 및 추론 스크립트

도움말 사용

업데이트 및 다운로드 가능한 리소스를 보려면 GitHub 리포지토리를 방문하세요.

초기 프로젝트 설정을 위한 빠른 시작 가이드를 따르세요.

제공된 추론 스크립트를 사용하여 동영상 콘텐츠 생성하기

결합 사용 방법:

방법 1: 라이브 비디오 녹화 + 뮤즈 토크

방법 2: 사진 + MuseV + 뮤즈 토크

완제품

스틸 사진 반복 영상에서 애니메이션 캐릭터가 말하게 하고, 만화 캐릭터의 입술 자체가 없어 말하기가 이상하니 다음에는 '입술', 가급적 '실제 사람'으로 이미지를 바꿔야 합니다. 공식 영상 45초 분량. 테스트 환경을 위해 15분 정도 기다립니다.

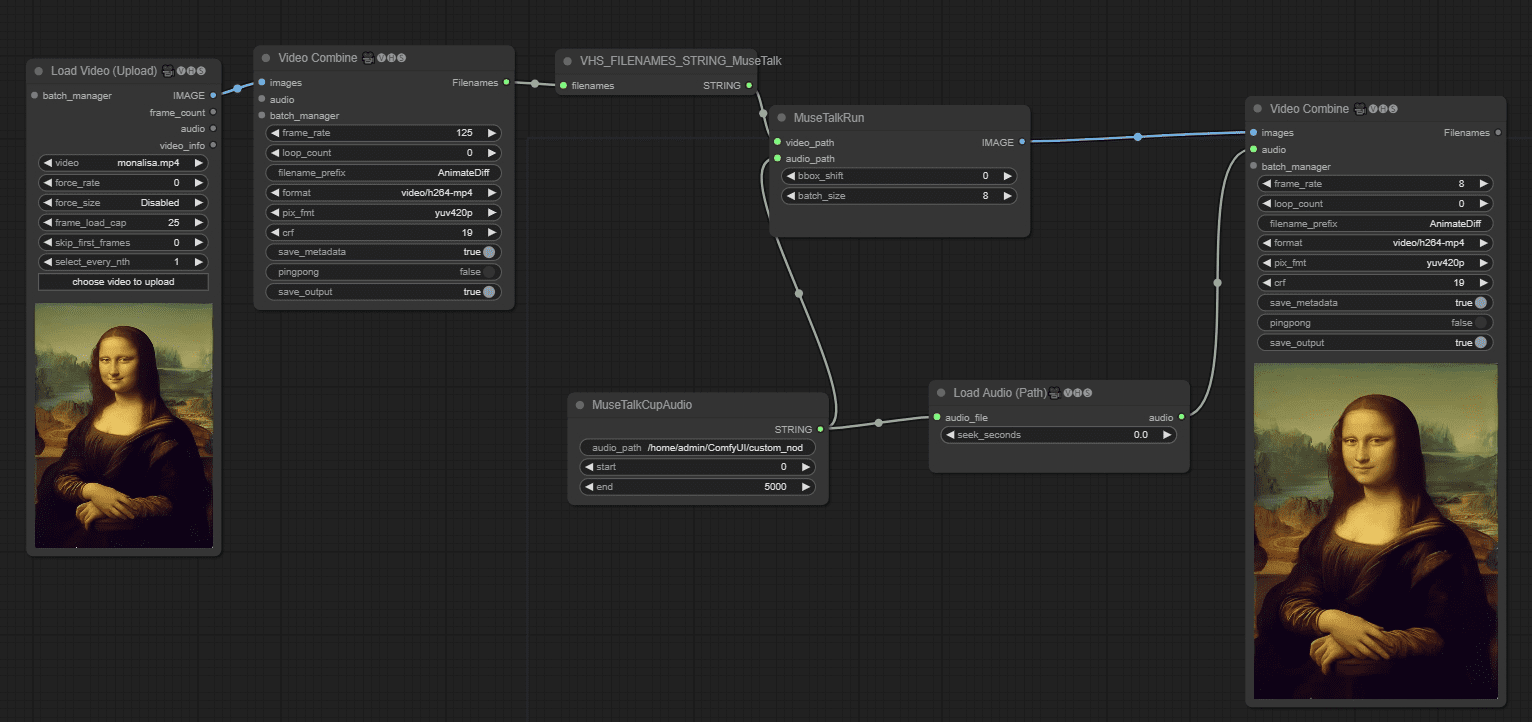

ComfyUI 워크플로에서 비디오 말하기 만들기

출시 MuseTalk MuseTalk는 실시간 고품질 입 동기화 모델입니다(NVIDIA Tesla V100에서 30fps 이상). MuseTalk는 MuseV에서 생성한 영상과 같은 입력 영상에 적용하여 완전한 아바타 솔루션으로 사용할 수 있습니다.

MuseV 온라인 경험 / Windows 원클릭 설치 패키지

링크: https://pan.quark.cn/s/ed896ceda5c8

추출 코드: JygA

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...