일반 소개

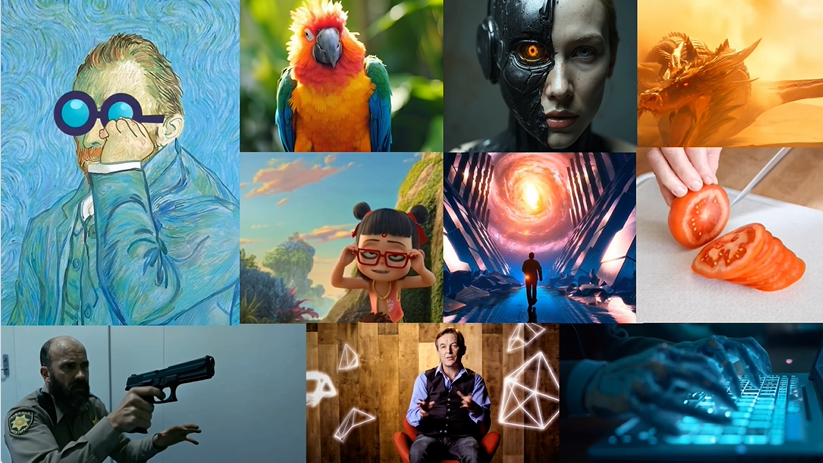

Magic 1-For-1은 메모리 사용량을 최적화하고 추론 지연 시간을 줄이기 위해 설계된 효율적인 비디오 생성 모델입니다. 이 모델은 텍스트 대 비디오 생성 작업을 텍스트 대 이미지 생성 및 이미지 대 비디오 생성의 두 가지 하위 작업으로 분해하여 보다 효율적인 학습 및 증류 작업을 수행하며, 짧은 비디오를 빠르게 생성해야 하는 시나리오를 위해 1분 미만의 고품질 1분 비디오 클립을 생성할 수 있는 Magic 1-For-1을 사용합니다. 이 프로젝트는 북경대학교, 헤드라, 엔비디아의 연구진이 개발했으며 코드와 모델 가중치는 GitHub에서 공개적으로 사용할 수 있습니다.

기능 목록

- 텍스트-이미지 생성: 입력된 텍스트 설명을 이미지로 변환합니다.

- 이미지를 동영상으로 생성: 생성된 이미지를 동영상 클립으로 변환합니다.

- 효율적인 메모리 사용: 단일 GPU 환경의 메모리 사용량을 최적화합니다.

- 빠른 추론: 빠른 동영상 생성을 위해 추론 대기 시간을 줄입니다.

- 모델 가중치 다운로드: 사전 학습된 모델 가중치를 다운로드할 수 있는 링크를 제공합니다.

- 환경 설정: 자세한 환경 설정 및 종속성 설치 가이드를 제공합니다.

도움말 사용

환경 설정

- git-lfs를 설치합니다:

sudo apt-get install git-lfs

- Conda 환경이 생성되고 활성화됩니다:

conda create -n video_infer python=3.9

conda activate video_infer

- 프로젝트 종속성을 설치합니다:

pip install -r requirements.txt

모델 가중치 다운로드

- 미리 학습된 가중치를 저장할 디렉토리를 만듭니다:

mkdir pretrained_weights

- 매직 1+1 웨이트를 다운로드하세요:

wget -O pretrained_weights/magic_1_for_1_weights.pth <model_weights_url>

- 포옹하는 얼굴 컴포넌트를 다운로드합니다:

huggingface-cli download tencent/HunyuanVideo --local_dir pretrained_weights --local_dir_use_symlinks False

huggingface-cli download xtuner/llava-llama-3-8b-v1_1-transformers --local_dir pretrained_weights/text_encoder --local_dir_use_symlinks False

huggingface-cli download openai/clip-vit-large-patch14 --local_dir pretrained_weights/text_encoder_2 --local_dir_use_symlinks False

비디오 생성

- 텍스트 및 이미지-동영상 생성을 위해 다음 명령을 실행합니다:

python test_ti2v.py --config configs/test/text_to_video/4_step_ti2v.yaml --quantization False

- 또는 제공된 스크립트를 사용하세요:

bash scripts/generate_video.sh

세부 기능 작동 흐름

- 텍스트를 이미지로 생성텍스트 설명을 입력하면 모델이 해당 이미지를 생성합니다.

- 이미지에서 동영상으로 생성생성된 이미지를 동영상 생성 모듈에 입력하면 짧은 동영상 클립을 생성할 수 있습니다.

- 효율적인 메모리 사용메모리 사용량을 최적화하여 단일 GPU 환경에서도 효율적인 작동을 보장합니다.

- 빠른 추론짧은 동영상을 빠르게 생성해야 하는 시나리오에서 추론 지연을 줄이고 빠른 동영상 생성을 달성합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...