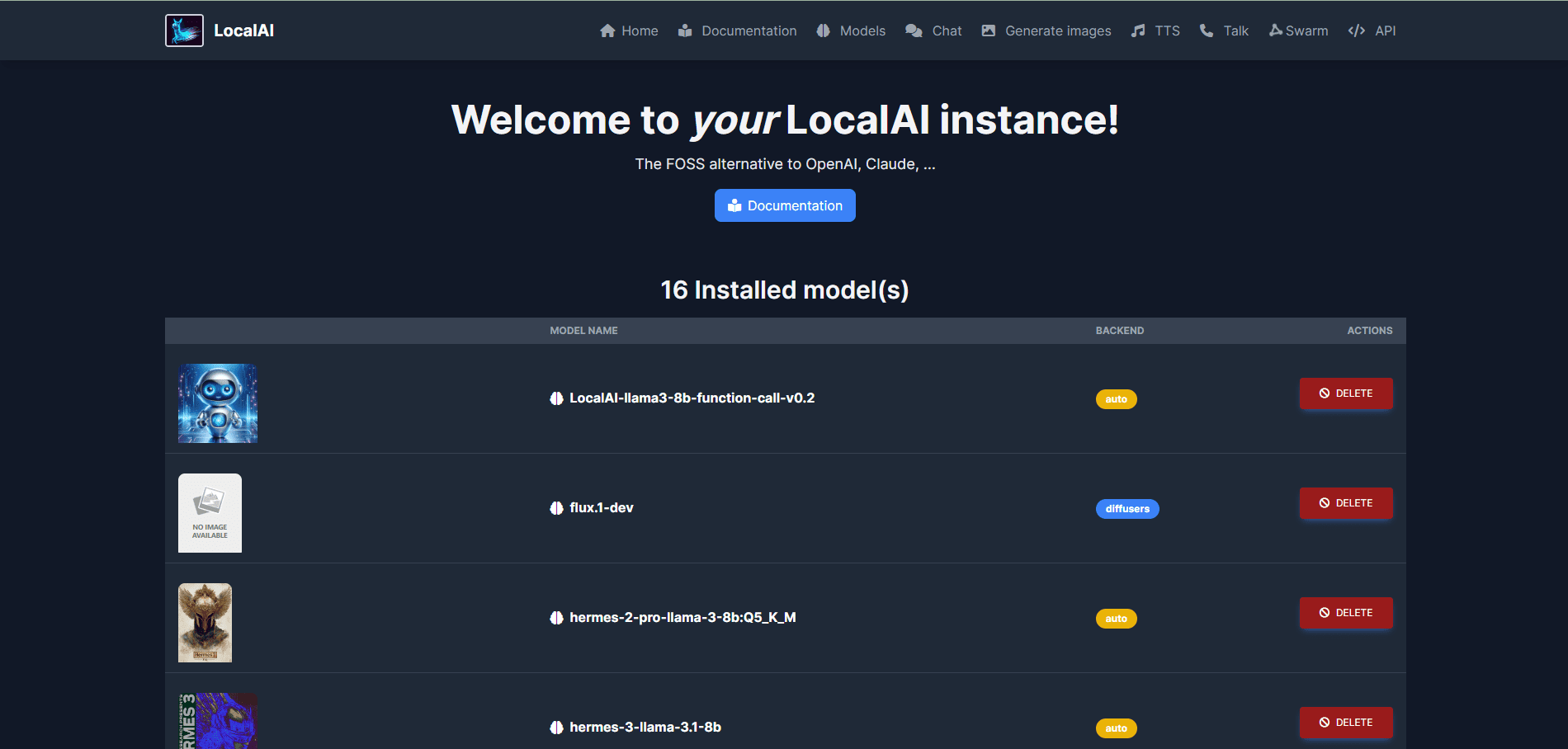

LocalAI: 오픈 소스 로컬 AI 배포 솔루션, 여러 모델 아키텍처 지원, 모델 및 API의 WebUI 통합 관리

일반 소개

LocalAI는 OpenAI, Claude 등과 호환되는 API 인터페이스를 제공하는 것을 목표로 하는 오픈 소스 로컬 AI 대안입니다. 소비자급 하드웨어에서 실행을 지원하고 GPU가 필요하지 않으며 텍스트, 오디오, 비디오, 이미지 생성 및 음성 복제와 같은 광범위한 작업을 수행할 수 있습니다. LocalAI는 Ettore Di Giacinto가 만들고 유지 관리하며 로컬 또는 온프레미스 배포를 위해 gguf, 트랜스포머, 디퓨저 등을 포함한 광범위한 모델 아키텍처를 지원합니다.

기능 목록

- 텍스트 생성: 고품질 텍스트 콘텐츠를 생성할 수 있는 GPT 시리즈 모델을 지원합니다.

- 오디오 생성: 텍스트 음성 변환 기능을 통해 자연스럽고 부드러운 음성을 생성합니다.

- 이미지 생성: 안정적인 확산 모델을 사용하여 고품질 이미지를 생성합니다.

- 음성 복제: 음성 복제 기술을 통해 원본 목소리와 유사한 음성을 생성합니다.

- 분산 추론: P2P 추론을 지원하여 모델 추론의 효율성을 향상시킵니다.

- 모델 다운로드: 허깅페이스와 같은 플랫폼에서 직접 모델을 다운로드하여 실행합니다.

- 통합 웹UI: 사용자 친화적인 작동을 위한 통합 웹 사용자 인터페이스를 제공합니다.

- 벡터 데이터베이스 임베딩 생성: 벡터 데이터베이스 임베딩 생성을 지원합니다.

- 제약 구문: 제약 구문으로 텍스트 콘텐츠를 생성하는 기능을 지원합니다.

- 비전 API: 이미지 처리 및 분석 기능을 제공합니다.

- 재정렬 API: 텍스트 콘텐츠의 재정렬 및 최적화를 지원합니다.

설치 프로세스

- 설치 스크립트 사용::

- 다음 명령을 실행하여 LocalAI를 다운로드하고 설치합니다:

curl -s https://localai.io/install.sh | sh

- 다음 명령을 실행하여 LocalAI를 다운로드하고 설치합니다:

- Docker 사용::

- GPU가 없는 경우 다음 명령을 실행하여 LocalAI를 시작합니다:

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest-aio-cpu - Nvidia GPU를 사용하는 경우 다음 명령을 실행합니다:

docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-aio-gpu-nvidia-cuda-12

- GPU가 없는 경우 다음 명령을 실행하여 LocalAI를 시작합니다:

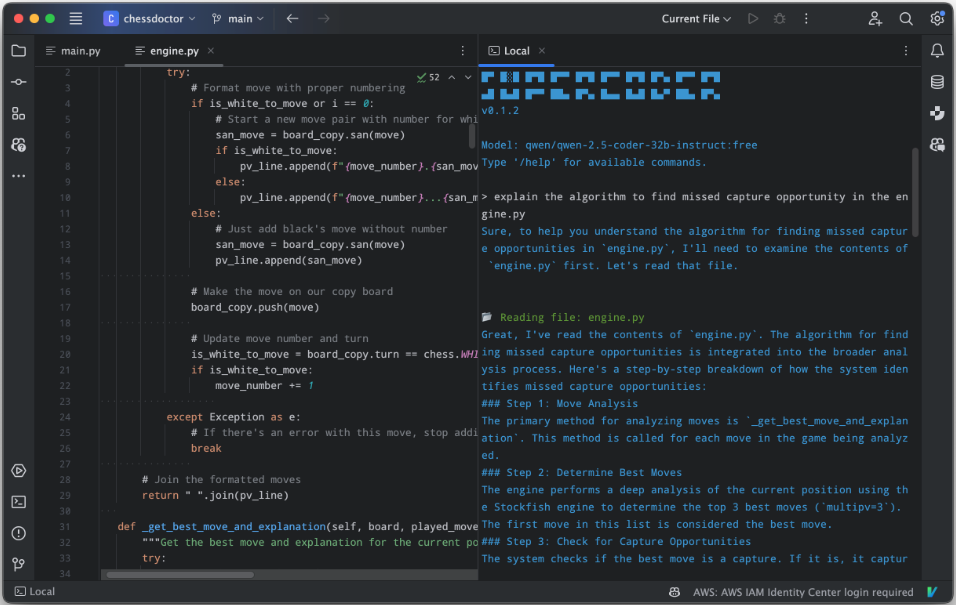

사용 프로세스

- LocalAI 시작::

- 위에서 설명한 설치 프로세스를 통해 LocalAI를 시작한 후, 로컬AI의

http://localhost:8080WebUI로 이동합니다.

- 위에서 설명한 설치 프로세스를 통해 LocalAI를 시작한 후, 로컬AI의

- 모델 로드::

- 웹UI에서 모델 탭으로 이동하여 원하는 모델을 선택하고 로드합니다.

- 또는 예를 들어 명령줄을 사용하여 모델을 로드합니다:

local-ai run llama-3.2-1b-instruct:q4_k_m

- 콘텐츠 생성::

- 웹UI에서 적절한 기능 모듈(예: 텍스트 생성, 이미지 생성 등)을 선택하고 필요한 매개변수를 입력한 후 생성 버튼을 클릭합니다.

- 예를 들어 텍스트를 생성하려면 프롬프트를 입력하고 모델을 선택한 다음 '텍스트 생성' 버튼을 클릭합니다.

- 분산 추론::

- 여러 개의 LocalAI 인스턴스를 구성하여 분산 P2P 추론을 달성하고 추론 효율성을 개선하세요.

- 공식 문서에서 분산 추론 구성 가이드를 참조하세요.

고급 기능

- 사용자 지정 모델::

- 사용자는 특정 요구 사항을 충족하기 위해 허깅페이스 또는 OCI 레지스트리에서 사용자 지정 모델을 다운로드하여 로드할 수 있습니다.

- API 통합::

- LocalAI는 개발자가 기존 애플리케이션에 쉽게 통합할 수 있도록 OpenAI API와 호환되는 REST API를 제공합니다.

- 자세한 API 사용법은 공식 API 설명서를 참조하세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...