일반 소개

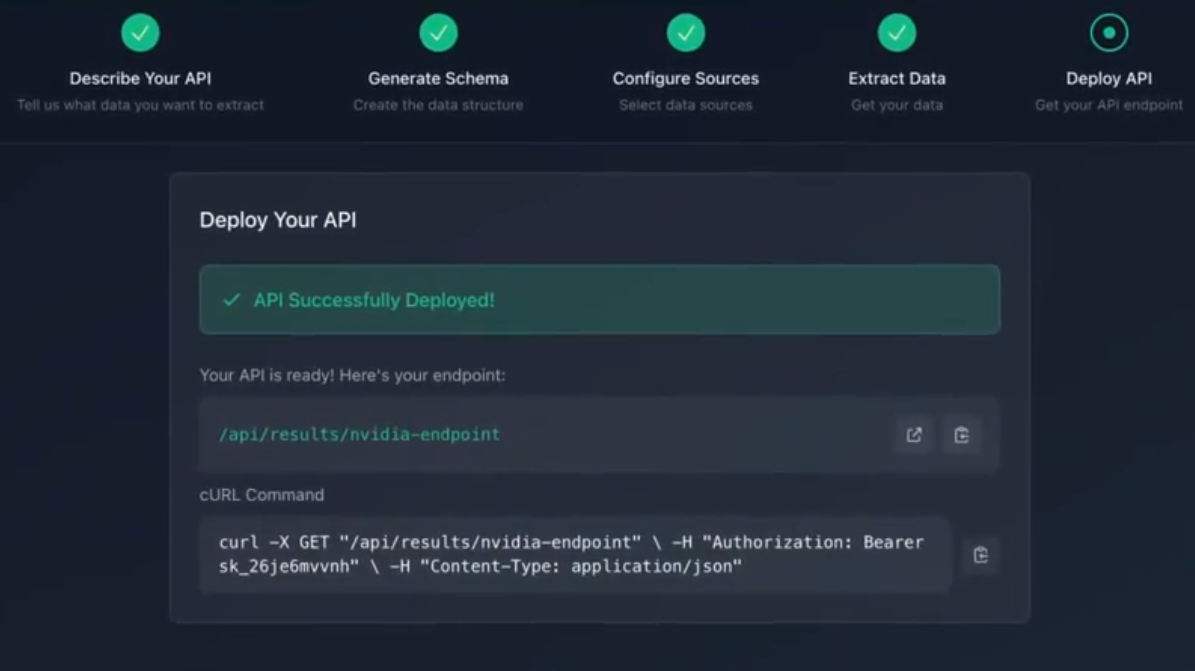

LLM API 엔진은 개발자가 AI 기반 API를 신속하게 구축하고 배포할 수 있도록 설계된 오픈 소스 프로젝트로, 대규모 언어 모델(LLM)과 지능형 웹 크롤링 기술을 활용하여 사용자가 자연어 설명을 통해 사용자 정의 API를 만들 수 있으며, 주요 기능으로는 자동 데이터 구조 생성, 실시간 데이터 업데이트, 구조화된 데이터 출력 및 유연한 배포 옵션이 있습니다. LLM API 엔진은 모듈식 아키텍처를 통해 Cloudflare Workers, Vercel Edge Functions, AWS Lambda와 같은 여러 플랫폼에 API 엔드포인트를 배포할 수 있도록 지원합니다.

기능 목록

- 텍스트를 API로 변환간단한 자연어 설명으로 API를 생성합니다.

- 자동 데이터 구조 생성OpenAI 기술을 사용하여 데이터 구조를 자동으로 생성합니다.

- 지능형 웹 크롤링파이어크롤 기술을 사용한 웹 페이지 데이터 크롤링.

- 실시간 데이터 업데이트시간 제한 크롤링 및 실시간 데이터 업데이트 지원.

- 즉시 API 배포API 엔드포인트의 신속한 배포.

- 구조화된 데이터 출력JSON 스키마를 통해 출력 데이터의 유효성을 검사합니다.

- 캐싱 및 스토리지 아키텍처캐싱 및 저장에 Redis를 사용합니다.

도움말 사용

설치 프로세스

- 클론 창고::

git clone https://github.com/developersdigest/llm-api-engine.git

cd llm-api-engine

- 종속성 설치::

npm install

- 환경 변수 파일 만들기: 프로젝트의 루트 디렉터리에 생성

.env파일을 열고 다음 변수를 추가합니다:

OPENAI_API_KEY=your_openai_key

FIRECRAWL_API_KEY=your_firecrawl_key

UPSTASH_REDIS_REST_URL=your_redis_url

UPSTASH_REDIS_REST_TOKEN=your_redis_token

NEXT_PUBLIC_API_ROUTE=http://localhost:3000

- 개발 서버 실행::

npm run dev

브라우저를 열어 액세스http://localhost:3000앱 보기.

기능 작동 흐름

- API 엔드포인트 만들기::

- 애플리케이션 홈페이지로 이동하여 '새 API 만들기' 버튼을 클릭합니다.

- API 이름과 설명을 입력하고 데이터 소스 유형(예: 웹 크롤링)을 선택합니다.

- 자연어를 사용하여 필요한 데이터 구조와 크롤링 규칙을 설명하세요.

- "API 생성" 버튼을 클릭하면 시스템이 자동으로 API 엔드포인트와 데이터 구조를 생성합니다.

- API 구성 및 관리::

- API 관리 화면에서 생성된 API 목록을 확인합니다.

- API를 클릭하면 API 구성을 편집하고, 크롤링 로그를 보고, API 엔드포인트를 테스트할 수 있는 세부정보 페이지로 이동합니다.

- 언제든지 변경 및 업데이트를 지원하는 Redis 스토리지 API를 사용하여 구성할 수 있습니다.

- API 엔드포인트 배포::

- 배포 플랫폼(예: Vercel, AWS Lambda 등)을 선택합니다.

- 플랫폼 요구 사항에 따라 배포 매개변수를 구성하고 '배포' 버튼을 클릭합니다.

- 배포가 완료되면 'API 관리' 화면에서 API 엔드포인트의 URL과 상태를 확인할 수 있습니다.

- API 엔드포인트 사용::

- 애플리케이션에서 API 엔드포인트를 호출하여 구조화된 데이터를 가져옵니다.

- JSON 형식의 데이터를 반환하는 HTTP 요청을 통해 API 엔드포인트에 대한 액세스를 지원합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 게시물

댓글 없음...