일반 소개

라이브토킹은 고품질 디지털 휴먼 라이브 솔루션을 구축하기 위한 오픈 소스 실시간 인터랙티브 디지털 휴먼 시스템입니다. 이 프로젝트는 Apache 2.0 오픈 소스 프로토콜을 사용하며 ER-NeRF 렌더링, 실시간 오디오 및 비디오 스트림 처리, 립 동기화 등 다양한 첨단 기술을 통합합니다. 이 시스템은 실시간 디지털 휴먼 렌더링 및 상호작용을 지원하며 라이브 방송, 온라인 교육, 고객 서비스 및 기타 여러 시나리오에 사용할 수 있습니다. 이 프로젝트는 깃허브에서 4300개 이상의 별과 600개 이상의 브랜치를 확보하여 강력한 커뮤니티 영향력을 보여주고 있으며, 라이브토킹은 실시간 성능과 대화형 경험에 특별한 주의를 기울이고 AIGC 기술을 통합하여 사용자에게 완벽한 디지털 휴먼 개발 프레임워크를 제공합니다. 이 프로젝트는 지속적으로 업데이트 및 유지 관리되며 포괄적인 문서로 지원되므로 디지털 휴먼 애플리케이션을 구축하는 데 이상적인 선택입니다.

기능 목록

- 여러 디지털 휴먼 모델이 지원됩니다:ernerf및musetalk및wav2lip및초경량-디지털-인간

- 오디오 및 비디오 대화 동시 진행

- 사운드 복제 지원

- 디지털에 찬성하는 사람들의 발언이 방해받는 경우

- 풀바디 동영상 접합 지원

- RTMP 및 WebRTC 푸시 스트림 지원

- 동영상 예약 지원: 말하지 않을 때 사용자 지정 동영상 재생

- 다중 동시성 지원

도움말 사용

1.설치 과정

- 환경 요구 사항 우분투 20.04, 파이썬 3.10, 파이토치 1.12, 쿠다 11.3

- 종속성 설치 ::

conda create -n nerfstream python=3.10

conda activate nerfstream

conda install pytorch==1.12.1 torchvision==0.13.1 cudatoolkit=11.3 -c pytorch

pip install -r requirements.txt

훈련하지 않는다면. ernerf 모델에서는 다음 라이브러리를 설치할 필요가 없습니다:

pip install "git+https://github.com/facebookresearch/pytorch3d.git"

pip install tensorflow-gpu==2.8.0

pip install --upgrade "protobuf<=3.20.1"

2. 빠른 시작

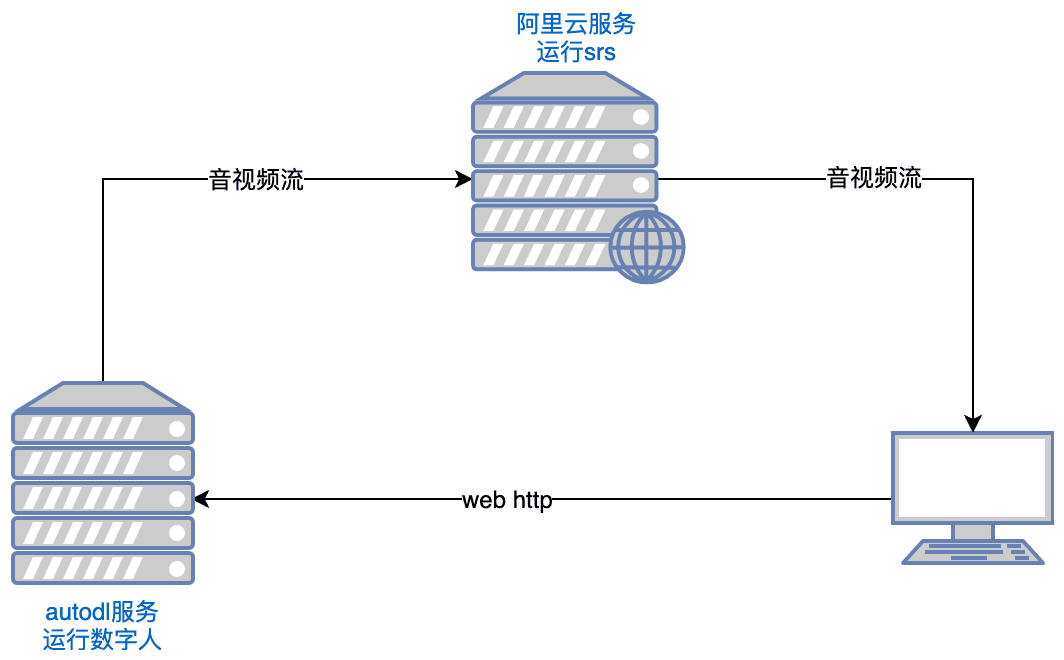

- SRS 실행 ::

export CANDIDATE='<服务器外网ip>'

docker run --rm --env CANDIDATE=$CANDIDATE -p 1935:1935 -p 8080:8080 -p 1985:1985 -p 8000:8000/udp registry.cn-hangzhou.aliyuncs.com/ossrs/srs:5 objs/srs -c conf/rtc.conf

참고: 서버는 포트 tcp:8000,8010,1985; uDP:8000을 열어야 합니다.

- 디지털 피플 출시 ::

python app.py

허깅페이스에 액세스할 수 없는 경우 실행하기 전에 실행하세요:

export HF_ENDPOINT=https://hf-mirror.com

브라우저로 열기 http://serverip:8010/rtcpushapi.html텍스트 상자에 텍스트를 입력한 후 제출하면 디지털 담당자가 해당 구절을 방송합니다.

자세한 사용 지침

- 도커 실행 이전 설치가 필요 없이 실행하기만 하면 됩니다:

docker run --gpus all -it --network=host --rm registry.cn-beijing.aliyuncs.com/codewithgpu2/lipku-metahuman-stream:vjo1Y6NJ3N

코드는 /root/metahuman-stream이전 git pull 최신 코드를 가져온 다음 2단계와 3단계에서와 같이 명령을 실행합니다.

- 미러링 ::

- autodl 이미지:오토들 튜토리얼

- ucloud 미러:ucloud 튜토리얼

- 일반적인 문제 Linux CUDA 환경 설정은 이 문서를 참조하세요:참조 문서

3. 구성 지침

- 시스템 구성

- config.yaml 파일을 편집하여 기본 매개변수를 설정합니다.

- 카메라 및 오디오 장치 구성

- AI 모델 매개변수 및 경로 설정

- 라이브 푸시 스트리밍 매개변수 구성

- 디지털 휴먼 모델 준비

- 사용자 지정 3D 모델 가져오기 지원

- 사전 구축된 예제 모델을 사용할 수 있습니다.

- 메타휴먼 모델 임포트 지원

주요 기능

- 실시간 오디오 및 비디오 동기식 대화::

- 디지타이저 모델 선택: 구성 페이지에서 적절한 디지타이저 모델(예: 에르너프, 뮤즈톡 등)을 선택합니다.

- 오디오/비디오 전송 방법 선택: 요구사항에 따라 적절한 오디오/비디오 전송 방법(예: WebRTC, RTMP 등)을 선택합니다.

- 대화 시작: 오디오/비디오 전송을 시작하여 실시간 오디오/비디오 동기식 대화를 할 수 있습니다.

- 디지털 휴먼 모델 전환::

- 설정 페이지로 들어가기: 프로젝트 실행 페이지에서 설정 버튼을 클릭하여 설정 페이지로 들어갑니다.

- 새 모델 선택: 설정 페이지에서 새 디지몬 모델을 선택하고 설정을 저장합니다.

- 프로젝트 다시 시작: 프로젝트를 다시 시작하여 새 모델 구성을 적용합니다.

- 오디오 및 비디오 매개변수 조정::

- 매개변수 설정 페이지로 들어가기: 프로젝트 실행 페이지에서 매개변수 설정 버튼을 클릭하여 매개변수 설정 페이지로 들어갑니다.

- 조정 매개변수: 필요에 따라 오디오 및 동영상 매개변수(예: 해상도, 프레임 속도 등)를 조정합니다.

- 저장 및 적용: 설정을 저장하고 새 매개변수 구성을 적용합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...