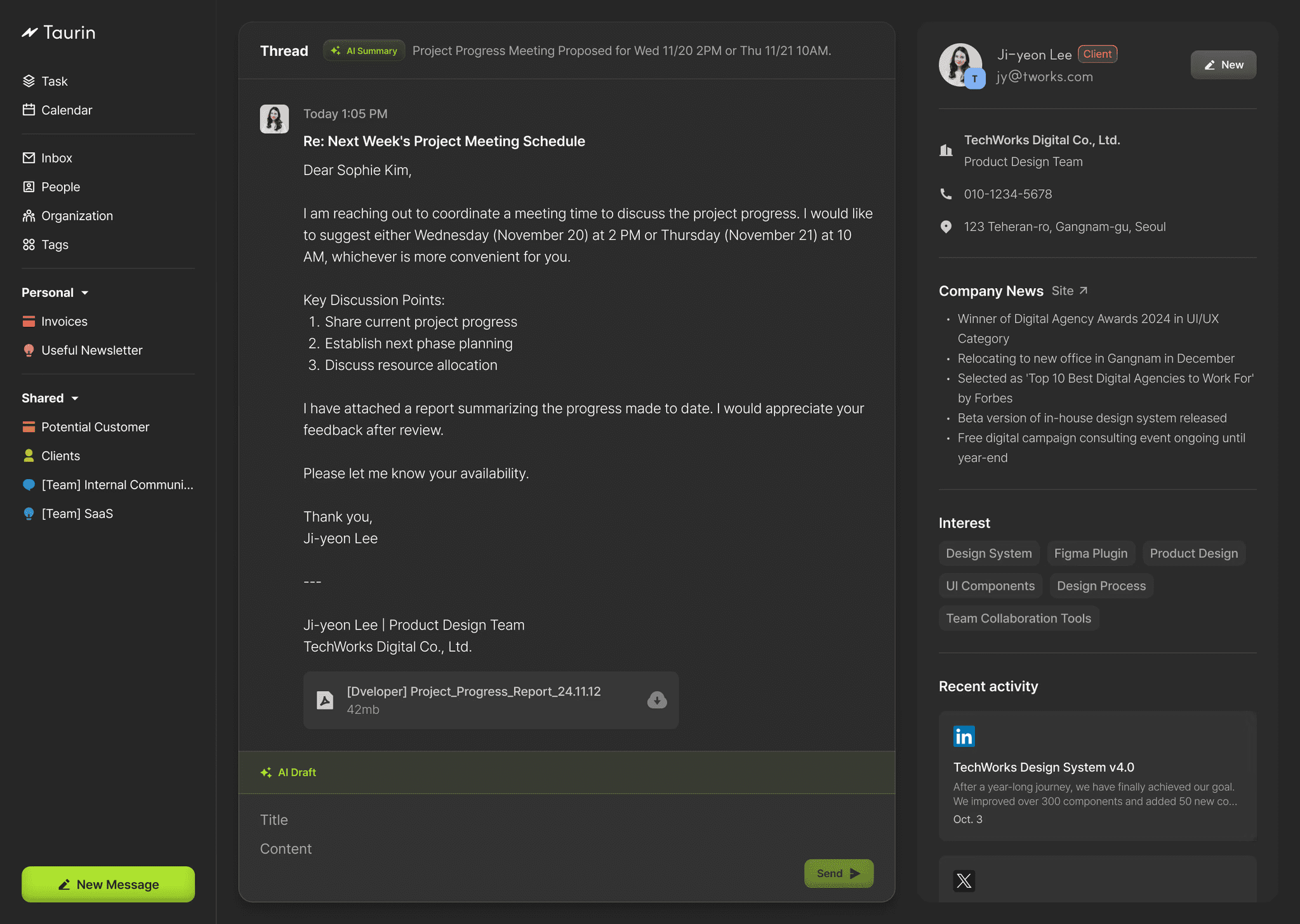

일반 소개

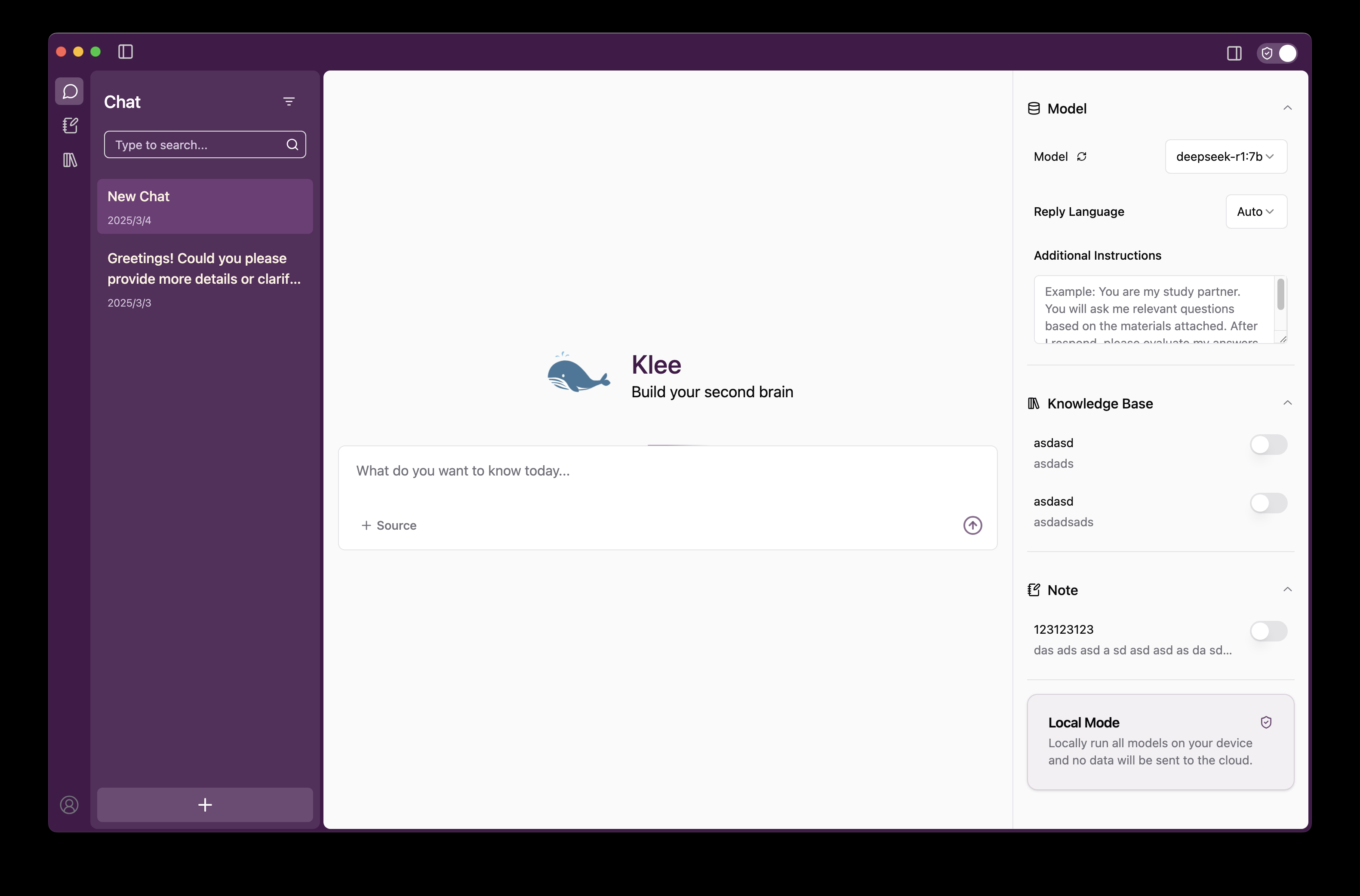

Klee는 사용자가 안전한 비공개 지식 베이스 관리와 마크다운 노트 필기 기능을 통해 로컬에서 오픈 소스 LLM(대규모 언어 모델)을 실행할 수 있도록 설계된 오픈 소스 데스크톱 애플리케이션입니다. 다음을 기반으로 합니다. Ollama 라마인덱스 기술로 구축된 Klee는 사용자가 간단한 조작으로 AI 모델을 다운로드하고 실행할 수 있으며, 인터넷에 연결하거나 클라우드에 업로드할 필요 없이 모든 데이터 처리가 로컬에서 이루어지므로 개인정보 보호와 보안이 보장됩니다. Klee는 Windows, MacOS, Linux를 위한 직관적인 사용자 인터페이스를 제공하여 기술 개발자와 일반 사용자 모두 쉽게 텍스트를 생성하고, 문서를 분석하고, 지식을 정리할 수 있습니다. Klee는 현재 GitHub에서 오픈 소스로 제공되고 있으며, 사용자가 자유롭게 다운로드하고 커스터마이징하거나 개발에 참여할 수 있어 커뮤니티에서 호평을 받고 있습니다.

기능 목록

- 한 번의 클릭으로 대규모 언어 모델 다운로드 및 실행환경을 수동으로 구성할 필요 없이 인터페이스를 통해 Ollama에서 직접 오픈 소스 LLM을 다운로드하고 실행할 수 있습니다.

- 로컬 지식창고 관리파일 및 폴더를 업로드하여 비공개 지식 색인을 만들고 AI가 이를 조회할 수 있도록 지원하는 기능입니다.

- 마크다운 노트 생성AI 대화 또는 분석 결과를 마크다운 형식으로 자동 저장하여 문서화 및 편집이 용이합니다.

- 완전 오프라인 사용인터넷 연결이 필요하지 않으며, 모든 기능이 로컬에서 실행되고 사용자 데이터가 수집되지 않습니다.

- 크로스 플랫폼 지원일관된 환경을 위해 Windows, MacOS 및 Linux 시스템과 호환됩니다.

- 오픈 소스 및 사용자 지정 가능사용자가 기능을 수정하거나 커뮤니티 기여에 참여할 수 있도록 전체 소스 코드가 제공됩니다.

도움말 사용

설치 프로세스

Klee의 설치는 클라이언트(klee-client)와 서버(klee-service)의 두 부분으로 나뉘며, 세부 단계는 다음과 같습니다:

1. 시스템 요구 사항

- 운영 체제Windows 7+, macOS 15.0+ 또는 Linux.

- 소프트웨어 종속성::

- Node.js 20.x 이상.

- Yarn 1.22.19 이상.

- Python 3.x(서버 측 필수, 3.12 이상 권장).

- Git(리포지토리 복제용).

- 하드웨어 요구 사항최소 8GB RAM, 더 큰 모델을 실행하려면 16GB 이상을 권장합니다.

2. 클라이언트(klee-client)를 설치합니다.

- 클라이언트 리포지토리 복제::

터미널에서 실행됩니다:

git clone https://github.com/signerlabs/klee-client.git

cd klee-client

- 종속성 설치::

yarn install

- 환경 변수 구성::

- 예제 파일을 복사합니다:

cp .env.example .env - 컴파일러

.env파일의 기본 구성은 다음과 같습니다:VITE_USE_SUPABASE=false VITE_OLLAMA_BASE_URL=http://localhost:11434 VITE_REQUEST_PREFIX_URL=http://localhost:6190서버 포트나 주소가 다른 경우에는

VITE_REQUEST_PREFIX_URL.

- 개발 모드 작동::

yarn dev

그러면 Vite 개발 서버와 일렉트론 애플리케이션이 시작됩니다.

5. 패키징 애플리케이션(선택 사항)::

yarn build

패키지 파일은 다음 위치에 있습니다. dist 카탈로그.

6. MacOS 서명(선택 사항)::

- 컴파일러

.envApple ID와 팀 정보를 추가합니다:APPLEID=your_apple_id@example.com APPLEIDPASS=your_password APPLETEAMID=your_team_id - 움직여야 합니다.

yarn build그런 다음 서명된 애플리케이션을 생성할 수 있습니다.

3. 서버 설치(klee-service)

- 서버 측 리포지토리 복제::

git clone https://github.com/signerlabs/klee-service.git

cd klee-service

- 가상 환경 만들기::

- Windows:

python -m venv venv venv\Scripts\activate - MacOS/Linux:

python3 -m venv venv source venv/bin/activate

- 종속성 설치::

pip install -r requirements.txt

- 서비스 시작::

python main.py

기본 포트는 6190이며 변경이 필요한 경우 변경할 수 있습니다:

python main.py --port 自定义端口号

서비스를 시작한 후에도 계속 실행해야 합니다.

4. 미리 컴파일된 버전 다운로드(선택 사항)

- 인터뷰 GitHub 릴리스시스템에 맞는 설치 패키지를 다운로드하세요.

- 수동으로 빌드할 필요 없이 압축을 풀고 바로 실행하세요.

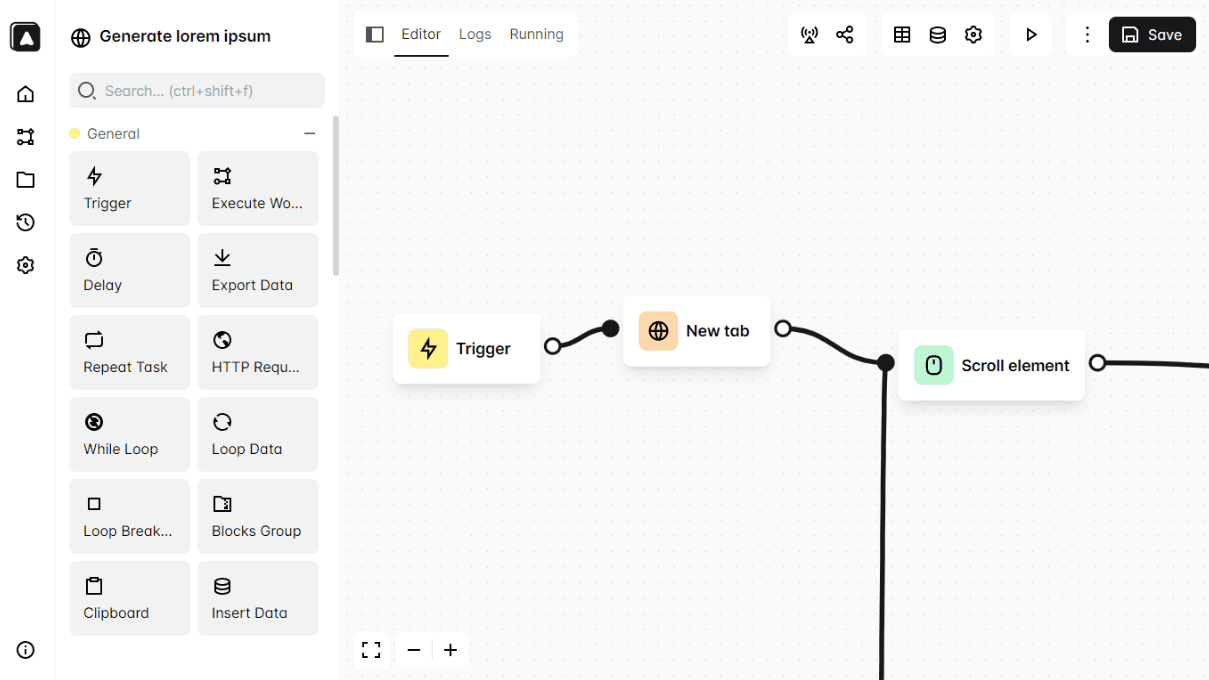

주요 기능

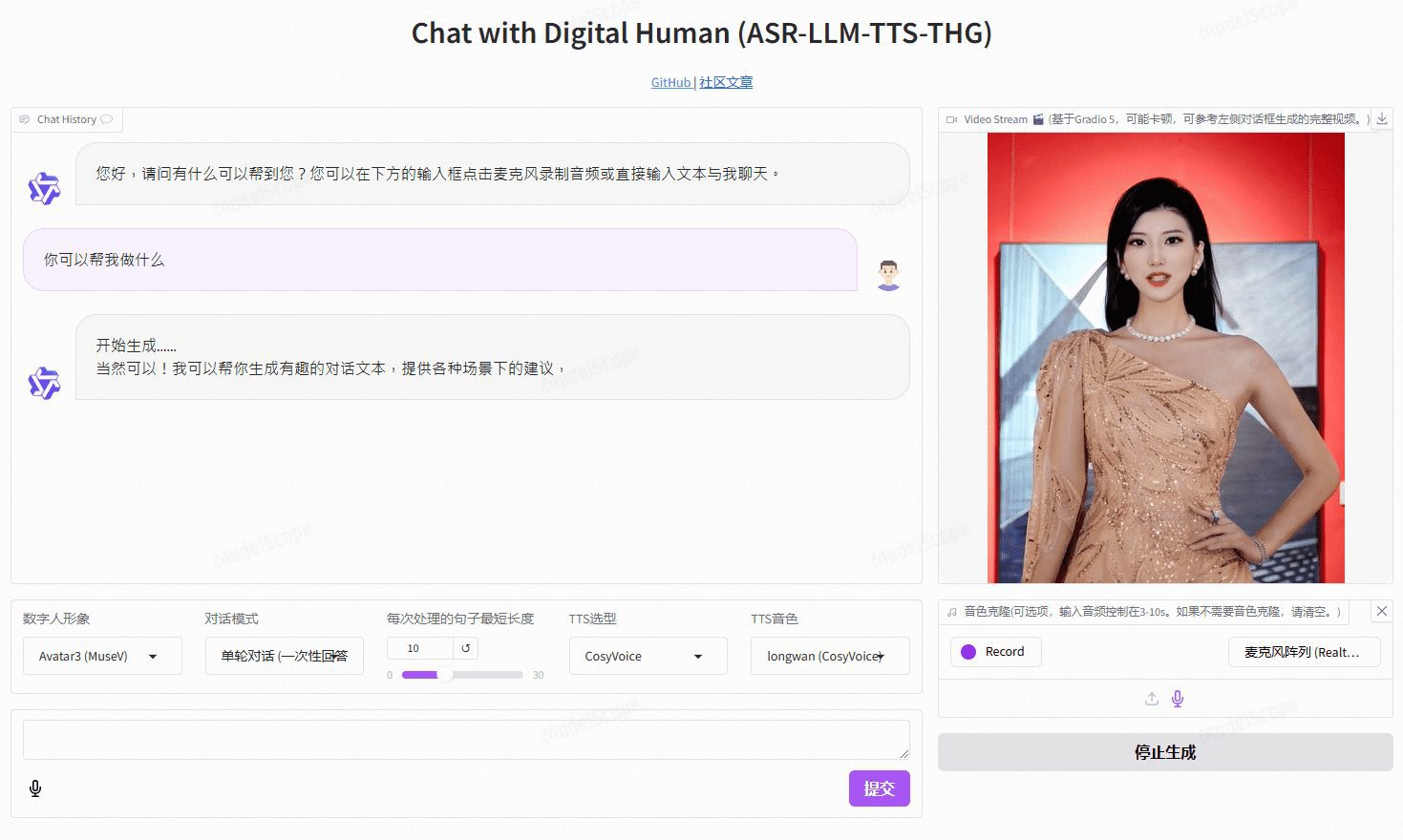

클릭 한 번으로 대규모 언어 모델 실행

- 애플리케이션 실행::

- 서버가 실행 중인지 확인하고 클라이언트 애플리케이션을 엽니다.

- 모델 다운로드::

- 인터페이스에서 Ollama 지원 모델(예: LLaMA, Mistral)을 선택합니다.

- "다운로드" 버튼을 클릭하면 Klee가 자동으로 모델을 로컬로 다운로드합니다.

- 운영 모델::

- 다운로드가 완료되면 '실행'을 클릭하여 모델을 메모리에 로드합니다.

- 대화 상자에 질문이나 명령을 입력하고 '보내기'를 클릭하면 응답을 받을 수 있습니다.

- 주의::

- 모델을 처음 로드하는 데는 모델 크기와 하드웨어 성능에 따라 몇 분 정도 걸릴 수 있습니다.

- 응답이 없는 경우 서버가 실행되고 있는지 확인합니다.

http://localhost:6190.

로컬 지식창고 관리

- 파일 업로드::

- 인터페이스에서 '지식' 옵션을 클릭합니다.

- 드래그 앤 드롭 또는 수동 파일/폴더 선택 지원(PDF, TXT 등 지원).

- 색인 구축::

- 업로드 후 LlamaIndex는 자동으로 파일에 대한 색인을 생성합니다.

- 색인화가 완료되면 AI가 문서 내용을 검색할 수 있습니다.

- 지식창고 쿼리하기::

- 대화 화면에서 '지식창고 사용'을 선택하고 질문을 입력합니다.

- AI가 지식창고 콘텐츠와 함께 답변을 생성합니다.

- 지식창고 관리하기::

- 지식 화면에서 파일을 삭제하거나 업데이트할 수 있습니다.

마크다운 노트 생성

- 노트 저장::

- AI가 응답하면 "노트로 저장" 버튼을 클릭합니다.

- 시스템은 자동으로 콘텐츠를 마크다운 형식으로 저장합니다.

- 관리 참고 사항::

- 노트 화면에서 모든 노트를 봅니다.

- 편집, 내보내기(.md 파일로 저장) 또는 삭제를 지원합니다.

- 사용 시나리오::

- AI 분석 결과, 연구 노트 또는 작업 요약을 기록하는 데 이상적입니다.

주요 기능

완전 오프라인 사용

- 작동 방법::

- 설치가 완료되면 네트워크 없이도 모든 기능이 작동합니다.

- 모델을 다운로드하고 인터넷 연결을 끊어도 여전히 정상적으로 작동합니다.

- 데이터 보안::

- Klee는 어떠한 사용자 데이터도 수집하지 않으며 모든 파일과 대화는 로컬에만 저장됩니다.

- 로그는 디버깅 목적으로만 사용되며 외부 서버에 업로드되지 않습니다.

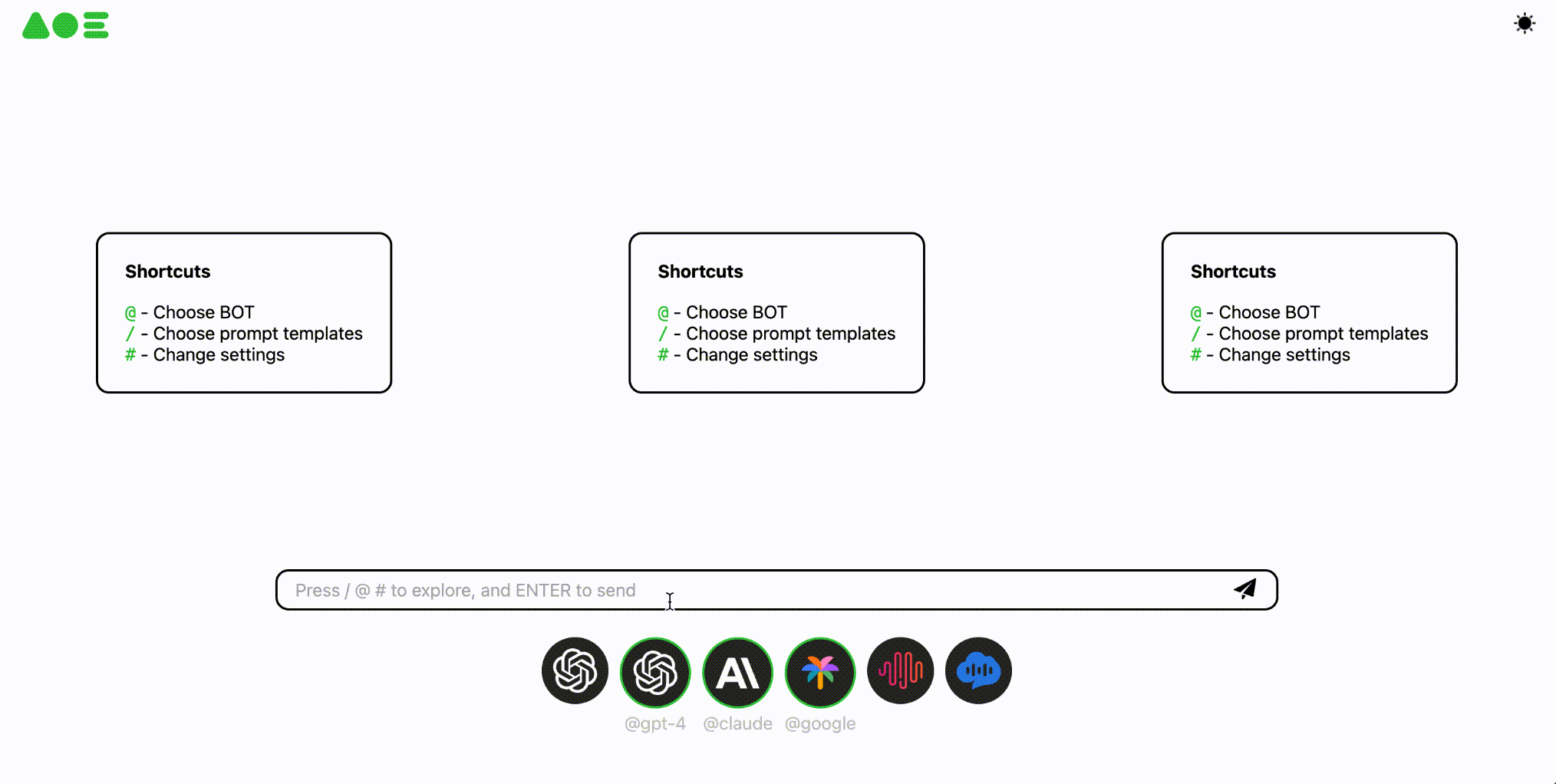

오픈 소스 및 커뮤니티 기여

- 소스 코드 가져오기::

- 인터뷰 GitHub 리포지토리를 클릭하고 코드를 다운로드합니다.

- 기여 방식::

- 풀 리퀘스트를 제출하여 기능을 추가하거나 버그를 수정하세요.

- GitHub 이슈 토론에 참여하여 문서를 최적화하거나 애플리케이션을 홍보하세요.

- 사용자 지정 방법::

- 다른 모델이나 API를 지원하도록 서버 측을 수정합니다.

- 클라이언트 인터페이스 조정, 다음 사항을 숙지해야 합니다. React 및 전자.

사용 권장 사항

- 성능 최적화대용량 모델(예: 13B 매개변수)을 실행하는 경우 16GB 이상의 RAM 또는 GPU 가속을 권장합니다.

- 모델 선택: 처음으로 테스트를 위해 더 작은 모델(예: 7B 매개변수)을 선택할 수 있습니다.

- 질문 피드백또는 불화 도움을 요청하세요.

이러한 단계를 통해 사용자는 Klee를 빠르게 설치 및 사용하여 현지화된 AI의 편리함을 누릴 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...