일반 소개

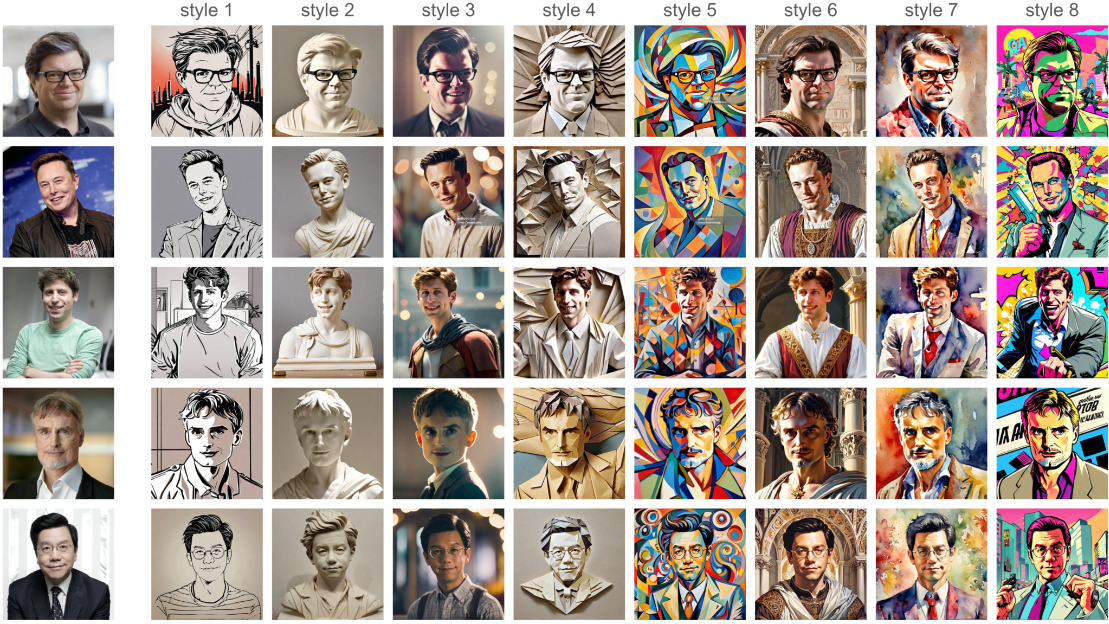

InstantID는 하나의 참조 ID 사진을 사용하여 몇 초 만에 개인화된 스타일이나 포즈를 가진 이미지를 생성하는 동시에 높은 수준의 충실도를 보장하는 데 중점을 둔 최첨단 기술입니다. 이 기술은 얼굴 이미지, 랜드마크 이미지, 텍스트 단서를 통합하여 이미지 생성 프로세스를 정확하게 안내하는 확산 모델 기반 솔루션을 사용합니다. 주요 특징으로는 고충실도 이미지 생성, 광범위한 미세 조정이나 여러 참조 이미지 없이 사용할 수 있는 사전 학습된 인기 있는 텍스트-이미지 확산 모델과의 호환성, 높은 얼굴 충실도 및 텍스트 편집 기능 등이 있습니다.

InstantID는 조정이 필요 없는 새로운 최첨단 방법으로 단일 이미지에서 아바타 기능 ID를 생성하여 다양한 다운스트림 작업을 지원합니다. 한 장의 사진에서 얼굴을 복제하고 단서 단어를 사용하여 동일한 얼굴의 다양한 스타일 이미지를 생성할 수 있습니다.

기능 목록

- 샘플 신원 유지 생성: 여러 개의 이미지가 필요 없이 하나의 앞면 이미지만으로 여러 스타일의 인물 사진을 생성할 수 있습니다.

- 충실도 높은 생성: 생성된 결과물은 충실도가 높고 원본 이미지의 아이덴티티 특징을 잘 보존할 수 있습니다.

- 여러 다운스트림 작업 지원: 스타일 마이그레이션, 이미지 편집 등과 같은 여러 다운스트림 작업을 지원합니다.

- 오픈 소스 코드 및 모델: 오픈 소스 코드와 사전 학습된 모델이 제공되므로 쉽게 다운로드하여 사용할 수 있습니다.

- 강력한 호환성: 인스턴트스타일과 같은 다른 프로젝트와의 통합을 지원하고 색상 호환되는 용도로 사용할 수 있습니다.

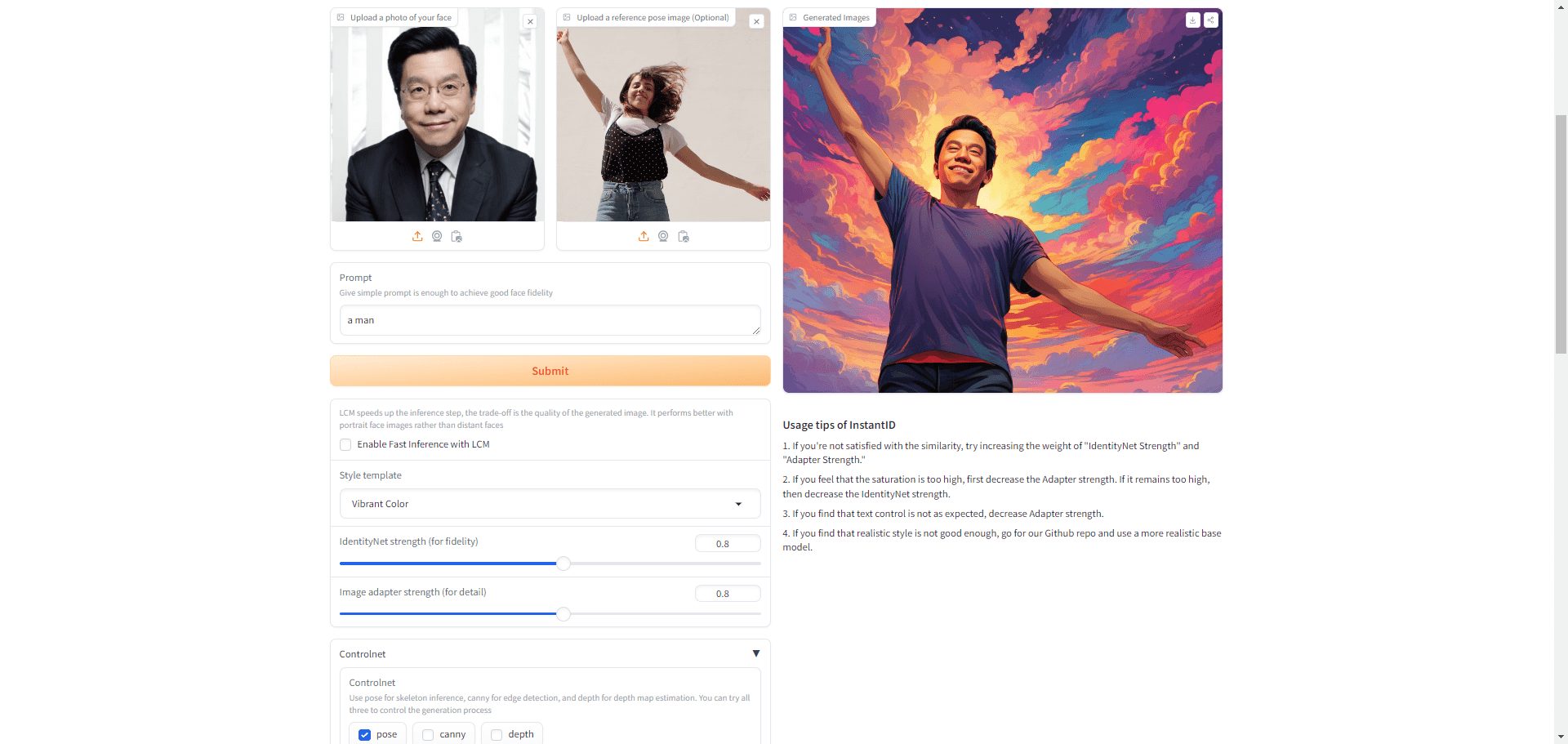

도움말 사용

사람 이미지를 업로드합니다. 여러 명의 사람 이미지의 경우 가장 큰 얼굴만 감지합니다. 얼굴이 너무 작지 않고 눈에 띄게 가려지거나 흐려지지 않았는지 확인하세요.

(선택 사항) 다른 인물 이미지를 참조 포즈로 업로드합니다. 업로드하지 않으면 첫 번째 인물 이미지를 사용하여 랜드마크를 추출합니다. 1단계에서 잘린 얼굴을 사용했다면 새 포즈를 추출할 때 업로드하는 것이 좋습니다.

일반 텍스트 이미지 모델과 마찬가지로 텍스트 프롬프트를 입력합니다.

제출 버튼을 클릭하여 사용자 지정을 시작합니다.

사용자는 하나의 참조용 신분증 사진을 제공해야 합니다.

개인화된 이미지 생성을 위해 다양한 스타일과 포즈를 선택할 수 있습니다.

테스트 중에 미세 조정하거나 미세 조정을 위해 여러 이미지를 수집할 필요가 없습니다.

생성된 이미지는 사전 학습된 인기 모델 및 제어 네트워크와의 융합에 바로 사용할 수 있습니다.

사람이 아닌 역할에 ID 속성을 유연하게 추가할 수 있도록 지원

설치 프로세스

- GitHub 리포지토리를 복제합니다:

git clone https://github.com/instantX-research/InstantID.git cd InstantID - 종속성을 설치합니다:

pip install -r requirements.txt - 사전 학습된 모델을 다운로드하세요:

from huggingface_hub import hf_hub_download hf_hub_download(repo_id="InstantX/InstantID", filename="ControlNetModel/config.json", local_dir="./checkpoints") hf_hub_download(repo_id="InstantX/InstantID", filename="ControlNetModel/diffusion_pytorch_model.safetensors", local_dir="./checkpoints") hf_hub_download(repo_id="InstantX/InstantID", filename="ip-adapter.bin", local_dir="./checkpoints")

사용 프로세스

- 이미지를 준비합니다:

from diffusers.utils import load_image image = load_image("your-example.jpg") - 모델 로드:

from diffusers import StableDiffusionXLInstantIDPipeline, ControlNetModel controlnet = ControlNetModel.from_pretrained("./checkpoints/ControlNetModel", torch_dtype=torch.float16) pipe = StableDiffusionXLInstantIDPipeline.from_pretrained("stabilityai/stable-diffusion-xl-base-1.0", controlnet=controlnet, torch_dtype=torch.float16) pipe.cuda() pipe.load_ip_adapter_instantid("./checkpoints/ip-adapter.bin") - 이미지를 생성합니다:

prompt = "analog film photo of a man. faded film, desaturated, 35mm photo, grainy, vignette, vintage, Kodachrome, Lomography, stained, highly detailed, found footage, masterpiece, best quality" negative_prompt = "(lowres, low quality, worst quality:1.2), (text:1.2), watermark, painting, drawing, illustration, glitch, deformed, mutated, cross-eyed, ugly, disfigured" image = pipe(prompt, image_embeds=face_emb, image=face_kps, controlnet_conditioning_scale=0.8).images[0]

세부 운영 절차

- 환경 준비하기필요한 종속성이 설치되어 있고 사전 학습된 모델이 다운로드되었는지 확인합니다.

- 이미지 로드사용

load_image함수는 처리할 이미지를 로드합니다. - 모델 로드사용

from_pretrained메서드는 사전 학습된 ControlNet 모델과 StableDiffusionXLInstantIDPipeline을 로드합니다. - 이미지 생성: 생성된 이미지에 대한 큐워드와 네거티브 큐워드를 설정하려면

pipe메서드를 사용하여 이미지를 생성합니다.

다음 단계에 따라 사용자는 InstantID를 사용하여 충실도가 높은 신원 보존 이미지를 쉽게 생성할 수 있습니다.

ComfyUI 구현 프로그램

SDXL 베이스 독을 선택합니다. 빠른 테스트에 매우 효과적인 SDXL Turbo의 4단계 프로세스를 사용해 볼 수도 있습니다.

첫 번째 로드는 일반적으로 60초 이상 걸리지만 노드는 모델을 캐시하기 위해 최선을 다합니다.

https://github.com/huxiuhan/ComfyUI-InstantID

InstantID 경험 주소

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...