glhf.chat: 거의 모든 오픈 소스 빅 모델 실행, GPU 리소스 및 API 서비스 무료 액세스(베타 기간)

일반 소개

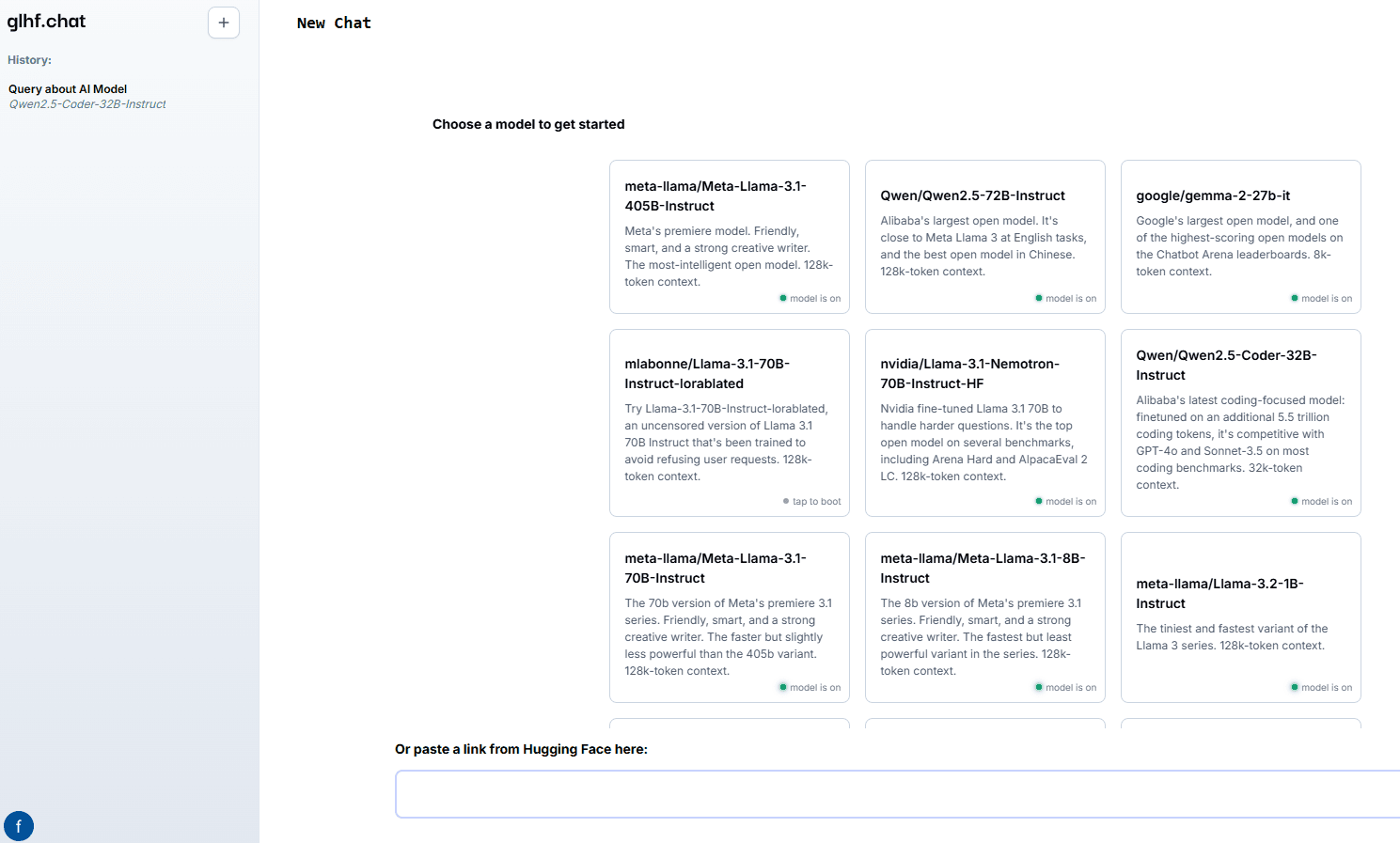

굿 럭 해브 펀(glhf.chat)은 오픈 소스 빅 모델 채팅 서비스를 제공하는 웹사이트입니다. 이 플랫폼을 통해 사용자는 vLLM과 커스텀 자동 스케일링 GPU 스케줄러를 사용하여 거의 모든 오픈 소스 빅 모델을 실행할 수 있습니다. 사용자는 허깅 페이스 리포지토리에 링크를 붙여넣기만 하면 채팅 인터페이스 또는 OpenAI 호환 API를 사용하여 상호 작용할 수 있습니다. 이 플랫폼은 베타 기간 동안 무료로 제공되며, 향후 주요 클라우드 GPU 제공업체보다 저렴한 가격으로 제공될 예정입니다.

기능 목록

- 메타 라마, 퀀, 믹스트랄 등 다양한 오픈 소스 매크로 모델을 지원합니다.

- 최대 8개의 Nvidia A100 80Gb GPU에 대한 액세스 제공

- 자동화된 상담원 모집단 모델을 위한 추론 서비스

- 리소스 사용 최적화를 위한 온디맨드 클러스터 시작 및 종료

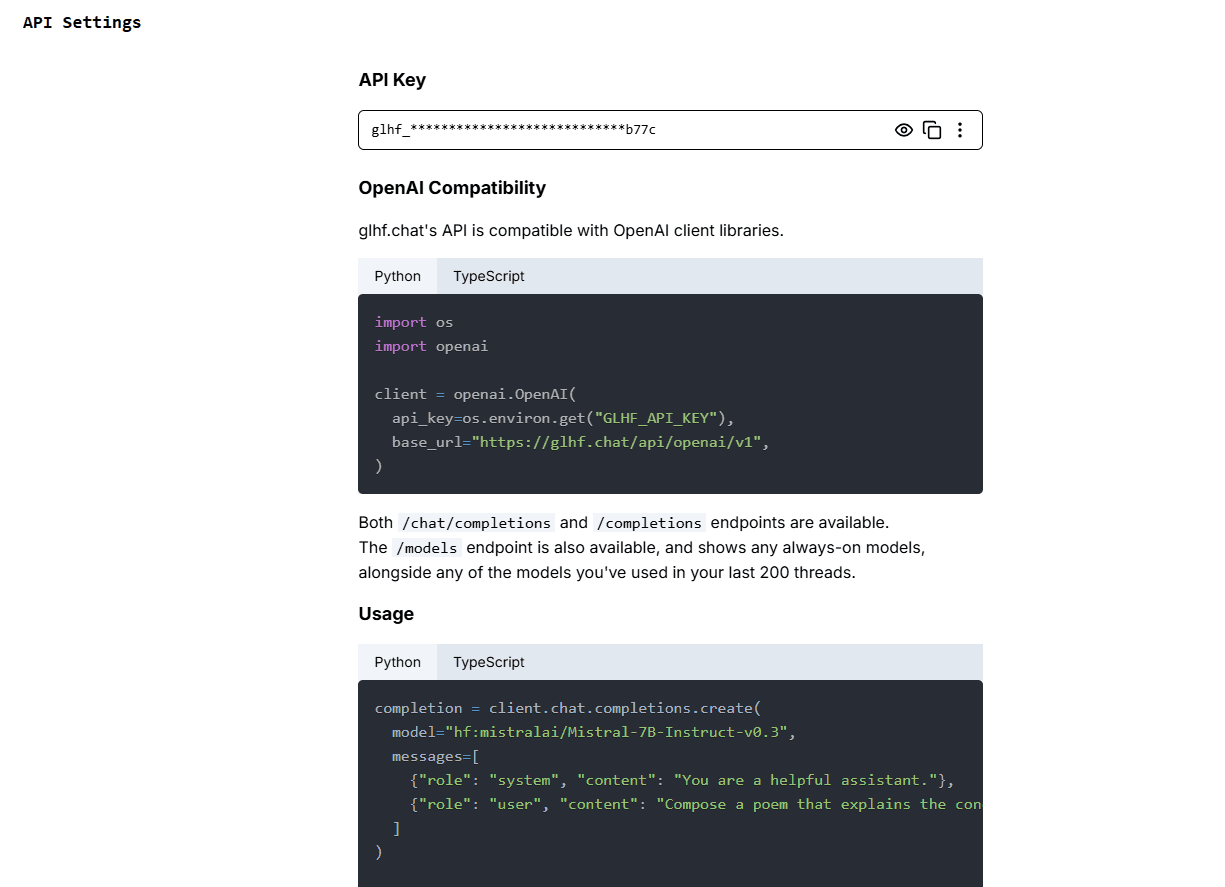

- 손쉬운 통합을 위한 OpenAI 호환 API 제공

도움말 사용

설치 및 사용

- 등록 및 로그인액세스glhf.chat를 클릭하고 계정을 등록한 후 완료되면 로그인하세요.

- 모델 선택플랫폼 홈페이지에서 원하는 매크로 모델을 선택합니다. 지원되는 모델에는 메타 라마, 퀀, 믹스트랄 등이 있습니다.

- 링크 붙여넣기허깅 페이스 리포지토리 링크를 지정된 위치에 붙여넣으면 플랫폼이 자동으로 모델을 로드합니다.

- 채팅 인터페이스 사용하기웹사이트에 제공되는 채팅 인터페이스를 통해 모델과 상호작용하며 질문이나 명령을 입력하면 모델이 실시간으로 답변을 생성합니다.

- API 통합웹사이트 도움말 센터의 API 설명서에 자세히 설명된 대로 OpenAI 호환 API를 사용하여 플랫폼의 기능을 자체 애플리케이션에 통합하세요.

세부 기능 작동 흐름

- 모델 선택 및 로드::

- 로그인하면 모델 선택 페이지로 이동합니다.

- 지원되는 모델 목록을 찾아보고 원하는 모델을 클릭합니다.

- 팝업 대화 상자에 포옹하는 얼굴 저장소 링크를 붙여넣고 '모델 로드' 버튼을 클릭합니다.

- 모델 로딩이 완료될 때까지 기다립니다. 로딩 시간은 모델 크기와 네트워크 상태에 따라 다릅니다.

- 채팅 인터페이스 사용::

- 모델이 로드되면 채팅 화면으로 들어갑니다.

- 입력란에 질문이나 지침을 입력하고 보내기를 클릭합니다.

- 모델은 입력에 따라 답글을 생성하고 답글이 채팅 창에 표시됩니다.

- 여러 개의 질문이나 명령을 연속해서 입력하면 모델이 이를 하나씩 처리하여 응답합니다.

- API 사용::

- API 키와 지침은 API 문서 페이지를 참조하세요.

- 애플리케이션에 API를 통합하고 문서에 제공된 샘플 코드를 따라 호출을 수행하세요.

- API를 통해 요청을 보내면 모델에서 생성된 응답을 받을 수 있습니다.

- API는 다양한 프로그래밍 언어를 지원하며, 구체적인 샘플 코드는 설명서를 참조하세요.

리소스 관리 및 최적화

- 자동 확장이 플랫폼은 사용자 수요에 따라 GPU 리소스를 자동으로 확장 및 축소하여 효율적인 활용을 보장하는 맞춤형 GPU 스케줄러를 사용합니다.

- 온디맨드 활성화일반적으로 사용되지 않는 모델의 경우, 플랫폼은 필요에 따라 클러스터를 시작하고 사용 시 자동으로 클러스터를 종료하여 리소스를 절약합니다.

- 무료 테스트베타 테스트 기간 동안 사용자는 플랫폼에서 제공하는 모든 기능을 무료로 이용할 수 있으며, 테스트가 종료되면 할인된 요금제를 이용할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...