일반 소개

FunASR은 알리바바의 달마 연구소에서 학술 연구와 산업 응용 분야를 연결하기 위해 개발한 오픈 소스 음성 인식 툴킷입니다. 음성 인식(ASR), 음성 엔드포인트 감지(VAD), 구두점 복구, 언어 모델링, 화자 확인, 화자 분리, 다자간 대화 음성 인식 등 다양한 음성 인식 기능을 지원하며, FunASR은 사전 학습된 모델의 추론 및 미세 조정을 지원하는 편리한 스크립트와 자습서를 제공하여 사용자가 효율적인 음성 인식 서비스를 빠르게 구축할 수 있도록 도와줍니다.

다양한 오디오 및 비디오 형식 입력 지원, 수십 시간의 긴 오디오 및 비디오를 구두점이 있는 텍스트로 식별 가능, 수백 개의 동시 전사 요청 지원 중국어, 영어, 일본어, 광동어 및 한국어를 지원합니다.

온라인 체험: https://www.funasr.com/

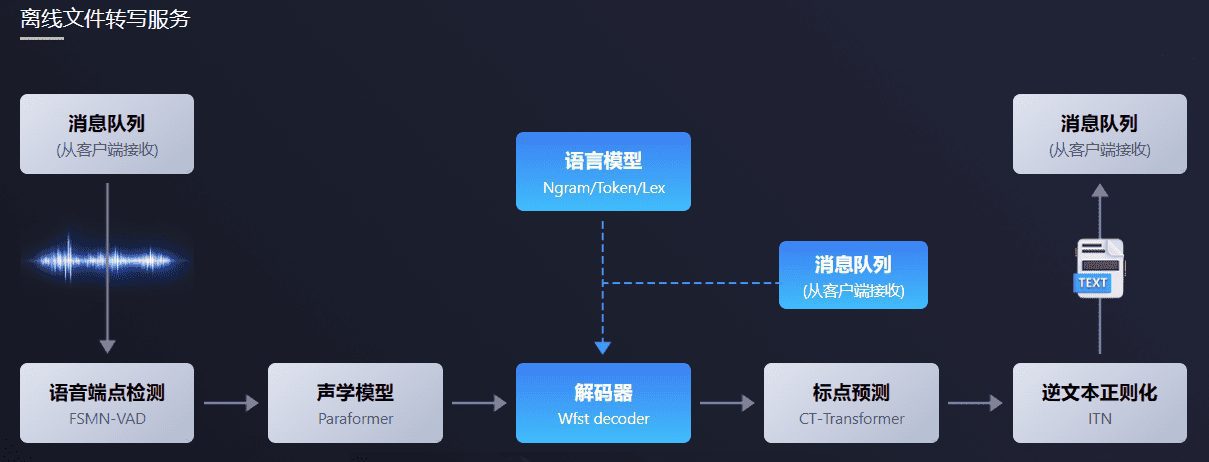

FunASR 오프라인 파일 전사 소프트웨어 패키지는 강력한 음성 오프라인 파일 전사 서비스를 제공합니다. 음성 엔드포인트 감지, 음성 인식, 구두점 및 기타 모델을 결합한 완벽한 음성 인식 링크를 통해 수십 시간의 긴 오디오 및 비디오를 구두점 텍스트로 인식할 수 있으며 수백 개의 동시 전사 요청을 지원합니다. 출력은 단어 수준의 타임스탬프가 있는 구두점 텍스트이며 ITN 및 사용자 정의 핫워드를 지원합니다. ffmpeg와의 서버 측 통합으로 다양한 오디오 및 비디오 형식 입력을 지원합니다. 이 패키지는 html, 파이썬, C++, 자바, c# 및 기타 프로그래밍 언어 클라이언트를 제공하며, 사용자가 직접 사용하고 추가 개발할 수 있습니다.

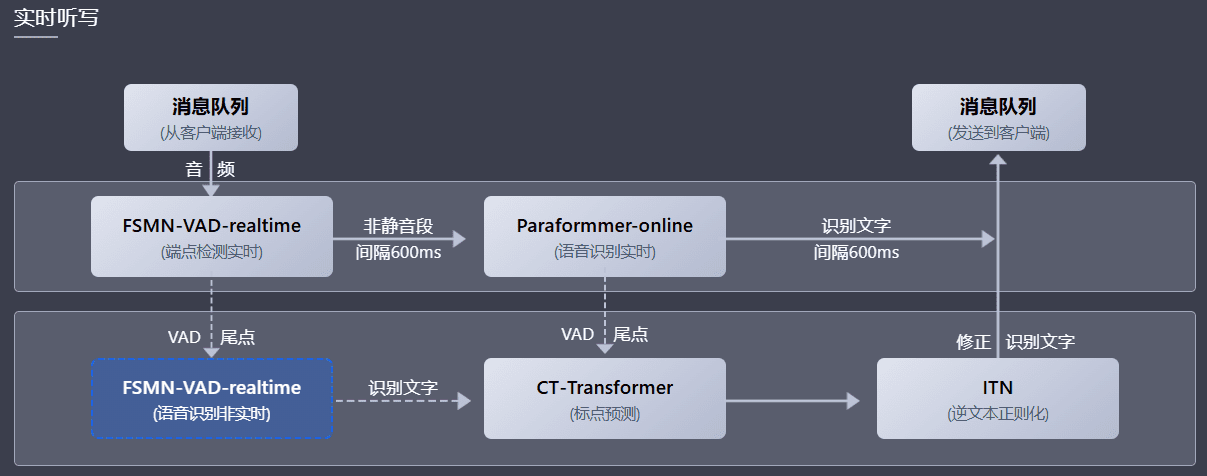

FunASR 실시간 음성 받아쓰기 소프트웨어 패키지는 음성 엔드포인트 감지 모델, 음성 인식, 음성 인식, 구두점 예측 모델 등의 실시간 버전을 통합합니다. 다중 모델 시너지를 사용하여 실시간 음성-텍스트 변환을 수행할 수 있을 뿐만 아니라 문장 끝에 고정밀 전사 텍스트, 구두점이 있는 출력 텍스트, 여러 요청에 대한 지원으로 출력을 수정할 수 있습니다. 사용자 시나리오에 따라 실시간 음성 받아쓰기 서비스(온라인), 비실시간 문장 전사(오프라인), 실시간 및 비실시간 통합 협업(2패스) 등 세 가지 서비스 모드를 지원합니다. 소프트웨어 패키지는 html, 파이썬, C++, 자바, c# 클라이언트 등 다양한 프로그래밍 언어를 제공하며, 사용자가 직접 사용 및 추가 개발할 수 있습니다.

기능 목록

- 음성 인식(ASR): 오프라인 및 실시간 음성 인식을 지원합니다.

- 음성 엔드포인트 감지(VAD): 음성 신호의 시작과 끝을 감지합니다.

- 문장 부호 복구: 자동으로 문장 부호를 추가하여 텍스트 가독성을 개선합니다.

- 언어 모델: 여러 언어 모델의 통합을 지원합니다.

- 화자 인증: 화자의 신원을 확인합니다.

- 화자 분리: 서로 다른 화자의 음성을 구분합니다.

- 다중 대화를 위한 음성 인식: 여러 사람이 동시에 대화할 수 있도록 음성 인식을 지원합니다.

- 모델 추론 및 미세 조정: 사전 학습된 모델에 대한 추론 및 미세 조정 기능을 제공합니다.

도움말 사용

설치 프로세스

- 환경 준비::

- Python 3.7 이상이 설치되어 있는지 확인합니다.

- 필요한 종속성 라이브러리를 설치합니다:

pip install -r requirements.txt

- 모델 다운로드::

- 모델스코프 또는 허깅페이스에서 사전 학습된 모델을 다운로드하세요:

git clone https://github.com/modelscope/FunASR.git cd FunASR

- 모델스코프 또는 허깅페이스에서 사전 학습된 모델을 다운로드하세요:

- 구성 환경::

- 환경 변수를 구성합니다:

export MODEL_DIR=/path/to/your/model

- 환경 변수를 구성합니다:

사용 프로세스

- 음성 인식::

- 음성 인식을 위해 명령줄을 사용합니다:

python recognize.py --model paraformer --input your_audio.wav - Python 코드를 사용한 음성 인식:

from funasr import AutoModel model = AutoModel.from_pretrained("paraformer") result = model.recognize("your_audio.wav") print(result)

- 음성 인식을 위해 명령줄을 사용합니다:

- 음성 엔드포인트 탐지::

- 음성 엔드포인트 감지를 위해 명령줄을 사용하세요:

python vad.py --model fsmn-vad --input your_audio.wav - Python 코드를 사용한 음성 엔드포인트 탐지:

from funasr import AutoModel vad_model = AutoModel.from_pretrained("fsmn-vad") vad_result = vad_model.detect("your_audio.wav") print(vad_result)

- 음성 엔드포인트 감지를 위해 명령줄을 사용하세요:

- 문장 부호가 복원됩니다.::

- 문장 부호 복구에는 명령줄을 사용합니다:

python punctuate.py --model ct-punc --input your_text.txt - 파이썬 코드를 사용한 문장 부호 복구:

from funasr import AutoModel punc_model = AutoModel.from_pretrained("ct-punc") punc_result = punc_model.punctuate("your_text.txt") print(punc_result)

- 문장 부호 복구에는 명령줄을 사용합니다:

- 화자 확인::

- 명령줄을 사용하여 화자 인증을 하세요:

python verify.py --model speaker-verification --input your_audio.wav - Python 코드를 사용한 화자 인증:

from funasr import AutoModel verify_model = AutoModel.from_pretrained("speaker-verification") verify_result = verify_model.verify("your_audio.wav") print(verify_result)

- 명령줄을 사용하여 화자 인증을 하세요:

- 멀티 토크 음성 인식::

- 명령줄을 사용한 멀티플레이어 대화를 위한 음성 인식:

python multi_asr.py --model multi-talker-asr --input your_audio.wav - Python 코드를 사용하여 여러 사람이 대화할 수 있는 음성 인식:

from funasr import AutoModel multi_asr_model = AutoModel.from_pretrained("multi-talker-asr") multi_asr_result = multi_asr_model.recognize("your_audio.wav") print(multi_asr_result)

- 명령줄을 사용한 멀티플레이어 대화를 위한 음성 인식:

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...