일반 소개

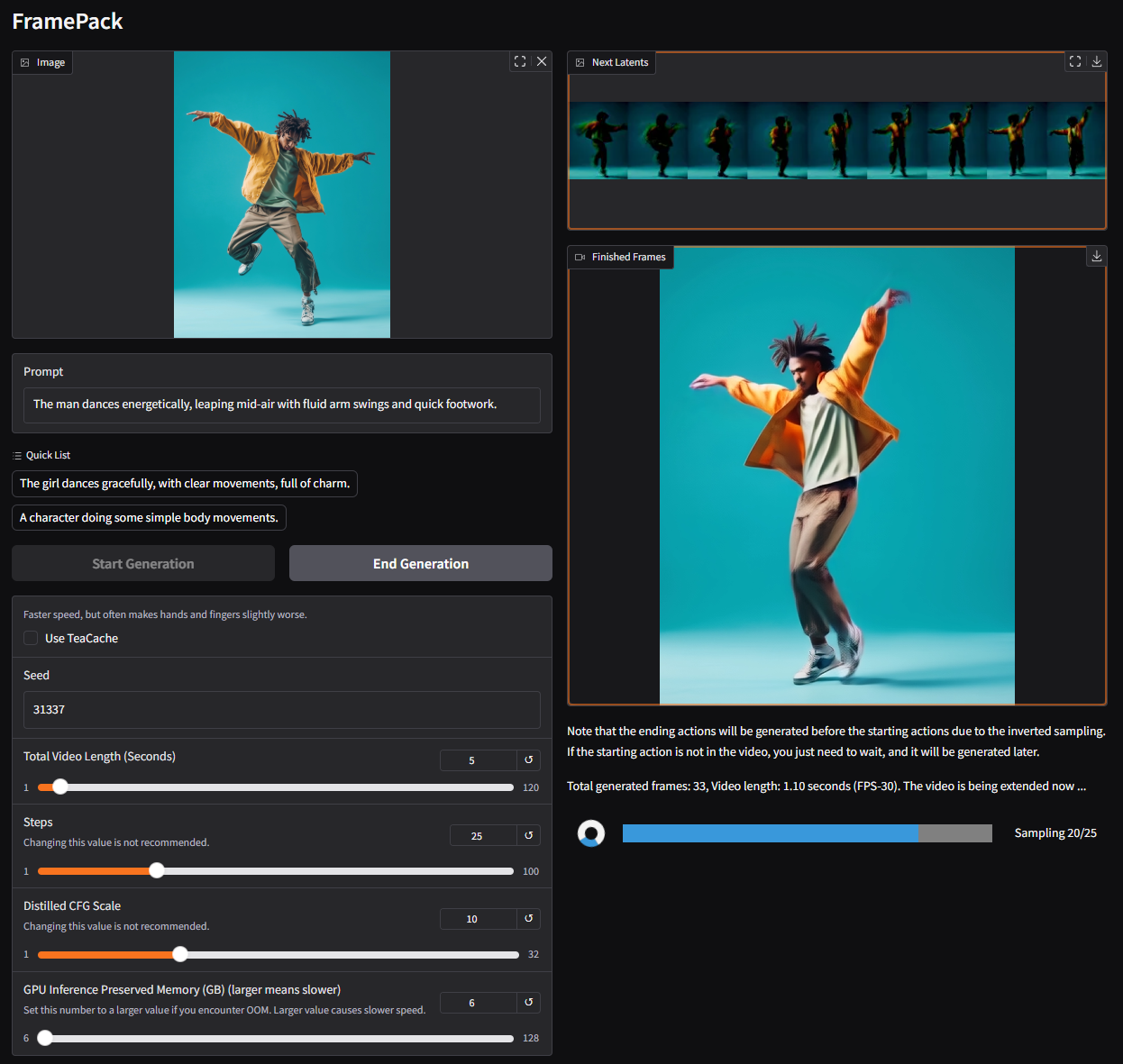

프레임팩은 동영상 확산 기술을 보다 실용적으로 만드는 데 중점을 둔 오픈 소스 동영상 생성 도구입니다. 고유한 다음 프레임 예측 신경망을 통해 입력 프레임을 고정된 길이로 압축하여 동영상 길이와 생성 노력을 분리합니다. 즉, 긴 동영상을 생성할 때에도 그래픽 메모리 요구량이 크게 증가하지 않습니다. 프레임팩은 최소 6GB의 그래픽 메모리로 30fps로 수천 개의 프레임을 생성할 수 있어 일반 소비자 GPU에 적합합니다. 이 프로젝트는 Lvmin Zhang이 개발했으며 13억 개의 모델 파라미터에 최적화된 Hunyuan 비디오 모델을 기반으로 하여 효율성과 경량화를 결합했습니다. 프레임팩은 다음과 같이 작동합니다. 프레임팩은 프레임당 최대 1.5초의 최적화된 속도로 이미지-동영상 생성을 지원하는 사용하기 쉬운 Gradio 인터페이스를 제공합니다. 콘텐츠 제작자, 개발자 및 동영상 생성에 관심이 있는 일반 사용자에게 적합합니다.

기능 목록

- 이미지에서 동영상으로 생성: 긴 동영상 확장을 지원하여 단일 이미지에서 모션 동영상을 생성할 수 있습니다.

- 저용량 RAM 최적화: 최소 6GB의 RAM으로도 60초 분량의 30프레임 동영상을 생성할 수 있습니다.

- 다음 프레임 예측: 컨텍스트를 압축하여 동영상 길이와 무관하게 워크로드를 생성합니다.

- 라디오 사용자 인터페이스: 이미지 업로드, 프롬프트 입력, 생성된 동영상 미리보기를 위한 직관적인 기능을 제공합니다.

- 다중 어텐션 메커니즘 지원: PyTorch, xformers, flash-attn 및 sage-attention이 지원됩니다.

- 크로스 플랫폼 호환성: Linux 및 Windows를 지원하며 NVIDIA RTX 30XX/40XX/50XX 시리즈 GPU와 호환됩니다.

- 최적화된 생성 속도: 프레임당 최대 1.5초 동안 티캐시로 최적화되었습니다.

- 일괄 교육 지원: 이미지 확산과 유사한 초대형 일괄 교육을 지원합니다.

도움말 사용

설치 프로세스

프레임팩 설치는 좀 더 기술적인 작업이 필요하며 Python 및 GPU 환경 구성 경험이 있는 사용자에게 적합합니다. 아래는 Windows 및 Linux 시스템에 대한 자세한 설치 단계와 공식 GitHub 페이지 및 웹 리소스입니다.

환경 요구 사항

- 운영 체제Linux 또는 Windows.

- GPU: fp16 및 bf16을 지원하는 NVIDIA RTX 30XX/40XX/50XX 시리즈(GTX 10XX/20XX 미테스트).

- 메모리최소 6GB(30fps 동영상 60초 생성).

- Python 버전파이썬 3.10을 권장합니다(참고: 파이썬 버전이 엄격하게 일치해야 하며, 그렇지 않으면 라이브러리 비호환성이 발생할 수 있습니다).

- CUDACUDA의 GPU 호환 버전(예: CUDA 12.6)이 설치되어 있어야 합니다.

설치 단계

- 클론 프레임팩 웨어하우스

터미널 또는 명령 프롬프트를 열고 다음 명령을 실행하여 프로젝트를 복제합니다:git clone https://github.com/lllyasviel/FramePack.git cd FramePack - 가상 환경 만들기

종속성 충돌을 피하려면 Python 가상 환경을 만드는 것이 좋습니다:python -m venv venv가상 환경을 활성화합니다:

- Windows:

venv\Scripts\activate.bat - Linux:

source venv/bin/activate

- Windows:

- PyTorch 및 종속성 설치

CUDA 버전(예: CUDA 12.6)에 맞는 PyTorch를 설치합니다:pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126프로젝트 종속성을 설치합니다:

pip install -r requirements.txt - (선택 사항) 세이지 주의 또는 플래시 주의 설치

성능을 개선하려면 Sage Attention을 설치하면 됩니다(CUDA 및 Python 버전에 맞는 휠 파일을 선택해야 합니다):pip install https://github.com/woct0rdho/SageAttention/releases/download/v2.1.1-windows/sageattention-2.1.1+cu126torch2.6.0-cp312-cp312-win_amd64.whl참고: 세이지 주의는 생성 품질에 약간의 영향을 줄 수 있으며, 처음 사용하는 사용자라면 건너뛸 수 있습니다.

- 라디오 인터페이스 시작하기

설치가 완료되면 다음 명령을 실행하여 인터페이스를 시작합니다:python demo_gradio.py시작 후 터미널에 다음과 같은 내용이 표시됩니다.

http://127.0.0.1:7860/브라우저에서 URL을 방문하여 FramePack의 Gradio 인터페이스에 액세스할 수 있습니다.

일반적인 설치 문제

- Python 버전 불일치종속성 설치에 실패하면 파이썬 버전이 3.10인지 확인합니다.

python --version현재 버전을 확인합니다. - 종속성 충돌만약

requirements.txt라이브러리 버전이 호환되지 않는 경우, 해당 라이브러리에서av및numpy및scipy버전 지정, 최신 버전을 다시 설치하세요:pip install av numpy scipy - 비디오 메모리 부족동영상 메모리가 6GB 미만인 경우 생성에 실패할 수 있습니다. 메모리가 더 큰 GPU를 사용하거나 동영상 길이를 줄이는 것이 좋습니다.

사용법

프레임팩의 핵심 기능은 하나의 이미지로 동영상을 생성하고 큐워드로 동영상 콘텐츠를 제어할 수 있도록 지원하는 것입니다. 자세한 작동 절차는 아래와 같습니다.

1. Gradio 인터페이스에 액세스

활성화(플랜) demo_gradio.py 그 후 브라우저에 FramePack 사용자 인터페이스가 표시됩니다. 인터페이스는 왼쪽과 오른쪽 섹션으로 나뉩니다:

- 왼쪽: 이미지를 업로드하고 프롬프트 단어를 입력합니다.

- 오른쪽: 생성된 동영상과 잠재적 미리보기(잠복 미리보기)를 표시합니다.

2. 이미지 업로드

왼쪽의 이미지 업로드 영역을 클릭하고 로컬 이미지(권장 해상도 544x704 또는 이와 유사한 크기)를 선택하면 FramePack에서 이 이미지를 기반으로 동영상 콘텐츠를 생성합니다.

3. 입력 프롬프트

단서 단어 텍스트 상자에 동영상의 동작을 설명하는 짧은 문장을 입력합니다. 예를 들어 간결하고 동작 중심의 큐 단어를 사용하는 것이 좋습니다:

The girl dances gracefully, with clear movements, full of charm.A robot jumps energetically, spinning in a futuristic city.

프레임팩은 공식적으로 GPT 형식을 통해 액션 큐를 생성할 것을 권장합니다:

귀하는 이미지 애니메이션을 위한 동작 중심의 짧은 프롬프트를 작성하는 어시스턴트입니다. 사용자가 이미지를 보내면 시각적 동작을 설명하는 간결한 프롬프트로 응답합니다. 시각적 모션을 설명합니다.

4. 동영상 생성

인터페이스에서 생성 버튼을 클릭하면 프레임팩이 프로세스를 시작합니다. 생성 프로세스는 세그먼트 단위로 진행되며, 각 세그먼트는 약 1초 분량의 동영상을 생성하고, 이 동영상은 점차적으로 서로 이어져 완전한 동영상을 형성합니다. 생성 진행 상황은 진행률 표시줄과 잠재적 미리보기로 표시됩니다. 생성된 파일은 ./outputs/ 폴더로 이동합니다.

5. 보기 및 조정

생성 프로세스 초기에는 짧은 동영상(예: 1초)만 표시될 수 있습니다. 이는 정상적인 현상이며 전체 동영상을 완성하려면 더 많은 클립이 생성될 때까지 기다려야 합니다. 결과가 만족스럽지 않은 경우 큐 단어를 조정하거나 입력 이미지를 변경하여 다시 생성할 수 있습니다.

생성 속도 최적화

- 사용 시작 티캐시생성 설정에서 티캐시를 활성화하면 속도가 프레임당 2.5초에서 1.5초로 증가합니다.

- 고성능 GPU로 더 빠른 세대: 예: NVIDIA 4090.

- 세이지 주의 비활성화: 세이지 주의가 설치된 경우 품질 생성을 보장하기 위해 첫 번째 테스트에서 비활성화할 수 있습니다.

주요 기능 작동

낮은 메모리 생성

프레임팩의 핵심 강점은 비디오 메모리 요구량이 낮다는 점입니다. 입력 컨텍스트를 압축하여 60초 분량의 30fps 동영상을 생성하는 데 6GB의 비디오 메모리만 필요합니다. 추가 구성이 필요하지 않으며 시스템이 그래픽 메모리 할당을 자동으로 최적화합니다.

다음 프레임 예측

FramePack은 다음 프레임 예측 신경망을 사용하여 프레임 단위로 동영상을 생성합니다. 사용자는 생성된 각 세그먼트의 잠재적 미리보기를 Gradio 인터페이스에서 실시간으로 확인하여 비디오 콘텐츠가 예상과 일치하는지 확인할 수 있습니다.

라디오 인터페이스

Gradio는 빠른 업로드와 미리보기를 지원하는 간단하고 직관적인 인터페이스를 갖추고 있습니다. 사용자는 --share 매개 변수를 통해 공용 네트워크에 인터페이스를 공유하거나 --port 노래로 응답 --server 사용자 지정 포트 및 서버 주소를 매개변수로 지정합니다:

python demo_gradio.py --share --port 7861 --server 0.0.0.0

애플리케이션 시나리오

- 콘텐츠 제작

프레임팩은 동영상 제작자가 짧은 동적 동영상을 생성하는 데 적합합니다. 예를 들어 소셜 미디어 콘텐츠 제작을 위해 캐릭터 이미지로 댄스 동영상을 생성할 수 있습니다. 비디오 메모리 요구량이 적어 일반 사용자도 쉽게 시작할 수 있습니다. - 게임 개발

개발자는 프레임팩을 사용하여 캐릭터의 움직임이나 환경 변화와 같은 동적 씬 애니메이션을 생성할 수 있으므로 수동 모델링 시간을 절약할 수 있습니다. 경량 모델은 실시간 렌더링 가능성을 지원합니다. - 교육 및 데모

교사나 트레이너는 정지 이미지로 교육용 동영상을 생성하여 동적 프로세스(예: 과학 실험 시뮬레이션)를 시연할 수 있습니다. Gradio 인터페이스는 사용하기 쉽고 기술 전문가가 아닌 사용자에게도 적합합니다. - 엣지 컴퓨팅

프레임팩의 13억 개의 파라미터 모델은 모바일 디바이스나 임베디드 시스템과 같은 엣지 디바이스에 배포하여 현지화된 비디오를 생성하는 데 적합합니다.

QA

- FramePack은 어떤 GPU를 지원하나요?

최소 6GB RAM이 장착된 NVIDIA RTX 30XX, 40XX, 50XX 시리즈 GPU를 지원합니다. GTX 10XX/20XX는 테스트되지 않았으며 호환되지 않을 수 있습니다. - 동영상을 생성하는 데 시간이 얼마나 걸리나요?

NVIDIA 4090에서는 최적화하지 않은 경우 프레임당 2.5초, 티캐시를 활성화한 경우 프레임당 1.5초입니다. 5초 분량의 동영상을 생성하는 데 약 3~4분이 소요됩니다. - 생성 품질을 어떻게 개선할 수 있을까요?

고품질 입력 이미지를 사용하고, 명확한 액션 단서를 작성하고, 세이지 주의 기능을 비활성화하고, 최종 고품질 생성을 위해 티캐시를 끄세요. - 매우 긴 동영상을 생성할 수 있나요?

예, FramePack은 수천 개의 동영상 프레임(예: 30fps에서 60초) 생성을 지원합니다. 동영상 메모리 요구 사항은 고정되어 있으며 동영상 길이에 따라 증가하지 않습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...