대규모 모델 기초는 대규모 언어 모델(LLM)의 핵심 기술과 실무 경로를 심도 있게 분석합니다. 언어 모델링의 기본 이론부터 시작하여 대규모 언어 모델의 3대 아키텍처(인코더 전용, 인코더-디코더, 디코더 전용)와 대표 모델(예: BERT, T5, GPT 시리즈). 이 책은 프롬프트 엔지니어링, 파라미터의 효율적인 미세 조정, 모델 편집, 검색 향상 생성 등의 핵심 기술을 설명합니다. 풍부한 사례 연구와 함께 다양한 시나리오에서의 적용 사례를 보여줌으로써 독자들에게 포괄적이고 심층적인 학습과 실용적인 지침을 제공하여 독자들이 대규모 언어 모델링 기술의 적용과 최적화를 마스터할 수 있도록 도와줍니다.

언어 모델링 기초

- 통계적 방법에 기반한 언어 모델링마르코프 가정과 큰 가능성 추정을 포함한 n-그램 모델과 그 이면의 통계에 대한 심층 분석입니다.

- RNN 기반 언어 모델링순환 신경망(RNN)의 구조적 특징, 학습에서 흔히 발생하는 경사 소실 및 폭발 문제, 언어 모델링의 실제 적용에 대한 자세한 설명입니다.

- 트랜스포머 기반 언어 모델링자기 주의 메커니즘, 피드 포워드 신경망(FFN), 레이어 정규화, 잔여 연결성 등 트랜스포머 아키텍처의 핵심 구성 요소와 이를 언어 모델링에 효율적으로 적용하는 방법에 대한 종합적인 분석입니다.

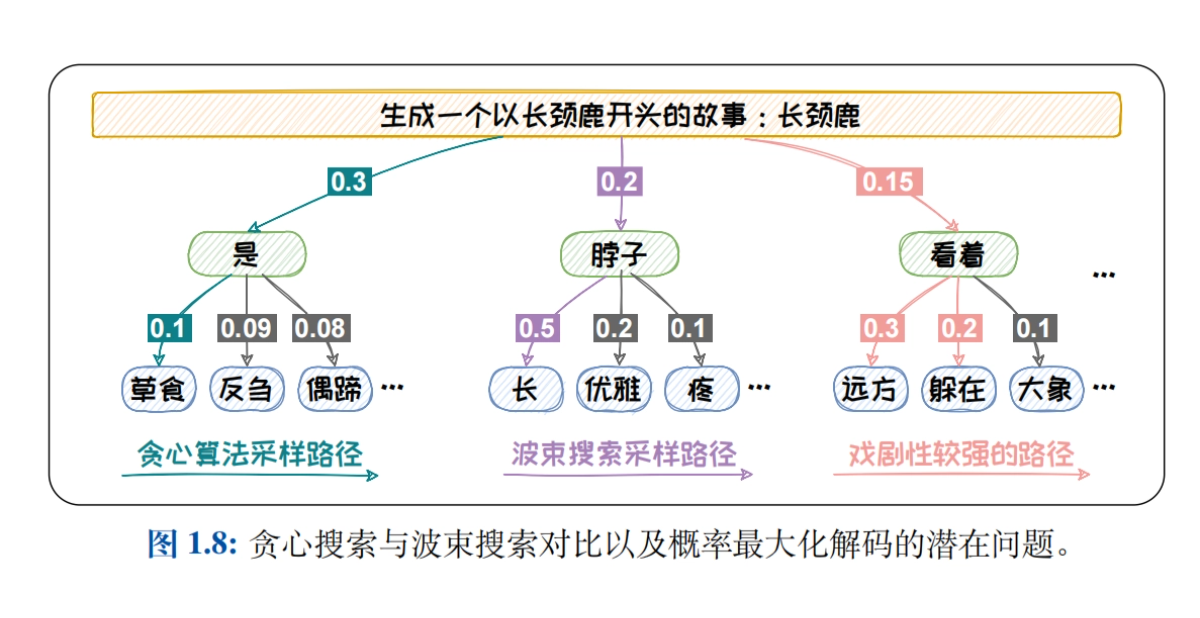

- 언어 모델링을 위한 샘플링 방법욕심 검색, 빔 검색, Top-K 샘플링, Top-P 샘플링 및 온도 메커니즘과 같은 디코딩 전략을 체계적으로 도입하여 다양한 전략이 생성된 텍스트의 품질에 미치는 영향을 탐색합니다.

- 언어 모델 검토언어 모델의 성능을 평가할 때 각 루브릭의 강점과 한계를 분석하기 위해 내재적 루브릭(예: 난해성)과 외재적 루브릭(예: BLEU, ROUGE, BERTScore, G-EVAL)에 대한 자세한 설명이 제시되어 있습니다.

빅 언어 모델 아키텍처

- 빅 데이터 + 빅 모델 → 새로운 인텔리전스다음은 모델 크기와 데이터 크기가 모델 성능에 미치는 영향에 대한 심층 분석, 스케일링 법칙(카플란-맥캔들리 법칙 및 친칠라의 법칙 등)에 대한 자세한 설명, 모델 및 데이터 크기를 최적화하여 모델 성능을 개선하는 방법에 대한 논의입니다.

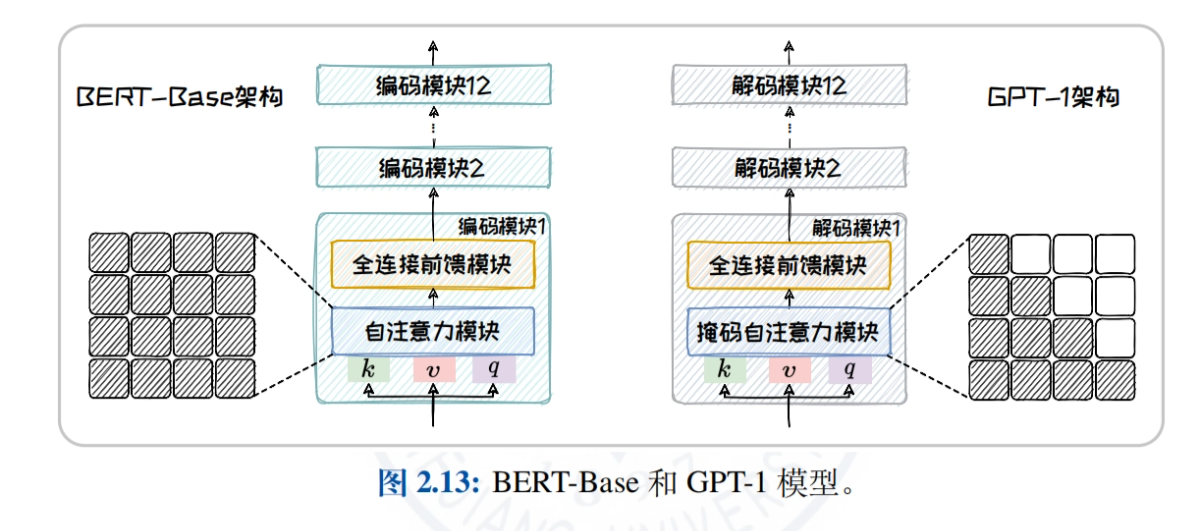

- 빅 언어 모델 아키텍처 개요인코더 전용, 인코더-디코더, 디코더 전용 등 세 가지 주요 아키텍처의 주의 메커니즘과 적용 가능한 작업을 비교 및 분석하여 독자들이 다양한 아키텍처의 특징과 장점을 이해할 수 있도록 돕습니다.

- 인코더 전용 아키텍처BERT를 예로 들어 모델 구조, 사전 학습 작업(예: MLM, NSP) 및 파생 모델(예: RoBERTa, ALBERT, ELECTRA)을 자세히 설명하여 자연어 이해 작업에서 모델을 적용하는 방법을 살펴봅니다.

- 인코더-디코더 아키텍처통합 텍스트 생성 프레임워크와 다양한 사전 학습 작업을 소개하고 기계 번역 및 텍스트 요약과 같은 작업에서 모델의 성능을 분석하기 위해 T5와 BART를 예로 들어 설명합니다.

- 디코더 전용 아키텍처오픈 도메인 텍스트 생성 작업에 대한 모델의 장점을 살펴보면서 GPT 제품군(GPT-1부터 GPT-4까지)과 LLaMA 제품군(LLaMA1/2/3)의 개발 역사와 특성을 자세히 설명합니다.

- 비 트랜스포머 아키텍처특정 시나리오에 적용할 수 있는 비주류 아키텍처의 잠재력을 탐구하는 RWKV, Mamba, TTT(Training While Testing) 패러다임과 같은 상태 공간 모델(SSM)을 소개합니다.

프롬프트 엔지니어링

- 프롬프트 프로젝트 소개프롬프트 및 프롬프트 엔지니어링을 정의하고, 모호성 제거 및 벡터화(토큰화, 임베딩) 프로세스를 자세히 설명하며, 잘 설계된 프롬프트 부트스트랩 모델을 통해 고품질 텍스트를 생성하는 방법을 살펴봅니다.

- 상황에 맞는 학습(ICL)제로 샘플, 단일 샘플, 소수 샘플 학습의 개념을 소개하고, 예제 선택 전략(예: 유사성 및 다양성)을 살펴보고, 문맥 학습을 사용하여 모델의 작업 적응성을 개선하는 방법을 분석합니다.

- 생각의 사슬(CoT)단계별(예: CoT, 제로샷 CoT, 자동 CoT), 생각하기(예: ToT, GoT), 브레인스토밍(예: 자기 일관성)의 세 가지 CoT 모드를 설명하고 사고의 사슬을 통해 모델의 추론을 강화하는 방법을 탐구합니다.

- 프롬프트 팁프롬프트 작성 표준화하기, 질문을 합리적으로 요약하기, 적절한 경우 CoT 사용하기, 심리적 단서(예: 역할극, 상황 대체) 잘 활용하기 등의 기법을 소개하여 독자가 프롬프트 디자인을 개선하는 데 도움을 줍니다.

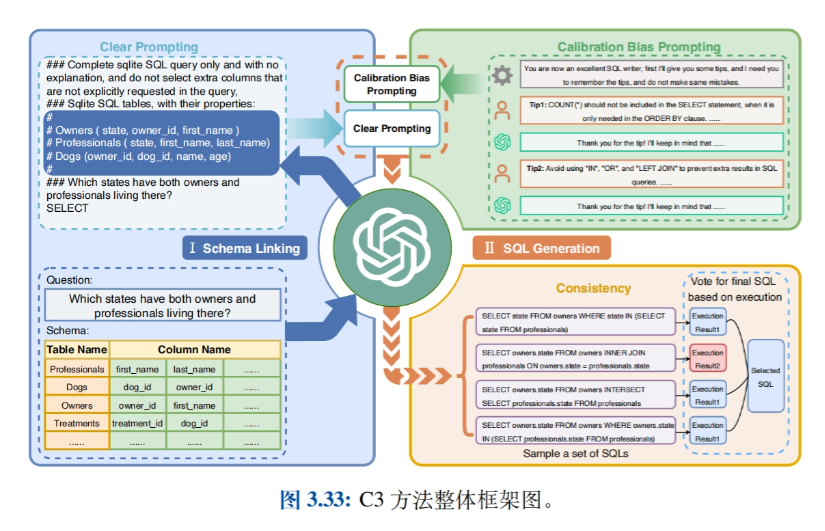

- 관련 애플리케이션빅 모델 기반 인텔리전트(에이전트), 데이터 합성, 텍스트-SQL, GPTS 등의 애플리케이션을 소개하고 다양한 영역에서 프롬프트 엔지니어링의 실제 사용 사례를 살펴봅니다.

효율적인 파라미터 미세 조정

- 효율적인 파라미터 미세 조정 소개다운스트림 작업 적응을 위한 두 가지 주요 접근 방식인 컨텍스트 학습과 인스트럭션 미세 조정을 도입하면 비용 절감 및 효율성 측면에서 상당한 이점을 제공하는 파라미터 효율 미세 조정(PEFT) 기법을 자세히 살펴볼 수 있습니다.

- 매개변수 첨부 방법추가 입력(예: 프롬프트 튜닝), 추가 모델(예: 접두사 튜닝 및 어댑터 튜닝), 추가 출력(예: 프록시 튜닝)의 구현 및 장점을 포함하여 모델 구조에 새롭고 작은 학습 가능한 모듈을 추가하여 효율적으로 미세 조정하는 방법에 대한 자세한 설명이 포함되어 있습니다.

- 매개변수 선택 방법모델 파라미터의 일부만 미세 조정하는 방법을 규칙 기반 방법(예: 비트핏)과 학습 기반 방법(예: 차일드 튜닝)으로 나누어 소개하고, 파라미터를 선택적으로 업데이트하여 계산 부담을 줄이고 모델의 성능을 개선하는 방법을 살펴봅니다.

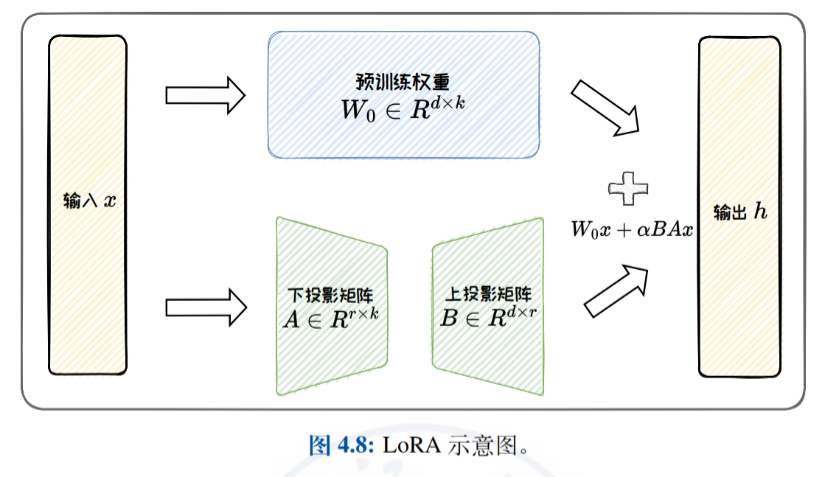

- 낮은 순위 적응 방법원본 가중치 업데이트 행렬을 저순위 행렬로 근사화하여 효율적으로 미세 조정하는 방법에 대해 자세히 소개하고, LoRA와 그 변형(예: ReLoRA, AdaLoRA, DoRA)에 중점을 두고 LoRA의 파라메트릭 효율성 및 작업 일반화 기능에 대해 논의합니다.

- 실습 및 적용HF-PEFT 프레임워크 및 관련 기법의 사용법을 소개하고, 표 형식 데이터 쿼리 및 표 형식 데이터 분석에서 PEFT 기법의 사용 사례를 시연하며, 대규모 모델별 작업의 성능을 개선하는 데 있어 PEFT의 효과를 입증합니다.

모델 편집

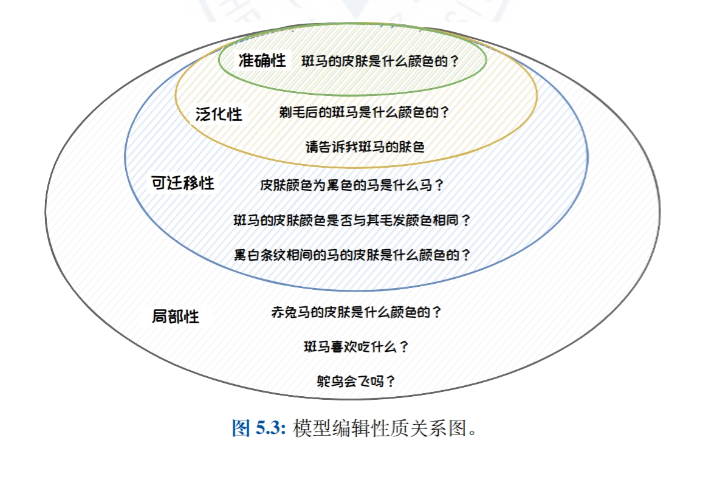

- 모델 편집 소개대규모 언어 모델의 편향성, 독성 및 지식 오류를 수정하는 데 있어 모델 편집의 중요성을 자세히 설명하는 모델 편집의 개념, 정의 및 특성에 대한 소개입니다.

- 모델 편집에 대한 고전적인 접근 방식모델 편집 방법을 외부 확장 방법(예: 지식 캐싱 및 추가 파라미터 방법)과 내부 수정 방법(예: 메타 학습 및 위치 편집 방법)으로 분류하여 각 방법에 대한 대표적인 작업을 제시합니다.

- 추가 매개변수 방법: T-Patcher모델에 특정 파라미터를 첨부하여 모델 출력을 정밀하게 제어할 수 있는 T-Patcher 방법을 자세히 설명하며, 모델의 특정 지식 포인트를 빠르고 정확하게 수정해야 하는 시나리오에 적합합니다.

- 위치 편집 방법: ROME모델 내에서 특정 레이어 또는 뉴런을 찾아 수정함으로써 모델 출력을 정밀하게 제어할 수 있으며, 모델 내부 지식 구조의 심층 수정이 필요한 시나리오에 적합한 ROME 방식에 대한 자세한 소개입니다.

- 모델 편집 애플리케이션정확한 모델 업데이트, 잊혀질 권리 보호, 모델 보안 강화 등 모델 편집의 실제 적용 사례를 소개하고 다양한 시나리오에서 모델 편집 기술의 적용 가능성을 보여 줍니다.

향상된 세대 검색

- 검색 향상 세대 프로필자연어 처리 작업에서 검색과 생성을 결합하여 모델 성능을 향상시키는 것의 중요성과 적용 시나리오를 자세히 설명하면서 검색 강화 생성의 배경과 구성을 소개합니다.

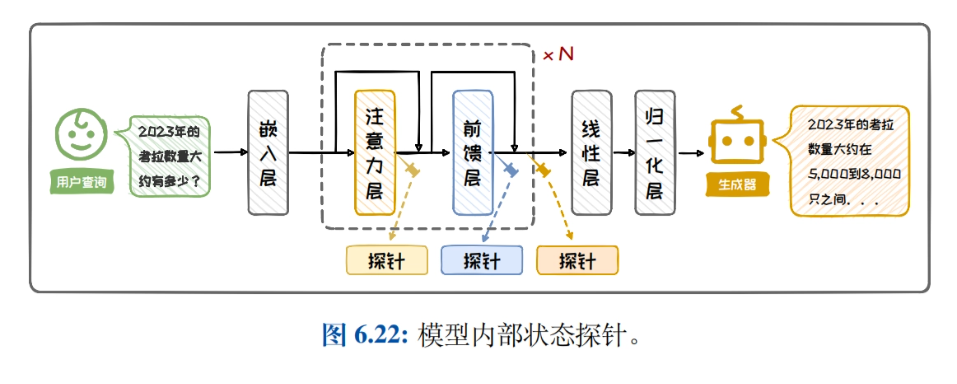

- 향상된 세대 아키텍처 검색RAG 아키텍처 분류, 블랙박스 강화 아키텍처, 화이트박스 강화 아키텍처를 소개하고, 아키텍처별 특성과 적용 가능한 시나리오를 비교-분석하여 독자가 적절한 아키텍처를 선택할 수 있도록 돕습니다.

- 지식 검색지식창고 구축, 쿼리 개선, 검색자 및 검색 효율성 향상에 대해 자세히 소개하며 검색 결과 재배치를 통해 검색 효율성을 개선하고 지식 검색 프로세스를 최적화하는 방법을 살펴봅니다.

- 세대 향상강화 시기, 강화 위치, 다양한 강화 및 비용 절감 방법을 소개하고, 다양한 작업에 생성 강화를 적용하는 전략을 논의하며, 생성된 텍스트의 품질과 효율성을 개선합니다.

- 실습 및 적용간단한 RAG 시스템을 구축하는 단계를 소개하고, 일반적인 애플리케이션에서 RAG의 예를 보여주며, 검색 강화 생성 기술을 이해하고 적용하여 실제 작업에서 모델의 성능을 개선할 수 있도록 도와줍니다.

리소스 자료 다운로드 주소

대규모 모델링의 기초 보고서는 https://url23.ctfile.com/f/65258023-8434020435-605e6e?p=8894(액세스 코드: 8894)에서 다운로드할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...