일반 소개

딥제미니는 개발자 토마스 슬릭터가 만든 오픈소스 프로젝트입니다. 다중 모델 오케스트레이션을 지원하는 AI 관리 도구로, 다양한 AI 모델을 유연하게 결합할 수 있는 것이 주요 특징이며, OpenAI 호환 API 인터페이스를 통해 호출할 수 있습니다. 이 프로젝트는 Python 3.11 및 FastAPI를 기반으로하며 SQLite 데이터베이스 스토리지 구성을 지원하며 웹 관리 인터페이스 및 Docker 배포를 제공합니다. 개발자, 기술 애호가 및 기업 사용자에게 적합하며 MIT 라이선스를 통해 자유롭게 사용 및 수정할 수 있습니다.DeepGemini는 중국어와 영어 인터페이스를 지원하며 기능이 풍부하고 사용하기 쉽습니다.

이 프로젝트는 인터페이스에서 직접 사용할 수 없는 다중 모델 워크플로우와 다중 모델 토론 작업 그룹을 인터페이스에서 구성했으며, API를 사용하려면 다른 채팅 도구에서 구성해야 했습니다. 이 도구는 지능을 위한 일반적인 작업 스케줄링 도구보다 더 간단하고 실용적이지만, 유일한 단점은 더 많은 API 할당량을 소모한다는 것입니다.

기능 목록

- 다중 모델 오케스트레이션을 지원하므로 여러 AI 모델의 조합을 사용자 지정하여 작업을 완료할 수 있습니다.

- 캐릭터 관리와 AI에 다양한 성격과 스킬을 설정할 수 있는 기능을 제공합니다.

- 여러 AI 캐릭터가 토론에서 협업할 수 있는 토론 그룹을 지원합니다.

- 브레인스토밍, 토론, SWOT 분석 등 다양한 토론 모드가 내장되어 있습니다.

- 딥서치, 클로드, 제미니, 그로크3 등 여러 AI 제공업체와 호환됩니다.

- 기존 애플리케이션의 OpenAI 인터페이스를 직접 대체하는 OpenAI 호환 API 인터페이스를 제공합니다.

- 실시간 스트리밍 응답을 지원하여 사용자 경험을 향상시킵니다.

- 웹 관리 인터페이스가 내장되어 있어 모델을 쉽게 구성하고 상태를 확인할 수 있습니다.

- 보다 안정적인 관리 구성을 위해 SQLite 데이터베이스 및 Alembic 마이그레이션을 지원합니다.

도움말 사용

DeepGemini의 설치 및 사용은 로컬 운영과 Docker 배포의 두 가지 방법으로 나뉩니다. 다음은 사용자가 빠르게 시작할 수 있도록 설치 단계와 기능별 작동 절차에 대한 자세한 설명입니다.

설치 프로세스 - 로컬에서 실행

- 프로젝트 코드 복제

터미널에 다음 명령을 입력하여 프로젝트를 다운로드합니다:

git clone https://github.com/sligter/DeepGemini.git

그런 다음 프로젝트 디렉토리로 이동합니다:

cd DeepGemini

- 종속성 설치

프로젝트에 권장uv도구가 종속성을 설치하고 실행합니다:

uv sync

그렇지 않은 경우 uv다음을 사용하여 수행할 수 있습니다. pip install -r requirements.txt 대안. Python 버전이 3.11 이상인지 확인하세요.

- 환경 변수 구성

샘플 구성 파일을 복사합니다:

cp .env.example .env

텍스트 편집기로 열기 .env를 클릭하고 다음 필수 필드를 설정합니다:

ALLOW_API_KEYAPI 키는 직접 정의하세요.ALLOW_ORIGINS허용된 도메인 이름의 출처를 입력한 다음*모두 허용됨을 나타내거나 쉼표를 사용하여 특정 도메인을 구분합니다.

선택적 구성에는 모델 API 키 및 매개 변수(DEEPSEEK_API_KEY).

- 서비스 시작

시작하려면 다음 명령을 입력합니다:

uv run uvicorn app.main:app --host 0.0.0.0 --port 8000

실행에 성공하면 브라우저를 열고 다음을 방문하세요. http://localhost:8000/dashboard웹 관리 인터페이스에 액세스하려면 다음 링크를 클릭하여 액세스할 수 있습니다.

설치 프로세스 - Docker 배포

- Docker 이미지 가져오기

터미널에서 실행됩니다:

docker pull bradleylzh/deepgemini:latest

- 구성 파일 및 데이터베이스 준비하기

현재 디렉토리에 파일을 만듭니다:

- Linux/Mac:

cp .env.example .env touch deepgemini.db echo "" > deepgemini.db - Windows PowerShell:

cp .env.example .env echo "" > deepgemini.db

컴파일러 .env설정 ALLOW_API_KEY 노래로 응답 ALLOW_ORIGINS.

- 도커 컨테이너 실행

시작하려면 명령을 입력합니다:

- Linux/Mac:

docker run -d -p 8000:8000 -v $(pwd)/.env:/app/.env -v $(pwd)/deepgemini.db:/app/deepgemini.db --name deepgemini bradleylzh/deepgemini:latest - Windows PowerShell:

docker run -d -p 8000:8000 -v ${PWD}\.env:/app/.env -v ${PWD}\deepgemini.db:/app/deepgemini.db --name deepgemini bradleylzh/deepgemini:latest

실행 후 http://localhost:8000/dashboard.

Docker Compose 사용(권장)

- 의도

.env및 데이터베이스 파일에 대해 설명했습니다. - 실행 중입니다:

docker-compose up -d

인터뷰 http://localhost:8000/dashboard.

주요 기능

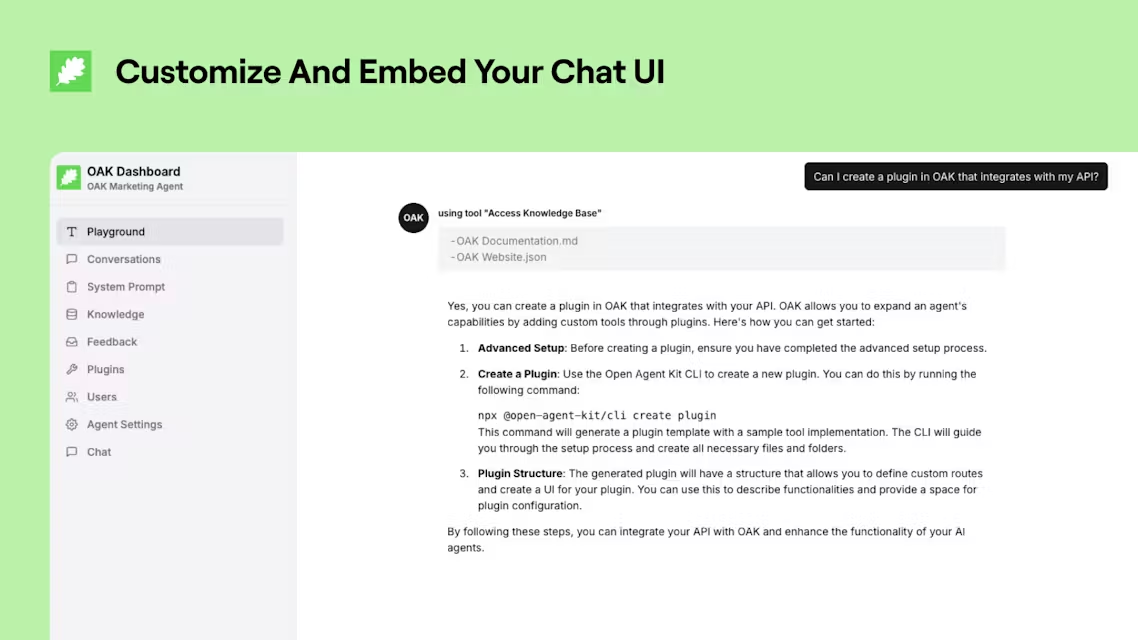

1. 웹 관리 인터페이스 작동

- 브라우저를 열고 다음 사이트를 방문하세요.

http://localhost:8000/dashboard. - 인터페이스에 모델 상태와 구성 옵션이 표시됩니다. "모델 추가"를 클릭하고 모델 이름(예: DeepSeek), API 키, 매개변수(온도, top_p 등)를 입력한 후 저장합니다.

- 역할 관리에서 AI 역할을 만들고 성격(예: '논리적 엄격함')과 기술(예: '텍스트 생성')을 설정합니다.

2. 멀티 모델 오케스트레이션 구성하기

- 워크플로 화면에서 새 워크플로를 클릭합니다.

- 구성 예시:

{

"name": "reason_and_execute",

"steps": [

{"model_id": "deepseek", "step_type": "reasoning", "step_order": 1},

{"model_id": "claude", "step_type": "execution", "step_order": 2}

]

}

- 저장되면 워크플로는 Claude로 결과를 생성하기 전에 DeepSeek로 추론합니다.

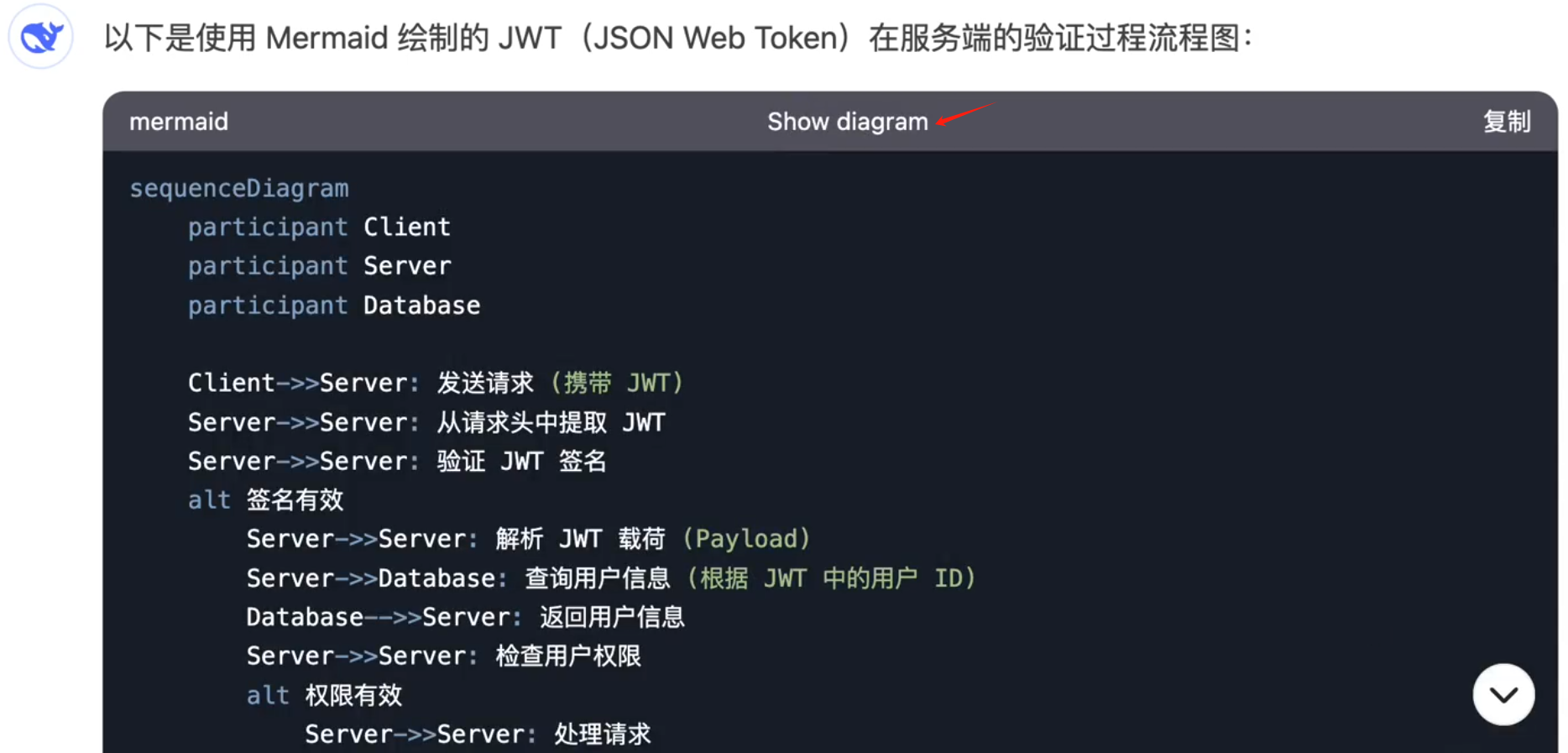

3. API 인터페이스 호출하기

- 활용

curlAPI를 테스트합니다:

curl -X POST "http://localhost:8000/v1/chat/completions" -H "Authorization: Bearer YOUR_API_KEY" -H "Content-Type: application/json" -d '{"model": "reason_and_execute", "messages": [{"role": "user", "content": "分析并回答:1+1等于几?"}]}'

- 상호 호환성

YOUR_API_KEY때문에.env를 키에 입력합니다. 반환 결과는 스트리밍 응답입니다.

4. 토론 그룹 생성

- 토론 그룹 페이지에서 여러 역할(예: 애널리스트 및 크리에이터)을 추가합니다.

- 토론 모드(예: '브레인스토밍')를 선택하고 질문을 입력한 다음 '토론 시작'을 클릭합니다. 시스템이 등장인물 간의 대화를 표시합니다.

주의

- 네트워크 연결이 제대로 작동하는지 확인합니다. 일부 모델은 외부 API에 액세스해야 합니다.

- 로그 파일은

<项目目录>/logs/을 눌러 문제를 해결하는 데 사용할 수 있습니다. - Docker 배포 중에 포트 충돌이 있는 경우, 포트 충돌을 수정할 수 있습니다.

-p 8000:8000의 첫 번째 포트 번호입니다.

애플리케이션 시나리오

- AI 개발 실험

개발자는 DeepGemini로 다중 모델 협업을 테스트할 수 있습니다. 예를 들어, 다음과 같이 시작하세요. 쌍둥이자리 질문을 분석한 다음 Claude를 사용하여 자세한 답변을 생성하세요. - 팀워크 시뮬레이션

토론 그룹 기능을 통해 팀 회의를 시뮬레이션하세요. 다양한 역할을 설정하여 제품 전략을 논의하고 다양한 제안을 도출하세요. - 교육 및 훈련

학생들은 이를 사용하여 AI 모델의 속성에 대해 배우고 다양한 토론 모드로 실험하여 결과를 관찰할 수 있습니다.

QA

- 어떤 AI 제공업체가 지원되나요?

딥서치, 클로드, 제미니, 그로크3, OpenAI 등을 지원하며, 다른 제공업체에 대한 맞춤형 액세스를 제공합니다. - 토론 그룹의 목적은 무엇인가요?

토론 그룹을 사용하면 여러 AI 페르소나가 브레인스토밍이나 토론과 같은 복잡한 문제에 대해 공동 작업하여 다양한 관점에서 답을 찾을 수 있습니다. - 문제를 디버깅하려면 어떻게 하나요?

로그 파일을 확인하거나 GitHub에 이슈를 제출하여 도움을 요청하세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...