일반 소개

ChatMCP는 모델 컨텍스트 프로토콜을 구현하도록 설계된 오픈 소스 AI 채팅 클라이언트입니다(MCP). 깃허브 사용자 daodao97이 개발한 이 프로젝트는 OpenAI, Claude, OLLama 등 다양한 대규모 언어 모델(LLM)을 지원합니다. ChatMCP는 MCP 서버와의 채팅 기능을 제공할 뿐만 아니라 MCP 서버 자동 설치, 채팅 로그 관리, 사용자 인터페이스 디자인 개선 등 다양한 유용한 기능도 포함하고 있습니다. 이 프로젝트는 GNU 일반 공중 라이선스 v3.0(GPL-3.0)에 따라 라이선스가 부여되어 사용자가 자유롭게 사용, 수정 및 배포할 수 있습니다.

기능 목록

- MCP 서버와의 채팅 지원

- MCP 서버 자동 설치

- SSE MCP 전송 지원

- 자동 MCP 서버 선택

- 채팅 기록 관리

- 여러 LLM 모델 지원(OpenAI, Claude, OLLama 등)

- 다양한 MCP 서버를 쉽게 설치할 수 있는 MCP 서버 마켓플레이스 제공

- 더 나은 사용자 인터페이스 디자인

- 다중 플랫폼 지원(MacOS, Windows, Linux 등)

도움말 사용

설치 프로세스

- 종속성 설치시스템에 uvx 또는 npx가 설치되어 있는지 확인합니다.

- uvx를 설치합니다:

brew install uv - npx를 설치합니다:

brew install node

- uvx를 설치합니다:

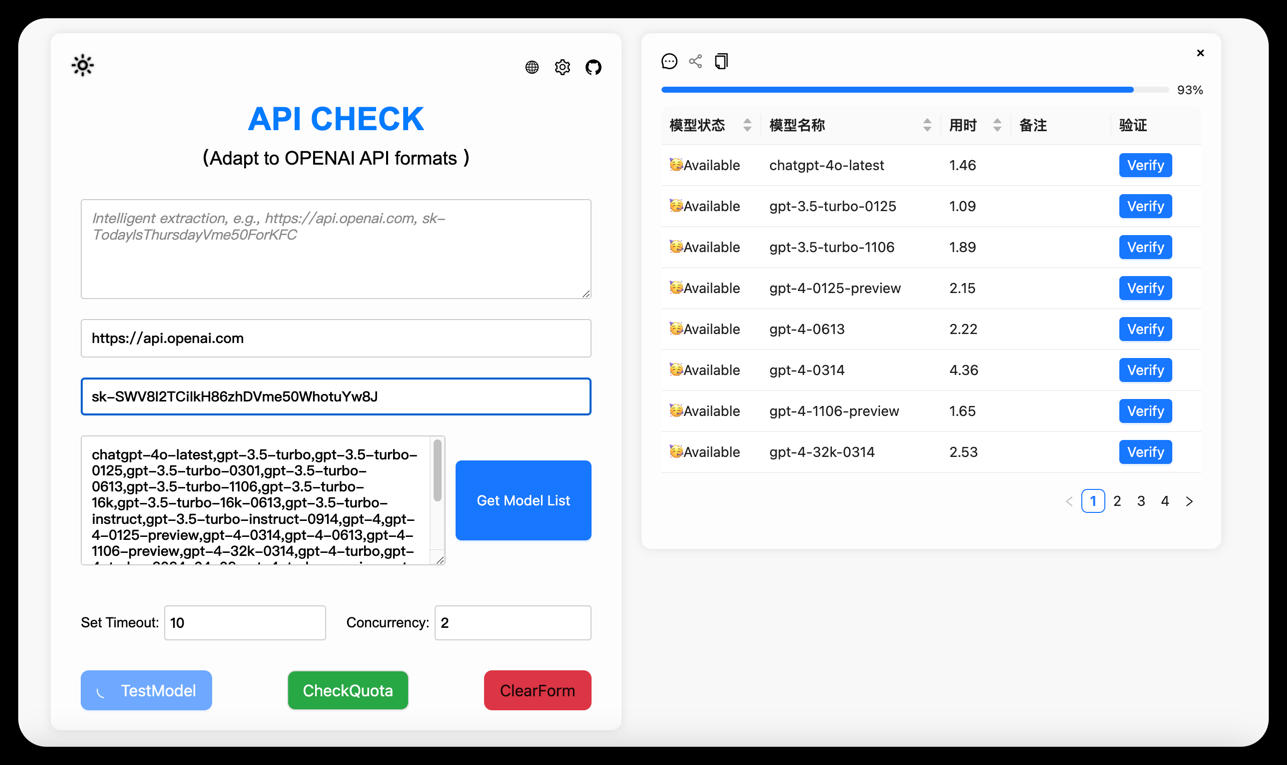

- LLM API 키 및 엔드포인트 구성하기설정 페이지에서 LLM API 키와 엔드포인트를 구성합니다.

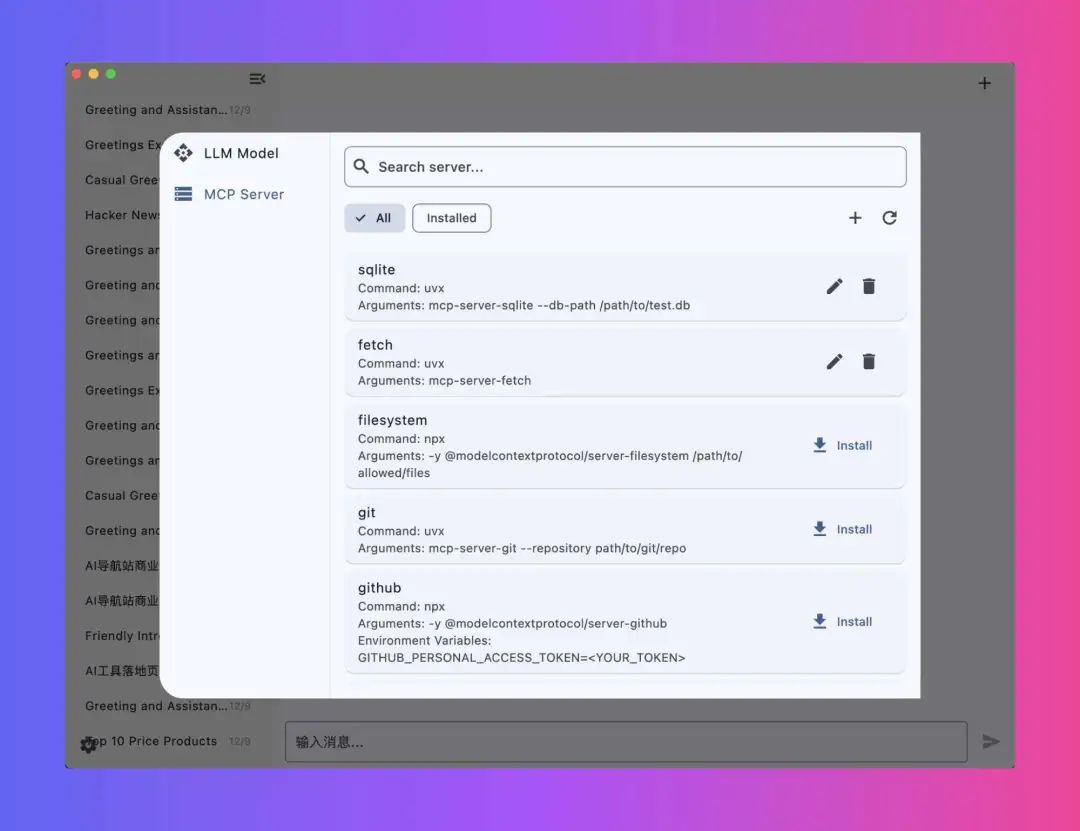

- MCP 서버 설치: MCP 서버 페이지에서 MCP 서버를 설치합니다.

- 클라이언트 다운로드운영 체제에 따라 MacOS 또는 Windows 버전을 다운로드할 수 있습니다.

- 디버깅 로그로그 파일은

~/Library/Application Support/run.daodao.chatmcp/logs. - 데이터베이스 및 구성 파일::

- 채팅 로그 데이터베이스:

~/Documents/chatmcp.db - MCP 서버 구성 파일입니다:

~/Documents/mcp_server.json

- 채팅 로그 데이터베이스:

- 애플리케이션 재설정다음 명령을 사용하여 애플리케이션을 재설정합니다:

rm -rf ~/Library/Application\ Support/run.daodao.chatmcp

rm -rf ~/Documents/chatmcp.db

rm -rf ~/Documents/mcp_server.json

사용 기능

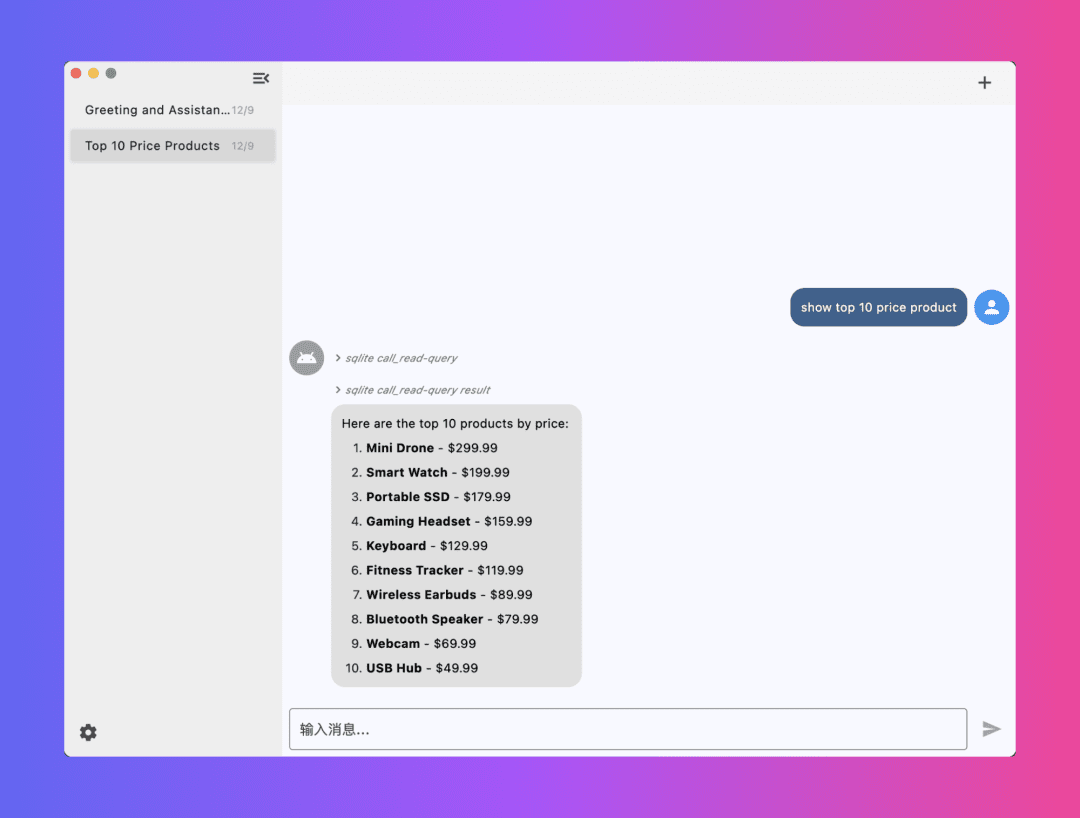

- MCP 서버와 채팅::

- ChatMCP 클라이언트를 열고 구성된 MCP 서버를 선택합니다.

- 채팅 콘텐츠를 입력하고 보내기 버튼을 클릭하여 MCP 서버와 상호작용합니다.

- 채팅 로그 관리::

- 채팅 로그는 다음 주소에 자동으로 저장됩니다.

~/Documents/chatmcp.db. - 기록 채팅은 클라이언트에서 보고 관리할 수 있습니다.

- 채팅 로그는 다음 주소에 자동으로 저장됩니다.

- MCP 서버 설치 및 선택::

- MCP 서버 마켓플레이스를 방문하여 설치할 MCP 서버를 선택합니다.

- 설치가 완료되면 설정 페이지에서 다른 MCP 서버를 선택하고 전환할 수 있습니다.

- LLM 모델 구성 및 사용::

- 설정 페이지에서 원하는 LLM 모델(예: OpenAI, Claude, OLLama 등)을 구성합니다.

- 구성이 완료되면 채팅 중 대화에 다른 LLM 모델을 사용하도록 선택할 수 있습니다.

- 사용자::

- ChatMCP는 다양한 작업을 용이하게 하는 간단하고 직관적인 사용자 인터페이스를 제공합니다.

- 멀티 플랫폼 지원을 통해 사용자는 MacOS, Windows, Linux와 같은 운영 체제에서 사용할 수 있습니다.

이 단계를 통해 사용자는 쉽게 ChatMCP를 설치하고 사용하여 MCP 서버를 통한 효율적인 AI 채팅 환경을 구축할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...