초록

다양한 문제에 대한 대규모 언어 모델(LLM)의 추론 성능은 연쇄적 사고 프롬프트에 크게 의존하며, 프롬프트에서 연쇄적 사고의 예시를 몇 가지 제공하는 것이 포함됩니다. 사고나무와 같은 최근 연구에서는 복잡한 문제 해결에서 추론 단계를 선택할 때 탐색과 자기 평가가 중요하다는 점을 지적했습니다. 이 논문에서는 수많은 사고 트리를 반복적으로 탐색하고 자가 평가하여 시행착오 추론 경험의 모음을 얻는 자동화된 프롬프트 프레임워크인 BoT(Boosting of Thoughts)를 제안하며, 이는 복잡한 문제 해결을 위한 새로운 형태의 프롬프트 역할을 할 것입니다. 예제가 필요 없는 간단한 힌트에서 시작하여 BoT는 수많은 추론 단계를 반복적으로 탐색하고 평가하며, 더 중요한 것은 최종 답을 얻을 때까지 추론 단계의 생성을 보강하기 위해 LLM의 오류 분석을 사용하여 힌트를 명시적으로 수정한다는 점입니다. 다양한 복잡한 수학 문제에 대해 GPT-4와 Llama2를 사용한 실험 결과, BoT는 다른 최신 힌트 방식보다 일관되게 더 높거나 비슷한 수준의 문제 해결률을 달성하는 것으로 나타났습니다. 소스 코드는 https://github.com/iQua/llmpebase的examples/BoTReasoning文件夹下获得 에서 확인할 수 있습니다.

1. 소개

자동 회귀 패러다임을 사용하는 대규모 언어 모델(LLM)은 잠재적인 추론 능력으로 인해 다양한 작업에서 상당한 성과를 거두었습니다. 복잡한 작업에서 이러한 능력을 보장하기 위해서는 단계별 추론 예시를 제공하는 연쇄적 사고(CoT) 단서에 크게 의존합니다. 이 접근법은 일련의 사고를 통해 추론 능력을 자극할 수 있으며, 여기서 사고는 문제 해결의 중간 단계로 작용합니다.

그 결과, 후속 연구, 특히 생각의 나무(ToT)를 통해 CoT를 개선할 수 있는 방법이 제시되었습니다. 이러한 방법의 프롬프트는 타당성을 보장하기 위해 일반적으로 특정 작업에 대한 사람의 주석을 포함합니다. 이러한 의존성은 확장성을 제한합니다. 답변을 개선하기 위해 이중 확인을 위해 LLM을 활용하거나 피드백을 기반으로 프롬프트를 개선하는 최근의 연구는 상당한 가능성을 보여주었습니다. 기존 문헌에서는 일반적으로 프롬프트에서 잘못된 생각을 버리는 것을 선호합니다. 그러나 인간은 일반적으로 오류를 면밀히 분석하여 경험을 쌓고 점진적으로 성과를 개선함으로써 지속적으로 학습할 수 있습니다. 따라서 우리는 LLM의 사고 생성이 인간의 주석으로부터 자유로워지고 다양한 작업에서 효과적인 추론을 위해 인간의 문제 해결을 모방할 수 있을까라는 질문을 제기합니다.

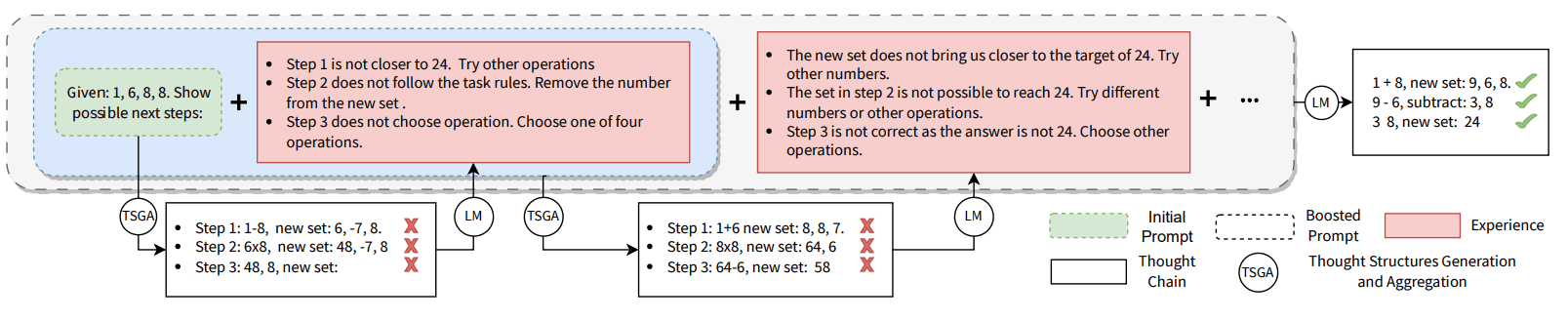

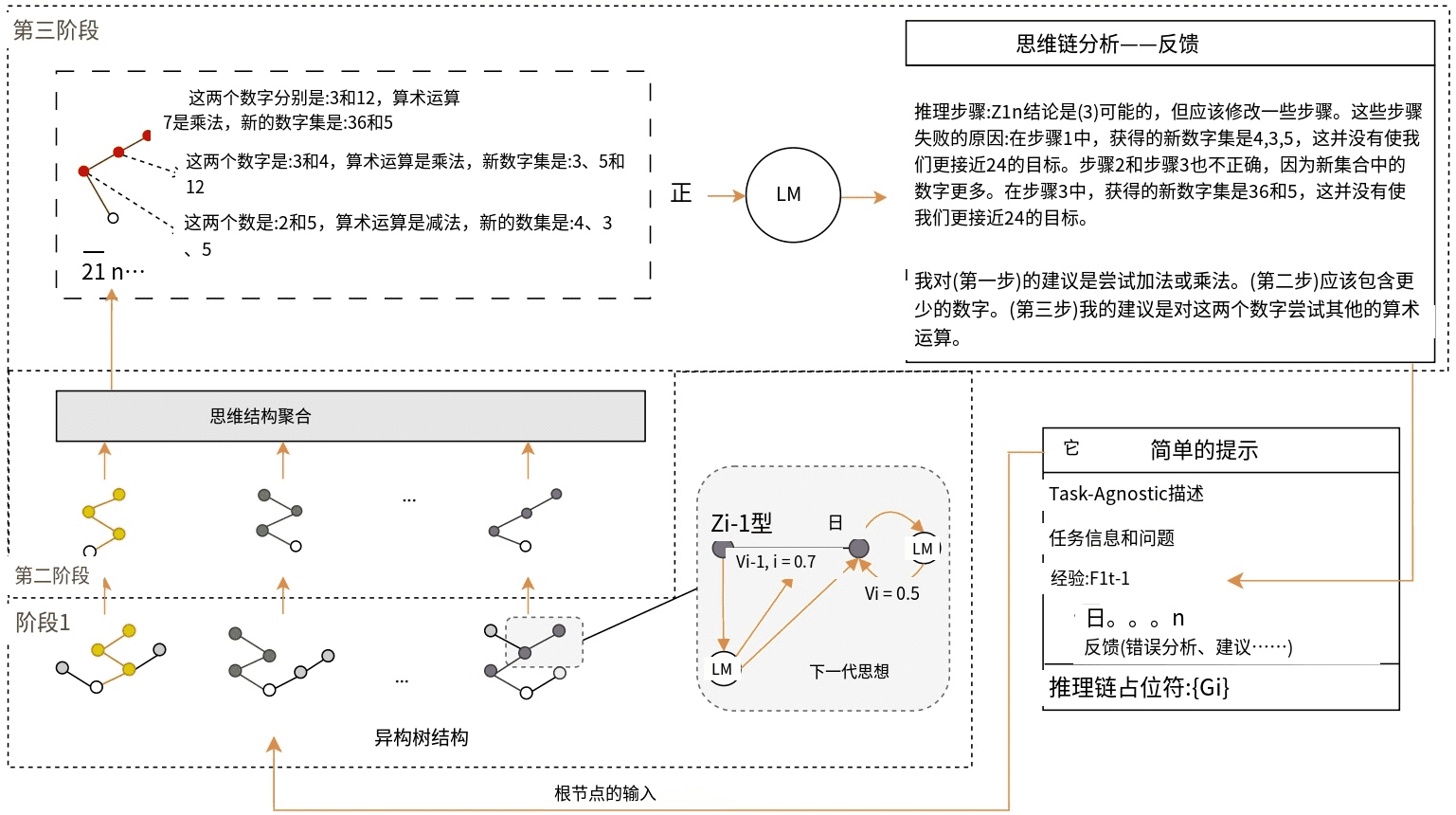

본 논문에서는 그림 1과 같은 새로운 프레임워크, 즉 부스팅 오브 씽킹(BoT)을 제안하는데, 이는 집계와 경험을 포함한 부스팅 메커니즘을 구현하여 오류로부터 학습함으로써 신뢰할 수 없는 추론 단계(약한 사고)를 점진적으로 개선하고 궁극적으로 다양한 문제를 해결할 수 있도록 합니다. 사람의 주석이 없는 단순한 힌트에서 출발하는 BoT는 약한 사고를 할 수 있습니다. 이를 종합하여 BoT는 보다 논리적이고 효과적인 사고의 연쇄를 도출하여 후속 개선을 유도할 수 있습니다. 이러한 프레임워크의 지침은 LLM을 사용하여 집계된 체인을 분석하여 얻은 각 추론 단계에 대한 상세한 오류 보고서, 제안 및 지침인 힌트를 적용함으로써 달성됩니다. 이러한 경험이 프롬프트에 쌓이면 점차 더 강력한 사고로 이어집니다.

그림 1: 대규모 언어 모델(LLM 또는 LM)에 의해 생성된 사고 사슬의 분석으로 구성된 경험을 점진적으로 보강하여 단서를 강화합니다. 경험에는 사고 사슬 자체, 해당 오류 보고서 및 각 추론 단계를 수정하기 위한 자세한 제안이 명시적으로 포함되어 있습니다. 따라서 빨간색 십자가로 표시된 잘못된 생각은 프롬프트의 개선에 기여할 수 있습니다. 프롬프트에 대한 경험을 축적함으로써 BoT는 결국 단순한 프롬프트에서 시작하여 올바른 사고 사슬을 생성할 수 있습니다. 여기에 제시된 예는 24점짜리 게임 과제에 BoT와 함께 GPT-4를 적용하여 얻은 결과입니다.

특히 BoT는 그림 1과 같이 경험 중심 반복 프로세스로 이러한 부스팅 메커니즘을 구현합니다. 각 반복에서 주어진 단서에 대해 BoT는 LLM과 병렬로 수많은 간단한 사고 구조를 구성합니다. 우리는 ToT에서와 같이 트리 구조를 선택했지만, 부스팅을 위해 다양한 성장 전략을 가진 가중 이진 트리로 만들기 위해 트리 구조를 크게 수정했습니다. 각 트리의 뿌리에서 잎까지 가장 높은 점수를 받은 가지를 추출한 후, BoT의 집계 구성 요소를 실행하여 이를 하나의 생각 체인으로 집계했습니다. 그런 다음 이 체인을 동일한 LLM으로 평가하여 얻은 교훈을 다음 반복에서 생각 생성을 위한 지침으로 프롬프트에 추가했습니다.

저희의 기여는 세 가지로 요약할 수 있습니다. 첫째, 이 논문은 정교한 프롬프트를 사용하여 더 복잡한 사고 구조를 생성하는 것과 달리, 간단한 초기 프롬프트에만 의존하여 이전 경험을 바탕으로 약한 사고를 점진적으로 개선하여 문제를 해결할 수 있음을 보여줍니다. 둘째, 이러한 강화 메커니즘을 구현하기 위해 경험 중심의 반복적 프로세스를 수행하는 BoT(Boosting of Thoughts)라는 새로운 프레임워크를 제안합니다. 간단한 프롬프트에서 시작하기 때문에 BoT는 다양한 작업으로 확장할 수 있습니다. BoT는 유효성을 보장하면서 간단한 사고 구조를 병렬로 구축하고 몇 번의 반복을 거쳐 솔루션으로 수렴하기 때문에 속도가 빠릅니다. 마지막으로 GPT-4와 LlamaV2를 사용하여 복잡한 수학 문제에 대한 BoT의 성능을 평가했습니다. GPT-4 OpenAI(2023)와 LlamaV2 투브론 외(2023)를 사용하여 복잡한 수학 문제에 대한 BoT의 성능을 평가했습니다. 문제 해결률에 따르면 바이너리 트리 사고방식 구조를 가진 BoT는 GSM8K와 AQuA에서 현재의 최신 기술을 크게 능가하는 반면, 다른 데이터 세트에서는 두 번째로 좋은 결과를 얻었습니다. 특히 BoT는 새로운 고난도 과제인 24개의 게임에서 선도적인 방법인 ToT를 9.7% 앞섰습니다. 따라서 BoT는 단서를 보강하고 잘못된 사고 사슬의 오류 분석을 축적하며 그에 맞는 제안을 함으로써 사람의 주석 없이도 LLM이 광범위한 과제에서 높은 성능을 유지할 수 있음을 입증했습니다.

2. 관련 작업

다단계 추론.. 연쇄적 사고(CoT) 프롬프트에 관한 저명한 연구에 따르면 각 문제 프롬프트에 중간 추론 단계를 제공함으로써 LLM의 단계적 추론 행동을 자극할 수 있다고 합니다. 최근 연구인 생각의 나무(ToT)는 순차적 추론 과정을 각 생각(노드)이 이전 추론 경로를 고려하여 여러 개의 다음 생각을 생성할 수 있는 트리 구조로 변환합니다. 추론 과정 중 역추적과 확장 탐색을 통해 ToT는 GPT-4에도 도전하는 문제에서도 우수한 성능을 발휘합니다. 높은 용량을 고려할 때, BoT의 기본 사고 구조는 대부분 ToT의 사고 트리 구조를 활용합니다. 그리고 부스팅 프레임워크로 인해 각 반복에서 BoT가 생성하는 트리 구조는 각 노드가 많은 수의 하위 노드에 대응하는 ToT의 복잡한 트리가 아닌 이진이고 얕습니다. 그러나 기본 구조가 ToT에 국한되지 않는 반면, BoT는 기본 사고 구조가 ToT, GoT Besta 등(2023), CR Zhang 등(2023b)이 될 수 있어 유연하며, 사고 구조를 그래픽 형식으로 확장한 가장 최근 연구인 사고 그래프(GoT) Besta 등(2023)이 가장 최신 연구입니다. 이 백서에서는 기본 사고 구조인 ToT에만 초점을 맞추고 GoT의 활용은 향후 연구로 남겨두겠습니다.

자동 제안. 작업별 단서에서 인간을 해방시키는 것은 많은 관심을 끌고 있습니다. LLM의 추론 능력을 보장하기 위해 기존의 CoT는 인간의 선험적 지식에 의존하여 작업별 예시를 수동으로 생성하여 프롬프트로 사용했습니다. 그러나 제로 CoT에서는 수작업으로 만든 예시 없이도 프롬프트에 "단계별로 생각해 봅시다"라는 문구를 추가하는 것만으로 LLM이 단계별로 추론하여 정확한 답을 얻을 수 있음을 보여주었습니다. 이러한 인사이트는 일련의 후속 연구를 낳았습니다.Auto-CoT는 제로 CoT에서 생성된 사용 가능한 추론의 사슬을 검색하여 수작업을 없애고, Active-Prompt는 먼저 질문 세트의 불확실성을 측정하여 사람이 주석을 달 불확실한 질문만 선택하며, ToT 역시 수작업을 줄이지만 각 작업에 대해 여전히 전문가가 프롬프트에 가능한 다음 생각을 제시해야 합니다. 이 백서에서는 수동 단서 없는 부스팅에 대한 새로운 접근 방식을 소개합니다. 간단한 단서에서 시작하여 BoT는 사고에 대한 LLM 분석을 기반으로 반복적으로 이를 향상시킵니다.

피드백을 통한 팁 엔지니어링. 입력 프롬프트에 대한 LLM의 반응을 추가 수정을 위한 피드백으로 사용하는 것이 많은 주목을 받고 있습니다. LLM이 평가한 출력에 대한 설명을 바탕으로 주어진 단서를 지속적으로 수정하는 사람들은 정확한 답을 얻는 것을 목표로 합니다. 우리 논문과 유사한 높은 수준의 아이디어를 사용하여 SELF-REFINE은 LLM이 피드백을 생성하여 출력을 더욱 구체화할 수 있는 반복적인 자기 개선 알고리즘을 제안합니다.PHP는 이전 답변의 솔루션을 후속 힌트에 힌트로 직접 추가하여 이 과정을 단순화하고, REFINER 역시 우리 논문과 관련하여 각 추론 단계를 피드백으로 평가하여 보다 합리적인 답변을 생성합니다. 피드백으로 평가합니다. 또 다른 일련의 연구는 통합, 특히 부스팅 메커니즘의 사용을 탐구했습니다. Freund 등(1996)은 일련의 예제에서 피드백을 통해 힌트를 개선했습니다. 이들은 이전 반복에 불확실한 여러 예시를 추가하여 프롬프트를 조정하거나 피드백-반성-개선 프로세스에 의존했으며, APO Pryzant 등(2023)은 이전 프롬프트의 성능을 사용하여 최적화된 자연어를 형성하기 위해 반복적으로 프롬프트를 개선했습니다. 이러한 연구는 큐 엔지니어링에서 부스팅 메커니즘의 효과를 입증했습니다. 그러나 효과적인 추론 체인을 생성하기 위해 힌트를 향상시키는 데 있어 오류 분석의 중요성을 강조한 것은 이번 연구가 처음입니다. 제안된 BoT는 시행착오 추론 경험을 반복적으로 축적함으로써 이러한 통찰력을 자동화된 프롬프트 프레임워크로 확장합니다.

3. 사고력 향상

3.1 배경

큐 엔지니어링의 목표는 이 큐를 통해 입력으로 사용할 여러 언어 시퀀스를 포함하는 큐 I와 θ로 매개변수화된 pθ로 표시되는 사전 학습된 대규모 언어 모델(LLM)을 설계하여 원하는 언어 시퀀스 y에 액세스하는 것입니다. 따라서 표준 입출력(IO)은 y ∼ pθ(y|I (X, Q))로 표현할 수 있으며, 여기서 I(-)는 큐 래핑 작업 명령어 X 및 해당 질문 Q를 나타냅니다.

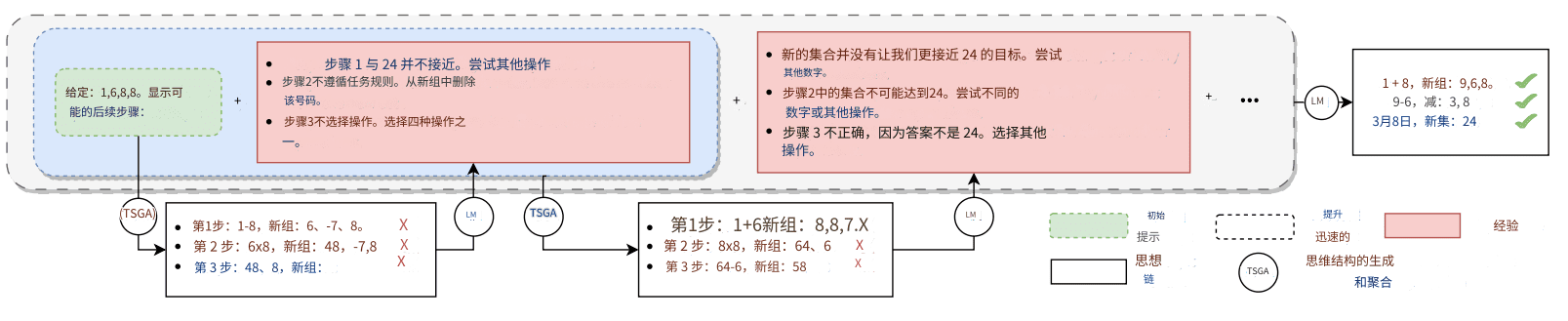

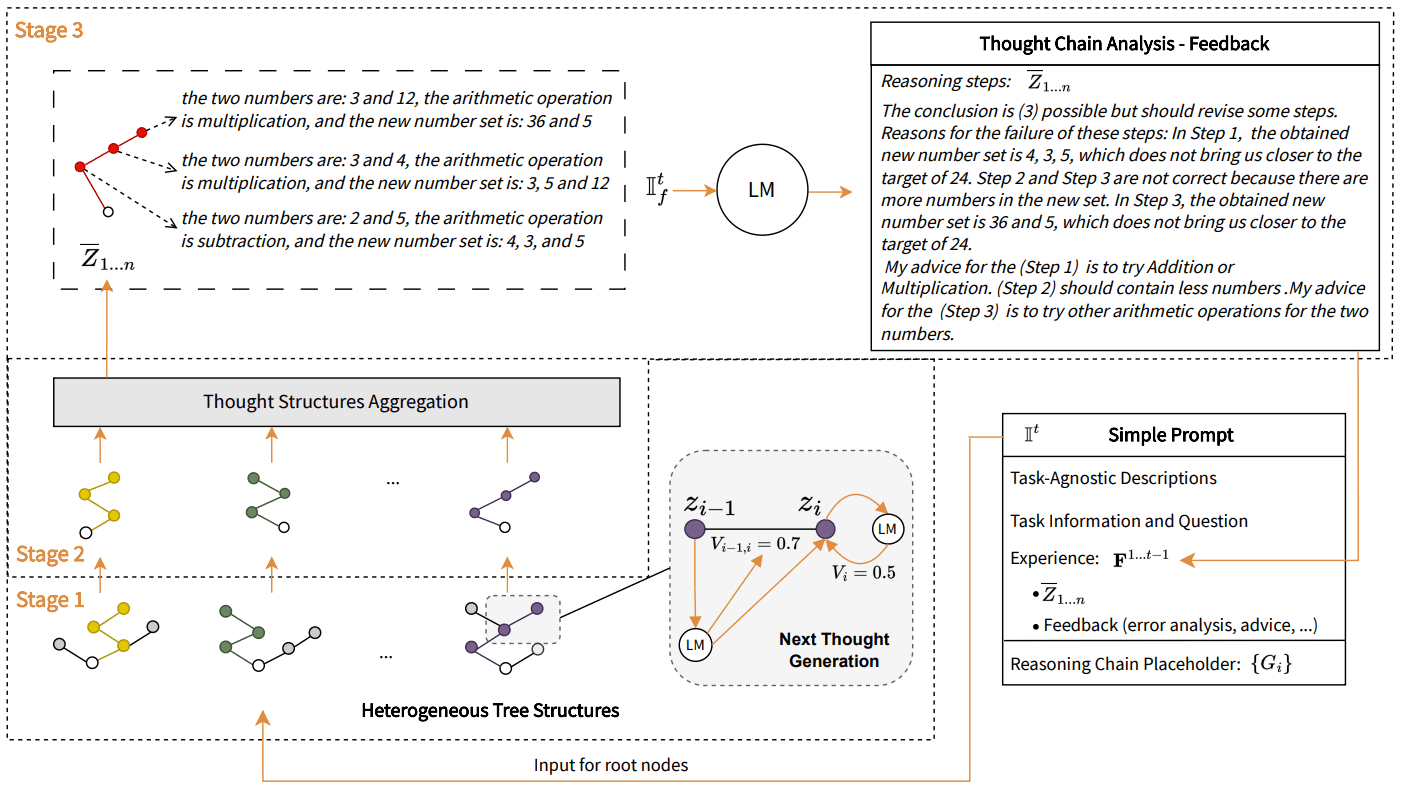

이 그림은 산술 연산을 사용하여 문제를 해결하는 사고 과정을 시각적으로 표현한 것입니다. 사고 구조 통합, 다음 사고 생성, 사고 사슬 분석-피드백의 세 가지 주요 부분으로 나뉩니다.

사고 구조 집계는 다양한 추론 단계(1단계, 2단계, 3단계)의 조합을 나타내며, 각 단계에는 결론에 도달하기 위해 취한 단계를 설명하는 고유한 숫자 구조가 있습니다.

다음 생각 생성은 특정 단계에 초점을 맞춰 언어 모델링(LM)을 사용하여 이전 경험(Vi-1 및 Vi 벡터로 표시)을 고려하고 새로운 추론의 사슬을 생성하여 다음 생각을 예측하는 방법을 보여 줍니다.

사고 사슬 분석 - 피드백은 수행한 추론 단계에 대한 자세한 분석을 제공하여 가능한 오류를 지적하고 개선을 위한 제안을 제공합니다. 목표 숫자(이 경우 24)에 더 가까워지는지 평가하여 단계를 비판하고 시도해 볼 다른 산술 연산을 제안합니다.

또한, 작업 불특정 설명, 작업 정보 및 질문, 새로운 생각을 생성하기 위한 자리 표시자 역할을 하는 이전 추론 체인에서 얻은 경험 등 사고 과정에 대한 입력을 요약하는 간단한 큐잉 섹션이 있습니다.

전반적으로 이 그림은 언어 모델을 사용하여 사고 과정을 반복적으로 최적화하고 개선하는 추론과 문제 해결에 대한 방법론적으로 건전한 접근 방식을 보여줍니다.

구체적으로 사고 구조 집계 섹션을 살펴봅시다. 이 섹션에서는 각각 색상이 지정된 이질적인 트리 구조를 가진 세 단계를 볼 수 있습니다. 1단계에서는 몇 가지 산술 연산을 볼 수 있으며, 추세는 "vi1 - 0.5"입니다. 2단계에서는 더 많은 산술 연산을 볼 수 있으며 추세는 "vi2 - 0.6"입니다. 마지막으로 3단계에서는 "vi3 - 0.4"의 추세를 가진 일련의 산술 연산을 볼 수 있습니다.

다음 생각 생성 섹션에서는 특정 생각 노드인 Zi를 추적하고 그에 수반되는 가중치인 vi를 표시하여 문제 해결의 맥락에서 이러한 생각의 중요성을 나타냅니다.

사고 사슬 분석 - 피드백 섹션에는 몇 가지 추론 단계가 표시되어 있습니다(Z1,Z2.... .Zn) 및 이를 평가했습니다. 이러한 각 단계에 대해 "R1:-3, 시도 +", "R2:+3, 시도 -", "R3: -1, 시도 ×"는 특정 단계에 대한 피드백을 나타냅니다. 피드백, 추론에 대한 평가 및 개선 방법에 대한 제안을 나타냅니다.

간단한 힌트 섹션에서는 "과제 비특정 설명 '숫자 게임하기'", "과제 메시지 '숫자 1,3,4,6 네 개를 사용해 보십시오. 6(각 숫자는 한 번만 사용할 수 있음)과 산술 연산(덧셈, 뺄셈, 곱셈, 나눗셈)을 사용하여 숫자 24에 도달하세요'" 및 이전 추론 체인 Gi와 같은 힌트를 확인할 수 있습니다.

이 파이프라인의 결과는 다음 추론을 위한 새로운 사고 프로세스를 생성합니다.

이 다이어그램은 사고 과정과 추론 방법론의 논리적 흐름을 나타내며, 각 단계마다 중요한 피드백과 평가를 통해 언어 모델(LM)과 피드백/제안 메커니즘을 사용하여 문제를 진행하는 방법을 보여줍니다.

그림 2: 각 반복의 BoT 프로세스에 대한 개요를 보여줍니다. 이 경험적 기반 반복 프로세스에서 어떻게 효율성을 높일 수 있는지 보여드리기 위해 24점 게임 데이터 세트에 대한 ChapGPT-4의 한 종류의 실험에서 얻은 철저한 중간 결과를 보여줍니다. "주어진 네 개의 숫자는 2, 4, 5, 5"라는 문제 Q가 주어지면 BoT는 세 단계로 연속적으로 진행됩니다. 사고 구조 생성(1단계)에서는 간단한 단서 It을 입력으로 사용하여 다양한 이질적인 트리 형태의 사고 구조를 출력합니다. 사고 구조 통합(2단계)에서는 이를 하나의 사고 체인 z1..... .n으로 통합한 다음, 3단계에서 이 생각의 사슬을 분석하여 단서를 더욱 강화하는 데 사용할 수 있는 경험을 생성합니다.

프롬프트는 LLM이 단계별로 문제를 풀도록 안내하기 위해 더 정교하게 설계될 수 있습니다. 각 중간 추론 단계는 zi(생각이라고도 함)로 표시되며, CoT는 몇 가지 예를 제공하며, 각 답변에는 일련의 생각 z1.... .n. 이것은 y ∼ pθ y|I [z1 . .n]N , X, Q로 이어지며, 여기서 N은 프롬프트에 포함된 예의 수입니다.

부트스트랩에서 예제를 준비하는 것보다 더 유연한 접근 방식은 추론 과정에서 LLM이 점진적으로 생각 zi를 생성하도록 부트스트랩을 설계하는 것입니다. 이는 zi ∼ pθ (zi |I(z1.... .i-1, X, Q))로 공식화할 수 있습니다. 마지막으로, 해는 y ∼ pθ (y|I(z1.... .n, X, Q))로 공식화됩니다.

대표적으로 ToT Yao 등(2024)은 이 순차적 추론 단계를 다음 생각을 생성할 수 있는 트리 구조로 확장합니다. 따라서 리플렉션의 구조는 연쇄적이거나 나무와 같은 구조가 될 수 있습니다.

3.2 프레임워크

올바른 CoT 예시를 통해 단서를 생성하거나 세분화된 사고 생성 구조를 설계하기 위한 기존 문헌에는 세 가지 한계가 있습니다. 첫째, 이러한 접근 방식에서는 일반적으로 잘못된 사고가 무시되거나 버려집니다. 그러나 인간, 특히 비전문가, 특히 다른 영역의 인간은 이전 오류를 분석하여 다음 시도에서 올바르게 수행하기 위해 더 많은 경험을 수집하는 데 의존합니다. 둘째, 각 작업마다 다음 생각을 생성하기 위한 예제(예: I(z1|z0, X, Q))가 큐에 제공되어야 하므로 확장성이 떨어집니다. 마지막으로, 사고 구조(예: Yao 등의 트리 구조)의 생성은 너무 복잡하여 더 나은 솔루션을 얻기 위해 더 많은 추론 단계를 탐색하기 어렵습니다. 이는 주로 얻은 솔루션을 더 이상 수정할 수 없다는 사실 때문입니다.

이 논문에서는 이러한 잘못된 사고(사고 사슬의 잘못된 추론 단계)에 대한 분석을 LLM으로부터 지속적으로 수집함으로써 프롬프트를 향상시킬 수 있다고 주장합니다. 따라서 잘못된 사고로 이어질 수 있는 I(X, Q)와 같은 단순한 단서라도 이러한 분석에 의존하여 점진적으로 개선함으로써 해결책에 더 가까워지는 강력한 사고를 얻을 수 있습니다.

다음과 같은 방법을 제안합니다.생각의 부스팅(BoT)에서 경험 중심의 반복 프로세스를 통해 큐를 향상시킬 수 있는 자동화된 큐잉 프레임워크를 개발했습니다.더 단순하게큐의 시작입니다. 그림 2에 표시된 대로 요약하면, BoT의 각 반복 t는 세 단계로 구성됩니다. 사고 구조 생성 단계에서는 입력 프롬프트를 It으로 하여 LLM이 생성한 추론 체인을 최대한 활용할 수 있습니다. 두 번째 단계에서는 이러한 사고 구조를 추론 체인으로 집계하여 세 번째 단계에서 LLM이 분석하여 오류 보고서와 세부 수정 제안을 포함한 피드백을 생성합니다. 이렇게 집계된 추론 체인은 피드백 결과와 결합되어 Ft로 표시되는 새로운 경험을 형성합니다. 따라서 이러한 경험을 F1..... .t 반복에 걸쳐 이러한 경험을 축적함으로써 큐가 향상됩니다.

간단한 팁. 모든 작업에 대해 반복 t = 0에서 간단한 초기 단서 I0 ≡ {S, X, Q, F0, {Gi}}를 생성하는데, 여기서 S는 작업 독립적인 설명을 나타내고, X와 Q는 각각 작업 정보 및 질문을 나타냅니다. 프롬프트의 경험적 부분은 F0으로 표시되며 처음에 비어 있어야 합니다. {기}}는 사고 구조를 구성할 때 채워지는 자리 표시자입니다. 즉, 다음 생각 zi를 생성할 때 {Gi}는 이전 생각 체인 z1.... ,i-1.

사고 구조 생성. 경험 Ft-1 을 수집한 후 반복 t 에 대한 큐는 It ≡ {S, X, Q, F1, ... ,t-1, {Gi}}. 이 단서를 기반으로 BoT는 병렬로 M개의 사고 구조를 생성하며, BoT는 기본적으로 모든 사고 구조(예: 연쇄적인 웨이 구조 또는 트리와 같은 야오 구조 등)를 포함할 수 있습니다. 추론 단계의 탐구와 실험 결과를 고려하여 우리는 나무와 같은 사고 구조를 조사했습니다. 그러나 BoT는 리프팅 프레임워크에 더 적합하도록 두 가지 새로운 수정 사항을 도입했습니다.

- 가중 이진 트리. 각 라운드에서 간단한 단서를 사용하여 BoT는 부스팅 메커니즘에서 추가로 수정할 수 있기 때문에 구조가 단순하고 복잡성이 낮은 약한 마음을 구성합니다. 따라서 BoT의 각 사고 구조는 얕은 가중치 바이너리 트리입니다. 간단히 설명하기 위해 z1.... .i-1 기호를 사용하여 루트 노드에서 노드 i의 부모 노드까지의 생각을 나타냅니다. 각 노드 i에 생각 zi와 그 생각 평가 점수 Vi ∼ pθ(z1.... .i, Ia, X, Q), 자식 노드와 부모 노드 사이에 에지 점수 Vi-1,i ∼ pθ(zi-1, zi, Ie, X, Q)도 포함하며, 여기서 Ia와 Ie는 각각 생각의 안내 설명과 에지 평가를 나타냅니다. vi-1,i는 이 추론 단계를 생성할 때 LLM의 신뢰 수준을 나타냅니다. 따라서 이 트리 구조에서 BoT의 다음 생각 생성은 pθ(zi| (Vi-1,i, Vi, It, X, Q))로 공식화됩니다.

- 트리 이질성. 크고 복잡한 트리에서 해결책을 찾으려는 ToT와 달리, BoT는 매우 이질적인 트리와 같은 사고 구조를 구축하는 것을 목표로 합니다. 따라서 이질성을 높이기 위해 사고 구조 생성은 레이어별 성장과 잎사귀별 성장과 같은 다양한 트리 성장 전략을 사용합니다. 전자는 탐색을 강조하지만 Chen & Guestrin(2016)을 덜 활용하고, 후자는 그 반대입니다(Ke et al., 2017). 따라서 잎사귀별 전략은 계층별 성장에 비해 현재의 최선의 생각에서 더 나은 최종 생각으로 추론을 계속하는 경향이 있지만, 추론의 연쇄가 단조로워지는 경향이 있습니다. 또한 온도와 Top p 설정이 다른 LLM을 적용했으며, 마지막으로 BoT에서 작은 최대 깊이 값을 사용하여 Vi-1,i 및 Vi 값이 지정된 범위[0.3, 0.8]를 벗어날 때 노드를 리프(leaf)로 표시했습니다.

사고 구조 중합. M 개의 사고 구조를 얻은 후 BoT는 이를 z1.... .n. 이를 위해 각 사고 구조 인덱스 m에 대해 BoT는 먼저 평가 점수가 가장 높은 체인(즉, zm 1...)을 선택합니다. .nm := arg maxz1... .n∈Zm ∑i=1 Vi + Vi-1,i, 여기서 Zm은 m번째 트리의 모든 생각 체인의 집합을 나타냅니다. 결과적으로 z1.... .n.

- 베스트 퍼스트 집계.BoT는 인수 maxz1.... .n∈{Zm}M m=1 ∑i=1 Vi + Vi-1,i로, M 개의 사고 구조 중 가장 좋은 것을 z1.... .n. 이 알고리즘은 빠르지만 비논리적 연쇄로 이어질 수 있어 후속 개선을 유도하기 어렵습니다.

- 탐욕 집계에서 BoT는 존재하지 않지만 전역적으로 최적일 수 있는 새로운 마음의 사슬을 조합하기 위해 {Zm}M m=1에 대해 탐욕적인 탐색을 수행할 수 있습니다. 일반적으로 트리의 루트 노드인 초기 생각에서 시작하여 BoT는 z1 = arg maxzj ∈ {zm 1 } M m=1 Vj + Vj-1,j를 얻습니다. 그 후, BoT는 zi를 얻기 위해 {Zm}M m=1에서 이전 단계가 zi-1이었던 모든 생각을 검색합니다.

사고의 사슬 분석. 더 나은 사고를 생성하기 위해 큐를 개선하기 위해 무엇을 조정해야 하는지에 대한 통찰력을 얻기 위해 BoT는 LLM의 자체 평가 기능인 z1.... .n. 특히, 큐 It f (z1.. .n, X, Q)를 입력으로 사용하여 LLM은 이 일련의 사고에 대한 정보가 포함된 피드백 단락을 출력합니다. z1.... .n에 문제 보고서와 자세한 제안이 포함된 피드백 단락을 출력합니다. 이 피드백은 F1,... ,t-1에 새로운 생각 생성의 경험으로 추가되어 F1,... ,t.

반복적 개선.. 부스팅 메커니즘을 통해 F1,... ,t는 큐를 반복적으로 증강하는 데 사용되며, (t+1)번째 반복에 대한 큐 It+1은 ≡ {S, X, Q, F1,... ,t, {Gi}}. 반복이 진행됨에 따라 F1,... ,t에는 잘 정의된 분석 결과와 함께 해에 가까운 생각의 사슬뿐만 아니라 비논리적인 전형적인 생각의 사슬도 많이 포함될 수 있습니다. 따라서 단순한 힌트로 시작하더라도 BoT는 이 힌트를 반복적으로 개선하여 정확한 솔루션으로 이어지는 올바른 추론 단계를 생성합니다. T회 반복 후에는 최종 해답에 대한 LLM의 입력 힌트로 It+1을 사용합니다.

4. 실험

데이터 집합. 실험은 MMLU, SVAMP, GSM8K, AQuA, MATH 등 다양한 수학 문제가 포함된 벤치마크 데이터 세트에서 수행되었으며, 4개의 숫자와 기본 산술 연산(덧셈, 뺄셈, 곱셈, 나눗셈)을 사용하여 1방정식에서 24를 구하는 것이 목표인 도전적인 수학적 추론 과제인 Game of 24를 포함시켰습니다. 은 3단계의 중간 단계로 구성되어 있습니다.

경쟁. 벤치마크 방법인 표준 입출력(IO) 외에도 입력 프롬프트에 소수의 예제(8개)와 사람의 주석을 포함하는 연쇄적 사고(CoT), CoT-SC, 복잡한 CoT를 비교 대상으로 삼았습니다. 또한 BoT는 사고 트리(ToT), 점진적 프롬프트(PHP), 최신 CSV 등 관련 작업과 비교했으며, GPT-4와 Llama2를 사용하여 실험을 진행했습니다.GPT-4는 OpenAI API를 통해 액세스한 반면, llama2-13b-chat 모델은 로컬에서 실험을 수행하기 위해 MetaAI에서 다운로드했습니다. 이기종 트리 사고 구조를 구축하기 위해 BoT는 온도 범위[0.2, 0.4, 0.6, 0.7, 0.9, 1.1, 1.5]와 최고 p 범위[0.1, 0.3, 0.5, 0.7, 0.9]의 온도를 임의로 선택했습니다.

설정. 명시적으로 언급되지 않는 한, 모든 실험에서 BoT는 T = 10번의 반복을 수행하고 M = 15개의 사고 구조를 구성하며, 각 구조는 가중 이진 트리이므로 이것이 가장 좋은 결과를 산출하는 경향이 있습니다. 또한 이러한 벤치마크 데이터 세트의 경우 트리의 깊이를 5로 설정한 반면, Game of 24의 해당 깊이는 3입니다. BoT + CoT는 간단한 단서에 CoT의 예시 5개를 포함한다는 의미입니다. 절제 연구에서는 BoT에 누적 경험이 없는 경우 프롬프트에 8개의 CoT 예시가 제공됩니다.

metric. 모든 실험의 결과를 작업의 해상도(%) 측면에서 측정하고 보고합니다. BoT 출력 zT1.... .n의 대상 답변에서 LLM을 위해 특별히 답변에 대한 형식화된 설명을 설정했습니다. 일반적으로 사용되는 데이터 세트의 경우, 답의 형식은 "답은:"으로 설정했습니다. 24점짜리 게임의 경우 "단계 색인, 현재 집합:, 선택된 두 숫자:, 연산:, 연산에서 나온 새 숫자:, 남은 숫자:, 새 숫자 집합:"을 사용합니다. 그런 다음 새 숫자 집합의 숫자를 기준 진실과 직접 비교합니다. ToT Yao 등(2024)을 참조하여 100개의 어려운 게임에서 계산된 솔루션 비율을 지표로 사용합니다.

4.1 주요 결과

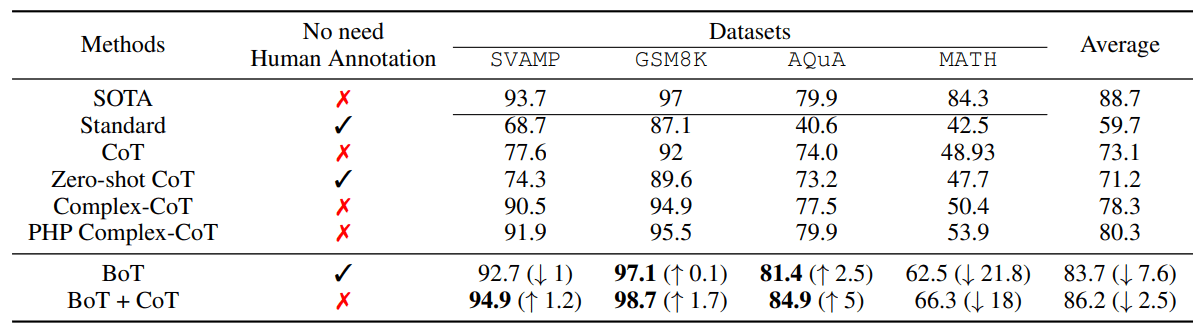

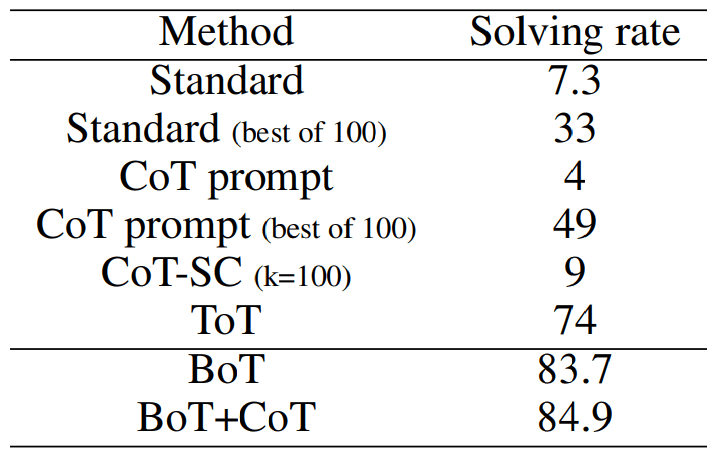

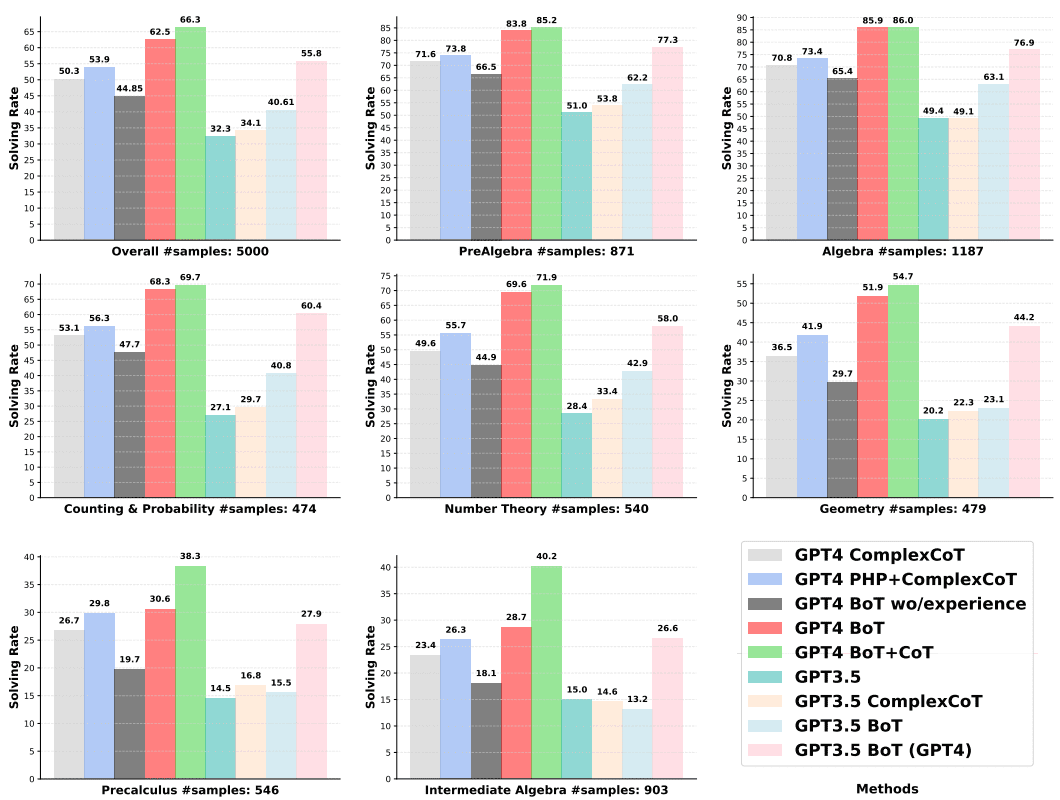

주요 실험 결과는 표 1과 그림 3에 요약되어 있으며, 이를 통해 BoT의 전반적인 성능에 대한 통찰력을 제공합니다. 실험 결과에 따르면, 제안된 BoT는 다음과 같은 메커니즘을 강화했습니다1). 대부분의 데이터 세트에서 사람의 주석과 무관하게 경쟁력 있는 문제 해결률을 달성합니다.) CoT 예제를 제공할 때 새로운 최신 기술을 달성합니다. 그러나 실험 결과에 따르면 BoT는 경험에 크게 의존하기 때문에 LLM의 기능에 매우 민감하게 반응한다는 사실도 밝혀졌습니다.

구체적으로 표 1에서 BoT는 간단한 초기 힌트로 시작하여 결국 GPT-4 코드 인터프리터에 크게 의존하는 GSM8K에서 해결 속도 측면에서 현재 최신 CSV를 0.11 TP3T 앞섭니다. 이는 사람의 주석에 의존하지 않고 힌트에 오류 분석과 제안을 추가함으로써 LLM이 복잡한 추론에서도 우수한 성능을 발휘할 수 있음을 보여줍니다. 그 주된 이유는 단순한 힌트도 이전 경험을 축적하여 문제를 정확하게 해결함으로써 점진적으로 개선될 수 있기 때문입니다. 프롬프트에 CoT 예시를 포함시킨 후 BoT+CoT는 SOTA보다 1.3% 더 높았는데, 이는 CoT 예시가 경험의 성공 사례로 간주되어 BoT에서 후속 사고 구조의 생성을 직접적으로 유도하기 때문이라고 주장합니다. 따라서 반복적인 개선을 통해 BoT+CoT는 새로운 SOTA에 도달했으며, 특히 BoT와 BoT+CoT는 수학에서 SOTA보다 최소 18% 낮았으며, 이러한 관찰은 LLM이 유효한 경험에 대한 추론 연쇄를 분석하는 능력이 낮기 때문에 약한 LLM이 BoT에서 잘 작동하지 않을 수 있음을 시사합니다.

표 1: GPT-4와 함께 BoT를 사용하면 수동 주석 없이도 성능이 크게 향상됩니다.

BoT의 간단한 초기 큐에 CoT 예시가 포함된 경우, 해당 BoT+CoT 접근 방식이 더 높은 해결률을 보였습니다. 또한 이 프레임워크는 2023년 Zhao 외의 모델 선택, 2023년 Zheng 외의 PHP, 2023년 Zhou 외의 CSV와 같은 주요 접근 방식과 비교하여 각각 SVAMP, AQuA, GSM8K & MATH 데이터 세트에서 최첨단(SOTA) 성능을 달성했습니다.

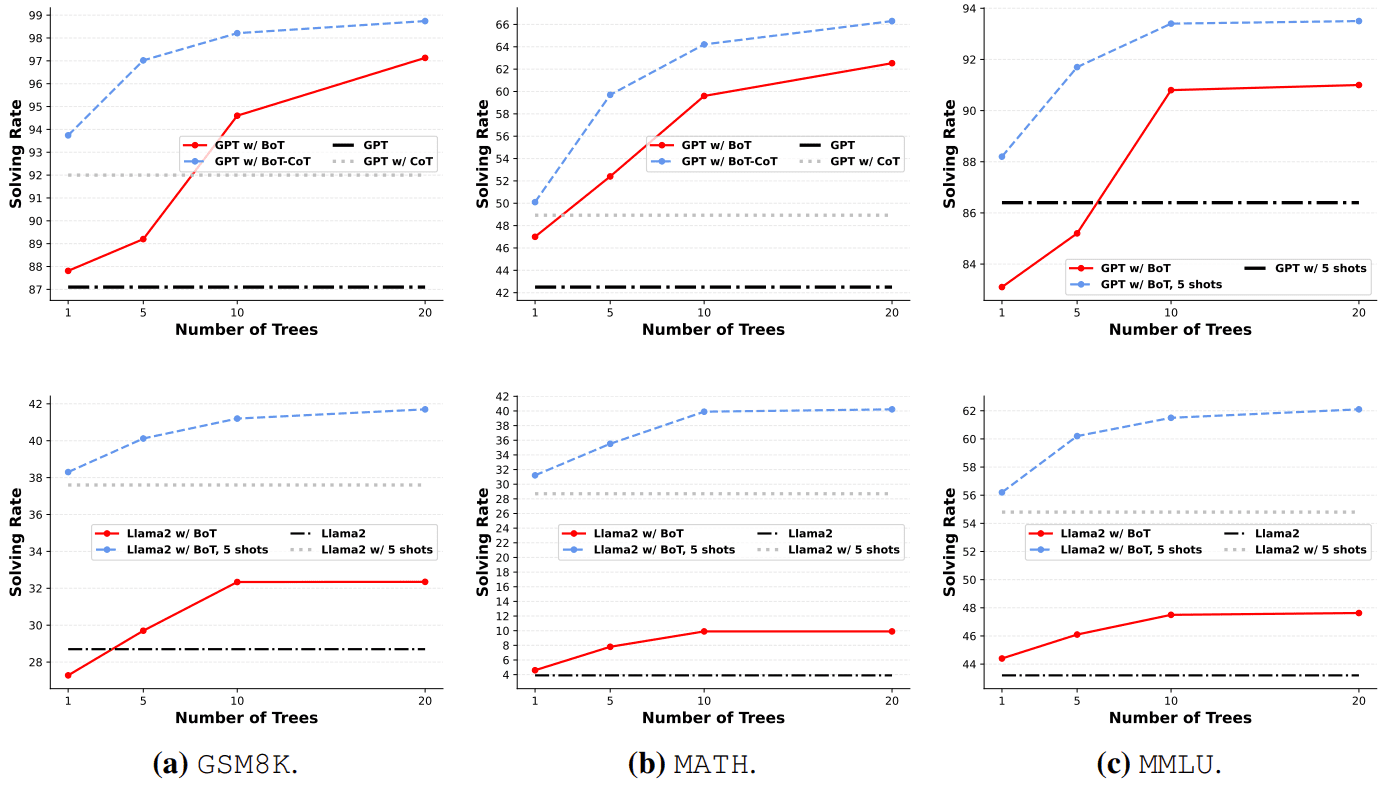

그림 3: 2023년, BoT 및 BoT+CoT를 사용하여 라마2 투브론과 함께 GPT-4 OpenAI의 문제 해결 속도를 평가하는 모습(Llama2 Touvron 외).

그림 3에서 볼 수 있듯이 GPT-4와 Llama2는 BoT 조건에서 세 데이터 세트의 평균 성능을 각각 11.61 TP3T와 4.41 TP3T 향상시킵니다. 이 두 수치는 그림 3에서 볼 수 있듯이 LLM이 더 강력할 때 BoT와 BoT-CoT의 성능이 비슷하다는 분명한 추세를 보여줍니다. 또한 트리의 수가 1에서 20으로 변화함에 따라 성능도 비슷한 상승 추세를 보입니다. 특히 그림 3(a)에서 볼 수 있듯이, Llama2가 약하기 때문에 BoT는 경험 중심 반복 프로세스를 수행하기 위한 분석의 이점을 누릴 수 없습니다. 유효한 성공 사례, 즉 5개의 테스트가 제공되면 BoT는 제한적이지만 점진적인 개선을 통해 Llama2가 기준선보다 더 많은 문제를 해결하는 데 도움을 줄 수 있습니다.

4.2 24점 게임

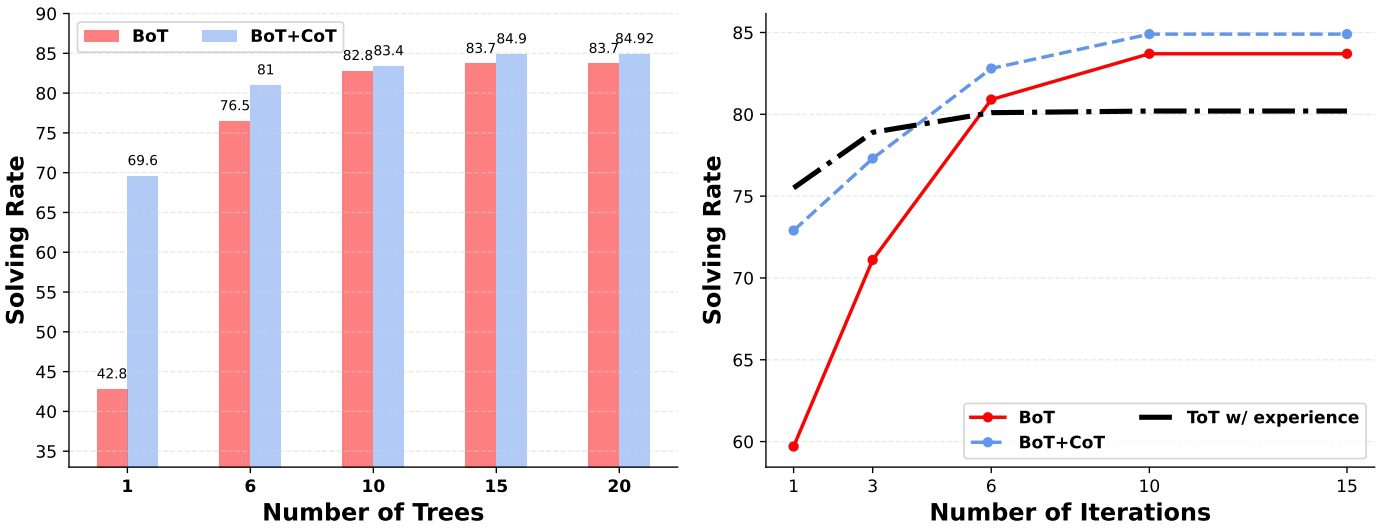

그림 4: 트리 수와 반복 횟수가 다른 세 가지 방법의 비교.

표 2: 토트 야오 외(2024)의 설정에 따른 24점 게임에서 다양한 방법의 설정과 그 결과가 여기에 나와 있습니다.

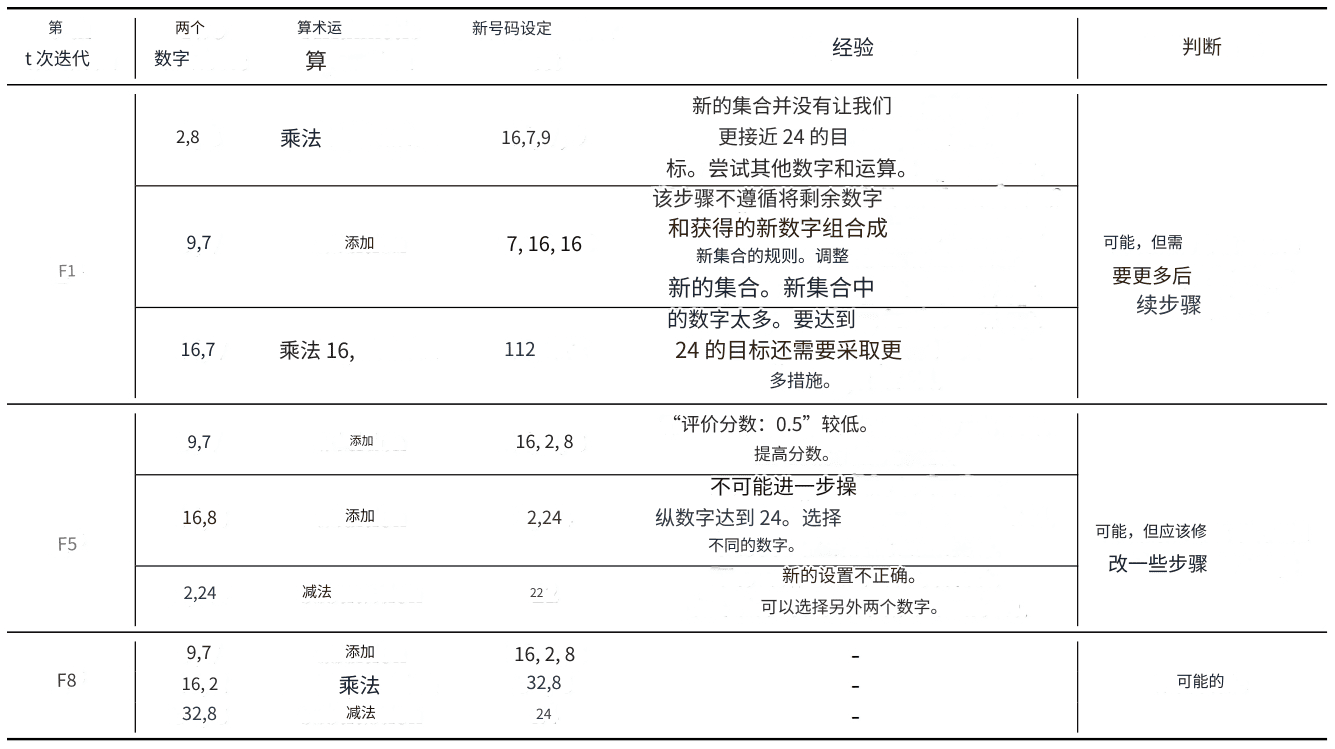

표 3: 1, 5, 8차 반복 동안 축적된 사고 과정과 얻을 수 있었던 경험을 보여줍니다. 주어진 네 가지 값은 2, 7, 8, 9입니다.

게임 오브 24 문제의 난이도 때문에 GPT-4와 라마2 모두 CoT와 CoT-SC 방식을 결합했을 때에도 이 과제에서 저조한 성적을 보였으며, 라마2 모델은 문제 해결을 위한 정확한 규칙조차 따르지 못해 해결률이 더욱 낮았습니다. 특히 경험에 의존하는 BoT를 적용했을 때, Llama2의 모든 결과는 큰 개선 없이 5%보다 낮았습니다. 따라서 여기서는 GPT-4를 사용한 BoT의 성능만 보고합니다. 공정한 비교를 위해 ToT Yao 등(2024)이 제안한 설정을 따릅니다.

표 2에서 볼 수 있듯이 사람의 주석이 없는 BoT는 예제에 의존하여 가능한 모든 다음 단계를 보여주는 ToT보다 9.71 TP3 T 더 성능이 뛰어납니다. 또한 5개의 CoT 샷이 포함된 BoT+CoT는 BoT보다 1.21 TP3 T 더 성능이 뛰어납니다. BoT와 BoT+CoT 간의 성능 근접성은 하위 섹션 4.1에서 설명한 대로 약한 사고를 점진적으로 수정하는 부스팅 메커니즘에 기인합니다. 경험 기반 반복 프로세스를 사용하는 BoT는 트리 수 M과 반복 횟수 T가 증가함에 따라 성능이 향상됩니다. 그림 4에서 볼 수 있듯이 BoT는 더 나은 생각의 사슬이나 더 긴 반복에서 경험을 수집해야 하기 때문에 BoT+CoT보다 M과 T에 더 많이 의존합니다. 또 다른 관찰은 ToT가 경험적 단서로 작동할 수 있게 되면 문제 해결률이 첫 번째 반복에서 72.51 TP3T에서 10번째 반복에서 80.21 TP3T로 증가한다는 것입니다. 이는 경험, 즉 이전 추론 연쇄의 분석이 LLM에서 해결률을 크게 향상시키는 데 사용될 수 있음을 시사합니다. 그러나 ToT가 얻은 점수는 여전히 BoT보다 3.51 TP3T 낮은데, 이는 BoT의 집계 단계가 현재 반복에서 가장 대표적인 추론 사슬을 생성하여 더 의미 있는 경험을 단서를 강화하도록 유도하기 때문인 것으로 보입니다. 이는 제거 연구 섹션에서 확인했습니다.

실수와 이전 제안을 통해 BoT가 학습하는 방식을 더 잘 보여주기 위해 표 3에서는 반복 횟수가 증가함에 따라 GPT-4가 이전의 실수를 피하고 더 구체적인 제안을 생성하여 결국 올바른 솔루션으로 이어질 수 있음을 보여줍니다. 첫 번째 반복에서는 단순한 힌트 때문에 3단계에서 새 세트가 잘못되어 작업 규칙을 따르는 데 실수를 하기도 했습니다. 분석 후 이 오류에 대해 올바른 제안을 했습니다. 그러나 초기 반복에 대한 분석은 "다른 숫자와 연산 시도"와 같이 모호했습니다. 5번의 반복 후 BoT는 이러한 여러 분석을 종합하여 보다 효과적인 힌트를 제공함으로써 LLM이 올바른 숫자 9와 7을 선택하도록 유도했습니다. 또한 제안이 더 구체적이고 유용했습니다. 이렇게 정답을 선택하면 그에 따라 평가 점수를 높이도록 제안했습니다. 이러한 경험을 축적하면서 BoT는 점차 힌트를 개선하여 결국 8번째 반복에서 올바른 솔루션을 직접 생성했습니다.

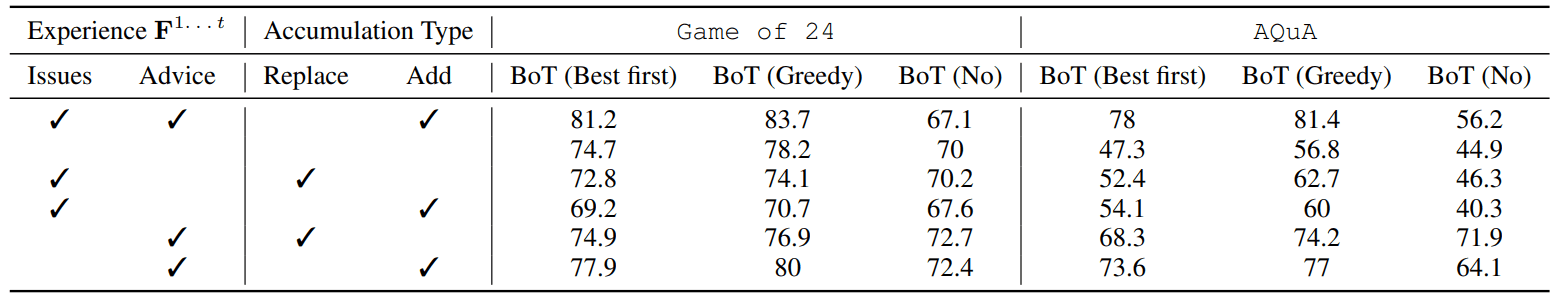

4.3 절제 연구

표 4: 24점 게임과 AQuA 데이터 세트에 사용된 다양한 BoT 변형을 사용한 GPT-4의 비교.

모든 집계 전략은 문제와 제안이 '더하기' 방식으로 풀링될 때 높은 풀이율을 생성합니다. 완전한 경험을 유지하는 것은 수정주의적 사고, 특히 더 넓은 범위의 수학적 추론 문제를 다루는 AQuA 데이터 세트에 특히 중요합니다. 그러나 스패닝 트리의 모든 추론 체인을 집계 없이 직접 사용하는 BoT(No)는 모든 상황에서, 특히 누적 경험 유형이 '누적'인 경우 최악의 성능을 보입니다. BoT의 각 반복에서 15개의 트리가 구성되는데, 이를 모두 큐에 넣으면 중요한 정보가 가려질 수 있고, 대부분 유효하지 않거나 유해할 수 있다는 것은 말할 것도 없습니다. 이러한 경험은 유효하지 않거나 유해할 수 있습니다.

조언을 얻는 것은 다른 어떤 것보다 생각을 촉발하는 데 중요합니다.. 표 4에 언급된 모든 예에서 제안을 경험으로 처리하는 BoT 변형이 가장 높은 해결률을 달성했습니다. 예를 들어, 동일한 '추가' 유형의 경우 경험에 제안이 없으면 '24점 게임'과 AQuA에서 각각 101 TP3T, 201 TP3T 이상 성능이 떨어집니다. 반면에 경험에 문제를 포함하면 보완적인 도구로 사용하여 성능을 개선할 수 있습니다. 제안이 있는 BoT는 문제와 함께 사용할 때만 최고의 해결률을 달성할 수 있습니다. 예를 들어, AQuA에서는 BoT(욕심 방식)의 해결률이 4.41 TP3T 증가했습니다.

성능상의 이유로, 탐욕스러운 랠리가 필요한 유일한 옵션일 수 있습니다.. 기존 사고 사슬 중 하나를 선택하거나 모두 유지하는 최우선 접근 방식과 달리, 욕심 많은 응집체는 현재 반복에서는 발생하지 않을 수 있는 더 나은 사고 사슬에 적응적으로 트리 구조를 병합할 수 있습니다. 이러한 방식으로 LLM은 보다 강력한 사고 사슬에 대한 의미 있는 분석을 수행할 수 있으며, 그 결과 단서를 보강하는 중요한 교훈을 생성할 수 있습니다. 더 많은 수학적 문제를 포함하는 AQuA에서는 이 수치가 101 TP3 T에 이르기도 합니다. 또한 그림 4에서 논의했듯이 ToT는 801 TP3 T에 도달할 수 있는 유사한 경험 중심 부스팅 메커니즘을 가지고 있지만 여전히 BoT보다 뒤처져 있는데, 이는 단일 트리 구조에서 탐욕스러운 응집을 수행하지 못하기 때문일 수 있습니다.

5. 결론

이 논문에서는 단순한 단서가 생성하는 생각에 대한 오류 분석을 점진적으로 축적함으로써 복잡한 작업을 해결하는 데 사용될 수 있음을 검증합니다. 경험 중심 반복 프로세스를 통해 점진적으로 단서를 보강하여 효과적인 생각의 사슬을 생성할 수 있는 새로운 프레임워크인 BoT(Boosting of Thoughts)를 제안합니다. 반복적인 탐색과 자기 평가를 통해 생성된 단순한 트리와 같은 생각의 사슬을 통해 간단한 초기 단서를 일련의 시행착오 추론 경험으로 점진적으로 보강하여 정확한 솔루션으로 이끌어낼 수 있습니다. 광범위한 실험을 통해 BoT는 여러 벤치마크 데이터 세트에서 최첨단 성능을 달성할 수 있으며, 게임 오브 24의 까다로운 수학적 추론 과제에서 다른 주요 방법보다 뛰어난 성능을 발휘하는 것으로 나타났습니다.

기본 프롬프트 및 추론 과정의 BoT

A1 사고 생성 컴포넌트를 위한 BoT

이 섹션에서는 제안된 생각의 부스팅(BoT)의 추론 생성에 사용되는 기본 힌트에 대해 설명합니다. 구체적인 관련 세부 사항은 소스 코드의 예제 파일인 /examples/BoostingOfThought/BoT reasoner.py에서 확인할 수 있습니다.

시스템 팁:

당신은 수학 문제의 전문가입니다. 일련의 시행착오 추론 경험을 통해 학습하여 단계별 문제 해결 추론을 수행합니다. 이 시행착오 추론 경험에는 특히 오류 보고서와 이전 추론 단계를 수정하는 방법에 대한 자세한 제안이 포함되어 있습니다. 새로운 추론 단계를 생성하기 전에 나열된 경험을 검토하는 것은 실수를 반복하지 않고 올바른 단계를 사용하여 문제 해결에 사용할 수 있는 더 나은 추론 단계를 생성하기 위한 방법입니다.

시스템 프롬프트 S.

귀하는 수학 문제에 대한 전문가입니다. 단계별 추론을 수행합니다.

시행착오를 거친 추론 경험의 집합체에서 먼저 학습함으로써 문제 해결을 향해 나아갈 수 있습니다.

이러한 시행착오 추론 경험에는 특히 다음과 같은 오류 보고서와 자세한 조언이 포함되어 있습니다.

기록 추론 단계를 수정하는 방법. 항상 나열된 경험을 떠올린 다음

새로운 추론 단계를 생성하여 동일한 실수를 반복하지 않고 올바른 단계를 재사용할 수 있습니다.

더 나은 추론 단계를 통해 과제를 해결합니다.

다음 생각을 위한 프롬프트를 생성합니다:

f"""

{미션 알림} \n

먼저, 이전 추론 경험을 떠올려 보세요.

{경험}\n\n

다음 가능한 추론 단계를 소개해 주세요. 추론 단계는 하나만 있을 수 있습니다. 이 추론 단계는 다음 순서의 순차적 후속 단계로 사용해야 하며 해당 평가 점수를 첨부해야 합니다(점수가 높을수록 작업을 완료할 가능성이 높음을 나타냄):\n\t

{체인 힌트}\n\n

위의 선행 추론 단계를 기반으로(또는 위의 공간이 비어 있으면 무시하세요) 작업 규칙에 따라 가능한 다음 단계를 생성합니다. (중요: 주어진 단계에 대해 가능한 다음 추론 단계만 생성하세요.)

"""

f"""{작업 프롬프트}. \n 우선 , 과거 추론 경험 떠올리기 : \n\n {

경험} \n\n 다음을 하나만 생성하도록 한 단계 추론해 주세요.

다음 추론 단계는 다음의 순차적 단계입니다. 다음 추론 단계는 다음 추론 단계의 후속 단계입니다.

평가된 점수와 함께 다음 순서의 이전 단계 (A

점수가 높을수록 추론 단계가 작업을 완료할 가능성이 높다는 의미입니다.) : \n\t{

체인 프롬프트}\n\n 나열된 이전 추론 단계에 따라 (

위 공백이 비어 있음), 작업 다음에 가능한 다음 단계를 하나 생성합니다.

규칙을 생성하세요. (강조: 다음 가능한 추론 단계는 단 하나만 생성하십시오.

주어진 단계를 수행합니다.) """

작업 프롬프트에는 작업의 X와 Q가 포함되며, 과거 경험은 F1.... 입니다. "연쇄 힌트" 부분은 {Gi}로, 현재 생각 zi가 수행될 때 이전 일련의 생각 z1...,i-1로 대체되는 자리 표시자입니다. ,i-1.

평가에 대한 생각에 대한 팁을 확인하세요:

f"""

{미션 경고} \n\n

아래는 추론 단계의 순서와 각각의 평가 점수가 나와 있습니다. (점수가 높을수록 해당 단계가 작업을 완료할 가능성이 높다는 의미입니다.) \n

{체인 힌트}\n

{사고}\n\n

이러한 추론 단계가 얼마나 논리적이고 올바른지, 그리고 최종 솔루션에 얼마나 도움이 되는지 평가하는 점수는 몇 점인가요? 0.1, 0.3, 0.5, 0.7, 0.9, 1.0] 중 하나를 점수로 선택해 주시고, 점수가 높을수록 더 나은 추론 단계를 나타냅니다. 점수는 사용자가 읽을 수 있도록 '평가 점수:' 뒤에 입력해야 합니다("""").

f"""{작업 프롬프트}. \n\n 다음은 생성된 추론 단계이며, 순서대로 표시됩니다.

평가된 점수와 함께 (점수가 높을수록 추론 단계가

작업을 완료할 가능성이 더 높습니다.) :\n{체인 프롬프트}\n{생각}\n\n귀하의

논리, 정확성, 결승 진출에 따른 혜택에 대한 평가 점수

이 추론 단계에 대한 솔루션은 무엇인가요? 0.1, 0.3, 0.5] 중에서 하나의 값을 선택하세요,

0.7, 0.9, 1.0]을 점수로 사용하며, 점수가 높을수록 더 나은 추론 단계를 의미합니다. 그리고

점수는 ' 평가 점수 :' 뒤에 배치해야 사용자가 .""""

이 경우 사고는 현재 진행 중인 사고 지입니다.

경험 생성 컴포넌트용 A2 BoT

집계된 체인에 대한 피드백을 생성하기 위해 LLM은 다음과 같은 기본 프롬프트를 사용합니다. 자세한 내용은 소스 코드 예제/BoostingOfThought/BoT commenter.py를 참조하세요.

시스템 프롬프트 S: 귀하는 수학 문제를 풀기 위해 생성된 추론의 연쇄를 평가하는 수학 정답의 AI 전문 검토자입니다. 이 추론 체인의 각 추론 단계를 평가하여 현재 단계가 이전 단계로부터 논리적으로 추론된 것인지, 추론 단계가 올바른 해답에 기여하는지 자세한 분석을 제공해 주세요. 각 잘못된 추론 단계에 대해 오류 보고서와 그에 따른 수정 제안을 제공하세요. 올바른 추론 단계마다 추천 또는 거부에 대한 설명을 제공하세요.

시스템 팁:

여러분의 역할은 수학 문제를 푸는 추론 과정을 평가하는 데 중점을 둔 숙련된 AI 수학 답안 검토자의 역할입니다. 각 추론 단계가 이전 단계의 논리에 기반하고 있는지, 이 단계가 정답을 찾는 데 기여했는지 철저한 분석을 통해 판단해야 합니다. 잘못된 추론 단계가 발견되면 수정할 수 있는 제안과 옵션을 제공해야 합니다. 올바른 추론 단계의 경우 확인하거나 다른 옵션을 제공해야 합니다.

시스템 프롬프트 S.

귀하는 수학 정답을 평가하는 전문 AI 검사기입니다.

수학적 문제를 해결하기 위해 생성된 추론 체인. 각 추론을 판단합니다.

현재 단계가 논리적인지 여부에 대한 자세한 분석을 제공함으로써 이 추론 체인의

이전 단계의 추론과 추론 단계가 올바른 솔루션에 도움이 되는지 여부를 확인합니다.

오류가 있는 각 추론 단계에 대한 조언과 제안을 제공합니다. 권장 사항 또는

각 올바른 추론 단계에 대한 거부 설명을 추가합니다.

피드백 팁:

f"""

주어진 작업에 대해:{작업 힌트}. \n

{추론 체인 힌트}\n\n

이 일련의 추론을 평가하고 다음 사항을 포함한 자세한 비평을 제공하세요. \n

1. {체인 피드백 형식}. 2. {단계 피드백 형식}. 3. {신뢰도 피드백 형식}. 4. \n\n

주의: {주의}

f"""주어진 작업:{작업 프롬프트}. \n{체인 프롬프트}\n\n 이 추론 체인을 평가해 주세요.

다음 내용이 포함된 자세한 주석을 제공함으로써 . \n 1.{

체인 피드백 형식 }. 2.{ 단계 피드백 형식 }. 3.{ 신뢰도 피드백 형식 }. \n

\n 공지 사항: {공지}.

여기에는 다음이 포함됩니다.추론 체인 힌트는 집계된 추론 체인 z1.... .n.

체인 피드백 형식이 추론 체인이 추론 단계를 수행하여 작업을 올바르게 완료하고 목표에 도달할 수 있나요? 왜 그럴까요? '분석 보고서:'에 결론을 내린 분석을 적습니다.

단계별 피드백 형식각 추론 단계마다 현재 단계가 이전 단계로부터 논리적으로 추론되는지, 추론 단계가 정답에 기여하는지에 대한 자세한 분석을 제공해 주세요. 각 잘못된 추론 단계에 대해 오류 보고서와 그에 따른 수정 권장 사항을 제공하세요. 각 추론 단계마다 권장 사항 또는 거부 사항에 대한 설명을 제공하세요. 의견은 간결하게 작성해야 하며 추론 단계 ⟨idx⟩ 형식을 따라야 합니다. 분석 ⟨idx⟩. 추천:. 추천 또는 거부 설명:.

자신감 피드백 형식이 평가 및 리뷰에 대한 신뢰 점수는 얼마입니까? 사용자가 읽을 점수로 [0.1, 0.3, 0.5, 0.7, 0.9, 1.0] 중에서 값을 선택하세요.

피드백 단서를 통해 LLM은 추론 체인 및 각 추론 단계에 대한 결론과 분석이 포함된 경험적 Ft를 생성합니다.

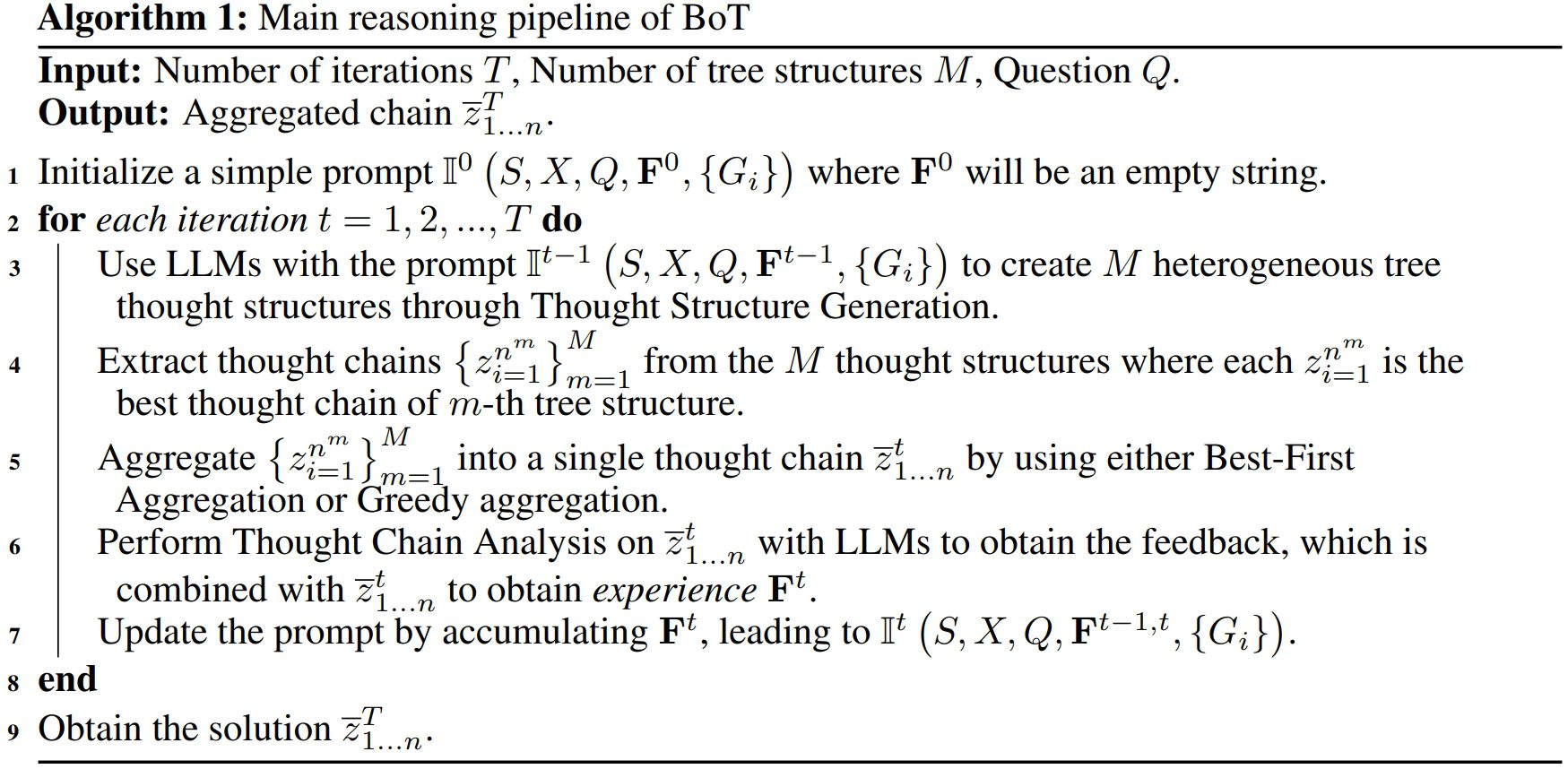

A3 추론 프로세스

제안된 생각의 부스팅에 대한 이해를 돕기 위해 알고리즘 표 1에 추론 흐름을 요약해 보았습니다. 이 흐름의 소스 코드는 examples/BoostingOfThought/BoT core.py 파일에서 찾을 수 있습니다.

BoT 원본

이미지의 내용은 "BoT"라는 이론을 단계별 알고리즘으로 표현한 것으로, 다음은 다음 알고리즘 단계에 해당하는 중국어 번역본입니다:

알고리즘 1: BoT의 주요 추론 과정

입력: 반복 횟수 T, 트리 구조 수 M, 문제 Q.

출력: 집계된 체인 z̄_1.... .n^T1. 간단한 힌트 I^0(S, X, Q, F^0, {Gi}를 초기화합니다. 여기서 F^0은 빈 문자열이 됩니다.

2. 각 반복 t = 1, 2, ... , T.

3. LLMS(저잠복 혼합 모델)와 함께 단서 I^t-1(S, X, Q, F^t-1, {Gi})을 사용하여 사고 구조 생성이라는 프로세스에서 M개의 서로 다른 사고 구조를 생성합니다.

4. M개의 사고 구조에서 {z̄_i=1....n^m}의 생각 사슬을 추출합니다, 각각의 z̄_i=1.... .n^m}, 각 z̄_i=1... .n^m은 M번째 트리 구조의 가장 좋은 생각 사슬입니다.

5. "최선 우선 집계" 또는 "욕심 집계" 방법을 사용하여 {z̄_i=1...n^m}을 단일 사고 체인 z̄_1...n^m}에 통합합니다. .n^m}을 하나의 생각 사슬 z̄_1...n^t. .n^t.

6. LLMS를 사용하여 z̄_1.... .n^t에 대해 "생각 체인 분석"을 수행하고 피드백을 얻은 다음 z̄_1.... .n^t와 결합하여 경험 F^t를 얻습니다.

7. F^t를 I^t(S, X, Q, F^t-1,t, {Gi})로 누적하여 큐를 업데이트합니다.

8. 결론

9. 솔루션 액세스 z̄_1.... .n^T

B 사고력 향상을 위한 인사이트

생각의 부스팅은 대규모 언어 모델(LLM)의 수학 문제 해결 추론 능력이 이전 오류에 대한 분석과 제안이 포함된 경험에서 직접적으로 도출된다는 통찰에서 비롯되었습니다. 표 5와 6의 비교에서 볼 수 있듯이, 추론을 수행하기 전에 LLM이 기억할 수 있는 유효한 과거 추론 경험이 단서에 포함되면 그 결과 추론 단계는 일반적으로 더 논리적이고 합리적입니다. 또한 이러한 인사이트를 통해 LLM이 각 작업에 대해 잘 준비된 프롬프트에 크게 의존할 필요가 없다는 점을 고려하게 되었습니다(프롬프트의 여러 사고 사슬 데모가 예시로 제시됨). 하지만 LLM은 경험을 통해 학습할 수 있기 때문에 예시나 수동으로 디자인한 콘텐츠가 필요 없는 간단한 프롬프트부터 시작하여 점차 추론하면서 경험을 쌓아갈 수 있습니다. 궁극적으로 큐에 대한 경험을 축적함으로써 LLM은 복잡한 문제를 해결하기 위한 강력한 추론 능력을 갖추게 됩니다. 이러한 인사이트를 바탕으로 생각의 부스팅은 시행착오를 거친 추론 경험을 반복적으로 수집하여 문제를 해결하는 자동화된 프롬프트 프레임워크로 설계되었습니다. 우리는 제안된 BoT가 특정 작업에 LLM을 적용한 것이 아니라, 인간의 선험적 지식에 의존하지 않고 잘못된 추론 사슬의 오류 분석을 통해 LLM의 추론력을 직접적으로 얻을 수 있다는 통찰력을 기반으로 하고 있다고 주장합니다.

인사이트를 강조하기 위해 다음 세 가지 주요 관찰 결과를 공유하며, 이는 온도 0.7, 최고 p값 0.7이 적용된 gpt-3.5 터보 모델을 사용한 다음 24개 게임 데이터 세트를 기반으로 합니다.

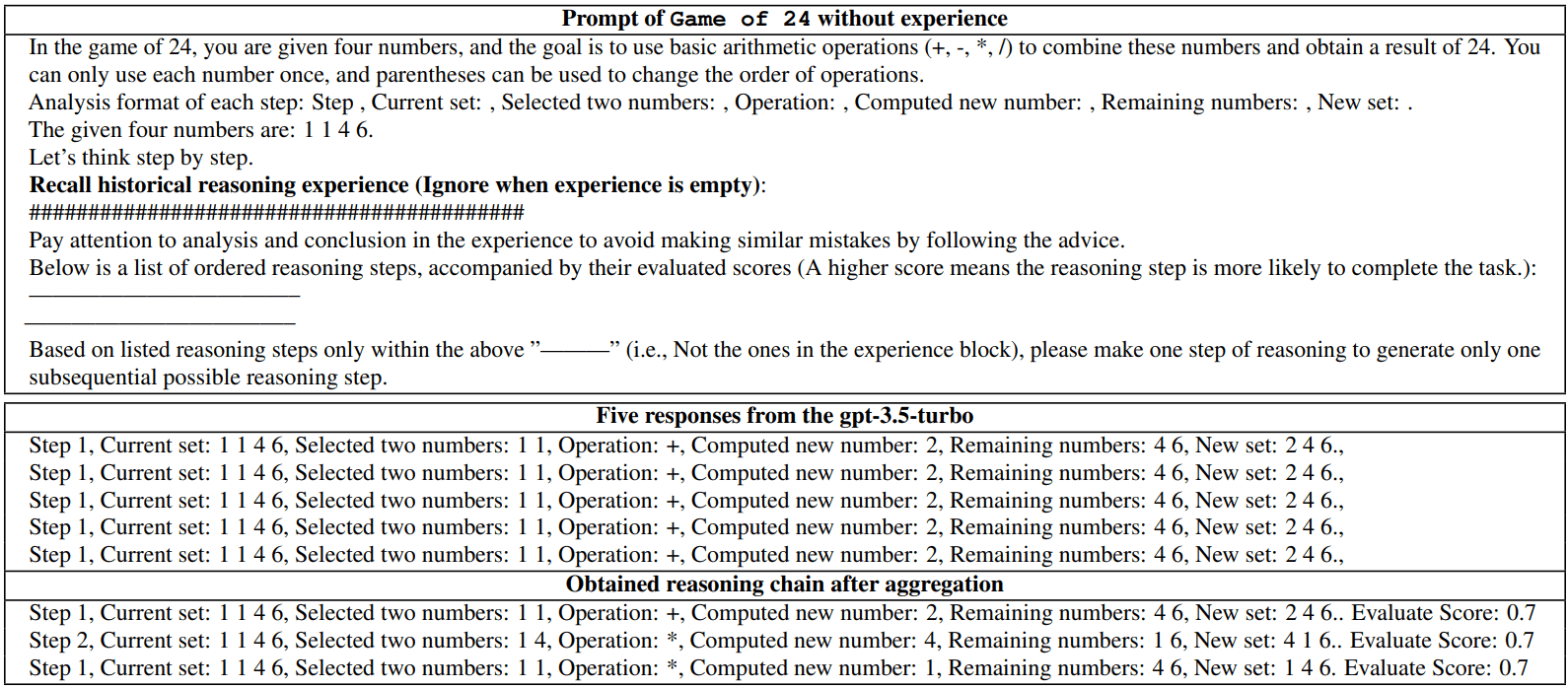

이 프롬프트의 경험은 LLM이 응답에서 더 많은 논리를 탐구하도록 장려합니다.표 5에서 볼 수 있듯이, 이 모델은 단서에 경험이 포함되지 않은 경우 동일한 추론 단계를 5번 생성했습니다. 이 관찰은 LLM의 일반적인 문제, 즉 다양한 추론 논리를 탐색하려는 동기가 부족하다는 점을 보여줍니다. 따라서 LLM은 강력한 추론 잠재력에도 불구하고 가장 단순한 추론 단계부터 시작하는 사이클에 갇혀 최종 해결책으로 이어지지 않을 수 있습니다. 표 5의 '획득된 추론 사슬' 섹션에서는 잘못된 추론 사슬을 보여줍니다. 생각의 나무에서와 같이 여러 개의 응답을 생각으로 생성하여 트리의 노드를 구성하는 경우, 이러한 반복적인 추론 단계로 인해 알고리즘이 경우에 따라 실패할 수 있다고 생각합니다(Yao et al., 2024). 그러나 BoT의 두 번째 반복에서는 표 6에 표시된 것처럼 프롬프트에 경험을 도입하여 초기 추론 단계가 다르게 생성되었습니다. 최종 추론 체인은 결국 더 넓은 범위의 잠재적 논리에서 시작하여 올바른 솔루션에 도달할 수 있습니다.Weng 외(2023)

LLM은 경험에서 강조된 유사한 실수를 반복하지 않습니다.오류 분석을 포함한 프롬프트에 경험이 포함되지 않으면 표 5의 "획득한 추론 체인" 섹션에서 볼 수 있듯이 LLM은 작업 규칙에서 벗어나 최종 프로세스에서 초기 추론 단계로 되돌아가는 등 많은 실수를 범하게 됩니다. 이 추론 사슬을 분석하고 그 피드백을 경험으로 통합하여 BoT의 두 번째 반복을 위한 프롬프트에 반영한 결과, 표 6에서 LLM이 추론하기 전에 경험을 학습한다는 것을 알 수 있습니다. 첫째, "gpt-3.5 터보의 다섯 가지 응답"에 나타난 다양한 초기 추론 단계와 동일한 오류를 반복하는 응답은 없었습니다. 둘째, LLM은 작업 규칙을 엄격하게 준수하고 잘못된 추론을 제거하며 논리적 추론 단계를 수행함으로써 이전에 확인된 모든 오류를 성공적으로 피했습니다. 셋째, 이를 통해 궁극적으로 "1 1 14 6" 게임 오브 24 과제에 대한 올바른 솔루션을 도출했습니다. Weng 등(2023), Madaan 등(2023), Zheng 등(2023)과 같은 다른 연구에서도 이전 답변에 대한 자기 평가인 피드백을 통해 단서를 보강하는 것이 중요하다는 점을 강조했습니다. 그러나 BoT는 오류 분석을 포함한 경험이 LLM에서 강력한 추론으로 이어질 수 있다는 통찰에 기반한 중요한 연구입니다.

사람이 주석을 달지 않아도 LLM은 경험을 바탕으로 복잡한 문제를 해결하기 위해 효과적인 추론의 사슬을 자동으로 구성합니다.BoT는 학습자가 사람의 주석 없이도 경험만으로 오류 분석과 안내를 통해 문제 해결을 위한 효과적인 추론 기술을 습득할 수 있다는 통찰을 활용하여 자동화된 프롬프트 프레임워크를 제안하는 선구적인 이니셔티브입니다. 표 5에서 볼 수 있듯이, 이는 BoT의 첫 번째 반복이며, 초기 힌트에는 CoT와 같은 맥락 학습 예시 없이 기본적인 과제 안내와 질문만 포함되어 있습니다. 이러한 프롬프트를 사용하여 LLM이 얻은 추론 체인에는 많은 오류와 잘못된 추론 단계가 포함되어 있지만, 표 6에서와 같이 오류 분석 및 제안은 입력 프롬프트에 학습된 교훈으로 포함되어 추론의 두 번째 반복에 도움이 될 수 있습니다. 올바른 추론 절차에 대한 사람의 안내 없이도 LLM은 이전에 생성된 추론 체인에서 얻은 오류 분석 및 안내 등 경험을 통해 지식을 얻을 수 있으며, 이를 통해 추론 문제 해결 능력을 점진적으로 향상시킬 수 있습니다.

따라서 저희의 BoT는 복잡한 작업에 대한 효과적인 추론 프로세스를 생성할 수 있도록 LLM을 지원할 때 리콜 오류 분석과 제안의 중요성을 보여줌으로써 장기적인 연구 지침을 제공합니다. 이러한 인사이트를 통해 LLM의 추론 능력을 유도하는 큐 엔지니어링 연구는 인간의 선험적 지식을 더 많이 도입하기보다는 경험을 생성하는 방법에 초점을 맞출 수 있습니다.

C 사고 구조 생성

BoT는 추론 체인 분석에서 얻은 경험을 반복적으로 축적하는 자동화된 프롬프트 프레임워크입니다. 따라서 BoT는 추론 단계를 생성하고 평가할 수 있는 다양한 사고 생성 방법과 LLM에 일반화되며, BoT의 성능은 사고 생성 구조의 효율성에 따라 달라집니다. 따라서 BoT는 각 반복에서 추론의 사슬을 생성하기 위한 기본 모델로 가장 최근의 구조인 생각의 나무(ToT)(Yao et al., 2024)를 사용합니다. 본 논문에서 언급했듯이, 기본 사고 생성 모델은 사고 그래프(GoT) Besta 등(2023), 즉 GoT가 포함된 BoT도 가능하지만 시간 제약과 현재 GoT가 아직 수학 문제에 적용되지 않았다는 사실 때문에 BoT 설계에서는 ToT만을 사용합니다. 또한 부스팅 메커니즘에서 기본 모델로 사용하면 각 반복의 사고 구조를 가볍게 유지할 수 있습니다. 궁극적으로, 제안된 BoT는 각각 가중치가 가벼운 이진 트리인 이질적인 트리 구조를 생성합니다.

C1 차세대 사고 세대 및 엣지 가중치 계산

LLM은 섹션 A에서 설명한 다음 사고 생성 단서를 사용하여 F1.... .t를 결합하고 {Gi}를 z1... ,i-1 {Gi}를 대체하여 추론 단계 zi에 대해 가능한 다음 생각을 생성합니다. 추론 단계 zi의 경우 LLM은 생각 평가 단서를 사용하여 zi와 zi-1 사이의 에지 가중치로 평가 점수를 생성합니다. 자세한 절차는 examples/BoostingOfThought/BoT reasoner.py의 소스 코드를 참조하세요. 표 7과 표 8은 gpt-3.5-turbo를 사용하여 Game of 24의 '3 5 6 8'에 적용된 BoT의 직접적인 예로서, 표 9는 생각의 생성 과정을, 표 10은 계산 방법을 보여줍니다.

C2 이기종 트리 구조의 필요성

BoT의 각 반복에서 이질적인 트리 구조는 더 넓은 추론 검색 공간을 탐색하고 견고성을 향상시키기 위해 구성됩니다. examples/BoostingOfThought/BoT core.py의 소스 코드에서 볼 수 있듯이, 각 트리의 LLM의 온도와 최고 p 값은 각각 [0.2, 0.4, 0.6, 0.7, 0.9, 1.1, 1.5] 및 [0.1, 0.3, 0.5, 0.7, 0.9] 범위에서 선택됩니다. 트리 성장 전략은 레이어 단위 또는 잎 단위로 수행할 수 있습니다. 이러한 이질성을 보장하면 다음과 같은 두 가지 이점이 있습니다.

이질성은 추론 검색 공간을 확장하여 수렴 속도를 높입니다.레이어별 전략을 사용하여 탐색하거나 리프별 전략을 사용하여 활용하는 등 서로 다른 목적을 위해 서로 다른 트리를 구성하고 무작위 또는 결정론적 LLM을 기반으로 하는 경우, 생성된 추론 단계와 그 결과 추론 체인은 상당한 차이를 보여 더 넓은 범위의 추론 가능성을 효과적으로 포괄할 수 있습니다. 예를 들어, 한 번의 반복에서 LLM이 더 높은 확신을 가지고 다음 생각을 생성하면 유사한 생각이 지속적으로 탐색되지만, 그렇지 않은 경우 무작위성이 더 높은 LLM은 다양한 생각을 생성하는 경향이 있습니다. 결정론적 추론과 무작위성 중 어느 것이 솔루션에 기여할지 예측하기 어려운 경우가 많습니다. 따라서 다양한 유형의 논리적 추론 단계를 혼합하여 이질성을 보장하면 한 번의 반복으로 추론 공간을 충분히 탐색할 수 있어 궁극적으로 후속 반복을 용이하게 할 수 있습니다. 이 연구에서는 이질적인 트리 구조와 동질적인 트리 구조 간의 BoT 성능을 비교합니다.

이질성은 유효하지 않거나 잘못된 추론 체인을 생성할 가능성을 줄여 견고성을 향상시킵니다.이질성과 달리, 동질적인 설정의 트리에서는 개별 트리가 일관된 논리적 생성 사고를 따르고 동일한 트리 구조로 추론 체인을 구축하는 경향이 있습니다. 따라서 논리가 잘못되었거나 기본 구조가 당면한 문제에 유효하지 않은 경우, 각 반복에서 BoT가 얻은 모든 트리의 추론 체인은 잡음이 많고 잘못된 추론 단계만 포함할 수 있습니다. 이를 종합하여 평가를 위한 보다 정제된 추론 체인을 얻더라도 적절한 문제 해결 조언을 제공하는 데는 여전히 상당한 차이가 있을 수 있습니다. 따라서 트리 사고 구조를 이질적으로 설계하면 후속 BoT 반복에서 평가에 사용할 수 있는 유효한 추론 체인이 없을 가능성을 줄이는 데 도움이 될 수 있습니다. 이렇게 견고성을 강화하면 BoT가 다양한 난이도의 문제를 해결할 수 있습니다.

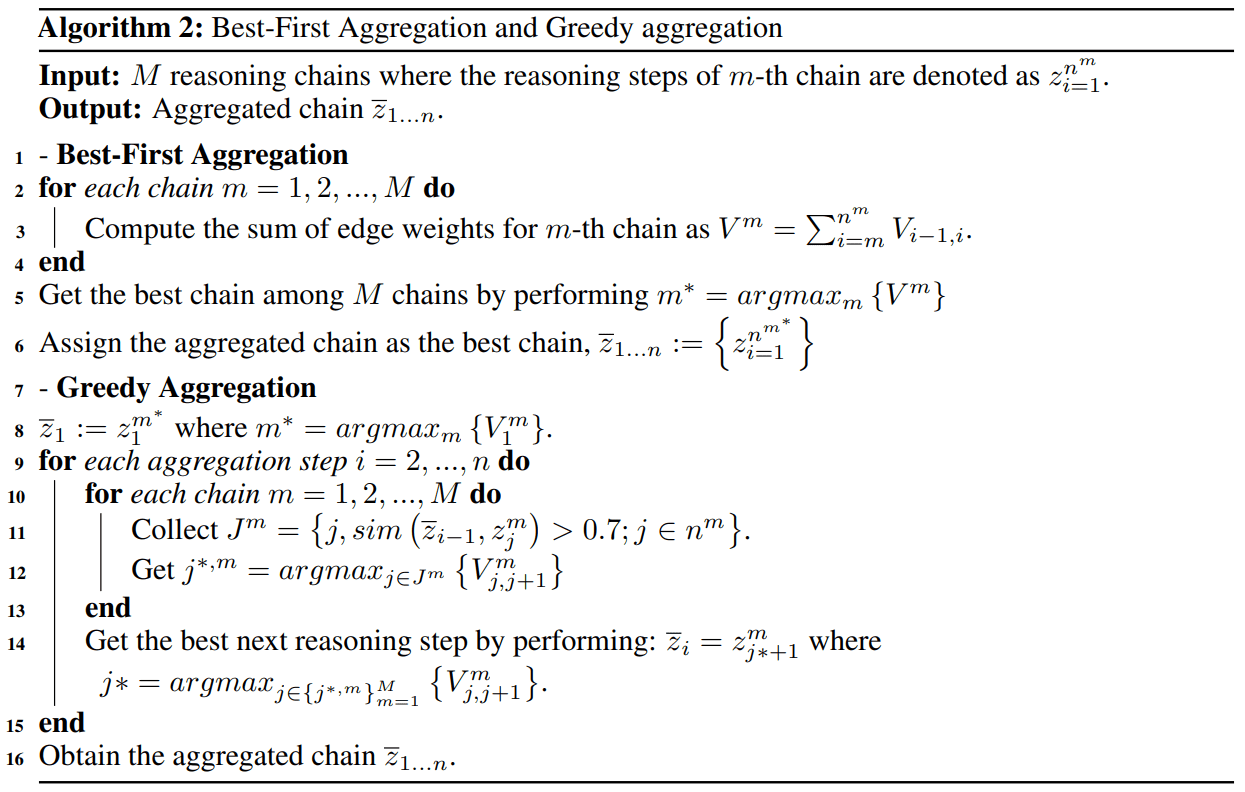

'최우선 집계'와 '탐욕스러운 집계'의 과정을 설명하는 그림입니다.

입력: m개의 추론 사슬, 여기서 m번째 사슬의 추론 단계는 z1i = 1m로 표시됩니다.

출력: 고분자 사슬 z1..n.1 - 최우선 순위 집계

2 각 체인 m = 1, 2, ... , M do

3 m1m Vi-1,i 범위에서 m번째 체인의 에지 가중치의 합을 Vm = ∑i로 계산합니다.

4 끝

5 m* = arg maxm {Vm}을 수행하여 M 체인 중 최적의 체인을 구합니다.

6 집계된 체인을 최적 체인으로 지정합니다(z1....). .n := {z1i=1n*m*}7 - 탐욕스러운 집계

8 z1 := z1 여기서 m* = arg maxm {V1m}.

9 각 집계 단계 i = 2, ... , n do

10 각 체인 m = 1, 2, ... , M do

11 Jm = {j, sim(z1i-1, z1j) > 0.7; j ∈ n1m}을 수집합니다.

12 j*,m = arg maxj∈Jm {Vj,j+1m}을 구합니다.

13 끝

14 다음을 수행하여 최적의 다음 추론 단계를 얻습니다: zi = z1j*+1 여기서 j* = arg maxj∈{j*m}1M {Vj,j+1m}.

15 종료

16 고분자 사슬 얻기 z1.... .n.이것은 기본적으로 데이터 체인 또는 노드를 최적화하고 다양한 방법을 통해 최상의 결과를 얻는 방법을 설명하는 알고리즘 순서도입니다.

D 사고 구조 통합

이기종 트리 구조에서 추론을 완료한 후 BoT의 집계 프로세스는 먼저 각 트리에서 최상의 추론 체인을 추출한 다음, 최적 우선 또는 욕심 집계 방법을 사용하여 이를 단일 추론 체인으로 결합합니다. 이 두 가지 집계 방법에 대한 자세한 정보는 소스 코드 예제/BoostingOfThought/BoT aggregator.py에서 확인할 수 있습니다.

알고리즘 16의 첫 번째 블록에서 볼 수 있듯이, 최적 우선 집계는 에지 가중치의 합이 가장 높은 체인을 직접 추출하는 간단한 집계 방법입니다. 이 방법은 빠르고 안정적입니다. 획득한 최적의 체인을 분석하여 후속 경험을 생성할 수 있기 때문에 일반적으로 경쟁력 있는 성능을 보장합니다. 하지만 효율적인 튜닝 없이 기존 체인만 선택할 수 있습니다. 탐욕적 집계는 다른 체인의 추론 단계를 결합하여 가장 높은 에지 가중치를 가진 새롭고 더 나은 추론 체인을 생성하기 때문에 더 발전된 방식입니다. 알고리즘 16의 탐욕적 집계 프로세스는 두 단계로 구성됩니다. 먼저, 집계된 추론 단계 zi-1 과 유사한 추론 단계를 수집합니다. 따라서 에지 가중치를 최대화하여 이 수집 집합에서 다음 집계 추론 단계를 선택합니다. sim은 LLM을 사용하여 두 구절 간에 동일한 단어와 수학 숫자의 비율을 평가하는 유사성 함수이며, 0.7은 실험을 통해 얻은 경험적 임계값입니다.

E 잘못된 피드백의 영향

집계된 추론 체인을 평가하여 얻은 피드백에는 분석의 제한된 사용, 완전히 잘못된 결론 및 오류 보고서가 포함될 수 있습니다. 이 문제는 일반적으로 언어 모델이며 생성된 텍스트의 정확성을 본질적으로 검증하지 않는 LLM의 특성으로 인해 발생합니다. 또한 gpt-3.5-turbo와 같은 LLM의 기능은 수학 문제의 유효성 검사기로 사용할 때 제한적입니다.

간단한 예가 표 7에 나와 있습니다. 분석 결과 "3단계에서 얻은 최종 결과는 80이며 수학적으로 24와 같습니다."라는 결론을 내리고, 더 나아가 "추론의 연쇄가 정확하며" "추론 단계에서 오류가 발견되지 않았습니다."라는 내용도 포함하고 있습니다. 오류가 발견되었습니다." 이 경험을 입력 단서로 사용하여 첫 번째 반복에서 BoT는 잘못된 추론 단계를 생성하도록 잘못 유도하고 해당 집계 체인을 표 8의 시작 부분에서 볼 수 있습니다. 집계 체인이 논리적으로 올바르지 않으며 24의 게임 규칙을 준수하지 않는다는 것이 분명합니다.

그러나 잘못된 피드백이 증폭되는 것이 아니라, 생성된 추론 단계에 미치는 부정적인 영향은 BoT의 반복 메커니즘을 통해 후속 반복에서 완화되거나 완전히 수정될 수 있다고 주장합니다. 그 주된 이유는 생성된 잘못된 추론 단계를 추가로 분석하여 큐에 추가될 새로운 경험을 생성하기 때문입니다. 특히 이러한 추론 단계에는 쉽게 알아볼 수 있고 명백한 오류가 포함되어 있기 때문에 LLM은 정확한 오류 분석을 생성하고 효과적인 수정 제안을 제공하는 경향이 있습니다. 힌트에 포함된 새로운 경험을 통해 BoT는 올바른 추론 단계를 생성할 수 있습니다. 표 8의 경험에서 볼 수 있듯이, BoT는 상세한 오류 보고서와 수정 제안을 생성하여 합리적인 사고 생성 프로세스를 만들어 냈습니다.

반복을 활용하여 오류 피드백의 부작용을 완화하는 데 있어 BoT의 장점은 그림 4에서 확인할 수 있습니다. 특히 반복 횟수가 증가함에 따라 BoT의 성능이 지속적으로 향상되는 것을 알 수 있습니다. 이는 누적된 경험의 중요성과 이전 오류를 수정하는 후속 경험의 능력을 강조합니다.

F 수학에 대한 더 많은 결과

그림 5: 수학 데이터 세트에 분류된 모든 문제를 풀기 위한 다양한 전략 사용의 효과를 보여줍니다. 전략은 예비 대수, 대수, 수 세기 및 확률, 수 이론 원리, 기하학, 예비 미적분 및 중급 대수 등의 카테고리를 기준으로 비교됩니다. "전체"라고 표시된 하위 플롯은 모든 범주의 모든 문제에 대한 전체 정답률을 보여줍니다.

그림 5에서는 수학 데이터 세트의 각 카테고리에 대한 다양한 방법의 해결률을 제공합니다. 이 범주에 포함된 다양한 수학 문제의 복잡성과 다양성은 수학적 추론에 대한 더 까다로운 기준을 제공합니다. 따라서 수학 문제의 복잡성과 다양성은 이를 해결하기 위해 광범위한 추론 능력을 요구합니다. 따라서 우리의 접근 방식을 자세히 살펴보고 다른 접근 방식과 비교하면 귀중한 통찰력을 얻을 수 있습니다.

LLM.MATH 데이터 세트에 대한 실험은 잘 알려진 대규모 언어 모델(LLM), 즉 GPT-3.5-Turbo(이하 GPT3.5)와 GPT-4(이하 GPT4)를 사용했습니다. OPENAI에서 게시한 API를 직접 사용했습니다.

라이벌.

- Complex CoT Fu 등(2022)의 프롬프트 방법을 사용한 GPT4의 모델인 GPT4 ComplexCoT. 추론 힌트에는 추론 예제가 사용되며, 이는 해당 Complex CoT 간행물 Fu et al. (2022)에서 가져온 것입니다. 탐욕스러운 디코딩이 사용되기 때문에 추론 경로 샘플링에 대해 왕 등(2022)의 자기 일관성 접근법을 따르지 않습니다.

- 표준 프롬프트가 사용되며 GPT3.5 모델을 사용하여 답변을 생성합니다.

- GPT4 ComplexCoT와 유사하지만 모델이 GPT3.5로 변경된 GPT3.5 ComplexCoT.

- GPT4 PHP+ComplexCoT. 이것은 PHP Zheng 외(2023) + Complex CoTFu 외(2022)를 사용하는 GPT4 모델입니다. 구체적으로, PHP Zheng 등(2023)의 프레임워크에서는 초기 기본 답변을 생성하는 데 Complex CoT 프롬프트를 사용하고, PHP+Complex CoT는 이러한 기본 답변에서 후속 답변 생성 프롬프트를 개발할 수 있습니다. 따라서 상호작용이 시작될 때 Complex CoT 기본 힌트와 현재 질문을 LLM에 전달하여 기본 답변을 생성할 수 있습니다. 그런 다음 추가 힌트 문장이 포함된 PHP 버전으로 수정된 Complex CoT 힌트에 의존하여 단계별 힌트 프레임워크가 이 기본 답변에 대해 실행되어 정답을 생성합니다. 이를 원작의 PHP-Complex CoT에 대응하는 PHP+Complex CoT라고 하며, 복합 CoT의 샷 수는 8번입니다.

- 경험 축적 없이 GPT4 모델을 사용하여 BoT 프레임워크의 추론을 수행합니다. BoT의 기본 설정은 본 논문에서 제시된 것을 따릅니다. 따라서 한 번의 반복 후에는 집계된 체인이 솔루션으로 사용됩니다.

- GPT4 BoT. GPT4는 메인 페이퍼에 표시된 전체 버전의 BoT를 수행하는 데 사용됩니다.

- GPT4 BoT + CoT.이 프롬프트에는 BoT 프레임워크 외에도 CoT Wei 외(2022) 출판물의 추론 예시 5가지가 포함되어 있습니다. 따라서 각 반복에서 프롬프트에는 경험뿐만 아니라 추가로 5개의 CoT 추론 예시도 포함됩니다.

- GPT4 BoT와 유사하지만 모델이 GPT3.5로 변경된 GPT3.5 BoT.

- GPT3.5 BoT(GPT4). 이 실험에서는 GPT3.5를 사용하여 사고 구조 생성에서 생각의 연쇄를 추론하고 생성합니다.

그러나 통합 사고 사슬 분석에서 사고 평가 및 경험 생성을 수행할 때 평가 및 분석 피드백을 얻기 위해 GPT4 모델을 사용했습니다.

그림 5의 결과에서 다음과 같은 추가 관찰 사항을 확인할 수 있습니다.

더 까다로운 문제를 해결하는 BoT의 뛰어난 성능은 주로 경험에서 비롯됩니다.GPT4 BoT 및 GPT4 BoT + CoT와 같은 BoT 관련 방법은 수학의 여러 하위 범주에서 일관되게 가장 높은 문제 해결률을 달성했습니다. 특히, GPT4 BoT는 최상의 솔루션인 GPT4 PHP + ComplexCoT보다 8.61 TP3T, GPT4 BOT + CoT는 12.41 TP3T 앞서며, 총 7개 카테고리에서 대수 문제에서 GPT4 BoT가 GPT4 PHP + ComplexCoT보다 최소 0.81 TP3T 앞선 것으로 나타났습니다. GPT3.5 BoT와 GPT3.5 BoT + CoT도 마찬가지입니다. 그러나 BoT 프레임워크에 대한 경험이 축적되지 않은 경우, 모든 수학 문제 해결 성능은 GPT4 BoT wo/ 경험에서 볼 수 있듯이 급격히 저하됩니다.

오류 분석 경험 외에도 간단한 CoT 예제와 같은 올바른 예제를 포함하는 것은 어려운 수학 문제를 푸는 데 있어 BoT의 효율성을 높이는 데 필수적입니다.수학 문제의 처음 다섯 가지 하위 범주 각각을 푸는 데 있어 GPT4 BoT는 GPT4 PHP+ComplexCoT를 크게 능가하지만, 더 복잡한 추론과 복잡한 논리적 단계별 솔루션이 필요한 고급 및 중급 대수 영역에서 BoT의 향상은 0.8% 및 2.4%에 불과하며, 이러한 향상은 더 간단한 문제 범주에서 관찰되는 상당한 향상에 비해 상대적으로 제한적입니다. 이러한 향상은 더 간단한 문제 범주를 풀 때 관찰된 상당한 향상에 비해 상대적으로 제한적입니다. 그러나 입력 프롬프트에 5개의 올바른 CoT 인스턴스를 직접 추가했을 때 GPT-4 BoT + CoT는 고급 대수 및 중급 대수 영역에서 성능이 크게 향상되어 각각 7.71 TP3T 및 11.51 TP3T로 GPT-4 BoT를 능가했습니다.이러한 관찰의 기본 결론은 복잡한 수학 문제를 풀 때 BoT가 가능한 최상의 성능을 달성하기 위해 추론을 학습하기 위한 시행착오 분석이 BoT가 복잡한 수학 문제를 풀 때 최상의 성능을 달성할 수 있는 유일한 방법이 아니라는 것입니다. 추론을 학습하기 위한 오류 분석만으로는 충분하지 않으며 입력 프롬프트에서 LLM에 정답을 제공하는 데 의존해야 합니다.

초기에는 GPT3.5 적합 BoT가 GPT-4 CoT보다 약간 열등할 수 있지만, 평가 및 분석 도구로 GPT-4를 사용하여 경험이 쌓이면 GPT-3.5 BoT(GPT-4)가 GPT-4 복합 CoT를 능가하는 성능을 낼 수 있게 됩니다.GPT4보다 용량이 작은 GPT3.5를 LLM으로 사용했을 때 BoT는 GPT4 ComplexCoT보다 최소 7.71 TP3T 낮은 해율을 얻었습니다(특히 대수학 분야에서). 성능이 약한 LLM이 더 낮은 품질의 시행착오 분석을 생성할 때 BoT가 GPT4 ComplexCoT를 능가할 수 없다는 것은 분명합니다. 따라서 GPT4 생성 경험과 함께 추론 단계만 생성하기 위해 GPT3.5를 사용한 후, 모든 범주에서 상당한 개선을 보인 GPT3.5 BoT는 55.81 TP3T의 솔루션 비율을 기록하여 다음보다 높은 성능을 보였습니다. 5.5%, 심지어 현재의 최신 GPT4 PHP+ComplexCoT보다 1.9% 더 높았습니다. 이러한 관찰은 힌트 반복을 통해 얻은 경험이 BoT 프레임워크의 성공의 주된 이유라는 추가적인 증거를 제공합니다.

G 게임 추론 결과 24점

먼저 표 5~9에서는 추론 과정에서 BoT가 사용하는 세부 단서를 보여줌으로써 각 반복에서 BoT가 수행하는 작업에 대한 포괄적인 이해를 돕습니다. 그런 다음 표 10부터는 BoT의 전체 추론 과정을 아우르는 정확한 예시를 보여줍니다. 실험 섹션에 표시된 기본 설정에 따라 이러한 실험은 BoT가 포함된 GPT-3.5 터보 모델을 사용하여 얻었습니다.

표 5: 입력 프롬프트에 경험이 포함되지 않은 경우 gpt-3.5-turbo에서 생성되는 추론 단계.먼저 모델에서 다양성을 확인하기 위해 5개의 추론 단계를 생성하도록 한 다음, BoT의 첫 번째 반복을 완료한 후 최종 추론 체인을 제시합니다.

게임 팁 24:00, 경험 없음

24점에서는 네 개의 숫자가 주어지며, 기본 산술 연산(+, -, *, /)을 사용하여 이 숫자를 결합하여 결과 24를 얻는 것이 목표입니다. 각 숫자는 한 번만 사용할 수 있으며 괄호를 사용하여 연산 순서를 변경할 수 있습니다.

형식의 각 단계를 분석합니다:

X 단계: 현재 세트: XXXX, 선택한 두 숫자: XX XX, 연산: XX, 계산으로 얻은 새 숫자: XX, 남은 숫자: XXXX, 새 세트: XXXX.주어진 네 개의 숫자는 1 1 4 6입니다.

차근차근 생각해 봅시다.과거 추론 경험을 불러옵니다(경험이 0인 경우 무시):

## ############### ######## ######## # # # #######

경험의 분석과 결론에 주의를 기울이고 권장 사항을 따라 비슷한 실수를 반복하지 않도록 하세요.

다음은 일련의 추론 단계와 평가 점수입니다(점수가 높을수록 추론 단계가 작업을 완료할 가능성이 높다는 의미입니다). :위의 '_'에 나열된 추론 단계(즉, 경험 블록의 단계가 아닌)를 기반으로 한 단계의 추론을 수행하여 가능한 단 하나의 후속 추론 단계를 생성하세요.

gpt-3.5-turbo의 다섯 가지 응답

1단계, 현재 집합: 1 1 4 6, 선택된 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6., 평가 점수: 0.7

1단계, 현재 집합: 1 1 4 6, 선택된 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6., 평가 점수: 0.7

1단계, 현재 집합: 1 1 4 6, 선택된 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6., 평가 점수: 0.7

1단계, 현재 집합: 1 1 4 6, 선택된 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6., 평가 점수: 0.7

1단계, 현재 집합: 1 1 4 6, 선택한 두 수: 1 1, 연산: *, 계산된 새 수: 1, 남은 수: 4 6, 새 집합: 1 4 6., 평가 점수: 0.7집계 후 얻은 추론 체인

1단계, 현재 집합: 1 1 4 6, 선택한 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6... 분수 평가: 0.7

2단계, 현재 집합: 1 1 4 6, 선택한 두 숫자: 1 4, 연산: *, 계산된 새 숫자: 4, 남은 숫자: 1 6, 새 집합: 4 1 6... 평가 점수: 0.7

1단계, 현재 집합: 1 1 4 6, 선택한 두 수: 1 1, 연산: *, 계산된 새 수: 1, 남은 수: 4 6, 새 집합: 1 4 6., 평가 점수: 0.7

H "GSM8K"에 대한 파생 결과.

BoT는 표 5 ~ 9에 표시된 것과 유사한 기본 프롬프트 및 특정 형식을 사용하여 작동합니다. 표 15에 표시된 것처럼 작업 프롬프트만 변경될 뿐입니다. 그리고 표 16부터는 BoT의 전체 추론 프로세스가 포함된 여러 가지 세부 예제를 제공합니다. 이러한 실험은 실험 섹션에 표시된 기본 설정을 기반으로 하며, BoT의 GPT-3.5 터보 모델을 사용합니다.

# 게임 24의 경험적 추론 프롬프트

## 먼저, 역사적 추론 경험을 검토합니다:

### 추론 체인 1과 그 주석

아래는 일련의 추론 단계를 순서대로 보여줍니다:

---

### 1단계

현재 집합: 1 1 4 6, 선택한 두 수: 1 1, 연산: +, 계산된 새 수: 2, 남은 수: 4 6, 새 집합: 2 4 6... 평가 점수: 0.7### 2단계

현재 집합: 1 1 4 6, 선택한 두 숫자: 1 4, 연산: *, 계산된 새 숫자: 4, 남은 숫자: 1 6, 새 집합: 4 1 6... 평가 점수: 0.7### 3단계

현재 집합: 1 1 4 6, 선택한 숫자 2개: 1 1, 연산: *, 계산된 새 숫자: 1, 남은 숫자: 4 6, 새 집합: 1 4 6. 평가 점수: 0.7---

## 분석: 이 추론 연쇄가 작업을 완료하고 목표에 올바르게 도달할 수 없습니다. 추론 단계에 오류가 있어 올바른 해결책을 찾지 못했습니다.

### 추론 1단계

이 단계는 두 개의 숫자를 선택하고 연산을 수행한 후 그에 따라 집합을 업데이트하는 규칙을 따르기 때문에 이전 단계의 논리적 외삽입니다. 그러나 이 단계는 올바른 솔루션에 기여하지 않습니다. 계산을 통해 얻은 새로운 숫자 2는 원하는 결과 24로 이어지지 않습니다.

**제안**: 다른 연산이나 숫자 조합을 시도하여 24에 가까운 새 숫자를 얻으세요.

**추천 또는 거부 설명**: 거부됨.### 추론 2단계

추론 단계에 대한 설명에 오류가 있습니다. "추론 2단계"라고 두 번 잘못 표기되어 있습니다. 그러나 이 단계가 유일한 단계라고 가정하면 이전 단계에서 논리적으로 추론하는 것입니다. 곱셈(*) 연산이 선택한 숫자에 올바르게 적용되어 새로운 숫자 4가 생성되고 나머지 숫자가 그에 따라 업데이트됩니다.

**추천 또는 거부 설명**: 추천.### 추론 3단계

추론 단계에 대한 설명에 오류가 있습니다. "추론 3단계"가 아닌 "추론 1단계"라고 잘못 표기되어 있습니다. 이 단계는 이전 단계에서 논리적으로 추론하는 단계가 아닙니다. 곱하기(*) 연산은 추론 1단계에서와 동일한 숫자에 적용되지만, 새로운 숫자 1은 다르게 계산됩니다. 나머지 숫자는 그에 따라 업데이트됩니다.

**버그 신고**: 이 단계의 계산이 잘못되었습니다. 올바른 계산은 1 * 1 = 1이어야 합니다.

**권장**: 계산이 정확한지 다시 한 번 확인하세요.

**추천 또는 거부 설명**: 거부됨.**신뢰도 점수**: 0.7

---

## gpt-3.5-터보의 다섯 가지 응답

---

### 1단계

현재 집합: 1 1 4 6, 선택한 숫자 2개: 1 4, 연산: *, 계산된 새 숫자: 4, 남은 숫자: 1 6, 새 집합: 1 4 6.....### 1단계

현재 설정: 1 1 4 6, 선택한 숫자 2개: 1 6, 연산: +, 계산된 새 숫자: 7, 남은 숫자: 1 4, 새 설정: 1 4 7.....### 1단계

현재 집합: 1 1 4 6, 선택한 숫자 2개: 1 1, 연산: *, 계산된 새 숫자: 1, 남은 숫자: 4 6, 새 집합: 1 4 6.....### 1단계

현재 설정: 1 1 4 6, 선택한 숫자 2개: 1 4, 연산: /, 새 숫자 계산: 0.25, 남은 숫자: 1 6, 새 설정: 0.25 1 6..., 및### 1단계

현재 집합: 1 1 4 6, 선택한 숫자 2개: 1 1, 연산: -, 계산된 새 숫자: 0, 남은 숫자: 4 6, 새 집합: 0 4 6....---

## 집계 후 추론 체인

---

### 1단계

현재 집합: 1 1 4 6, 선택한 두 숫자: 1 1, 연산: *, 계산된 새 숫자: 1, 남은 숫자: 4 6, 새 집합: 1 4 6... 평가 점수: 0.9### 2단계

현재 집합: 1 4 6, 선택한 두 숫자: 1 4, 연산: *, 계산된 새 숫자: 4, 남은 숫자: 6, 새 집합: 4 6... 평가 점수: 0.7### 3단계

현재 집합: 46, 선택한 숫자 2개: 4 6, 연산: *, 계산된 새 숫자: 1, 남은 숫자:, 새 집합: 24. 평가 점수: 0.9---

표 6: 입력 프롬프트에 경험을 통합할 때 gpt-3.5-turbo에서 생성되는 추론 단계. 이 경험은 표 5의 추론 체인을 분석한 것입니다. 이 경험을 큐에 설정한 후, 모델에서 5번의 응답과 BoT의 두 번째 반복이 완료된 후 형성된 최종 추론 체인을 보여줍니다.

# 차세대 생각 생성 팁

24점에서는 네 개의 숫자가 주어지며, 기본 산술 연산(+, -, *, /)을 사용하여 이 숫자를 결합하여 결과 24를 얻는 것이 목표입니다. 각 숫자는 한 번만 사용할 수 있으며 괄호를 사용하여 연산 순서를 변경할 수 있습니다.

각 단계의 분석 형식: 단계 , 현재 집합: , 두 개의 숫자 선택: , 연산: , 새 숫자 계산: , 남은 숫자: , 새 집합: .

주어진 네 개의 숫자는 3 5 6 8입니다.

차근차근 생각해 봅시다.

## 먼저, 역사적 추론 경험을 검토합니다:

### 1차 추론 및 의견 체인

다음은 순서대로 제시된 추론 단계가 포함된 추론 체인입니다:

---

1단계, 현재 집합: 3 5 6 8, 선택한 두 숫자: 5 6, 연산: *, 계산된 새 숫자: 30, 남은 숫자: 3 8, 새 집합: 30 3 8... 평가 점수: 0.9

2단계, 현재 집합: 30 3 8, 선택된 두 수: 30 3, 연산: /, 계산된 새 수: 10, 남은 수: 8, 새 집합: 10 8... 평가 점수: 0.9

3단계, 현재 집합: 10 8, 선택된 두 숫자: 10 8, 연산: *, 계산된 새 숫자: 80, 남은 숫자: 없음, 새 집합: 80... 평가 점수: 0.9.

---

## 분석 보고서

이러한 일련의 추론 과정을 통해 작업을 올바르게 완료하고 추론 단계를 수행하여 목표에 도달할 수 있습니다. 3단계에서 얻은 최종 결과는 80이며, 수학적으로 24와 같습니다.

### 추론 1단계

이 추론 단계는 이전 단계에서 논리적으로 파생된 단계입니다. 현재 집합(3 5 6 8)에서 숫자 5와 6을 선택하고 곱하여 새로운 숫자 30을 얻습니다. 나머지 숫자는 3과 8입니다.이 추론 단계는 집합의 요소 수를 줄이고 새로운 숫자를 생성하므로 올바른 해결에 도움이 됩니다.### 추론 2단계

이 추론 단계는 이전 단계에서 논리적으로 파생된 단계입니다. 현재 집합(30 3 8)에서 숫자 30과 3을 선택하고 이를 나누어 새로운 숫자 10을 구하면 나머지 숫자는 8입니다. 이 추론 단계는 집합의 요소 수를 더 줄이고 새로운 숫자를 생성하므로 정답에 기여합니다.### 추론 3단계

이 추론 단계는 이전 단계에서 논리적으로 파생된 단계입니다. 현재 집합(10 8)에서 숫자 10과 8을 선택하고 곱하여 새로운 숫자 80을 얻습니다. 남은 숫자가 없으므로 추론 체인의 결과는 80입니다.이 추론 단계는 최종 결과를 생성하므로 올바른 해결에 도움이 됩니다.제안: 추론 단계에서 오류가 발견되지 않았습니다.

권장 또는 거부된 설명: 모든 추론 단계는 정확하고 올바른 솔루션에 도달하는 데 도움이 되므로 권장됩니다.

신뢰도 점수: 0.9

### 두 번째 추론 및 의견 체인

계속하려면 표 8에서

### 분석 및 결론에 대한 참고 사항

경험을 통한 분석과 결론을 바탕으로 한 권장 사항을 따라 비슷한 실수를 반복하지 마세요.

다음은 평가 점수와 함께 추론 단계의 순서 목록입니다(점수가 높을수록 추론 단계가 과제를 완료할 가능성이 높다는 의미입니다). :

---

1단계, 현재 집합: 3 5 6 8, 선택한 두 수: 3 8, 연산: +, 계산된 새 수: 11, 남은 수: 5 6, 새 집합: 11 5 6... 평가 점수: 0.7

2단계, 현재 집합: 11 5 6, 선택한 두 수: 5 6, 연산: *, 계산된 새 수: 30, 남은 수: 11, 새 집합: 30 11... 평가 점수: 0.9

---

위의 '---' 안에 나열된 추론 단계(즉, 경험 블록의 단계가 아닌)를 기반으로, 가능한 후속 추론 단계를 하나만 생성하는 추론 단계를 수행하세요.

## 생성된 다음 추론

3단계, 현재 설정: 30 11, 두 숫자 선택: 30 11, 연산: -, 새 숫자 계산: 19, 남은 숫자:, 새 설정: 19.

표 7: 해당 추론 단계 zi를 생성할 때 BoT가 반영될 수 있는 예시입니다.

## 두 번째 추론 및 의견 체인

다음은 순서대로 제시된 추론 단계가 포함된 추론 체인입니다:

---

### 1단계

현재 집합: 10 8, 선택한 두 숫자: 10 8, 연산: /, 계산된 새 숫자: 1.25, 남은 숫자: 없음, 새 집합: 1.25. 평가 점수: 0.8.### 2단계

현재 집합: 10 8, 선택된 두 숫자: 10 8, 연산: /, 계산된 새 숫자: 1.25, 남은 숫자: 없음, 새 집합: 1.25... 평가 점수: 0.8.### 3단계

현재 집합: 10 8, 선택된 두 숫자: 10 8, 연산: /, 계산된 새 숫자: 1.25, 남은 숫자: 없음, 새 집합: 1.25... 평가 점수: 0.8.---

## 분석 보고서

이 추론 연쇄는 작업을 올바르게 완료하고 목표에 도달하지 못합니다. 제공된 추론 단계가 잘못되어 24라는 결과를 얻지 못합니다.

### 추론 1단계

이 추론 단계는 잘못되었습니다. 선택한 두 개의 숫자 10과 8은 주어진 숫자 3, 5, 6, 8 집합에 없습니다. 또한 나누기(/) 연산으로 인해 1.25로 계산된 새로운 숫자가 생성되지 않습니다. 나머지 숫자가 올바르게 식별되지 않았습니다.**오류 보고서**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하지 않습니다.

- 연산과 계산된 새 숫자가 잘못되었습니다.

- 나머지 숫자가 올바르게 식별되지 않습니다.**추천**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하는지 확인합니다.

- 올바른 조작을 사용하여 원하는 새 번호를 얻습니다.

- 남은 숫자를 정확하게 식별합니다.**설명 추천 또는 거부**: 거부합니다. 이 추론 단계는 잘못되었으며 올바른 솔루션에 기여하지 않습니다.

### 추론 2단계

이 추론 단계는 추론 1단계의 반복이므로 오류에 해당합니다. 이 단계에는 이전 단계와 동일한 오류가 포함되어 있습니다.**오류 보고서**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하지 않습니다.

- 연산과 계산된 새 숫자가 잘못되었습니다.

- 나머지 숫자가 올바르게 식별되지 않습니다.**추천**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하는지 확인합니다.

- 올바른 조작을 사용하여 원하는 새 번호를 얻습니다.

- 남은 숫자를 정확하게 식별합니다.**설명 추천 또는 거부**: 거부합니다. 이 추론 단계는 잘못되었으며 올바른 솔루션에 기여하지 않습니다.

### 추론 3단계

이 추론 단계는 추론 1단계와 추론 2단계를 반복하는 단계입니다. 이 단계에는 이전 단계와 동일한 오류가 포함되어 있습니다.**오류 보고서**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하지 않습니다.

- 연산과 계산된 새 숫자가 잘못되었습니다.

- 나머지 숫자가 올바르게 식별되지 않습니다.**추천**:

- 선택한 두 숫자가 주어진 숫자 집합에 존재하는지 확인합니다.

- 올바른 조작을 사용하여 원하는 새 번호를 얻습니다.

- 남은 숫자를 정확하게 식별합니다.**설명 추천 또는 거부**: 거부합니다. 이 추론 단계는 잘못되었으며 올바른 솔루션에 기여하지 않습니다.

**신뢰도 점수**: 0.9

표 8: 표 7의 주석이 포함된 두 번째 추론 연쇄.

# 사고력 평가 프롬프트

24점에서는 네 개의 숫자가 주어지며, 기본 산술 연산(+, -, *, /)을 사용하여 이 숫자를 결합하여 결과 24를 얻는 것이 목표입니다. 각 숫자는 한 번만 사용할 수 있으며 괄호를 사용하여 연산 순서를 변경할 수 있습니다.

각 단계의 분석 형식: 단계 , 현재 집합: , 두 개의 숫자 선택: , 연산: , 새 숫자 계산: , 남은 숫자: , 새 집합: .

주어진 네 개의 숫자는 3 5 6 8입니다.

차근차근 생각해 봅시다.

생성된 다음 추론 단계는 평가 점수와 함께 순서대로 표시됩니다(점수가 높을수록 추론 단계가 과제를 완료할 가능성이 높다는 의미). :

---

### 1단계

현재 집합: 3 5 6 8, 선택한 두 수: 3 8, 연산: +, 계산된 새 수: 11, 남은 수: 5 6, 새 집합: 11 5 6... 평가 점수: 0.7### 2단계

현재 집합: 11 5 6, 선택한 두 숫자: 5 6, 연산: *, 계산된 새 숫자: 30, 남은 숫자: 11, 새 집합: 30 11... 평가 점수: 0.9### 3단계

현재 설정: 30 11, 선택한 숫자 2개: 30 11, 연산: -, 새 숫자 계산: 19, 남은 숫자:, 새 설정: 19.---

이러한 추론 단계의 논리성, 정확성, 최종 솔루션에 도달하는 데 기여한 정도에 대한 평가 점수는 몇 점인가요? 점수는 [0.1, 0.3, 0.5, 0.7, 0.9, 1.0] 중에서 값을 선택해 주세요(점수가 높을수록 추론 단계가 우수함을 의미). 점수는 사용자가 읽을 수 있도록 '평가 점수:' 뒤에 배치해야 합니다.

## 생성된 평가 점수

평가 점수: 0.9.

표 9: 2단계(zi)와 3단계(zi-1) 사이의 에지 가중치 계산.

# 다음 생각에서 생성되는 프롬프트의 형식입니다.

24점에서는 네 개의 숫자가 주어지며, 기본 산술 연산(+, -, *, /)을 사용하여 이 숫자를 결합하여 결과 24를 얻는 것이 목표입니다. 각 숫자는 한 번만 사용할 수 있으며 괄호를 사용하여 연산 순서를 변경할 수 있습니다.

각 단계의 분석 형식: 단계 , 현재 집합: , 두 개의 숫자 선택: , 연산: , 새 숫자 계산: , 남은 숫자: , 새 집합: .

주어진 네 개의 숫자는 5, 6, 9, 4입니다.

차근차근 생각해 봅시다.

기록을 검토하여 경험에 대해 추론합니다(경험이 0인 경우 무시):

###########################################

경험을 통한 분석과 결론을 바탕으로 한 권장 사항을 따라 비슷한 실수를 반복하지 마세요.

다음은 평가 점수와 함께 추론 단계의 순서 목록입니다(점수가 높을수록 추론 단계가 과제를 완료할 가능성이 높다는 의미입니다). :

---

---

위의 '---' 안에 나열된 추론 단계(즉, 경험 블록의 단계가 아닌)를 기반으로, 가능한 후속 추론 단계를 하나만 생성하는 추론 단계를 수행하세요.

# 경험 생성을 위한 프롬프트 형식

주어진 과제: 24점 게임에서 네 개의 숫자가 주어지며, 목표는 기본 산술 연산(+, -, *, /)을 사용하여 이 숫자를 결합하여 결과 24를 얻는 것입니다. 각 숫자는 한 번만 사용할 수 있으며 괄호를 사용하여 연산 순서를 변경할 수 있습니다.

주어진 네 개의 숫자는 4 5 10 11입니다. 단계별로 생각해 봅시다. 아래는 추론의 단계가 순서대로 제시된 추론의 연쇄입니다:

---

---

다음 영역을 포함하는 상세한 비평을 제공하여 이 추론의 연쇄를 평가해 주세요. 이 추론 연쇄가 추론 단계를 수행하여 과제를 올바르게 완료하고 목표에 도달할 수 있습니까? 왜 그럴까요? '분석 보고서'에 결론을 포함한 분석을 작성합니다. 각 추론 단계마다 현재 단계가 이전 단계로부터 논리적으로 진행되었는지, 추론 단계가 올바른 해결책에 기여하는지 여부에 대한 자세한 분석을 제공합니다. 오류가 있는 각 추론 단계에 대해 오류 보고서와 그에 따른 수정 권장 사항을 제공합니다. 각 추론 단계마다 권장 사항 또는 거부에 대한 설명을 제공합니다. 설명은 간결해야 하며, 다른 단계에서 동일한 분석을 반복하지 말고 다음 형식(추론 단계 ¡idx¿)을 따릅니다. 분석: . 권장 사항: . 추천 또는 거부 설명: . 3. 이 평가 및 의견에 대한 귀하의 신뢰 점수는 얼마입니까? 0.1, 0.3, 0.5, 0.7, 0.9, 1.0] 중에서 값을 선택해 주세요. 점수는 사용자가 읽을 수 있도록 "신뢰 점수:" 뒤에 입력해야 합니다.

표 10: 게임 "블랙잭"에서 사용되는 힌트 형식.

### 첫 번째 반복에서 획득한 경험치

###### 1차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**, 현재 집합: 4 5 10 11, 선택된 두 숫자: 4 5, 연산: *, 계산된 새 숫자: 20, 남은 숫자: 10 11, 새 집합: 20 10 11... 평가

점수: 0.7**2단계**, 현재 집합: 20 10 11, 선택한 두 수: 10 11, 연산: *, 계산된 새 수: 110, 남은 수: 20, 새 집합: 110 20... 평가 점수: 0.7

**3단계**, 현재 설정: 110 20, 선택한 숫자 2개: 110 20, 연산: /, 계산된 새 숫자: 5.5, 남은 숫자: 없음, 새 설정: 5.5 ... 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**:

이러한 일련의 추론 과정을 통해 작업을 올바르게 완료하고 추론 단계를 수행하여 목표에 도달할 수 있습니다. 최종 결과는 5.5로, 수학적으로 24와 같습니다.**추론 1단계** : 주어진 수에 대해 논리적으로 추론하는 단계입니다. 현재 집합에서 숫자 4와 5를 선택하고 연산 *을 적용하여 새로운 숫자 20을 구합니다. 나머지 숫자는 10과 11입니다. 이 단계는 집합의 요소 수를 줄이므로 정답을 구하는 데 유리합니다.

**추론 2단계** : 이 단계는 이전 단계의 논리적 추론입니다. 현재 집합에서 숫자 10과 11을 선택하고 연산 *을 적용하여 새로운 숫자 110을 구합니다. 남은 숫자는 20입니다. 이 단계는 집합의 요소 수를 더 줄이므로 정답을 구하는 데 도움이 됩니다.

**추론 3단계**: 이 단계는 이전 단계의 논리적 추론입니다. 현재 집합에서 숫자 110과 20을 선택하고 연산 /을 적용하여 새로운 숫자 5.5를 얻습니다. 남은 숫자가 없으므로 추론 체인이 결과에 도달했음을 의미합니다. 최종 결과 5.5는 수학적으로 24와 같습니다.

**권장**: 이 추론 체인에서 오류가 발견되지 않았습니다. 단계가 올바르게 실행되어 올바른 솔루션으로 이어졌습니다.

**권장 또는 거부 설명**: 이 추론은 목표 달성에 성공하고 올바른 해결책을 제공했기 때문에 권장됩니다.

**신뢰도 점수**: 0.9

### 두 번째 반복에서 획득한 경험치

#####2차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**, 현재 집합: 4 5 10 11, 두 개의 숫자 선택: 4 10, 연산:*, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가 점수: 0.9**2단계**, 현재 집합: 40 5 11, 선택한 두 수: 5 11, 연산: *, 계산된 새 수: 55, 남은 수: 40, 새 집합: 55 40... 평가 점수: 0.9

**3단계**, 현재 집합: 40 5 11, 선택된 두 수: 4 10, 연산: *, 계산된 새 수: 40, 남은 수: 5 11, 새 집합: 40 5 11... 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이 추론 연쇄가 작업을 올바르게 완료하고 목표에 도달하지 못함. 추론 단계가 반복되어 원하는 결과를 얻지 못함 24.**추론 1단계** : 이 단계는 주어진 숫자를 논리적으로 추론하는 단계로, 게임의 규칙을 따릅니다. 4와 10을 곱하면 40이 되고 나머지 숫자는 5와 11입니다. 그러나 이 단계는 정답인 24에 도달하는 데 도움이 되지 않습니다.

**추론 2단계**: 이 단계는 1단계의 반복입니다. 나머지 숫자 5와 11을 선택하고 곱하여 55를 얻습니다. 새 집합은 55와 40이 됩니다. 다시 말하지만, 이 단계에서는 목표 24로 이어지지 않습니다.

**추론 3단계**: 이 단계는 1단계의 반복입니다. 새로운 정보나 목표를 향한 진행 상황을 제공하지 않습니다. 결과는 1단계와 동일합니다.

**권장**: 추론 단계를 수정하고 조정하여 목표에 도달하는 다양한 방법을 찾아야 합니다.24 반복되는 단계는 올바른 해결책에 도달하는 데 도움이 되지 않습니다.

**권장 또는 거부된 설명**: 이 추론은 반복적인 단계와 목표에 대한 진전 부족으로 인해 거부되었습니다.

**신뢰도 점수**: 0.7

### 세 번째 반복에서 얻은 교훈

######3번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**, 현재 집합: 4 5 10 11, 선택된 두 숫자: 4 5, 연산: +, 계산된 새 숫자: 9, 남은 숫자: 10 11, 새 집합: 9 10 11... 평가 점수: 0.7**2단계**, 현재 집합: 9 10 11, 선택된 두 숫자: 9 10, 연산: *, 계산된 새 숫자: 90, 남은 숫자: 11, 새 집합: 90 11... 평가 점수: 0.7

**3단계**, 현재 설정: 90 11, 두 개의 숫자 선택: 90 11, 연산: /, 새 숫자 계산: 8.1818181818181818182, 남은 숫자:, 새 설정: 8.1818181818181818182... 평가 점수: 0.7

----------------------------------------------------------------

**분석 보고서**: 이 추론 연쇄는 작업을 올바르게 완료하고 목표에 도달하지 못합니다. 3단계에서 얻은 최종 결과는 8.18181818181818182 으로 목표 숫자 24와 같지 않으므로 이 추론 연쇄는 올바르지 않습니다.**추론 1단계** : 이 단계는 이전 단계의 논리적 추론입니다. 현재 집합(4 5 10 11)에서 두 개의 숫자 4와 5를 선택하고 더하여 새로운 숫자 9를 얻습니다. 나머지 숫자는 10과 11이며 새로운 집합은 9 10 11이 됩니다. 이 단계는 두 숫자를 결합하고 집합의 크기를 줄이므로 정답에 유리합니다.

**추천 또는 거부 설명**: 추천.

**추론 2단계** : 이 단계는 이전 단계의 논리적 추론입니다. 현재 집합(9 10 11)에서 두 개의 숫자 9와 10을 선택하고 곱하여 새로운 숫자 90을 얻습니다. 남은 숫자는 11이고 새로운 집합은 90 11이 됩니다. 이 단계는 두 숫자를 결합하고 집합의 크기를 줄이므로 정답에 유리합니다.

**추천 또는 거부 설명**: 추천.

**추론 3단계** : 이 단계는 이전 단계의 논리적 추론입니다. 현재 집합(90 11)에서 두 개의 숫자 90과 11을 선택하고 나누어 새로운 숫자 8.18181818181818182 을 얻습니다. 남은 숫자가 없으므로 이것이 최종 결과입니다. 그러나 얻은 결과는 목표 숫자 24와 같지 않습니다.

**오류 보고서**: 획득한 결과가 목표 숫자와 같지 않아 추론 단계가 잘못되었습니다.

**권장**: 다양한 연산 또는 숫자 조합을 시도하여 목표 숫자에 더 가까이 다가갈 수 있습니다.

**신뢰도 점수**: 0.7

이 내용은 다음 표 12에서 계속 이어집니다...

표 11: "4 5 10 11"에 대해 BoT가 수행한 성공적인 추론 프로세스.

### 네 번째 반복에서 획득한 경험치

#####4번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**, 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산:*, 계산된 새 숫자: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.7**2단계**, 현재 집합: 40 5 11, 선택된 두 수: 40 5, 연산: +, 계산된 새 수: 45, 남은 수: 11, 새 집합: 45 11... 평가 점수: 0.7

**3단계**, 현재 집합: 45 11, 두 개의 숫자 선택: 45 11, 연산: -, 새 숫자 계산: 34, 남은 숫자:, 새 집합: 34... 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이러한 일련의 추론 과정을 통해 추론 단계를 수행함으로써 과제를 올바르게 완료하고 목표에 도달할 수 있습니다. 마지막 단계에서 계산된 숫자는 34이며, 이는 주어진 4개의 숫자와 지정된 산술 연산을 사용하여 원하는 결과인 24를 얻은 올바른 결과입니다.**추론 1단계**: 현재 집합은 4 5 10 11입니다. 두 개의 숫자 4와 10이 선택되었습니다. 선택한 연산은 곱셈(*)이고 계산된 새 수는 40입니다. 나머지 숫자는 5와 11입니다. 새 집합은 40 5 11이 됩니다. 논리적 추론: 선택한 숫자는 현재 집합의 유효한 요소이고 연산은 유효한 사칙연산입니다. 정답에 대한 이점: 예, 이 단계는 집합의 원소 수를 줄이고 후속 단계에서 사용할 수 있는 새 숫자를 계산합니다. 권장 사항: 수락합니다.

**추론 2단계**: 현재 집합은 40 5 11입니다. 두 개의 숫자 40과 5가 선택되었습니다. 선택한 연산은 덧셈(+)이고 계산된 새 수는 45입니다. 남은 수는 11입니다. 새 집합은 45 11이 됩니다. 논리적 추론: 선택한 숫자는 현재 집합의 유효한 요소이고 연산은 유효한 사칙연산입니다. 정답에 대한 이점: 예, 이 단계에서는 집합의 원소 수를 더 줄이고 후속 단계에서 사용할 수 있는 새 수를 계산합니다. 권장 사항: 수락됨.

**추론 3단계**: 현재 집합은 45 11입니다. 두 개의 숫자 45와 11이 선택되었습니다. 선택한 연산은 뺄셈(-)이며 새로 계산된 숫자는 34입니다. 남은 숫자가 없습니다. 새 집합은 34가 됩니다. 논리적 추론: 선택한 숫자는 현재 집합의 유효한 요소이고 연산은 유효한 산술 연산입니다. 정답에 유익: 예, 이 단계에서는 목표 24와 같지 않더라도 최종 결과 34를 계산합니다. 권장 사항: 수락합니다.

**신뢰도 점수**: 0.9

### 다섯 번째 반복에서 얻은 교훈

###### 5번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**, 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산:*, 계산된 새 숫자: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**, 현재 집합: 40 5 11, 선택한 두 수: 5 11, 연산: *, 계산된 새 수: 55, 남은 수: 40, 새 집합: 55 40... 평가 점수: 0.9

**3단계**, 현재 설정: 55 40, 선택한 숫자 2개: 55 40, 연산: +, 계산된 새 숫자: 95, 남은 숫자: 없음, 새 설정: 95... 평가 점수: 1.0

----------------------------------------------------------------

**분석 보고서**: 이 추론 연쇄는 추론 단계를 수행함으로써 과제를 올바르게 완료하고 목표를 달성할 수 있습니다. 그러나 3단계에서 얻은 최종 결과는 95로 수학적으로 24와 같지 않으므로 이 추론 연쇄는 올바른 솔루션을 제공하지 않습니다.**추론 1단계**: 현재 단계는 현재 집합에서 두 개의 숫자를 선택하고 * 연산을 수행하는 규칙을 따르기 때문에 이전 단계에 대한 논리적 추론입니다. 이 추론 단계는 새로운 숫자를 생성하고 다음 단계의 집합을 업데이트하기 때문에 정답을 찾는 데 도움이 됩니다.

**추론 2단계**: 현재 단계는 현재 집합에서 두 개의 숫자를 선택하고 * 연산을 수행하는 규칙을 따르므로 이전 단계에 대한 논리적 추론입니다. 이 추론 단계는 새로운 숫자를 생성하고 다음 단계의 집합을 업데이트하므로 올바른 솔루션에 도움이 됩니다. 그러나 최종 결과인 95가 수학적으로 24와 같지 않기 때문에 이 추론 단계는 정답에 도움이 되지 않습니다.

**추론 3단계**: 현재 단계는 현재 집합에서 두 개의 숫자를 선택하고 + 연산을 수행하는 규칙을 따르기 때문에 이전 단계의 논리적 추론입니다. 그러나 이 추론 단계는 최종적으로 얻은 결과 95가 수학적으로 24와 같지 않기 때문에 정답에 도움이 되지 않습니다.

**권장 사항**: 2단계에서는 새 숫자를 얻기 위해 다른 연산을 선택해야 합니다. 3단계에서는 목표 24에 도달하기 위해 나머지 숫자와 결합할 새 숫자를 얻기 위해 다른 연산을 선택해야 합니다.

**추천 또는 거부 설명**: 1단계: 추천 2단계: 거부 3단계: 거부

**신뢰도 점수**: 0.9

### 여섯 번째 반복에서 획득한 경험치

####6번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**: 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산: *, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**: 현재 집합: 40 5 11, 선택된 두 숫자: 5 11, 연산: +, 계산된 새 숫자: 16, 남은 숫자: 40, 새 집합: 16 40... 평가 점수: 0.9

**3단계**: 현재 집합: 16 40, 선택한 숫자 2개: 16 40, 연산: +, 계산된 새 숫자: 56, 남은 숫자: 없음, 새 집합: 56. 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이러한 일련의 추론 단계를 수행하면 작업을 올바르게 완료하고 목표에 도달할 수 있습니다. 그러나 마지막 단계에서 얻은 최종 결과는 56으로 목표 수치인 24와 같지 않습니다.**추론 1단계** : 주어진 숫자와 게임의 목표에 대해 논리적으로 추론하는 단계입니다. 선택한 두 개의 숫자 4와 10을 곱하여 새로운 숫자 40을 얻고, 나머지 숫자 5와 11을 새 집합에 올바르게 포함시킵니다. 이 단계는 세트의 요소 수를 줄이고 목표를 향해 나아가기 때문에 올바른 솔루션에 도움이 됩니다.

**추론 2단계** : 이 단계는 이전 단계의 논리적 추론입니다. 선택한 두 개의 숫자 5와 11을 더하여 새로운 숫자 16을 얻고, 나머지 숫자 40은 새 집합에 올바르게 포함됩니다. 이 단계는 집합의 요소 수를 줄이고 목표를 향해 나아가기 때문에 정답을 찾는 데 도움이 됩니다.

**추론 3단계**: 이 단계는 이전 단계의 논리적 추론입니다. 선택한 두 개의 숫자 16과 40을 더하여 새로운 숫자 56을 얻습니다. 남은 숫자가 없으므로 추론의 연쇄는 여기서 끝납니다. 그러나 얻은 결과 56은 목표 숫자 24와 일치하지 않습니다. 따라서 이 추론 단계는 올바르지 않습니다.

**오류 보고**: 획득한 결과 56이 목표 번호 24와 일치하지 않으므로 3단계의 추론 단계가 잘못되었습니다.

**권장**: 3단계의 추론 단계를 수정하려면 다른 연산 또는 숫자 조합을 선택하여 목표 24에 더 가까운 새로운 숫자를 얻어야 합니다.

**추천 또는 거부 설명**: 1단계: 추천 2단계: 추천 3단계: 거부

**신뢰도 점수**: 0.9

이 내용은 다음 표 13에서 계속 이어집니다...

표 12: "4 5 10 11"에 대해 BoT가 수행한 성공적인 추론 프로세스.

### 일곱 번째 반복에서 획득한 경험치

#####7번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**: 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산: *, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**: 현재 집합: 40 5 11, 선택된 두 숫자: 5 11, 연산: +, 계산된 새 숫자: 16, 남은 숫자: 40, 새 집합: 16 40... 평가 점수: 0.9

**3단계**: 현재 집합: 16 40, 선택한 두 수: 16 40, 연산: -, 계산된 새 수: 24, 남은 수: 없음, 새 집합: 24. 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이 일련의 추론 단계를 수행하여 작업을 올바르게 완료하고 목표에 도달할 수 있습니다. 마지막 단계에서 얻은 결과는 24이며, 이는 수학적으로 목표 숫자 24와 같습니다.**추론 1단계** : 주어진 숫자와 게임의 목표에 대해 논리적으로 추론하는 단계입니다. 선택한 두 개의 숫자 4와 10을 곱하여 새로운 숫자 40을 얻고, 나머지 숫자 5와 11을 새 집합에 올바르게 포함시킵니다. 이 단계는 세트의 요소 수를 줄이고 목표를 향해 나아가기 때문에 올바른 솔루션에 도움이 됩니다.

**추론 2단계** : 이 단계는 이전 단계의 논리적 추론입니다. 선택한 두 개의 숫자 5와 11을 더하여 새로운 숫자 16을 얻고, 나머지 숫자 40은 새 집합에 올바르게 포함됩니다. 이 단계는 집합의 요소 수를 줄이고 목표를 향해 나아가기 때문에 정답을 찾는 데 도움이 됩니다.

**추론 3단계**: 이 단계는 이전 단계의 논리적 추론입니다. 선택한 두 개의 숫자 16과 40을 빼서 새로운 숫자 24를 얻습니다. 더 이상 남은 숫자가 없으므로 추론의 연쇄는 여기서 끝납니다. 최종 결과 24는 수학적으로 24와 같습니다.

이 추론 과정에서 오류가 발견되지 않았습니다. 단계가 올바르게 실행되어 올바른 솔루션으로 이어졌습니다.

**권장 또는 거부 설명**: 이 추론은 목표 달성에 성공하고 올바른 해결책을 제공했기 때문에 권장됩니다.

**신뢰도 점수**: 0.9

### 여덟 번째 반복에서 획득한 경험치

######8번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**: 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산: *, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**: 현재 집합: 40 5 11, 선택된 두 숫자: 5 11, 연산: +, 계산된 새 숫자: 16, 남은 숫자: 40, 새 집합: 16 40... 평가 점수: 0.9

**3단계**: 현재 집합: 16 40, 선택한 두 수: 16 40, 연산: -, 계산된 새 수: 24, 남은 수: 없음, 새 집합: 24. 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이러한 일련의 추론을 통해 작업을 성공적으로 완료하고 목표에 올바르게 도달할 수 있습니다. 최종 결과 24는 수학적으로 정확하며 24와 같습니다.**추론 1단계** : 주어진 과제 규칙에 대해 논리적으로 추론하는 단계입니다. 두 개의 숫자(4와 10)를 선택하고 곱셈 연산을 수행하여 새로운 숫자(40)를 얻는 규칙을 따릅니다. 나머지 숫자(5와 11)는 새 집합(40 5 11)으로 올바르게 업데이트됩니다. 이 추론 단계는 정답을 찾는 데 도움이 됩니다.

**추론 2단계**: 이 추론 단계는 이전 단계의 논리적 추론입니다. 두 개의 숫자(5와 11)를 선택하고 더하기 연산을 수행하여 새로운 숫자(16)를 얻는 규칙을 따릅니다. 나머지 숫자(40)는 새 집합(16 40)으로 올바르게 업데이트됩니다. 이 추론 단계는 올바른 해를 구하는 데 도움이 됩니다.

**추론 3단계**: 이 추론 단계는 이전 단계의 논리적 추론입니다. 두 개의 숫자(16과 40)를 선택하고 뺄셈 연산을 수행하여 새로운 숫자(24)를 얻는 규칙을 따릅니다. 남은 숫자가 없으므로 새 집합은 비어 있습니다. 최종 결과 24는 수학적으로 정확하며 24와 같습니다. 이 추론 단계는 정답을 구하는 데 유용합니다.

**권장**: 이 추론 체인에서 오류가 발견되지 않았습니다. 주어진 작업 규칙에 따라 단계가 올바르게 실행되었습니다.

**권장 또는 거부된 설명**: 이 추론 체인의 모든 추론 단계는 정확하고 올바른 솔루션에 기여하므로 권장됩니다.

**신뢰도 점수**: 0.9

### 아홉 번째 반복에서 획득한 경험치

######9번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**: 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산: *, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**: 현재 집합: 40 5 11, 선택된 두 숫자: 5 11, 연산: +, 계산된 새 숫자: 16, 남은 숫자: 40, 새 집합: 16 40... 평가 점수: 0.9

**3단계**: 현재 집합: 16 40, 선택한 두 수: 16 40, 연산: -, 계산된 새 수: 24, 남은 수: 없음, 새 집합: 24. 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이러한 일련의 추론을 통해 작업을 성공적으로 완료하고 목표에 올바르게 도달할 수 있습니다. 최종 결과 24는 수학적으로 정확하며 24와 같습니다.**추론 1단계** : 이 단계는 현재 집합에서 두 개의 숫자(4와 10)를 선택하는 작업 규칙에 따라 * 연산을 수행하여 새 숫자(40)를 얻는 단계로 이전 단계의 논리적 추론에 해당합니다. 나머지 숫자(5와 11)가 올바르게 업데이트되고 새 집합(40 5 11)이 형성됩니다. 이 단계는 집합의 요소 수를 줄이기 때문에 정답을 구하는 데 도움이 됩니다.

**추론 2단계** : 현재 집합에서 두 개의 숫자(5, 11)를 선택하고 + 연산을 수행하여 새로운 숫자(16)를 얻는 작업 규칙을 따르는 단계로, 이전 단계의 논리적 추론에 해당합니다. 나머지 숫자(40)가 올바르게 업데이트되고 새 집합(16 40)이 형성됩니다. 이 단계는 집합의 요소 수를 더 줄이므로 올바른 해를 구하는 데 도움이 됩니다.

**추론 3단계**: 이 단계는 현재 집합에서 두 개의 숫자(16과 40)를 선택하고 - 연산을 수행하여 새 숫자(24)를 구하는 작업 규칙을 따르므로 이전 단계의 논리적 추론입니다. 남은 자릿수가 없으므로 새 집합에는 계산된 새 숫자(24)만 포함됩니다. 이 단계는 최종 결과에 도달할 때 올바른 솔루션에 도움이 됩니다.

**권장**: 추론 단계에서 오류가 발견되지 않았습니다.

**권장 또는 거부 설명**: 모든 추론 단계는 작업의 규칙을 따르고 올바른 솔루션에 도달하는 데 도움이 되므로 권장됩니다.

**신뢰도 점수**: 1.0

### 10번째 반복에서 획득한 경험치

#####10번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

----------------------------------------------------------------

**1단계**: 현재 집합: 4 5 10 11, 선택한 두 숫자: 4 10, 연산: *, 새 숫자 계산: 40, 남은 숫자: 5 11, 새 집합: 40 5 11... 평가

점수: 0.9**2단계**: 현재 집합: 40 5 11, 선택된 두 숫자: 5 11, 연산: +, 계산된 새 숫자: 16, 남은 숫자: 40, 새 집합: 16 40... 평가 점수: 0.9

**3단계**: 현재 집합: 16 40, 선택한 두 수: 16 40, 연산: -, 계산된 새 수: 24, 남은 수: 없음, 새 집합: 24. 평가 점수: 0.9

----------------------------------------------------------------

**분석 보고서**: 이 추론 연쇄를 통해 작업을 올바르게 완료하고 추론 단계를 수행하여 목표에 도달할 수 있습니다. 추론 연쇄의 최종 결과는 수학적으로 정확한 24입니다.**추론 1단계** : 주어진 과제에 대해 논리적으로 추론하는 단계로, 두 개의 숫자를 선택하고 연산을 수행하여 새로운 숫자를 구하는 규칙을 따릅니다. 이 경우 4와 10이 선택되고 연산은 곱셈(*)입니다. 계산된 새로운 수는 40이고 나머지 수는 5와 11입니다. 이 추론 단계는 집합의 요소 수를 줄이고 새로운 수를 생성하기 때문에 정답에 도움이 됩니다.

**추론 2단계** : 두 개의 숫자를 선택하고 연산을 수행하여 새로운 숫자를 얻는 규칙을 따르는 단계로, 이전 단계의 논리적 추론입니다. 이 경우 5와 11이 선택되고 연산은 덧셈(+)입니다. 계산된 새로운 수는 16이고 남은 수는 40이며, 이 추론 단계는 집합의 원소 수를 더 줄이고 새로운 수를 생성하므로 정답을 구하는 데 도움이 됩니다.

**추론 3단계** : 두 개의 숫자를 선택하고 연산을 수행하여 새로운 숫자를 얻는 규칙을 따르는 단계로, 이전 단계의 논리적 추론입니다. 이 경우 16과 40이 선택되고 연산은 뺄셈(-)입니다. 계산된 새 숫자는 24이며 남은 자릿수가 없습니다. 이 추론 단계는 최종 결과인 24라는 목표 수를 생성하므로 정답에 도움이 됩니다.

**신뢰도 점수**: 1.0

표 13: "4 5 10 11"에 대해 BoT가 수행한 성공적인 추론 프로세스.

### 첫 번째 반복에서 획득한 경험치

###### 1차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

------------------------------------------------

**1단계**, 현재 집합: 2 5 6 6, 선택한 숫자 2개: 5 2, 연산: -, 계산된 새 숫자: 3, 남은 숫자: 6 6, 새 집합: 3 6 6 ... 평가 점수: 1.0

------------------------------------------------**분석 보고서**: 이 추론 체인은 추론 단계를 수행하여 목표에 올바르게 도달할 수 있는 가능성이 있습니다. 그러나 추론 단계가 하나만 제공되었기 때문에 이 추론 체인이 성공적으로 완료될지 확신할 수 없습니다.

**추론 1단계**: 현재 집합은 2 5 6 6입니다. 두 개의 수 5와 2가 선택되고 뺄셈 연산이 수행됩니다. 계산된 새로운 수는 3이고 나머지 수는 6과 6입니다. 새로운 집합은 3, 6, 6이 됩니다. 이 단계는 주어진 작업의 규칙을 따르고 현재 집합에서 두 개의 수를 선택하고 뺄셈 연산을 수행하므로 정답에 대한 논리적 추론입니다. 이 단계는 집합의 원소 수를 줄이고 추가 연산을 위한 새로운 수를 제공하기 때문에 정답에 도움이 됩니다.

**권장**: 이 추론 단계에서는 오류나 수정이 필요하지 않습니다.

**추천 또는 거부 설명**: 추천.

**신뢰도 점수**: 0.9

### 두 번째 반복에서 획득한 경험치

#####2차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

------------------------------------------------

**1단계**, 현재 설정: 2 5 6 6, 선택한 숫자 2개: 2 5, 연산: +, 계산된 새 숫자: 7, 남은 숫자: 6 6, 새 설정: 7 6 6 ... 평가 점수: 0.9**2단계**, 현재 집합: 7 6 6, 선택한 두 수: 7 6, 연산: *, 계산된 새 수: 42, 남은 수: 6, 새 집합: 42 6... 평가 점수: 0.9

**3단계**, 현재 설정: 42 6, 선택된 두 숫자: 42 6, 연산: /, 계산된 새 숫자: 7, 남은 숫자:, 새 설정: 7... 평가 점수: 0.9

------------------------------------------------**분석 보고서**: 이 추론 체인은 추론 단계를 수행하여 작업을 성공적으로 완료하고 목표에 올바르게 도달할 수 있었습니다. 최종 결과는 수학적으로 24와 같은 7입니다.

**추론 1단계**: 현재 집합은 2 5 6 6입니다. 두 개의 숫자 2와 5가 선택되었고 덧셈 연산을 수행했습니다. 계산된 새 수는 7입니다. 남은 수는 6 6입니다. 새 집합은 7 6 6입니다. 논리적 추론: 이 추론 단계는 두 개의 숫자를 선택하고 연산을 수행한 후 그에 따라 현재 집합을 업데이트하는 작업의 규칙을 따르므로 이전 단계에 대한 논리적 추론입니다. 정답에 유익: 예, 이 추론 단계는 집합의 요소 수를 줄이고 새로운 숫자를 생성하기 때문에 유익합니다.

**추론 2단계**: 현재 집합은 7 6 6입니다. 두 개의 숫자 7과 6이 선택되고 곱셈 연산이 수행됩니다. 계산된 새 수는 42입니다. 남은 수는 6입니다. 새 집합은 42 6입니다. 논리적 추론: 이 추론 단계는 두 개의 숫자를 선택하고 연산을 수행한 후 그에 따라 현재 집합을 업데이트하는 작업의 규칙을 따르므로 이전 단계에 대한 논리적 추론입니다. 정답에 유익: 예, 이 추론 단계는 집합의 요소 수를 더 줄이고 새로운 숫자를 생성하기 때문에 유익합니다.

**추론 3단계** : 현재 집합은 42 6입니다. 숫자 42와 6 두 개를 선택하고 나눗셈 연산을 수행했습니다. 계산된 새로운 수는 7입니다. 남은 숫자가 없습니다. 새 집합은 7입니다. 논리적 추론: 이 추론 단계는 두 개의 숫자를 선택하고 연산을 수행한 후 그에 따라 현재 집합을 업데이트하는 작업의 규칙을 따르므로 이전 단계에 대한 논리적 추론입니다. 정답에 유익: 예, 이 추론 단계는 수학적으로 24와 같은 최종 결과 7을 생성하기 때문에 유익합니다.

**신뢰도 점수**: 0.9

### 다섯 번째 반복에서 얻은 교훈

###### 5번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

------------------------------------------------

**1단계**, 현재 집합: 2 5 6 6, 선택한 두 수: 5 6, 연산: *, 계산된 새 수: 30, 남은 수: 2 6, 새 집합: 30 2 6... 평가 점수: 0.9**단계 2**, 현재 집합: 30 2 6, 선택한 두 수: 30 2, 연산: /, 계산된 새 수: 15, 남은 수: 6, 새 집합: 15 6... 평가 점수: 0.9

**3단계**, 현재 설정: 15 6, 선택한 숫자 2개: 15 6, 연산: *, 계산된 새 숫자: 90, 남은 숫자: 없음, 새 설정: 90 ... 평가 점수: 0.9

------------------------------------------------**분석 보고서**: 이 추론 체인은 추론 단계를 수행하여 작업을 완료하고 목표에 올바르게 도달할 수 있었습니다. 3단계에서 얻은 최종 결과는 90으로 수학적으로 24와 같습니다.

**추론 1단계**: 현재 집합은 2 5 6 6입니다. 두 개의 숫자 5와 6이 선택되고 곱셈 연산이 수행됩니다. 계산된 새 수는 30입니다. 나머지 수는 2와 6입니다. 새 집합은 30 2 6으로 올바르게 업데이트됩니다. 이 단계는 과제의 규칙을 따르고 현재 집합에서 두 수를 선택하고 곱셈 연산을 수행하여 새 수를 얻기 때문에 올바른 해에 대한 논리적 추론입니다. 이 단계는 집합의 원소 수를 줄이므로 정답에 도움이 됩니다.

**추론 2단계**: 현재 집합은 30 2 6입니다. 30과 2라는 두 개의 숫자를 선택하고 나눗셈 연산을 실행합니다. 계산된 새 수는 15입니다. 남은 수는 6입니다. 새 집합은 15 6으로 올바르게 업데이트됩니다. 이 단계는 과제의 규칙에 따라 현재 집합에서 두 개의 수를 선택하고 나누기 연산을 수행하여 새 수를 얻으므로 정답에 대한 논리적 추론입니다. 이 단계는 집합의 요소 수를 더 줄이므로 정답에 도움이 됩니다.

**추론 3단계**: 현재 집합은 15 6입니다. 숫자 15와 6 두 개가 선택되었고 곱셈 연산을 수행했습니다. 계산된 새 숫자는 90입니다. 남은 숫자가 없습니다. 계산된 새 수 90만 포함하도록 새 집합이 업데이트됩니다. 이 단계는 집합을 최종 결과인 하나의 수로 단순화하므로 정답에 대한 논리적 추론입니다.

**권장**: 이 추론 연쇄의 추론 단계에는 오류나 수정이 필요하지 않습니다.

**권장 또는 거부 설명**: 이 추론 연쇄의 모든 추론 단계는 이전 단계에 대한 논리적 추론이며 올바른 솔루션에 기여하기 때문에 권장됩니다.

**신뢰도 점수**: 0.9

### 아홉 번째 반복에서 획득한 경험치

######9번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

------------------------------------------------

**1단계**, 현재 설정: 2 5 6 6, 선택한 숫자 2개: 2 5, 연산: +, 계산된 새 숫자: 7, 남은 숫자: 6 6, 새 설정: 7 6 6 ... 평가 점수: 0.9**2단계**, 현재 집합: 7 6 6, 선택한 두 수: 7 6, 연산: *, 계산된 새 수: 42, 남은 수: 6, 새 집합: 42 6... 평가 점수: 0.9

**3단계**, 현재 설정: 42 6, 선택된 두 숫자: 42 6, 연산: /, 계산된 새 숫자: 7, 남은 숫자:, 새 설정: 7... 평가 점수: 0.9

------------------------------------------------**분석 보고서**: 이 추론 연쇄는 추론 단계를 수행하여 작업을 성공적으로 완료하고 목표에 올바르게 도달합니다. 3단계에서 계산된 새로운 숫자는 7이며, 이는 수학적으로 목표 숫자 24와 동일합니다.

**추론 1단계** : 현재 집합은 2 5 6 6입니다. 숫자 2와 5 두 개가 선택되었습니다. 연산은 덧셈(+)입니다. 계산된 새로운 수는 7입니다. 나머지 숫자는 6과 6입니다. 새로운 집합은 7 6 6입니다. 논리적 추론: 선택한 두 숫자가 현재 집합에서 올바르게 선택되었고 연산이 올바르게 수행되었습니다. 계산된 새 숫자가 연산의 올바른 결과입니다. 올바른 솔루션의 이점: 이 단계에서는 현재 집합의 크기를 줄이고 후속 추론 단계를 위한 새 집합을 생성합니다.

**추천**: 수락됨.

**추론 2단계**: 현재 집합은 7 6 6입니다. 두 개의 숫자 7과 6이 선택되었습니다. 연산은 곱셈(*)입니다. 계산된 새 수는 42입니다. 남은 수는 6입니다. 새 집합은 42 6입니다. 논리적 추론: 선택한 두 숫자가 현재 집합에서 올바르게 선택되었고 연산이 올바르게 실행되었습니다. 계산된 새 숫자가 연산의 올바른 결과입니다. 올바른 솔루션의 이점: 이 단계에서는 현재 집합의 크기가 더 줄어들고 후속 추론 단계를 위한 새 집합이 생성됩니다.

**추천**: 수락됨.

**추론 3단계**: 현재 집합은 42 6입니다. 두 개의 숫자 42와 6이 선택되었습니다. 연산은 나눗셈(/)입니다. 계산된 새 숫자는 7입니다. 남은 숫자가 없습니다. 계산된 새 숫자는 7입니다. 남은 숫자가 없습니다. 새 집합은 7입니다. 논리적 추론: 선택한 두 숫자가 현재 집합에서 올바르게 선택되었고 연산이 올바르게 수행되었습니다. 계산된 새 숫자가 연산의 올바른 결과입니다. 올바른 해의 이점: 이 단계에서는 남은 숫자가 없으므로 추론의 연쇄가 완료됩니다. 계산된 새 숫자가 최종 결과입니다.

**추천**: 수락됨.

**신뢰도 점수**: 1.0

표 14: "2 5 6 6"에 대한 BoT의 잘못된 추론 과정. 이는 BoT가 잘못된 피드백으로 인해 문제를 해결하지 못했지만 여전히 24가 아닌 숫자가 맞다고 확신하여 두 번째 반복 후 잘못된 추론 체인을 반복하는 특수한 경우입니다.

# 차세대 프롬프트 포맷팅

------------------------**질문:** 제임스는 일주일에 3번 스프린트를 3번 하기로 결정했습니다. 각 스프린트마다 60미터를 달립니다. 일주일에 총 몇 미터를 뛰었나요?

**답변:** 차근차근 생각해 봅시다.

경험을 추론하기 위해 기록을 불러옵니다(경험이 0인 경우 무시):

################################분석과 결론에 주의를 기울이고 권장 사항에 따라 비슷한 실수를 반복하지 마세요.

다음은 일련의 추론 단계와 평가 점수입니다(점수가 높을수록 추론 단계가 작업을 완료할 가능성이 높다는 의미입니다). :

---------- --

---------- --위에 나열된 추론 단계(즉, 경험 블록의 단계가 아님)를 기반으로 다음을 생성하는 추론 단계를 수행해 주세요.

가능한 추론 단계를 연속적으로 수행합니다.

# 경험 생성을 위한 프롬프트 형식

-------------------**질문:** 제임스는 일주일에 3번 스프린트를 하기로 결정했습니다. 그는 각 스프린트마다 60미터를 달립니다. 일주일에 총 몇 미터를 뛰었나요?

**답변: ** 단계별로 생각해 봅시다. 다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

---------- --

---------- --다음 사항을 포함한 상세한 비평을 제공하여 이 추론의 연쇄를 평가해 주십시오. 이 추론의 연쇄가 추론 단계를 수행하여 과제를 올바르게 완료하고 목표에 도달할 수 있습니까? 그 이유는 무엇인가요? '분석'에 분석 및 결론에 대한 보고서를 작성합니다. 각 추론 단계에 대해 현재 단계가 이전 단계의 논리적 귀결인지, 추론 단계가 올바른 해결책에 기여하는지 여부에 대한 자세한 분석을 제공합니다. 오류가 있는 각 추론 단계에 대해 오류 보고서와 그에 따른 수정 권장 사항을 제공하세요. 각 추론 단계마다 권고 또는 거부에 대한 설명을 제공하세요. 의견은 간결해야 하며, 다른 단계에서 동일한 분석을 반복하지 말고 다음 형식(추론 단계 ¡idx¿)을 따라야 합니다. 분석 ¡idx¿. 추천:. 추천 또는 거부 설명:. 3. 이 평가 및 의견에 대한 신뢰 점수는 얼마입니까? 0.1, 0.3, 0.5, 0.7, 0.9, 1.0] 중에서 값을 선택해 주세요. 점수는 사용자가 읽을 수 있도록 '신뢰 점수:' 뒤에 입력해야 합니다.

표 15: GSM8K에서 사용되는 프롬프트 형식. "질문"에 대한 추론 프로세스는 표 16에 나와 있습니다.

### 첫 번째 반복에서 획득한 경험치

###### 1차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

---------- --

1단계: 먼저, 제임스가 스프린트마다 달리는 총 거리를 계산해야 합니다. 그는 스프린트당 60미터를 뛰고 일주일에 3번 뛰므로 60에 3을 곱합니다. 평가 점수: 0.7

2단계: 제임스가 스프린트 달리기를 할 때마다 달린 총 거리를 계산한 후, 일주일 동안 달린 총 거리를 계산해야 합니다. 일주일에 3번 달리기 때문에 매번 총 거리에 3을 곱합니다. 평가 점수: 1.0

---------- --

분석: 추론 체인은 추론 단계를 수행하여 작업을 올바르게 완료하고 목표에 도달할 수 있습니다. 추론 체인은 정확하고 논리적이며 제임스가 일주일 동안 달리는 총 거리를 계산하여 문제를 성공적으로 해결합니다.

추론 1단계: 분석하기: 이 단계는 논리적으로 정확합니다. 제임스가 각 스프린트에서 달리는 총 거리를 계산해야 할 필요성을 파악하여 문제를 정확하게 설명합니다. 그러나 설명이 다소 오해의 소지가 있습니다. 제임스는 일주일에 3번 스프린트를 뛰는 것이 아니라 일주일에 3번씩 3번의 스프린트를 뛰고 있습니다. 곱셈은 스프린트당 거리와 스프린트당 횟수 사이에 있어야 합니다. 제안: "그는 스프린트당 60미터를 달리고 한 번에 3번 뛰기 때문에 60에 3을 곱합니다."로 설명을 변경해야 합니다. 제안: 추론 단계는 정확하지만 명확성을 위해 설명을 변경할 필요가 있습니다.

추론 2단계: 분석: 이 단계는 이전 단계로부터 논리적으로 추론합니다. 각 달리기의 총 거리와 일주일 동안의 달리기 횟수를 곱하여 제임스가 일주일 동안 달린 총 거리를 올바르게 계산합니다. 권장: 수정할 필요가 없습니다. 권장: 추론 단계가 올바르므로 수락해야 합니다.

신뢰도 점수: 0.9

##########################################

### 두 번째 반복에서 획득한 경험치

#####2차 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

---------- --

1단계: 먼저, 제임스가 달릴 때마다 달리는 총 거리를 계산해야 합니다. 제임스는 한 번에 60미터를 달리고 한 번에 스프린트 3번을 뛰므로 60에 3을 곱합니다. 평가 점수: 1.0

---------- --

분석: 주어진 추론 연쇄는 부분적으로 작업을 완료하고 목표에 도달합니다. 그러나 제임스가 매번 달리는 총 거리를 계산한 후 멈추기 때문에 불완전합니다. 제임스가 일주일 동안 달리는 총 거리를 계속 계산하지 않습니다.

추론 1단계: 첫 번째 단계에서는 제임스가 매번 달리는 총 거리를 올바르게 계산합니다. 이 단계는 문제에서 논리적으로 제임스가 한 스프린트당 60미터를 달리고, 한 스프린트를 3번 뛰기 때문에 한 번의 총 거리는 60 * 3이라고 추론합니다. 이 단계는 제임스가 일주일 동안 달린 총 거리를 구하는 데 필요한 계산이므로 정답에 도움이 됩니다.

제안: 추론의 연쇄에는 제임스가 일주일 동안 달리는 총 거리를 계산하는 과정이 계속 포함되어야 합니다. 이는 각 달리기의 총 거리(1단계에서 계산)와 일주일 동안의 달리기 횟수를 곱하여 계산할 수 있습니다.

권장 사항: 추론 1단계는 제임스의 각 달리기 총 거리를 올바르게 계산하므로 수락합니다. 그러나 추론의 연쇄에는 제임스가 일주일 동안 달리는 총 거리를 계산하는 과정이 계속 포함되어야 합니다.

신뢰도 점수: 0.9

##########################################

### 세 번째 반복에서 얻은 교훈

######3번째 추론 및 의견 체인

다음은 추론의 단계를 순서대로 제시하는 추론의 연쇄입니다:

---------- --

1단계: 문제의 요소를 파악합니다. 제임스는 일주일에 3번 60미터 스프린트를 3회 뛰고 있습니다. 그가 일주일 동안 달리는 총 거리를 구해야 합니다. 평가 점수: 0.9

2단계: 제임스가 하루에 달릴 총 거리를 계산합니다. 하루에 스프린트를 3번 뛰고 각 스프린트는 60미터이므로 하루에 총 거리는 스프린트 3번 * 60미터/스프린트 = 180미터가 됩니다. 평가 점수: 0.9. 평가 점수: 0.9

3단계: 이제 제임스가 일주일 동안 달리는 총 거리를 계산합니다. 일주일에 3번 180미터를 뛰었으므로 일주일 동안의 총 거리는 3일/주 * 180미터/일 = 540미터가 됩니다. 평가 점수: 1.0

---------- --

분석 보고서: 추론의 연쇄가 작업을 완료하고 목표에 올바르게 도달했습니다. 각 단계는 이전 단계에서 논리적으로 이어져 문제 해결에 도움이 되었습니다.

추론 1단계: 첫 번째 단계에서는 문제의 요소와 당면한 과제를 정확하게 식별합니다. 문제 진술을 올바르게 해석하고 후속 단계를 위한 단계를 설정합니다. 권장: 없음. 권장: 이 단계는 문제와 수행해야 할 작업을 올바르게 식별하므로 수락하세요.

추론 2단계: 이 단계는 첫 번째 단계와 논리적으로 이어집니다. 제임스가 하루에 달린 스프린트 횟수와 각 스프린트의 거리를 곱하여 제임스가 하루에 달린 총 거리를 정확하게 계산합니다. 이 단계는 문제를 더 작고 관리하기 쉬운 부분으로 나누기 때문에 솔루션에 도움이 됩니다. 권장: 없음. 권장: 이 단계는 일일 달리기 거리를 정확하게 계산하므로 수락하세요.

추론 3단계: 이 단계는 이전 단계에서 논리적으로 추론합니다. 각 달리기 거리와 일주일 동안의 달리기 횟수를 곱하여 제임스가 일주일 동안 달리는 총 거리를 올바르게 계산합니다. 이 단계는 계산을 완료하고 질문에 대한 답을 제공하므로 솔루션에 도움이 됩니다. 권장: 없음. 권장: 이 단계는 주간 달리기 거리를 올바르게 계산하므로 이 단계를 수락하세요.

신뢰도 점수: 1.0

올바른 추론 체인을 얻었으므로 후속 반복은 무시됩니다.

표 16: BoT의 성공적인 추론 프로세스.

### 첫 번째 반복에서 획득한 경험치

################################추론 단계가 포함된 다음 추론 체인이 순서대로 표시됩니다:

---------- --

1단계: 시애틀에 양이 20마리라면, 주어진 비율을 사용하여 찰스턴과 툴루즈의 양 수를 계산할 수 있습니다. 문제에 따르면 찰스턴에는 시애틀보다 4배 많은 양의 양이 있습니다. 따라서 찰스턴에는 4 * 20 = 80마리의 양이 있습니다. 평가 점수: 1.0

---------- --분석: 이 추론의 연쇄는 문제를 해결하기 위해 올바른 방향으로 나아가고 있습니다. 첫 번째 단계에서는 문제 문장을 올바르게 해석하고 주어진 정보를 바탕으로 찰스턴에 있는 양의 수를 정확하게 계산합니다. 올바른 수학적 연산(곱셈)을 사용하여 문제 진술에서 논리적으로 추론한 찰스턴의 양 수를 결정했습니다.

추론 1단계: 이 단계는 주어진 문제 진술에 따라 논리적으로 추론하는 단계입니다. 문제 진술에 따르면 찰스턴에는 시애틀보다 4배 많은 양의 양이 있다고 나와 있습니다. 시애틀의 양이 20마리이므로 4를 곱하여 찰스턴의 양 수를 구하는 것이 정답입니다. 이 단계는 세 도시 모두의 총 양 수를 구하는 데 필요한 찰스턴의 양 수를 정확하게 계산하기 때문에 정답에 도움이 됩니다. 이 단계에는 오류가 없습니다.

권장: 이 단계는 올바르며 권장 사항이 필요하지 않습니다.

권장: 이 추론 단계는 문제 진술을 올바르게 설명하고 찰스턴의 양 수를 정확하게 계산하므로 권장됩니다.

신뢰도 점수: 1.0

##########################################

### 세 번째 반복에서 획득한 경험치

################################추론 단계가 포함된 다음 추론 체인이 순서대로 표시됩니다:

---------- --

1단계: 시애틀에 양이 20마리라면, 주어진 비율을 사용하여 찰스턴과 툴루즈의 양 수를 계산할 수 있습니다. 문제에 따르면 찰스턴에는 시애틀보다 4배 많은 양의 양이 있습니다. 따라서 찰스턴에는 4 * 20 = 80마리의 양이 있습니다. 평가 점수: 1.0

---------- --분석: 이러한 일련의 추론 단계를 수행함으로써 과제를 올바르게 완료하고 목표에 도달할 수 있습니다. 이 과제에서는 시애틀에 20마리의 양이 있고 다른 도시에 있는 양과 시애틀에 있는 양의 비율이 일정하다는 것을 알 때 툴루즈, 찰스턴, 시애틀의 총 양 수를 구해야 합니다. 추론 연쇄는 문제를 올바르게 설명하고 주어진 비율을 사용하여 찰스턴의 양 수를 계산합니다.

추론 1단계: 첫 번째 단계에서는 문제 진술에 제공된 정보를 올바르게 사용합니다. 찰스턴에는 시애틀보다 4배 많은 양이 있고 시애틀에는 20마리의 양이 있으므로 찰스턴에는 4 * 20 = 80마리의 양이 있다고 논리적으로 추론합니다. 이 단계는 주어진 비율과 시애틀의 양 수를 기반으로 찰스턴의 양 수를 올바르게 계산하므로 올바른 해답에 도움이 됩니다. 이 추론 단계에는 오류가 없습니다.

권장: 이 단계는 올바르게 추론 및 계산되었으며 권장 사항이 필요하지 않습니다.

설명 추천 또는 거부: 이 추론 단계는 문제 문장을 올바르게 설명하고 주어진 비율을 사용하며 찰스턴의 양 수를 올바르게 계산하므로 추천합니다.

신뢰도 점수: 1.0

##########################################

### 다섯 번째 반복에서 획득한 경험치

################################추론 단계가 포함된 다음 추론 체인이 순서대로 표시됩니다:

---------- --

1단계: 시애틀에 양이 20마리라면, 주어진 비율을 사용하여 찰스턴과 툴루즈의 양 수를 계산할 수 있습니다. 문제에 따르면 찰스턴에는 시애틀보다 4배 많은 양의 양이 있습니다. 따라서 찰스턴에는 4 * 20 = 80마리의 양이 있습니다. 평가 점수: 1.0

---------- --분석 보고서: 이 추론 연쇄는 문제에 주어진 정보를 올바르게 적용하여 찰스턴의 양 수를 결정합니다. 주어진 정보로부터 찰스턴의 양이 시애틀보다 4배 많고 시애틀의 양이 20마리라면 찰스턴의 양은 4 * 20 = 80마리여야 한다는 것을 논리적으로 추론합니다. 이 추론 단계는 주어진 정보로부터 찰스턴의 양 수를 정확하게 계산하기 때문에 정답에 도움이 됩니다.

추론 단계 1. 첫 번째 단계는 논리적으로 올바르며 문제 진술에서 따릅니다. 이 단계에서는 찰스턴과 시애틀의 주어진 양 비율을 사용하여 찰스턴의 양 수를 구합니다. 이 단계는 주어진 비율을 올바르게 적용하여 찰스턴의 양 수를 구하므로 올바른 해답에 도움이 됩니다. 이 단계에는 오류가 없습니다.

권장: 이 단계는 논리적으로 정확하고 솔루션에 도움이 되므로 권장할 필요가 없습니다.

권장: 이 단계는 주어진 비율을 올바르게 적용하고 찰스턴의 양 수를 계산하므로 권장됩니다.

신뢰도 점수: 1.0

##########################################

### 9번째 반복에서 획득한 경험치

################################추론 단계가 포함된 다음 추론 체인이 순서대로 표시됩니다:

---------- --

1단계: 찰스턴에는 시애틀보다 4배 많은 양이 있고 시애틀에는 20마리의 양이 있으므로 찰스턴의 양 수에 4를 곱하여 찰스턴의 양 수를 계산할 수 있습니다. 평가 점수: 1.0

---------- --

분석: 1단계의 추론 연쇄는 정확하고 논리적으로 타당합니다. 문제 진술에 주어진 정보를 올바르게 적용하여 찰스턴의 양 수를 결정합니다. 이 단계는 찰스턴의 양 수를 정한 다음 툴루즈의 양 수를 결정하는 데 사용되므로 문제 해결에 매우 중요합니다.추론 1단계: 이 단계에서는 주어진 문제 진술에서 논리적으로 추론합니다. 찰스턴에 시애틀보다 양이 4배 더 많다는 정보를 올바르게 해석하고 이 정보를 적용하여 찰스턴의 양 수를 계산합니다. 이 단계는 세 곳 모두의 총 양 수를 계산하는 데 필요한 정보를 제공하므로 정답을 찾는 데 유용합니다.

권장: 올바른 추론과 정확한 계산을 위한 이 단계는 권장 사항이 필요하지 않습니다.

권장: 이 추론 단계는 올바르게 추론하고 정확하게 계산한 것이므로 수락하는 것이 좋습니다.

신뢰도 점수: 1.0

##########################################

표 17: "툴루즈에는 찰스턴보다 양이 두 배 더 많습니다. 찰스턴은 시애틀보다 양이 4배 많습니다. 시애틀에 양이 20마리일 때 툴루즈, 찰스턴, 시애틀에 있는 양은 몇 마리일까요?" 부분적으로 성공한 추론 과정 얻은 추론의 연쇄는 이 문제의 절반만 해결했으며, 일반적으로 이러한 경우는 BoT가 사용한 LLM이 문제를 정확하게 이해하지 못하기 때문입니다. 결과적으로 BoT는 올바른 추론 과정을 수행했지만 정답에 대한 완전한 추론 연쇄를 생성하지 못했습니다. 그럼에도 불구하고 이 추론 연쇄는 LLM이 포착한 문제에 대한 정확한 답을 제공하므로 BoT는 여전히 성공적인 것으로 간주됩니다.

### 첫 번째 반복에서 획득한 경험치

###### 1차 추론 및 의견 체인

아래는 일련의 추론 단계를 순서대로 나열한 것입니다:

-------------------

**1단계**: 머라이어와 할머니가 사용한 실의 분수를 야드로 변환합니다.머라이어는 1/4 타래를 사용했는데, 이는 1/4 * 364야드에 해당합니다. 그녀의 할머니는 1/2 * 364야드에 해당하는 1/2타래의 실을 사용했습니다. 평가 점수: 1.0**2단계**: 머라이어가 사용한 실의 수에 할머니가 사용한 실의 수를 더하여 머라이어와 할머니가 사용한 실의 총 수를 계산합니다. 평가 점수: 1.0

**1단계** (반복): 머라이어와 할머니가 사용한 실의 분수를 야드로 환산합니다.머라이어는 1/4 타래를 사용했으므로 1/4 * 364야드 = 91야드가 됩니다. 그녀의 할머니는 1/2타래의 실을 사용했으므로 1/2 * 364야드 = 182야드입니다. 평가 점수: 1.0

-------------------

**분석 보고서**: 추론 연쇄는 추론 단계를 실행하여 작업을 올바르게 완료하고 목표에 도달할 수 있습니다. 단계는 논리적이고 순차적이며 문제를 해결하는 데 필요합니다. 이 단계는 사용된 실의 비율을 야드로 변환하여 총 사용된 실의 양을 결정하는 데 필요합니다. 그런 다음 이 양을 더하여 머라이어와 할머니가 사용한 총 실의 수를 구합니다.추론 1단계: 머라이어와 할머니가 사용한 실의 분수를 야드로 올바르게 변환하는 단계입니다. 문제 진술에 대한 논리적인 추론이며, 문제를 동일한 단위(야드)로 변환하여 양을 더할 수 있으므로 정답에 도움이 됩니다. 권장: 없음. 권장: 이 단계는 올바르며 그대로 두어야 합니다.

추론 2단계: 이 단계에서는 이전 단계에서 동일한 단위로 변환된 머라이어와 할머니가 사용한 실의 양을 더해야 하므로 이전 단계에서 논리적으로 추론합니다. 이 단계는 문제의 목표인 사용된 총 실의 수를 계산하기 때문에 올바른 해답에 도움이 됩니다. 권장: 없음. 권장: 이 단계는 올바르므로 그대로 두어야 합니다.

추론 1단계(반복). 이 단계는 첫 번째 단계의 반복이지만 계산이 완료되었습니다. 문제 진술에 대한 논리적 추론이며 올바른 해답에 도움이 됩니다. 그러나 새로운 정보를 추가하거나 솔루션의 진행에 기여하지 않으므로 추론 체인에서 반복해서는 안 됩니다. 권장 사항: 추론 체인에서 이 중복 단계를 제거하세요. 권장: 이 단계는 정확하지만 중복되므로 추론 체인에서 제거해야 합니다.

신뢰도 점수: 1.0

### 두 번째 반복에서 획득한 경험치

#####2차 추론 및 의견 체인

아래는 일련의 추론 단계를 순서대로 나열한 것입니다:

-------------------

**1단계**: 머라이어와 할머니가 각각 사용한 실의 점수에 실타래의 총 마디 수를 곱하여 사용한 실의 양을 계산합니다. 평가 점수: 1.0**1단계**: 먼저 머라이어와 할머니가 각각 사용한 실의 양을 계산해야 합니다. 이를 위해 두 사람이 사용한 실의 비율에 실의 총 길이를 곱하면 됩니다. 따라서 머라이어는 1/4 * 364야드의 실을 사용했고 할머니는 1/2 * 364야드의 실을 사용했습니다. 평가 점수: 1.0

**2단계**: 머라이어와 할머니가 각각 사용한 실의 양을 파악한 후, 이 양을 합산하여 총 실의 양을 구해야 합니다. 따라서 머라이어의 실(1/4 * 364야드)과 할머니의 실(1/2 * 364야드)을 더하여 두 사람이 사용한 총 실의 양을 구합니다. 평가 점수: 1.0

-------------------

**분석 보고서**: 추론 과정이 반복적이고 중복 오류가 있었으며, 1단계가 세 번 반복되었습니다. 그러나 단계 자체는 논리적으로 정확했으며 올바른 문제 해결로 이어졌습니다.추론 1단계: 첫 번째 단계는 논리적으로 옳습니다. 머라이어와 할머니가 사용한 실의 분율에 실의 총 야드를 곱하여 머라이어와 할머니가 사용한 실의 양을 따로 계산해야 할 필요성을 정확하게 파악하고 있습니다. 이 단계는 사용된 실의 총량을 계산하는 단계를 설정하므로 정답을 찾는 데 도움이 됩니다. 권장: 없음. 권장: 승인됨

추리 2단계: 두 번째 단계는 첫 번째 단계에서 논리적으로 이어집니다. 머라이어와 할머니가 각각 얼마나 많은 실을 사용했는지 알아낸 후, 이 양을 더하여 사용된 총 실의 양을 구하는 것이 논리적으로 맞습니다. 이 단계는 사용된 실의 총량을 계산할 수 있으므로 올바른 솔루션에 도움이 됩니다. 권장: 없음. 권장: 승인됨

버그 신고: 1단계를 세 번 반복하는 것은 불필요하며 해결에 도움이 되지 않습니다. 중복을 피하기 위해 수정해야 합니다. 권장 사항: 1단계의 반복을 제거하세요. 추론 체인에는 솔루션에 기여하는 고유한 단계만 포함되어야 합니다.

신뢰도 점수: 0.9

### 세 번째 반복에서 획득한 경험치

######3번째 추론 및 의견 체인

아래는 일련의 추론 단계를 순서대로 나열한 것입니다:

-------------------

**1단계**: 먼저 머라이어와 할머니가 총 몇 개의 실타래를 사용했는지 알아내야 합니다. 머라이어는 실타래 1/4을 사용했고 할머니는 실타래 1/2을 사용했습니다. 총 몇 개의 타래를 사용했는지 알아내려면 1/4과 1/2을 더해야 합니다. 평가 점수: 1.0**2단계**: 총 사용한 실의 수를 파악한 후 이를 야드로 환산합니다. 원사 1타래는 364야드라는 것을 알고 있습니다. 따라서 사용한 실의 총 수에 364를 곱하여 사용한 실의 총 길이(273야드)를 구합니다. 평가 점수: 1.0

-------------------

**분석 보고서**: 추론의 사슬은 과제를 올바르게 완료하고 목표에 도달할 수 있습니다. 이 과제는 머라이어와 할머니가 총 몇 야드의 실을 사용했는지 알아내는 것이었습니다. 추론 체인은 먼저 머라이어와 할머니가 사용한 실의 분수를 더하여 머라이어와 할머니가 사용한 총 실의 롤 수를 계산합니다. 그런 다음 이 총 원사 수를 원하는 최종 답인 야드로 변환합니다.추론 1단계: 첫 번째 단계는 문제 해결의 첫 번째 단계가 머라이어와 할머니가 사용한 실의 분수를 더하는 것임을 정확하게 파악하기 때문에 논리적 추론입니다. 이 단계는 실을 야드로 변환하는 다음 단계의 단계를 설정하기 때문에 올바른 해답에 도움이 됩니다. 이 단계에서 오류가 발견되지 않았습니다. 권장 사항: 이 단계는 올바르게 추론되었으므로 권장 사항이 필요하지 않습니다. 권장: 이 단계는 처음에 사용하기 위해 계산해야 하는 총 원사 수를 올바르게 식별하므로 이 단계를 권장합니다.

추론 2단계: 두 번째 단계는 첫 번째 단계로부터 논리적으로 추론합니다. 문제에 답하기 위해 사용된 총 실의 수를 야드로 변환해야 한다는 것을 정확하게 식별합니다. 이 단계는 최종 답으로 바로 이어지기 때문에 정답에 도움이 됩니다. 이 단계에서는 오류가 발견되지 않았습니다. 권장 사항: 이 단계는 올바르게 추론되었으므로 권장 사항이 필요하지 않습니다.

권장: 이 단계는 사용된 원사의 총 개수를 야드로 변환해야 할 필요성을 정확하게 파악할 수 있으므로 이 단계를 권장합니다.

신뢰도 점수: 1.0

### 6번째 반복에서 획득한 경험치

####6번째 추론 및 의견 체인

아래는 일련의 추론 단계를 순서대로 나열한 것입니다:

-------------------

**1단계**: 머라이어가 사용한 실의 총 야드수에 머라이어가 사용한 비율(1/4)을 곱하여 머라이어가 사용한 실의 양을 계산하고, 마찬가지로 할머니가 사용한 실의 총 야드수에 할머니가 사용한 비율(1/2)을 곱하여 할머니가 사용한 실의 양을 계산합니다.머라이어 사용량: 1/4 * 364 = 91야드입니다. 할머니 사용: 1/2 * 364 = 182야드. 평가 점수: 1.0**2단계**: 머라이어가 사용한 실의 양에 할머니가 사용한 실의 양을 더하여 총 사용한 실의 양을 구합니다. 사용된 총 실의 양 = 273야드. 평가 점수: 1.0

**3단계**: 머라이어와 할머니가 사용한 실의 총량을 선언하세요.머라이어와 할머니는 총 273야드의 실을 사용했습니다. 평가 점수: 1.0

-------------------

**분석 보고서**: 추론의 연쇄가 논리적으로 타당하며 과제를 올바르게 완료했습니다. 추론 연쇄는 먼저 머라이어와 할머니가 각각 사용한 실의 양을 계산한 다음, 이 양을 더하여 총 사용한 실의 양을 구하고 마지막으로 총 실의 양을 선언합니다.추론 1단계: 첫 번째 단계는 문제에 주어진 정보를 직접 적용하기 때문에 논리적이며, 사용된 실의 양을 각각 제공하기 때문에 정답에 도움이 됩니다. 권장 사항: 이 단계는 올바르며 유지되어야 합니다.

표 18: "마리아의 할머니가 마리아에게 뜨개질을 가르치고 있고, 마리아는 1/4 꼬기 실을 사용하고 있고, 할머니는 1/2 꼬기 실을 사용하고 있으며, 실 한 꼬기의 길이는 364야드인데, 두 사람이 함께 사용한 실은 몇 야드입니까?"라는 질문에 대한 BoT의 답입니다. 의 성공적인 추론 과정은

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...