일반 소개

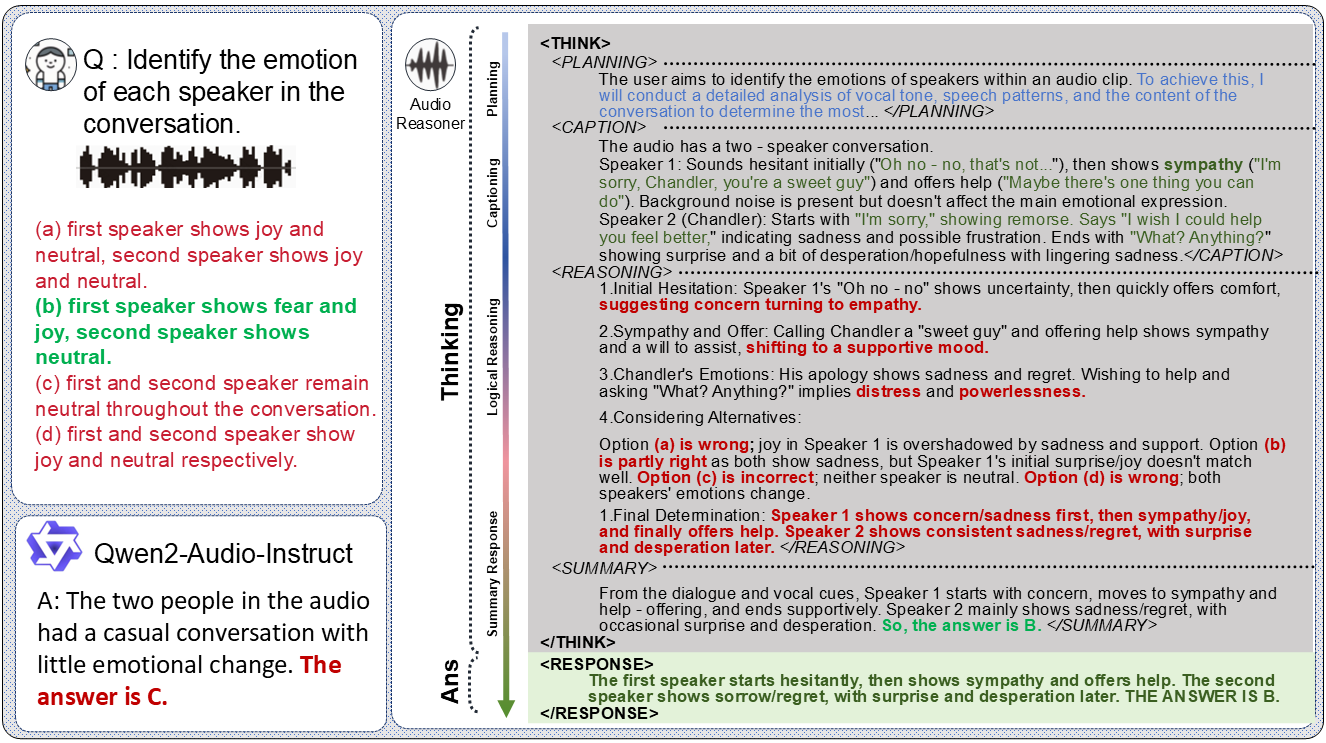

Audio-Reasoner는 칭화대학교 팀이 개발하여 깃허브에서 호스팅하는 오픈 소스 프로젝트로, 오디오의 심층 추론을 지원하는 대규모 언어 모델을 구축하는 데 중점을 두고 있습니다. 이 모델은 구조화된 생각의 연쇄(CoT) 기술을 도입하여 오디오 콘텐츠에 대한 복잡한 추론과 다중 모드 이해를 가능하게 하는 Qwen2-Audio-Instruct를 기반으로 합니다. 이 프로젝트에는 오디오-리서처-7B 모델과 곧 출시될 CoTA 데이터세트(120만 개의 고품질 샘플 포함)가 포함되며, 오디오-리서처는 MMAU-mini 및 AIR-Bench-Chat 벤치마크에서 각각 25.42% 및 14.57%의 획기적인 성능 향상을 달성했습니다.Audio-Reasoner Audio-Reasoner는 사운드, 음악, 음성 및 기타 오디오 유형의 처리를 지원하며 오디오 분석 및 콘텐츠 이해 시나리오에 적합하므로 연구자와 개발자에게 이상적인 툴입니다.

기능 목록

- 오디오 심층 추론구조화된 연쇄 사고를 사용하여 오디오를 분석하고 세부적인 추론 과정과 결과를 생성합니다.

- 멀티모달 작업 지원교차 모드 이해 및 추론 작업을 위해 오디오와 텍스트 입력을 결합합니다.

- 다중 오디오 처리음성, 음악, 음성 등 다양한 오디오 유형의 인식 및 분석을 지원합니다.

- 사전 학습된 고성능 모델여러 벤치마크 테스트에서 우수한 성적을 거둔 Audio-Reasoner-7B 모델을 제공합니다.

- CoTA 데이터 세트120만 개의 샘플이 포함되어 있어 구조화된 추론 훈련과 모델의 기능 향상을 지원합니다.

- 추론 코드 및 데모사용자 테스트 및 개발을 위한 완전한 추론 코드와 데모 예제를 제공합니다.

- 오픈 소스 프로그램:: 향후에는 커뮤니티 협업을 촉진하기 위해 데이터 합성 프로세스와 트레이닝 코드가 공개될 예정입니다.

도움말 사용

설치 프로세스

오디오 리서처를 설치하려면 Python 환경을 구성하고 모델 가중치를 다운로드해야 하며, 다음은 사용자가 빌드를 성공적으로 완료할 수 있도록 하기 위한 세부 단계입니다:

1. GitHub 리포지토리 복제하기

먼저 오디오 리소저 프로젝트를 로컬에 복제합니다. 터미널을 열고 다음 명령을 실행합니다:

git clone https://github.com/xzf-thu/Audio-Reasoner.git

cd Audio-Reasoner

이렇게 하면 프로젝트 파일이 로컬 및 프로젝트 디렉토리에 다운로드됩니다.

2. 가상 환경 생성 및 활성화

종속성 충돌을 피하려면 Conda를 사용하여 별도의 Python 환경을 만드는 것이 좋습니다:

conda create -n Audio-Reasoner python=3.10

conda activate Audio-Reasoner

이 명령은 "Audio-Reasoner"라는 Python 3.10 기반 환경을 생성하고 활성화합니다.

3. 종속성 패키지 설치

이 프로젝트는 다음을 제공합니다. requirements.txt 파일에 필요한 종속성이 포함된 파일을 다운로드합니다. 설치 단계는 다음과 같습니다:

pip install -r requirements.txt

pip install transformers==4.48.0

주의:transformers 안정적인 모델 성능을 보장하려면 버전 4.48.0을 설치해야 합니다. 다른 종속성을 먼저 설치한 다음, 다른 종속성을 설치하기 위해 transformers 버전으로 변경하여 충돌을 방지하세요.

4. 모델 가중치 다운로드

오디오 리소저-7B 모델은 허깅페이스에서 출시되었으며 다운로드하고 경로를 수동으로 구성해야 합니다:

- 인터뷰 허깅페이스 오디오 리소서-7B를 클릭하고 모델 파일을 다운로드합니다.

- 다운로드한 체크포인트 경로를 코드에 입력합니다.

last_model_checkpoint변수를 예로 들 수 있습니다:

last_model_checkpoint = "/path/to/Audio-Reasoner-7B"

사용 방법

설치 후 사용자는 코드를 통해 오디오 리서처를 실행하여 오디오 작업을 처리할 수 있습니다. 다음은 자세한 작동 가이드입니다:

빠른 시작: 샘플 코드 실행

이 프로젝트는 사용자가 모델 기능을 테스트하는 데 도움이 되는 빠른 시작 예제를 제공합니다:

- 오디오 파일 준비

기본적으로 프로젝트 자체의assets/test.wav파일을 사용하거나 직접 만든 WAV 형식의 오디오로 대체할 수 있습니다. 경로가 올바른지 확인하세요. - 오디오 경로 및 코드 편집의 문제

쇼(티켓)inference.py또는 다음 코드를 사용하여 오디오 경로를 설정하고 질문할 수 있습니다:audiopath = "assets/test.wav" prompt = "这段音频的节奏感和拍子是怎样的?" audioreasoner_gen(audiopath, prompt) - 실행 중인 프로그램

터미널에서 실행합니다:conda activate Audio-Reasoner cd Audio-Reasoner python inference.py모델은 다음을 포함한 구조화된 추론 결과를 출력합니다.

<THINK>(계획, 설명, 추론, 요약) 및<RESPONSE>(최종 답변).

핵심 기능: 오디오 심층 추론

오디오 리서처의 핵심은 연쇄 사고에 기반한 오디오 추론이며, 그 작동 방식은 다음과 같습니다:

- 오디오 입력 및 문제

- 활용

audioreasoner_gen함수를 사용하여 오디오 경로와 특정 질문을 전달합니다. 예시:audiopath = "your_audio.wav" prompt = "音频中是否有鸟叫声?" audioreasoner_gen(audiopath, prompt)

- 활용

- 추론 결과 보기

예를 들어 이 모델은 상세한 추론 프로세스를 반환합니다:<THINK> <PLANNING>: 检查音频中的声音特征,识别是否有鸟叫声。 <CAPTION>: 音频包含自然环境音,可能有风声和动物叫声。 <REASONING>: 分析高频声音特征,与鸟类叫声模式匹配。 <SUMMARY>: 音频中可能存在鸟叫声。 </THINK> <RESPONSE>: 是的,音频中有鸟叫声。 - 출력 매개변수 조정(선택 사항)

더 길거나 유연한 답변이 필요한 경우 수정할 수 있습니다.RequestConfig매개변수:request_config = RequestConfig(max_tokens=4096, temperature=0.5, stream=True)

사전 설정된 샘플의 로컬 테스트

이 프로젝트에는 빠른 검증을 위한 테스트 오디오와 질문이 내장되어 있습니다:

conda activate Audio-Reasoner

cd Audio-Reasoner

python inference.py

실행 후 터미널에 다음과 같은 설명이 표시됩니다. assets/test.wav 분석 결과는 첫 경험에 적합합니다.

기능: 멀티모달 이해

오디오 리서처는 오디오와 텍스트의 공동 분석을 지원합니다. 예시:

prompt = "这段音乐的情绪是否与‘悲伤’描述相符?"

audioreasoner_gen("sad_music.wav", prompt)

이 모델은 오디오 기능과 텍스트 시맨틱을 결합하여 추론 결과를 출력합니다.

주의 사항 및 자주 묻는 질문

- 오디오 형식권장 WAV 형식, 샘플링 속도 16kHz, 모노.

- 느리게 움직이는속도가 느리면 GPU가 활성화되어 있는지 확인하세요(CUDA용 PyTorch 필요).

- 모델이 응답하지 않음모델 경로가 올바른지, 종속성이 완전히 설치되었는지 확인합니다.

- 종속성 충돌설치에 실패하면 새 환경을 만들고 종속성을 엄격한 순서대로 설치해 보세요.

고급 사용

- 사용자 지정 추론 논리수정 :: 수정

system모델의 추론 스타일을 조정하는 큐 단어입니다. - 배치 파일:: Will

max_batch_size다중 오디오 동시 추론을 지원하려면 더 높은 값(예: 128)으로 설정합니다. - CoTA 데이터 세트와 결합향후 CoTA 데이터 세트가 출시되면 추가 학습 또는 모델 미세 조정에 사용할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...