일반 소개

Archon은 개발자 Cole Medin(GitHub 사용자명 coleam00)이 구축한 세계 최초의 "에이전트" 프로젝트로, AI 지능을 자율적으로 구축, 최적화 및 반복하는 데 중점을 둔 오픈 소스 프레임워크입니다. AI 인텔리전스를 자율적으로 구축하고 반복하는 데 중점을 둔 오픈 소스 프레임워크입니다. 개발자를 위한 실용적인 도구이자 지능형 신체 시스템의 진화를 보여주는 교육 플랫폼으로, 현재 V4 버전인 Archon은 완전히 최적화된 Streamlit UI를 사용하여 직관적인 관리 인터페이스를 제공합니다. 파이썬으로 개발된 이 프로젝트는 단순한 지능 생성에서 복잡한 워크플로 협업으로 진화하기 위해 Pydantic AI, LangGraph, Supabase와 같은 기술을 통합하며, Archon은 계획, 피드백 루프, 도메인 지식 통합을 통해 지능형 추론, 지식 임베딩, 확장 가능한 아키텍처라는 현대 AI 개발의 세 가지 원칙을 보여줍니다.

Archon은 다른 인텔리전스 개발 프레임워크의 '기생충'이라고 부르고 싶습니다. Archon은 다른 인텔리전스 개발 프레임워크를 구축하고 최적화할 수 있지만 그 자체로도 하나의 인텔리전스입니다.

기능 목록

- 지능형 바디 자동 생성사용자 입력 요구 사항에 따라 맞춤형 AI 인텔리전스 본문 코드를 생성합니다.

- 문서 크롤링 및 인덱싱Pydantic AI와 같은 문서를 크롤링하고 벡터 임베딩을 생성하여 Supabase에 저장합니다.

- RAG 시스템 지원검색 강화 생성 기술을 활용하여 정확한 코드 제안 및 최적화를 제공합니다.

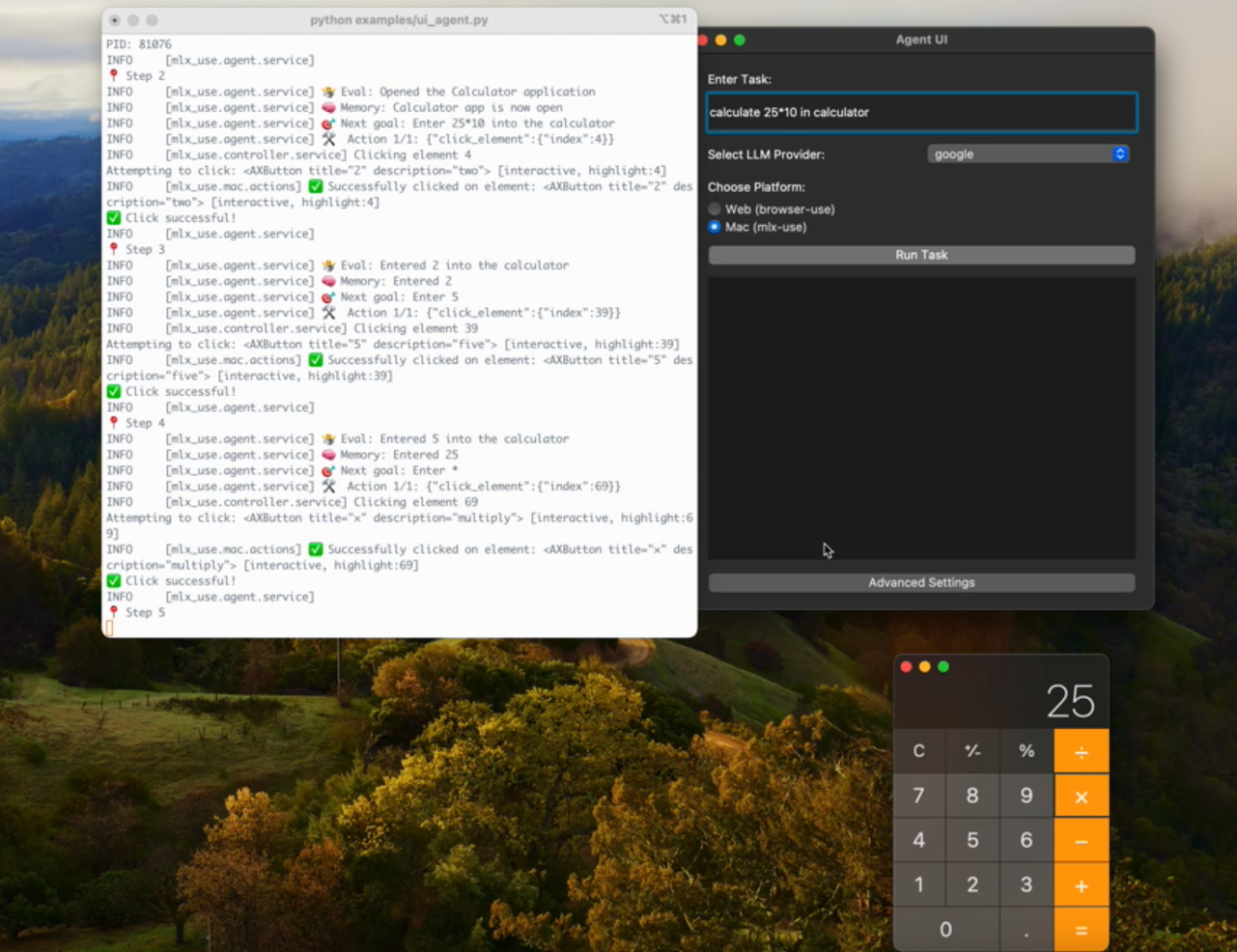

- 간소화된 UI 관리시각적 인터페이스를 통해 환경 변수, 데이터베이스, 지능형 바디 서비스를 구성할 수 있습니다.

- 다중 지능 협업기준 LangGraph 추론, 코딩 및 작업 라우팅을 위한 조정된 워크플로우를 지원합니다.

- 로컬 및 클라우드 호환OpenAI, Anthropic, OpenRouter API 또는 네이티브 지원 Ollama 모델.

- 도커 컨테이너형 배포기본 컨테이너를 제공하고 MCP 프로덕션 환경을 즉시 사용할 수 있는 컨테이너를 제공합니다.

- MCP 통합파일 및 종속성 관리를 위해 AI IDE(예: Windsurf, Cursor)와의 통합을 지원합니다.

- 커뮤니티 지원oTTomator 싱크탱크 포럼을 통해 사용자 소통을 위한 플랫폼을 제공합니다.

도움말 사용

Archon은 사용자가 인공지능을 빠르게 개발하고 관리할 수 있도록 설계된 풍부한 기능의 오픈 소스 프레임워크입니다. 자세한 설치 및 사용 가이드를 통해 쉽게 시작할 수 있습니다.

설치 프로세스

Archon V4는 Docker(권장)와 로컬 Python 설치의 두 가지 설치 방법을 지원합니다. 단계는 다음과 같습니다:

방법 1: 도커 설치(권장)

- 환경 준비하기

- Docker와 Git이 설치되어 있는지 확인합니다.

- Supabase 계정을 만듭니다(벡터 데이터베이스용).

- OpenAI/Anthropic/OpenRouter API 키를 준비하거나 로컬에서 Ollama를 실행합니다.

- 클론 창고

터미널에서 실행됩니다:git clone https://github.com/coleam00/archon.git cd archon

- Docker 스크립트 실행

다음 명령을 실행하여 컨테이너를 빌드하고 시작합니다:python run_docker.py- 스크립트는 자동으로 두 개의 컨테이너, 즉 기본 Archon 컨테이너(Streamlit UI 및 그래프 서비스를 실행하는)와 MCP 컨테이너(AI IDE 통합을 지원하는)를 빌드합니다.

- 있는 경우

.env파일을 실행하면 환경 변수가 자동으로 로드됩니다.

- 액세스 인터페이스

브라우저를 열고 다음 사이트를 방문하세요.http://localhost:8501를 클릭해 스트림릿 UI에 액세스합니다.

방법 2: 로컬 Python 설치

- 환경 준비하기

- Python 3.11 이상이 설치되어 있는지 확인합니다.

- Supabase 계정과 API 키를 받습니다.

- 클론 창고

git clone https://github.com/coleam00/archon.git cd archon - 가상 환경 만들기 및 종속성 설치하기

python -m venv venv source venv/bin/activate # Windows: venv\Scripts\activate pip install -r requirements.txt - 스트림라이트 UI 실행

streamlit run streamlit_ui.py - 액세스 인터페이스

브라우저를 열고 다음 사이트를 방문하세요.http://localhost:8501.

환경 변수 구성

Docker 또는 로컬 설치를 처음 실행하는 경우 환경 변수를 구성해야 합니다. 환경 변수를 설정하려면 .env 파일에 샘플 콘텐츠가 포함되어 있습니다:

OPENAI_API_KEY=your_openai_api_key

SUPABASE_URL=your_supabase_url

SUPABASE_SERVICE_KEY=your_supabase_service_key

PRIMARY_MODEL=gpt-4o-mini

REASONER_MODEL=o3-mini

이 정보는 Supabase 대시보드와 API 제공업체에서 확인할 수 있습니다.

기능 작동 흐름

설치가 완료되면 Streamlit UI는 설정 및 사용 과정을 단계별로 안내하는 5가지 주요 기능 모듈을 제공합니다.

1. 환경

- 절차::

- '환경' 탭으로 이동합니다.

- API 키(예: OpenAI 또는 OpenRouter)와 모델 설정(예.

gpt-4o-mini). - "저장"을 클릭하면 구성이 다음과 같이 저장됩니다.

env_vars.json.

- 다음 사항에 유의하십시오.로컬 Ollama를 사용하는 경우 서비스가

localhost:11434UI 스트리밍은 OpenAI에서만 지원됩니다.

2. 데이터베이스 설정(데이터베이스)

- 절차::

- '데이터베이스' 탭으로 이동합니다.

- Supabase URL과 서비스 키를 입력합니다.

- '데이터베이스 초기화'를 클릭하면 시스템이 자동으로 데이터베이스를 생성합니다.

site_pages표. - 연결 상태를 확인하여 성공 여부를 확인합니다.

- 테이블 구조::

CREATE TABLE site_pages ( id UUID PRIMARY KEY DEFAULT uuid_generate_v4(), url TEXT, chunk_number INTEGER, title TEXT, summary TEXT, content TEXT, metadata JSONB, embedding VECTOR(1536) );

3. 문서 크롤링 및 색인 생성(문서)

- 절차::

- '문서' 탭으로 이동합니다.

- 대상 문서 URL을 입력합니다(예: Pydantic AI 문서).

- "크롤링 시작"을 클릭하면 시스템이 문서를 청크 처리하고 임베드를 생성하여 Supabase에 저장합니다.

- 인덱싱이 완료되면 UI에서 인덱싱 진행 상황을 확인할 수 있습니다.

- 사용: for RAG 이 시스템은 지식창고를 제공합니다.

4. 지능형 바디 서비스(에이전트 서비스)

- 절차::

- '상담원 서비스' 탭으로 이동합니다.

- 서비스 시작을 클릭하여 LangGraph 워크플로를 실행합니다.

- 로그를 통해 서비스 상태를 모니터링하세요.

- 기능지능 생성의 핵심 로직이 제대로 작동하도록 추론, 코딩 및 작업 라우팅을 조정합니다.

5. 스마트 바디 만들기(채팅)

- 절차::

- '채팅' 탭으로 이동합니다.

- "JSON 파일을 분석하는 인텔리전스 생성"과 같은 요구 사항을 입력합니다.

- 이 시스템은 RAG 시스템에서 검색한 지식을 결합하여 코드를 생성하고 표시합니다.

- 코드를 복사하여 로컬에서 실행하거나 서비스를 통해 배포하세요.

- 일반적인 예::

입력: '실시간 날씨를 쿼리하는 스마트 바디 생성'.

출력 예시:from pydantic_ai import Agent, OpenAIModel agent = Agent(OpenAIModel("gpt-4o-mini"), system_prompt="查询实时天气") result = agent.run("获取北京今天的天气") print(result.data)

선택 사항: MCP 구성

- 절차::

- 'MCP' 탭으로 이동합니다.

- Cursor와 같은 AI IDE와의 통합을 구성합니다.

- MCP 컨테이너를 시작하고 그래프 서비스에 연결합니다.

- 사용스마트바디 코드용 IDE에서 자동화된 파일 생성 및 종속성 관리를 지원합니다.

사용 예

"로그 분석 인텔리전스"를 개발한다고 가정해 보겠습니다:

- Chat에서 "Nginx 로그를 구문 분석하는 Pydantic AI 인텔리전스 생성"을 입력합니다.

- Archon은 관련 문서를 검색하고 코드를 생성합니다:

from pydantic_ai import Agent, OpenAIModel

agent = Agent(OpenAIModel("gpt-4o-mini"), system_prompt="解析Nginx日志")

result = agent.run("分析access.log并提取IP地址")

print(result.data)

- 코드를 로컬에 저장하고 실행하기 전에 API 키를 구성해야 합니다.

주의

- 모델 호환성OpenAI만 Streamlit UI에서 스트리밍 출력을 지원하며, 다른 모델(예: Ollama)은 비스트리밍만 지원합니다.

- 네트워크 요구 사항문서를 크롤링하고 API를 호출하려면 안정적인 네트워크가 필요합니다.

- 테스트 중 구성 요소 조정문제가 발생하면 UI 로그 또는 터미널 출력을 확인하세요.

이러한 단계를 통해 학습과 실제 개발 모두에서 AI 인텔리전스를 빠르게 생성하고 관리할 수 있는 Archon의 기능을 최대한 활용할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...