Dify 설치 및 Ollama 및 Xinference 통합

이 문서에서는 Docker를 통해 Dify를 설치한 다음 통합하는 방법에 대해 설명합니다. Ollama 및 XInference를 사용하고 Dify 지식창고 퀴즈 기반 애플리케이션을 빠르게 구축하세요.

- I. Dify 소개

- 설치 다변화

- Dify, 올라마 모델 Q&A 추가

- 지식 기반 기반 퀴즈 다변화

- V. 문서 링크

I. Dify 소개

Dify 는 개발자가 제너레이티브 AI 애플리케이션을 빠르게 구축하고 배포할 수 있도록 설계된 오픈 소스 LLM(대규모 언어 모델링) 애플리케이션 개발 플랫폼입니다. 다음은 Dify의 주요 특징과 기능입니다[1]:

- 서비스형 백엔드와 LLMOps 개념의 융합 Dify는 서비스형 백엔드와 LLMOps의 개념을 결합하여 개발자가 프로덕션급 제너레이티브 AI 애플리케이션을 빠르게 구축할 수 있도록 지원합니다.

- 여러 모델 지원 Dify는 여러 추론 제공업체 및 자체 호스팅 솔루션의 모델을 원활하게 통합하여 GPT, Mistral, Llama3 등을 포함한 수백 개의 독점 및 오픈 소스 LLM 모델을 지원합니다.

- 직관적인 프롬프트 오케스트레이션 인터페이스 Dify는 프롬프트 작성, 모델 성능 비교, 채팅 기반 애플리케이션에 음성 변환과 같은 추가 기능 추가를 위한 직관적인 프롬프트 IDE를 제공합니다.

- 고품질 RAG 엔진 Dify는 다양한 RAG 문서 수집부터 검색까지 모든 기능을 다루며 PDF, PPT 등과 같은 일반적인 문서 형식에서 텍스트 추출을 지원합니다.

- 에이전트 프레임워크 통합 사용자는 LLM 함수 호출을 기반으로 하거나 ReAct 에이전트를 정의하고 미리 빌드된 도구 또는 사용자 지정 도구를 추가하세요.Dify는 Google Search, DELL-E, Stable Diffusion 및 WolframAlpha와 같은 50개 이상의 기본 제공 도구를 제공합니다.

- 유연한 프로세스 구성 Dify는 강력한 AI 워크플로를 구축하고 테스트할 수 있는 강력한 시각적 캔버스를 제공하여 개발자가 직관적으로 AI 프로세스를 설계하고 최적화할 수 있도록 지원합니다.

- 종합적인 모니터링 및 분석 도구 Dify는 애플리케이션 로그와 성능을 모니터링하고 분석하는 도구를 제공하며, 개발자는 프로덕션 데이터와 주석을 기반으로 힌트, 데이터 세트 및 모델을 지속적으로 개선할 수 있습니다.

- 서비스형 백엔드 Dify의 모든 기능은 API와 함께 제공되므로 자체 비즈니스 로직에 Dify를 쉽게 통합할 수 있습니다.

설치 다변화

Dify Github 코드를 로컬에 복사합니다[2].

git clone https://github.com/langgenius/dify.git

diffy 소스 코드의 docker 디렉토리로 이동하여 환경 변수를 복사합니다.

cd dify/docker

cp .env.example .env

도커 컴포즈를 통해 애플리케이션을 설치합니다.

docker compose up -d

올라마 컨테이너에 들어가서qwen2:7b모델.

root@ip-172-31-30-167:~/dify/docker# docker pull ollama/ollama

root@ip-172-31-83-158:~/dify/docker# docker run -d --gpus=all -v ollama:/root/.ollama -p 11434:11434 --name ollama --restart always -e OLLAMA_KEEP_ALIVE=-1 ollama/ollama

root@ip-172-31-83-158:~/dify/docker# docker exec -it ollama bash

root@b094349fc98c:/# ollama run qwen2:7b

Dify, 올라마 모델 Q&A 추가

EC2의 공용 IP 주소와 포트 80을 통해 Dify 홈페이지에 로그인하고 관리자 계정을 생성합니다.

관리자 계정을 통해 로그인합니다.

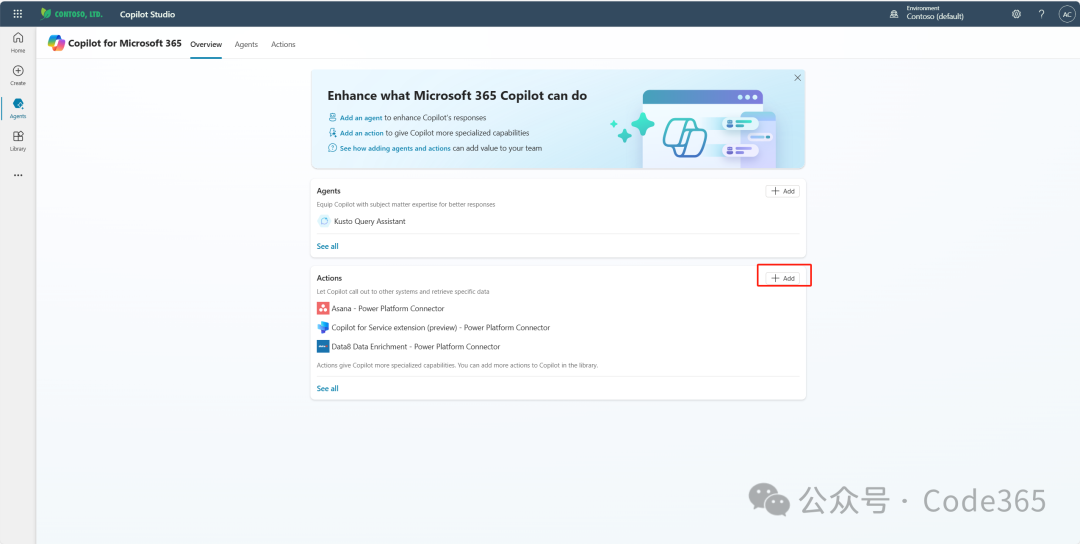

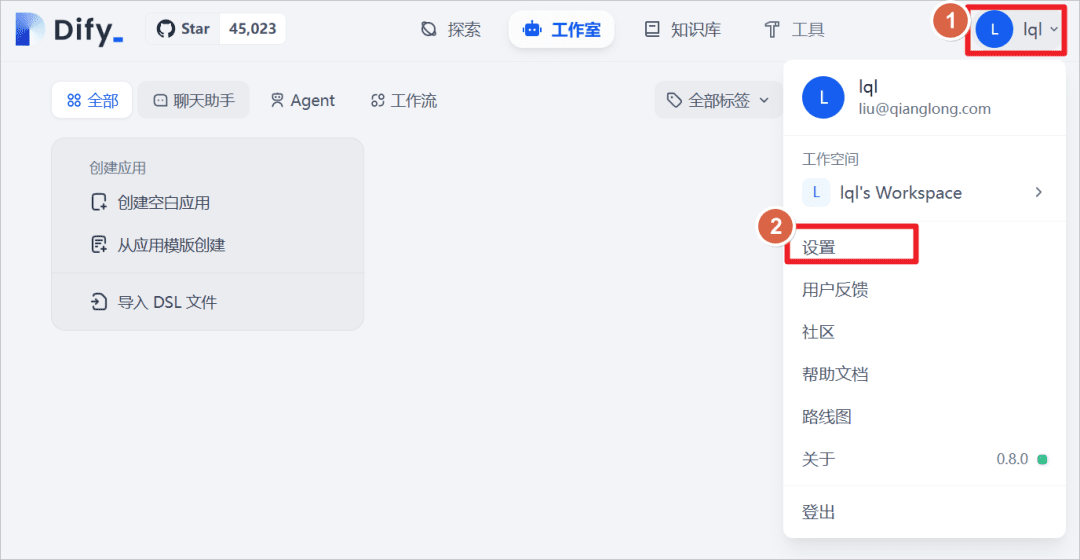

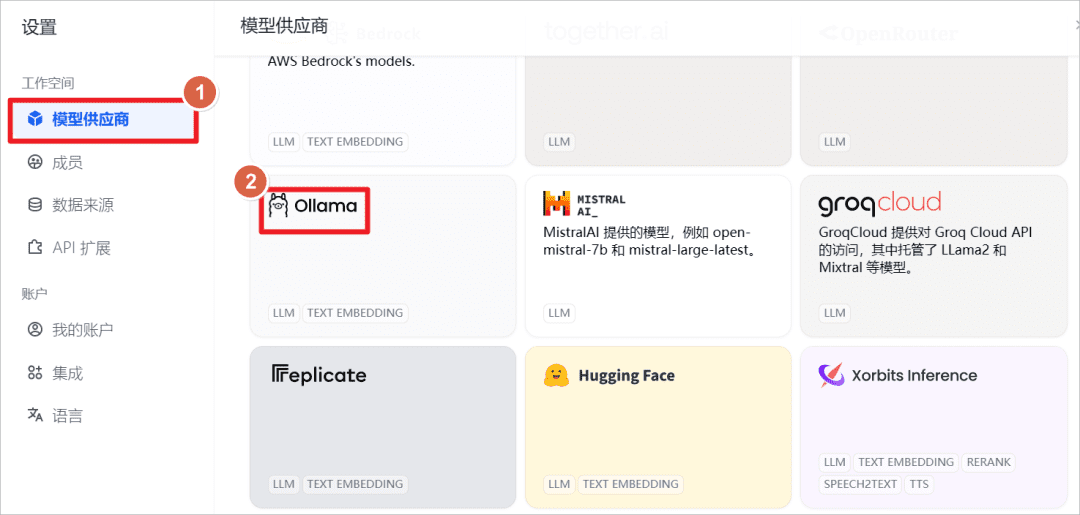

사용자 - 설정을 클릭합니다.

올라마 모델을 추가합니다.

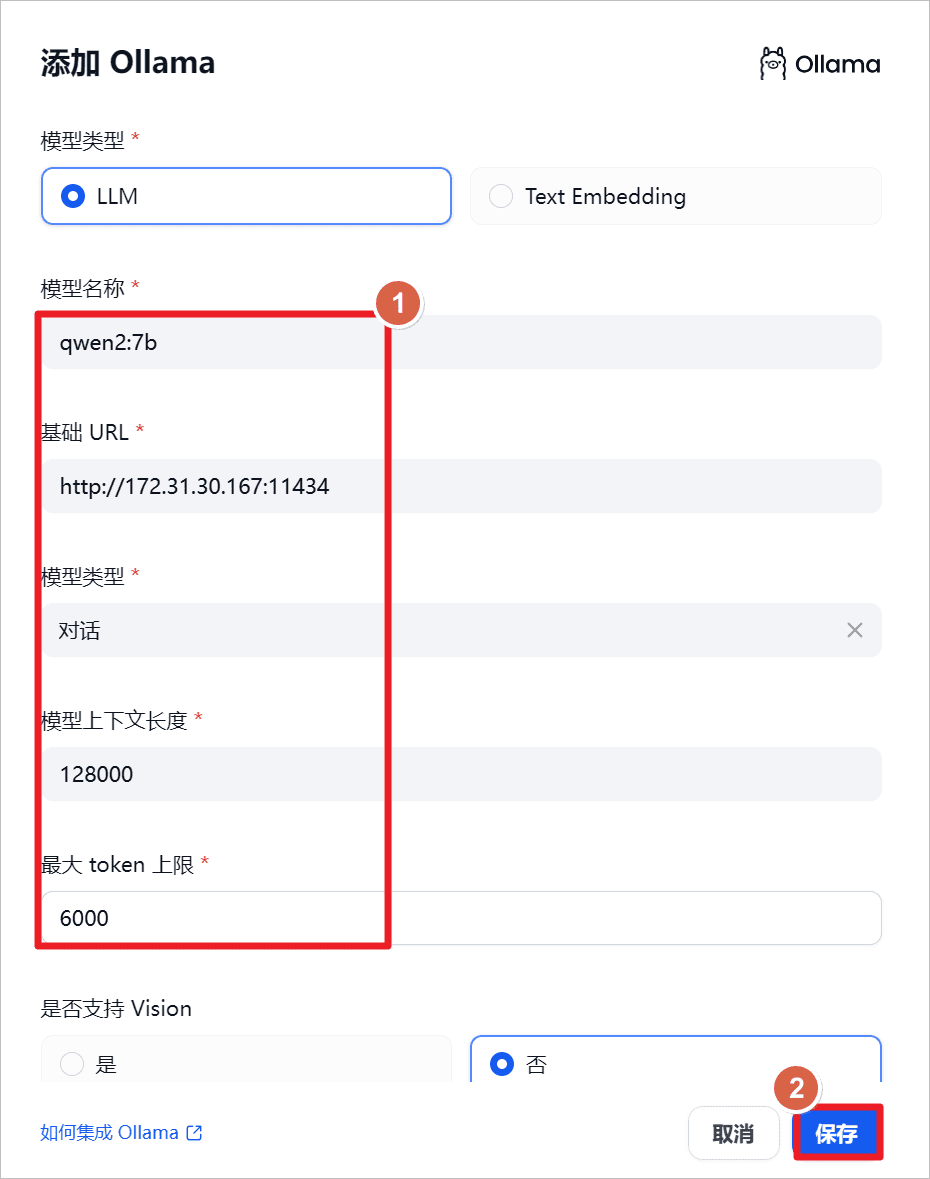

증가qwen2:7b모델의 경우, 올라마가 로컬에서 시작되므로 URL을 로컬 IP 주소로 설정하고 포트를114341(수학.) 속

"qwen2-7b-instruct는 증강 모델 길이 추정 기술인 YARN을 사용하여 131,072개의 컨텍스트 토큰을 지원하며, 정상적인 사용과 적절한 출력을 보장하기 위해 API에서 사용자 입력을 128,000개로, 출력을 최대 6,144개로 제한하는 것이 좋습니다."[3].

"

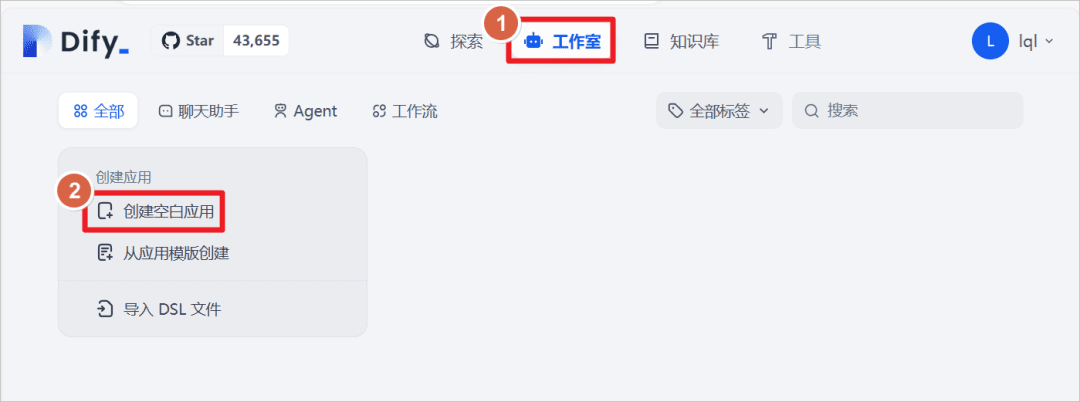

스튜디오 - 빈 애플리케이션 만들기를 클릭합니다.

"채팅 도우미" 유형의 애플리케이션을 만들고 애플리케이션 이름을Qwen2-7B를 클릭하고 만들기를 클릭합니다.

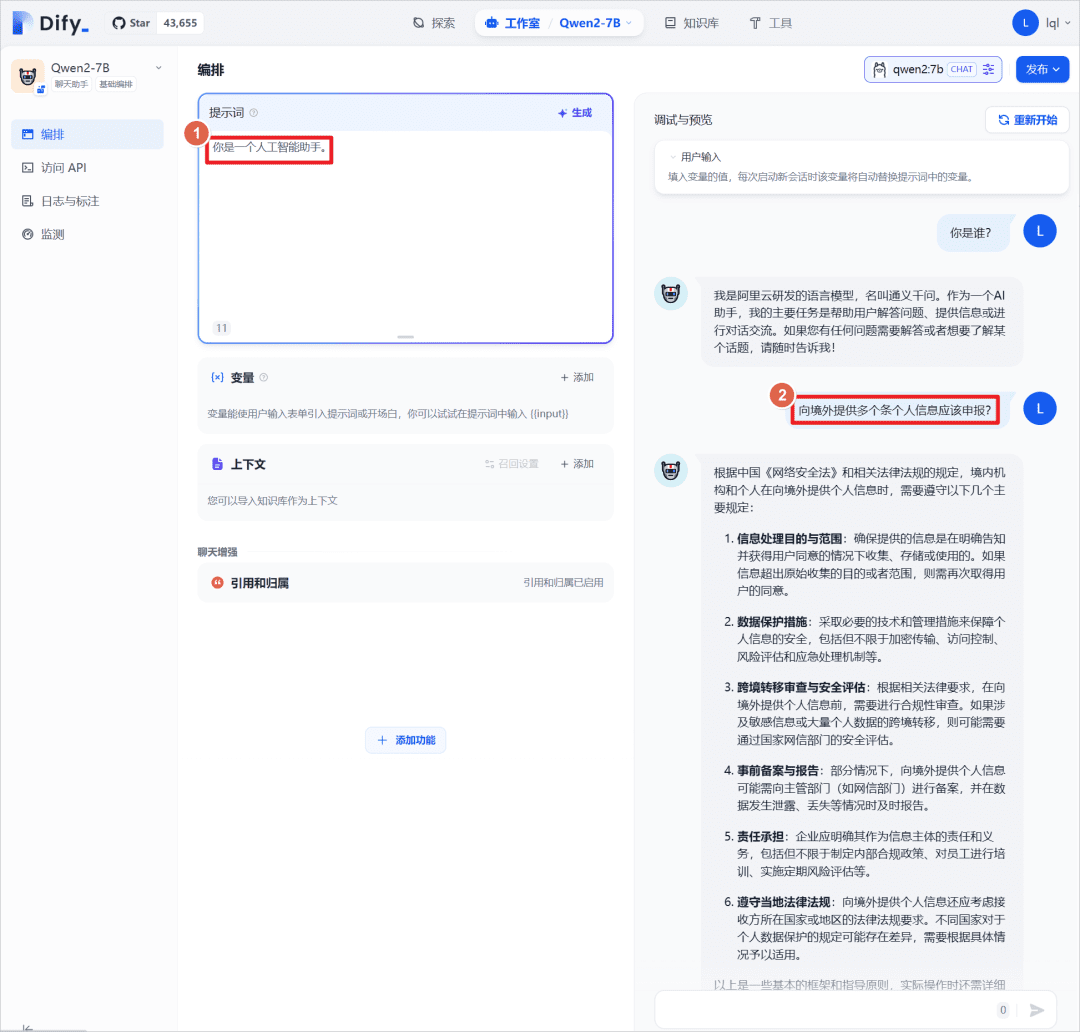

앱에 "당신은 AI 어시스턴트입니다"라는 메시지를 설정하는 것은Qwen2:7B여기서는 외부 지식 기반을 도입하지 않고 빅 모델 자체로 대화 테스트를 수행하며, 나중에 답변 결과를 비교하기 위해 소개할 것입니다.

지식 기반 기반 퀴즈 다변화

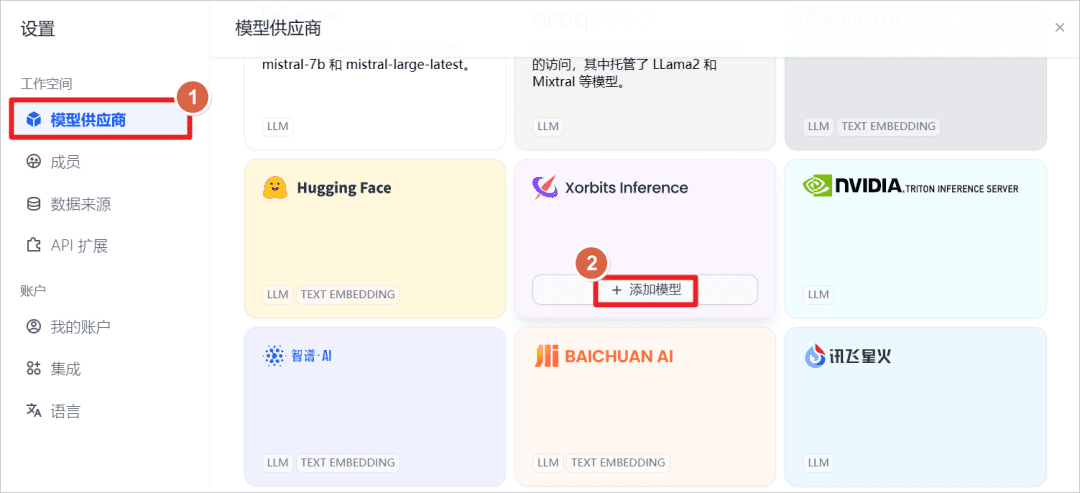

증가Xorbits Inference제공된 모델.

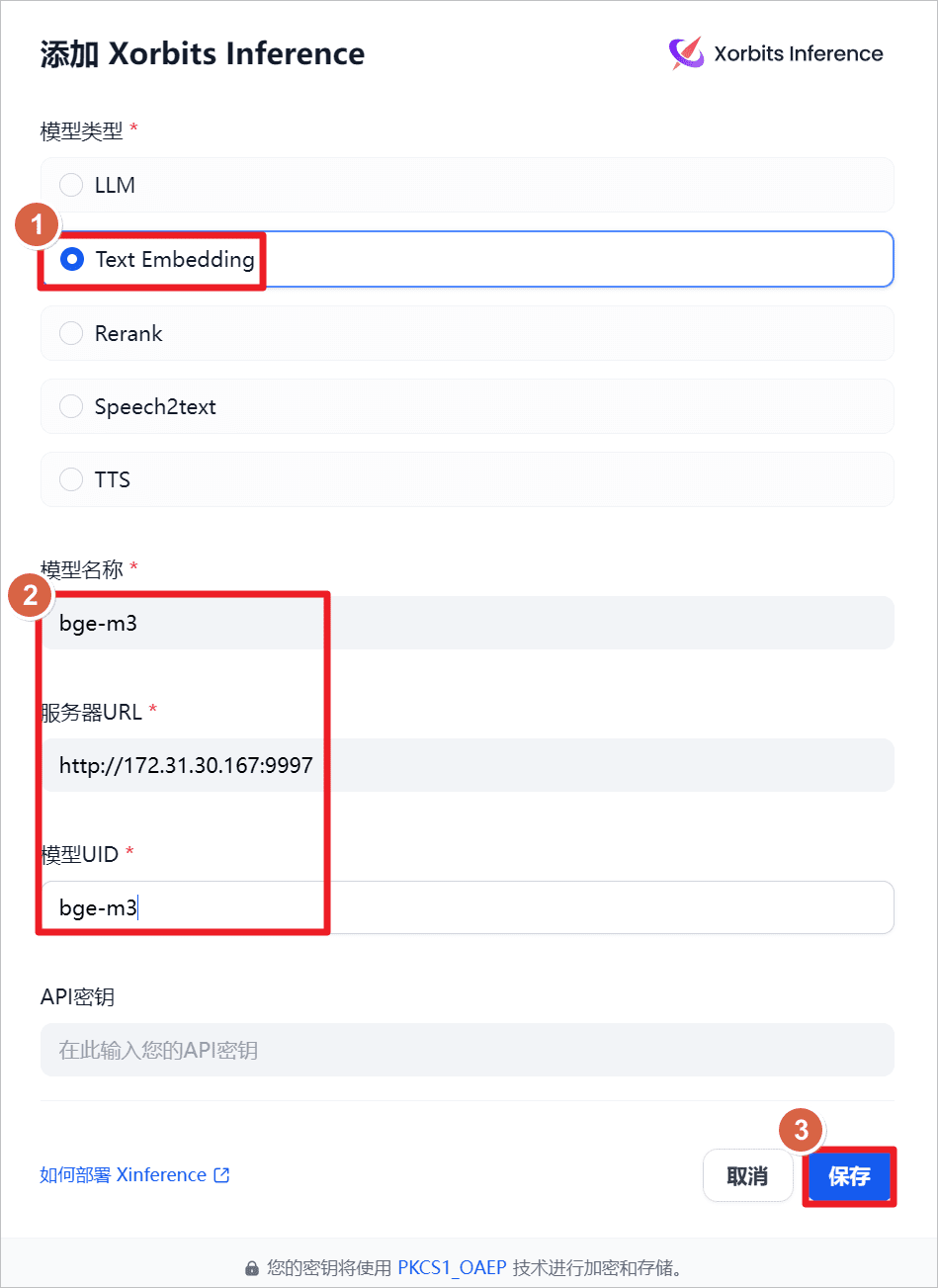

증가Text Embedding즉, 텍스트 임베딩 모델인 경우 모델 이름은bge-m3서버 URL은 다음과 같습니다.http://172.31.30.167:9997(여기서는 로컬 머신의 IP이며, 다른 머신에도 설치할 수 있고, 네트워크와 포트에 연결할 수 있으면 충분함), 로컬 머신에서 미리 XInference를 시작하고, 로컬 머신에서 실행 중인bge-m3모델(이전 게시물 참조).

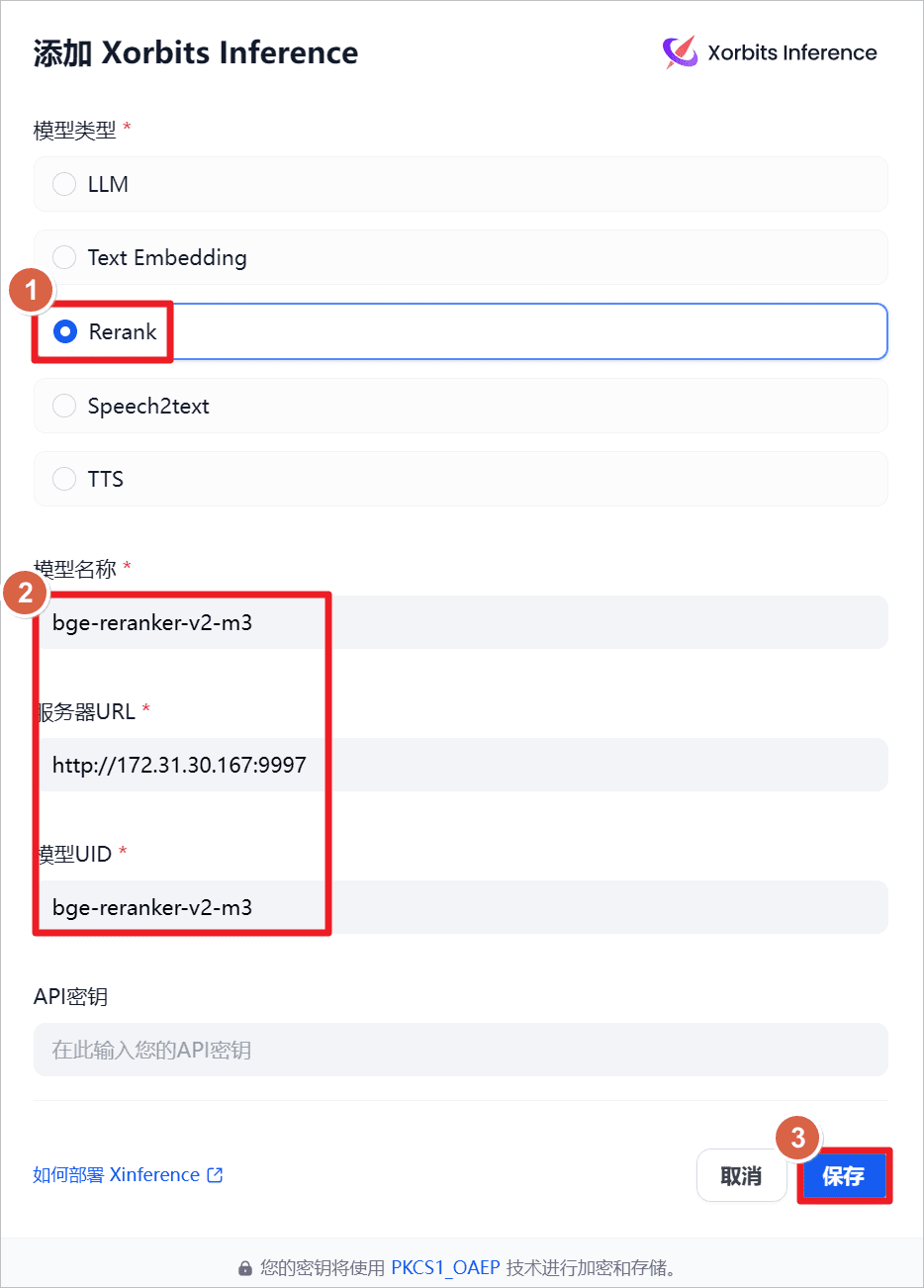

증가Rerank즉, 재배치 모델인 경우 모델 이름은bge-reraker-v2-m3서버 URL은 다음과 같습니다.http://172.31.30.167:9997(여기서는 로컬 머신의 IP이며, 다른 머신에도 설치할 수 있고, 네트워크와 포트에 연결할 수 있으면 충분함), 로컬 머신에서 미리 XInference를 시작하고, 로컬 머신에서 실행 중인bge-reraker-v2-m3모델(이전 게시물 참조).

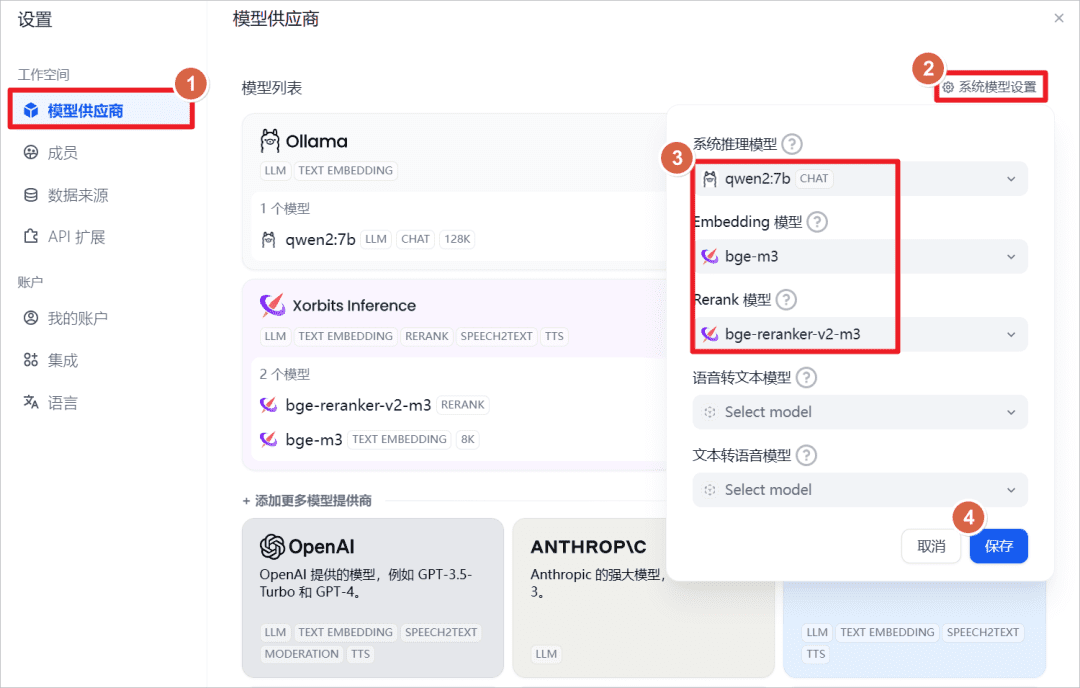

시스템 기본 설정을 확인합니다.

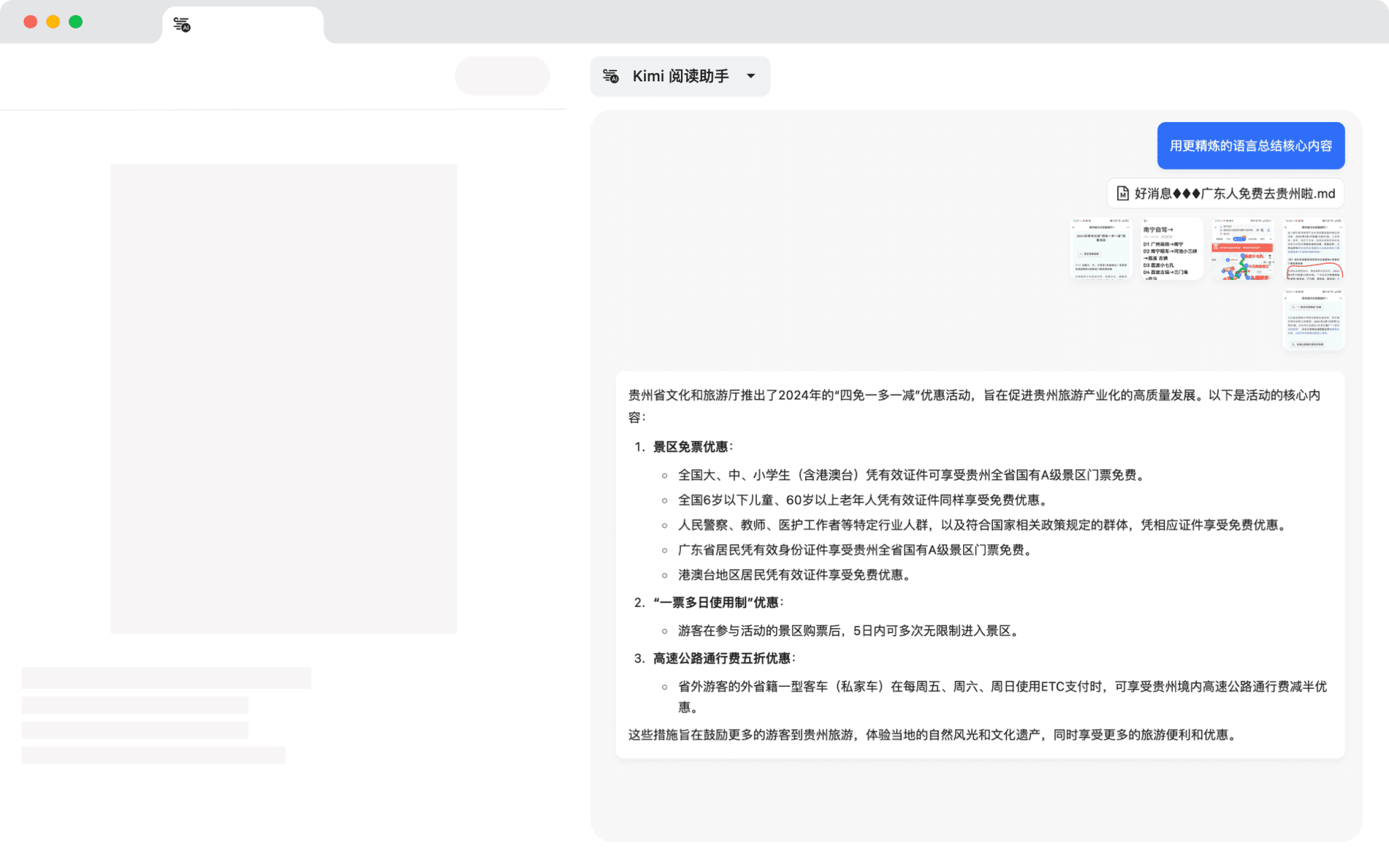

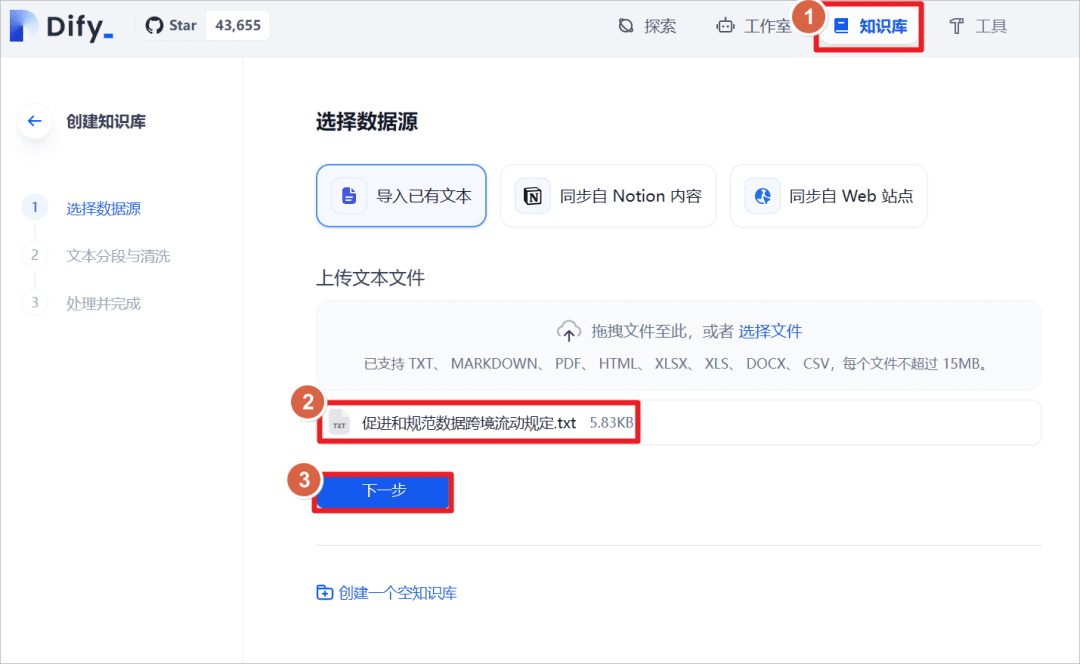

'지식 기반' - '기존 텍스트 가져오기' - '텍스트 파일 업로드'를 클릭하고 '데이터의 국경 간 흐름 촉진 및 규제에 관한 조항' 문서를 선택합니다.

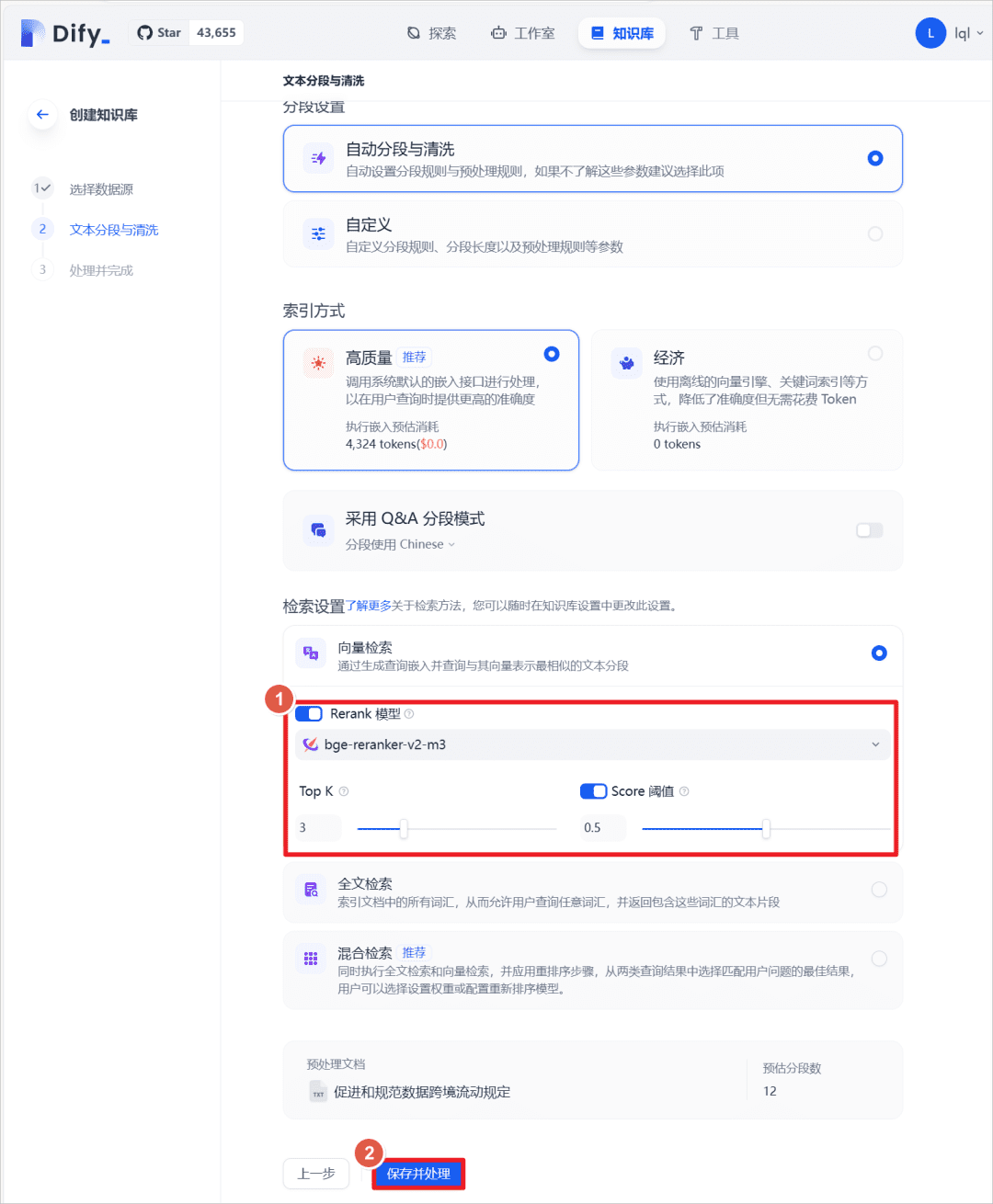

가져오기에 성공한 후 텍스트 검색 방법을 설정하고Rerank모델을 선택하고bge-reranker-v2-m3모델을 사용하려면 기본Score임계값은 0.5입니다(즉, 0.5 미만의 텍스트 일치 항목은 리콜되지 않으며 더 큰 모델의 컨텍스트에 추가되지 않습니다).

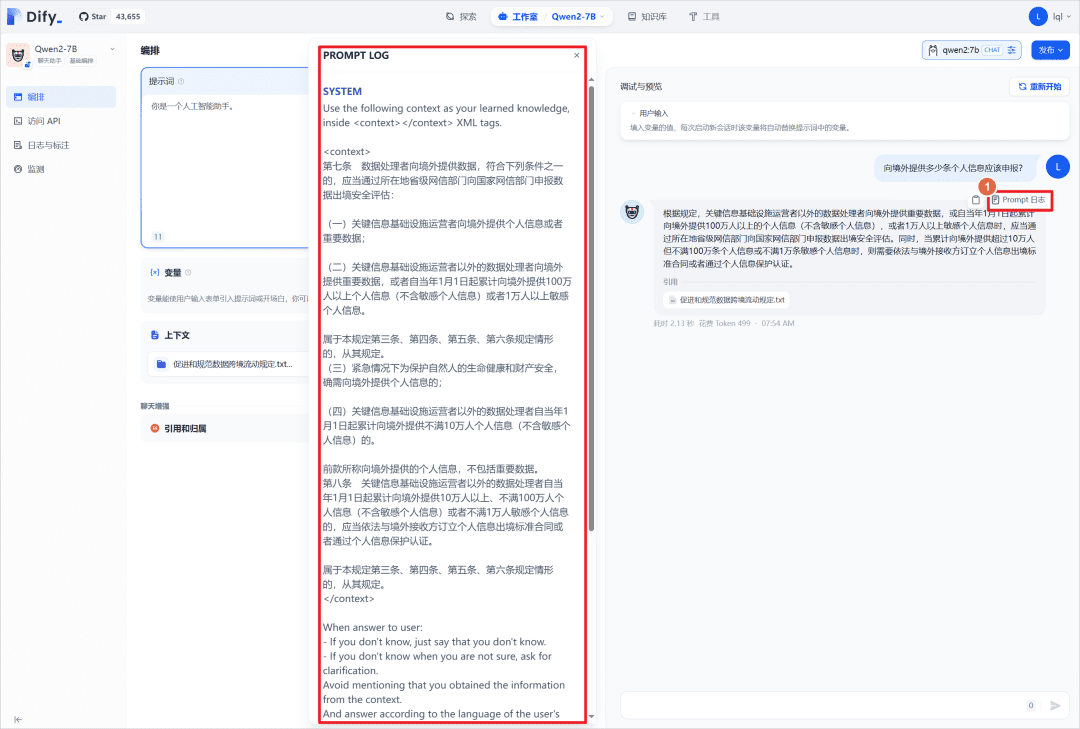

이전 채팅 애플리케이션에서 위에서 만든 지식창고를 추가하고 더 큰 모델에 동일한 질문을 다시 하면 모델이 지식창고와 함께 답변한 것을 볼 수 있습니다.

"프롬프트 로그"를 클릭하여 로그 파일을 보면 시스템 프롬프트를 볼 수 있으며, 일치하는 지식창고 콘텐츠를<context></context>가운데.

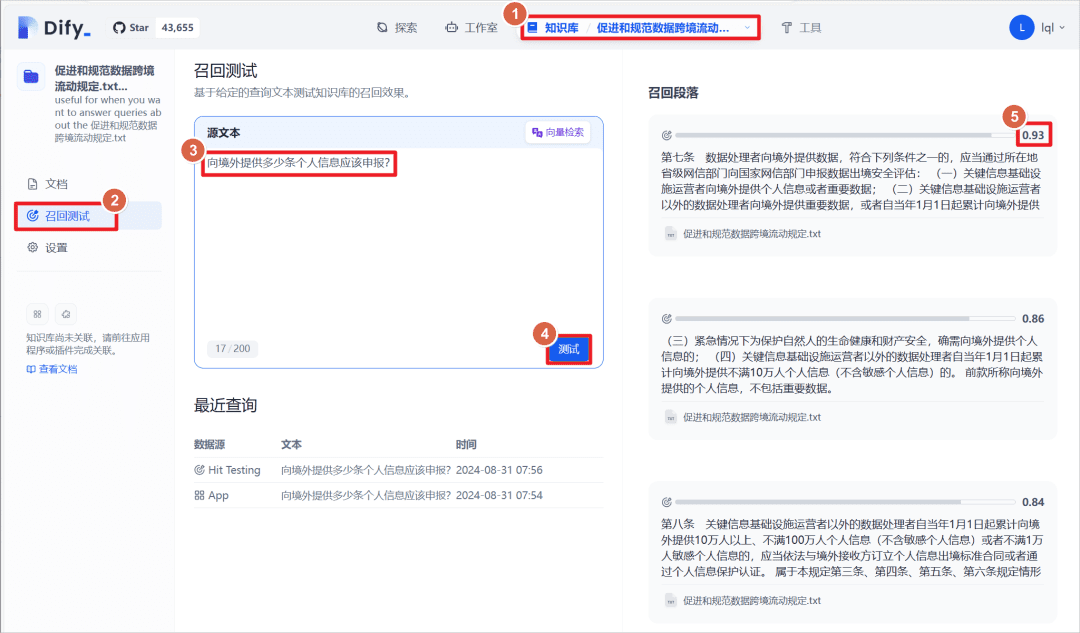

생성 된 지식창고를 클릭하고 "리콜 테스트"를 클릭하면 지식창고의 텍스트와 일치하는 텍스트와 일치하는 텍스트 단락을 입력 할 수 있으며 일치하는 텍스트에는 가중치가 있으며 위에 설정된 임계 값은 0.5이며, 즉이 점수보다 크면 "리콜 단락"으로 표시됩니다. ".

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...